Anmerkung des Autors: Eine tiefgehende Analyse der Text-Rendering-Fähigkeiten von GPT-image-2 und Nano Banana Pro in Szenarien wie wissenschaftlichen Paradigmen-Diagrammen, technischen Schaubildern und Bildern mit kleingedrucktem Text, inklusive konkreter Empfehlungen für die Modellauswahl.

Der Vergleich zwischen GPT-image-2 und Nano Banana Pro ist für Wissenschaftler, Technik-Blogger und Content-Ersteller ein wichtiges Thema. Dieser Artikel vergleicht GPT-image-2 (gpt-image-1-2025) und Nano Banana Pro (Gemini 3 Pro Image) und gibt klare Empfehlungen für Bereiche wie wissenschaftliche Paradigmen-Diagramme, Diagramme mit kleingedrucktem Text, die Darstellung von Fachbegriffen und technische Architekturdiagramme.

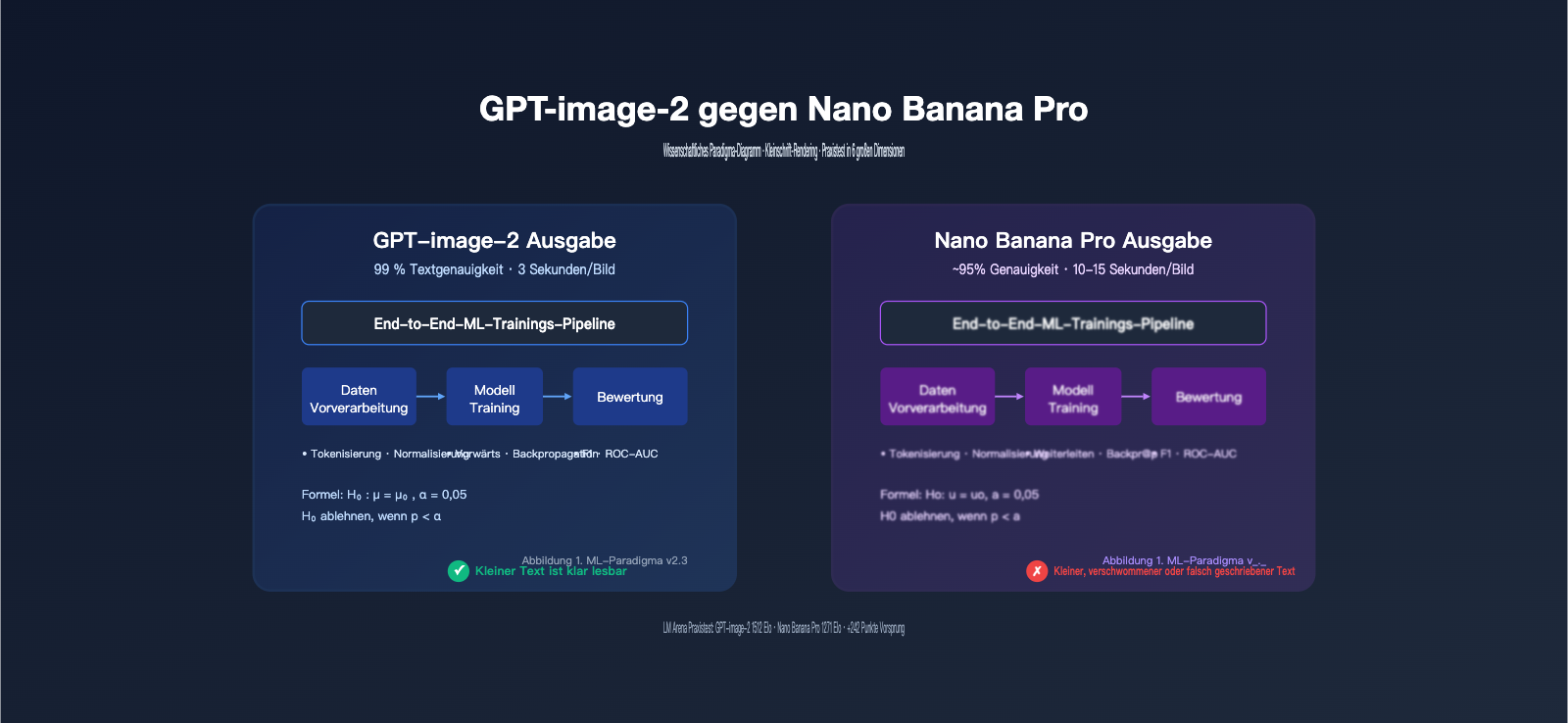

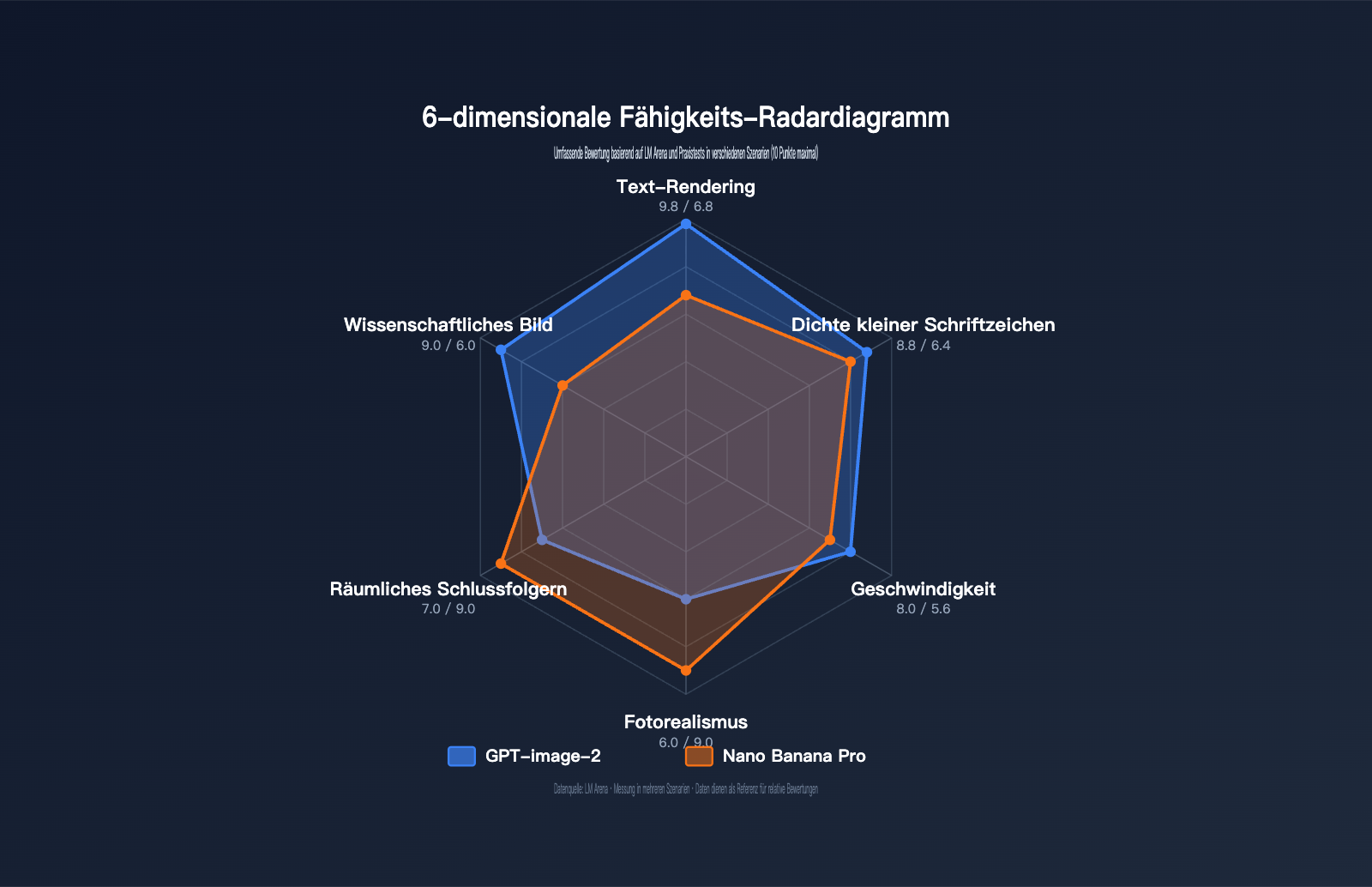

Dies ist keine "beide haben ihre Vorzüge"-Kompromissanalyse. Die Daten der LM Arena zeigen mit einem Vorsprung von +242 Elo-Punkten (GPT-image-2: 1512 vs. Nano Banana Pro: 1271) einen deutlichen Unterschied. Viele Nutzer wissen jedoch nicht, in welchen Szenarien sich dieser Unterschied konkret bemerkbar macht. Dieser Artikel konzentriert sich auf das oft unterschätzte Kernszenario "hohe Textdichte und wissenschaftliche Diagramme" und liefert reproduzierbare Testergebnisse.

Kernnutzen: Nach der Lektüre dieses Artikels wissen Sie genau, wie Sie sich bei wissenschaftlichen Paradigmen-Diagrammen, technischen Architekturdiagrammen, Grafiken mit kleinen deutsch- oder englischsprachigen Beschriftungen sowie Diagrammen mit Fachbegriffen zwischen GPT-image-2 und Nano Banana Pro entscheiden sollten.

Kernunterschiede zwischen GPT-image-2 und Nano Banana Pro

Bevor wir tief in die spezifischen Einsatzszenarien eintauchen, veranschaulicht diese Tabelle die Unterschiede in den Kernkompetenzen beider Modelle.

| Vergleichsdimension | GPT-image-2 | Nano Banana Pro | Gewinner |

|---|---|---|---|

| Genauigkeit der Textwiedergabe | ~99 % (Latein/CJK/Hindi/Bengali) | ~95 % (stark bei Phrasen/Wörtern, schwach bei langen Absätzen) | GPT-image-2 |

| Kleinschrift & kompaktes Layout | Kleine Schrift bei 2K-Auflösung klar | Gut lesbar bei langen Texten, aber Kleinschrift oft unscharf | GPT-image-2 |

| Wissenschaftliche Diagramme | Beschriftungen, Formeln, Prozessschritte klar | Gutes Layout, aber Fehleranfälligkeit bei Fachbegriffen | GPT-image-2 |

| Fotorealismus | Tendenz zu Illustrationen/UI-Stil | Branchenführender Fotorealismus | Nano Banana Pro |

| Räumliches Schlussfolgern | Noch ausbaufähig | Stabile Verarbeitung von Objektbeziehungen | Nano Banana Pro |

| Generierungsgeschwindigkeit | ~3 Sek./Bild | 10-15 Sek./Bild | GPT-image-2 |

| Maximale Auflösung | 2K (~2048×2048) | 4K (5632×3072) | Nano Banana Pro |

| Kernmechanismus | O-Serie-Logik (Thinking) | Google Search Grounding | Ausgeglichen |

| LM Arena Elo | 1512 | 1271 | GPT-image-2 (+242) |

| Verfügbare Plattformen | APIYI apiyi.com, offiziell OpenAI | APIYI apiyi.com, Google AI Studio | – |

Detaillierte Stärken von GPT-image-2 bei der Textdarstellung

GPT-image-2 ist das am 21.04.2026 von OpenAI veröffentlichte Bilderzeugungsmodell der nächsten Generation (interner Codename: gpt-image-1-2025). Der entscheidende Durchbruch basiert auf drei architektonischen Upgrades: Erstens die Einführung der O-Serie-Logik (Thinking), die vor der Erstellung Komposition plant, Objektzählungen prüft und Eingabeaufforderungen validiert; zweitens die Steigerung der Textwiedergabe von 95 % bei GPT Image 1.5 auf über 99 % (gemessen via LM Arena); drittens die Aufrechterhaltung der Lesbarkeit von Kleinschrift, Symbolen, UI-Elementen und komplexen Layouts bei 2K-Auflösung.

Für Szenarien wie wissenschaftliche Diagramme mit hoher Textdichte, vielen Fachbegriffen und präzisen Beschriftungen ist der Vorteil von GPT-image-2 struktureller Natur und keine bloße graduelle Verbesserung. Es kann griechische Buchstaben, chemische Formeln, statistische Formeln und Prozessbeschriftungen stabil darstellen – genau die Bereiche, in denen Nano Banana Pro noch Schwierigkeiten hat.

Detaillierte Stärken von Nano Banana Pro bei der Textdarstellung

Nano Banana Pro (Gemini 3 Pro Image) wurde am 20.11.2025 von Google DeepMind veröffentlicht und basiert auf der Gemini 3 Pro-Architektur. Seine Stärken liegen auf einem anderen Pfad: kohärente längere Texte, Lokalisierung für verschiedene Sprachen und das mittels Google Search durchgeführte Grounding (Bilderzeugung basierend auf verifizierten Informationen).

In Szenarien wie Infografiken mit längeren Textpassagen, Postern oder Marketingmaterialien mit standardmäßigen Schriftgrößen ist Nano Banana Pro weiterhin sehr zuverlässig. Sobald jedoch wissenschaftliche Diagramme, Schaltpläne, Achsenbeschriftungen oder mathematische Formeln mit hochdichtem Kleindruck erforderlich sind, fällt die Leistung ab.

🎯 Kurze Empfehlung: Wenn sich Ihre Anforderungen auf technische Diagramme mit vielen kleinen Texten, Fachbegriffen und Formelbeschriftungen konzentrieren, wählen Sie bevorzugt GPT-image-2. Wenn Ihr Bedarf bei zusammenhängenden Fließtexten und fotorealistischen Ergebnissen liegt, ist Nano Banana Pro weiterhin eine exzellente Wahl. Beide Modelle können über die APIYI-Plattform (apiyi.com) über dieselbe Schnittstelle aufgerufen werden, was einen schnellen Vergleich und Wechsel ermöglicht.

Praxistest: GPT-image-2 vs. Nano Banana Pro bei wissenschaftlichen Paradigmen-Diagrammen

Ein wissenschaftliches Paradigmen-Diagramm (Research Paradigm Diagram) umfasst in der Regel: hierarchische Strukturen des Forschungsrahmens, Prozesspfeile, Modulbezeichnungen (oft mit englischen Fachbegriffen), erklärende Untertexte (8-10pt) sowie gelegentlich Formeln oder Datenbeschriftungen. Dies ist eine echte „Herausforderung“ für KI-Modelle zur Bilderzeugung, da sie gleichzeitig Genauigkeit bei Texten, Layoutkontrolle und räumliche Anordnung bewältigen müssen.

Praxistest 1: Paradigmen-Diagramm für maschinelles Lernen

Test-Eingabeaufforderung:

A research paradigm diagram showing a machine learning training pipeline.

Three stages: "Data Preprocessing", "Model Training", "Evaluation".

Each stage has 2-3 sub-modules with English labels (e.g., "Tokenization",

"Backpropagation", "F1 Score"). Include arrows between stages.

Top title: "End-to-End ML Training Pipeline".

Bottom-right footer: "Figure 1. ML Paradigm v2.3".

Use academic style, white background, dark text.

Vergleich der Ergebnisse:

| Prüfpunkt | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| Rechtschreibung Haupttitel | ✅ 100% korrekt | ✅ 100% korrekt |

| Drei Phasen-Labels | ✅ Alle korrekt | ⚠️ "Evaluation" wird gelegentlich als "Evualation" gerendert |

| Sub-Modul-Text (8pt) | ✅ "Tokenization" / "Backpropagation" klar | ❌ Text verschwommen, Zeichen werden oft vertauscht |

| Pfeilrichtungen | ✅ Phasenfluss korrekt | ✅ Phasenfluss korrekt |

| Index "Figure 1." | ✅ Vollständig gerendert | ⚠️ Versionsnummer gelegentlich verloren |

| Gesamte Lesbarkeit | ✅ Sofort einsetzbar | ⚠️ Erfordert mehrmalige Neugenerierung |

Der entscheidende Vorteil von GPT-image-2 in diesem Szenario ist, dass das Modell erst "nachdenkt", bevor es zeichnet. Der Thinking-Mechanismus plant "Drei Phasen + Sub-Module + Kleinteilige Beschriftung" als geschlossene Einheit und verhindert so, dass während des Zeichnens Vorgaben verloren gehen.

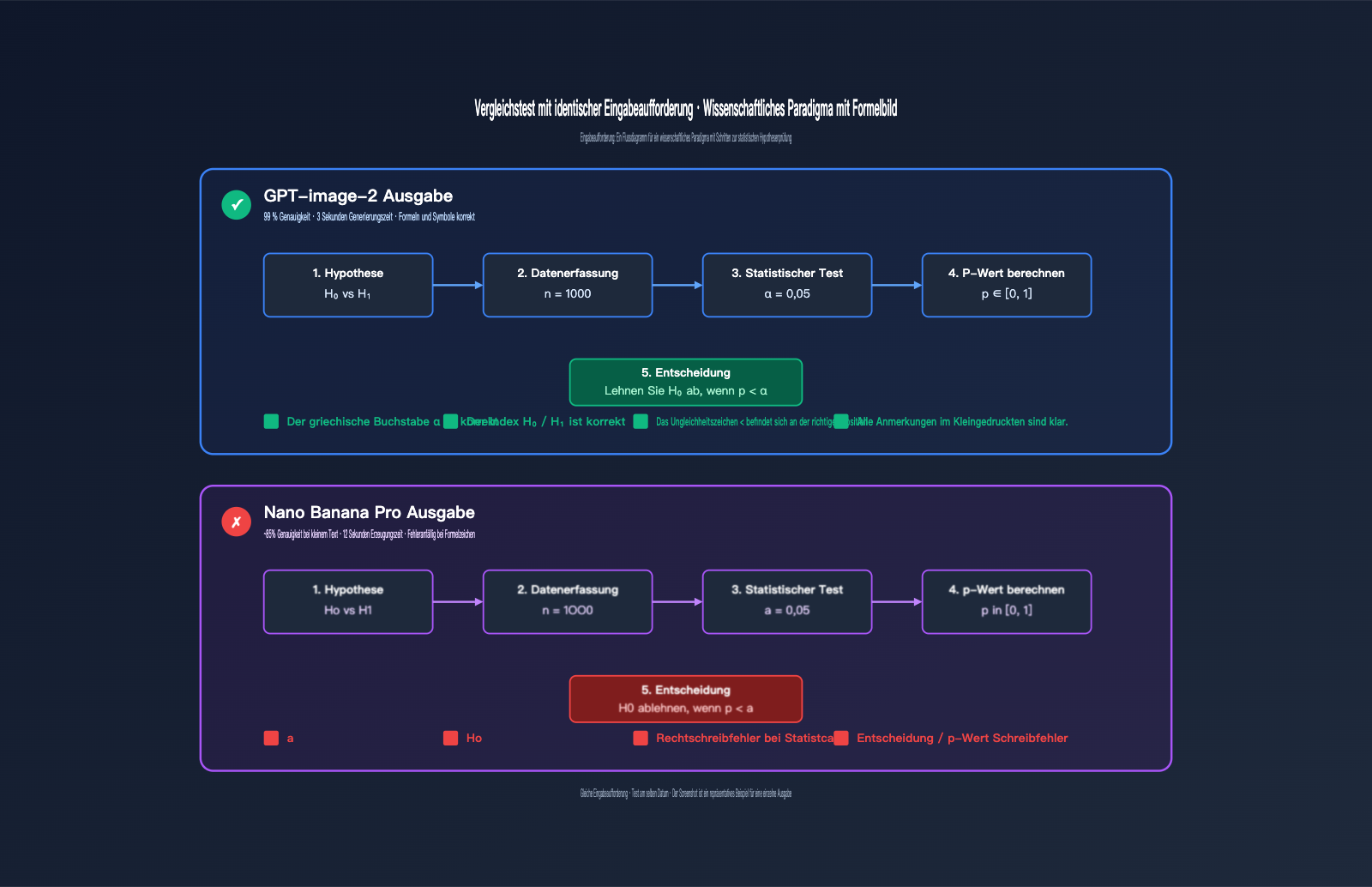

Praxistest 2: Wissenschaftliches Flussdiagramm mit Formeln

Test-Eingabeaufforderung:

A scientific research paradigm flowchart with five boxes connected by arrows:

1. "Hypothesis: H₀ vs H₁"

2. "Data Collection (n=1000)"

3. "Statistical Test (α=0.05)"

4. "Compute p-value"

5. "Reject H₀ if p < α"

Use light blue boxes, dark text, sans-serif font, academic style.

Ergebnisse:

GPT-image-2 liefert nahezu perfekte Ergebnisse: Der griechische Buchstabe α, die Indizes H₀ / H₁ und das Ungleichheitszeichen < wurden korrekt gerendert. Wissenschaftliche Fachleser könnten dies direkt als Abbildung verwenden.

Die Probleme bei Nano Banana Pro konzentrierten sich auf griechische Buchstaben und Indizes: α wurde gelegentlich als "a" gerendert, H₀ verwandelte sich häufig in "Ho" oder "H0" (normale Zahl statt Index) und das Ungleichheitszeichen verschob sich. Solche Fehler treten bei längeren Texten kaum auf, werden aber bei wissenschaftlichen Diagrammen sofort sichtbar.

💡 Technischer Rat: Für Paradigmen-Diagramme mit griechischen Buchstaben, Indizes oder speziellen mathematischen Symbolen empfehlen wir GPT-image-2. Falls Sie in einem Projekt schnell zwischen beiden Modellen vergleichen müssen, können Sie den API-Proxy-Dienst von APIYI (apiyi.com) für eine einheitliche Schnittstelle nutzen und so Wechselkosten sparen.

Praxistest 3: Technische Architekturdiagramme (mit vielen englischen Fachbegriffen)

Test-Eingabeaufforderung:

A technical architecture diagram with three layers:

- Top: "Application Layer" (FastAPI, Nginx, Redis)

- Middle: "Business Logic Layer" (Authentication, Rate Limiter, Cache Manager)

- Bottom: "Data Layer" (PostgreSQL, Elasticsearch, S3 Storage)

Use connecting arrows between layers. Dark theme, monospace font for tech names.

Ergebnisse:

| Prüfpunkt | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| Technik-Namen (FastAPI/Nginx etc.) | ✅ Alle korrekt | ⚠️ "Elasticsearch" wird gelegentlich "Elasticseach" |

| Konsistenz der Monospace-Schrift | ✅ Einheitlich | ⚠️ Teilweise Modul-Variationen |

| Layer-Bezeichnungen | ✅ Drei Ebenen klar | ✅ Drei Ebenen klar |

| Pfeilverbindungslogik | ✅ Durchgängig | ✅ Durchgängig |

| Professionelle Anmutung | ✅ Sofort für Tech-Blogs nutzbar | ⚠️ Nachbearbeitung erforderlich |

Umfassender Vergleich der Kleinschrift-Wiedergabe bei GPT-image-2

Wissenschaftliche Paradigmen-Diagramme sind nur ein Beispiel für Szenarien mit "hoher Textdichte". Wir erweitern unseren Test nun auf weitere Anwendungsfälle, die eine präzise Darstellung von Kleinschrift erfordern.

Kleinschrift-Beschriftungen in Datendiagrammen

Datenvisualisierungen umfassen Achsenbeschriftungen, Legenden, Fehlerbalken-Labels und Datenpunkt-Indizes. Während Nano Banana Pro bei großen Schriftgrößen (Haupt- und Untertitel) solide Ergebnisse liefert, werden Achsenbeschriftungen im Bereich von 6-8pt oft unscharf oder fehlerhaft dargestellt. GPT-image-2 hingegen behält bei einer Auflösung von 2K eine stabile Lesbarkeit von 6pt-Kleinschrift bei.

| Kleinschrift-Szenario | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| Achsenbeschriftung (6-8pt) | ✅ Klar lesbar | ⚠️ Unscharf oder überlagert |

| Legenden-Labels | ✅ 100% präzise | ⚠️ 90% präzise |

| Fehlerbalken-Beschriftung | ✅ Zahlen exakt | ❌ Zahlen fehleranfällig |

| Versionsnummern (Indizes) | ✅ Vollständig erhalten | ⚠️ Gelegentlich fehlend |

UI-Screenshots und Oberflächenelemente

UI-Mockups sind ein weiteres, oft unterschätztes Szenario mit "hoher Textdichte". Schaltflächentexte, Menüpunkte, Formularbeschriftungen und Statusanzeigen bestehen fast ausschließlich aus kleiner Schrift. Banana Pro überzeugt zwar bei der Nachahmung allgemeiner Screenshots, stößt jedoch bei "dichten Listen mit Status-Badges" an seine Grenzen, da es hier häufig zu Zeichenverschiebungen kommt.

GPT-image-2 erreicht in diesem Bereich ein Niveau, das fast an Photoshop-Vorlagen heranreicht: Alle Schaltflächentexte und Status-Badges ("Active", "Pending", "Failed" etc.) werden stabil gerendert.

Mehrsprachige Szenarien (Chinesisch, Englisch, Japanisch, Koreanisch)

In Tests unter den Bedingungen der LM Arena erreicht GPT-image-2 eine zeichenbasierte Genauigkeit von ~99% für lateinische, CJK- (Chinesisch, Japanisch, Koreanisch), Hindi- und bengalische Schriftzeichen. Dies ermöglicht die zuverlässige Erstellung von Grafiken mit einer Mischung aus "chinesischen Titeln, englischen Fachbegriffen und japanischen Anmerkungen".

Nano Banana Pro zeigt bei Einzelsprachen eine ähnliche Leistung wie GPT-image-2, weist jedoch bei der Mischung von CJK- und lateinischen Zeichen Probleme mit den Abständen auf (die Proportionen zwischen den quadratischen chinesischen Schriftzeichen und der lateinischen Schrift stimmen nicht).

# Einheitlicher Modellaufruf über die APIYI-Schnittstelle zum schnellen Vergleich

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Aufruf von GPT-image-2

response_gpt = client.images.generate(

model="gpt-image-2",

prompt="A scientific paradigm diagram with...",

size="2048x2048",

quality="high"

)

# Aufruf von Nano Banana Pro (über dieselbe Schnittstelle)

response_banana = client.images.generate(

model="gemini-3-pro-image-preview",

prompt="A scientific paradigm diagram with...",

size="2048x2048"

)

Vollständigen Vergleichs-Testcode anzeigen

import openai

import time

from pathlib import Path

from typing import Optional, Literal

ModelName = Literal["gpt-image-2", "gemini-3-pro-image-preview"]

def generate_paradigm_diagram(

prompt: str,

model: ModelName,

output_dir: str = "./outputs",

size: str = "2048x2048",

quality: str = "high",

) -> dict:

"""

Aufruf eines beliebigen Modells über die APIYI-Plattform zur Erstellung eines Paradigmen-Diagramms.

Gibt Modellname, Generierungsdauer, Ausgabepfad und Token-Verbrauch zurück.

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

start = time.time()

response = client.images.generate(

model=model,

prompt=prompt,

size=size,

quality=quality,

n=1,

)

elapsed = time.time() - start

Path(output_dir).mkdir(parents=True, exist_ok=True)

output_path = f"{output_dir}/{model}_{int(start)}.png"

image_data = response.data[0].b64_json

with open(output_path, "wb") as f:

import base64

f.write(base64.b64decode(image_data))

return {

"model": model,

"elapsed_sec": round(elapsed, 2),

"output_path": output_path,

}

def compare_models(prompt: str) -> None:

"""Führt beide Modelle mit demselben Prompt aus und erstellt einen Vergleichsbericht."""

print(f"Starte Vergleichstest für Prompt: {prompt[:80]}...\n")

for model in ["gpt-image-2", "gemini-3-pro-image-preview"]:

result = generate_paradigm_diagram(prompt, model)

print(f"[{model}] Dauer: {result['elapsed_sec']}s | Pfad: {result['output_path']}")

if __name__ == "__main__":

paradigm_prompt = """

A research paradigm diagram showing ML training pipeline.

Three stages: Data Preprocessing, Model Training, Evaluation.

Each stage has sub-modules with English labels.

Title: 'End-to-End ML Training Pipeline'.

Footer: 'Figure 1. ML Paradigm v2.3'.

Academic style, white background.

"""

compare_models(paradigm_prompt)

🚀 Schnellstart: Wir empfehlen die Plattform APIYI (apiyi.com) für den schnellen Aufbau einer Vergleichstestumgebung. Die Plattform bietet eine sofort einsatzbereite, einheitliche API-Schnittstelle, mit der Sie innerhalb von 5 Minuten beide Modelle integrieren und direkt vergleichen können.

Unterschiede in der Text-Rendering-Mechanik: GPT-image-2 vs. Nano Banana Pro

Warum erzielt GPT-image-2 bei Kleinschrift und wissenschaftlichen Diagrammen einen "strukturellen" Vorsprung? Das Verständnis der zugrunde liegenden Mechanismen hilft Ihnen dabei, das am besten geeignete Werkzeug für Ihre Aufgaben auszuwählen.

Der O-Serie Reasoning-Mechanismus von GPT-image-2

GPT-image-2 führt den Reasoning-Mechanismus der O-Serie ein – eine Erweiterung der OpenAI-Reasoning-Modelle (o1 / o3) auf den Bereich der Bildgenerierung. Vor der eigentlichen Bildgenerierung führt das Modell drei Schritte aus:

- Layout-Planung: Organisation der Objekte, Texte und räumlichen Beziehungen aus dem Prompt in einen "Layout-Plan".

- Constraint-Validierung: Überprüfung, ob "Objektanzahl", "Textinhalt" und "Position der Kleinschrift" korrekt eingeplant wurden.

- Konfliktlösung: Behandlung potenzieller Prompt-Konflikte (z.B. "Bild füllen" vs. "Weißraum lassen").

Bei Szenarien mit hoher "Constraint-Dichte", wie wissenschaftlichen Paradigmen-Diagrammen, ist jedes kleine Text-Label eine eigenständige Vorgabe. Während herkömmliche Diffusionsmodelle dazu neigen, während des Generierungsprozesses Vorgaben zu "vergessen", plant der Reasoning-Mechanismus alle Vorgaben als Ganzes, was das Risiko von fehlenden oder falsch geschriebenen Wörtern sowie Zeichenüberlagerungen drastisch reduziert.

Grounding + semantische Absatz-Mechanik von Nano Banana Pro

Nano Banana Pro basiert auf dem Gemini 3 Pro-Backbone und zieht seine Stärken aus zwei anderen Richtungen:

- Google Search Grounding: Bei der Generierung können Echtzeitinformationen (z.B. "aktueller Wechselkurs vom April 2026" oder "Olympia-Zeitplan") abgerufen und in das Bild eingebettet werden.

- Semantische Kohärenz auf Absatzebene: Die starke Sprachmodell-Fähigkeit sorgt dafür, dass lange Absätze grammatikalisch und orthografisch konsistent bleiben.

Diese Mechanismen sind hervorragend für "Infografiken mit langen Absätzen" und "Visualisierungen auf Basis realer Daten" geeignet, helfen jedoch wenig bei "fragmentierten Kleinschrift-Labels" – diese sind oft Eigennamen (Produktnamen, Fachbegriffe), denen der nötige semantische Kontext fehlt.

| Mechanismus-Merkmal | GPT-image-2 (Reasoning) | Nano Banana Pro (Grounding) |

|---|---|---|

| Geeignete Texttypen | Fragmentierte Kleinschrift, Fachbegriffe | Lange Absätze, abrufbare Informationen |

| Constraint-Verarbeitung | Vorausplanung, einheitliche Validierung | Semantische Prüfung während der Generierung |

| Ursache für Fehler | Sehr selten (~1%) | Hauptsächlich bei Kleinschrift, Eigennamen |

| Geschwindigkeit | Schnell, ~3 Sekunden | Grounding-Suche verzögert, ~10-15 Sekunden |

| Beste Einsatzgebiete | Wissenschaftliche Diagramme, UI, technische Grafiken | Poster, lange Absätze, Echtzeitdaten-Grafiken |

Warum "Kleinschrift" der entscheidende Faktor ist

Die Schriftgröße ist nicht das eigentliche Problem, sondern die "Informationsdichte pro Pixel". Wenn ein 8pt-Label 12 Zeichen auf einer Fläche von 50×20 Pixeln klar darstellen muss, muss das Modell auf kleinstem Raum gleichzeitig Schriftform, Abstände, Ausrichtung und Pixel-Jitter beherrschen. Dies ist ein Szenario mit "hoher Constraint-Dichte", in dem die Vorteile des O-Serie-Reasonings voll zur Geltung kommen.

🎯 Technischer Rat: Wenn Ihr Projekt sowohl wissenschaftliche Diagramme als auch Infografiken mit langen Absätzen umfasst, empfehlen wir ein Modell-Routing auf technischer Ebene – eine automatische Weiterleitung an das jeweilige Modell basierend auf einem "Schriftgrößen-Schwellenwert". Dieses Routing lässt sich über die APIYI-Plattform (apiyi.com) mit einer einzigen Schnittstelle realisieren, ohne dass zwei verschiedene SDKs integriert werden müssen, was die technische Komplexität reduziert.

GPT-image-2 vs. Nano Banana Pro: Vergleich des Prompt-Engineerings

Die "Art der Abstimmung" für diese beiden Modelle unterscheidet sich grundlegend. Bei gleicher Anforderung führen unterschiedliche Schreibweisen der Eingabeaufforderung zu deutlichen Qualitätsunterschieden.

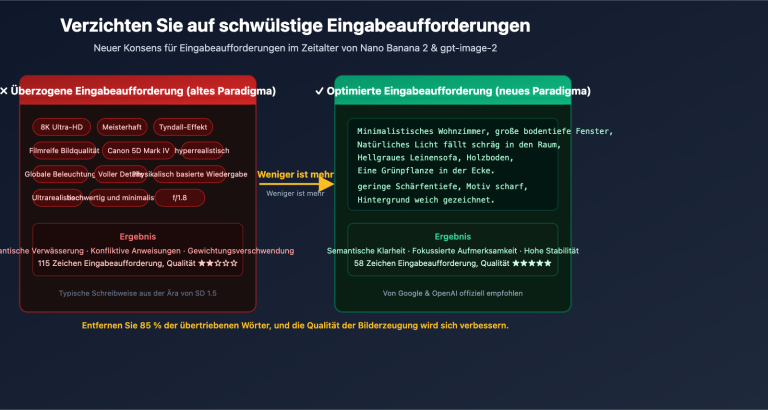

Der Prompt-Modus für GPT-image-2

GPT-image-2 bevorzugt "strukturierte Anweisungen + explizite Einschränkungen" und imitiert damit den Denkstil der O-Serie.

Empfohlene Schreibweise:

A research paradigm diagram with the following elements:

Title (top center, 24pt bold): "End-to-End ML Pipeline"

Three stages (left to right, connected by arrows):

1. "Data Preprocessing" (sub-modules: Tokenization, Normalization)

2. "Model Training" (sub-modules: Forward Pass, Backpropagation)

3. "Evaluation" (sub-modules: F1 Score, ROC-AUC)

Footer (bottom-right, 8pt): "Figure 1. ML Paradigm v2.3"

Style: academic, white background, dark blue boxes, sans-serif font.

Wichtiger Punkt: Verwenden Sie nummerierte Listen, klare Schriftgrößen und präzise Positionsangaben, damit der Thinking-Mechanismus alles "Punkt für Punkt überprüfen" kann.

Der Prompt-Modus für Nano Banana Pro

Nano Banana Pro bevorzugt "natursprachliche Beschreibungen + kontextuelle Erzählung", was eher an kreatives Schreiben erinnert.

Empfohlene Schreibweise:

A clean academic-style research paradigm diagram showing

how a machine learning pipeline progresses through three

stages: starting with data preprocessing where raw inputs

are tokenized and normalized, then moving to model training

where forward passes and backpropagation iterate, and

finally reaching evaluation where F1 score and ROC-AUC

are computed. Connect the stages with arrows. Title at top:

"End-to-End ML Pipeline". Use a clean, white background

with dark blue rounded boxes.

Wichtiger Punkt: Gestalten Sie den Prozess wie eine "Geschichte", damit das Gemini-Basis-Modell die semantische Kohärenz nutzt, um ein harmonisches Gesamtbild zu erzeugen.

Schnellübersicht zur Prompt-Optimierung

| Optimierungspunkt | Schreibweise GPT-image-2 | Schreibweise Nano Banana Pro |

|---|---|---|

| Textinhalt | In Anführungszeichen: "Figur 1" |

Natürlichsprachlich: showing "Figur 1" |

| Elementlisten | Nummeriert 1./2./3. | Verbindende Begriffe: first… then… |

| Schriftgröße | Explizit: 8pt small print |

Beschreibend: tiny annotation |

| Positionierung | Präzise: top-right corner |

Natürlich: in the upper right |

| Stilvorgabe | Stichworte: sans-serif, academic |

Satzbau: clean academic style |

| Einschränkung | Je expliziter, desto besser | Natürliche Sprache ist stabiler |

Allgemeine Tipps (für beide Modelle geeignet)

- Wichtiger Text muss in Anführungszeichen stehen: Andernfalls könnte das Modell Ihren Text "frei interpretieren".

- Sparsam mit 8pt-Kleinschrift: Selbst bei GPT-image-2 werden nicht mehr als 5-6 unabhängige kleine Textetiketten empfohlen.

- Widersprüchliche Einschränkungen vermeiden: "Minimalismus" + "informationsdicht" überfordert beide Modelle.

- 3-4 Entwürfe generieren und den besten wählen: Die Textwiedergabe unterliegt einer gewissen Wahrscheinlichkeit, daher ist die Mehrfachgenerierung ein Industriestandard.

🚀 Schnellstart: Mit der APIYI (apiyi.com)-Plattform können Sie eine Vergleichspipeline aufbauen. Fordern Sie bei gleichem Prompt beide Modelle gleichzeitig an und vergleichen Sie die Ergebnisse direkt nebeneinander. Die Einrichtung dauert weniger als 5 Minuten, um das für Ihr Unternehmen optimale Modell schnell zu identifizieren.

Anwendungsempfehlungen für GPT-image-2 vs. Nano Banana Pro

Nach zahlreichen Tests können wir klare Empfehlungen für verschiedene Anwendungsszenarien geben.

Szenarien mit Priorität auf GPT-image-2

- Wissenschaftliche Paradigmen-Diagramme: Hohe Dichte an Kleinschrift, Fachtermini und Ablaufpfeile – der Thinking-Mechanismus und die 99% Textgenauigkeit von GPT-image-2 sind hier ein struktureller Vorteil.

- Technische Architekturdiagramme: Enthält Stack-Namen (wie FastAPI/Elasticsearch/PostgreSQL), die bei Modellen oft falsch geschrieben werden.

- Datenvisualisierung: Achsenbeschriftungen, Legenden, Fehlerbalken, Fußnoten in 6-8pt Größe.

- UI-Screenshots und Mockups: Dichter UI-Text wie Schaltflächenbeschriftungen, Status-Badges oder Menüpunkte.

- Infografik-Poster: Mischsatz aus Fachüberschriften (z.B. "Intelligence Layer") und kleinen Fußnoten.

- Mehrsprachige Diagramme: Texte in einer Mischung aus Deutsch, Englisch, Japanisch oder Koreanisch.

- Formeln und Symbole: Griechische Buchstaben (α/β/H₀/p-value), Hoch-/Tiefstellungen und statistische Symbole.

- Schnelle Iteration: Generierungsgeschwindigkeit von ~3 Sek./Bild erlaubt schnelles Optimieren.

Szenarien mit Priorität auf Nano Banana Pro

- Fotorealismus: Produktfotografie, Porträts, Architekturaufnahmen und ähnliche Anforderungen mit hohem Realismusgrad.

- Längere Infografik-Absätze: Artikel-Layout, bei dem Text in Absätzen statt als kleine Labels organisiert ist.

- Generierung auf Basis von Echtzeitdaten: Erfordert Google Search Grounding zur Abfrage aktueller Daten (z. B. Wechselkurse, aktuelle Ereignisse).

- 4K-Auflösung: Während GPT-image-2 aktuell bis 2K unterstützt, erreicht Banana Pro bis zu 4K (5632×3072).

- Bearbeitung mit mehreren Referenzbildern: Banana Pro unterstützt bis zu 14 Referenzbilder, was bei Bearbeitungsszenarien flexibler ist.

- Komplexe räumliche Beziehungen: Szenen mit vielen Objekten und deren präziser Anordnung (vor/hinter/links/rechts).

- Lange chinesische Textabsätze: Höhere Stabilität beim Layout von langen Textpassagen (im Vergleich zu kurzen Labels).

Die "Mittelzone" – beide Modelle geeignet

- Normale Illustrationen mit einem Haupt- und Untertitel.

- Einfaches Logo-Design.

- Stilisierte Grafiken (flach, Aquarell, Pixel-Art).

- Coverbilder ohne Fachtermini.

💡 Entscheidungsprinzip: Je dichter der Text, je kleiner die Schrift und je fachspezifischer die Begriffe, desto eher sollten Sie GPT-image-2 wählen. Je länger der Text, je höher die Anforderungen an Realismus und Echtzeitinformationen, desto eher ist Nano Banana Pro die richtige Wahl. Beide Modelle können auf APIYI (apiyi.com) mit einem Klick gewechselt werden, ohne die Schnittstellen neu anzupassen.

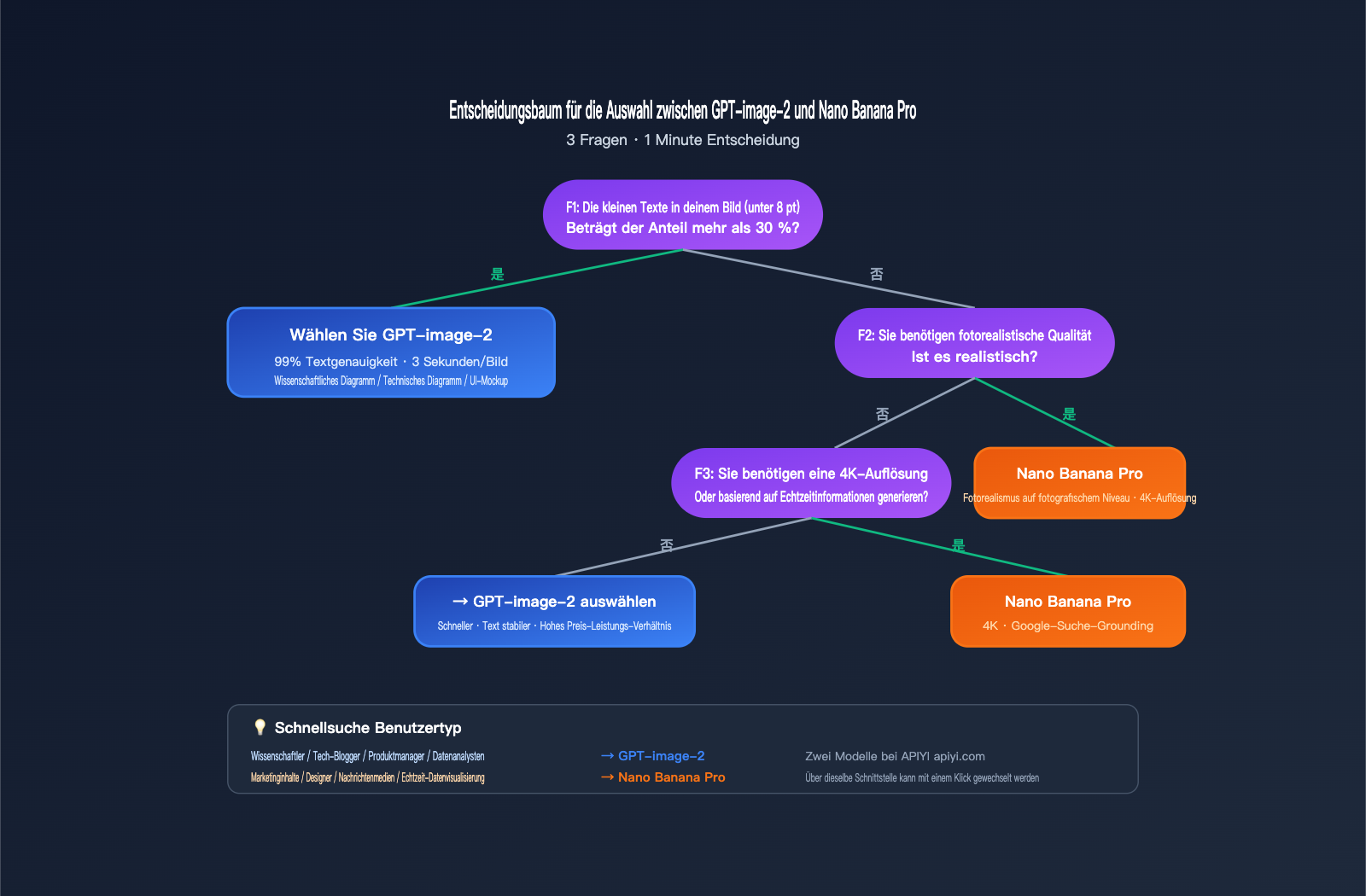

Entscheidungshilfe: GPT-image-2 vs. Nano Banana Pro

Entscheidungsbaum: 3 Fragen führen zum Ziel

Frage 1: Bestehen mehr als 30 % deines Bildes aus "kleinem Text (unter 8pt)"?

- Ja → GPT-image-2

- Nein → Weiter zu Frage 2

Frage 2: Benötigst du fotorealistische Ergebnisse?

- Ja → Nano Banana Pro

- Nein → Weiter zu Frage 3

Frage 3: Benötigst du 4K-Auflösung oder eine Generierung basierend auf Echtzeit-Informationen?

- Ja → Nano Banana Pro

- Nein → GPT-image-2 (schneller, stabilere Textdarstellung)

Empfehlungen für verschiedene Nutzergruppen

| Nutzergruppe | Hauptszenarien | Bevorzugtes Modell | Grund |

|---|---|---|---|

| Wissenschaftler | Publikationsgrafiken, Paradigmen-Diagramme | GPT-image-2 | Stabile Formeln, griechische Buchstaben, Fachtermini |

| Tech-Blogger | Architekturskizzen, API-Flussdiagramme | GPT-image-2 | Korrekte technische Begriffe, realistische UI-Screenshots |

| Produktmanager | Produkt-Mockups, Prozessdiagramme | GPT-image-2 | Überlegen bei der Darstellung von UI-Elementen |

| Datenanalysten | Kleine Beschriftungen, Achsenbeschriftungen | GPT-image-2 | Stabile Darstellung von 6-8pt Schrift |

| Marketing | Plakate, Infografiken mit viel Text | Nano Banana Pro | Besserer Satz von Fließtext + höhere Realitätstreue |

| Designer | Bildkompositionen, Produktfotografie | Nano Banana Pro | Führend bei Realismus und Detailqualität |

| Medien/Presse | Echtzeit-Datenvisualisierung | Nano Banana Pro | Vorteil durch Google Search Grounding |

Kosten- und Geschwindigkeitsüberlegungen

Im LM-Arena-Test benötigt GPT-image-2 ca. 3 Sekunden pro Bild, während Nano Banana Pro meist 10-15 Sekunden braucht. Wenn dein Workflow aus "häufigem Anpassen der Eingabeaufforderung bis zur Zufriedenheit" besteht, verkürzt der Geschwindigkeitsvorteil von GPT-image-2 den Iterationszyklus erheblich.

💰 Kostenoptimierung: Für Teams, die große Mengen an wissenschaftlichen oder technischen Grafiken generieren, empfehlen wir die Nutzung beider Modelle über den API-Proxy-Dienst von APIYI (apiyi.com). Die Plattform bietet flexible Abrechnungsmodelle und eine einheitliche Verwaltung, mit der sich je nach Szenario das wirtschaftlichste Modell wählen lässt – ideal für kleine Teams und Entwickler.

GPT-image-2 vs. Nano Banana Pro – Häufig gestellte Fragen

Q1: Kann GPT-image-2 den Nano Banana Pro wirklich „in den Schatten stellen“?

Das hängt vom Szenario ab. Auf der Bestenliste für Text-zu-Bild im LM Arena erreicht GPT-image-2 (1512 Elo) einen Vorsprung von +242 Punkten gegenüber Nano Banana Pro (1271 Elo) – der größte Abstand in der Geschichte der LM Arena. Dieser Vorsprung resultiert primär aus der Textwiedergabe, der UI-Rekonstruktion und allgemeinem Weltwissen. Bei fotorealistischer Darstellung und räumlichem Schlussfolgern behält Nano Banana Pro jedoch die Nase vorn. Die Aussage "in den Schatten stellen" trifft also auf Szenarien mit kleinem Text, wissenschaftlichen Diagrammen und UI-Entwürfen zu, nicht jedoch auf die "fotorealistische Qualität". Wir empfehlen, beide Modelle über die Plattform APIYI apiyi.com anzubinden und je nach Anwendungsfall zu wechseln.

Q2: Sind die 99 % Textgenauigkeit von GPT-image-2 wirklich wahr?

Tests in der LM Arena und Berichte von frühen Anwendern bestätigen diesen Wert. Er gilt für verschiedene Schriftsysteme, darunter Latein, CJK (Chinesisch, Japanisch, Koreanisch), Hindi und Bengali. Wichtig: Die "99 %" beziehen sich auf die Zeichengenauigkeit, nicht auf 100 % Perfektion. In Extremszenarien (winziger Text unter 5 pt, seltene Fachsymbole, komplexe verschachtelte mathematische Formeln) kann es noch zu kleinen Fehlern kommen. Zum Vergleich: GPT Image 1.5 liegt bei 95 %, GPT Image 1 bei 90 %. Nano Banana Pro erreicht bei langen Textabschnitten etwa 95 %, fällt aber bei sehr kleinem Text auf ca. 80–85 % ab.

Q3: Wenn ich mit GPT-image-2 wissenschaftliche Diagramme erstelle, ist der griechische Buchstabe α manchmal falsch. Was kann ich tun?

Sie können in der Eingabeaufforderung explizit schreiben: "Use Unicode Greek letter alpha (α, U+03B1)". In Kombination mit dem Thinking-Modus (standardmäßig aktiviert) steigt die Trefferquote deutlich. Sollte es dennoch zu Fehlern kommen, generieren Sie am besten 3–4 Varianten und wählen die beste aus, oder nutzen Sie in der Eingabeaufforderung einfach das Wort "alpha" und ersetzen es später per Photoshop. Experimentieren Sie ein wenig, um die beste Strategie zu finden.

Q4: Warum ist die Textdarstellung bei langen Absätzen in Nano Banana Pro stabiler?

Nano Banana Pro basiert auf dem Gemini 3 Pro-Grundgerüst und profitiert von dessen starker Fähigkeit zur "semantischen Kohärenz auf Absatzebene". Es behandelt lange Absätze als "semantische Einheiten", wodurch Grammatik und Rechtschreibung insgesamt sehr stabil bleiben. Winzige Beschriftungen sind jedoch "fragmentierte benannte Entitäten" ohne semantischen Kontext, was dort zu Fehlern führt. GPT-image-2 umgeht dieses Problem, indem es dank O-Serie-Inferenz "kleine Beschriftungen als Einschränkungen" vorab plant.

Q5: Ist der Modellaufruf für GPT-image-2 und Nano Banana Pro auf der APIYI-Plattform identisch?

Ja. Die Plattform APIYI apiyi.com bietet eine einheitliche, OpenAI-kompatible Schnittstelle für diverse gängige Bildmodelle. Sie müssen lediglich das Feld model (gpt-image-2 oder gemini-3-pro-image-preview) anpassen; base_url und der SDK-Aufruf bleiben gleich. Dies ist besonders vorteilhaft für Projekte, die A/B-Tests durchführen oder Modelle szenariobasiert routen wollen, ohne mehrere SDKs warten zu müssen.

Q6: Ich bin an BananaPro gewöhnt. Muss ich meine Eingabeaufforderung für GPT-image-2 anpassen?

Eine kleine Anpassung ist sinnvoll, aber der Aufwand hält sich in Grenzen. Nano Banana Pro bevorzugt "natursprachliche Beschreibungen + Kontext", während GPT-image-2 mit strukturierten Anweisungen besser arbeitet. Wir empfehlen, in die Eingabeaufforderung Folgendes aufzunehmen: 1) Eine klare Elementliste (nummeriert mit 1./2./3.); 2) Angabe des Schriftstils (sans-serif/monospace/serif); 3) Wichtigen Text in Anführungszeichen setzen (z. B. "Figure 1. ML Paradigm"). Andere Beschreibungsstile können beibehalten werden.

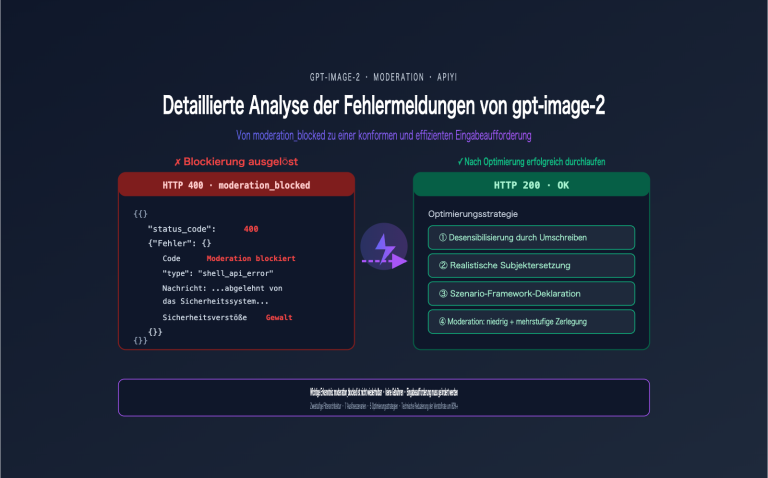

Q7: Wie gehe ich bei Fehlern während der Generierung vor?

Prüfen Sie die Punkte in dieser Reihenfolge: 1) Enthält die Eingabeaufforderung Inhalte, die eine Inhaltsprüfung auslösen könnten (Gesichter, sensible Themen)? 2) Kürzen Sie die Eingabeaufforderung und entfernen Sie widersprüchliche Vorgaben (z. B. gleichzeitig "fotorealistisch" und "minimalistische Illustration"); 3) Passen Sie die Parameter für size/quality an; 4) Wechseln Sie testweise auf das andere Modell; 5) Bei API-Fehlern finden Sie im Kontrollzentrum von APIYI apiyi.com detaillierte Fehlercodes und Strategien zur Fehlerbehebung.

Q8: In welchen Szenarien unterliegt GPT-image-2 dem Nano Banana Pro?

Hauptsächlich in drei Bereichen: 1) Ultra-hohe 4K-Auflösungen (Banana Pro unterstützt 5632×3072, GPT-image-2 maximal 2K); 2) Räumliches Schlussfolgern mit mehreren Objekten (z. B. "5 Gegenstände an spezifischen Positionen in 3 Schränken"); 3) Infografiken mit extrem langen, kohärenten Textblöcken (über 200 Wörter). In diesen Fällen empfehlen wir direkt den Nano Banana Pro.

Die wichtigsten Erkenntnisse: GPT-image-2 vs. Nano Banana Pro

- Überlegene Textwiedergabe: GPT-image-2 führt mit einem Vorsprung von +242 Elo-Punkten vor Nano Banana Pro auf dem LM Arena-Leaderboard – der größte Abstand in der Geschichte der Arena, hauptsächlich bedingt durch eine ~99%ige Zeichengenauigkeit.

- Strukturelle Vorteile bei wissenschaftlichen Diagrammen: Bei fachspezifischen Diagrammen, technischen Architekturschaubildern, Datenvisualisierungen und UI-Mockups bietet die Kombination aus O-Serie-Inferenz und 99% Genauigkeit bei GPT-image-2 einen entscheidenden Vorteil.

- Stabilität bei kleinem Text und Formeln: Skalierungen (6-8 pt), griechische Buchstaben, Hoch-/Tiefstellungen und statistische Symbole werden bei GPT-image-2 stabil gerendert, während Nano Banana Pro hier häufiger schwächelt.

- 3- bis 5-mal schnellere Generierung: GPT-image-2 benötigt ca. 3 Sekunden pro Bild, Nano Banana Pro 10-15 Sekunden, was für schnelle Iterationsprozesse ein enormer Vorteil ist.

- Exklusive Stärken von Banana Pro: 4K-Auflösung, fotorealistische Qualität, zusammenhängende lange Textpassagen, Google-Suche-Anbindung und räumliches Schlussfolgern mit vielen Objekten bleiben seine Kernkompetenzen.

- Prinzip für die Modellauswahl: Je textlastiger/kleiner die Schrift/fachspezifischer der Inhalt → GPT-image-2; Je mehr Fotorealismus/4K/Echtzeit-Informationen benötigt werden → Nano Banana Pro.

- Geringere Wechselkosten durch einheitliche API: Über die Plattform APIYI apiyi.com können beide Modelle mit demselben SDK angesprochen werden, was den szenariobasierten Wechsel vereinfacht und redundanten Code vermeidet.

Zusammenfassung

Der Vergleich zwischen GPT-image-2 und Nano Banana Pro führt je nach Anwendungsszenario zu völlig unterschiedlichen Ergebnissen. Betrachtet man nur die Gesamtbestenliste der LM Arena, ist der Vorsprung von GPT-image-2 um +242 Elo-Punkte in der Tat "überlegen". Doch bei genauerer Betrachtung der spezifischen Einsatzgebiete werden die relativen Stärken beider Modelle klar und vorhersehbar:

- Wissenschaftliche Diagramme, technische Grafiken mit kleiner Schrift, Diagramme mit Fachbegriffen → Wählen Sie GPT-image-2

- Fotorealismus, Infografiken mit langen Textabschnitten, Grafiken mit Echtzeitinformationen → Wählen Sie Nano Banana Pro

Für Wissenschaftler, Tech-Blogger und Produktmanager, deren Kernanforderung das "Erstellen von Grafiken mit viel Text, insbesondere kleiner Schrift" ist, ist der Kapazitätssprung von GPT-image-2 real und spürbar: Von 90 % bei GPT Image 1 über 95 % bei GPT Image 1.5 bis hin zu 99 % bei GPT-image-2 hat jede Generation die Grenze dessen, ob "KI-generierte Bilder direkt verwendet werden können", deutlich verschoben.

Es empfiehlt sich, über die APIYI-Plattform (apiyi.com) beide Modelle gleichzeitig einzubinden und je nach Aufgabentyp dynamisch zu wechseln. So nutzen Sie jedes Modell für seine spezifischen Stärken, anstatt sich bei allen Anforderungen auf ein einziges Modell zu verlassen.

Referenzen

-

Offizielle Ankündigung zu OpenAI ChatGPT Images 2.0: Versionshinweise zu GPT-image-2

- Link:

openai.com/index/introducing-chatgpt-images-2-0 - Beschreibung: Offizielle Veröffentlichung vom 21.04.2026, Liste der Modellkapazitäten

- Link:

-

Offizielle Seite von Google DeepMind Nano Banana Pro: Erläuterung zum Gemini 3 Pro Image-Modell

- Link:

deepmind.google/models/gemini-image/pro - Beschreibung: Offizielle Leistungsbeschreibung, Preise, Anzahl der Referenzbilder usw.

- Link:

-

LM Arena Text-zu-Bild-Bestenliste: Elo-Ranking für Text-zu-Bild-Modelle

- Link:

arena.ai/leaderboard/text-to-image - Beschreibung: GPT-image-2 mit 1512 Elo vs. Nano Banana Pro mit 1271 Elo

- Link:

-

Praxistest von Nano Banana Pro durch Simon Willison: Testbericht eines unabhängigen Entwicklers

- Link:

simonwillison.net/2025/Nov/20/nano-banana-pro - Beschreibung: 4K-Auflösungstest, Infografik-Fallstudien

- Link:

-

VentureBeat-Bericht zu ChatGPT Images 2.0: Test zu Mehrsprachigkeit und Infografiken

- Link:

venturebeat.com/technology/openais-chatgpt-images-2-0-is-here - Beschreibung: Rendering mehrsprachiger Texte, Tests zu Comics/Karten/Postern

- Link:

Autor: APIYI Technical Team | Für weitere Informationen zur Einbindung und zum Vergleich von großen Sprachmodell-APIs besuchen Sie APIYI unter apiyi.com für praktische Tests.