Anmerkung des Autors: Eine detaillierte Analyse der IMAGE_SAFETY-Fehlermeldung der Nano Banana Pro API. Wir untersuchen den zweistufigen Sicherheitsfilter, die Token-Abrechnungslogik und 8 praktische Methoden zur Steigerung der Erfolgsquote bei der Generierung.

Wenn Sie Bilder mit der Nano Banana Pro API generieren, sind Sie vielleicht schon einmal auf diese verwirrende Antwort gestoßen: Obwohl die Eingabeaufforderung keinerlei sensible Inhalte enthält, wird finishReason: IMAGE_SAFETY zurückgegeben – das Bild wurde vom Sicherheitsfilter blockiert. Noch rätselhafter ist, dass thoughtsTokenCount: 173 in der Antwort darauf hindeutet, dass das Modell den Denkprozess abgeschlossen hat, das Bild aber dennoch "abgelehnt" wurde. Dieser Artikel analysiert die Fehlermeldung Feld für Feld und erläutert Googles zweistufigen Sicherheitsfilter, die Token-Abrechnungslogik bei Blockierungen sowie Strategien zur Optimierung der Erfolgsquote.

Kernnutzen: Nach dem Lesen dieses Artikels verstehen Sie die Bedeutung jedes Feldes in der IMAGE_SAFETY-Fehlermeldung, wissen, ob bei einer Blockierung Kosten anfallen, und erfahren, wie Sie durch die Optimierung der Eingabeaufforderung Ihre Erfolgsquote auf 70-80 % steigern können.

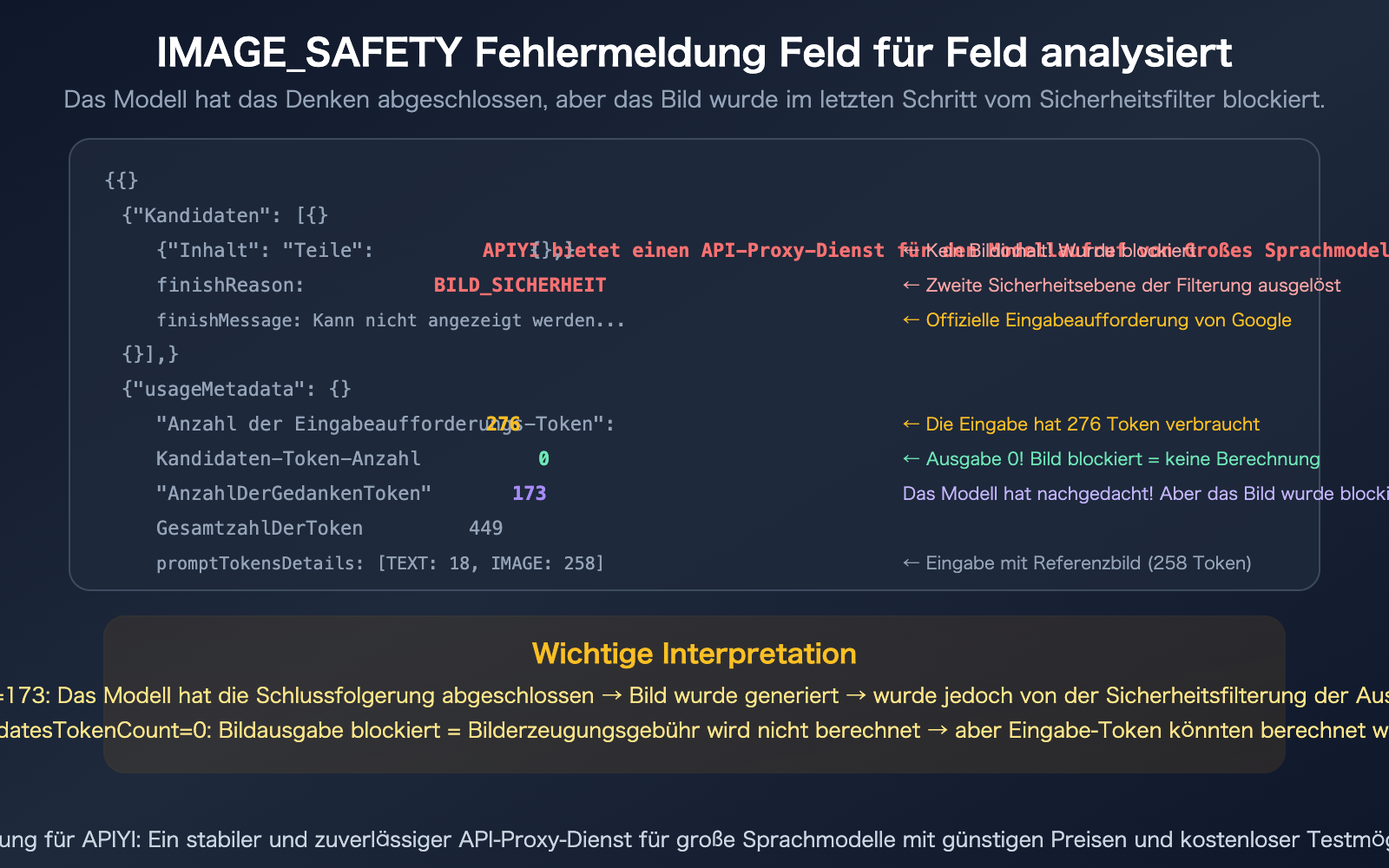

Analyse der IMAGE_SAFETY-Fehlermeldung

Zuerst klären wir die Bedeutung der einzelnen Felder in dieser Antwort.

| Feld | Wert | Bedeutung |

|---|---|---|

content.parts |

null |

Kein Inhalt zurückgegeben (Bild wurde blockiert) |

finishReason |

IMAGE_SAFETY |

Zweite Ebene des Sicherheitsfilters wurde ausgelöst |

finishMessage |

"Unable to show…" | Offizieller Google-Hinweis: Verstoß gegen die Richtlinien für generative KI |

promptTokenCount |

276 | Eingabe verbrauchte 276 Token |

candidatesTokenCount |

0 | Ausgabe-Token sind 0 (Bild blockiert, keine Generierung) |

totalTokenCount |

449 | Insgesamt 449 Token (276 Eingabe + 173 Denkprozess) |

thoughtsTokenCount |

173 | Der Denkprozess des Modells verbrauchte 173 Token |

promptTokensDetails |

TEXT:18, IMAGE:258 | 18 Text-Token + 258 Bild-Token (Referenzbild) |

modelVersion |

gemini-3-pro-image-preview | Nano Banana Pro Modell |

Die 3 wichtigsten Signale bei einem IMAGE_SAFETY-Fehler

Signal 1: thoughtsTokenCount: 173 — Das Modell hat tatsächlich nachgedacht

Dies zeigt, dass Ihre Eingabeaufforderung die erste Sicherheitsprüfung (Eingabeseite) bestanden hat. Das Modell begann mit dem Schlussfolgerungsprozess (Thinking) und hat das Bild sogar bereits generiert – wurde jedoch bei der finalen Ausgabe durch den zweiten Sicherheitsfilter blockiert. Das Problem liegt nicht an Ihrer Eingabeaufforderung, sondern am Inhalt, den das Modell "zeichnen wollte".

Signal 2: candidatesTokenCount: 0 — Ausgabe ist null

Nachdem das Bild blockiert wurde, werden die Ausgabe-Token als 0 gezählt. Laut Google gilt: "Für blockierte Bilder werden keine Gebühren erhoben". Beachten Sie jedoch: Ob Eingabe-Token (276) und Denk-Token (173) berechnet werden, hängt von der jeweiligen Abrechnungslogik ab.

Signal 3: IMAGE: 258 — Sie haben ein Referenzbild verwendet

Ihre Anfrage enthielt ein Referenzbild (das 258 Bild-Token verbrauchte). Das bedeutet, Sie führen wahrscheinlich eine Bild-zu-Bild-Bearbeitung durch und keine reine Text-zu-Bild-Generierung. Sicherheitsfilter bei der Bildbearbeitung sind oft strenger als bei reinem Text, da auch das Referenzbild selbst einer Sicherheitsprüfung unterzogen wird.

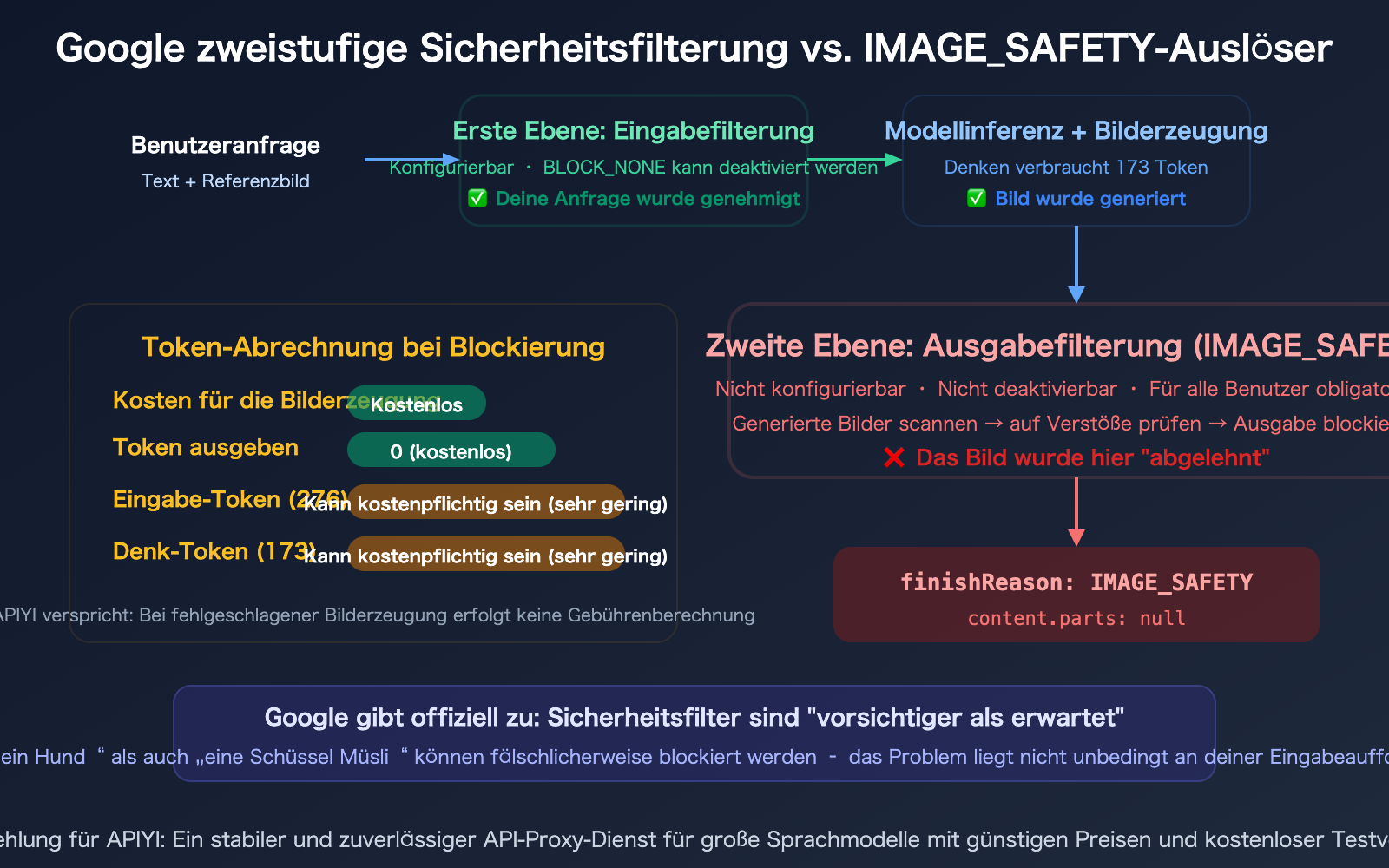

Googles zweistufiger Sicherheitsfilter-Mechanismus

Um den IMAGE_SAFETY-Fehler zu verstehen, muss man wissen, dass Googles Sicherheitsfilter aus zwei Ebenen besteht – und die zweite Ebene lässt sich nicht deaktivieren.

Ebene 1: Konfigurierbare Eingabesicherheit

| Dimension | Beschreibung | Konfigurierbar |

|---|---|---|

| Filterposition | Eingabeseite (Eingabeaufforderung) | Ja |

| Filterobjekt | Vom Benutzer eingereichter Text und Bilder | Ja |

| Einstellbar auf | BLOCK_NONE (keine Blockierung) | Ja |

| Verhalten bei Auslösung | Anfrage wird direkt abgelehnt, keine Token-Berechnung | — |

Sie können über die API-Parameter safety_settings auf BLOCK_NONE setzen, um die Empfindlichkeit der ersten Ebene zu verringern.

Ebene 2: Nicht konfigurierbarer Sicherheitsfilter für die Ausgabe

| Dimension | Beschreibung | Konfigurierbar |

|---|---|---|

| Filterposition | Ausgabeseite (generiertes Bild) | Nein |

| Filterobjekt | Vom Modell generierter Bildinhalt | Nein |

| Deaktivierbar | Nein, für alle Benutzer/Ebenen zwingend | Nein |

| Verhalten bei Auslösung | finishReason: IMAGE_SAFETY, parts: null |

— |

Der IMAGE_SAFETY-Fehler tritt auf, wenn die zweite Ebene auslöst. Ihre Eingabeaufforderung hat die erste Ebene passiert, das Modell hat den Denkprozess abgeschlossen (173 Token) und das Bild generiert – aber das Bild wurde vor der finalen Ausgabe durch die zweite Ebene blockiert.

Google räumt ein, dass dieser Filter "vorsichtiger geworden ist als erwartet", was zu vielen Fehlblockierungen führt – selbst harmlose Eingabeaufforderungen wie "ein Hund" oder "eine Schüssel Müsli" können blockiert werden.

Fallen bei einer IMAGE_SAFETY-Blockierung Kosten an?

Dies ist eine der brennendsten Fragen für Entwickler.

Abrechnungsregeln für Nano Banana Pro IMAGE_SAFETY

| Abrechnungsposten | Kosten bei Blockierung | Erläuterung |

|---|---|---|

| Kosten für Bilderzeugung | Keine Kosten | Google stellt klar: "You will not be charged for blocked images" |

| Ausgabe-Token | Keine Kosten | candidatesTokenCount: 0, keine Ausgabe bedeutet keine Kosten |

| Eingabe-Token | Mögliche Kosten (sehr gering) | 276 Token × $0,25/M ≈ $0,00007 (vernachlässigbar) |

| Denk-Token | Abhängig von der Logik | 173 Token, Gemini API könnte dies in candidates einbeziehen |

Fazit: Wenn eine Blockierung durch IMAGE_SAFETY erfolgt, fallen die Hauptkosten (Bilderzeugung und Ausgabe-Token) nicht an. Die Kosten für Eingabe-Token sind extrem niedrig (weniger als ein Zehntausendstel Dollar) und können praktisch ignoriert werden.

Zusätzliche Absicherung durch APIYI: Bei der Nutzung über APIYI (apiyi.com) fallen bei einem fehlgeschlagenen Generierungsvorgang keine Kosten an – dies gilt auch für Fälle, in denen IMAGE_SAFETY eingreift. Sie zahlen nur für erfolgreich generierte Bilder.

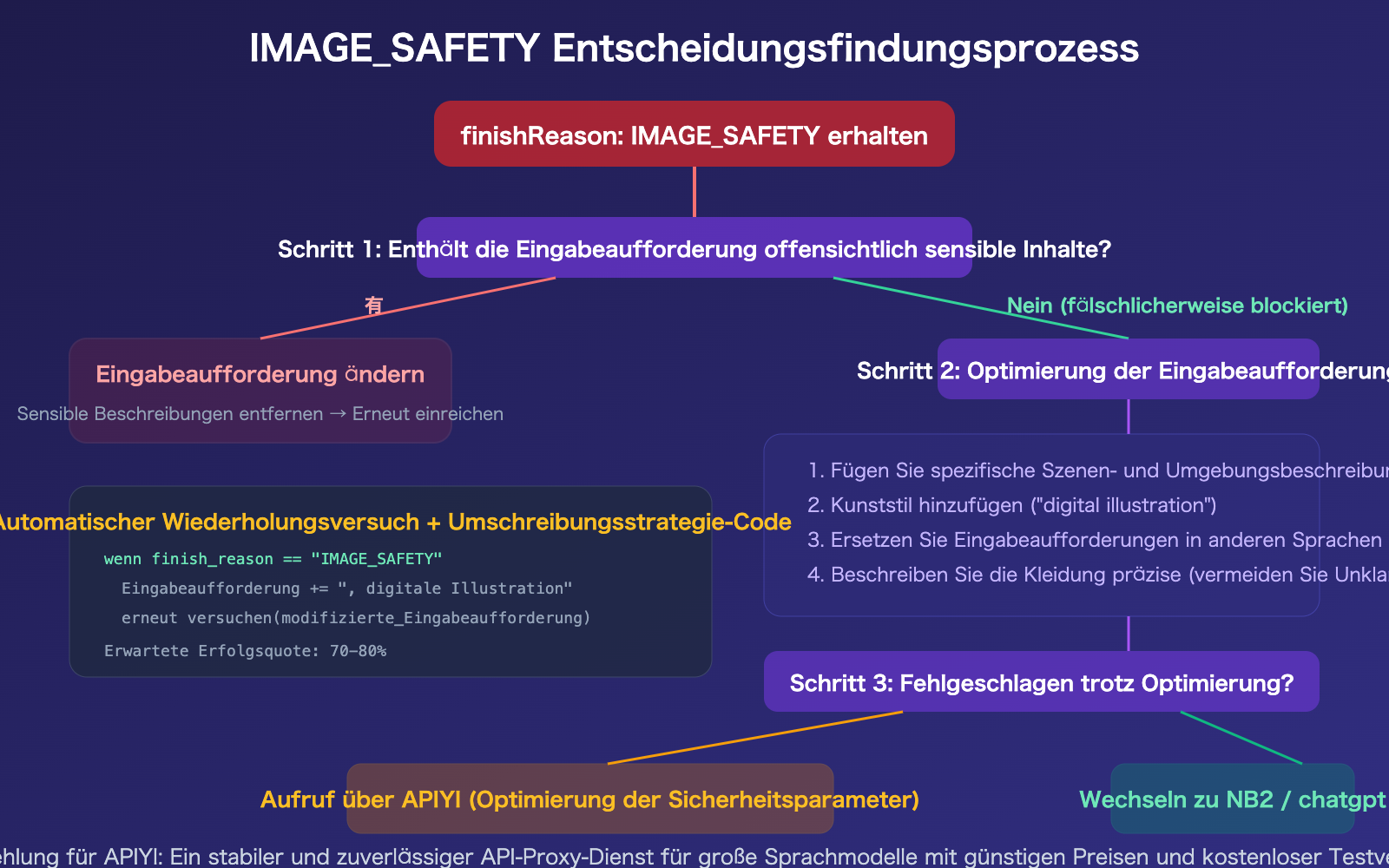

8 Methoden zur Erhöhung der Erfolgsrate bei IMAGE_SAFETY

Da die zweite Sicherheitsebene nicht deaktiviert werden kann, müssen wir indirekte Wege nutzen, um die Erfolgsquote zu verbessern.

Methode 1: BLOCK_NONE zur Deaktivierung der ersten Ebene

Stellen Sie zunächst sicher, dass die erste Ebene keine zusätzlichen Blockierungen verursacht:

from google.genai import types

safety_settings = [

types.SafetySetting(

category="HARM_CATEGORY_HARASSMENT",

threshold="BLOCK_NONE"

),

types.SafetySetting(

category="HARM_CATEGORY_HATE_SPEECH",

threshold="BLOCK_NONE"

),

types.SafetySetting(

category="HARM_CATEGORY_SEXUALLY_EXPLICIT",

threshold="BLOCK_NONE"

),

types.SafetySetting(

category="HARM_CATEGORY_DANGEROUS_CONTENT",

threshold="BLOCK_NONE"

),

]

Methode 2: Präzisere Eingabeaufforderungen

Vage Eingabeaufforderungen lösen eher Sicherheitsfilter aus. Spezifische Details führen das Modell zu "sichereren" Bildern:

❌ "Eine Frau"

→ Das Modell könnte Inhalte generieren, die vom Filter als unangemessen eingestuft werden

✅ "Eine Frau in einem professionellen Business-Anzug, arbeitet in einem modernen Büro,

natürliches Licht, digitaler Illustrationsstil"

→ Spezifische Szene + Kleiderbeschreibung + Kunststil → Deutlich höhere Erfolgsrate

Methoden 3 bis 8: Fortgeschrittene Optimierungsstrategien

| Methode | Aktion | Erwarteter Effekt |

|---|---|---|

| Methode 3: Kunststil hinzufügen | "digital illustration style" oder "watercolor style" am Ende ergänzen | Reduziert Realismus → weniger Auslöser |

| Methode 4: Kontext festlegen | Klare Szenenbeschreibung ("im Park", "im Büro") | Schränkt den Spielraum des Modells ein |

| Methode 5: Hautdarstellung vermeiden | Vage Kleidung durch "formal attire" oder "winter clothing" ersetzen | Umgeht sensible Bereiche direkt |

| Methode 6: Englische Eingabeaufforderung | Englische Prompts sind bei Sicherheitsfiltern präziser kalibriert | Weniger Fehlblockierungen |

| Methode 7: Automatischer Retry | Eingabeaufforderung bei Fehler automatisch umschreiben und erneut versuchen | Höhere Gesamterfolgsrate |

| Methode 8: Aufruf über APIYI | APIYI bietet optimierte Konfigurationen für Sicherheitsparameter | Höhere Erfolgsrate insgesamt |

Vergleich der Eingabeaufforderungen vor und nach der Optimierung

| Szene | Vor Optimierung (niedrige Rate) | Nach Optimierung (hohe Rate) |

|---|---|---|

| Personen | "Ein Mädchen im Badeanzug" | "Eine Frau in Sportkleidung beim Training im Fitnessstudio, digitaler Illustrationsstil" |

| Essen | "Steak" | "Ein medium gebratenes Steak auf einem weißen Porzellanteller, Restauranttisch, professionelle Food-Fotografie" |

| Tiere | "Ein Hund" | "Ein Golden Retriever fängt ein Frisbee im Garten, Nachmittagssonne, digitaler Illustrationsstil" |

| E-Commerce | "Dessous-Model" | "Produktaufnahme eines weißen Sport-BHs, flach gelegt, rein weißer Hintergrund, kein Model, Produktfotografie" |

🎯 Kernprinzip: Je spezifischer die Eingabeaufforderung = desto weniger Spielraum für das Modell = desto seltener wird der Sicherheitsfilter ausgelöst. Das Hinzufügen von Kunststilen (z. B. "digital illustration") kann den Realismusgrad und damit die Blockierungswahrscheinlichkeit weiter senken.

Die Erfolgsrate bei Aufrufen über APIYI (apiyi.com) ist in der Regel höher als bei einer Direktverbindung zur Google API, da die Plattform die Sicherheitsparameter optimiert hat.

Häufig gestellte Fragen

Q1: Warum werden dieselben Eingabeaufforderungen manchmal erfolgreich verarbeitet und manchmal blockiert?

Da die zweite Sicherheitsfilterebene die generierten Bilder prüft und nicht die Eingabeaufforderung. Bei derselben Eingabeaufforderung unterscheidet sich das vom Modell generierte Bild jedes Mal leicht (aufgrund der Zufälligkeit von Diffusionsmodellen). Manche Ergebnisse können zufällig den Schwellenwert des Sicherheitsfilters überschreiten. Daher kann ein erneuter Versuch mit derselben Eingabeaufforderung manchmal erfolgreich sein – das Modell hat dann zufällig ein „sichereres“ Bild generiert.

Q2: Ist es normal, dass thoughtsTokenCount größer als 0 ist, aber candidatesTokenCount 0 beträgt?

Ja, das ist normal. Dies deutet genau darauf hin, dass die Blockierung auf der zweiten Ebene (Ausgabeseite) stattgefunden hat: Das Modell hat den Denkprozess (Thinking) abgeschlossen und ein Bild generiert, aber das Bild wurde vor der endgültigen Ausgabe vom Sicherheitsfilter blockiert. Die Denk-Token wurden verbraucht (173), aber da das Bild nicht tatsächlich ausgegeben wurde, werden die Ausgabe-Token mit 0 gezählt. Dies ist ein spezifisches Antwortmuster für IMAGE_SAFETY – anders als bei einer Blockierung auf der ersten Ebene (bei der auch thoughtsTokenCount 0 wäre).

Q3: Was tun bei häufigen Blockierungen von E-Commerce-Bildern (Unterwäsche/Bademode)?

Dies ist ein bekanntes Szenario für häufige Fehlblockierungen. In den Google-Entwicklerforen gibt es zahlreiche Berichte über „non-NSFW ecommerce underwear images with IMAGE_SAFETY error“. Empfehlung: 1) Verwenden Sie Produktfotos (ohne Model) anstelle von Model-Fotos; 2) Geben Sie in der Eingabeaufforderung explizit „product flat lay, no model, white background“ an; 3) Nutzen Sie den API-Proxy-Dienst von APIYI (apiyi.com), da die Sicherheitskonfigurationen der Plattform für E-Commerce-Szenarien optimiert sind.

Q4: Werden blockierte Anfragen bei APIYI berechnet?

Nein. APIYI garantiert, dass fehlgeschlagene Generierungen nicht berechnet werden, einschließlich der Fälle von IMAGE_SAFETY-Blockierungen. Sie zahlen nur für erfolgreich generierte Bilder. Dies entspricht der Abrechnungslogik der offiziellen Google-API (blockierte Bilder werden nicht berechnet), wobei APIYI dies noch weiter absichert – selbst minimale Kosten für Eingabe-Token fallen nicht an.

Zusammenfassung

Die Kernpunkte zum IMAGE_SAFETY-Fehler bei Nano Banana Pro:

- Der Fehler ist im Wesentlichen eine Filterung der zweiten Ebene (Ausgabe): Ihre Eingabeaufforderung hat die erste Ebene passiert, das Modell hat den Denkprozess abgeschlossen (173 Token) und das Bild wurde generiert – wurde jedoch bei der endgültigen Ausgabe durch den nicht deaktivierbaren Sicherheitsfilter der zweiten Ebene blockiert.

- Blockierte Anfragen werden in der Regel nicht berechnet:

candidatesTokenCount: 0bedeutet, dass keine Ausgabe-Token berechnet werden. Google stellt klar, dass „keine Gebühren für blockierte Bilder“ anfallen. Durch die Nutzung von APIYI erhalten Sie zusätzlich die Garantie, dass bei Fehlern keine Kosten entstehen. - Optimierung der Eingabeaufforderung kann die Erfolgsrate auf 70-80 % steigern: Das Grundprinzip lautet „Je spezifischer, desto sicherer“ – fügen Sie konkrete Szenarien, künstlerische Stile und detaillierte Beschreibungen der Kleidung hinzu und verwenden Sie englische Eingabeaufforderungen.

Wir empfehlen, Nano Banana Pro über APIYI (apiyi.com) aufzurufen – durch optimierte Sicherheitskonfigurationen, keine Kosten bei Fehlern und 28 % Rabatt minimieren Sie die Auswirkungen von IMAGE_SAFETY-Fehlblockierungen auf Ihr Geschäft.

📚 Referenzmaterialien

-

Gemini API Safety Settings Dokumentation: Offizielle Erläuterung der Sicherheitseinstellungen

- Link:

ai.google.dev/gemini-api/docs/safety-settings - Beschreibung: Enthält die BLOCK_NONE-Konfiguration und eine Liste der Sicherheitskategorien

- Link:

-

Nano Banana Pro IMAGE_SAFETY Vollständiger Leitfaden zur Fehlerbehebung: 8 Methoden zur Steigerung der Erfolgsrate

- Link:

help.apiyi.com/en/nano-banana-pro-image-safety-error-fix-guide-en.html - Beschreibung: Enthält Vorlagen zur Optimierung der Eingabeaufforderung und szenariobasierte Lösungen

- Link:

-

Google AI Entwicklerforum IMAGE_SAFETY Diskussion: Community-Berichte und offizielle Antworten

- Link:

discuss.ai.google.dev/t/nano-banana-is-unusable-because-of-the-new-safety-filters/132366 - Beschreibung: Google räumt ein, dass die Filter "zu vorsichtig" eingestellt sind

- Link:

-

APIYI Dokumentationszentrum: Garantie für Nano Banana Pro – keine Gebühren bei Fehlern

- Link:

docs.apiyi.com - Beschreibung: Enthält Anleitungen zur Optimierung von Sicherheitsparametern und Konfigurationen für E-Commerce-Szenarien

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren; weitere Informationen finden Sie im APIYI Dokumentationszentrum unter docs.apiyi.com