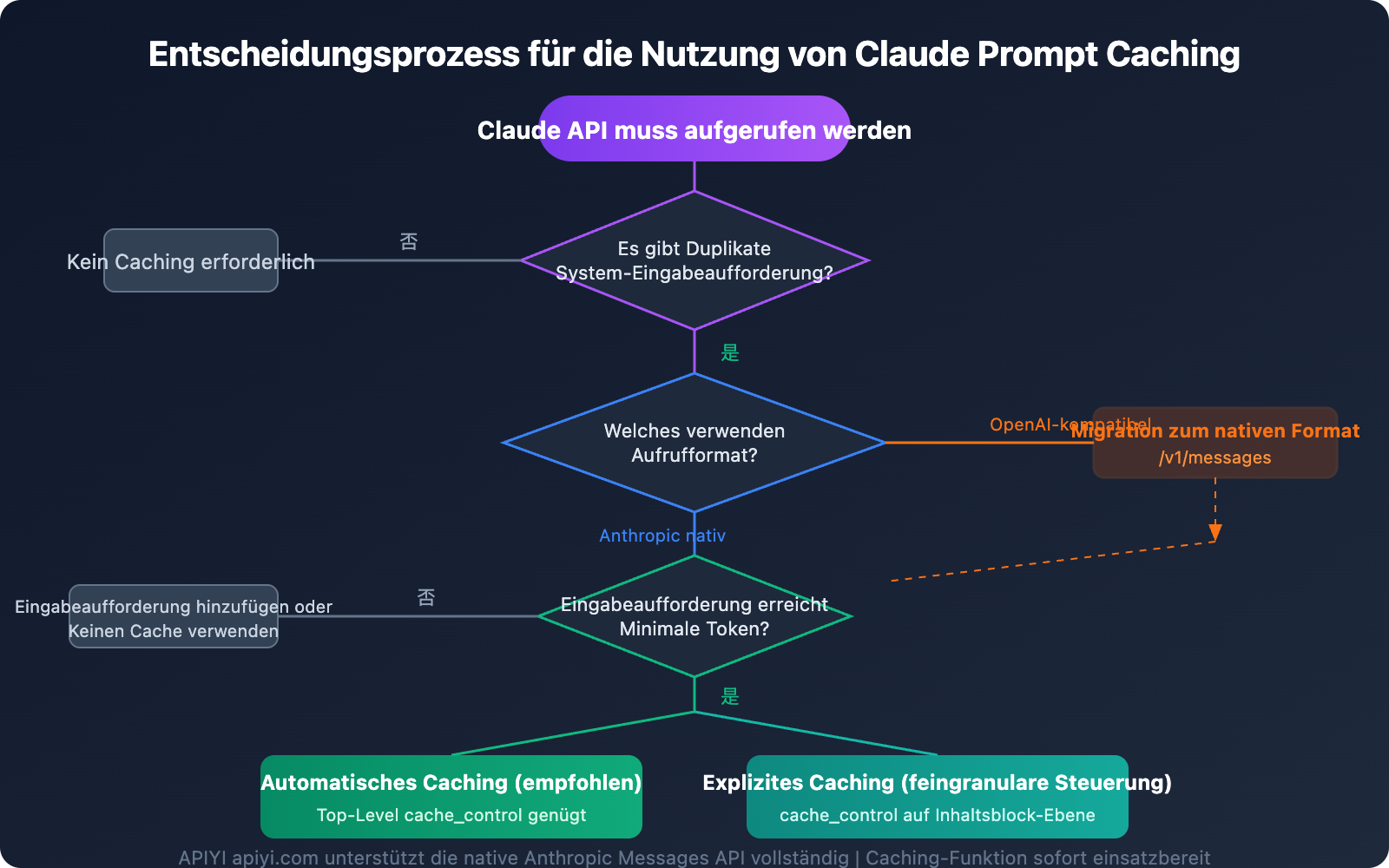

Viele Entwickler stoßen bei der Nutzung der Claude API auf ein Rätsel: Obwohl Prompt-Caching aktiviert ist, warum erscheinen keine Rabatte auf der Abrechnung?

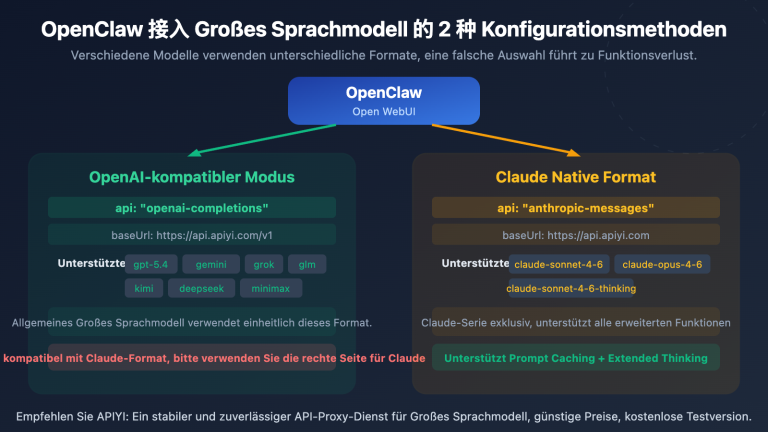

Die Antwort ist oft simpel: Sie verwenden den OpenAI-kompatiblen Modus für den Modellaufruf, aber das Caching-System von Claude unterstützt ausschließlich das native Anthropic Messages API-Format.

Das ist kein Bug, sondern eine in der offiziellen Anthropic-Dokumentation klar definierte Einschränkung. In diesem Artikel erklären wir Ihnen die technischen Hintergründe, die verschiedenen Aufrufmethoden und den Preisvergleich, damit Sie das Prompt-Caching von Claude korrekt nutzen und unnötige Kosten vermeiden.

Kernprinzipien des Claude Prompt-Caching-Mechanismus

Bevor wir uns die Unterschiede in den Aufrufformaten ansehen, sollten wir verstehen, wie das Prompt-Caching bei Claude technisch funktioniert.

Wie das Claude-Caching arbeitet

Wenn Sie eine Anfrage mit aktiviertem Prompt-Caching senden, durchläuft das System folgende Schritte:

- Cache-Prüfung: Das System prüft, ob das Präfix der Eingabeaufforderung bereits in einer der letzten Abfragen zwischengespeichert wurde.

- Cache-Treffer (Hit): Falls eine Übereinstimmung gefunden wird, wird die zwischengespeicherte Version verwendet. Dies reduziert die Verarbeitungszeit und die Kosten erheblich.

- Cache-Schreiben (Write): Bei einem Misserfolg wird die vollständige Eingabeaufforderung verarbeitet und das Präfix nach Beginn der Antwort für zukünftige Anfragen gespeichert.

| Kernparameter des Claude Prompt-Caching | Beschreibung |

|---|---|

| Cache-Typ | ephemeral (kurzlebiger Cache, derzeit der einzige unterstützte Typ) |

| Standard-TTL | 5 Minuten (wird bei jedem Treffer automatisch aktualisiert) |

| Optionale TTL | 1 Stunde (gegen Aufpreis) |

| Maximale Cache-Breakpoints | 4 cache_control-Markierungen |

| Cache-Reihenfolge | tools → system → messages |

| Cache-Abgleich | 100 % exakte Übereinstimmung des Präfixes der Eingabeaufforderung |

Was das Claude Prompt-Caching unterstützt

Das Prompt-Caching von Claude kann die meisten Inhaltsblöcke einer Anfrage zwischenspeichern:

- Tools: Werkzeugdefinitionen im

tools-Array. - System-Nachrichten: Inhaltsblöcke im

system-Array. - Text-Nachrichten: Textblöcke im

messages.content-Array. - Bilder & Dokumente: Bilder und Dokumente innerhalb der Benutzernachrichten.

- Tool-Nutzung & Ergebnisse: Inhaltsblöcke von Werkzeugaufrufen und deren Ergebnissen.

🎯 Technischer Tipp: Für Szenarien, in denen dieselbe System-Eingabeaufforderung häufig aufgerufen wird, ist Prompt-Caching die effektivste Methode zur Kostenoptimierung. Wir empfehlen, die Claude API über die Plattform APIYI (apiyi.com) im nativen Anthropic-Format zu nutzen, um voll von den Caching-Rabatten zu profitieren.

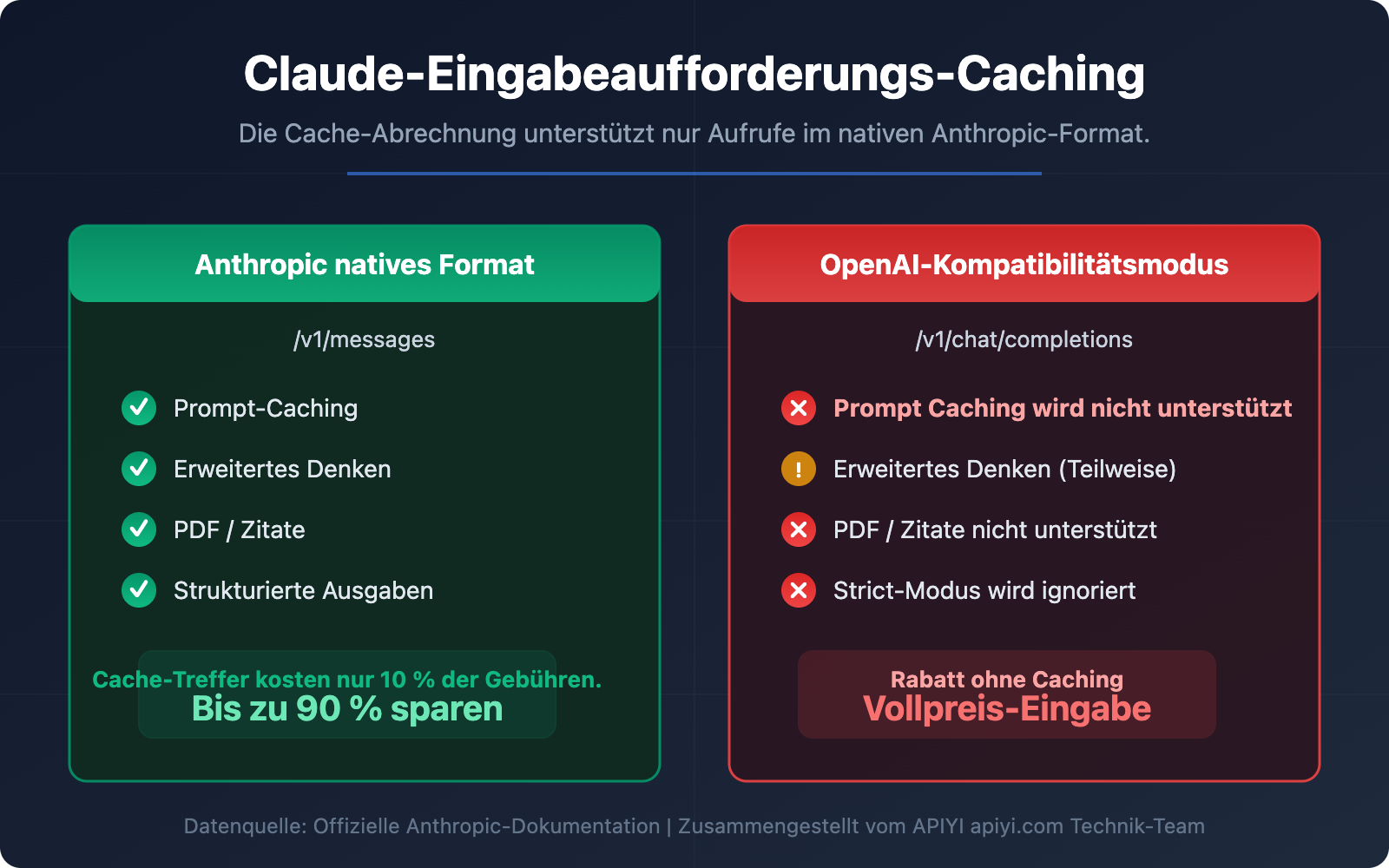

Anthropic Natives Format vs. OpenAI-Kompatibilitätsmodus: Unterschiede beim Claude-Caching

Dies ist der wichtigste Teil dieses Artikels – der fundamentale Unterschied zwischen den beiden Aufrufformaten bei der Caching-Unterstützung von Claude.

Offizielle Erklärung von Anthropic

Laut dem Originaltext der offiziellen Dokumentation von Anthropic zur OpenAI-SDK-Kompatibilität:

"Prompt caching is not supported, but it is supported in the Anthropic SDK"

Das bedeutet: Wenn Sie Claude über den OpenAI-Kompatibilitätsmodus (Endpunkt /v1/chat/completions) aufrufen, können Sie die Prompt-Caching-Funktion überhaupt nicht nutzen.

Fehlerbehebung: Häufige Gründe für Cache-Misses bei Claude

Falls Sie feststellen, dass der Cache konsequent nicht getroffen wird, überprüfen Sie die folgenden Punkte:

- Falsches Aufrufformat: Sie verwenden den OpenAI-Kompatibilitätsmodus anstelle des nativen Anthropic-Formats.

- Inkonsistenter Inhalt: Das Cache-Matching erfordert ein zu 100 % identisches Prompt-Präfix.

- Unzureichende Token: Die Mindestanforderungen des Modells für cachebare Token wurden nicht erreicht.

- Zeitüberschreitung: Der Cache ist abgelaufen, da er länger als 5 Minuten nicht verwendet wurde.

- Parameteränderungen:

tool_choice, Bildinhalte oder Thinking-Parameter wurden modifiziert.

Mindestanforderungen für Cache-Token der Claude-Modelle

| Modellserie | Mindestanzahl cachebarer Token |

|---|---|

| Claude Opus 4.6 / Opus 4.5 | 4.096 Token |

| Claude Sonnet 4.6 / Sonnet 4.5 / Sonnet 4 / Opus 4.1 / Opus 4 | 1.024 Token |

| Claude Haiku 4.5 | 4.096 Token |

| Claude Haiku 3.5 / Haiku 3 | 2.048 Token |

Wenn Ihre Eingabeaufforderung die Mindestanzahl an Token nicht erreicht, wird die cache_control-Einstellung nicht wirksam – die Anfrage wird normal verarbeitet, aber nicht im Cache gespeichert.

🎯 Debugging-Tipp: Wenn Sie Claude-Modellaufrufe über die Plattform APIYI (apiyi.com) tätigen, können Sie anhand des

usage-Feldes in der Antwort schnell beurteilen, ob das Caching funktioniert. Wenn sowohlcache_read_input_tokensals auchcache_creation_input_tokensden Wert 0 haben, wurde die Caching-Funktion nicht korrekt aktiviert.

Claude Prompt Caching – Häufig gestellte Fragen (FAQ)

Q1: Kann ich Claude im OpenAI-kompatiblen Modus mit Caching aufrufen?

Nein. Dies ist eine von Anthropic offiziell erklärte Einschränkung. Der OpenAI-kompatible Modus (Endpunkt /v1/chat/completions) unterstützt kein Prompt Caching. Sie müssen das native Anthropic Messages API-Format (Endpunkt /v1/messages) verwenden, um die Caching-Funktion nutzen zu können.

Über die Plattform APIYI (apiyi.com) können Sie Claude-APIs in beiden Formaten aufrufen – wenn Sie die Caching-Funktion benötigen, wählen Sie einfach den Endpunkt /v1/messages.

Q2: Das Schreiben in den Claude-Cache ist teurer als die normale Eingabe. Lohnt es sich trotzdem?

Absolut. Das Schreiben in den Cache ist nur etwa 25 % teurer als die Basiseingabe (bei einer TTL von 5 Minuten), aber ein Cache-Treffer kostet nur 10 % der regulären Gebühr. Sobald derselbe Inhalt mehr als zweimal verwendet wird, hat sich die Investition amortisiert und Sie beginnen zu sparen. Nehmen wir einen System-Prompt mit 100.000 Token als Beispiel:

- Ohne Cache: 0,30 $ pro Aufruf (Sonnet 3.5)

- Cache-Schreibvorgang: 0,375 $ (nur beim ersten Mal)

- Cache-Lesezugriff: 0,03 $ (bei jedem weiteren Mal)

- Bereits ab dem zweiten Aufruf sparen Sie Geld.

Q3: Wie migriere ich im Code vom OpenAI-Format zum nativen Anthropic-Format?

Die wichtigsten Anpassungen sind:

- Endpunkt:

/v1/chat/completions→/v1/messages - Header: Fügen Sie

anthropic-version: 2023-06-01hinzu. - Nachrichtenformat: Die Struktur des

messages-Arrays ist weitgehend identisch. - System-Prompt: Extrahieren Sie diesen aus

messagesin ein eigenständigessystem-Feld. - Parameter: Fügen Sie den Parameter

cache_controlhinzu.

Die Plattform APIYI (apiyi.com) unterstützt beide Endpunkte. Bei der Migration müssen Sie lediglich den Pfad und das Format der Anfrage ändern; Ihr API-Schlüssel bleibt gleich.

Q4: Kann der Claude-Cache über verschiedene Anfragen hinweg geteilt werden?

Der Cache wird innerhalb desselben Workspaces geteilt (seit dem 5. Februar 2026 wurde dies von der Organisationsebene auf Workspace-Ebene isoliert). Zwischen verschiedenen Organisationen wird der Cache niemals geteilt.

Q5: Können Caching und die Batch-API kombiniert werden?

Ja. Die Batch-API bietet bereits einen Rabatt von 50 %, und die Preisvorteile des Cachings werden darauf aufgerechnet. Die Kombination beider Methoden ermöglicht die maximale Kostenoptimierung. Für Batch-Szenarien empfiehlt sich eine Cache-TTL von einer Stunde, um die Trefferrate zu erhöhen.

Zusammenfassung: 3 Kernpunkte zur Claude Prompt Caching Abrechnung

Basierend auf dieser Analyse sollten Sie sich drei wichtige Punkte zum Claude Prompt Caching merken:

- Nur natives Anthropic-Format: Die Caching-Funktion ist nur über den Endpunkt

/v1/messagesverfügbar. Der OpenAI-kompatible Modus (/v1/chat/completions) unterstützt dies nicht. - Cache-Treffer kosten nur 10 %: Das erste Schreiben kostet 25 % extra, aber jeder folgende Treffer kostet nur ein Zehntel des Basispreises. Nach zwei Aufrufen lohnt es sich bereits.

- Die richtige Aufrufmethode ist entscheidend: Verwenden Sie den Parameter

cache_control: {"type": "ephemeral"}, um sicherzustellen, dass die Mindestanforderungen des Modells an die Token-Anzahl für das Caching erfüllt werden.

Wir empfehlen, die vollständigen Funktionen des Claude Prompt Caching über die Plattform APIYI (apiyi.com) auszuprobieren. Die Plattform unterstützt die native Anthropic Messages API vollständig und hilft Ihnen, Claude-Modelle zu optimalen Kosten zu nutzen.

Referenzen

-

Offizielle Anthropic-Dokumentation zu Prompt Caching: Detaillierte Erläuterung der Claude API-Caching-Funktion

- Link:

platform.claude.com/docs/en/build-with-claude/prompt-caching

- Link:

-

Offizielle Anthropic-Preisseite: Preise für Claude-Modelle und Caching

- Link:

platform.claude.com/docs/en/about-claude/pricing

- Link:

-

Dokumentation zur OpenAI SDK-Kompatibilität: Erläuterung der Funktionseinschränkungen im Kompatibilitätsmodus

- Link:

platform.claude.com/docs/en/api/openai-sdk

- Link:

📝 Autor: APIYI Team | APIYI Technik-Team, spezialisiert auf die Integration von APIs für Große Sprachmodelle und den Austausch von technischem Wissen. Besuchen Sie apiyi.com für weitere technische Tutorials.