Perbandingan Fitur Dua Format Pemanggilan API Claude

| Fitur/Karakteristik | Format Native Anthropic | Mode Kompatibel OpenAI |

|---|---|---|

| Cache Prompt Caching | ✅ Mendukung penuh | ❌ Tidak mendukung |

| Pemrosesan dokumen PDF | ✅ Mendukung | ❌ Tidak mendukung |

| Sitasi (Citations) | ✅ Mendukung | ❌ Tidak mendukung |

| Output Lengkap Extended Thinking | ✅ Mendukung | ⚠️ Mendukung sebagian (tidak bisa melihat proses berpikir) |

| Output Streaming | ✅ Mendukung | ✅ Mendukung |

| Pemanggilan Alat (Tool Use) | ✅ Mendukung | ✅ Mendukung |

| Visi (Pemahaman Gambar) | ✅ Mendukung | ✅ Mendukung |

| Output Terstruktur | ✅ Mendukung (mode strict) | ❌ Parameter strict diabaikan |

Mengapa Mode Kompatibel OpenAI Tidak Mendukung Cache Claude

Desain mode kompatibel OpenAI ditujukan untuk pengujian dan perbandingan kemampuan model, bukan untuk penggunaan di lingkungan produksi:

- Perbedaan Protokol: Parameter

cache_controladalah field asli dari API Messages Anthropic, yang tidak memiliki padanan field dalam format chat completions OpenAI. - Batasan Arsitektur: Lapisan kompatibilitas perlu mengonversi format OpenAI ke format Anthropic, dan dalam proses konversi ini, informasi kontrol cache akan hilang.

- Pertimbangan Prioritas: Anthropic secara resmi menyatakan bahwa prioritas lapisan kompatibilitas lebih rendah dibandingkan keandalan dan kelengkapan fitur API Claude native.

💡 Tips Penting: Jika bisnis Anda bergantung pada prompt caching untuk mengontrol biaya, Anda wajib menggunakan format API Messages Native Anthropic, bukan mode kompatibel OpenAI.

Detail Harga Cache Prompt Caching Claude: Hemat Biaya Hingga 90%

Struktur harga prompt caching Claude adalah bagian yang paling menarik—harga pembacaan saat cache hit hanya 10% dari harga input dasar.

Perbandingan Harga Cache Semua Model Claude

| Model | Input Dasar | Penulisan Cache 5 Menit | Penulisan Cache 1 Jam | Pembacaan Cache | Output |

|---|---|---|---|---|---|

| Claude Opus 4.6 | $5/MTok | $6.25/MTok | $10/MTok | $0.50/MTok | $25/MTok |

| Claude Sonnet 4.6 | $3/MTok | $3.75/MTok | $6/MTok | $0.30/MTok | $15/MTok |

| Claude Sonnet 4.5 | $3/MTok | $3.75/MTok | $6/MTok | $0.30/MTok | $15/MTok |

| Claude Haiku 4.5 | $1/MTok | $1.25/MTok | $2/MTok | $0.10/MTok | $5/MTok |

MTok = Juta Token. Sumber data: Halaman harga resmi Anthropic (Februari 2026)

Aturan Perhitungan Harga Cache Claude

Harga cache mengikuti 3 aturan pengali sederhana:

- Penulisan Cache 5 Menit: Harga input dasar × 1.25

- Penulisan Cache 1 Jam: Harga input dasar × 2.0

- Pembacaan Cache (Hit): Harga input dasar × 0.1

Sebagai contoh Claude Sonnet 4.6, asumsikan Anda memiliki petunjuk sistem sebesar 100.000 Token:

| Skenario | Biaya input per permintaan | Total biaya untuk 10.000 permintaan |

|---|---|---|

| Tanpa menggunakan cache | $0.30 | $3,000 |

| Permintaan pertama (penulisan cache) | $0.375 | Biaya satu kali |

| Permintaan berikutnya (cache hit) | $0.03 | $300 |

| Rasio penghematan | Sekitar 90% |

💰 Optimasi Biaya: Untuk skenario yang menggunakan system prompt yang sama secara berulang, memanggil API Claude dalam format native Anthropic melalui platform APIYI (apiyi.com) memungkinkan Anda memanfaatkan prompt caching sepenuhnya untuk mencapai penghematan biaya hingga 90%.

Berikut adalah contoh kode praktis untuk menunjukkan cara mengaktifkan Claude prompt caching dengan benar.

Contoh Pemanggilan Dasar: Format Native Anthropic + Extended Thinking

curl https://api.apiyi.com/v1/messages \

-H "Content-Type: application/json" \

-H "Authorization: Bearer sk-YOUR_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-d '{

"model": "claude-sonnet-4-6",

"max_tokens": 16000,

"stream": false,

"thinking": {

"type": "enabled",

"budget_tokens": 10000

},

"messages": [

{

"role": "user",

"content": "Berapa hasil dari 27 * 453?"

}

]

}'

Di atas adalah pemanggilan dasar format native Anthropic yang menggunakan fitur Extended Thinking. Sekarang, mari kita lihat cara mengaktifkan prompt caching di atasnya.

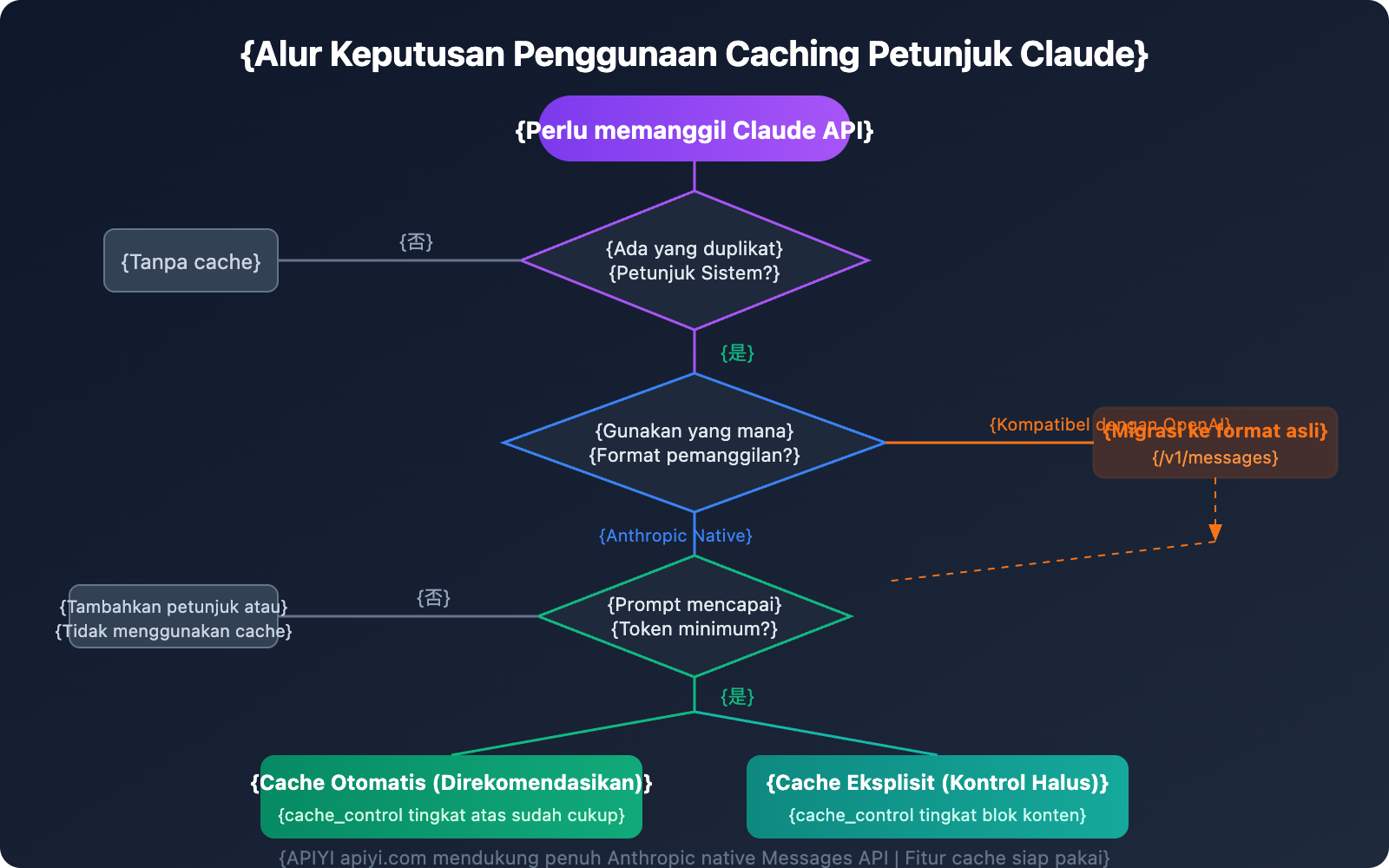

Mode Cache Otomatis: Cara Termudah Mengaktifkan Cache Claude

Cache otomatis adalah cara paling sederhana untuk mengaktifkan Claude prompt caching — cukup tambahkan field cache_control di level teratas body permintaan:

curl https://api.apiyi.com/v1/messages \

-H "Content-Type: application/json" \

-H "Authorization: Bearer sk-YOUR_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-d '{

"model": "claude-sonnet-4-6",

"max_tokens": 1024,

"cache_control": {"type": "ephemeral"},

"system": "Anda adalah asisten dokumentasi teknis profesional yang membantu pengguna memahami cara penggunaan dan praktik terbaik model AI. Jawaban Anda harus akurat, ringkas, dan praktis.",

"messages": [

{"role": "user", "content": "Apa saja fitur utama Claude Sonnet 4.6?"},

{"role": "assistant", "content": "Claude Sonnet 4.6 adalah model berperforma tinggi yang diluncurkan oleh Anthropic..."},

{"role": "user", "content": "Berapa besar jendela konteksnya?"}

]

}'

Dalam mode cache otomatis, sistem akan secara otomatis menempatkan breakpoint cache pada blok konten terakhir yang dapat dicache. Dalam percakapan multi-turn, titik cache akan bergerak maju secara otomatis seiring bertambahnya percakapan.

Mode Cache Eksplisit: Kontrol Presisi Konten Cache Claude

Untuk skenario yang membutuhkan kontrol halus atas perilaku caching,

Claude Prompt Caching FAQ

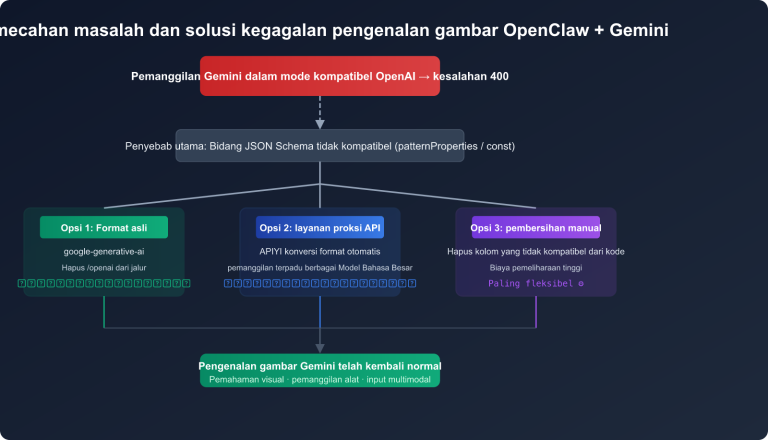

Q1: Bisakah saya menggunakan caching saat memanggil Claude dalam mode kompatibilitas OpenAI?

Tidak bisa. Ini adalah batasan resmi yang dinyatakan dengan jelas oleh Anthropic. Mode kompatibilitas OpenAI (endpoint /v1/chat/completions) tidak mendukung prompt caching. Anda harus menggunakan format Anthropic Messages API asli (endpoint /v1/messages) untuk bisa menggunakan fitur caching.

Melalui platform APIYI apiyi.com, Anda bisa menggunakan kedua format tersebut untuk melakukan pemanggilan model Claude—jika membutuhkan fitur caching, cukup pilih endpoint /v1/messages.

Q2: Penulisan cache Claude lebih mahal daripada input biasa, apakah masih layak digunakan?

Sangat layak. Penulisan cache hanya lebih mahal 25% dari input dasar (dengan TTL 5 menit), tetapi biaya untuk hit cache hanya 10% dari harga normal. Selama konten yang sama digunakan lebih dari 2 kali, Anda sudah balik modal dan mulai menghemat uang. Sebagai contoh dengan system prompt sebesar 100 ribu Token:

- Tanpa cache: $0.30 per panggilan (Sonnet 3.5)

- Penulisan cache: $0.375 (hanya untuk pertama kali)

- Pembacaan cache: $0.03 (setiap pemanggilan berikutnya)

- Anda mulai menghemat uang sejak pemanggilan ke-2

Q3: Bagaimana cara migrasi dari format OpenAI ke format asli Anthropic dalam kode?

Poin-poin perubahan utamanya adalah:

- Endpoint:

/v1/chat/completions→/v1/messages - Header permintaan: Tambahkan

anthropic-version: 2023-06-01 - Format pesan: Struktur array

messagespada dasarnya sama - System prompt: Diekstrak dari

messageske dalam fieldsystemyang terpisah - Tambahkan parameter

cache_control

Platform APIYI apiyi.com mendukung kedua endpoint tersebut secara bersamaan. Saat migrasi, Anda hanya perlu mengubah jalur permintaan dan formatnya saja, tanpa perlu mengganti kunci API.

Q4: Apakah cache Claude bisa dibagikan antar permintaan?

Cache dibagikan di dalam Workspace yang sama (mulai 5 Februari 2026, isolasi diubah dari tingkat organisasi ke tingkat Workspace). Cache tidak akan pernah dibagikan antar organisasi yang berbeda.

Q5: Apakah caching dan Batch API bisa digunakan bersamaan?

Bisa. Batch API memberikan diskon 50%, dan pengali harga caching akan ditumpuk di atas diskon tersebut. Kombinasi keduanya dapat menghasilkan optimasi biaya yang maksimal. Disarankan untuk menggunakan TTL cache 1 jam pada skenario pemrosesan batch untuk meningkatkan rasio hit cache.

Kesimpulan: 3 Poin Inti Mengenai Penagihan Claude Prompt Caching

Berdasarkan analisis dalam artikel ini, ada 3 poin kunci yang perlu Anda ingat mengenai penagihan prompt caching Claude:

- Hanya mendukung format asli Anthropic: Fitur caching hanya tersedia di endpoint

/v1/messages, mode kompatibilitas OpenAI (/v1/chat/completions) tidak mendukungnya. - Biaya hit cache hanya 10%: Penulisan pertama kali memang 25% lebih mahal, tetapi setiap hit berikutnya hanya memakan biaya sepersepuluh dari harga dasar. Anda balik modal hanya dalam 2 kali pemanggilan.

- Cara pemanggilan yang benar adalah kuncinya: Gunakan parameter

cache_control: {"type": "ephemeral"}dan pastikan jumlah Token memenuhi persyaratan minimum cache model.

Direkomendasikan untuk mencoba fitur lengkap Claude prompt caching melalui platform APIYI apiyi.com. Platform ini mendukung penuh Anthropic Messages API asli, membantu Anda menggunakan model Claude dengan biaya yang paling optimal.

Referensi

-

Dokumentasi Resmi Prompt Caching Anthropic: Penjelasan mendalam fitur cache API Claude

- Tautan:

platform.claude.com/docs/en/build-with-claude/prompt-caching

- Tautan:

-

Halaman Harga Resmi Anthropic: Harga model Claude dan caching

- Tautan:

platform.claude.com/docs/en/about-claude/pricing

- Tautan:

-

Dokumentasi Kompatibilitas SDK OpenAI: Penjelasan batasan fitur mode kompatibilitas

- Tautan:

platform.claude.com/docs/en/api/openai-sdk

- Tautan:

📝 Penulis: Tim APIYI | Tim Teknis APIYI, berfokus pada integrasi API Model Bahasa Besar AI dan berbagi pengetahuan teknis. Kunjungi apiyi.com untuk mendapatkan lebih banyak tutorial teknis.