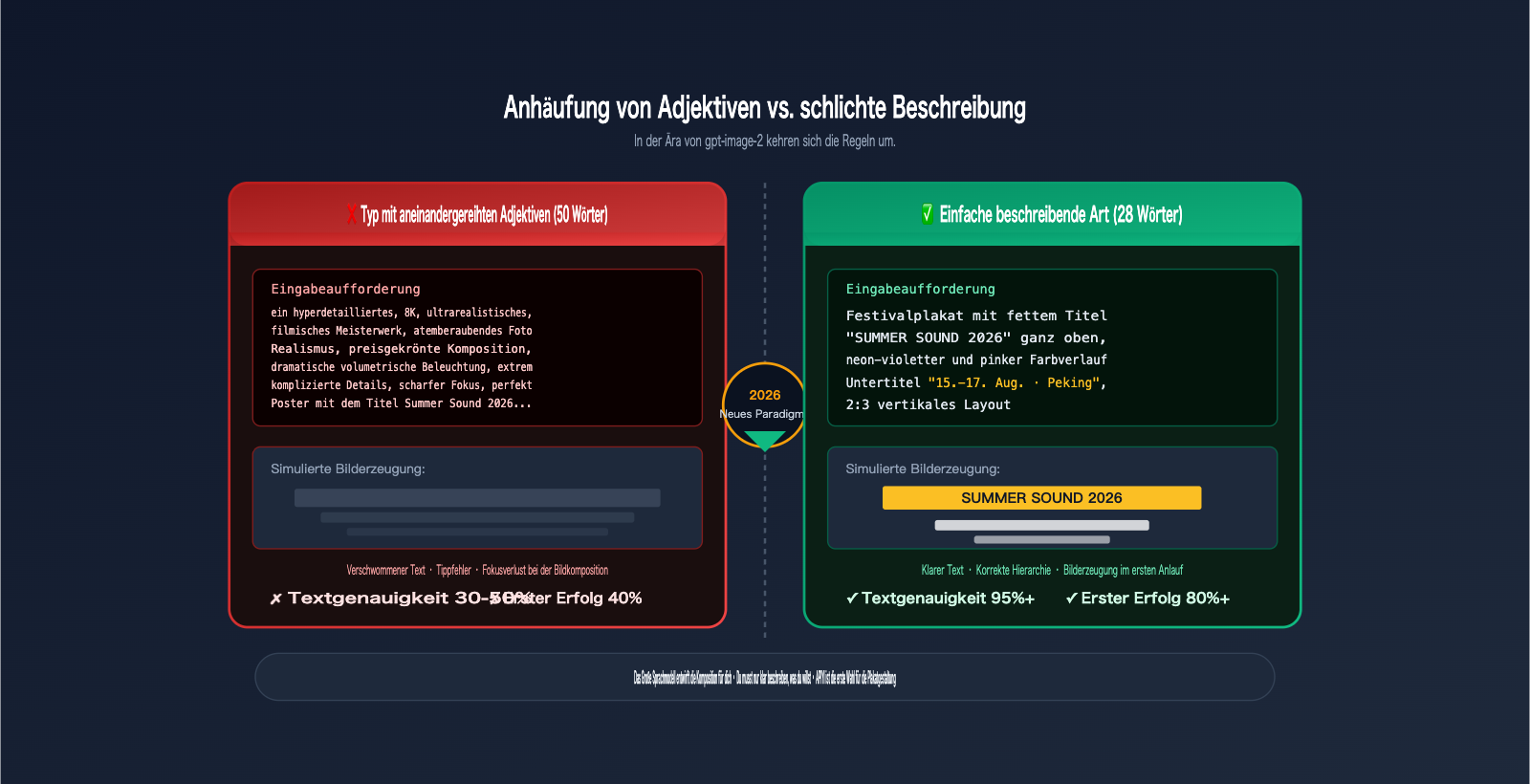

Falls Sie im letzten Jahr Poster oder Cover mit Midjourney oder Stable Diffusion erstellt haben, dürfte Ihnen diese „Zauberformel“ bestens bekannt sein:

a hyper-detailed, 8K, ultra-realistic, cinematic masterpiece,

stunning photorealism, award-winning composition, dramatic lighting,

extremely intricate details, sharp focus, masterpiece...

Man reiht 50 Adjektive aneinander, und am Ende ist der Text auf dem Poster trotzdem nur ein verschwommener Brei.

Seit der Veröffentlichung von gpt-image-2 durch OpenAI am 21. April 2026 hat sich dieser Ansatz grundlegend geändert. Das Feedback unserer Kunden ist einhellig: Einfache, klare Eingabeaufforderungen + den gewünschten Text in englische Anführungszeichen setzen = perfekte Poster. Man muss keine Zaubersprüche mehr auswendig lernen oder Adjektive stapeln, und die Textdarstellung ist bei über 95 % der ersten Versuche korrekt.

Dies ist der entscheidende Paradigmenwechsel von gpt-image-2 gegenüber der traditionellen KI-Bilderzeugung: Das Modell versteht die Komposition von selbst – Sie müssen nur klar formulieren, was Sie möchten.

In diesem Artikel haben wir drei praxiserprobte Ressourcen für Sie zusammengestellt:

- 10 häufige Anwendungsfälle für Poster/Cover (Blog / Newsletter / Social Media / Musikfestival / Produkt / Buch / Magazin / Video-Plattform / Banner / Feiertage)

- 3 sofort einsatzbereite, einfache Eingabeaufforderungen (inkl. Empfehlungen für API-Parameter und Qualitätsstufen)

- Die 1-Anführungszeichen-Regel (Setzen Sie den anzuzeigenden Text in englische Anführungszeichen – das verdoppelt Ihre Erfolgsquote bei der Bilderzeugung)

Nach diesem Artikel wissen Sie, wann Sie für gpt-image-2 kurze Prompts schreiben sollten, warum das Stapeln von Adjektiven eher schadet und wie Sie dies in Ihren eigenen Projekten über API-Proxy-Dienste wie APIYI (apiyi.com) skalierbar umsetzen können.

{gpt-image-2 für die Bilderzeugung von Postern}

{Einfache Eingabeaufforderung · Deckt 10 Hauptszenarien ab · Bilderzeugung in einem Durchgang}

{16:9 · Blog-Titelbild}

{2:3}

{3:4}

{16:9 · Videocover}

{1:1 · Produkt-Hauptbild}

{3:4 · Magazin}

{21:9 · Werbebanner}

{Frohes chinesisches Neujahrsfest}

{Ausgabe 42}

{Offizieller Account 2.35:1}

{2:3 · Bücher}

{95%+}

{Textgenauigkeit}

{4K}

{Native Ausgabe}

{Einfache Eingabeaufforderung}

{🎨 10 große Anwendungsszenarien}

{✅ Text zu über 95 % genau}

{APIYI.com}

I. Warum gpt-image-2 für Poster mit einfachen Eingabeaufforderungen auskommt

1.1 Die drei großen Revolutionen von gpt-image-2

Bevor wir über „einfache Eingabeaufforderungen“ (Plain Prompts) sprechen, sollten wir verstehen, warum gpt-image-2 das schafft: „Text eingeben und er wird korrekt dargestellt, um das Layout musst du dir keine Sorgen machen“.

| Fähigkeit | Vorgängermodelle | gpt-image-2 |

|---|---|---|

| Text-Rendering-Genauigkeit | 60–70 %, oft verschwommen/falsch | >95 % sofort korrekt |

| Mehrsprachigkeit | Hauptsächlich Englisch | Lateinisch / Chinesisch / Japanisch / Koreanisch / Arabisch / Hindi |

| Native Auflösung | 1024–2048 | Nativ 4K (3840×2160) |

| Physikalische Konsistenz | Hände/Gebäude oft verzerrt | Omni-Attention-Architektur reduziert Verzerrungen massiv |

| Inferenz-Modus | Ein-Schritt-Sampling | Erst Layout planen, dann generieren, selbstprüfend und iterativ |

| Output pro Durchgang | 1 Bild | Bis zu 10 Bilder in einer konsistenten Serie |

Der entscheidende Punkt ist der fünfte: Erst Layout planen, dann generieren. Das Modell „überlegt“ intern zuerst, wie das Poster aufgebaut sein sollte – wo der Titel steht, wo der Untertitel, wie viel Weißraum gelassen wird, wie groß das Hauptmotiv ist – und beginnt erst dann mit dem Zeichnen. Das bedeutet, du musst das Layout nicht in der Eingabeaufforderung „Schritt für Schritt anleiten“; das Modell ist darin besser als du.

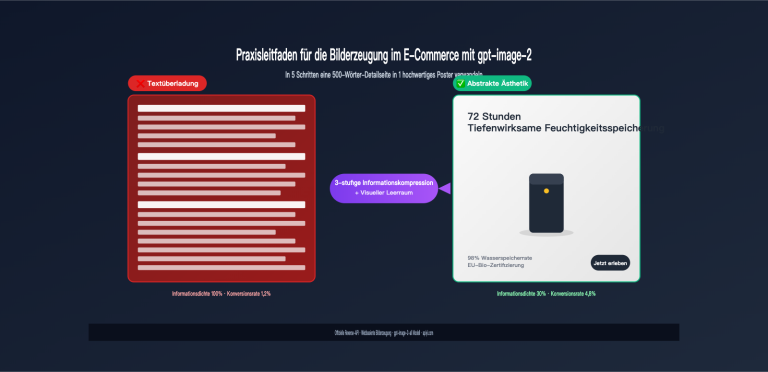

1.2 Einfache vs. überladene Eingabeaufforderungen: Eine Übersicht

Dies ist die wichtigste Tabelle des gesamten Artikels. Verinnerliche sie, bevor du weiterliest:

| Vergleichsdimension | Überladen (Midjourney/SD-Stil) | Einfach/Beschreibend (Ideal für gpt-image-2) |

|---|---|---|

| Länge | 50–150 Wörter | 15–40 Wörter |

| Anzahl der Adjektive | 10+ (8K/Meisterwerk/filmisch/preisgekrönt) | 2–3 reichen aus |

| Textdarstellung | Nicht zitiert, Modell rät | In englische Anführungszeichen gesetzt |

| Layout-Anweisungen | "zentriert / Drittel-Regel / symmetrisch…" | Einfach beschreiben oder weglassen |

| Licht-Anweisungen | "dramatisches kinoreifes volumetrisches Licht" | "weiches Morgenlicht" reicht |

| Erfolgsquote beim ersten Versuch | 40–60 % | 80 %+ |

| Textgenauigkeit | 30–50 % | >95 % |

| Iterationen | Oft 5–10 Runden nötig | Normalerweise 1–2 Runden |

Warum ist das so? Weil gpt-image-2 ein „Inferenz-Modell“ ist. Es behandelt die Eingabeaufforderung als einen Text, der verstanden werden muss, und nicht als eine Ansammlung von Schlagworten. Das Anhäufen von Adjektiven lenkt es nur ab – es versucht, „allen 50 Wörtern gleichzeitig gerecht zu werden“, was zu verschwommenem Text, chaotischen Elementen und einem zerstreuten Fokus führt.

1.3 Die Anführungszeichen-Regel (Quote Rule): Die wichtigste Regel überhaupt

Dies ist die erste Regel, die du für Poster mit gpt-image-2 beherrschen musst:

📌 Anführungszeichen-Regel: Wenn ein Text buchstabengetreu auf dem Poster erscheinen soll, setze ihn in englische Anführungszeichen; oder verwende ALL CAPS (Großbuchstaben). Andere Beschreibungen können in natürlicher Sprache verfasst werden.

Vergleich:

# ❌ Unpräzise Schreibweise

A festival poster with the title Summer Sound 2026 in bold

# ✅ Einfache Schreibweise (Empfohlen)

Festival poster with bold title "SUMMER SOUND 2026" at the top

Die zweite Schreibweise „sperrt“ die Zeichenfolge "SUMMER SOUND 2026", sodass das Modell sie exakt so rendern muss. In unseren Kundentests hat diese Regel die Fehlerrate bei Texten von etwa 30 % auf unter 5 % gesenkt.

II. 10 typische Anwendungsszenarien für Poster mit gpt-image-2

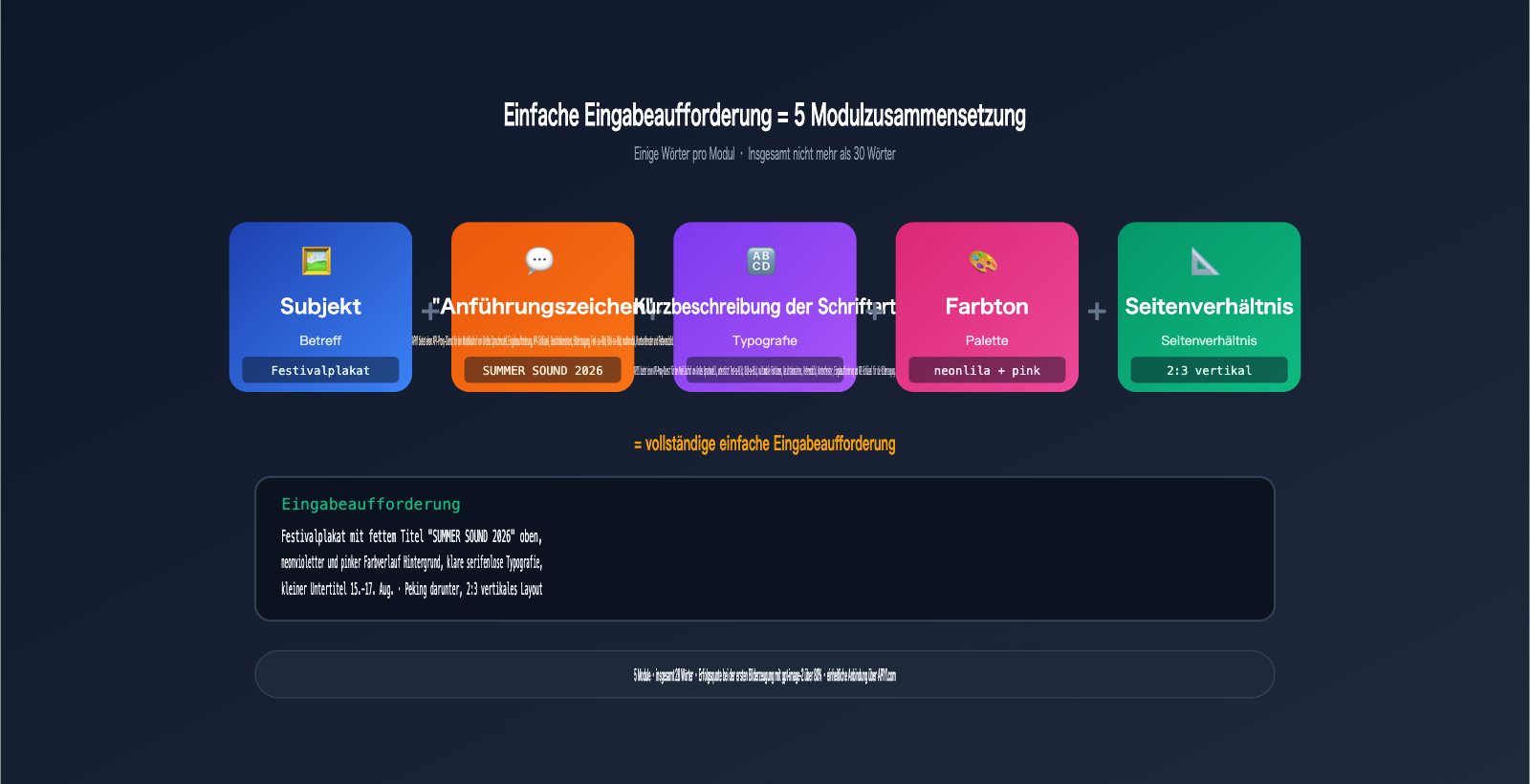

Bevor ich dir die Parametertabelle gebe, hier eine Schnellübersicht für 10 häufige Szenarien. Die Eingabeaufforderung für jedes Szenario folgt demselben Muster:

[Szenario-Hauptteil] + "Anführungszeichen-Text" + [Schriftart-Kurzbeschreibung] + [Farbton] + [Seitenverhältnis]

| # | Szenario | Empfohlenes Verhältnis / Größe | Typische Verwendung |

|---|---|---|---|

| 1 | Blog-Artikel-Cover | 16:9 · 1920×1080 | Tech-Blogs, Artikel-Header |

| 2 | WeChat-Artikel-Cover | 2.35:1 · 1920×815 | Hauptbild für Artikel |

| 3 | Xiaohongshu-Cover | 3:4 · 1080×1440 | Empfehlungen / Tutorials / Tipps |

| 4 | Musikfestival/Event-Poster | 2:3 · 1200×1800 | Live-Events, Messen |

| 5 | Produkt-Launch-Poster | 1:1 · 2048×2048 | Produktneuheiten, E-Commerce |

| 6 | Buch-/E-Book-Cover | 2:3 · 1600×2400 | Veröffentlichungen, Content-Paid |

| 7 | Magazin-Cover | 3:4 · 1500×2000 | Masthead + mehrspaltige Titel |

| 8 | Bilibili / YouTube-Thumbnail | 16:9 · 1280×720 | Titel + Hauptmotiv |

| 9 | Horizontales Werbebanner | 21:9 · 2400×800 | Web / App-Werbeflächen |

| 10 | Feiertags-Marketing-Poster | Verschiedene Verhältnisse | Neujahr / Events / International |

Hier sind die einfachen Eingabeaufforderungs-Vorlagen für jedes Szenario – du kannst sie direkt nach dem Anpassen der Texte verwenden.

2.1 Blog-Artikel-Cover (16:9)

Minimalist blog cover, dark navy background,

centered white title "Understanding Transformers" in bold serif,

small abstract neural network pattern on the right,

16:9 horizontal layout

Tipp: Dunkler Hintergrund + weißer Titel – Leser erkennen das sofort im Feed.

2.2 WeChat-Artikel-Cover (2.35:1)

WeChat article cover, 2.35:1 horizontal,

left side big text "AI Weekly · Issue 23" in bold sans-serif,

right side abstract tech illustration, gradient blue background

Tipp: Das Verhältnis 2.35:1 ist Standard für Artikel-Header; Text links platzieren, um das Vorschaubild rechts nicht zu verdecken.

2.3 Xiaohongshu-Cover (3:4)

Cozy lifestyle cover, warm morning light,

top-left pink tag says "AI Guide",

center large text "5 Tips" with hand-drawn underline,

3:4 vertical, soft pastel colors

Tipp: Xiaohongshu-Nutzer bevorzugen „handgeschriebene“ Ästhetik und warme Töne.

2.4 Musikfestival/Event-Poster (2:3)

Festival poster with bold title "SUMMER SOUND 2026" at the top,

neon purple and pink gradient background, abstract sound waves,

small subtitle "Aug 15-17 · Beijing" below,

clean sans-serif typography, 2:3 vertical layout

Tipp: Großer Titel + Untertitel in Anführungszeichen – die Inferenz-Fähigkeit von gpt-image-2 ordnet die Hierarchie automatisch.

2.5 Produkt-Launch-Poster (1:1)

Product launch poster, 1:1 square,

centered bold text "PIXEL PRO 2026",

small tagline "See more. Think less." below,

clean white background, subtle product silhouette on the right

Tipp: Markenname in Großbuchstaben, Tagline mit großem Anfangsbuchstaben – die beste Kombination für gpt-image-2.

2.6 Buch-/E-Book-Cover (2:3)

Book cover design, 2:3 vertical,

top title "THE LAST ARCHIVIST" in elegant serif,

bottom author name "By J. M. Kline" in small caps,

moody sci-fi atmosphere, silhouette of a figure on a cliff,

muted blue and amber tones

Tipp: Titel + Autor in Anführungszeichen – das Modell richtet sie automatisch nach Branchenstandard aus.

2.7 Magazin-Cover (3:4)

Magazine cover mockup, 3:4 vertical,

big masthead "FUTURE" at top in bold sans-serif,

left column "Issue 42" "April 2026",

main photo is a close-up portrait with studio lighting,

cover story text "The New AI Creators" in white overlay

Tipp: Mehrspaltiger Text – Magazine gehören zu den Stärken von gpt-image-2.

2.8 Bilibili / YouTube-Thumbnail (16:9)

Video thumbnail, 16:9 horizontal,

left half: person looking surprised,

right half: huge yellow text "5 Minutes to Learn Prompt" in bold,

black outline on text, red accent arrow pointing to it

Tipp: Die Regel für Thumbnails ist „großer Text mit schwarzem Rand + Dramatik“ – das Modell versteht das.

2.9 Horizontales Werbebanner (21:9)

Web banner, 21:9 horizontal, dark background,

left side bold text "Upgrade to Pro" "Save 40% This Week",

right side abstract product visualization,

clean minimal layout, blue accent color

Tipp: Das extrem breite 21:9-Format wird nativ unterstützt (3x breiter als bei GPT-Image-1.5).

2.10 Feiertags-Marketing-Poster (Mehrsprachig)

Chinese New Year marketing poster, 3:4 vertical,

top gold text "Happy New Year",

below smaller red text "Happy Lunar New Year 2026",

festive red and gold palette, traditional paper-cut elements

Tipp: Zweisprachig nebeneinander – beide Texte in Anführungszeichen werden dank der Mehrsprachigkeit von gpt-image-2 stabil gerendert.

🎯 Batch-Tipp: Du kannst diese 10 Szenarien über die APIYI apiyi.com Schnittstelle für gpt-image-2 in Serie laufen lassen und firmenweite Vorlagen als „Lückentext-Prompts“ erstellen, damit jeder im Team in 5 Sekunden ein Bild generieren kann.

III. Praxisbeispiele für einfache Eingabeaufforderungen mit gpt-image-2 für Poster

Die folgenden drei Beispiele sind vollständige Eingabeaufforderungen, die Sie direkt kopieren können. Für jedes Beispiel finden Sie Empfehlungen zu den API-Parametern (am Beispiel des API-Proxy-Dienstes APIYI api.apiyi.com) sowie die erwarteten Ergebnisse.

3.1 Beispiel 1: Festival-Poster (gpt-image-2 für Event-Key-Visuals)

Einfache Eingabeaufforderung:

Festival poster with bold title "SUMMER SOUND 2026" at the top,

neon purple and pink gradient background, abstract sound waves,

small subtitle "Aug 15-17 · Beijing" below,

clean sans-serif typography, 2:3 vertical layout

API-Parameter-Empfehlung (via api.apiyi.com):

{

"model": "gpt-image-2",

"prompt": "<oben genannte Eingabeaufforderung>",

"size": "1600x2400",

"quality": "high",

"output_format": "png",

"n": 4

}

size=1600x2400: 2:3-Verhältnis, geeignet für den Druck im A3-Format.quality=high: Für große Titel ist "high" zwingend erforderlich, da die Neonfarben sonst die Ränder der Schrift verwischen könnten.n=4: Erzeugt 4 Varianten zur Auswahl.- Erwartete Dauer: ca. 90–150 Sekunden.

Erwartetes Ergebnis: Ein großes Neon-Titelbild mit "SUMMER SOUND 2026", ein Hintergrund mit abstrakten Schallwellen und der Untertitel "Aug 15-17 · Beijing" am unteren Rand. Beide Textzeilen in Anführungszeichen sollten exakt so wiedergegeben werden.

3.2 Beispiel 2: Tech-Blog-Cover (gpt-image-2 für Header-Bilder)

Einfache Eingabeaufforderung:

Minimalist blog cover, dark navy background,

centered white title "Understanding Transformers" in bold serif,

small abstract neural network pattern on the right,

16:9 horizontal layout

API-Parameter-Empfehlung:

{

"model": "gpt-image-2",

"prompt": "<oben genannte Eingabeaufforderung>",

"size": "1920x1080",

"quality": "medium",

"output_format": "webp",

"output_compression": 85,

"n": 2

}

size=1920x1080: Standard-16:9-Format für Blog-Header.quality=medium: Bei einem schlichten Hintergrund und einem einzelnen Titel ist "medium" völlig ausreichend.output_format=webp: Kleinere Dateigröße für schnellere Ladezeiten im Blog.- Erwartete Dauer: ca. 25–45 Sekunden.

Erwartetes Ergebnis: Dunkelblauer Hintergrund mit weißem Serif-Titel, ergänzt durch ein minimalistisches neuronales Netzwerk-Muster auf der rechten Seite. Die Textschärfe ist bei 1080p ohne Nachbearbeitung optimal.

3.3 Beispiel 3: Xiaohongshu-Cover (gpt-image-2 für Social-Media-Posts)

Einfache Eingabeaufforderung:

Cozy lifestyle cover, warm morning light,

top-left pink tag says "AI 新手指南",

center large text "5 个技巧" with hand-drawn underline,

3:4 vertical, soft pastel colors

API-Parameter-Empfehlung:

{

"model": "gpt-image-2",

"prompt": "<oben genannte Eingabeaufforderung>",

"size": "1080x1440",

"quality": "high",

"output_format": "png",

"n": 4

}

size=1080x1440: Vertikales 3:4-Format für Xiaohongshu.quality=high: Für die chinesische Schriftwiedergabe wird generell "high" empfohlen, um unterbrochene Striche zu vermeiden.n=4: Für A/B-Tests, um die Variante mit der natürlichsten "handgezeichneten Unterstreichung" auszuwählen.- Erwartete Dauer: ca. 60–90 Sekunden.

Erwartetes Ergebnis: Warme Farbgebung, ein pinkes Tag "AI 新手指南" oben links, der große Text "5 个技巧" in der Mitte mit einer handgezeichneten Unterstreichung. Die gleichzeitige Wiedergabe der beiden chinesischen Textblöcke ist der ultimative Test für die multimodalen Fähigkeiten von gpt-image-2.

🎯 Implementierungstipp: Wir empfehlen, die Prompts dieser drei Beispiele als "Standard-Vorlagen" in Ihrem Team zu speichern und sie einmal in der APIYI-Konsole zu testen, um die Verbindung zu verifizieren. Für Batch-Verarbeitung oder Parameteranpassungen können Sie auf die Hochverfügbarkeits-Leitung

vip.apiyi.comwechseln, mitb.apiyi.comals automatischem Fallback – ein API-Schlüssel funktioniert für alle drei Leitungen.

IV. 5 fortgeschrittene Tipps für die Poster-Erstellung mit gpt-image-2

4.1 Mehrsprachige Poster: Chinesisch-Englisch / Chinesisch-Japanisch nebeneinander

gpt-image-2 unterstützt nativ das Rendern von Texten in mehreren Sprachen. Für Poster oder lokalisierte Marketingmaterialien können Sie in einer einzigen Eingabeaufforderung Texte in zwei Sprachen in Anführungszeichen kombinieren:

Bilingual poster, 3:4 vertical,

top Chinese text "春节快乐",

below English text "Happy Spring Festival 2026",

red and gold festive palette

Die beiden Textabschnitte werden unabhängig voneinander gerendert und beeinflussen sich nicht gegenseitig. Dies war in der Vergangenheit eine der größten Hürden bei SD/MJ.

4.2 10 Bilder auf einmal für A/B-Tests

gpt-image-2 unterstützt den Parameter n bis zu einem Wert von 10, sodass Sie 10 Bilder einer Serie mit derselben Eingabeaufforderung erhalten. Empfehlung für Posterszenarien:

| n-Wert | Anwendung |

|---|---|

| 1 | Schnelles Feedback bei der Feinabstimmung |

| 4 | Tägliche Auswahl, bestes Preis-Leistungs-Verhältnis |

| 8 | Wichtige Markenmaterialien, Auswahl aus vielen Kandidaten |

| 10 | A/B-Tests oder wenn 3–5 Entwürfe für Kunden benötigt werden |

Die 10 Bilder behalten die Konsistenz des Hauptmotivs bei (gleiche Schriftart, gleiche Hauptfarbe), weisen jedoch Unterschiede in den Kompositionsdetails auf – ideal für einen Pool an Marketing-Assets.

4.3 Masken-Retusche: Nur den Titel auf dem Poster ändern

Wenn Hintergrund und Komposition des ersten Entwurfs bereits überzeugen und nur der Titel geändert werden soll (z. B. von "Ausgabe 23" auf "Ausgabe 24"), müssen Sie das Bild nicht neu generieren. Nutzen Sie die Maskenbearbeitung:

- Markieren Sie den Titelbereich mit einem beliebigen Werkzeug weiß und den Rest schwarz.

- Rufen Sie die Bearbeitungsschnittstelle von gpt-image-2 auf und übergeben Sie das Originalbild + Maske.

- Schreiben Sie eine einfache Eingabeaufforderung: "Change the title to 'Issue 24'".

Die Omni-Attention-Architektur von gpt-image-2 sorgt dafür, dass die Pixel außerhalb der Maske stabil bleiben und die ursprüngliche Komposition nicht beeinträchtigt wird.

4.4 Referenzbilder zur Wahrung der Markenkonsistenz

gpt-image-2 unterstützt bis zu 5 Referenzbilder. Bei der Erstellung einer Marken-Poster-Serie:

| Referenzbild-Position | Inhalt |

|---|---|

| 1 | Farbpalette der Marke (Haupt- + Sekundärfarben) |

| 2 | Screenshot von gängigen Schriftarten |

| 3 | Frühere erfolgreiche Poster |

| 4 | Klare Version des Logos |

| 5 | Szenenatmosphäre (z. B. Foto des Studios) |

Fügen Sie der Eingabeaufforderung den Satz "Use the color palette and typography from the reference images" hinzu. Das Modell fixiert die visuellen Markenelemente, sodass die Poster-Serie wie "aus einem Guss" wirkt.

4.5 Einfache Eingabeaufforderung + nachträgliches Photoshop-Feintuning

Der effizienteste Workflow: 90 % durch KI, 10 % manuelle Nachbearbeitung.

- KI-Phase: Nutzen Sie eine einfache Eingabeaufforderung, generieren Sie 4 Bilder und wählen Sie eines mit 80 % Qualität aus.

- Manuelle Phase: Öffnen Sie Photoshop und passen Sie nur drei Dinge an: Logo-Position, Farbtonverschiebung und Zeilenabstand.

Dieser Workflow aus "einfacher Eingabeaufforderung + Feintuning" ist 3–5 Mal schneller und stabiler als der alte Weg, bei dem man verzweifelt versucht, mit einer 300-Wörter-Eingabeaufforderung sofort ein 100-Prozent-Ergebnis zu erzwingen.

V. Auswahl der Qualitätsstufen für Poster mit gpt-image-2

Die Wahl der richtigen Qualität für das jeweilige Szenario ist der Schlüssel zur Kostenkontrolle. Beachten Sie die folgende Tabelle:

| Qualität | Zeitaufwand (2K) | Zeitaufwand (4K) | Relative Kosten | Empfohlenes Szenario |

|---|---|---|---|---|

| low | 15–25 Sek. | — | 1× | Skizzen, schnelle Erkundung |

| medium | 30–60 Sek. | 60–120 Sek. | 2× | Blog-Cover, tägliche Social-Media-Posts |

| high | 60–120 Sek. | 120–300 Sek. | 4× | Druckposter, Marken-Hauptvisuals |

| auto | Modell entscheidet | Modell entscheidet | variabel | Wenn unsicher, dem Modell überlassen |

Faustregeln:

- Für klaren Text → Qualität ≥ medium

- Für 4K-Druck → Qualität = high zwingend erforderlich

- In der Skizzenphase → low reicht aus, spart Geld und Zeit

VI. FAQ: Häufige Fragen zur Poster-Erstellung mit gpt-image-2

F1: Warum verschlechtert sich das Ergebnis, wenn ich zu viele Adjektive verwende?

Da gpt-image-2 ein "schlussfolgerndes" Modell ist, versucht es, deine gesamte Beschreibung zu verstehen, anstatt Schlüsselwörter wie Tags abzugleichen. 50 Adjektive erzeugen nur Rauschen – das Modell wägt ständig zwischen Synonymen wie "hyperrealistisch", "filmreif" oder "Meisterwerk" ab, wodurch die Aufmerksamkeit davon abgelenkt wird, "den Text in den Anführungszeichen korrekt zu schreiben".

Lösung: Streiche alle Adjektiv-Ansammlungen, behalte nur ein einziges, prägendes Adjektiv (z. B. minimalistisch / stimmungsvoll / gemütlich) und beschreibe die Szene stattdessen präzise.

F2: Wie schreibe ich chinesische Titel in die Eingabeaufforderung?

Schreibe sie einfach direkt in die englischen Anführungszeichen, es sind keine zusätzlichen Einstellungen erforderlich:

Top gold text "新春快乐",

below smaller red text "Happy Lunar New Year 2026"

Die Genauigkeit von gpt-image-2 bei der Wiedergabe chinesischer Schriftzeichen liegt bei über 95 %. Wenn du vertikalen chinesischen Text benötigst, füge einfach den Zusatz "vertical Chinese text" hinzu.

F3: Wie lange dauert ein 4K-Poster?

quality=high + 3840x2160 dauert etwa 2–5 Minuten. Bei Netzwerkschwankungen können es bis zu 6 Minuten werden. In Produktionsumgebungen empfehlen wir, über den API-Proxy-Dienst von APIYI (apiyi.com) die Batch-Warteschlange der vip.apiyi.com-Hochleistungsleitung zu nutzen und das Timeout für einzelne Aufgaben auf über 360 Sekunden einzustellen.

F4: Kann ich spezifische Schriftarten (z. B. Helvetica, Source Han Sans) festlegen?

Du kannst eine Stilrichtung vorgeben, aber keine bestimmte Schriftart exakt erzwingen. Effektive Schreibweisen sind:

bold sans-serif→ Das Modell wählt einen Stil ähnlich wie Helvetica / Interelegant serif→ Stil ähnlich wie Garamond / Timeshandwritten→ Handschriftslab serif→ Stil ähnlich wie Roboto Slab

Wenn deine Marke eine strikte Einhaltung der Helvetica-Schriftart erfordert, empfehlen wir den Workflow: "Einfache Eingabeaufforderung für das Basisbild + nachträglicher Austausch der Textebene in Photoshop".

F5: Wie rufe ich gpt-image-2 in meinen eigenen Projekten für Poster auf?

Der einfachste Weg ist die Nutzung eines Gateways, das das OpenAI-Protokoll unterstützt. Hole dir einen Schlüssel im APIYI-Dashboard (apiyi.com), setze die base_url auf https://api.apiyi.com/v1 und kopiere den restlichen SDK-Code aus den offiziellen Python/Node-Beispielen von OpenAI. Für Batch-Szenarien wechsle auf vip.apiyi.com. Spezifische Parameter findest du in der gpt-image-2-Rubrik unter docs.apiyi.com.

F6: Wie wähle ich aus 10 Bildern das beste aus?

Drei-Schritte-Methode:

- Textkorrektheit: Prüfe zuerst, ob der Text in den Anführungszeichen auf allen 10 Bildern korrekt gerendert wurde; falls nicht, sortiere sie sofort aus.

- Klarheit des Hauptmotivs: Ist das Hauptobjekt hervorgehoben und sind die Details brauchbar?

- Markenkonsistenz: Entsprechen Farbgebung und Schriftstil den Vorgaben?

Normalerweise bestehen 6–8 von 10 Bildern Schritt 1, 2–3 Bilder Schritt 2 und 1–2 Bilder Schritt 3 – das sind deine finalen Kandidaten.

F7: Was macht gpt-image-2 bei Postern besser als Midjourney?

| Fähigkeit | Midjourney v7 | gpt-image-2 |

|---|---|---|

| Text-Rendering | 70 % Genauigkeit | >95 % Genauigkeit |

| Mehrsprachigkeit | Hauptsächlich Englisch | Nativ für Chinesisch, Japanisch, Koreanisch, Arabisch |

| Länge der Eingabeaufforderung | Empfohlen 100+ Wörter | 15–40 Wörter optimal |

| Natives 4K | Erfordert Upscaling | Nativ unterstützt |

| Masken-Korrektur | Eingeschränkt | Präzise, ohne die Komposition zu stören |

| Bilder pro Durchlauf | 4 Bilder | 10 Bilder |

Für Poster- oder Cover-Szenarien, bei denen Text + Mehrsprachigkeit + druckfähige Auflösung im Vordergrund stehen, ist gpt-image-2 derzeit die beste Wahl.

VII. Zusammenfassung: Poster-Erstellung mit gpt-image-2

An diesem Punkt solltest du den wichtigsten Paradigmenwechsel verstanden haben: Der richtige Weg für Poster mit gpt-image-2 = einfache Eingabeaufforderung + Anführungszeichen-Regel. Hier ist deine Checkliste:

- ✅ Setze den anzuzeigenden Text in englische Anführungszeichen (höchste Priorität).

- ✅ Beschreibe die Gesamtatmosphäre mit einem Adjektiv (minimalist / moody / cozy / festive…).

- ✅ Beschreibe die Szene in natürlicher Sprache, ohne Tags wie "8K/Meisterwerk/filmreif" zu stapeln.

- ✅ Definiere das Seitenverhältnis und die Auflösung (16:9 / 2:3 / 3:4 / 1:1 usw.).

- ✅ Wähle die Qualität je nach Szenario: high für Druck, medium für Blog-Cover, low für Entwürfe.

- ✅ Erstelle 4–10 Bilder pro Durchlauf als Kandidatenpool, wähle das beste aus und verfeinere es bei Bedarf.

Du wirst feststellen: Ein Poster, für das du früher 30 Minuten gebraucht hast, lässt sich jetzt in unter 5 Minuten als Bilderserie erstellen. Das ist keine bloße Verbesserung der Prompt-Technik, sondern ein Paradigmenwechsel – OpenAI hat das "Verständnis für Komposition" in die Schlussfolgerungsfähigkeit von gpt-image-2 integriert. Du musst kein gestresster "Prompt-Ingenieur" mehr sein.

🎯 Nächster Schritt: Wähle aus Abschnitt 2 das Szenario aus, das deinem Anwendungsfall am nächsten kommt (Blog-Cover / Social Media / Produktposter), und teste die Eingabeaufforderung in deinem Tool. Falls du noch keinen bequemen API-Zugang hast, empfehlen wir, einen Test-Schlüssel bei APIYI (apiyi.com) zu beantragen (setze ein tägliches Limit von 20–50 ¥), um die 2K-Validierung über

api.apiyi.comdurchzuführen, bevor du auf 4K hochgehst. Für Batch-Aufträge und nächtliche Warteschlangen nutzevip.apiyi.com, bei Ausfällen springtb.apiyi.comautomatisch ein. Vollständige Parameter und Code-Beispiele findest du unterdocs.apiyi.com.

Die Poster-Erstellung mit gpt-image-2 hat sich vom "Optimieren von Prompt-Tricks" hin zum "Verständnis für den Inhalt" gewandelt – und das ist gut so. Wahre Kreativität kehrt zum Inhalt zurück, und das Werkzeug bleibt ein Werkzeug.

Autor: APIYI Technik-Team

Ressourcen:

- APIYI Website: apiyi.com

- APIYI Dokumentation: docs.apiyi.com

- APIYI Hauptseite: api.apiyi.com (Backup: vip.apiyi.com / b.apiyi.com)

- Offizielle Ankündigung von OpenAI: openai.com/index/introducing-chatgpt-images-2-0/