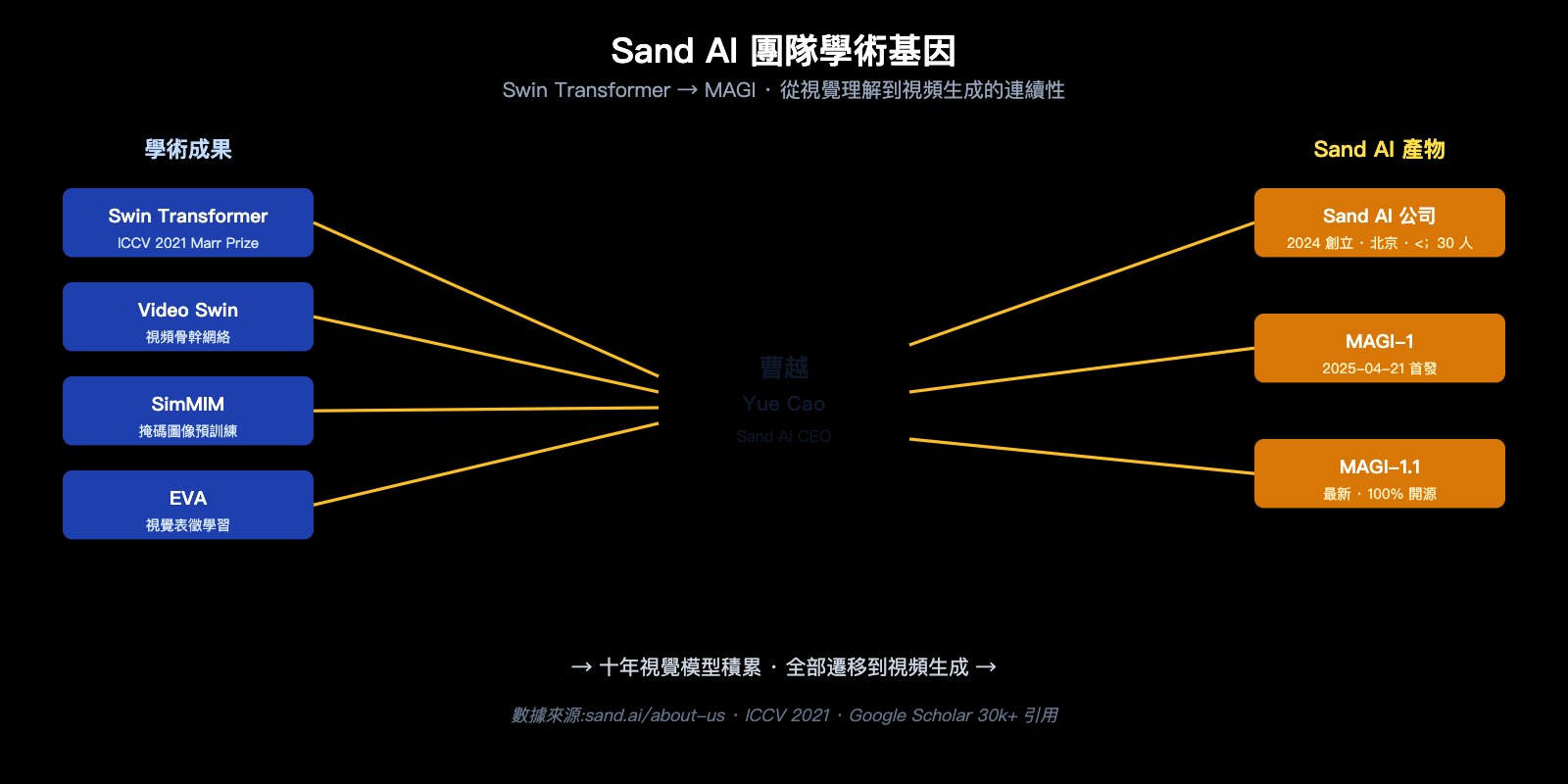

如果你最近在 Hugging Face、GitHub 或者英文 AI Twitter 上反覆看到一個名字——Sand AI,並且對它推出的 MAGI-1 / MAGI-1.1 感到好奇,這篇文章就是爲你寫的。和很多"突然冒出來的視頻模型團隊"不同,Sand AI 其實有非常硬核的來歷:它的 CEO 曹越(Cao Yue)是 Swin Transformer 的核心作者,這篇論文獲得了 ICCV 2021 的最佳論文獎(Marr Prize),Google 學術引用超過 3 萬次,被微軟 Office 365、Azure、TikTok、快手等大廠產品廣泛採用。換句話說,Sand AI 不是一家臨時下場的團隊,而是 Swin Transformer 原班人馬把視覺模型十年積累遷移到視頻生成的產物。

更讓海外社區興奮的是,Sand AI 不僅做了一個能打的視頻生成模型,還選擇把它完整開源——MAGI-1 全套權重 + 代碼 + 推理工具,Apache 2.0 協議,直接放在 GitHub 與 Hugging Face 上。在 2025-2026 這一波"國產視頻模型集中開源"的浪潮裏,Sand AI 是少數把"自迴歸視頻生成"這條新路線跑通並開源的團隊之一。本文將圍繞公司背景、創始人履歷、MAGI 技術架構、開源策略與適合人羣 6 個維度,把"什麼是 Sand AI"這件事一次講清楚。

Sand AI 核心信息一覽

在開始拆解之前,我們用一張表把"什麼是 Sand AI"這個問題的所有關鍵事實先壓到一屏之內。

| 維度 | Sand AI 公開信息 |

|---|---|

| 公司英文名 | Sand AI(網站 sand.ai) |

| 成立背景 | 由 Swin Transformer 核心作者曹越創立 |

| 總部位置 | 中國北京 |

| 團隊規模 | 不到 30 人,平均年齡 30 歲以下 |

| 公司使命 | "推動 AI 讓每個人受益",擁抱開源與開放協作 |

| CEO | 曹越(Yue Cao),前北京智源 AI 研究院視覺模型研究中心負責人 |

| 旗艦產品 | MAGI / MAGI-1 / MAGI-1.1 自迴歸視頻生成模型 |

| 首次發佈 | 2025 年 4 月 21 日(MAGI-1) |

| 最新版本 | MAGI-1.1(100% 開源) |

| 模型規格 | 24B 與 4.5B 兩個參數版本 |

| 開源協議 | Apache 2.0,GitHub SandAI-org/MAGI-1 + Hugging Face sand-ai/MAGI-1 |

| 核心創新 | 自迴歸 + 擴散結合(Autoregressive Denoising Diffusion) |

| Web 入口 | magi.sand.ai/app/projects |

| API 平臺 | platform.sand.ai/docs |

| 主要競品 | Wan 系列、HunyuanVideo、Hailuo、Sora 等 |

🎯 快速理解建議:如果你只想用一句話記住 Sand AI,可以這樣講——"它是一家把 Swin Transformer 那套視覺建模功底搬到視頻生成的開源初創"。如果你想現在就動手試一下 MAGI 系列與其他視頻模型的差異,我們建議先在 API易 apiyi.com 這種統一平臺上把 Sora 2 / Veo 3.1 / Kling 等成熟模型先跑一輪,再去 sand.ai / Hugging Face 拉 MAGI-1.1 做對比,這樣能立刻看出"自迴歸路線"的差異。

Sand AI 公司背景與團隊基因

要理解 Sand AI 爲什麼一上來就能做出有競爭力的視頻模型,必須先看它的團隊背景。

創始人:Swin Transformer 之父曹越

Sand AI 的 CEO 曹越(Yue Cao) 在中國 AI 圈是個相當熟悉的名字,海外學術圈也一樣。他的核心履歷可以濃縮成下面這幾條:

| 時間 | 經歷 |

|---|---|

| 2019-2022 | 微軟亞洲研究院(Microsoft Research Asia)資深研究員,Swin Transformer 核心作者 |

| 2021 | Swin Transformer 獲 ICCV 2021 最佳論文獎(Marr Prize) |

| 2022-2023 | 聯合創立 Lightyear AI(光年之外),後被美團收購 |

| 2023-2024 | 任北京智源研究院視覺模型研究中心負責人,主攻基礎視覺模型與多模態大模型 |

| 2024 至今 | 創立 Sand AI,擔任 CEO |

Swin Transformer 的影響力至今仍在持續——這篇論文已經被 Google 學術引用超過 30,000 次,廣泛應用在 Microsoft Office 365、Azure Cognitive Service、TikTok、快手等產品的視覺理解鏈路裏。它也是 Video Swin Transformer 的前置工作,某種程度上,曹越本人就代表了"從視覺理解到視頻生成"這條技術路徑的連續性。

團隊規模:不到 30 人的"超精英小團隊"

Sand AI 的團隊結構和大多數大模型公司差異極大:全員加起來不到 30 人,涵蓋產品、市場、工程、研究 4 個方向,核心團隊平均年齡不到 30 歲。這種小團隊結構在過去幾年的大模型創業潮裏相對少見,但也意味着:

- 決策鏈條短,迭代速度快;

- 工程與研究高度耦合,論文級創新可以直接變成產品;

- 沒有大公司式的部門牆,3 個人就能跑通一條新鏈路。

這種"小而硬"的基因,是 Sand AI 能在 2025 年 4 月就拿出 MAGI-1 這種高完成度模型的重要原因。

公司使命與開源態度

Sand AI 在 about-us 頁面給自己定義的使命是:"Advance AI to benefit everyone(推動 AI 讓每個人受益)",並且明確表示要"擁抱開源、通過開放協作推動進步,讓前沿 AI 對所有人可用"。這不是一句營銷口號——Sand AI 後續推出的 MAGI-1、MAGI-1.1 都按 Apache 2.0 協議完整開源,把權重、推理代碼、Distill 版本一起放上 GitHub 與 Hugging Face,這種開源態度在當前的視頻生成賽道上非常激進。

Sand AI 旗艦產品 MAGI:自迴歸視頻生成的新範式

理解完團隊,接下來纔是真正的重頭戲——Sand AI 的旗艦產品 MAGI 系列。它在技術路線上和 Sora、Kling、Veo、HunyuanVideo 等主流方案有一個根本差別:它不是"一次性生成整段視頻"的純擴散模型,而是把"自迴歸"與"擴散"結合起來,逐塊(chunk)生成視頻。

MAGI 關鍵事實

| 維度 | MAGI / MAGI-1 / MAGI-1.1 |

|---|---|

| 首次發佈 | 2025 年 4 月 21 日 |

| 最新版本 | MAGI-1.1(100% 開源) |

| 參數規格 | 24B(完整版) + 4.5B(輕量版) |

| 蒸餾版本 | 4.5B Distill + Distill+Quant(2025 年 5 月 26 日發佈) |

| 開源協議 | Apache 2.0 |

| 倉庫 | github.com/SandAI-org/MAGI-1 / huggingface.co/sand-ai/MAGI-1 |

| 視頻生成時長 | 當前 1-10 秒,支持無限延長 |

| 單段幀數 | 每個 chunk 24 幀,聯合去噪 |

| 併發能力 | 同時處理最多 4 個 chunk |

| 生成耗時 | 通常 1-2 分鐘出結果 |

| 風格支持 | 寫實視頻 + 3D 半卡通風格 |

| 控制能力 | 秒級時間軸控制 + 分塊 prompting |

| 物理理解 | Physics-IQ 基準上的視頻續寫顯著領先 |

| 性能定位 | 開源中達到 SOTA,優於 Wan-2.1 / HunyuanVideo,超越閉源 Hailuo |

自迴歸 + 擴散:爲什麼是新範式

主流的視頻擴散模型(Sora、Veo、Kling 等)通常會一次性把整段視頻當作一個張量去做去噪。這種方法在畫質上很強,但有兩個固有缺陷:

- 難以無限延長:模型一次能生成的視頻長度被推理時的顯存與時延卡死;

- 物理一致性弱:整段一次出,缺少"前一幀推理後一幀"的因果鏈。

MAGI 選擇的路線是把視頻拆成 24 幀一組的 chunk,每個 chunk 內部做擴散去噪,chunk 與 chunk 之間走自迴歸的因果約束。這意味着:

- 想要視頻更長?繼續往後自迴歸一段就行,從原理上沒有上限——這也是 sand.ai 官網爲什麼強調 "infinite video extension capabilities";

- 想要物理更真實?每一幀都基於前面已生成的幀,因此在 Physics-IQ 這種物理預測基準上有結構性優勢;

- 想要更細的可控性?可以對每個 chunk 單獨喂 Prompt,形成"分段導演"的效果。

這種設計在 Sand AI 自己的實測中表現非常突出:在開源模型裏擊敗了 Wan-2.1、HunyuanVideo 等強對手,在閉源對比中也超過了 Hailuo,Physics-IQ 基準上"顯著優於現有所有模型"。

MAGI 架構裏的工程創新

爲了讓自迴歸 + 擴散這條路真正跑得動,Sand AI 在 MAGI 裏塞了一整套架構改造:

| 模塊 | 作用 |

|---|---|

| Block-Causal Attention | 讓 chunk 之間形成因果連接,避免未來信息泄漏 |

| Parallel Attention Block | 提升單 chunk 內部的並行效率 |

| QK-Norm + GQA | 穩定訓練 + 減少 KV Cache 負擔 |

| Sandwich Normalization in FFN | 進一步穩定大模型訓練 |

| SwiGLU | 提升非線性表達能力 |

| Softcap Modulation | 控制注意力分佈的極端值 |

| Transformer-based VAE | 解碼速度更快 |

這些創新單獨拿出來都不算"突破性",但疊加在一起,就讓 MAGI-1 同時擁有了長視頻、強物理、可控性、可擴展性 4 項往往難以同時兼顧的能力。

🎯 架構選型建議:如果你的業務需要"長視頻續寫"或"分鏡級別的可控性",MAGI 這種自迴歸 + 擴散的範式值得納入候選;在它正式提供商用 API 之前,可以先在 API易 apiyi.com 上用 Sora 2、Veo 3.1、Kling 3.0 等已商用化模型完成產品原型,等 MAGI 商用 API 成熟後無縫遷移。

Sand AI 如何把 MAGI 交付給開發者

光有強模型還不夠,Sand AI 在交付路徑上也設計得相當工程化。從普通用戶到開發者再到研究者,sand.ai 提供了三條不同入口。

三種使用 MAGI 的方式

| 入口 | 地址 | 適合人羣 |

|---|---|---|

| Web 應用 | magi.sand.ai/app/projects |

內容創作者 / 普通用戶,直接在瀏覽器裏出片 |

| API 平臺 | platform.sand.ai/docs |

開發者,要把 MAGI 接進自己的產品 |

| 開源倉庫 | github.com/SandAI-org/MAGI-1 + huggingface.co/sand-ai/MAGI-1 |

研究者 / 自部署團隊,要本地跑權重 |

這三條路覆蓋了 "零代碼出片 → 工程接入 → 完全自託管" 的全譜系需求。和那些"只放論文不放權重"或者"只放 Demo 不開源"的團隊相比,Sand AI 的做法要徹底得多。

24B 與 4.5B 雙版本的工程意義

MAGI-1 同時提供 24B 與 4.5B 兩個參數規格,這件事本身就說明 Sand AI 想兼顧兩類用戶:

- 24B 完整版:面向有充足 GPU 資源、追求最高畫質的研究者與企業;

- 4.5B 蒸餾版:面向工程化部署、追求成本與時延平衡的團隊,5 月又追加了 Distill+Quant 版本,把顯存進一步壓縮。

這種"高低端雙模型 + 持續蒸餾"的發佈節奏,幾乎是 2025-2026 年開源大模型最成熟的玩法,Sand AI 在這一點上和 Mistral、Qwen 等開源大廠保持了同步。

Sand AI 在視頻生成賽道的位置與啓示

把背景、產品、交付路徑全部串起來之後,Sand AI 在 2026 年視頻生成賽道里的位置已經相當清晰。

爲什麼值得關注

| 角度 | Sand AI 的差異化價值 |

|---|---|

| 學術深度 | Swin Transformer 團隊基因,網絡架構創新有連續性 |

| 路線選擇 | 自迴歸 + 擴散是少有人走的第三條路,而非簡單復刻 Sora |

| 開源徹底度 | Apache 2.0 + 權重 + 代碼 + Distill 版本全部公開 |

| 產品形態 | Web / API / 自託管三入口齊備 |

| 物理理解 | Physics-IQ 基準顯著領先,適合科普/教育/科研內容 |

| 長視頻 | 自迴歸路線天然支持無限延長 |

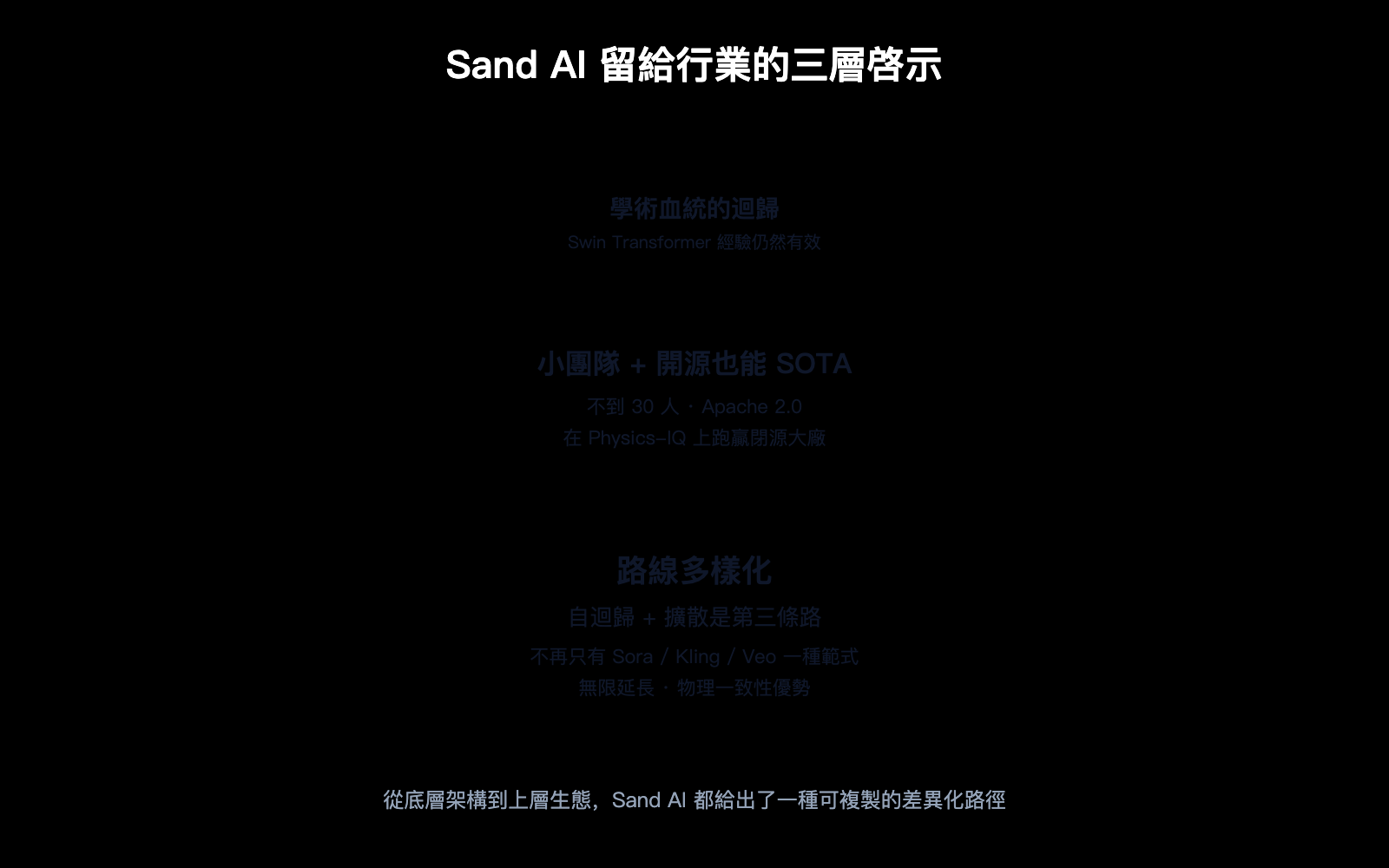

三層產業啓示

Sand AI 的快速崛起對整個視頻生成賽道至少留下了三層啓示:

- 路線多樣化:Sora / Veo / Kling 之外,自迴歸 + 擴散這條路可以走通,且在物理一致性上有結構優勢;

- 小團隊 + 開源也能 SOTA:不到 30 人 + Apache 2.0,照樣能在 Physics-IQ 上跑贏大量閉源大廠;

- 學術血統的迴歸:Swin Transformer 這類"經典視覺模型"的訓練經驗,在視頻生成時代仍然有強烈的延續價值。

這三點對 2026 年想入場視頻生成的團隊都有直接參考意義——你不需要 1000 張 H100 才能做出像樣的模型,但你確實需要"懂架構、敢開源、肯卷物理一致性"的工程文化。

🎯 生態接入建議:對於希望把"開源 + 閉源"視頻模型同時納入產品的團隊,我們建議把 Sora 2、Veo 3.1、Kling 3.0、MAGI-1 等放到一個統一接口下管理;在 MAGI 商用 API 尚未對外大規模放開之前,可以先通過 API易 apiyi.com 接入已商用化的視頻模型完成業務跑通,等待 Sand AI 的 platform.sand.ai 進一步開放。

Sand AI 適合誰、不適合誰

回到一個非常實際的問題:你應該現在就用 Sand AI 的 MAGI 嗎? 答案取決於你在視頻生成上的具體訴求。

適合的人羣

| 人羣 | 適合理由 |

|---|---|

| 研究者 / 論文作者 | 完整開源 + 自迴歸新範式,適合做後續學術工作 |

| 自託管 / 私有部署團隊 | Apache 2.0 + 4.5B 蒸餾版,可本地跑權重 |

| 物理科普 / 教育內容創作者 | Physics-IQ 領先,物理一致性好 |

| 長視頻續寫需求方 | 自迴歸路線天然支持 infinite extension |

| 想做"分鏡級可控生成"的產品 | 支持秒級時間軸 + chunk-wise prompting |

| 中文 AI 內容生態參與者 | 北京團隊,中文 prompt 友好 |

不太適合的人羣

| 人羣 | 原因 |

|---|---|

| 只追求"出片就行"的零代碼用戶 | Sora 2 / Kling 等成熟產品的 UX 仍然更輕量 |

| 完全不願意自部署的小團隊 | platform.sand.ai 商用 API 仍在持續完善 |

| 需要 4K + 長時長 + 含音頻的影視級輸出 | 當前定位仍偏研究 / 創意,而不是影視後期 |

| 對"權重許可"不敏感的純應用層 | 直接調閉源 API 反而省心 |

🎯 試用建議:如果你的訴求是"立刻看效果",我們建議先去 magi.sand.ai 用 Web 應用免登錄或快速註冊體驗一段;如果想對比 Sand AI 與其它視頻模型的真實差異,可以同時通過 API易 apiyi.com 調用 Sora 2 / Veo 3.1 / Kling 3.0,用同一組 Prompt 並行出片,直觀判斷 MAGI 的自迴歸路線是否真的更適合你的業務。

Sand AI 常見問題 FAQ

Q1:Sand AI 是哪家公司?和 Stability AI、Midjourney 是同一類嗎?

Sand AI 是一家成立於中國北京的 AI 初創公司,由 Swin Transformer 核心作者曹越(Yue Cao)創立,核心團隊不到 30 人。和 Stability AI 偏圖像、Midjourney 偏閉源訂閱不同,Sand AI 專注於視頻生成,且選擇了完整開源(Apache 2.0)的路線。它的旗艦產品是自迴歸視頻生成模型 MAGI-1 / MAGI-1.1。

Q2:MAGI-1 和 Sora、Kling、Veo 有什麼本質區別?

最大的區別在技術路線:Sora / Veo / Kling 等主流模型一次性生成整段視頻,而 MAGI 把視頻拆成 24 幀一組的 chunk,chunk 內部做擴散去噪、chunk 之間走自迴歸因果連接。這種範式讓 MAGI 在"無限視頻延長"和"物理一致性"兩件事上有結構性優勢——sand.ai 官方在 Physics-IQ 基準上展示了顯著領先的結果。

Q3:MAGI-1 真的完全開源嗎?可以商用嗎?

是的。MAGI-1 與 MAGI-1.1 按 Apache 2.0 協議在 GitHub(SandAI-org/MAGI-1)和 Hugging Face(sand-ai/MAGI-1)上開源,代碼、權重、推理工具一應俱全。Apache 2.0 是一個非常友好的開源協議,允許商用、允許修改、允許閉源衍生,只需要保留版權聲明。這意味着你可以把 MAGI-1 用在自己的產品裏,也可以基於它做二次訓練。

Q4:本地跑 MAGI-1 需要什麼硬件?

完整版 MAGI-1 是 24B 參數,本地推理需要專業級多卡 GPU;如果你硬件預算有限,推薦用 Sand AI 在 2025 年 5 月發佈的 4.5B Distill 版本 或 Distill+Quant 版本,顯存需求顯著下降,在單張高端消費級 GPU 上也能跑。如果只是想"看看效果",建議先去 magi.sand.ai 用 Web 應用,不需要本地配置。

Q5:Sand AI 有商用 API 嗎?和 Sora、Kling 比起來怎麼樣?

Sand AI 的商用 API 平臺 platform.sand.ai 已經上線,但生態成熟度仍然在追趕 Sora、Kling 這類已經全面商用的模型。如果你正在做一個需要"立刻可用、有充足配額、支持中文 prompt"的視頻生成產品,我們建議先通過 API易 apiyi.com 這種統一中轉平臺調用 Sora 2、Veo 3.1、Kling 3.0 等已商用化的視頻模型完成業務跑通,同時關注 Sand AI 後續 API 的開放節奏,在合適的時機再做替換或並行接入。

Q6:Sand AI 接下來值得關注嗎?

非常值得。兩個理由:第一,Swin Transformer 團隊的學術血統意味着 MAGI 後續的版本迭代很有可能在架構層面持續創新,而不是單純靠堆數據;第二,Sand AI 選擇了一條"自迴歸 + 擴散 + 完整開源"的差異化路徑,這條路如果走得通,將影響整個 2026-2027 年開源視頻生成賽道的範式選擇。無論你是研究者、產品開發者還是內容創作者,都建議把 sand.ai 加入持續觀察清單。

總結:什麼是 Sand AI 的最終答案

回到最初那個問題——"什麼是 Sand AI?" 現在我們可以給出一個相對完整的回答:Sand AI 是一家由 Swin Transformer 核心作者曹越在北京創立、不到 30 人的小團隊 AI 初創公司,以開源的自迴歸視頻生成模型 MAGI-1 / MAGI-1.1 爲旗艦產品,在 Physics-IQ 等物理一致性基準上跑出了優於多數開源與部分閉源模型的成績,並且把全套權重與代碼以 Apache 2.0 協議放在 GitHub 與 Hugging Face。這是一家"學術血統硬、路線選擇新、開源態度徹底"的視頻生成黑馬。

對開發者和研究者而言,Sand AI 的真正意義不是"又多了一個視頻模型",而是爲整個視頻生成賽道提供了一條可複製的差異化路徑:不靠超大算力、不靠閉源圈地、不靠營銷轟炸,而是靠學術功底 + 架構創新 + 完整開源。如果說 2025 年前的視頻生成賽道是 Sora 一家獨大,那麼 Sand AI 的出現,讓 2026 年的開源視頻生態多了一種"小團隊也能 SOTA"的可能性。

🎯 最終建議:想要第一時間跟進 Sand AI 與 MAGI 的進展,我們建議你做三件事:1) 關注 sand.ai 與 Hugging Face

sand-ai組織的更新;2) 用 magi.sand.ai 的 Web 應用跑一次自己的真實需求,形成第一手手感;3) 把 MAGI 與 Sora 2、Veo 3.1、Kling 3.0 等已商用化模型同時接入 API易 apiyi.com 這種統一平臺做橫向對比,在內部基準上判斷它對你業務的真實價值。這套流程走完之後,Sand AI 是否值得納入你的視頻生成工具棧 的答案就會自然浮現。

作者:APIYI Team | 關注 AI 大模型落地與開源生態,更多視頻與多模態模型評測請訪問 API易 apiyi.com。