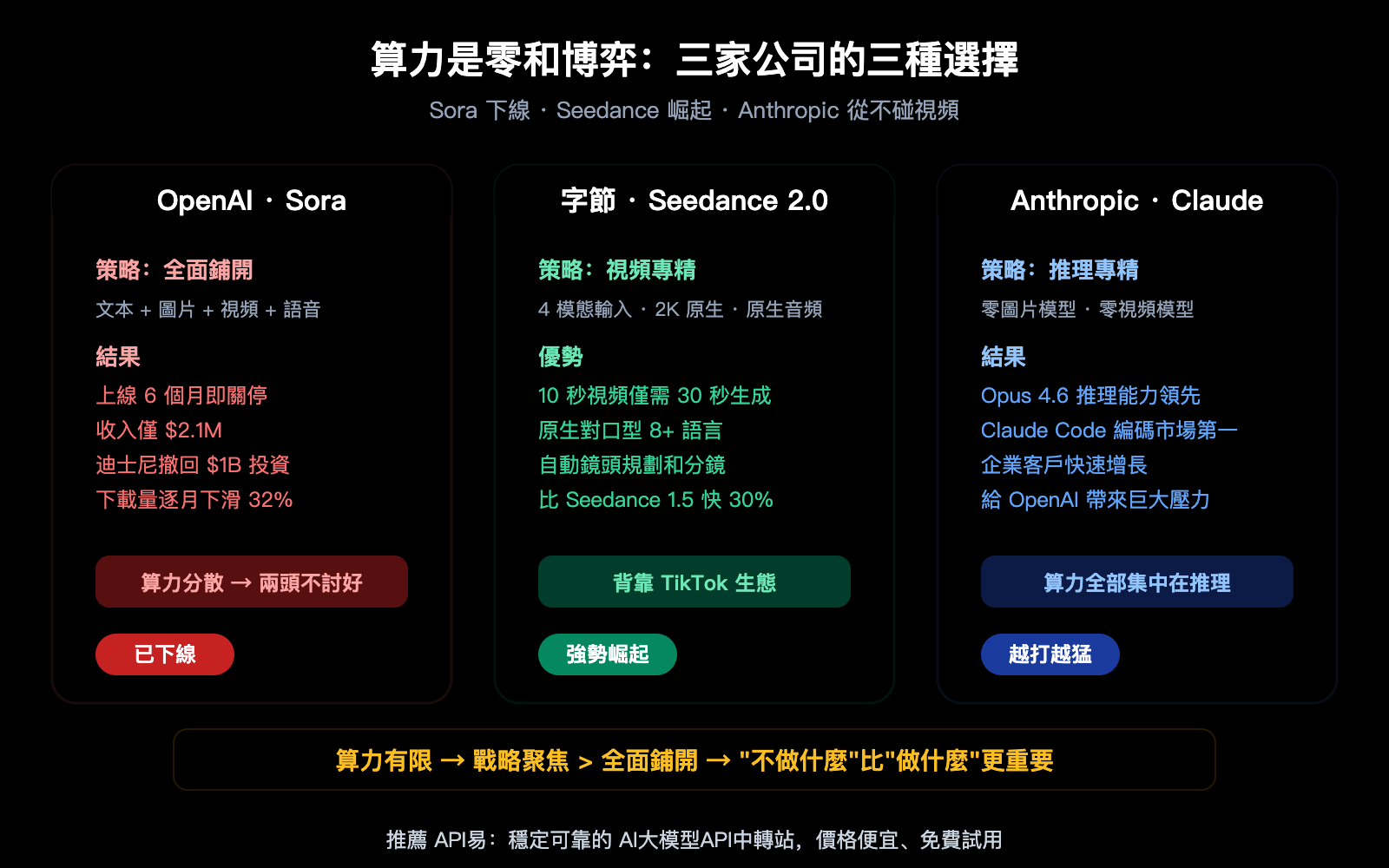

作者注:深度分析 OpenAI Sora 2 下線的真實原因,對比 Seedance 2.0 的競爭壓力,解讀 Anthropic 堅持不做圖片視頻模型背後的算力集中策略和行業啓示

2026 年 3 月 24 日,OpenAI 正式宣佈關停 Sora——上線僅 6 個月,累計收入僅 210 萬美元,迪士尼撤回 10 億美元投資計劃。與此同時,字節跳動的 Seedance 2.0 以原生 2K 分辨率、4 模態輸入和 30 秒極速生成迅速搶佔市場。但更值得深思的是另一個事實:Anthropic 自始至終沒有做過任何圖片或視頻生成模型,卻在 AI 競爭中越打越猛。本文將從算力經濟學的角度,分析 Sora 下線、Seedance 崛起和 Anthropic 聚焦策略背後的底層邏輯。

核心價值: 3 分鐘理解 AI 視頻生成市場的算力困局,以及"不做什麼"比"做什麼"更重要的戰略思考。

Sora 2 下線核心事實

先看清楚發生了什麼,再分析爲什麼。

| 事實 | 細節 | 影響 |

|---|---|---|

| 關停時間 | 2026 年 3 月 24 日正式宣佈 | 上線僅 6 個月 |

| 累計收入 | 應用內購買約 $2.1M | 遠不夠覆蓋算力成本 |

| 下載趨勢 | 11 月峯值 333 萬 → 2 月降至 113 萬 | 逐月下滑 32% |

| 迪士尼退出 | 撤回 $10 億投資計劃 | 失去最重要的內容合作伙伴 |

| 官方說法 | "算力需求增長,聚焦世界模擬研究推進機器人" | 算力重新分配給文本/推理模型 |

| CEO 態度 | Sam Altman 告訴員工:關停 Sora 釋放資源用於下一代模型 | 明確視頻不是優先級 |

Sora 團隊在告別聲明中說:"我們要和 Sora 說再見了。感謝每一位用 Sora 創作、分享、建立社區的人。你們用 Sora 做的事情很重要,我們知道這個消息令人失望。"

同時,CNBC 指出 OpenAI 正在 IPO 前削減高成本項目,Sora 的關停也是成本控制的一部分。

Sora 2 下線的 3 個深層原因

原因一:視頻生成的算力黑洞

這是最根本的原因。視頻生成的算力消耗是文本生成的數百倍:

| 任務類型 | 單次算力消耗 | 每美元產出 | GPU 利用效率 |

|---|---|---|---|

| 文本對話 | 毫秒級 | 數千次對話 | 極高 |

| 圖片生成 | 秒級 | 數百張圖 | 高 |

| 視頻生成(10秒) | 分鐘級 | 數十條視頻 | 低 |

Sora 的每一個視頻請求都在"錘擊" OpenAI 的服務器基礎設施,即便訂閱制收費也無法覆蓋成本。更關鍵的是,這些 GPU 如果用於文本和推理模型(GPT-5、o3 等),能產生高得多的商業價值。

原因二:Seedance 2.0 等競品的降維打擊

字節跳動的 Seedance 2.0 在 2026 年 2 月發佈,幾乎在每個維度上都超越了 Sora:

| 對比維度 | Sora | Seedance 2.0 |

|---|---|---|

| 輸出分辨率 | 1080p | 原生 2K(2048×1080) |

| 生成速度 | 約 60-120 秒/10 秒視頻 | 約 30 秒/10 秒視頻 |

| 輸入模態 | 文本 + 圖片 | 文本 + 圖片(9張) + 視頻(3條) + 音頻(3條) |

| 原生音頻 | 不支持(需後期配音) | 支持(對口型 8+ 語言) |

| 鏡頭控制 | 基礎 | 自動分鏡和鏡頭規劃 |

| 生態優勢 | 獨立應用 | 背靠 TikTok / 抖音內容生態 |

Seedance 2.0 背靠字節跳動的 TikTok 生態,天然擁有視頻消費場景和用戶基礎。而 Sora 作爲獨立應用,缺乏內容分發渠道,用戶生成視頻後沒有明確的消費出口。

除了 Seedance,Google 的 Veo 3、快手的 Kling 2.0、Luma 的 Ray 2 也都在 2026 年初密集發佈了競品。視頻生成賽道已經極度擁擠,Sora 的先發優勢已經被追平甚至反超。

原因三:OpenAI 自身的戰略調整

OpenAI 正面臨來自 Anthropic 的巨大競爭壓力。Bloomberg 和 CNBC 的報道都提到,Anthropic 的 AI 系統在企業客戶和軟件工程師中的受歡迎程度急劇上升,給 OpenAI 帶來了直接的商業威脅。

在這種壓力下,OpenAI 必須把算力集中到核心戰場——文本推理和編碼能力。每一塊用於渲染 Sora 視頻的 GPU,都是一塊沒有用於訓練 GPT-5 或優化 o3 的 GPU。

🎯 行業洞察: Sora 的關停不是"視頻生成不行了",而是"OpenAI 做視頻生成不划算"。算力分散在太多產品線上,導致每條線都無法做到最好。

如果你的 AI 應用需要同時調用文本和視頻模型,推薦通過 API易 apiyi.com 統一管理,一個平臺覆蓋 Seedance、Kling、Claude 等多種模型。

Anthropic 爲什麼從不碰圖片和視頻模型

這是更值得深思的戰略選擇。Anthropic 成立至今,從未發佈過任何圖片生成或視頻生成模型——連 Google 的 Nano Banana(Gemini 圖片生成)這種"文本模型附帶圖片能力"的路線都沒走過。

Anthropic 的算力集中策略

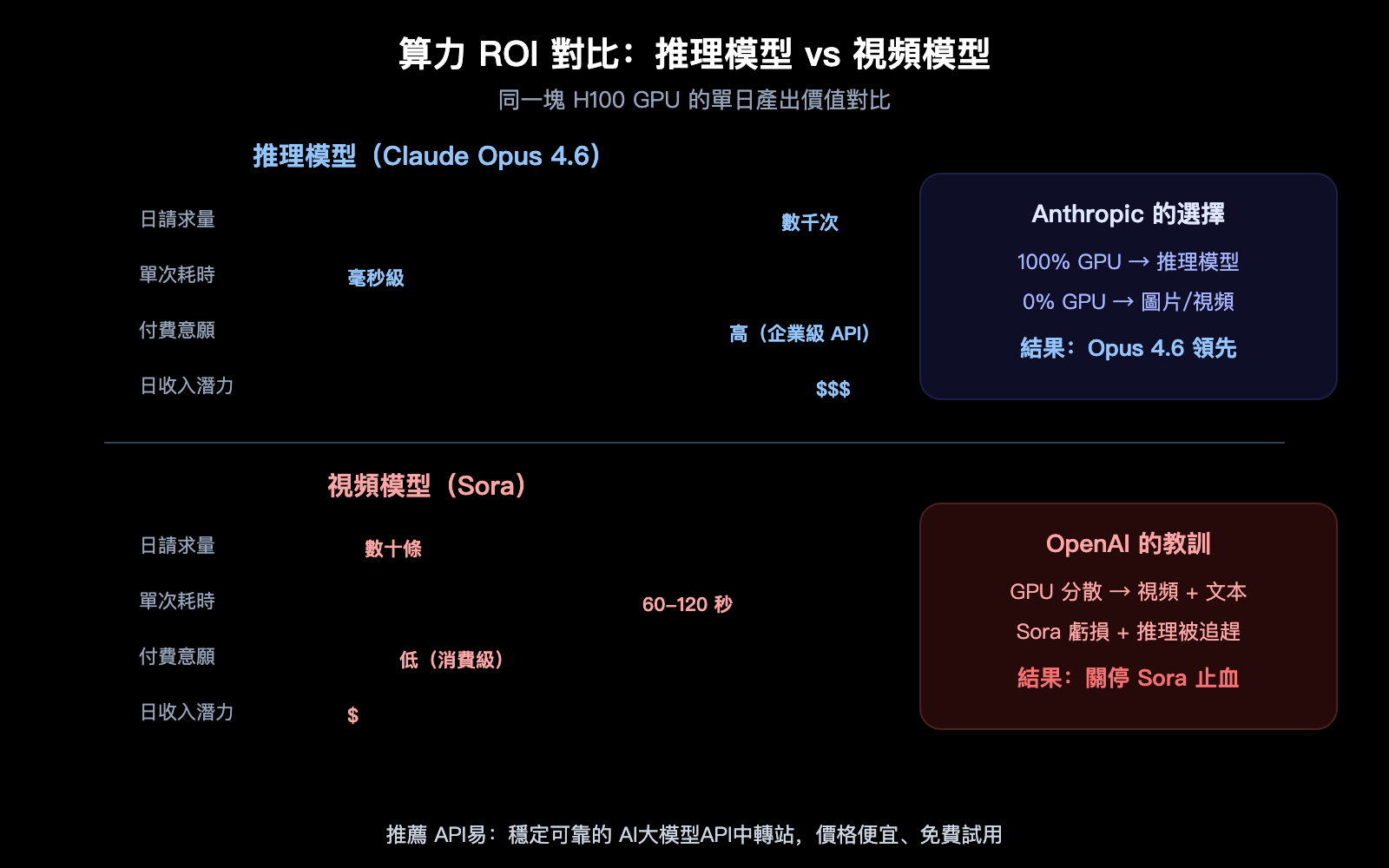

Anthropic 的邏輯很簡單:算力是有限的,必須全部集中在最有價值的方向。

對 Anthropic 來說,最有價值的方向是推理和代碼——這是企業客戶願意付高價的核心能力。Opus 4.6 的推理能力之所以能領先競品,很大程度上是因爲 Anthropic 沒有把 GPU 分散到圖片和視頻模型上。

這和 OpenAI 形成了鮮明對比:

| 戰略維度 | OpenAI(分散) | Anthropic(集中) |

|---|---|---|

| 產品線 | GPT + DALL·E + Sora + Whisper + Jukebox | Claude(純文本/代碼) |

| 算力分配 | 文本 + 圖片 + 視頻 + 音頻 | 100% 文本推理 |

| 核心競爭力 | "什麼都能做" | "推理和代碼做到最好" |

| 商業模式 | 消費級 + API + 企業 | API + 企業(高客單價) |

| Sora 的結果 | 6 個月關停,$2.1M 收入 | — |

| Claude Code 的結果 | — | 編碼 Agent 市場領先 |

爲什麼推理模型的 ROI 遠高於視頻模型

從商業角度看,推理模型和視頻模型的單位算力回報完全不在一個量級:

- 推理模型: 企業客戶按 Token 付費,利潤率高,使用頻率高,可嵌入工作流

- 視頻模型: 消費者付費意願低(Sora 證明了這一點),算力消耗巨大,使用頻率低

一塊 H100 GPU 用於運行 Claude Opus 4.6,每天可以服務數千次企業級推理請求,產生可觀的 API 收入。同樣的 GPU 用於視頻生成,每天只能生成幾十條視頻,且大部分用戶不願意爲此付費。

Anthropic 不做圖片生成的信號

儘管有泄露的配置文件顯示 Claude 內部存在 create_image 和 edit_image 函數名,但 Anthropic 至今沒有正式發佈任何圖片生成能力。Manifold 預測市場上"Anthropic 是否會在 2026 年發佈圖片生成模型"的概率持續走低。

Anthropic 的制度文化和資源分配策略都推向同一個方向:把推理能力做到極致,而不是分散精力去做圖片和視頻。

🎯 開發者建議: Anthropic 不做圖片/視頻不代表你的應用不能有這些能力。通過 API易 apiyi.com 可以同時接入 Claude(推理)、Nano Banana 2(圖片生成)、Seedance(視頻生成),用不同模型的優勢互補。

AI 視頻生成賽道的算力經濟學

Sora 的關停給整個 AI 視頻生成行業敲響了警鐘:視頻模型的算力消耗和商業變現之間存在巨大鴻溝。

AI 視頻生成 API 定價對比

| 模型 | 每秒視頻價格 | 10 秒視頻成本 | 生成速度 | 分辨率 |

|---|---|---|---|---|

| Sora | $0.10/秒 | $1.00 | 60-120 秒 | 1080p |

| Kling 2.0 | $0.07/秒 | $0.70 | 中等 | 1080p |

| Ray 2 | $0.05-0.16/秒 | $0.50-1.62 | 47-167 秒 | 1080p |

| Ray 2 Flash | $0.02-0.05/秒 | $0.17-0.54 | 30-53 秒 | 720p |

| Seedance 2.0 | 未公開 | 付費層級制 | ~30 秒 | 2K |

對比文本模型的成本:Claude Opus 4.6 的輸出 Token 價格約 $60/百萬 Token,一次完整的推理對話(~1000 output tokens)成本約 $0.06——僅相當於 Sora 生成 0.6 秒視頻的費用。

誰能在視頻賽道活下來

Sora 的關停並不意味着 AI 視頻生成沒有未來,而是說明了一個關鍵條件:只有擁有內容生態的公司才能在視頻賽道長期生存。

- 字節跳動(Seedance): 背靠 TikTok 和抖音,天然有視頻消費場景和用戶基礎

- Google(Veo): 背靠 YouTube,全球最大視頻平臺

- 快手(Kling): 國內短視頻平臺,生態閉環

而 OpenAI 沒有自己的內容平臺——Sora 生成的視頻缺乏消費出口,用戶做完視頻不知道發哪裏。

提示: 儘管 Sora 下線了,視頻生成 API 市場仍然活躍。Kling、Seedance、Ray 2 等模型可通過 API易 apiyi.com 統一接入,一個 Key 調用多種視頻生成能力。

對開發者的啓示

常見問題

Q1: Sora 下線後,我的 Sora API 集成怎麼辦?

Sora 的 API 和消費端同時關停,所有 API 集成都會失效。建議立即遷移到替代方案:Seedance 2.0(質量最高、速度最快)、Kling 2.0(性價比最優,$0.07/秒)、或 Ray 2 Flash(最便宜,$0.02/秒起)。通過 API易 apiyi.com 可以快速切換到這些替代模型,只需修改模型名。

Q2: Anthropic 未來會做圖片或視頻生成嗎?

短期內不太可能。雖然泄露文件顯示 Claude 內部存在 create_image 函數名,但 Anthropic 的制度文化和資源分配策略都優先推理能力。Manifold 預測市場也顯示概率較低。Anthropic 的競爭優勢正是來自於這種"不做什麼"的戰略紀律——把所有算力集中在推理上。

Q3: Seedance 2.0 和 Kling 2.0 哪個更適合 API 集成?

取決於需求:Seedance 2.0 在質量和功能上更強(2K 原生、原生音頻、4 模態輸入),但目前 API 定價尚未公開透明化。Kling 2.0 的 API 定價更透明($0.07/秒),生態更開放。如果追求最高質量選 Seedance,如果追求性價比選 Kling。兩者在 API易 apiyi.com 均可接入。

Q4: OpenAI 關停 Sora 會影響 GPT-5 的開發嗎?

恰恰相反——關停 Sora 正是爲了給 GPT-5 騰出算力。Sam Altman 明確告訴員工,Sora 釋放的資源將用於下一代模型。從競爭角度看,OpenAI 正面臨 Anthropic Claude 在企業市場的強勢挑戰,必須把算力集中到文本和推理能力上才能保持競爭力。

總結

Sora 下線事件的核心啓示:

- 算力是零和博弈: OpenAI 的教訓證明,同時做文本、圖片、視頻、音頻會導致每條線都做不到最好。Anthropic 從不碰圖片和視頻,把 100% 算力集中在推理上,結果是 Opus 4.6 的推理能力領先競品

- 視頻賽道需要內容生態: Sora 缺乏分發渠道導致用戶留存低、收入僅 $2.1M。Seedance 背靠 TikTok、Veo 背靠 YouTube,天然有視頻消費場景

- 多模型組合是最優解: "不做什麼"比"做什麼"更重要的戰略,意味着開發者應該用不同領域的最強模型組合,而不是依賴一個"全能"模型

推薦通過 API易 apiyi.com 統一管理多模型調用——推理用 Claude、圖片用 Nano Banana、視頻用 Seedance/Kling——平臺提供免費額度和統一接口,一個 Key 覆蓋所有模型。

📚 參考資料

-

TechCrunch: OpenAI's Sora is shutting down: Sora 關停的完整報道

- 鏈接:

techcrunch.com/2026/03/24/openais-sora-was-the-creepiest-app-on-your-phone-now-its-shutting-down/ - 說明: 包含下載數據、收入數據和 OpenAI 官方聲明

- 鏈接:

-

CNBC: OpenAI shutters Sora as company reels in costs: 算力成本和 IPO 角度的分析

- 鏈接:

cnbc.com/2026/03/24/openai-shutters-short-form-video-app-sora-as-company-reels-in-costs.html - 說明: 包含財務數據和競爭壓力分析

- 鏈接:

-

Variety: Disney Drops Plans for $1 Billion Investment: 迪士尼撤資報道

- 鏈接:

variety.com/2026/digital/news/openai-shutting-down-sora-video-disney-1236698277/ - 說明: 迪士尼退出合作的詳細背景

- 鏈接:

-

Seedance 2.0 官方網站: 字節跳動視頻生成模型的完整功能介紹

- 鏈接:

seedance2.ai - 說明: 包含 4 模態輸入、2K 輸出和原生音頻功能的詳細說明

- 鏈接:

-

API易文檔中心: 多模型統一 API 接入

- 鏈接:

docs.apiyi.com - 說明: 支持 Claude、Nano Banana、視頻生成模型的一站式接入

- 鏈接:

作者: APIYI 技術團隊

技術交流: 歡迎在評論區討論,更多資料可訪問 API易 docs.apiyi.com 文檔中心