選擇一個既快又便宜的 AI 模型,是每個開發者在高頻調用場景中面臨的核心挑戰。Google 於 2026 年 3 月 3 日正式發佈了 Gemini 3.1 Flash Lite Preview,這是 Gemini 3 系列中最快、最具性價比的模型,專爲翻譯、摘要、分類等高吞吐量場景而設計。

核心價值: 讀完本文,你將全面瞭解 Gemini 3.1 Flash Lite 的技術參數、性能優勢和最佳使用場景,並通過實際代碼快速上手調用。

Gemini 3.1 Flash Lite 核心參數速覽

在深入瞭解 Gemini 3.1 Flash Lite 之前,先看一下這個模型的關鍵技術規格:

| 參數項 | Gemini 3.1 Flash Lite 規格 | 說明 |

|---|---|---|

| 模型 ID | gemini-3.1-flash-lite-preview |

當前爲預覽版 |

| 上下文窗口 | 1,000,000 tokens | 百萬級長上下文 |

| 最大輸出 | 64,000 tokens | 支持長文本生成 |

| 輸入價格 | $0.25 / 百萬 tokens | 極低成本 |

| 輸出價格 | $1.50 / 百萬 tokens | 高性價比輸出 |

| 輸出速度 | ~382 tokens/秒 | 極速響應 |

| 輸入模態 | 文本、圖片、音頻、視頻 | 原生多模態 |

| 輸出模態 | 文本 | 文本生成 |

| 發佈日期 | 2026 年 3 月 3 日 | 最新發布 |

🚀 快速開始: Gemini 3.1 Flash Lite Preview 已在 API易 apiyi.com 平臺上線,支持 OpenAI 兼容接口調用,無需額外配置即可快速接入。

Gemini 3.1 Flash Lite 的 5 大核心優勢

優勢一:速度提升 2.5 倍

Gemini 3.1 Flash Lite 在速度方面實現了質的飛躍。根據 Artificial Analysis 基準測試數據:

- 首 Token 響應時間 (TTFT): 比 Gemini 2.5 Flash 快 2.5 倍

- 輸出速度: 達到 382 tokens/秒,比 Gemini 2.5 Flash 的 232 tokens/秒提升 64%

- 整體吞吐量: 提升約 45%

這意味着在實時翻譯、聊天機器人、內容摘要等對延遲敏感的場景中,用戶可以獲得近乎即時的響應體驗。

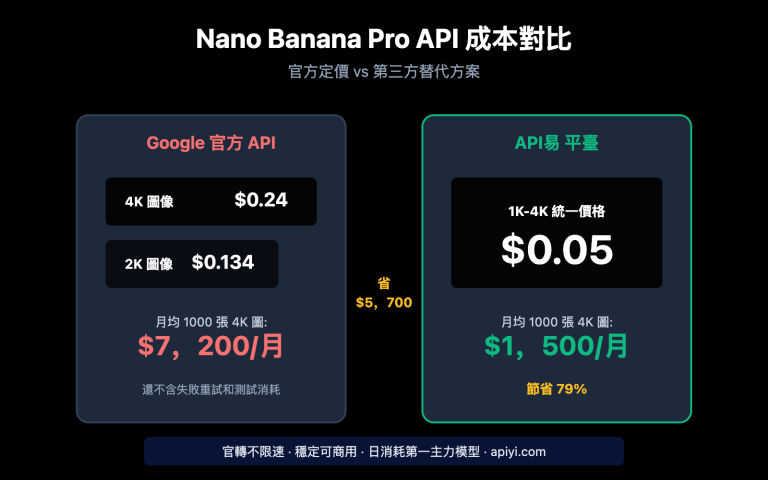

優勢二:極致性價比

Gemini 3.1 Flash Lite 的定價策略非常有競爭力:

| 價格對比 | 輸入價格 ($/1M tokens) | 輸出價格 ($/1M tokens) | 綜合成本 |

|---|---|---|---|

| Gemini 3.1 Flash Lite | $0.25 | $1.50 | ⭐ 最低 |

| Gemini 3 Flash | $1.00 | $4.00 | 中等 |

| Gemini 3 Pro | $2.50 | $15.00 | 較高 |

| Claude 4.5 Haiku | $0.80 | $4.00 | 中等 |

| GPT-5 mini | $0.60 | $2.40 | 中等 |

以每天處理 100 萬個 tokens 計算,使用 Gemini 3.1 Flash Lite 的月成本僅約 $52.50,相比 Gemini 3 Pro 節省超過 80%。

優勢三:百萬 Token 上下文窗口

Gemini 3.1 Flash Lite 支持 1M tokens 的上下文窗口,這在同價位模型中極爲罕見。這意味着你可以:

- 一次性處理整本書籍的翻譯或摘要

- 分析數小時的會議錄音轉錄文本

- 處理大規模代碼庫的理解和文檔生成

- 進行長文檔的多語言對照翻譯

優勢四:原生多模態支持

雖然定位爲輕量級模型,Gemini 3.1 Flash Lite 依然保留了完整的多模態輸入能力:

- 文本: 標準文本理解和生成

- 圖片: 圖像識別和理解

- 音頻: 語音內容處理

- 視頻: 視頻內容理解

這使它不僅適用於純文本任務,還能處理圖文混合翻譯、視頻字幕生成等多模態場景。

優勢五:可調節思考深度

Gemini 3.1 Flash Lite 支持 Thinking Levels 功能,開發者可以根據任務複雜度靈活調整模型的推理深度:

- 低思考量: 適用於簡單翻譯、分類等任務,追求極致速度

- 中思考量: 適用於摘要、內容改寫等需要一定理解的任務

- 高思考量: 適用於複雜推理、代碼生成等需要深度思考的任務

Gemini 3.1 Flash Lite 性能基準測試

Gemini 3.1 Flash Lite 在 Arena.ai 排行榜獲得了 1432 分 的 Elo 評分,在同級別模型中表現突出。

| 基準測試 | Gemini 3.1 Flash Lite | 說明 |

|---|---|---|

| GPQA Diamond | 86.9% | 科學知識推理 |

| MMMU-Pro | 76.8% | 多模態推理 |

| MMMLU | 88.9% | 多語言問答 |

| LiveCodeBench | 72.0% | 代碼生成 |

| Video-MMMU | 84.8% | 視頻理解 |

| SimpleQA | 43.3% | 參數化知識 |

| MRCR v2 (128k) | 60.1% | 長上下文理解 |

值得注意的是,在 GPQA Diamond、MMMLU 等 6 項基準測試中,Gemini 3.1 Flash Lite 超越了 GPT-5 mini 和 Claude 4.5 Haiku,證明了輕量級模型也能具備前沿水準的智能表現。

🎯 技術建議: 以上基準測試數據說明 Gemini 3.1 Flash Lite 在多語言處理方面表現尤爲出色(MMMLU 88.9%),非常適合跨語言翻譯場景。通過 API易 apiyi.com 可以快速調用該模型進行多語言任務測試。

Gemini 3.1 Flash Lite 快速上手

極簡代碼示例

使用 OpenAI 兼容接口,只需幾行代碼即可調用 Gemini 3.1 Flash Lite:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # API易統一接口

)

# 翻譯場景示例

response = client.chat.completions.create(

model="gemini-3.1-flash-lite-preview",

messages=[

{"role": "system", "content": "你是一位專業翻譯,請將用戶輸入的中文翻譯成英文,保持原意和語氣。"},

{"role": "user", "content": "人工智能正在深刻改變我們的工作方式和生活方式。"}

],

temperature=0.3

)

print(response.choices[0].message.content)

查看完整代碼:批量翻譯 + 摘要場景

import openai

import time

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # API易統一接口

)

MODEL = "gemini-3.1-flash-lite-preview"

def translate_text(text, target_lang="English"):

"""翻譯文本到目標語言"""

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"Translate the following text to {target_lang}. Keep the original meaning and tone."},

{"role": "user", "content": text}

],

temperature=0.3

)

return response.choices[0].message.content

def summarize_text(text, max_words=100):

"""生成文本摘要"""

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"請用不超過{max_words}字總結以下內容的核心要點。"},

{"role": "user", "content": text}

],

temperature=0.5

)

return response.choices[0].message.content

def classify_text(text, categories):

"""文本分類"""

cats = "、".join(categories)

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"將以下文本分類到這些類別之一: {cats}。只返回類別名稱。"},

{"role": "user", "content": text}

],

temperature=0.1

)

return response.choices[0].message.content

# 使用示例

texts = [

"量子計算將在未來十年徹底改變密碼學領域",

"新款電動汽車續航里程突破1000公里",

"央行宣佈下調基準利率25個基點"

]

categories = ["科技", "汽車", "財經", "體育", "娛樂"]

for text in texts:

# 翻譯

translated = translate_text(text)

# 分類

category = classify_text(text, categories)

# 摘要

summary = summarize_text(text, max_words=30)

print(f"原文: {text}")

print(f"翻譯: {translated}")

print(f"分類: {category}")

print(f"摘要: {summary}")

print("---")

💰 成本優化: 對於翻譯、摘要、分類等高頻調用場景,Gemini 3.1 Flash Lite 的超低定價(輸入僅 $0.25/百萬 tokens)能顯著降低運營成本。通過 API易 apiyi.com 平臺調用還可獲得額外的價格優勢和免費測試額度。

Gemini 3.1 Flash Lite 最佳使用場景

場景一:高頻批量翻譯

Gemini 3.1 Flash Lite 在多語言問答基準 MMMLU 上達到 88.9% 的高分,加上極低的調用成本和極快的響應速度,是批量翻譯任務的理想選擇:

- 電商產品描述翻譯: 每天數萬條產品信息的多語言翻譯

- 用戶評論翻譯: 實時翻譯海外用戶反饋

- 技術文檔國際化: 大規模文檔的多語言版本生成

- 字幕翻譯: 視頻字幕的快速多語言轉換

場景二:實時內容摘要

382 tokens/秒的輸出速度使其非常適合實時摘要場景:

- 新聞摘要生成: 海量新聞的自動摘要提取

- 會議紀要: 長時間會議錄音的快速總結

- 文獻綜述: 學術論文的批量摘要生成

- 郵件摘要: 企業郵件的自動摘要和分類

場景三:大規模內容審覈與分類

低延遲和低成本的特性使其成爲內容審覈流水線的理想選擇:

- 用戶生成內容審覈: 社交平臺的內容安全過濾

- 工單自動分類: 客服系統的智能路由

- 情感分析: 品牌輿情的實時監控

- 標籤自動生成: 內容管理系統的自動標籤

場景選擇決策指南

| 使用場景 | 推薦理由 | 關鍵優勢 | 預估月成本 |

|---|---|---|---|

| 批量翻譯 | MMMLU 88.9% 多語言能力突出 | 低價 + 高質 | ~$50 (100萬tokens/天) |

| 實時摘要 | 382 tokens/秒極速輸出 | 低延遲 + 快速 | ~$30 (50萬tokens/天) |

| 內容審覈 | 分類準確率高、響應快 | 低成本 + 批量處理 | ~$20 (30萬tokens/天) |

| 聊天機器人 | TTFT 快 2.5 倍 | 即時響應 | ~$80 (200萬tokens/天) |

| 長文檔處理 | 1M tokens 上下文窗口 | 整本書一次處理 | 按需計費 |

💡 選擇建議: 如果你的業務場景是高頻、批量、對成本敏感的文本處理任務,Gemini 3.1 Flash Lite 是目前性價比最優的選擇。我們建議通過 API易 apiyi.com 平臺進行實際場景測試,該平臺支持一鍵切換到其他模型進行效果對比。

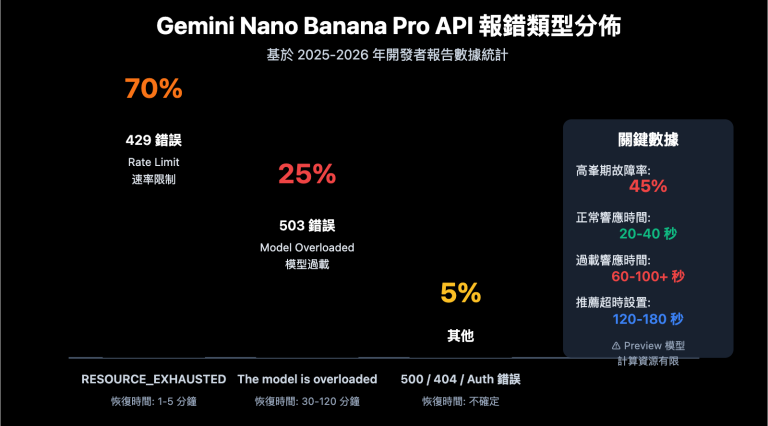

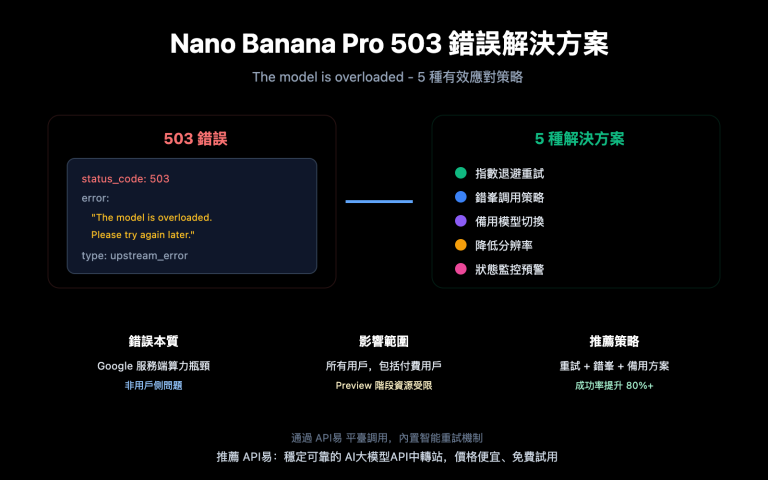

Gemini 3.1 Flash Lite 使用注意事項

當前限制

作爲預覽版模型,需要注意以下幾點:

- 預覽階段: 模型仍處於 Preview 狀態,API 接口和行爲可能會有調整

- 輸出限制: 最大輸出爲 64K tokens,超長生成任務需要分段處理

- 超長上下文性能: 在 1M tokens 極長上下文場景(MRCR v2 1M 測試僅 12.3%)下表現一般,建議控制在 128K 以內獲得最佳效果

- 安全邊界: 圖像到文本的安全性評分有待提升,涉及敏感內容時需增加審覈層

使用建議

- 溫度參數: 翻譯任務建議使用

temperature=0.3,摘要任務建議temperature=0.5 - 系統提示詞: 提供清晰的角色定義和輸出格式要求,可顯著提升輸出質量

- 批量處理: 利用異步調用方式提升吞吐量,充分發揮模型的速度優勢

- 上下文控制: 雖然支持 1M 上下文,但建議將常規任務控制在 128K 以內以獲得最佳性價比

常見問題

Q1: Gemini 3.1 Flash Lite 和 Gemini 3 Flash 有什麼區別?

Gemini 3.1 Flash Lite 是 Gemini 3 系列中的輕量級版本,專爲高頻、低成本場景優化。相比 Gemini 3 Flash,它的輸入價格低 75%($0.25 vs $1.00),輸出速度快約 64%,但在複雜推理任務上的能力略低。簡單來說:需要極致性價比選 Flash Lite,需要更強推理能力選 Flash。通過 API易 apiyi.com 平臺可以同時測試兩個模型,快速找到最適合你場景的選擇。

Q2: Gemini 3.1 Flash Lite 適合用來做翻譯嗎?

非常適合。Gemini 3.1 Flash Lite 在多語言基準測試 MMMLU 上獲得了 88.9% 的高分,在同級別模型中排名領先。加上 $0.25/百萬 tokens 的超低輸入價格和 382 tokens/秒的輸出速度,它是目前批量翻譯任務最具性價比的模型之一。建議通過 API易 apiyi.com 獲取免費測試額度進行實際翻譯質量驗證。

Q3: 如何通過 OpenAI 兼容接口調用 Gemini 3.1 Flash Lite?

只需將 base_url 設置爲 API易的接口地址,model 參數使用 gemini-3.1-flash-lite-preview 即可。無需修改現有的 OpenAI SDK 代碼結構,實現無縫切換。詳見本文「快速上手」章節的代碼示例。

Q4: Gemini 3.1 Flash Lite 的 1M 上下文窗口實際好用嗎?

在 128K tokens 範圍內表現優秀(MRCR v2 128K 得分 60.1%),但在極端的 1M tokens 場景下性能會有明顯下降(MRCR v2 1M 得分 12.3%)。建議日常使用控制在 128K 以內,需要處理超長文檔時可以採用分段策略。

總結

Gemini 3.1 Flash Lite Preview 憑藉 $0.25/百萬輸入 tokens 的超低價格、382 tokens/秒 的極速輸出、1M tokens 的上下文窗口,以及在多語言處理(MMMLU 88.9%)和科學推理(GPQA Diamond 86.9%)等基準測試中的優異表現,成爲 2026 年翻譯、摘要、分類等高頻場景的性價比之王。

無論你是需要處理每天數百萬 tokens 的批量翻譯,還是構建低延遲的實時摘要服務,Gemini 3.1 Flash Lite 都是值得優先考慮的選擇。

推薦通過 API易 apiyi.com 快速接入 Gemini 3.1 Flash Lite Preview,該平臺提供 OpenAI 兼容接口,支持一鍵切換多種主流模型,便於快速驗證效果和對比選型。

參考資料

-

Google DeepMind – Gemini 3.1 Flash-Lite Model Card: 官方模型技術規格和基準測試數據

- 鏈接:

deepmind.google/models/model-cards/gemini-3-1-flash-lite/

- 鏈接:

-

Google AI for Developers – Gemini 3.1 Flash-Lite Preview: 官方 API 文檔和開發指南

- 鏈接:

ai.google.dev/gemini-api/docs/models/gemini-3.1-flash-lite-preview

- 鏈接:

-

Artificial Analysis – 性能評測: 獨立第三方的速度和性能基準測試

- 鏈接:

artificialanalysis.ai/models/gemini-3-1-flash-lite-preview

- 鏈接:

📝 作者: APIYI 技術團隊 | 更多 AI 模型使用指南和技術教程,請訪問 API易幫助中心 help.apiyi.com