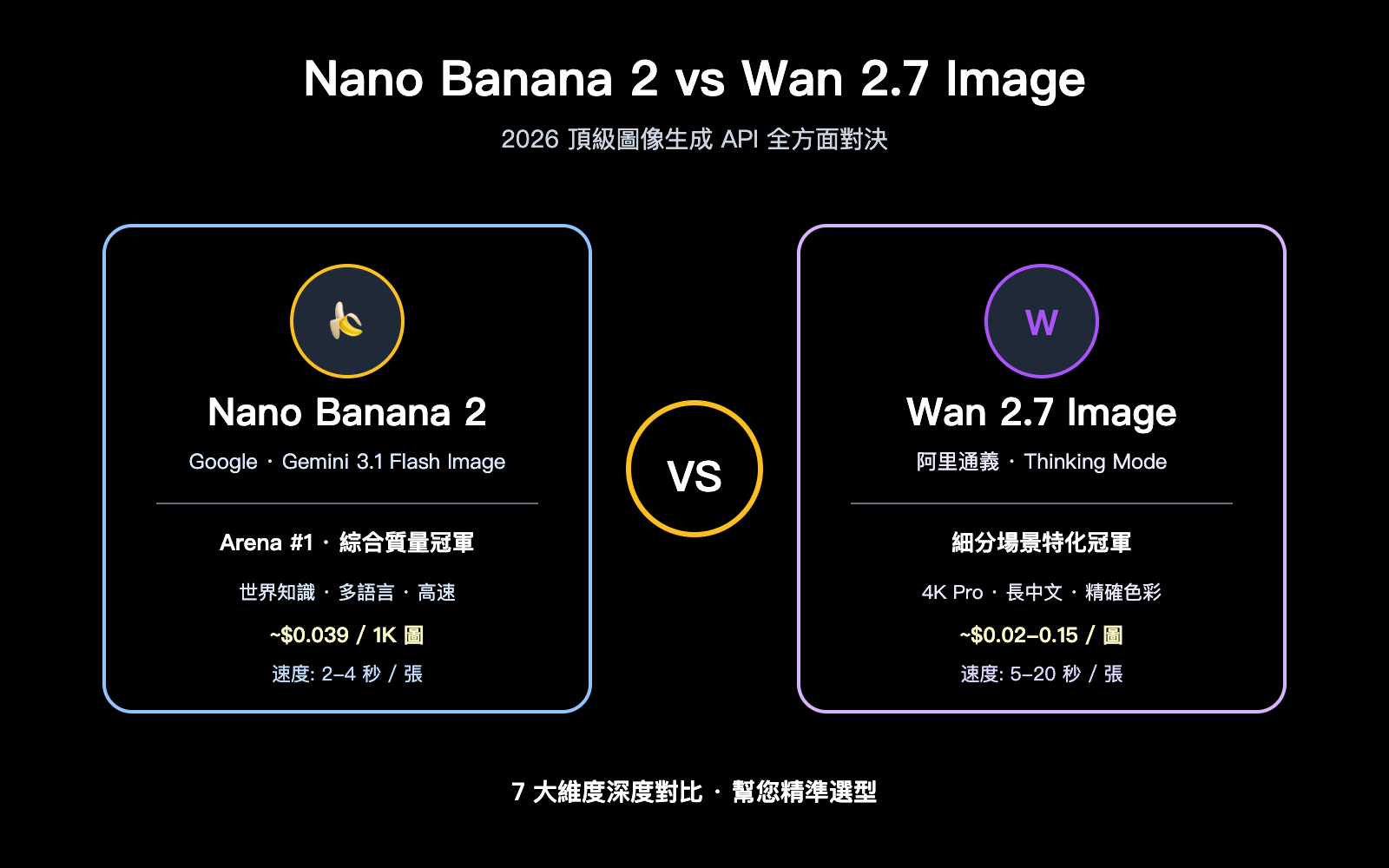

2026 年上半年,全球圖像生成 API 賽道迎來兩位重量級選手: 一位是 Google 在 2 月底推出的 Nano Banana 2 (Gemini 3.1 Flash Image Preview),以"Pro 級質量 + Flash 級速度"迅速登頂 Artificial Analysis Image Arena 榜單;另一位是阿里通義實驗室 4 月 6 日發佈的 Wan 2.7 Image,首次在國產圖像模型中引入 Thinking Mode (思考模式) 與 4K Pro 分辨率。

兩者都號稱"業界頂級",但它們的技術路線、能力取捨與適用場景其實差異巨大。本文基於兩者的官方規格文檔、Artificial Analysis 榜單以及英文社區實測,從技術架構、生成質量、文字渲染、多主體一致性、定價、中文場景、API 接入7 個維度做一次徹底的對比,幫助您在生產環境中選對模型。

如果您希望在同一個 API Key 下並行測試兩個模型,可以通過 API易 apiyi.com 平臺直接測試。方便您拿自己的業務 prompt 做盲測。

Nano Banana 2 vs Wan 2.7 Image 核心能力速覽

兩款模型的基本定位對比

| 對比維度 | Nano Banana 2 | Wan 2.7 Image |

|---|---|---|

| 發佈廠商 | Google DeepMind | 阿里巴巴通義實驗室 |

| 基礎模型 | Gemini 3.1 Flash Image | 阿里 Wan 系列 |

| 發佈時間 | 2026-02-27 | 2026-04-06 |

| 核心定位 | 高速 + Pro 級質量 | Thinking Mode + 4K Pro |

| 最高分辨率 | 最高 4K (約 4096×4096) | 標準 2048×2048 · Pro 4K |

| 官方通道 | Gemini API / Vertex AI | 阿里雲 Model Studio / WaveSpeedAI |

| Arena 排名 | Text-to-Image #1 | 暫未獨立上榜 |

技術取向的根本差異

在完整對比之前,必須先理解兩者最本質的設計哲學差異:

- Nano Banana 2 走的是"世界知識 + 速度"路線: 共享 Gemini 3.1 的世界模型和實時搜索能力,它不僅是"畫圖"模型,更是"能看懂提示背後真實世界"的模型

- Wan 2.7 Image 走的是"推理 + 精確控制"路線: 引入 Thinking Mode,讓模型在生成前對構圖、空間關係、語義意圖進行推理規劃;同時提供 HEX 色彩代碼、9 張參考圖等精細控制手段

這兩條路線並非簡單孰優孰劣,而是對應不同的業務需求。這也是爲什麼在 Artificial Analysis 綜合榜單上 Nano Banana 2 領先,但在某些特定中文文案、品牌色彩嚴格場景下,Wan 2.7 反而更受國內用戶青睞。

🎯 選型前提: 如果您的業務覆蓋多語言與跨文化內容,優先考慮 Nano Banana 2;如果您的業務有嚴格品牌色 / 長中文 / 專業排版要求,優先考慮 Wan 2.7。建議通過 API易 apiyi.com 平臺同時接入兩者,分場景路由。

Nano Banana 2 vs Wan 2.7 Image 技術架構對比

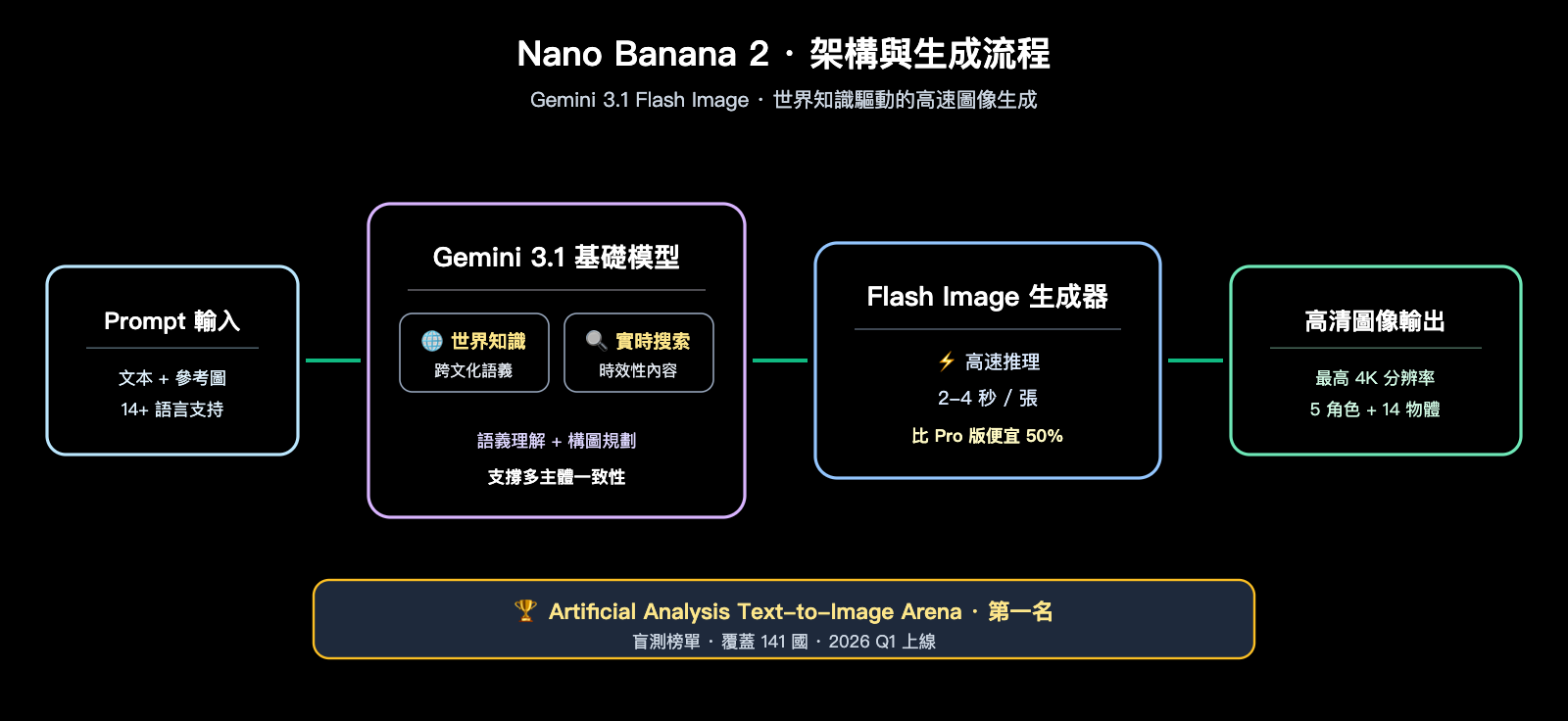

Nano Banana 2 的架構特點

Nano Banana 2 基於 Gemini 3.1 Flash 模型的共享世界知識表示,它的三個關鍵技術點:

- Gemini 世界知識庫: 模型理解"什麼是唐朝瓷器""什麼是包豪斯設計"這種跨文化概念,不需要在 prompt 中逐字解釋

- 實時搜索參考: Gemini 的實時信息能力被帶入圖像生成,時效性內容 (如最新產品、熱點賽事) 的視覺表達更準確

- Flash 級速度: 相比 Nano Banana Pro,單圖生成速度提升 2-3 倍,價格下降約 50%,在批量生成場景優勢明顯

Google 官方把 Nano Banana 2 同步上線到 Gemini App、Google Search (141 個國家)、Google Ads、Google Cloud 和 Flow,意味着它是目前渠道覆蓋最廣的頂級圖像模型。

Wan 2.7 Image 的架構特點

Wan 2.7 Image 繼承自 Wan 視頻生成模型的統一多模態架構,圖像端是視頻架構的"單幀特例"。它的三個核心技術差異化:

- Thinking Mode (思考模式): 模型先理解 prompt、規劃分鏡和空間佈局,再進入實際擴散生成——類似 LLM 的 Chain of Thought,但用於視覺構圖

- 4K Pro 輸出: 分標準版 (2048×2048) 與 Pro 版 (4096×4096) 兩檔,Pro 版本專爲印刷廣告、大幅海報等場景設計

- 12 語言長文本渲染: 支持 3000+ tokens 的文本區域嵌入,可在圖片中生成公式、表格、多語言海報文案

從架構看, Wan 2.7 Image 更像一個"工業級視覺生產工具",把可控性做到了圖像生成模型的第一梯隊。

Nano Banana 2 vs Wan 2.7 Image 生成質量實測對比

Artificial Analysis Image Arena 榜單表現

在 2026 年 3 月更新的 Artificial Analysis Image Arena 盲測榜單上:

| 榜單類別 | Nano Banana 2 | Wan 2.7 Image |

|---|---|---|

| Text-to-Image (總榜) | #1 | 暫未上榜 |

| 文字渲染 (Text Rendering) | 顯著進步 | 優秀 (長文本強項) |

| 3D 成像 | 領先 | 良好 |

| 肖像細節 | 良好 | 領先 (膚質細節) |

| 街景構圖 | 領先 | 中等 |

| 複雜空間關係 | 優秀 | 領先 (Thinking Mode) |

| 整體勝率 (6 場實測) | 5 勝 | 1 勝 |

英文社區的 "6 scene real-world test" 數據顯示: Wan 2.7 Image Pro 在 6 個真實場景測試中僅勝出 1 場,但這 1 場恰好是肖像細節——Wan 2.7 在皮膚紋理 (毛孔、色差、瑕疵) 上避免了 "AI 同款過度光滑" 的問題,這是 Nano Banana 2 目前的一個明顯短板。

兩款模型各自的質量優勢場景

| 質量維度 | 贏家 | 優勢描述 |

|---|---|---|

| 真實街景 / 環境敘事 | Nano Banana 2 | 構圖層次 + 光影深度更強 |

| 人物皮膚細節 | Wan 2.7 Image | 避免塑料感,保留真實瑕疵 |

| 多語言文字 (含中文) | Nano Banana 2 | 14 種語言改進,海報場景強 |

| 長中文段落渲染 | Wan 2.7 Image | 3000+ tokens 穩定輸出 |

| 多主體一致性 | Nano Banana 2 | 5 角色 + 14 物體上限 |

| 空間關係指令 | Wan 2.7 Image | Thinking Mode 先推理再繪 |

| 品牌色精確控制 | Wan 2.7 Image | 原生支持 HEX 色值 |

💡 質量結論: Nano Banana 2 是"綜合第一",Wan 2.7 Image 是"細分場景特化"。大多數通用場景 Nano Banana 2 勝,但凡涉及嚴格品牌色、長中文排版、人物肌理時,Wan 2.7 Image 具有明顯優勢。

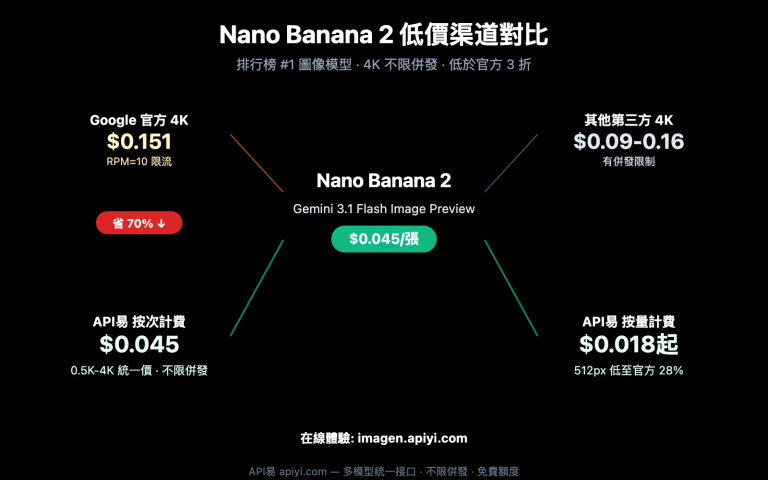

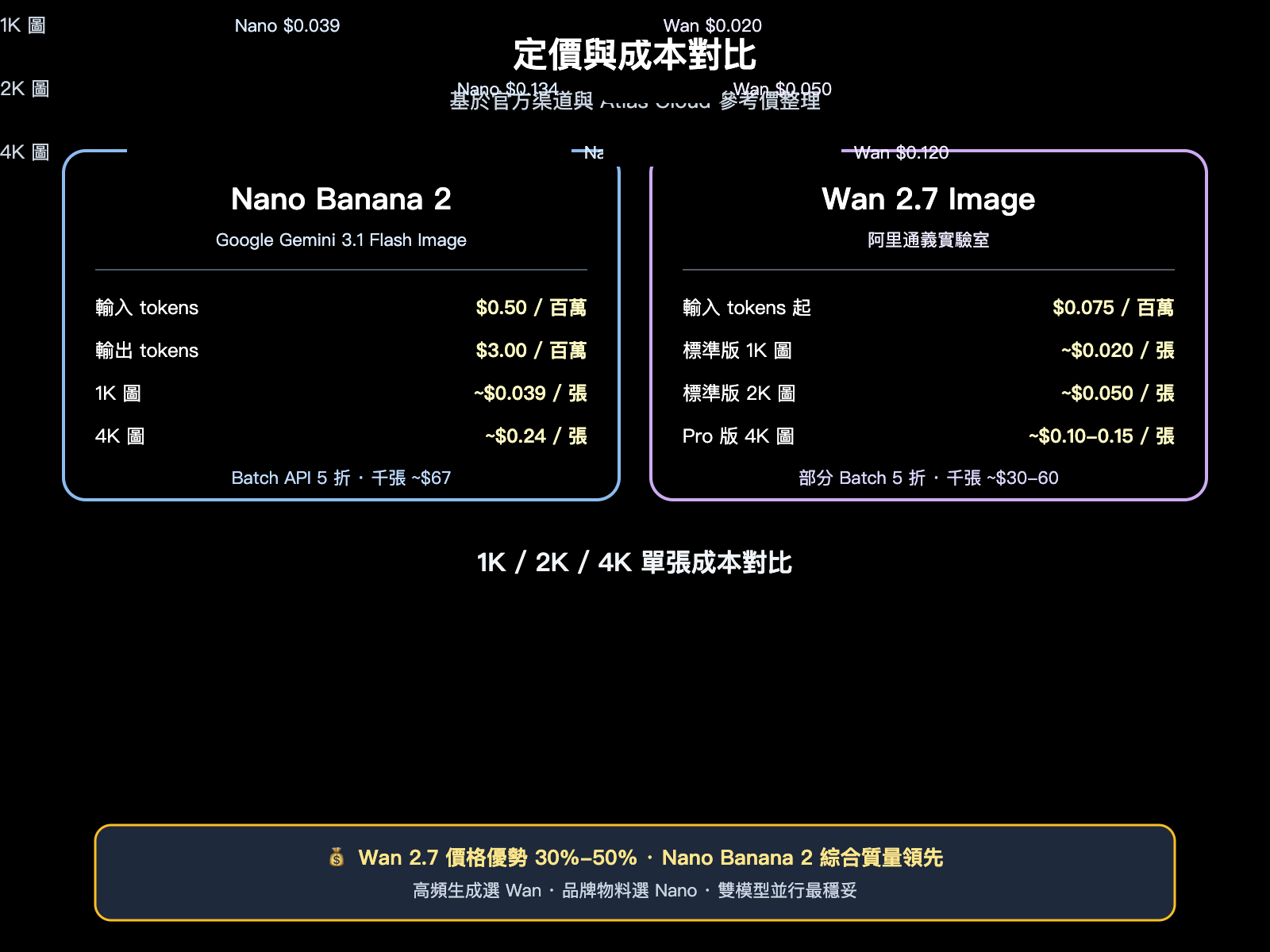

Nano Banana 2 vs Wan 2.7 Image 定價與成本對比

兩款模型的定價結構

| 計費維度 | Nano Banana 2 | Wan 2.7 Image |

|---|---|---|

| 輸入 token 單價 | $0.50 / 百萬 tokens | 約 $0.075 / 百萬 tokens 起 |

| 輸出 token 單價 | $3.00 / 百萬 tokens | 分檔次,Pro 版更高 |

| 1K 圖 (1024×1024) | ~$0.039 / 張 | ~$0.020-$0.030 / 張 |

| 2K 圖 | ~$0.134 / 張 | ~$0.050-$0.080 / 張 |

| 4K 圖 | ~$0.24 / 張 | ~$0.10-$0.15 / 張 (Pro) |

| 批量折扣 | Batch API 5 折 | Batch 部分場景 5 折 |

| 千張均價參考 | 約 $67 / 1000 張 | 約 $30-$60 / 1000 張 |

成本選型的 3 個判斷標準

單看"誰更便宜"意義不大——不同業務場景對質量 / 速度 / 價格的權重不同。建議按下面 3 條判斷:

- UGC 高頻生成 (月 >10 萬張): 價格敏感,Wan 2.7 Image 標準版更合適,每月可節省 30%-50% 成本

- 品牌物料 / 廣告設計: 質量敏感,Nano Banana 2 綜合質量更強,單張貴 10%-20% 但減少人工修圖時間

- 4K 印刷級大圖: Wan 2.7 Image Pro 是目前少數原生輸出 4K 的圖像模型,單價還低於 Nano Banana 2 的 4K 升級版

🎯 選擇建議: 如果您目前還無法判斷自己的業務屬於哪一類,推薦通過 API易 apiyi.com 平臺同時開通兩個模型的調用權限,用真實 prompt 各跑 100 張做對比,平臺後臺按調用統計總成本,1 周之內即可拿到有說服力的選型結論。

通過聚合平臺調用的成本優化

兩款模型的定價在不同渠道存在明顯差異——官方直調、阿里雲、Atlas Cloud、WaveSpeedAI、聚合平臺各不相同。一個實用的成本優化策略是:

- 通過聚合平臺 (如 API易 apiyi.com) 接入,統一計費、統一發票

- 在聚合平臺後臺設置每日預算告警,防止失控消費

- 利用 Batch API 的 5 折優惠處理非實時場景 (如夜間批量生成)

Nano Banana 2 vs Wan 2.7 Image 文字渲染能力對比

文字渲染一直是圖像生成模型的"硬指標"——幾個月前大多數模型還會把"美好生活"渲染成"羙好生活"這種字符錯位。兩款新模型在這項能力上都有質的飛躍:

| 文字渲染維度 | Nano Banana 2 | Wan 2.7 Image |

|---|---|---|

| 英文短文本 | 極佳 | 極佳 |

| 中文短文本 | 優秀 | 極佳 |

| 長段落文本 | 良好 (單行穩定) | 極佳 (3000+ tokens) |

| 數學公式 | 良好 | 優秀 |

| 表格 / 結構化 | 優秀 | 極佳 |

| 多語言混排 | 支持 14+ 語言 | 支持 12 語言 |

| 排版精確度 | 中等 | 精確 (可指定位置) |

| 字體多樣性 | 豐富 | 中等 |

Nano Banana 2 的文字優勢在於跨語言覆蓋廣——一張海報可以同時嵌入中英日韓阿 5 種語言的文案,這對跨境電商等場景特別有價值。

Wan 2.7 Image 的文字優勢在於長中文穩定——可以在單張圖內渲染一整段產品說明、完整的食譜步驟、甚至數學推導公式,這是其他圖像模型難以企及的能力。

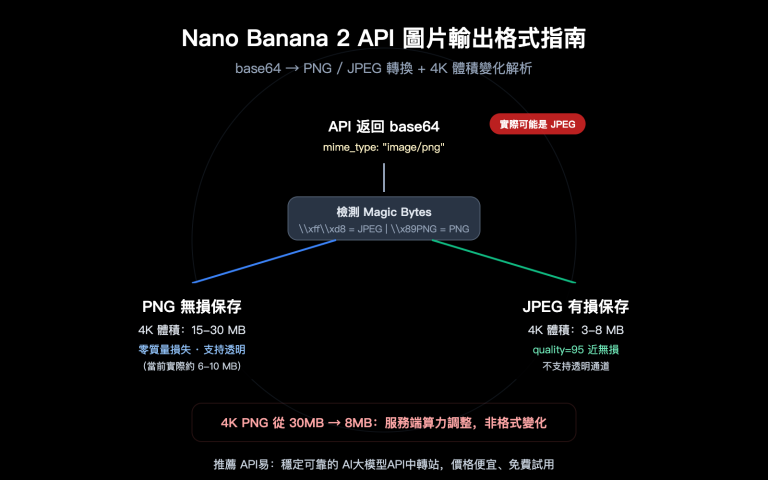

Nano Banana 2 vs Wan 2.7 Image API 調用對比

API 兼容性與 SDK 支持

| 接入維度 | Nano Banana 2 | Wan 2.7 Image |

|---|---|---|

| 官方 SDK | Google Gen AI SDK | 阿里雲 DashScope SDK |

| OpenAI 兼容協議 | 通過 Vertex AI | 部分第三方支持 |

| 流式返回 | 部分接口支持 | 多數不支持 |

| 批量調用 | Batch API | 阿里雲 batch 模式 |

| 回調 / Webhook | 支持 | 支持 |

| 多圖輸入 | 最多 5 主體參考 | 最多 9 張參考圖 |

兩家的原生 SDK 彼此不兼容,這意味着如果想同時使用兩個模型,你需要維護兩套 SDK 調用代碼,或者通過聚合平臺統一接入。

通過聚合平臺統一調用兩個模型

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_image(prompt: str, model: str, size: str = "1024x1024"):

response = client.images.generate(

model=model,

prompt=prompt,

size=size,

n=1

)

return response.data[0].url

nano_url = generate_image(

prompt="一張科技感海報,主標題'API易',副標題 'Unified AI Gateway'",

model="gemini-3.1-flash-image"

)

wan_url = generate_image(

prompt="品牌色 #1E40AF 的企業介紹海報,包含完整的中文產品說明段落",

model="wan-2.7-image-pro",

size="2048x2048"

)

📌 完整的 A/B 測試與統計代碼

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

TEST_PROMPTS = [

"一張極簡科技感產品海報,中央是 'GPT-4' 標題",

"水墨風格的長城秋景,題詩'不到長城非好漢'",

"實驗室中的科學家,穿白大褂,手持試管",

"復古賽博朋克街景,霓虹招牌顯示'2026 未來都市'",

"包含完整產品說明段落的食品營養海報"

]

def run_ab_test(prompt: str):

results = {}

for model in ["gemini-3.1-flash-image", "wan-2.7-image-pro"]:

start = time.time()

try:

response = client.images.generate(

model=model,

prompt=prompt,

size="1024x1024"

)

results[model] = {

"url": response.data[0].url,

"latency": time.time() - start,

"tokens": getattr(response, "usage", None)

}

except Exception as e:

results[model] = {"error": str(e)}

return results

for prompt in TEST_PROMPTS:

print(f"Prompt: {prompt}")

print(run_ab_test(prompt))

print("---")

這段代碼最大的價值在於: 一套 SDK、一個 API Key、一個 base_url 可以同時調用兩個模型,之後您可以自由切換 model 參數,不用維護兩份 SDK 代碼。

Nano Banana 2 vs Wan 2.7 Image 場景化選型建議

按業務類型的精準推薦

| 業務場景 | 推薦模型 | 關鍵理由 |

|---|---|---|

| 跨境電商商品圖 | Nano Banana 2 | 多語言 + 世界知識 |

| 中文品牌海報 | Wan 2.7 Image | 長中文 + 4K Pro |

| 自媒體配圖 | Nano Banana 2 | 速度快 + 單價低 |

| 4K 印刷大圖 | Wan 2.7 Image Pro | 原生 4K + 品牌色 |

| 社交媒體營銷圖 | Nano Banana 2 | 文字渲染 + Arena 第一 |

| 人像 / 肖像攝影風 | Wan 2.7 Image | 肌理細節更真實 |

| 信息圖表 / 數據可視化 | Nano Banana 2 | 世界知識理解強 |

| 複雜空間構圖 | Wan 2.7 Image | Thinking Mode 推理 |

| 遊戲美術 / 概念圖 | Nano Banana 2 | 構圖層次 + 敘事深度 |

| 科學公式 / 教育內容 | Wan 2.7 Image | 長文本 + 公式渲染 |

3 種典型業務組合策略

策略 1: Nano Banana 2 主力 + Wan 2.7 Image 補位

適合中小團隊,90% 調用走 Nano Banana 2 保證速度與綜合質量,遇到長中文、嚴格品牌色場景切到 Wan 2.7 Image。這種組合下單 token 成本可控,且無需頻繁切換模型。

策略 2: 雙模型並行 + 質量投票

適合品牌方 / 設計工作室,對同一 prompt 同時請求兩個模型,由產品或設計師人工選最終結果。單次成本翻倍,但質量上限顯著提高。

策略 3: Wan 2.7 Image 主力 + Nano Banana 2 特化

適合國內內容平臺、電商中臺,Wan 2.7 Image 處理中文主場景,Nano Banana 2 專門承接跨境、多語言、熱點時效性內容。

🎯 推薦做法: 無論採用哪種策略,都建議通過 API易 apiyi.com 聚合平臺統一接入,利用平臺的標籤分組、預算告警、統一發票等功能降低運維複雜度。

關於 Nano Banana 2 vs Wan 2.7 Image 的 FAQ

Q1: Nano Banana 2 和 Wan 2.7 Image,誰的中文理解更強?

兩者的中文理解都顯著優於上一代。Wan 2.7 Image 在長中文段落、古詩詞、專業術語場景更穩定,因爲其訓練數據覆蓋大量中文語料;Nano Banana 2 在日常中文、跨語言混排場景更好,尤其是帶有文化背景知識的 prompt (如"宋朝瓷器")。

Q2: 哪個模型的文字渲染不會糊?

兩者在短文本 (≤50 字符) 上都已經做到100% 清晰。差異主要在長文本: Wan 2.7 Image 支持 3000+ tokens 的長段落渲染 (適合菜單、產品說明),Nano Banana 2 更擅長多語言混排的短廣告文案。

Q3: API 調用速度誰更快?

Nano Banana 2 顯著更快——單圖生成時間約 2-4 秒,而 Wan 2.7 Image 標準版約 5-8 秒, Pro 版 4K 輸出約 15-20 秒。如果您的業務對實時性要求高,優先選 Nano Banana 2。

Q4: 兩個模型都能編輯已有圖片嗎?

都支持。Nano Banana 2 提供強大的圖像編輯 + 多主體一致性 (最多 5 個角色、14 個物體);Wan 2.7 Image 提供基於 9 張參考圖的風格遷移與複雜編輯,對局部精修控制力更強。

Q5: 在國內調用哪個更穩定?

Wan 2.7 Image 節點在國內,無需代理,發票合規;Nano Banana 2 需要跨境出口,直接調用 Google 官方需要科學上網。如果在國內部署生產業務,通過 API易 apiyi.com 這類合規聚合平臺接入 Nano Banana 2 是目前最主流的做法,可以規避網絡與合規風險。

Q6: 兩個模型能混合使用,讓單張圖片同時受益嗎?

可以。典型做法是**"生成 + 編輯"管線**: 先用 Nano Banana 2 快速生成主圖,再用 Wan 2.7 Image 基於這張圖做局部精修 (比如調整品牌色、優化中文文案區域)。這種混合管線比單一模型輸出質量更高,適合精品內容生產。

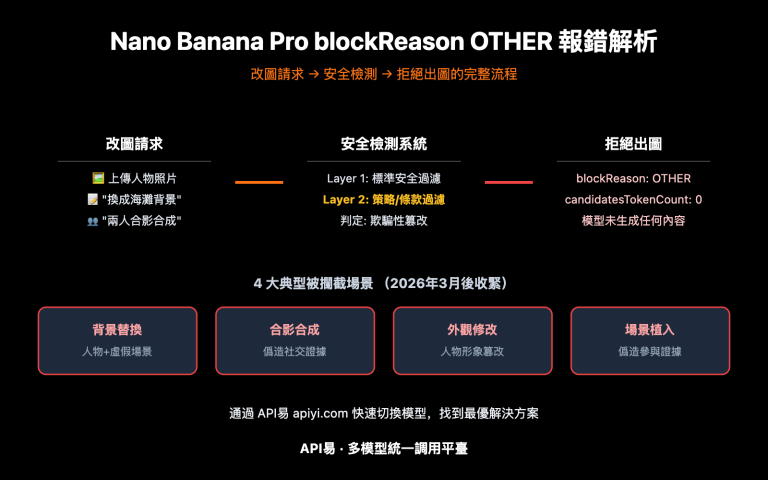

Q7: 兩個模型在法律 / 合規上有差異嗎?

整體都做了版權與內容安全攔截。Nano Banana 2 的 Layer 2 策略對名人肖像、知名 IP 非常嚴格;Wan 2.7 Image 對中文文化語境下的敏感詞有更細緻的攔截規則。商業用途前建議閱讀兩家的使用條款,或諮詢聚合平臺的法務支持。

Q8: 如果只能選一個,該選哪個?

- 如果您的業務主要在海外 / 跨境 / 多語言,選 Nano Banana 2

- 如果您的業務主要在國內 / 中文 / 品牌精確控制,選 Wan 2.7 Image

- 如果您的業務對質量極致追求,選 Nano Banana 2 (綜合勝率更高)

- 如果您的業務重視成本 + 4K 輸出,選 Wan 2.7 Image Pro

Q9: 未來 6 個月內會不會有下一代?

Google 通常每 4-6 個月迭代 Gemini Image 系列,下一代 Nano Banana 3 預計 2026 年 Q3-Q4;阿里 Wan 系列通常每 3-5 個月迭代一次,Wan 2.8 預計在 2026 年 Q3。短期內,本文對比的結論依然有效。

總結: Nano Banana 2 vs Wan 2.7 Image 怎麼選

回到本文最初的問題——Nano Banana 2 vs Wan 2.7 Image,到底選誰? 答案非常清晰:

Nano Banana 2 是 2026 年上半年的綜合第一。它在 Artificial Analysis Image Arena 登頂,單次調用價格比上一代下降 50%,速度提升 2-3 倍,加上 Gemini 3.1 世界知識帶來的跨文化語義理解能力,讓它在大多數通用場景下都是最優選擇。對需要速度、價格、多語言、跨境業務的團隊,這是毫無爭議的默認選項。

Wan 2.7 Image 是 2026 年細分場景的特化冠軍。它的 Thinking Mode 讓複雜空間構圖更穩定, 4K Pro 輸出覆蓋印刷級需求,3000+ tokens 長文本渲染能力適合需要大段中文內容的場景,人物肌理真實度避免了"塑料感"問題。對國內品牌、長中文內容、精確色彩控制的業務,它的優勢是 Nano Banana 2 短期內無法替代的。

最佳策略其實是**"組合拳"**——不要逼自己只選一個。通過 API易 apiyi.com 這類聚合平臺同時接入兩個模型,針對不同場景動態路由,既能利用 Nano Banana 2 的綜合質量優勢,又能在關鍵場景調用 Wan 2.7 Image 的特化能力。平臺的統一計費、按調用打標籤、按業務線隔離 API Key 等功能,讓多模型架構的運維成本降到最低。

今天就開始測試: 建議本週在 API易 apiyi.com 開通賬號,準備 20-50 條代表性 prompt,用同一套代碼調用兩個模型,產品和設計團隊盲評——一週之內您就能拿到最適合自己業務的決策依據。

作者: APIYI Team — 專注於 AI 大模型 API 中轉與圖像生成模型聚合服務