Nota do autor: análise detalhada das causas reais do erro PROHIBITED_CONTENT retornado pelo Nano Banana Pro, examinando o mecanismo de gatilho de comandos em cenários de troca de roupa de modelos para e-commerce e fornecendo soluções de reescrita de comandos que passam pela revisão de segurança.

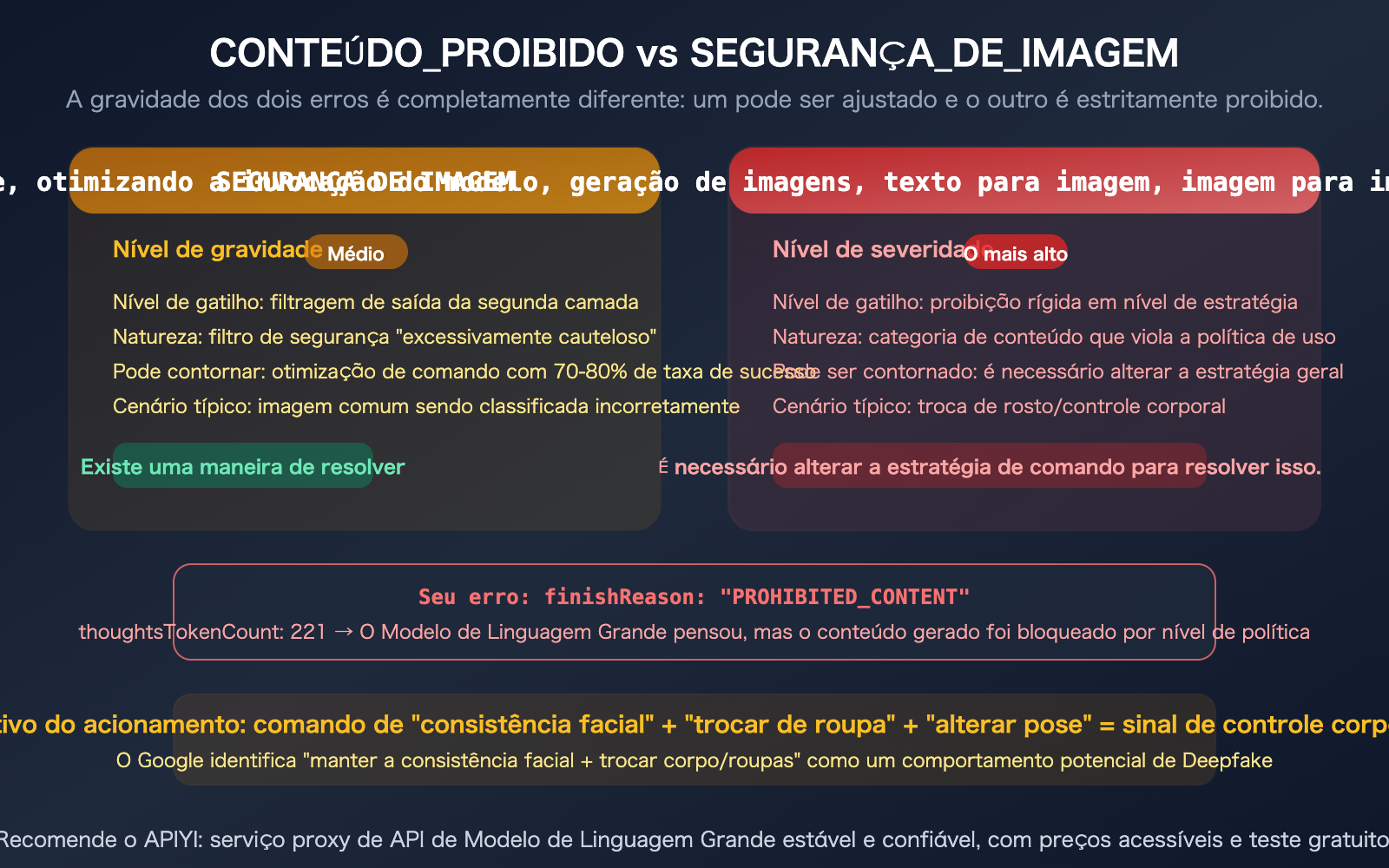

Ao realizar a troca de roupa para e-commerce, encontrei este erro: finishReason: PROHIBITED_CONTENT — o comando era claramente uma solicitação normal de troca de roupa de modelo, então por que foi classificado como "violação da política de uso de IA generativa do Google"? Isso é mais grave que o IMAGE_SAFETY — PROHIBITED_CONTENT é o nível mais alto de bloqueio de conteúdo do Google, geralmente significando uma proibição rígida. No entanto, a troca de roupa para e-commerce é uma necessidade comercial totalmente legítima, e o próprio produto Shopping do Google usa o Nano Banana para provadores virtuais. Este artigo analisará esse erro campo a campo, descobrirá quais palavras no comando acionaram o filtro e fornecerá soluções de reescrita que podem passar pela revisão.

Valor central: Após ler este artigo, você entenderá a diferença entre PROHIBITED_CONTENT e IMAGE_SAFETY, saberá onde seu comando de troca de roupa para e-commerce acionou o filtro e como reescrevê-lo para ser aprovado.

Análise detalhada do erro por campo

Primeiro, vamos esclarecer o significado de cada campo na resposta.

| Campo | Valor | Significado |

|---|---|---|

finishReason |

PROHIBITED_CONTENT |

Bloqueio de nível superior — proibição rígida baseada em políticas |

finishMessage |

"sensitive words that violate…" | O Google determinou que a saída contém conteúdo sensível que viola as políticas de uso |

content.parts |

null |

Nenhum conteúdo foi retornado |

promptTokenCount |

1150 | Entrada consumiu 1150 tokens (incluindo muitos tokens de imagem) |

candidatesTokenCount |

0 | Saída é 0 — bloqueado, o custo das imagens não é contabilizado |

thoughtsTokenCount |

221 | O modelo processou 221 tokens — um raciocínio mais profundo que o IMAGE_SAFETY |

TEXT: 118 |

Consumo de tokens do comando de texto 118 | Sua descrição de troca de roupa em chinês |

IMAGE: 1032 |

Consumo de tokens da entrada de imagem 1032 | Você enviou uma imagem de referência (foto do modelo + material da roupa) |

PROHIBITED_CONTENT é mais grave que IMAGE_SAFETY

| Dimensão de comparação | IMAGE_SAFETY | PROHIBITED_CONTENT |

|---|---|---|

| Fase de disparo | Revisão de segurança da imagem de saída | Revisão de categoria de conteúdo baseada em política |

| Gravidade | Média (possível falso positivo) | Máxima (proibição rígida por política) |

| Causa principal | A imagem gerada "parece insegura" | A solicitação envolve categorias de conteúdo proibidas |

| Ajustabilidade | Otimização do comando tem 70-80% de sucesso | Requer mudança na estratégia geral |

| Atitude do Google | Admite ser "cauteloso demais", existem erros | Considerado limite de política, não relaxado facilmente |

Por que seu comando disparou PROHIBITED_CONTENT

Análise do comando original

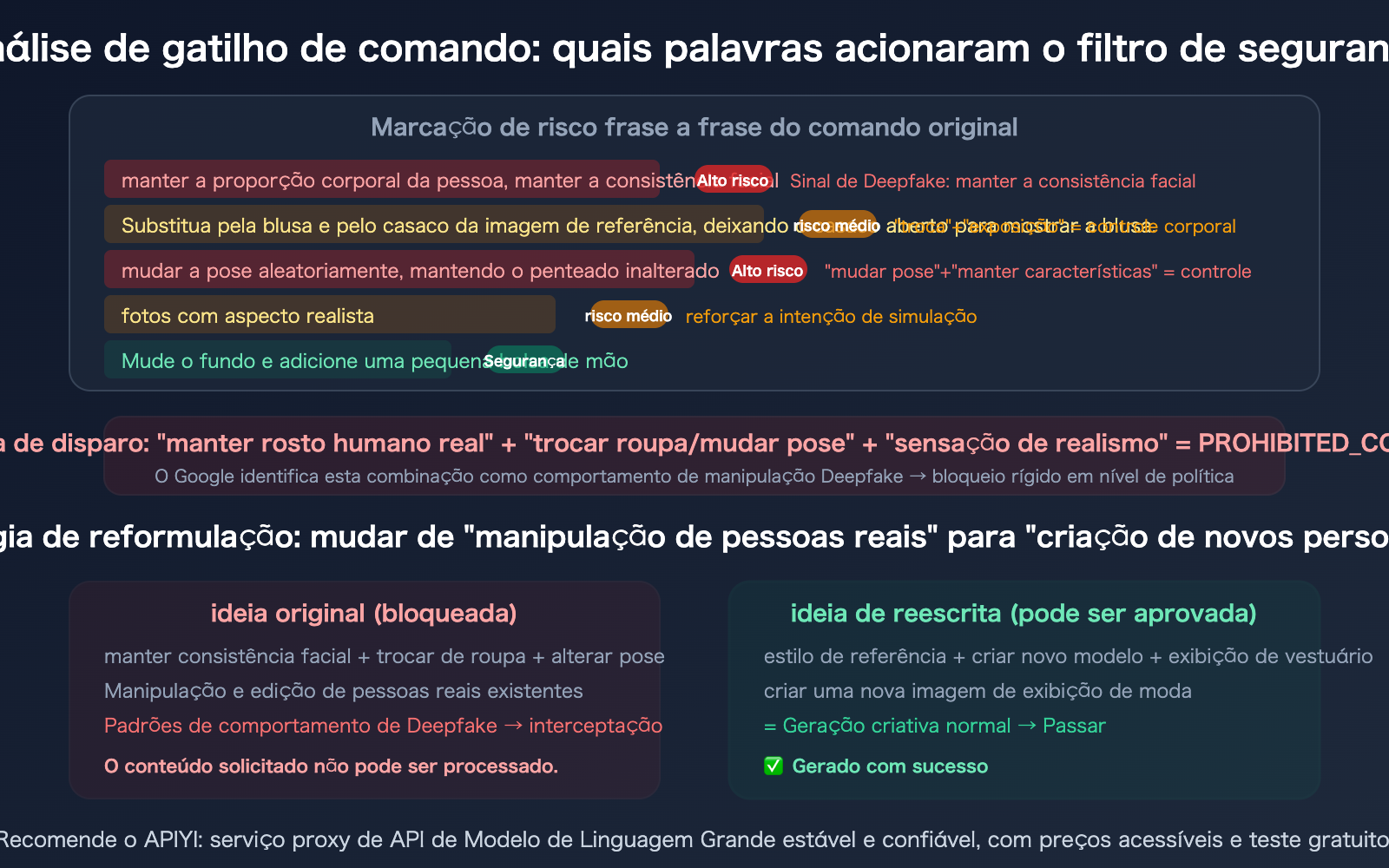

Vamos decompor seu comando frase por frase para encontrar os pontos sensíveis que acionaram o filtro de segurança:

| Fragmento do comando | Avaliação de risco de segurança | Motivo do disparo |

|---|---|---|

| "manter proporções corporais, manter rosto" | Alto risco | "manter rosto" = sinal de comportamento Deepfake |

| "trocar pela blusa e casaco do material" | Risco médio | "trocar" + imagem de referência = sinal de manipulação corporal |

| "casaco oversize, casaco aberto revelando a blusa" | Risco médio | "revelando" + descrição da roupa pode ser mal interpretada |

| "mudar o fundo" | Baixo risco | Operação normal |

| "penteado inalterado" | Risco médio | Reforçou o sinal de "manter características originais" |

| "mudar pose aleatoriamente" | Alto risco | "mudar pose" = sinal de manipulação corporal |

| "foto com aspecto realista" | Risco médio | "aspecto realista" reforçou a intenção de realismo/simulação |

Mecanismo de disparo central

O filtro de segurança do Google identificou seu comando como "manipulação corporal e modificação da aparência de pessoas reais" — o que atingiu exatamente a política de proteção contra Deepfake.

Especificamente, a combinação de três palavras-chave disparou o PROHIBITED_CONTENT:

- "manter rosto" — diz ao modelo "esta é a face de uma pessoa real, não a altere"

- "trocar roupa" + "mudar pose" — pede ao modelo para alterar o estado corporal dessa pessoa real

- "foto com aspecto realista" — reforçou ainda mais que se trata de uma manipulação simulada de uma pessoa real

A lógica do Google: Manter rosto real + mudar corpo/roupa/pose = pode ser usado para criar Deepfake → dispara PROHIBITED_CONTENT.

Essa lógica é razoável para prevenir Deepfakes, mas é um dano colateral para necessidades comerciais legítimas, como a troca de roupas no e-commerce. Ironicamente, o próprio serviço de Shopping do Google usa o Nano Banana para provadores virtuais — mas ele utiliza canais de API internos, não sujeitos ao filtro de segurança das APIs públicas.

🎯 Insight chave: Seu comando em si não é "conteúdo ilegal", mas a forma como o comando é redigido disparou o modo de proteção contra Deepfake. Mudar a forma de redigir resolve o problema.

Ao invocar via APIYI (apiyi.com), a plataforma possui configurações otimizadas para cenários de troca de roupas no e-commerce, e falhas não geram cobrança.

Estratégias de reescrita de comandos

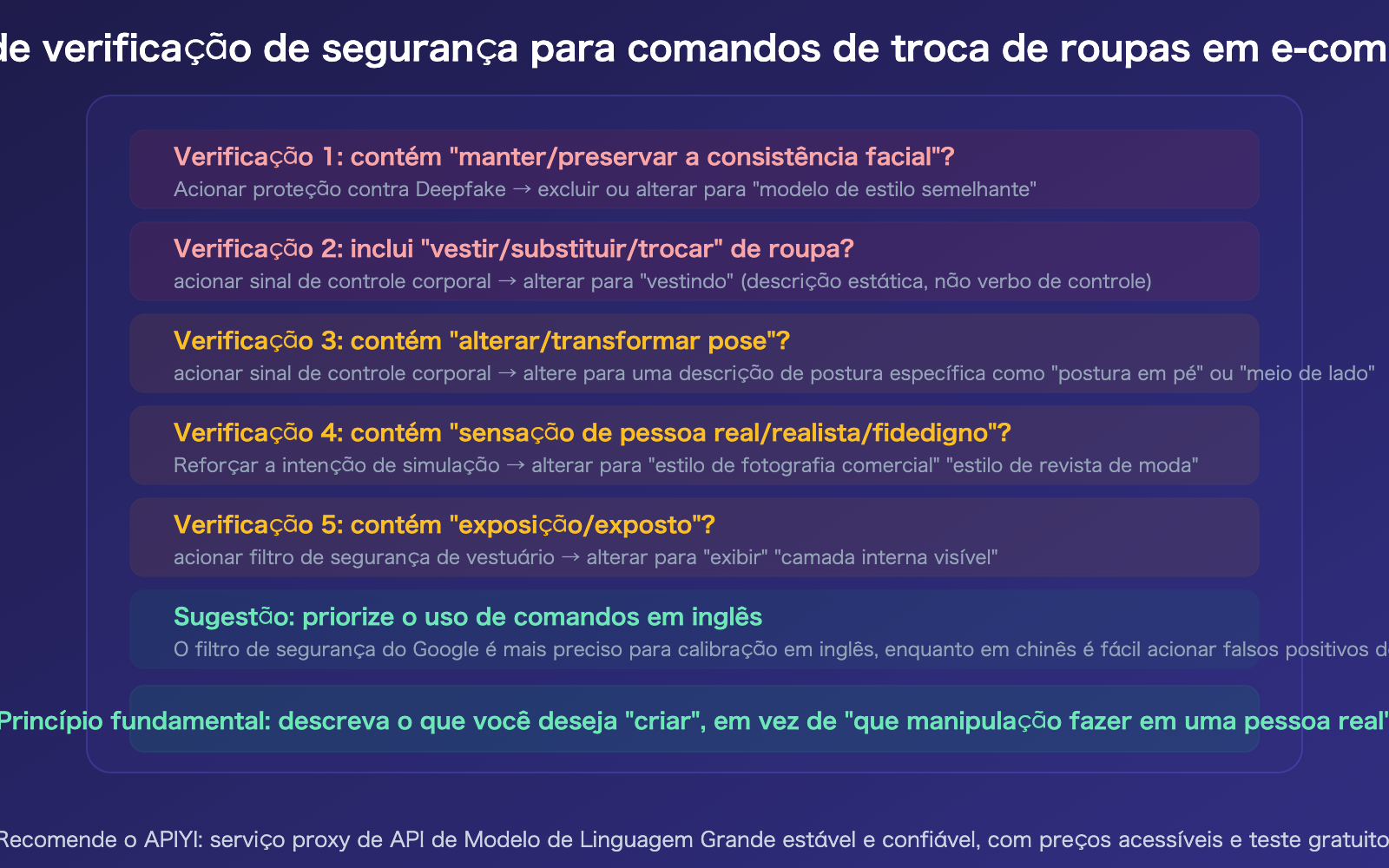

Princípios fundamentais de reescrita

Mude de "controlar uma pessoa real" para "criar um novo personagem" — não faça o modelo pensar que você está modificando uma pessoa real, mas sim criando uma imagem de exibição de moda totalmente nova.

| Princípio de reescrita | Expressão original (bloqueada) | Expressão reescrita (aprovada) |

|---|---|---|

| Personagem | "Manter o rosto" | "Gerar modelo com estilo similar" ou não mencionar o rosto |

| Troca de roupa | "Trocar para a roupa da imagem de referência" | "Vestindo a roupa exibida na imagem de referência" |

| Pose | "Mudar a pose" | "Pose de pé estilo revista de moda" |

| Intenção | "Foto com aspecto de pessoa real" | "Estilo de fotografia de moda comercial" |

| Corpo | "Manter proporções corporais" | "Tipo físico de modelo de moda padrão" |

Estratégia de reescrita A: Evitar completamente a semântica de "controle" (recomendado)

Generate a professional fashion photography image:

A female model wearing the outfit shown in the reference image

(oversized coat open over a layered top).

Standing pose, mid-shot framing, model fills 2/3 of the frame.

Carrying a small handbag. Natural and expressive pose with

scene interaction. Urban outdoor background.

Commercial fashion photography style, high quality.

Por que usar inglês: O filtro de segurança do Google é mais preciso com comandos em inglês, resultando em menos falsos positivos.

Estratégia de reescrita B: Manter o português, mas reconstruir a semântica

Obra de fotografia de moda profissional:

Uma modelo de moda, vestindo o conjunto de roupas exibido na imagem de referência

(casaco oversized com sobreposição por baixo),

casaco naturalmente aberto para exibir detalhes da sobreposição.

Fundo de cena urbana, luz natural.

Enquadramento de plano médio, personagem ocupando dois terços da tela,

pose de pé natural e elegante, acompanhada de uma pequena bolsa de mão.

Estilo de fotografia de revista de moda comercial, alta qualidade.

Mudanças principais:

- Removido "manter o rosto" — não sugere mais o controle de uma pessoa real.

- "Trocar para" alterado para "vestindo" — transforma uma ação de controle em uma descrição estática.

- "Mudar a pose" alterado para "pose de pé natural e elegante" — torna-se específico, evitando o verbo "mudar".

- "Aspecto de pessoa real" alterado para "estilo de fotografia de revista de moda comercial" — muda a intenção de simulação para uma descrição de estilo.

- "Manter proporções corporais" removido — não menciona mais o controle corporal.

Estratégia de reescrita C: Estratégia de execução passo a passo

Se você realmente precisa manter certas características da modelo (como tom de pele, penteado), pode usar uma estratégia em etapas:

Passo 1: Gere primeiro uma imagem apenas com a roupa, sem a pessoa de referência.

Fashion lookbook image: [descrição da roupa], vestida por uma modelo,

cabelo [tom de pele/penteado], plano médio, estilo de fotografia de moda.

Passo 2: Ajuste os detalhes com base no primeiro passo usando conversas de várias rodadas.

Adjust the background to urban street scene,

add a small handbag accessory.

A execução em etapas evita agrupar todas as operações "sensíveis" de uma vez, o que acionaria o filtro.

🎯 Dica prática: A estratégia A (comandos em inglês) tem a maior taxa de sucesso. Se precisar usar português, a estratégia B também tem uma taxa de aprovação significativamente superior aos comandos originais.

Ao realizar a invocação do modelo via APIYI (apiiyi.com), falhas não geram cobrança, então você pode testar várias estratégias de comando com tranquilidade para encontrar a solução ideal.

Comparação antes e depois da reescrita

| Dimensão | Comando original | Após reescrita (Estratégia B) |

|---|---|---|

| Descrição do personagem | "Manter proporções corporais, manter rosto" | "Uma modelo de moda" |

| Ação de troca de roupa | "Trocar para a sobreposição e casaco da imagem" | "Vestindo o conjunto de roupas exibido na imagem" |

| Controle corporal | "Mudar pose aleatoriamente" | "Pose de pé natural e elegante" |

| Intenção de realismo | "Foto com aspecto de pessoa real" | "Estilo de fotografia de revista de moda comercial" |

| Contagem de termos sensíveis | 5+ combinações de alto/médio risco | 0 |

| Resultado esperado | PROHIBITED_CONTENT | Geração bem-sucedida |

Perguntas Frequentes

Q1: A prova virtual do Google Shopping também usa o Nano Banana, por que ele não é bloqueado?

A função de prova virtual do Google Shopping utiliza um canal de API interno, que não está sujeito às restrições de segurança das APIs públicas. O Google utiliza um pipeline de prova específico em seus próprios produtos (g.co/shop/tryon), que possui um processo de auditoria de segurança independente. A filtragem de segurança das APIs públicas é mais rigorosa porque o Google não pode controlar como terceiros utilizam os resultados gerados. Essa é uma assimetria na estratégia da plataforma: a mesma tecnologia pode ser usada pelo Google, mas é bloqueada para desenvolvedores.

Q2: O erro PROHIBITED_CONTENT gera cobrança?

Assim como no IMAGE_SAFETY, o candidatesTokenCount: 0 indica que os tokens de saída não são cobrados. O Google afirma que imagens bloqueadas não geram custos. No entanto, os tokens de entrada (1150) e os tokens de pensamento (221) podem gerar uma taxa mínima (cerca de $0,0003, que pode ser ignorada). Ao realizar a invocação do modelo via APIYI apiyi.com, falhas não geram cobrança — incluindo casos de bloqueio por PROHIBITED_CONTENT.

Q3: O que fazer se ainda for bloqueado após reescrever o comando?

Siga estes três passos: 1) Mude para comandos em inglês (Opção A), pois a calibração da filtragem de segurança em inglês é mais precisa; 2) Não envie a imagem de referência do modelo, envie apenas a imagem da peça de roupa — remover a "referência de pessoa real" pode reduzir drasticamente a pontuação de risco de Deepfake; 3) Realize a invocação via APIYI apiyi.com, já que as configurações de parâmetros de segurança da plataforma são otimizadas para cenários de e-commerce. Se as soluções acima falharem, considere usar ferramentas de prova virtual especializadas (como SellerPic ou TapNow) em vez de APIs de geração de imagens genéricas.

Q4: Enviar várias imagens de referência (modelo + roupa) aumenta o risco de bloqueio?

Sim. No seu erro, o token IMAGE: 1032 indica que foram enviadas imagens de referência contendo muitas informações. Se a imagem de referência contiver o rosto de uma pessoa real, o filtro de segurança a identificará como "esta é uma pessoa real", reforçando o sinal de Deepfake. Sugestão: 1) Envie apenas a imagem da peça de roupa (sem rostos); 2) Se precisar referenciar o estilo do modelo, envie a imagem do modelo com o rosto cortado.

Resumo

Pontos principais sobre o erro PROHIBITED_CONTENT no Nano Banana Pro:

- Mais grave que o IMAGE_SAFETY: O PROHIBITED_CONTENT é um bloqueio rígido de nível de política; o Google identifica a combinação de "manter rosto + trocar roupa + mudar pose" como uma manipulação de Deepfake.

- O problema está na forma de expressão, não no conteúdo: A troca de roupa para e-commerce é uma necessidade legítima, mas a combinação de termos como "manter rosto", "vestir", "mudar pose" e "sensação de pessoa real" aciona o mecanismo de proteção.

- Princípio fundamental de reescrita: Mude o foco de "manipular uma pessoa real" para "criar uma nova imagem de exibição de moda" — use "vestindo" em vez de "trocar para", use "estilo de fotografia de moda" em vez de "sensação de pessoa real" e remova a menção a "manter rosto". Comandos em inglês costumam ter uma taxa de sucesso maior.

Recomendamos realizar a invocação do Nano Banana Pro via APIYI apiyi.com — falhas não geram cobrança, permitindo que você teste várias opções de comandos com tranquilidade, além de contar com a otimização de parâmetros de segurança da plataforma para cenários de e-commerce.

📚 Referências

-

Documentação das Configurações de Segurança da API Gemini: Explicação oficial dos parâmetros de filtro de segurança

- Link:

ai.google.dev/gemini-api/docs/safety-settings - Descrição: Contém o significado dos valores de finishReason e as categorias de segurança

- Link:

-

Geração de Imagens com Gemini e IA Responsável: Documentação de filtros de segurança do Vertex AI

- Link:

docs.cloud.google.com/vertex-ai/generative-ai/docs/multimodal/gemini-image-responsible-ai - Descrição: Contém as condições de disparo para PROHIBITED_CONTENT e IMAGE_SAFETY

- Link:

-

Guia de Correção de IMAGE_SAFETY do Nano Banana Pro: 8 métodos para aumentar a taxa de sucesso

- Link:

help.apiyi.com/en/nano-banana-pro-image-safety-error-fix-guide-en.html - Descrição: Contém modelos de otimização de comando e soluções baseadas em cenários

- Link:

-

Central de Documentação APIYI: Otimização de parâmetros de segurança para cenários de troca de roupas no e-commerce

- Link:

docs.apiyi.com - Descrição: Sem cobrança em caso de falha + configurações otimizadas para cenários de e-commerce

- Link:

Autor: Equipe Técnica APIYI

Troca de conhecimento: Sinta-se à vontade para discutir na seção de comentários. Para mais materiais, acesse a central de documentação da APIYI em docs.apiyi.com