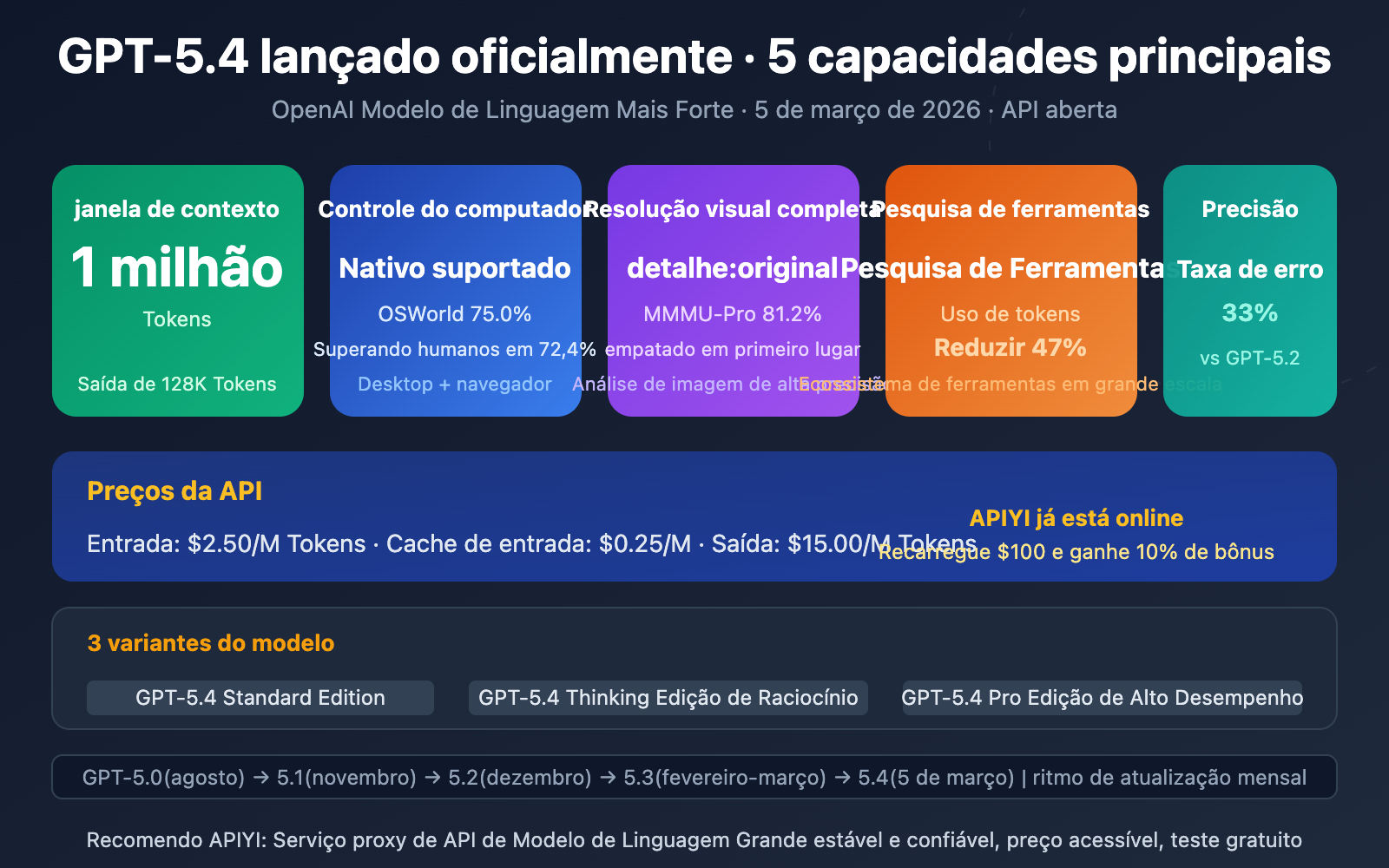

Nota do autor: O GPT-5.4 foi lançado oficialmente e está aberto para invocação via API, suportando contexto de 1 milhão de tokens, controle nativo de computador e visão em resolução total. A APIYI já está sincronizada e disponível, basta se registrar para começar a usar.

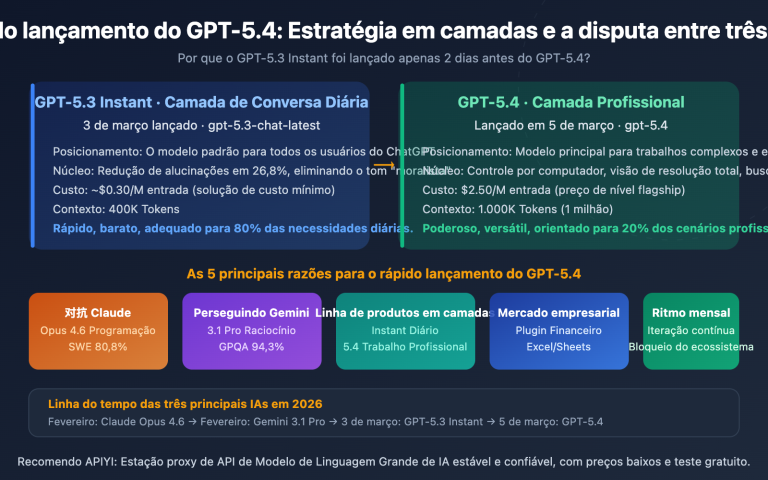

O GPT-5.4 foi lançado oficialmente em 5 de março de 2026, sendo o modelo de propósito geral mais poderoso da OpenAI até hoje. É a primeira vez que contexto de 1 milhão de tokens, controle nativo de computador e visão em resolução total são combinados em um único modelo. A pontuação no benchmark GDPval saltou de 70.9% do GPT-5.2 para 83.0%, e o teste de controle de computador OSWorld até superou o desempenho humano.

Valor principal: Ao ler este artigo, você entenderá as 5 principais capacidades do GPT-5.4, seu desempenho em benchmarks, métodos de acesso via API e detalhes de preços, e aprenderá como invocá-lo imediatamente através da plataforma APIYI.

Pontos Principais da API GPT-5.4

| Ponto | Especificação | Valor para Desenvolvedores |

|---|---|---|

| Contexto de 1 milhão de Tokens | Entrada 1.050K, Saída 128K | Um romance inteiro ou um repositório de código completo em uma única entrada |

| Controle Nativo de Computador | Captura de tela + operações de teclado/mouse, OSWorld 75.0% | Automação de fluxos de trabalho entre aplicativos |

| Visão em Resolução Total | Parâmetro detail: original |

Cenários de alta precisão como plantas arquitetônicas, imagens médicas |

| Busca de Ferramentas | Uso de tokens reduzido em 47% | Redução drástica de custos em ecossistemas de ferramentas em larga escala |

| Melhoria na Precisão | Taxa de erro de declarações individuais reduzida em 33% | Mais confiável em áreas de alto risco como finanças e direito |

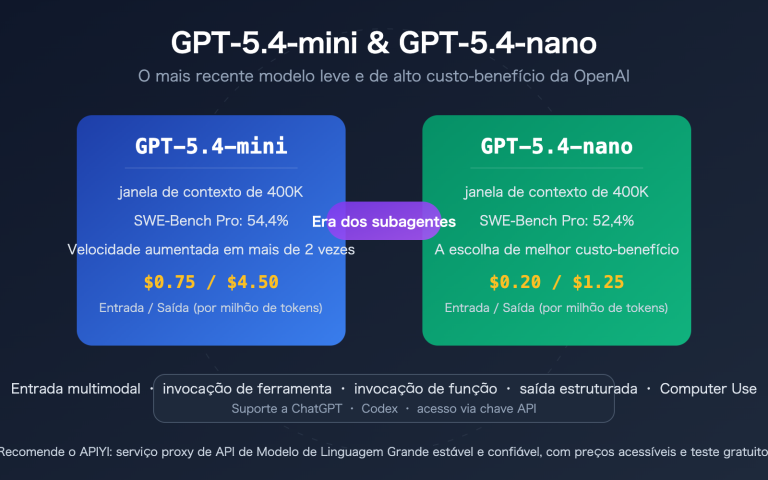

Três Variantes do Modelo GPT-5.4 API

O GPT-5.4 é o primeiro a oferecer simultaneamente três variantes para diferentes necessidades:

GPT-5.4 Padrão (gpt-5.4): O modelo principal de propósito geral, suporta contexto de 1 milhão de tokens, controle nativo de computador e processamento de visão em resolução total. Ideal para cenários profissionais que exigem equilíbrio entre capacidade e custo.

GPT-5.4 Thinking (gpt-5.4-thinking): Versão aprimorada para raciocínio, suporta cinco níveis de raciocínio: none/low/medium/high/xhigh. Disponível para todos os usuários pagantes no ChatGPT, é adequado para análises complexas, modelagem financeira e pesquisas profundas.

GPT-5.4 Pro (gpt-5.4-pro): Versão de desempenho máximo, voltada para tarefas corporativas que exigem precisão extrema. Disponível nos planos ChatGPT Pro (US$ 200/mês) e Enterprise.

🎯 Recomendação de Acesso: A APIYI (apiyi.com) já disponibilizou toda a linha de modelos GPT-5.4, com preços sincronizados com o site oficial da OpenAI. Basta se registrar para começar a usar, com recargas a partir de US$ 100 ganhando 10% de bônus. É um caminho conveniente para desenvolvedores nacionais acessarem rapidamente a API GPT-5.4.

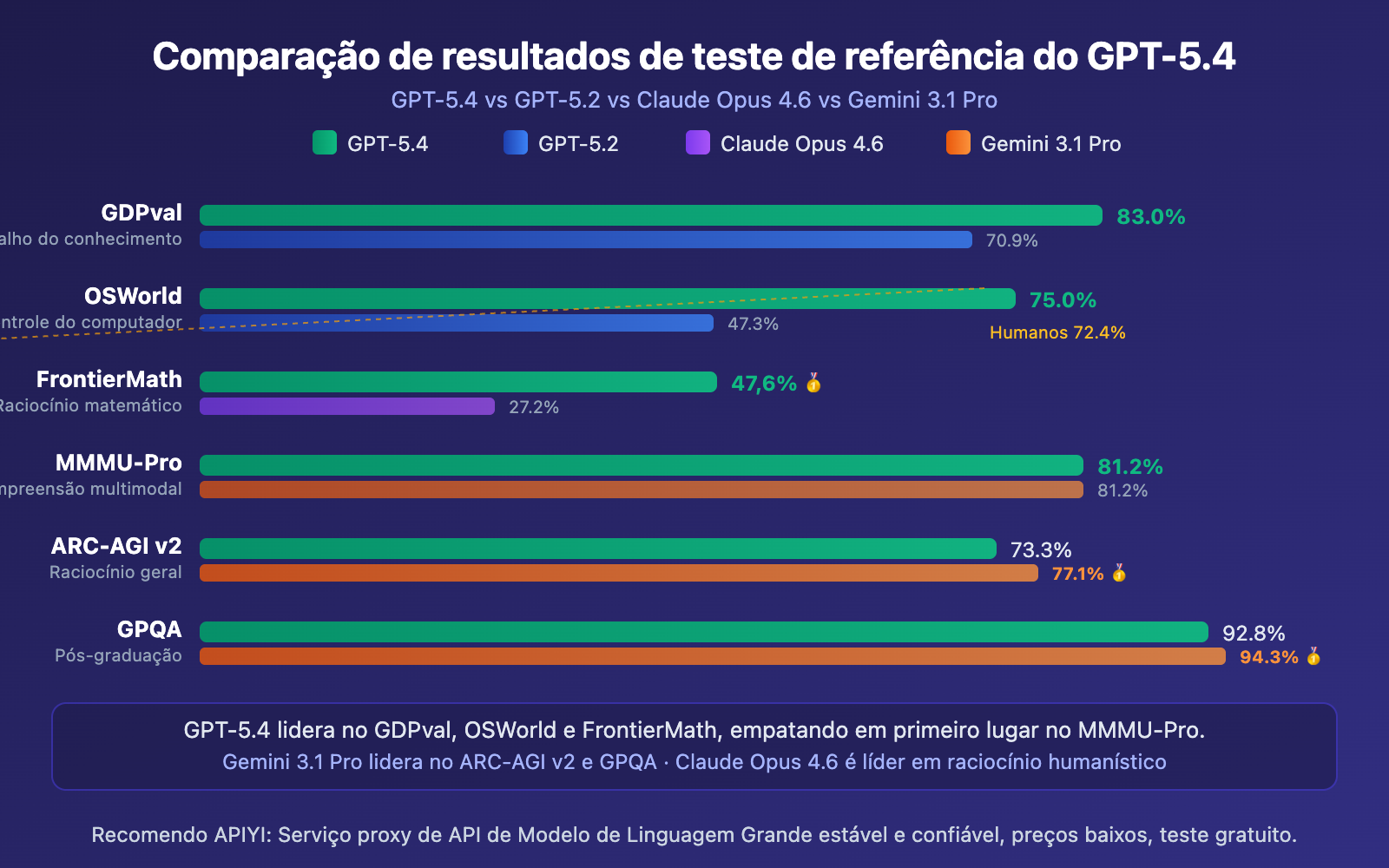

Dados de Teste de Benchmark da API GPT-5.4

Dados Detalhados do Benchmark da API GPT-5.4

| Benchmark | GPT-5.4 | GPT-5.2 | Claude Opus 4.6 | Gemini 3.1 Pro |

|---|---|---|---|---|

| GDPval (Trabalho de Conhecimento) | 83.0% 🥇 | 70.9% | — | — |

| OSWorld (Controle de Computador) | 75.0% 🥇 | 47.3% | — | — |

| FrontierMath (Matemática) | 47.6% 🥇 | — | 27.2% | — |

| MMMU-Pro (Multimodal) | 81.2% 🥇 | — | — | 81.2% |

| ARC-AGI v2 (Raciocínio Geral) | 73.3% | — | — | 77.1% 🥇 |

| GPQA (Nível de Pós-Graduação) | 92.8% | — | — | 94.3% 🥇 |

| BrowseComp (Navegação Web) | 82.7% | — | — | 85.9% 🥇 |

Algumas descobertas-chave:

O GPT-5.4 está muito à frente em capacidade de trabalho profissional (GDPval), com 83% das comparações correspondendo ou superando especialistas do setor. Isso significa que em cenários reais de trabalho, como análise financeira, processamento de planilhas e criação de PPTs, ele já está muito próximo ou até supera o nível de um profissional.

O controle de computador (OSWorld 75.0%) é o avanço mais impressionante – superando diretamente o desempenho humano de 72.4%. Isso significa que o GPT-5.4 pode reconhecer o conteúdo da tela através de capturas de tela e usar operações de teclado e mouse para completar fluxos de trabalho complexos entre aplicativos.

🎯 Recomendação Prática: Os benchmarks são apenas uma referência; o efeito real varia de acordo com o cenário. Recomendamos obter créditos de teste gratuitos através do APIYI em apiyi.com e comparar o desempenho real do GPT-5.4 com outros modelos em seus cenários reais.

Preços e Métodos de Acesso à API GPT-5.4

Preços Oficiais da API GPT-5.4

| Item de Preço | Preço (USD / Milhão de Tokens) | Observação |

|---|---|---|

| Entrada Padrão | $2.50 | Entrada ≤272K Tokens |

| Entrada em Cache | $0.25 | 90% de desconto, economia significativa em conteúdo repetido |

| Saída Padrão | $15.00 | Saída máxima de 128K Tokens |

| Entrada Longa (>272K) | $5.00 | Parte excedente a 272K Tokens cobrada em dobro |

| Saída Longa (>272K) | $22.50 | Saída cobrada em 1.5x quando entrada >272K |

A plataforma APIYI já está sincronizada e disponível, com preços idênticos ao site oficial da OpenAI: entrada $2.50/M, saída $15.00/M. Recarregue a partir de 100 USD e ganhe 10% de bônus. Registre-se para acessar toda a linha de modelos GPT-5.4.

Exemplo Mínimo de Integração com a API GPT-5.4

Aqui está a forma mais simples de fazer a chamada, funcionando com apenas 10 linhas de código:

import openai

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{"role": "user", "content": "Analise os indicadores-chave deste relatório financeiro trimestral"}]

)

print(response.choices[0].message.content)

Ver código de implementação completo (inclui controle de computador e visão em resolução total)

import openai

import base64

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

# Análise de imagem em resolução total

def analyze_image(image_path: str, prompt: str) -> str:

with open(image_path, "rb") as f:

image_data = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": prompt},

{"type": "image_url", "image_url": {

"url": f"data:image/png;base64,{image_data}",

"detail": "original"

}}

]

}]

)

return response.choices[0].message.content

# Análise profunda com nível de raciocínio

def deep_analysis(prompt: str, effort: str = "high") -> str:

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{"role": "user", "content": prompt}],

reasoning={"effort": effort} # none/low/medium/high/xhigh

)

return response.choices[0].message.content

result = analyze_image("relatorio_financeiro.png", "Analise os dados anômalos nesta demonstração financeira")

print(result)

Sugestão: Registre-se na APIYI apiyi.com para obter sua chave API. Recarregue a partir de 100 USD e aproveite um bônus de 10%. A plataforma suporta toda a linha GPT-5.4 e outros modelos principais através de uma interface unificada, facilitando comparações rápidas e trocas.

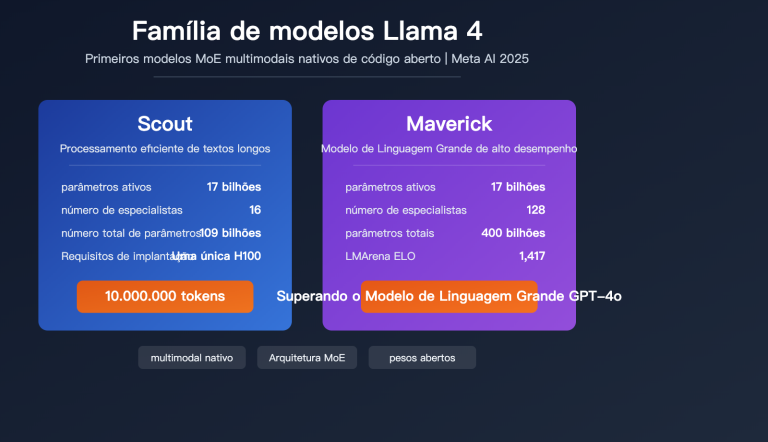

Comparação do GPT-5.4 com Modelos Concorrentes

Recomendações de Seleção de Modelo GPT-5.4 por Cenário

| Cenário de Uso | Modelo Recomendado | Motivo | Plataformas Disponíveis |

|---|---|---|---|

| Conversas e Redação Diárias | GPT-5.3 Instant | Custo mais baixo (~$0.30/M entrada) | APIYI e outras plataformas |

| Análise Complexa e Pesquisa | GPT-5.4 Thinking | GDPval 83.0%, raciocínio xhigh | APIYI e outras plataformas |

| Fluxos de Trabalho Automatizados | GPT-5.4 Padrão | Controle nativo de computador 75.0% | APIYI e outras plataformas |

| Refatoração de Grandes Bases de Código | GPT-5.3 Codex | Otimizado para programação, 1M de contexto | APIYI e outras plataformas |

| Assistência de Programação em Tempo Real | GPT-5.3 Codex Spark | Resposta ultrarrápida >1000 tokens/s | APIYI e outras plataformas |

| Necessidade de Precisão Máxima | GPT-5.4 Pro | Desempenho máximo de nível empresarial | APIYI e outras plataformas |

Sugestão de Seleção: Não tem certeza de qual modelo escolher? Recomenda-se começar com o GPT-5.3 Instant para necessidades diárias (custo mais baixo) e mudar para o GPT-5.4 em tarefas complexas. Todos os modelos podem ser acessados via APIYI apiyi.com através de uma interface unificada, sem necessidade de trocar de plataforma.

Perguntas Frequentes

Q1: Os 1 milhão de Tokens de contexto do GPT-5.4 estão disponíveis para todas as requisições?

Não. Para requisições com entrada superior a 272K Tokens, o preço de entrada dobra (US$ 5,00/M) e o preço de saída aumenta 50% (US$ 22,50/M). Para a maioria dos cenários, é recomendável controlar adequadamente o comprimento da entrada. Se você realmente precisa de um contexto muito longo, é sugerido usar a entrada em cache (US$ 0,25/M) para reduzir custos.

Q2: Como escolher entre GPT-5.4 e GPT-5.2?

Se você precisa de capacidade de controle do computador ou processamento visual em resolução total, escolha o GPT-5.4. Se sua tarefa é principalmente raciocínio textual e você é sensível ao custo, o GPT-5.2 (US$ 1,75/M entrada) continua sendo a opção mais econômica. Recomendamos testar e comparar os dois modelos em cenários reais através do APIYI apiyi.com, pois a plataforma suporta alternância com um clique.

Q3: Como integrar rapidamente o GPT-5.4 via APIYI?

A integração pode ser feita em 3 etapas:

- Acesse APIYI apiyi.com, registre uma conta e obtenha uma Chave API

- Recarregue um mínimo de US$ 100 e receba um bônus de 10%

- Configure o

base_urlcomohttps://vip.apiyi.com/v1e omodelcomogpt-5.4, e você já pode fazer a invocação.

Resumo

Os pontos principais do lançamento oficial da API do GPT-5.4:

- 5 capacidades centrais em um único modelo: Contexto de 1 milhão de Tokens, controle nativo do computador (OSWorld 75,0%, superando humanos), visão em resolução total, busca com ferramentas (redução de 47% nos Tokens) e aumento de 33% na precisão.

- Precificação justa, grandes descontos em cache: Entrada US$ 2,50/M, saída US$ 15,00/M, entrada em cache por apenas US$ 0,25/M (90% de desconto).

- Três variantes cobrem todos os cenários: Versão Padrão para uso geral, versão Thinking para raciocínio profundo e versão Pro para desempenho máximo.

O GPT-5.4 é atualmente o modelo de uso geral mais poderoso da OpenAI, especialmente adequado para cenários que exigem controle do computador, processamento de documentos muito longos e análise visual de alta precisão.

Recomendamos a integração rápida do GPT-5.4 através do APIYI apiyi.com. A plataforma mantém os preços sincronizados com o site oficial, oferece 10% de bônus em recargas a partir de US$ 100, e permite a invocação de toda a série de modelos logo após o registro.

📚 Referências

-

Anúncio oficial do OpenAI GPT-5.4: Detalhes de lançamento e introdução aos recursos principais do GPT-5.4

- Link:

openai.com/index/introducing-gpt-5-4/ - Descrição: Explicação oficial para entender as novas funcionalidades como controle de computador e processamento visual do GPT-5.4

- Link:

-

Documentação da API OpenAI GPT-5.4: Detalhes sobre especificações do modelo, precificação e parâmetros da interface

- Link:

developers.openai.com/api/docs/models/gpt-5-4 - Descrição: Leitura obrigatória para desenvolvedores, contendo ID do modelo, limites de contexto, limites de taxa e outros detalhes técnicos

- Link:

-

Reportagem do TechCrunch sobre o GPT-5.4: Análise aprofundada das versões Pro e Thinking

- Link:

techcrunch.com/2026/03/05/openai-launches-gpt-5-4-with-pro-and-thinking-versions/ - Descrição: Entenda as diferenças e os cenários de aplicação das três variantes do GPT-5.4

- Link:

-

Benchmark LLM Stats GPT-5.4: Dados completos de benchmark e comparação com concorrentes

- Link:

llm-stats.com/models/gpt-5-4 - Descrição: Veja a classificação e as pontuações específicas do GPT-5.4 em vários testes de referência

- Link:

Autor: Equipe Técnica da APIYI

Discussões técnicas: Sinta-se à vontade para discutir na seção de comentários. Para mais materiais, visite o centro de documentação da APIYI em docs.apiyi.com