작성자 주: OpenAI가 gpt-image-2 기반의 Photobooth 데모 프로젝트를 공식 오픈소스로 공개했습니다. 이번 글에서는 소스 코드와 스트리밍 구현 원리를 심층 분석하고, APIYI API 중계 서비스를 통해 국내에서 별도의 복잡한 설정 없이 이 기능을 즉시 구현하는 방법을 설명해 드립니다.

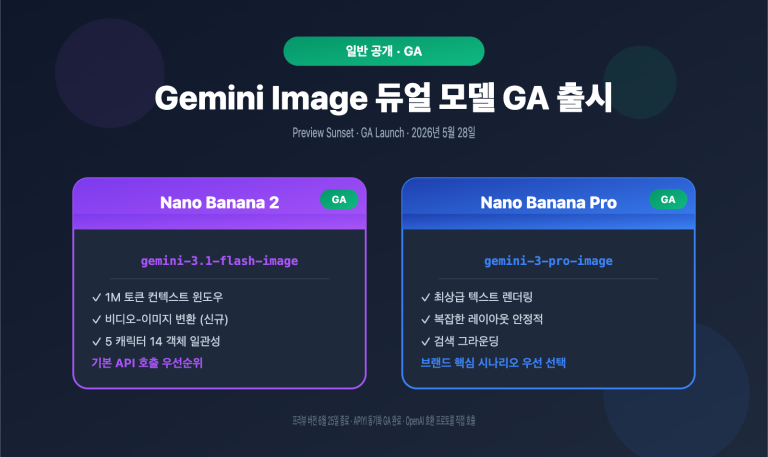

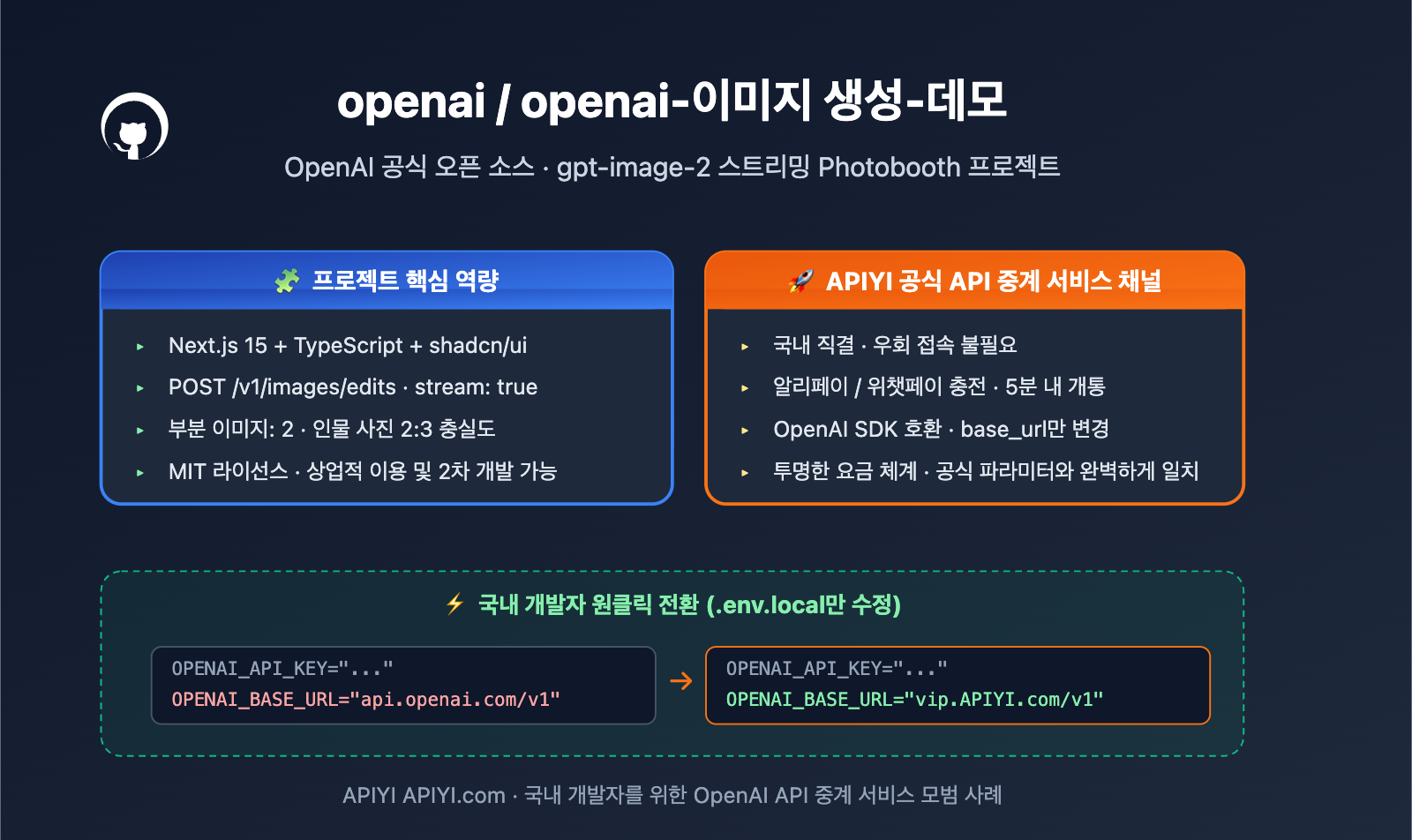

OpenAI는 GitHub에 openai-imagegen-demo 프로젝트를 공개했습니다. 이는 gpt-image-2 모델과 함께 출시된 Next.js 데모 애플리케이션으로, 스트리밍 이미지 생성, 인물 스타일 변환, 다중 스타일 동시 생성 등 최신 모델만의 독보적인 기능을 보여줍니다. 프로젝트 주소: github.com/openai/openai-imagegen-demo

단순한 "Hello World" 예제가 아닙니다. 소스 코드에는 OpenAI가 공식 권장하는 partial_images 점진적 스트리밍 출력 방식과, 다중 이미지 편집 시나리오에서 /v1/images/edits 엔드포인트를 활용하는 최신 기법이 담겨 있습니다.

핵심 가치: 이 글을 읽고 나면 공식 데모의 아키텍처와 핵심 파라미터, 구현 단계를 완벽히 이해하게 되며, 국내에서 APIYI API 중계 서비스를 통해 VPN 없이도 gpt-image-2 API를 즉시 활용하는 방법을 알게 되실 겁니다.

openai-imagegen-demo 핵심 요약

| 요점 | 설명 | 가치 |

|---|---|---|

| 프로젝트 포지션 | OpenAI 공식 오픈소스 Photobooth 데모, gpt-image-2 인물 스타일 변환 시연 | 가장 권위 있는 gpt-image-2 통합 레퍼런스 |

| 기술 스택 | Next.js 15 App Router + TypeScript + Tailwind + shadcn/ui | 현대적 웹 기술 스택, 프로덕션급 재사용 가능 |

| 핵심 엔드포인트 | POST /v1/images/edits, stream: true 및 partial_images 활용 |

공식 최초의 스트리밍 이미지 생성 데모 |

| 모델 | gpt-image-2, 품질 high, 사이즈 1024x1536 (2:3 인물 비율) |

인물 일관성 및 표정 복원 강조 |

| 라이선스 | MIT License, 자유로운 상업적 이용 및 2차 개발 가능 | 상업 프로젝트에 즉시 통합 가능 |

| 접속 방식 | 공식은 OpenAI API Key 필요; APIYI 중계 서비스(apiyi.com)로 국내 직결 가능 |

진입 장벽 완화, VPN 불필요 |

imagegen-demo 프로젝트 상세 분석

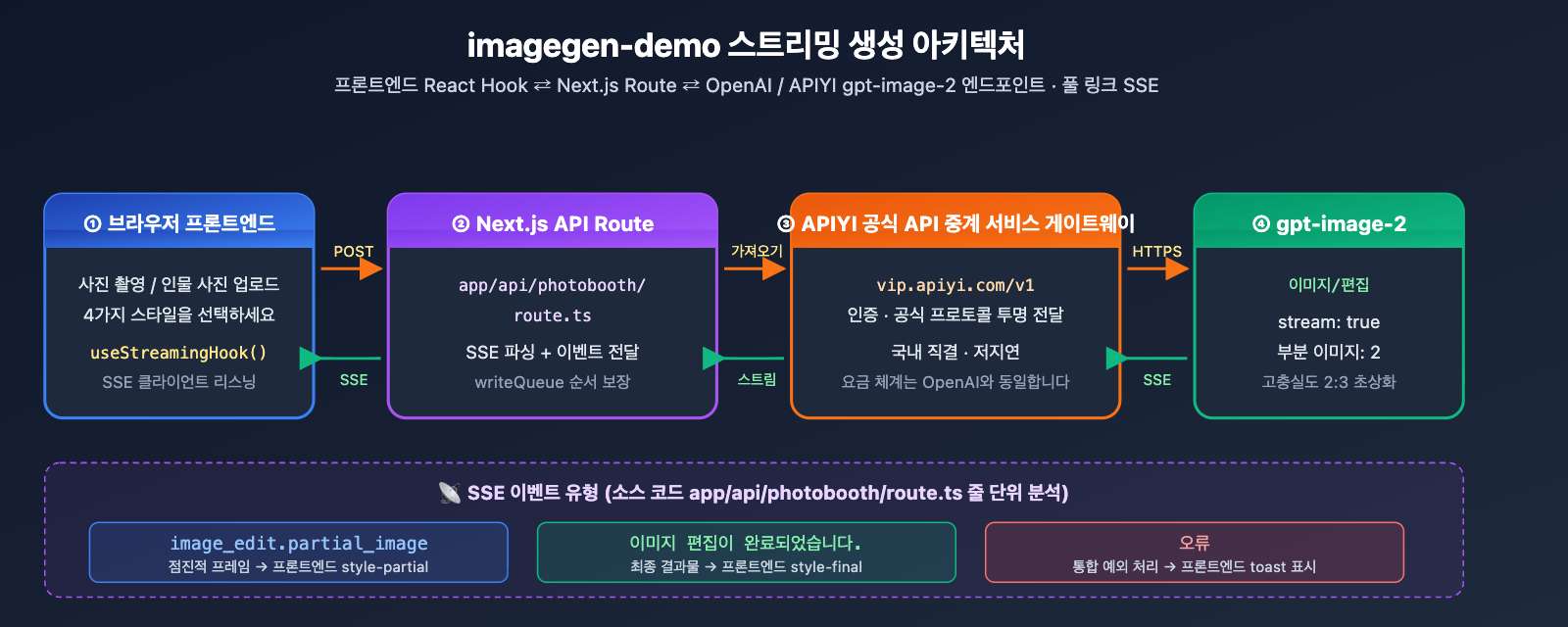

openai-imagegen-demo는 본질적으로 **인터랙티브 포토부스(Photobooth)**입니다. 사용자가 셀카를 업로드하거나 촬영한 뒤, 최대 4가지 사전 설정 스타일(니트 스타일, 디지털 아트, 유화 등)을 선택하면 애플리케이션이 gpt-image-2의 images/edits 엔드포인트를 병렬로 호출하여 스트리밍 방식으로 각 스타일의 결과물을 단계별로 반환합니다.

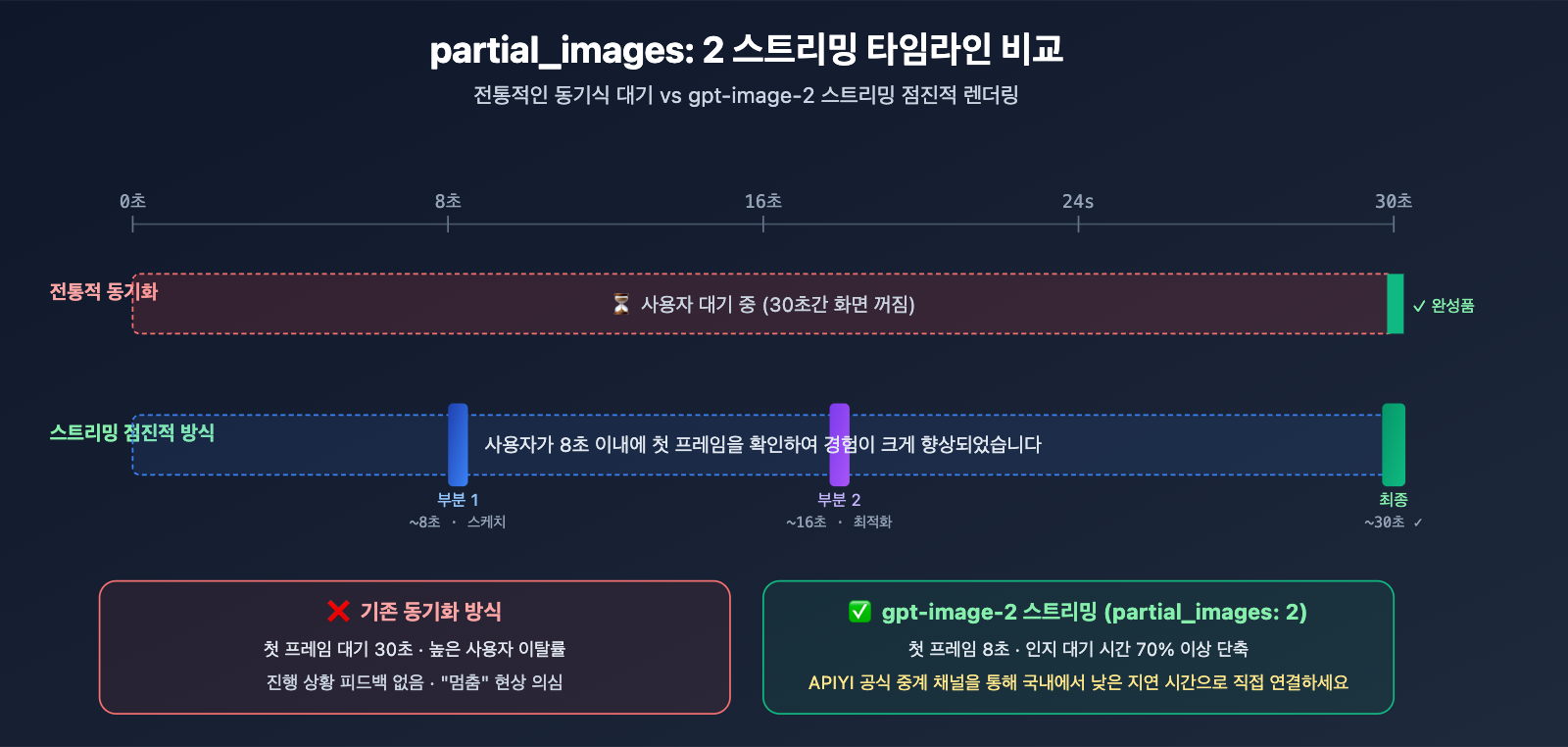

시중의 일반적인 "텍스트-이미지 변환 데모"와 달리, 이 공식 저장소는 두 가지 새로운 기능에 집중합니다: **이미지-이미지 변환(image editing)**과 **점진적 스트리밍 출력(partial_images)**입니다. 전자는 "인물 일관성 유지"라는 공학적 난제를 해결했고, 후자는 30초 동안의 검은 화면 대신 프레임 단위로 이미지가 서서히 나타나게 하여 사용자 경험을 극대화했습니다.

imagegen-demo 프로젝트 아키텍처 분석

핵심 소스 코드 분석

이 프로젝트의 핵심은 단 하나의 API Route인 app/api/photobooth/route.ts입니다. 이 파일은 프론트엔드에서 전달받은 인물 사진과 스타일 프롬프트를 패키징하여, OpenAI의 /v1/images/edits 엔드포인트로 스트리밍 방식의 요청을 보냅니다. 주요 요청 본문 구조는 다음과 같습니다.

const body = {

model: "gpt-image-2",

prompt: `${style.prompt}\n\n${OPENAI_IMAGE_OUTPUT_REQUIREMENTS}`,

images: [{ image_url: imageDataUrl }],

size: "1024x1536",

quality: "high",

output_format: "png",

stream: true,

partial_images: 2,

};

다음 세 가지 디테일에 주목해 보세요:

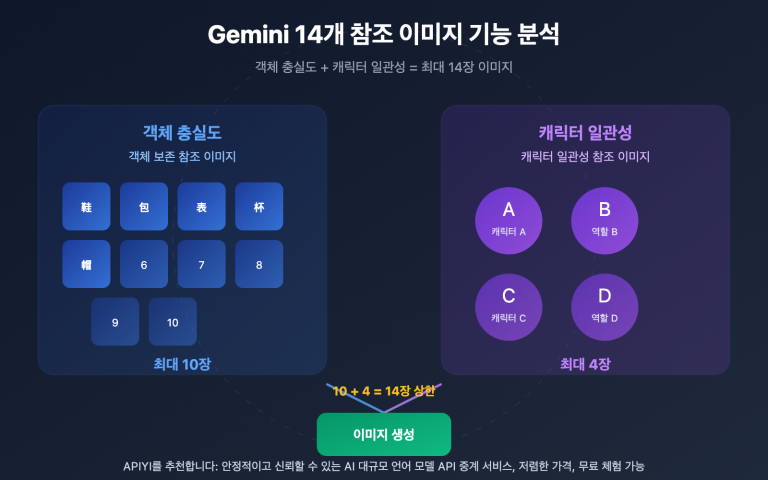

stream: true+partial_images: 2: gpt-image-2만의 고유한 스트리밍 기능으로, 서버가 최종 이미지를 전달하기 전에 중간 프레임을 2번 푸시합니다.images매개변수: 한 장 또는 여러 장의 참조 이미지를 data URL 형태로 받아 다중 이미지 융합 편집을 지원합니다.OPENAI_IMAGE_OUTPUT_REQUIREMENTS: "인물 2:3 비율, 인물의 자세와 표정 유지"를 강제하는 설정으로, 이미지 편집 프롬프트를 잘 작성하기 위한 황금률입니다.

스트리밍 이벤트 해석

Route는 SSE(Server-Sent Events)를 통해 공식 응답을 리스닝하며, 다음 세 가지 이벤트를 처리합니다.

image_edit.partial_image: 중간 프레임, 프론트엔드로style-partial푸시image_edit.completed: 최종 결과물, 프론트엔드로style-final푸시error: 예외 발생 시 프론트엔드에서 통합 처리

프론트엔드의 React 측에서는 커스텀 훅을 사용하여 writeQueue Promise 체인을 유지함으로써, 여러 스타일이 동시에 처리될 때 이벤트 순서가 꼬이지 않도록 합니다. 이 부분이 본 데모에서 가장 공학적으로 참고할 만한 가치가 있는 부분입니다.

imagegen-demo 빠르게 시작하기

초간단 실행 단계

공식 README에 따라 다음 5줄의 명령어만 입력하면 바로 실행할 수 있습니다.

git clone https://github.com/openai/openai-imagegen-demo

cd openai-imagegen-demo

cp .env.example .env.local

echo "OPENAI_API_KEY=sk-xxxxx" >> .env.local

npm install && npm run dev

APIYI 공식 중계 서비스를 통한 .env.local 설정 확인하기

# 옵션 1: OpenAI 공식 API 사용 (해외 네트워크 + API 할당량 필요)

OPENAI_API_KEY="sk-proj-xxxxx"

# 옵션 2: APIYI 공식 중계 서비스 사용 (국내 직결, 우회 접속 불필요)

OPENAI_API_KEY="your-apiyi-key"

OPENAI_BASE_URL="https://vip.apiyi.com/v1"

# 선택 사항: 조직 및 프로젝트 ID

OPENAI_ORG_ID=""

OPENAI_PROJECT_ID=""

그런 다음 app/api/photobooth/route.ts에 하드코딩된 endpointBase를 process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1"로 읽어오도록 수정하면, 공식 API와 중계 서비스 간의 전환이 매끄럽게 이루어집니다.

const endpointBase = process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1";

const response = await fetch(`${endpointBase}/images/edits`, {

method: "POST",

headers: {

"Authorization": `Bearer ${apiKey}`,

"Content-Type": "application/json",

},

body: JSON.stringify(body),

});

연동 팁: 국내 개발자가 OpenAI 공식 데모를 직접 실행할 경우 네트워크, API 할당량, 결제 방식 등 세 가지 장벽에 부딪힐 수 있습니다. APIYI(apiyi.com)의 공식 중계 서비스를 통해 호환 가능한 키를 발급받고,

OPENAI_BASE_URL을https://vip.apiyi.com/v1로 설정하면 로컬에서 바로 실행할 수 있습니다. 스트리밍 이벤트와 매개변수 모두 공식 사양과 완벽하게 호환됩니다.

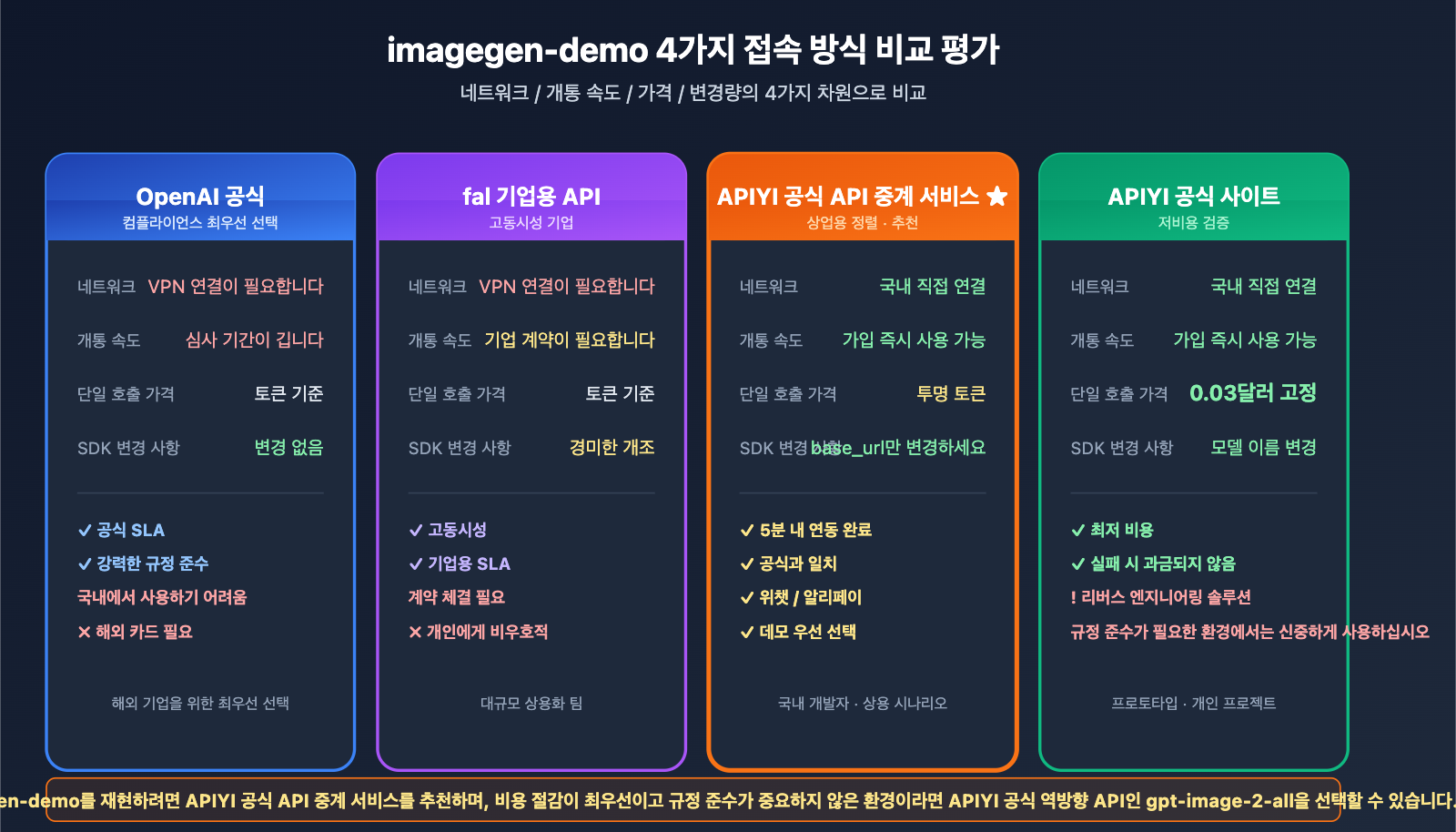

imagegen-demo 접속 방식 비교

| 접속 방식 | 네트워크 요구사항 | 개통 속도 | 1회 가격 | SDK 수정량 |

|---|---|---|---|---|

| OpenAI 공식 직결 | 해외 네트워크 필요 | 카드 등록 + 심사 대기 | 토큰당 과금 (약 $0.15+/장) | 수정 없음 |

| fal 기업용 API | 해외 접속 | 기업 계약 필요 | 토큰당 과금 | 경미한 수정 |

| APIYI 공식 중계 | 국내 직결 | 즉시 사용 | 토큰당 투명 과금 | base_url만 수정 |

| APIYI 공식 역방향 | 국내 직결 | 즉시 사용 | 고정 $0.03 / 장 | 모델명만 수정 |

방식 해설

OpenAI 공식 직결 분석: 공식 채널은 규정 준수와 SLA 측면에서 압도적인 우위를 점하며, imagegen-demo의 기본 타겟 환경입니다. 하지만 국내에서 실행하려면 우회 접속이 필요하고, 해외 신용카드 등록 및 API 한도 심사 기간이 길다는 단점이 있습니다. 반면, APIYI 공식 중계 채널은 네트워크 접근성과 개통 속도 면에서 검증 단계나 국내 운영 환경에 훨씬 적합합니다.

fal 기업용 API 분석: fal은 2026년 4월 21일 gpt-image-2 기업용 엔드포인트를 출시하며 높은 동시 접속 SLA 성능을 보여주었습니다. 하지만 기업 고객 대상이라 개인 개발자가 접근하기엔 문턱이 높습니다. 로컬에서 imagegen-demo를 빠르게 실행하려는 개발자에게는 APIYI가 훨씬 가볍고 효율적입니다.

APIYI 공식 중계 vs 역방향 차이: 공식 중계는 APIYI가 사용자의 요청을 OpenAI 공식 API로 그대로 전달하는 방식으로, 과금 체계, SLA, 기능이 공식과 완전히 동일하여 상업적 용도에 적합합니다. 공식 역방향은 ChatGPT 웹 버전을 역방향으로 구현한 것으로, 장당 $0.03으로 가격이 고정되어 있어 프로토타입 검증에 유리합니다. 두 채널 모두 APIYI 플랫폼에서 동시에 제공되므로 개발자가 필요에 따라 전환하여 사용할 수 있습니다.

비교 설명: 위 데이터는 OpenAI 공식 가격 정책, fal 기업용 발표 자료 및

docs.apiyi.com기술 문서를 종합한 것이며, APIYI(apiyi.com)를 통해 직접 테스트 및 검증하실 수 있습니다.

gpt-image-2 핵심 파라미터 상세 분석 (imagegen-demo 소스 코드 기준)

imagegen-demo의 lib/constants.ts를 기반으로, 공식 권장 gpt-image-2 기본 파라미터 조합을 정리했습니다.

| 파라미터 | 데모 기본값 | 설명 | 조정 제안 |

|---|---|---|---|

| model | gpt-image-2 |

최신 이미지 모델 | 변경하지 않음 |

| size | 1024x1536 |

2:3 세로 비율 | 소셜 미디어 가로형은 1536x1024로 변경 |

| quality | high |

최고 화질 | 비용 절감 시 medium/low 사용 |

| output_format | png |

투명 배경 지원 | 웹 환경은 webp로 용량 절감 |

| stream | true |

SSE 스트리밍 활성화 | 실시간 앱 필수 |

| partial_images | 2 |

중간 프레임 2회 전송 | 최대 3회, 대기 시간과 대역폭 고려 |

프롬프트 엔지니어링 베스트 프랙티스

데모의 OPENAI_IMAGE_OUTPUT_REQUIREMENTS 상수는 매우 참고할 만한 프롬프트 템플릿입니다.

"portrait orientation (2:3 aspect ratio), preserve the exact people, poses, facial expressions, and scene composition as faithfully as possible"

이 문구는 gpt-image-2 이미지 편집의 황금 법칙을 보여줍니다.

- 비율 명시:

size파라미터를 설정했더라도 프롬프트 내에 비율을 다시 언급하여 정확도를 높입니다. - 충실도 강조:

preserve the exact ...는 인물 일관성을 유지하기 위한 핵심 주문입니다. - 충실도 요소 나열: 인물, 자세, 표정, 장면 구성을 각각 명시할수록 복원력이 높아집니다.

자주 묻는 질문 FAQ

Q1: openai-imagegen-demo는 어떤 프로젝트인가요?

openai-imagegen-demo는 OpenAI가 GitHub에 공식 공개한 포토부스 데모 앱입니다. Next.js 15 + TypeScript + gpt-image-2를 사용하여 "인물 사진 업로드 → 스타일 선택 → 다중 스타일 이미지 스트리밍 생성" 워크플로우를 구현했습니다. 현재 gpt-image-2의 images/edits 엔드포인트를 통합하는 가장 권위 있는 참고 자료이며, MIT 라이선스로 상업적 이용이 가능합니다.

Q2: imagegen-demo와 다른 이미지 생성 데모의 차이점은 무엇인가요?

두 가지 핵심 차이가 있습니다. 첫째, 기존 DALL-E의 텍스트-이미지 변환이 아닌 gpt-image-2의 새로운 /v1/images/edits 엔드포인트를 사용하여 인물 일관성을 유지합니다. 둘째, stream: true + partial_images 스트리밍 기능을 활성화하여 30초 동안 검은 화면을 보는 대신 이미지가 점진적으로 렌더링되는 과정을 실시간으로 확인할 수 있습니다. 다른 커뮤니티 데모들은 대부분 DALL-E 3 기반의 텍스트-이미지 변환 방식이라 이러한 기능이 없습니다.

Q3: imagegen-demo는 언제 출시되었나요?

이 저장소는 2026년 4월 21일 OpenAI가 ChatGPT Images 2.0을 발표할 때 함께 공개되었습니다. API와 Codex에 gpt-image-2 모델이 정식 도입됨에 따라 개발자들의 통합 장벽을 낮추기 위해 배포되었으며, README는 지속적으로 업데이트되고 있습니다.

Q4: imagegen-demo는 어떤 애플리케이션에 적합한가요?

다음 네 가지 시나리오에 특히 적합합니다.

- 소셜 앱의 의상/스타일 변경: 사용자가 셀카를 업로드하여 동양풍, 유화, 사이버펑크 버전으로 변환

- 이커머스 상품 이미지 통일: 제품 사진을 브랜드 비주얼 스타일에 맞춰 일괄 변환

- 회의/행사 AI 포토 부스: 오프라인 이벤트용 인터랙티브 촬영 장치

- 교육용 데모/해커톤 프로토타입: gpt-image-2의 새로운 기능을 빠르게 시연

Q5: API를 통해 imagegen-demo를 빠르게 실행하는 방법은?

APIYI 공식 중계 서비스를 통한 빠른 복제를 추천합니다:

- APIYI(apiyi.com)에 접속하여 계정 생성 후 API 키 발급

- 저장소 복제:

git clone https://github.com/openai/openai-imagegen-demo .env.local파일에OPENAI_API_KEY와OPENAI_BASE_URL=https://vip.apiyi.com/v1작성route.ts파일에서endpointBase가process.env.OPENAI_BASE_URL을 읽도록 수정npm install && npm run dev실행 후localhost:3000에서 확인

APIYI는 gpt-image-2, Nano Banana Pro, Flux 등 다양한 주요 이미지 모델을 통합 지원하여 로컬에서 빠르게 테스트하고 전환할 수 있습니다.

Q6: imagegen-demo의 partial_images 파라미터는 어떻게 작동하나요?

partial_images는 최종 이미지가 반환되기 전 서버가 중간 프레임을 몇 번 전송할지 지정합니다. 데모 기본값은 2로, 생성 과정이 "초기 스케치 → 2차 최적화 → 최종 결과물"의 3단계로 진행됨을 의미합니다. 각 중간 프레임은 SSE 이벤트 image_edit.partial_image를 통해 전송되며, 프론트엔드에서 실시간 렌더링되어 긴 대기 시간을 방지합니다. 최대 3까지 설정 가능하지만, 중간 프레임이 많아질수록 대역폭 소모가 늘어납니다.

Q7: 국내 개발자가 별도의 장벽 없이 데모를 실행하려면?

국내에서 공식 데모를 직접 실행하면 OpenAI API 네트워크 접속, 해외 신용카드 결제, API 할당량 심사 등 장벽이 있습니다. APIYI 중계 서비스를 이용하면 한 번에 해결됩니다:

apiyi.com에서 계정 생성 (카카오페이/네이버페이 충전 지원)- OpenAI 프로토콜 호환 API 키 획득

.env.local에OPENAI_BASE_URL=https://vip.apiyi.com/v1설정route.ts가 해당 환경 변수를 읽도록 설정 (코드 수정 불필요)

약 5분이면 완료되며, 별도의 우회 접속 없이 OpenAI 공식 요금과 투명하게 연동됩니다.

Q8: imagegen-demo의 알려진 제한 사항은 무엇인가요?

현재 확인된 제한 사항은 다음과 같습니다:

- 단일 이미지 생성 시간: 고화질(

quality: high) 기준 장당 약 20~30초 소요, 대량 처리는 병렬 최적화 필요 - 인물 일관성: 복잡한 자세나 다인원 장면에서는 미세한 왜곡이 발생할 수 있음

- 비용: OpenAI 공식 토큰 과금 기준 장당 약 $0.15부터 시작, 대량 작업 시

medium화질이나 APIYI 중계 서비스($0.03/장) 권장 - 스타일 프리셋: 데모에는 약 10종의 스타일만 내장되어 있어

lib/styles.ts를 직접 확장해야 함 - 모바일 카메라 호환성: iOS Safari에서는 첫 접속 시 카메라 권한을 수동으로 허용해야 할 수 있음

openai-imagegen-demo 핵심 요약

- OpenAI 공식 오픈소스: gpt-image-2 출시와 함께 공개된 공식 데모로, MIT 라이선스에 따라 상업적 이용이 가능합니다.

- 이미지-이미지 변환 능력 집중:

/v1/images/edits엔드포인트를 활용하여 얼굴 일관성을 유지하는 엔지니어링 패러다임을 제시합니다. - 스트리밍 렌더링 기술:

stream: true와partial_images: 2설정을 통해 대기 시간을 블랙 스크린이 아닌 점진적 렌더링 방식으로 개선했습니다. - Next.js 15 풀스택: App Router와 SSE(Server-Sent Events) 아키텍처는 이미지 생성 애플리케이션을 위한 현대적인 베스트 프랙티스입니다.

- 국내 접속 지름길: APIYI(apiyi.com)의 공식 중계 서비스를 통해

base_url만 수정하면 즉시 연결할 수 있습니다. - 프롬프트 골든 패러다임:

preserve the exact ...는 이미지 충실도를 결정짓는 핵심 주문으로, 프로젝트에 바로 적용해 보세요. - 공식 중계 vs 공식 역방향 채널: 상업용은 공식 중계(OpenAI와 정렬)를, 검증용은 공식 역방향(장당 $0.03 고정)을 선택하세요.

요약

openai-imagegen-demo는 gpt-image-2의 새로운 기능을 이해하기 위한 최고의 입문서입니다. 핵심 가치는 다음 세 가지입니다.

- 권위 있는 레퍼런스: 공식 팀이 직접 작성한 통합 패러다임으로, 파라미터, 프롬프트, 스트리밍 아키텍처를 한눈에 파악할 수 있습니다.

- 프로덕션급 코드: Next.js 15 + SSE + 다중 스타일 동시 처리 등 실제 프로젝트에 바로 재사용 가능한 코드를 제공합니다.

- 국내 환경 재현 가능: APIYI 중계 서비스를 통해 국내 개발자도 5분 만에 공식 데모를 실행해 볼 수 있습니다.

gpt-image-2의 스트리밍 이미지 편집 기능을 바로 경험해보고 싶다면, APIYI(apiyi.com)에서 호환 가능한 API 키를 발급받으세요. openai-imagegen-demo를 클론한 뒤 OPENAI_BASE_URL을 https://vip.apiyi.com/v1으로 설정하면 로컬 환경에서도 OpenAI 공식 데모와 동일한 효과를 바로 확인할 수 있습니다.

延伸阅读 Related Articles

gpt-image-2와 openai-imagegen-demo에 관심이 있으시다면, 다음 글들도 함께 읽어보시는 것을 추천드려요:

- 📘 gpt-image-2 역방향 API는 어디서 찾나요? 3분 만에 APIYI 공식 역방향 채널 연결하기 – 장당 $0.03의 저비용 솔루션인 공식 역방향 채널에 대해 알아보세요.

- 📊 gpt-image-2 vs Nano Banana Pro 이미지 모델 비교 분석 – 주요 이미지 모델들의 성능 차이를 비교합니다.

- 🚀 gpt-image-2 활용 사례: 6대 산업 적용 가이드 – 이커머스, 교육, 소셜 미디어 등 실제 적용 사례를 탐구해 보세요.

📚 참고 자료

-

OpenAI imagegen-demo 공식 저장소: 전체 소스 코드, README 및 설치 문서

- 링크:

github.com/openai/openai-imagegen-demo - 설명: gpt-image-2 통합 방식을 이해하기 위한 가장 권위 있는 소스 코드 및 설치 가이드입니다.

- 링크:

-

OpenAI 공식 gpt-image-2 API 문서: 모델 파라미터, 엔드포인트, 과금 안내

- 링크:

developers.openai.com/api/docs/models/gpt-image-2 - 설명: 지원되는 모든 파라미터, 가격, 속도 제한 규칙을 확인하세요.

- 링크:

-

OpenAI ChatGPT Images 2.0 출시 페이지: 새로운 모델 기능 소개

- 링크:

openai.com/index/introducing-chatgpt-images-2-0/ - 설명: gpt-image-2의 설계 철학, 핵심 기능 및 사용 사례를 확인해 보세요.

- 링크:

-

APIYI gpt-image-2 공식 중계 채널 문서: 국내 직접 연결 가이드

- 링크:

docs.apiyi.com/en/api-capabilities/gpt-image-2-all/overview - 설명: 호환 가능한 API 키, base_url 설정 및 가격 상세 정보를 확인하세요.

- 링크:

작성자: APIYI 기술팀

기술 교류: 댓글로 여러분의 imagegen-demo 실전 사례를 공유해 주세요. 더 많은 문서는 APIYI 문서 센터(docs.apiyi.com)에서 확인하실 수 있습니다.