"안녕하세요, 구글 AI Studio 계정이 있는데 무료 할당량이 다 찼다고 나와요. 계속 AI Studio에서 모델을 만들고 싶은데, 제 무료 계정은 충전이 안 되더라고요. 제 구글 계정에 충전하는 방법이 있을까요? 아니면 다른 방법으로 계속 사용할 수 있는 방법이 있을까요?"

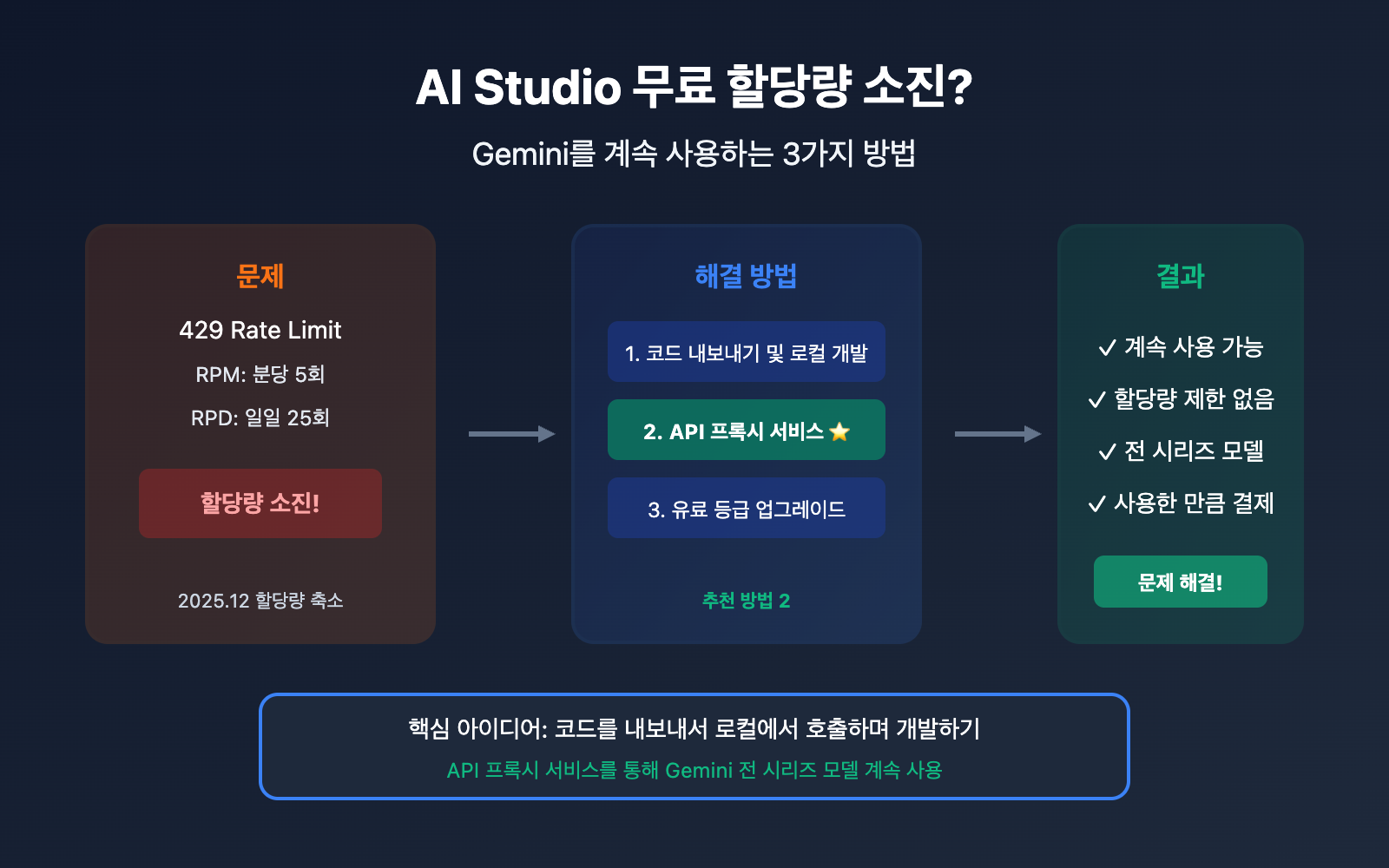

이것은 저희가 매일 받는 사용자 문의 중 하나예요. Google AI Studio의 무료 할당량은 확실히 제한적이며, 특히 2025년 12월에 Google이 무료 등급의 할당량을 대폭 축소했거든요.

다행인 점은, Google 계정에 직접 충전하지 않고도 Gemini 전 시리즈 모델을 계속 사용할 수 있다는 거예요.

핵심 아이디어는 간단해요. 코드를 내보내서 로컬에서 호출하며 개발하는 것이죠.

이번 글에서는 무료 할당량이 소진된 후에도 Gemini를 계속 사용할 수 있는 3가지 해결 방법을 자세히 소개해 드릴게요.

AI Studio 할당량 제한 이해하기

현재 무료 등급 할당량 (2026년 기준)

2025년 12월 7일, Google은 Gemini Developer API 할당량에 중대한 조정을 가했습니다. 이로 인해 많은 개발자의 애플리케이션에서 갑자기 429 오류가 발생하기 시작했죠.

| 모델 | 무료 등급 RPM | 무료 등급 RPD | 유료 등급 RPM |

|---|---|---|---|

| Gemini 2.5 Pro | 5 | 25 | 1,000 |

| Gemini 2.5 Flash | 15 | 500 | 2,000 |

| Gemini 2.0 Flash | 15 | 1,500 | 4,000 |

참고: RPM = 분당 요청 수, RPD = 일일 요청 수

할당량이 갑자기 소진되는 이유

| 원인 | 설명 |

|---|---|

| RPM 초과 | 짧은 시간 동안 너무 많은 요청을 보냄 |

| RPD 초과 | 당일 총 요청 수가 상한선에 도달함 |

| TPM 초과 | 긴 문맥(Context) 사용으로 대량의 토큰 소모 |

| 할당량 축소 | 2025.12 Google의 정책 변경으로 제한이 엄격해짐 |

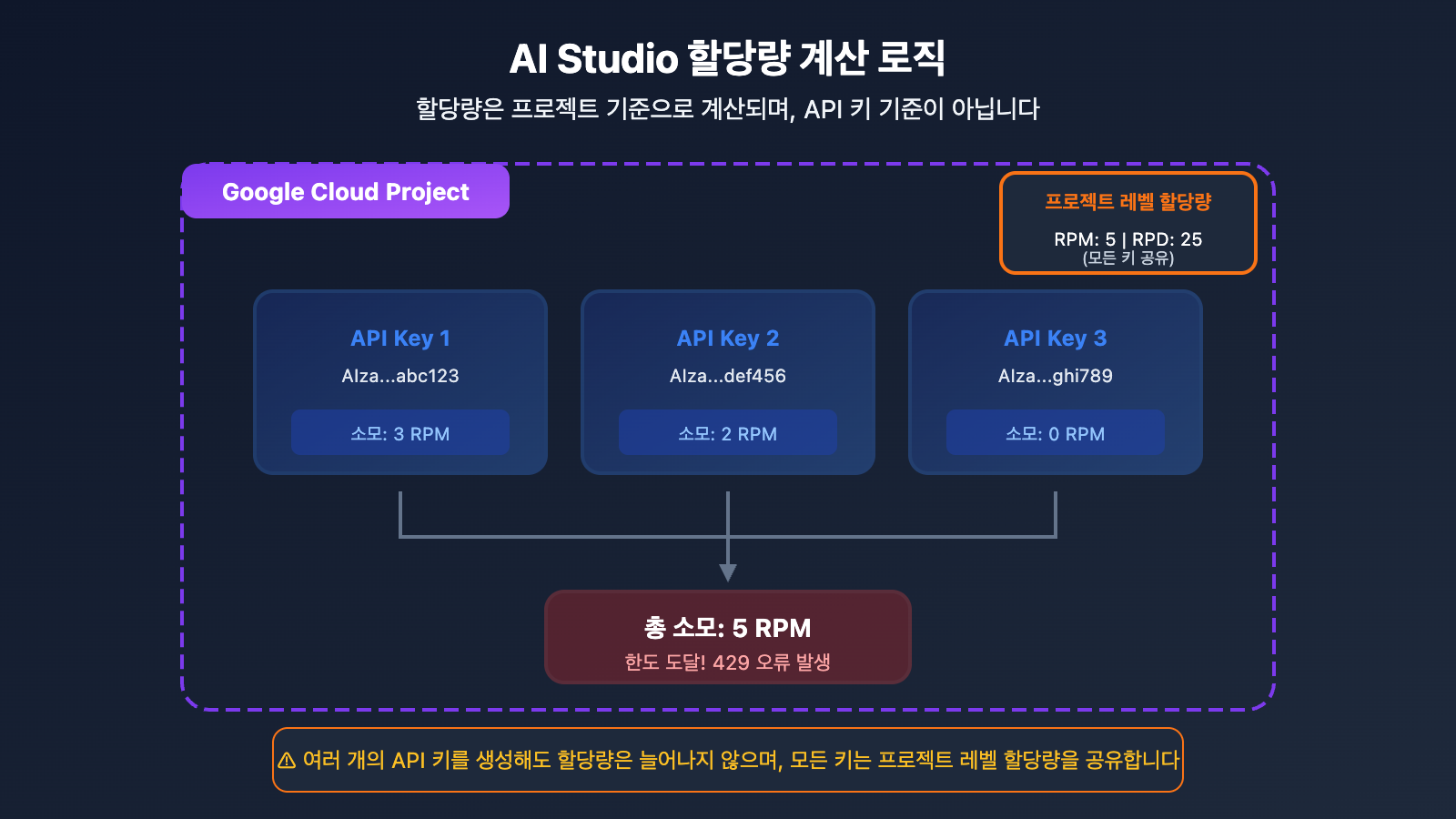

중요 알림: 여러 개의 API Key를 만들어도 할당량은 공유됩니다

많은 사용자가 API Key를 여러 개 만들면 할당량이 늘어날 것이라고 생각하지만, 실제로는 그렇지 않아요.

할당량은 API Key가 아니라 프로젝트(Project) 단위로 계산됩니다. 동일한 프로젝트 내에서 여러 개의 API Key를 생성해도 할당량은 늘어나지 않습니다.

방안 1: 로컬 개발 환경으로 코드 내보내기 (추천)

핵심 개념

AI Studio의 본질은 시각화된 프롬프트 디버깅 도구입니다. 여러분이 AI Studio에서 생성한 모델이나 디버깅한 프롬프트는 모두 코드로 내보낼 수 있으며, 로컬 환경에서 본인의 API 키를 사용하여 직접 호출할 수 있습니다.

작업 단계

Step 1: AI Studio에서 프롬프트 디버깅 완료하기

AI Studio에서 제공하는 무료 할당량을 활용해 프롬프트와 매개변수 설정 등을 충분히 테스트하고 완성하세요.

Step 2: 코드 내보내기

AI Studio는 다양한 내보내기 방식을 지원합니다:

- ZIP 다운로드: 전체 코드 패키지를 로컬로 다운로드

- GitHub로 푸시: 여러분의 코드 저장소로 직접 전송

- 코드 스니펫 복사: Python/JavaScript/curl 코드를 복사

Step 3: 로컬 API 키 설정

# 환경 변수 설정 (추천)

export GEMINI_API_KEY="your-api-key-here"

# 또는

export GOOGLE_API_KEY="your-api-key-here"

Step 4: 로컬에서 실행하기

import google.generativeai as genai

import os

# 환경 변수에서 API 키를 자동으로 읽어옵니다

genai.configure(api_key=os.environ.get("GEMINI_API_KEY"))

model = genai.GenerativeModel('gemini-2.0-flash')

response = model.generate_content("안녕하세요, 자기소개를 부탁드려요.")

print(response.text)

주의 사항

| 항목 | 설명 |

|---|---|

| API 키 보안 | 클라이언트 코드에 API 키를 직접 하드코딩하지 마세요. |

| 환경 변수 | GEMINI_API_KEY 또는 GOOGLE_API_KEY를 사용하세요. |

| 할당량 제한 | 로컬 호출 역시 무료 티어의 할당량 제한을 받습니다. |

🎯 기술 제안: 코드를 내보낸 후에도 무료 할당량이 부족하다면, APIYI(apiyi.com)와 같은 제3자 API 서비스 제공업체 이용을 고려해 보세요. 이러한 플랫폼은 더 높은 할당량과 유연한 요금 체계를 제공합니다.

방안 2: 제3자 API 프록시 서비스 사용하기 (최적의 솔루션)

API 프록시 서비스란 무엇인가요?

API 프록시 서비스는 여러 개의 API 키와 계정 자원을 통합하여 하나의 통일된 API 인터페이스를 제공하는 서비스입니다. 사용자는 다음의 간단한 과정만 거치면 됩니다:

- 프록시 플랫폼에 가입하여 API 키를 발급받습니다.

- 코드 내의 API 주소를 프록시 주소로 변경합니다.

- 할당량 걱정 없이 계속해서 서비스를 이용합니다.

왜 API 프록시를 선택해야 할까요?

| 장점 | 설명 |

|---|---|

| 할당량 걱정 없음 | 프록시 업체가 할당량을 관리하므로 사용자는 사용에만 집중할 수 있습니다. |

| 모든 모델 라인업 지원 | Gemini Pro, Flash, Nano Banana 등 모든 모델을 지원합니다. |

| OpenAI 호환 형식 | 기존 코드 구조를 크게 수정할 필요가 없습니다. |

| 사용한 만큼 지불(종량제) | 월정액 없이 사용한 양에 대해서만 비용이 발생합니다. |

| 높은 안정성 | 다중 노드 부하 분산(Load Balancing)을 통해 특정 노드의 제한을 피할 수 있습니다. |

코드 마이그레이션 예시

변경 전 (Google API 직접 호출):

import google.generativeai as genai

genai.configure(api_key="YOUR_GOOGLE_API_KEY")

model = genai.GenerativeModel('gemini-2.0-flash')

response = model.generate_content("Hello")

변경 후 (API 프록시 사용):

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

response = client.chat.completions.create(

model="gemini-2.0-flash",

messages=[{"role": "user", "content": "Hello"}]

)

print(response.choices[0].message.content)

지원 모델 리스트

| 모델 시리즈 | 상세 모델 | 설명 |

|---|---|---|

| Gemini 2.5 | gemini-2.5-pro, gemini-2.5-flash | 최신 멀티모달 모델 |

| Gemini 2.0 | gemini-2.0-flash, gemini-2.0-flash-thinking | 빠른 추론 모델 |

| Gemini 3 | gemini-3-pro-image-preview | 이미지 생성 모델 |

| Nano Banana | nano-banana-pro | 네이티브 이미지 생성 |

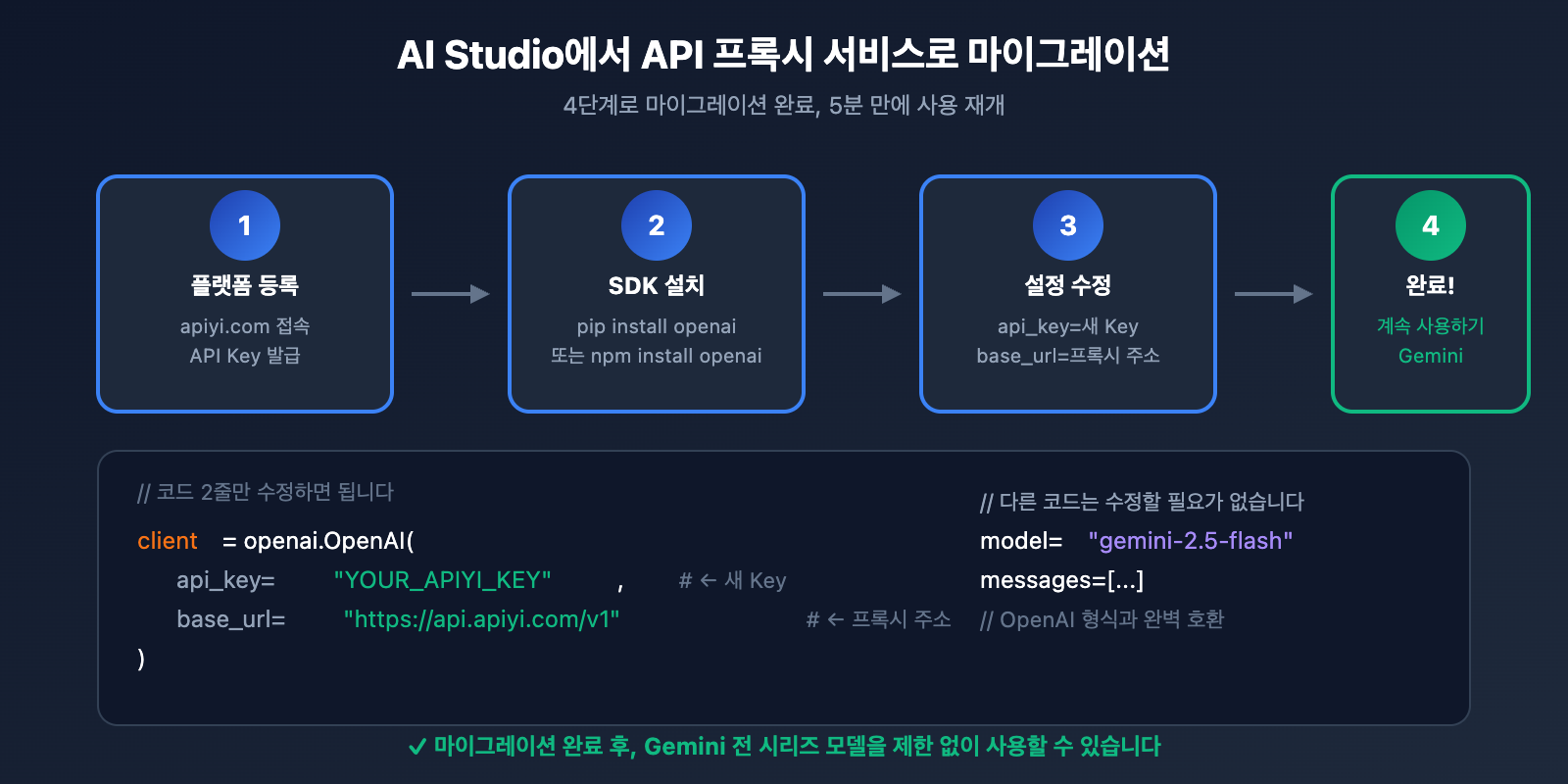

💡 빠른 시작: APIYI(apiyi.com) 플랫폼을 통해 빠르게 연동해 보시는 것을 추천드려요. 이 플랫폼은 Gemini 전 시리즈 모델을 지원하며, OpenAI 호환 형식을 제공하여 5분이면 마이그레이션을 마칠 수 있습니다.

방안 3: Google 유료 티어로 업그레이드하기

유료 티어 할당량(Quota) 비교

Google 공식 서비스를 계속 이용하고 싶다면 유료 티어로 업그레이드하는 방법을 고려해 볼 수 있어요.

| 티어 | 활성화 조건 | Gemini 2.5 Pro RPM | Gemini 2.5 Flash RPM |

|---|---|---|---|

| Free | 기본 | 5 | 15 |

| Tier 1 | 결제 사용 설정 | 150 | 1,000 |

| Tier 2 | $50 이상 소비 | 500 | 2,000 |

| Tier 3 | $500 이상 소비 | 1,000 | 4,000 |

업그레이드 단계

- Google Cloud 콘솔에 로그인해요.

- 프로젝트를 생성하거나 선택합니다.

- 결제(Billing)를 활성화해요 (신용카드 연동 필요).

- AI Studio에서 할당량 변화를 확인합니다.

유료 티어의 문제점

| 문제점 | 설명 |

|---|---|

| 해외 결제 카드 필요 | 국내 사용자가 발급받고 관리하기 번거로울 수 있어요. |

| Google Cloud 계정 필요 | 설정 과정이 비교적 복잡한 편이에요. |

| 최소 소비 문턱 | 높은 티어로 올라가려면 일정 금액 이상의 사용 실적이 필요해요. |

| 여전한 할당량 상한 | 무제한이 아니라 상한선이 높아지는 개념이에요. |

세 가지 방안 비교

| 비교 항목 | 로컬 개발용 내보내기 | API 프록시 서비스 | 유료 티어 업그레이드 |

|---|---|---|---|

| 설정 난이도 | 중간 | 쉬움 | 복잡 |

| 할당량 제한 | 여전히 제한됨 | 제한 없음 | 한도 상향 |

| 비용 | 무료 (제한적) | 사용한 만큼 결제 | 사용한 만큼 결제 |

| 신용카드 필요 | 아니요 | 아니요 | 예 (해외 카드) |

| 안정성 | 보통 | 높음 | 높음 |

| 활용 시나리오 | 가벼운 사용 | 대부분의 사용자 권장 | 기업급 수요 |

상세 튜토리얼: AI Studio에서 API 프록시로 마이그레이션하기

1단계: API 프록시 플랫폼 계정 등록하기

APIYI(apiyi.com)에 접속하여 계정을 등록하고 API 키를 발급받으세요.

2단계: OpenAI SDK 설치하기

# Python

pip install openai

# Node.js

npm install openai

3단계: 코드 설정 수정하기

Python 예시:

import openai

# API 프록시 설정

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

# Gemini 모델 호출

def chat_with_gemini(prompt):

response = client.chat.completions.create(

model="gemini-2.5-flash", # 다른 Gemini 모델 선택 가능

messages=[

{"role": "user", "content": prompt}

],

temperature=0.7,

max_tokens=2048

)

return response.choices[0].message.content

# 사용 예시

result = chat_with_gemini("Python으로 퀵 정렬 알고리즘을 작성해 줘")

print(result)

Node.js 예시:

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: 'YOUR_APIYI_KEY',

baseURL: 'https://api.apiyi.com/v1'

});

async function chatWithGemini(prompt) {

const response = await client.chat.completions.create({

model: 'gemini-2.5-flash',

messages: [

{ role: 'user', content: prompt }

]

});

return response.choices[0].message.content;

}

// 사용 예시

const result = await chatWithGemini('머신러닝이 무엇인지 설명해 줘');

console.log(result);

4단계: 테스트 및 검증

# 연결 테스트

try:

response = client.chat.completions.create(

model="gemini-2.5-flash",

messages=[{"role": "user", "content": "Hello, 연결 테스트"}],

max_tokens=50

)

print("연결 성공:", response.choices[0].message.content)

except Exception as e:

print("연결 실패:", e)

이미지 생성 모델 마이그레이션

AI Studio에서의 이미지 생성

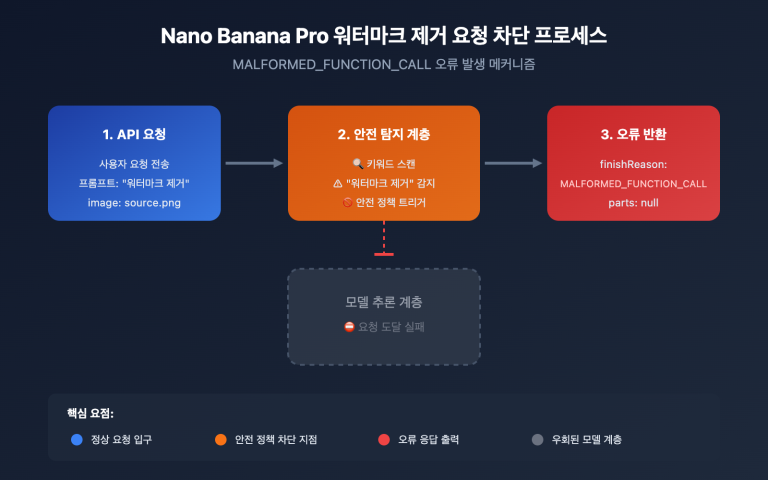

AI Studio에서 Gemini의 이미지 생성 기능(Nano Banana Pro)을 사용하고 계셨다면, API 프록시를 통해 동일하게 계속 사용할 수 있어요.

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

# 이미지 생성

response = client.images.generate(

model="nano-banana-pro",

prompt="햇살 아래서 낮잠을 자고 있는 귀여운 치즈 고양이, 실사 사진 스타일",

size="1024x1024",

quality="hd"

)

image_url = response.data[0].url

print(f"생성된 이미지: {image_url}")

멀티모달 대화 (텍스트 및 이미지 혼합)

import base64

def encode_image(image_path):

with open(image_path, "rb") as f:

return base64.b64encode(f.read()).decode()

image_base64 = encode_image("example.jpg")

response = client.chat.completions.create(

model="gemini-2.5-flash",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "이 이미지의 내용을 설명해 줘"},

{

"type": "image_url",

"image_url": {

"url": f"data:image/jpeg;base64,{image_base64}"

}

}

]

}

]

)

print(response.choices[0].message.content)

💰 비용 최적화: 이미지 생성 작업의 경우, APIYI(apiyi.com) 플랫폼에서 유연한 과금 방식을 제공해요. Nano Banana Pro, DALL-E, Stable Diffusion 등 다양한 모델을 지원하므로 필요에 따라 최적의 방안을 선택할 수 있습니다.

일반적인 오류 처리

오류 1: 429 Too Many Requests

import time

from tenacity import retry, stop_after_attempt, wait_exponential

@retry(stop=stop_after_attempt(3), wait=wait_exponential(multiplier=1, min=2, max=10))

def call_api_with_retry(prompt):

return client.chat.completions.create(

model="gemini-2.5-flash",

messages=[{"role": "user", "content": prompt}]

)

오류 2: 유효하지 않은 API 키

# API 키 설정 확인

import os

api_key = os.environ.get("APIYI_KEY")

if not api_key:

raise ValueError("APIYI_KEY 환경 변수를 설정해 주세요")

client = openai.OpenAI(

api_key=api_key,

base_url="https://api.apiyi.com/v1"

)

오류 3: 존재하지 않는 모델

# 모델 이름이 정확한지 확인

SUPPORTED_MODELS = [

"gemini-2.5-pro",

"gemini-2.5-flash",

"gemini-2.0-flash",

"nano-banana-pro"

]

model_name = "gemini-2.5-flash"

if model_name not in SUPPORTED_MODELS:

print(f"경고: {model_name}은(는) 지원 목록에 없을 수 있습니다")

자주 묻는 질문 FAQ

Q1: AI Studio의 무료 할당량은 언제 초기화되나요?

- RPM (분당 요청 수): 롤링 윈도우 방식으로 매분 초기화됩니다.

- RPD (일일 요청 수): 태평양 표준시(PT) 자정에 초기화됩니다.

- TPM (분당 토큰 수): 롤링 윈도우 방식으로 매분 초기화됩니다.

만약 급하게 사용해야 한다면, 할당량 초기화를 기다릴 필요 없이 APIYI(apiyi.com) 플랫폼을 통해 호출하는 것을 추천드려요.

Q2: API 프록시 사용은 안전한가요?

정식 API 프록시 서비스 제공업체를 선택한다면 안전합니다. 주로 다음 사항에 유의하세요.

- 신뢰할 수 있는 서비스 업체를 선택하세요.

- 코드에 API 키를 직접 하드코딩하지 마세요.

- 환경 변수를 사용하여 키를 관리하세요.

Q3: API 프록시 가격은 어떤가요?

대부분의 API 프록시 서비스는 종량제(Pay-as-you-go) 방식을 채택하고 있으며, 보통 공식 가격보다 저렴한 경우가 많습니다. APIYI(apiyi.com) 플랫폼은 투명한 요금 체계를 제공하고 있으니, 웹사이트에서 구체적인 가격을 확인하실 수 있습니다.

Q4: 마이그레이션 후 코드를 많이 수정해야 하나요?

OpenAI 호환 포맷의 API 프록시를 사용한다면 코드 수정은 매우 미미합니다.

api_key와base_url만 수정하면 됩니다.- 모델 이름은 일부 조정이 필요할 수 있습니다.

- 그 외의 다른 코드 로직은 수정할 필요가 없습니다.

Q5: 여러 API 서비스를 동시에 사용할 수 있나요?

네, 가능합니다. 상황에 따라 다양한 서비스를 선택해서 사용할 수 있어요.

- 가벼운 테스트용으로는 AI Studio 무료 할당량을 사용하세요.

- 일상적인 개발에는 API 프록시 서비스를 이용해 보세요.

- 특수한 요구 사항이 있을 때는 공식 유료 서비스를 사용하면 됩니다.

요약

Google AI Studio의 무료 할당량을 모두 사용했을 때, 3가지 선택지가 있습니다:

| 방안 | 대상 | 핵심 작업 |

|---|---|---|

| 로컬 개발 환경으로 내보내기 | 라이트 유저 | 코드를 내보내어 로컬에서 호출 |

| API 프록시 서비스 | 대부분의 개발자 | base_url을 수정하여 계속 사용 |

| 유료 플랜으로 업그레이드 | 엔터프라이즈급 수요 | 신용카드 등록 및 할당량 증설 |

핵심 제안:

- Google 계정에 직접 충전하지 마세요. (해외 결제 가능한 카드가 있고 엔터프라이즈급 서비스가 꼭 필요한 경우가 아니라면 권장하지 않습니다.)

- 코드를 로컬 환경으로 내보내세요.

- API 프록시 서비스를 사용하여 Gemini 모델을 계속 호출하세요.

- 한 줄 요약: 코드를 내보내어 로컬 환경에서 개발 및 호출을 진행하세요.

APIYI(apiyi.com)를 통해 Gemini 사용을 빠르게 재개하는 것을 추천합니다. 이 플랫폼은 Gemini 전 시리즈 모델을 지원하며, OpenAI 호환 형식을 제공하여 마이그레이션 비용이 매우 낮습니다.

더 읽어보기:

- Gemini API 요율 제한: ai.google.dev/gemini-api/docs/rate-limits

- AI Studio 빌드 모드: ai.google.dev/gemini-api/docs/aistudio-build-mode

- API Key 사용 가이드: ai.google.dev/gemini-api/docs/api-key

📝 작성자: APIYI 기술 팀 | 대규모 언어 모델 API 통합 및 최적화 전문

🔗 기술 교류: APIYI(apiyi.com)를 방문하여 Gemini 전 시리즈 모델 호출 지원을 확인해 보세요.