title: "Replicateの代替案:『コールドスタート』が本番環境の致命的なボトルネックになる時"

description: "Replicateのコールドスタート問題とコストの不確実性に悩んでいませんか?APIYIが提供するゼロ・コールドスタート、固定料金、失敗時の課金なしというソリューションで、本番環境のAIインフラを最適化する方法を解説します。"

Replicateの代替案:『コールドスタート』が本番環境の致命的なボトルネックになる時

Replicateは、開発者コミュニティで広く知られる機械学習モデルのホスティングプラットフォームであり、そのシンプルなAPIと膨大なコミュニティモデルによって高い評価を得ています。しかし、本番環境において、あるアーキテクチャ上の問題が開発者を悩ませ続けています。それは、コールドスタートによる10〜60秒以上の遅延です。リアルタイムな応答が求められるアプリケーションにとって、これは受け入れがたい数値です。

さらに重要なのは、Replicateの計算時間ベースの課金モデルがコストを予測不可能にしている点です。同じモデルであっても、時間帯や負荷状況によって費用が数倍も異なることがあります。加えて、失敗した呼び出しに対しても課金が発生し、プライベートデプロイメントではアイドルコストも発生するため、開発者は「Replicateの代替案」を模索せざるを得なくなっています。

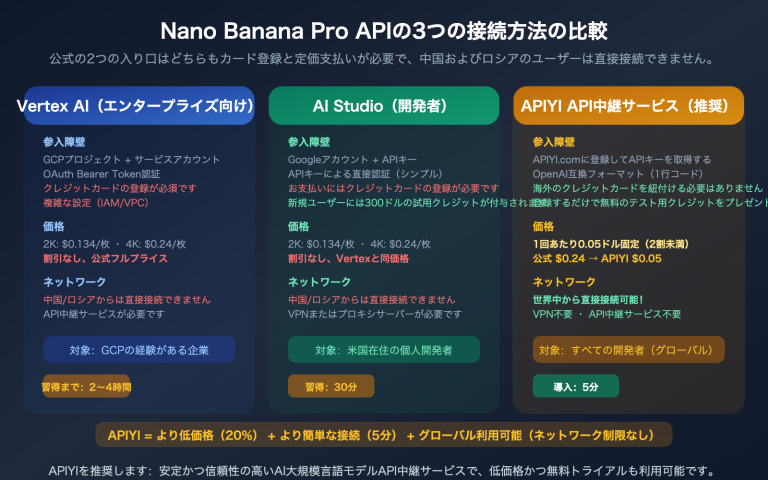

核心的な価値: 本記事では、コールドスタート、コストの予測可能性、失敗した呼び出しへの対応において、APIYIがReplicateとどのように根本的に異なるのかを解説します。APIYIなら、ゼロ・コールドスタート、NB Pro固定 $0.05/回、そして失敗時の課金なしを実現します。

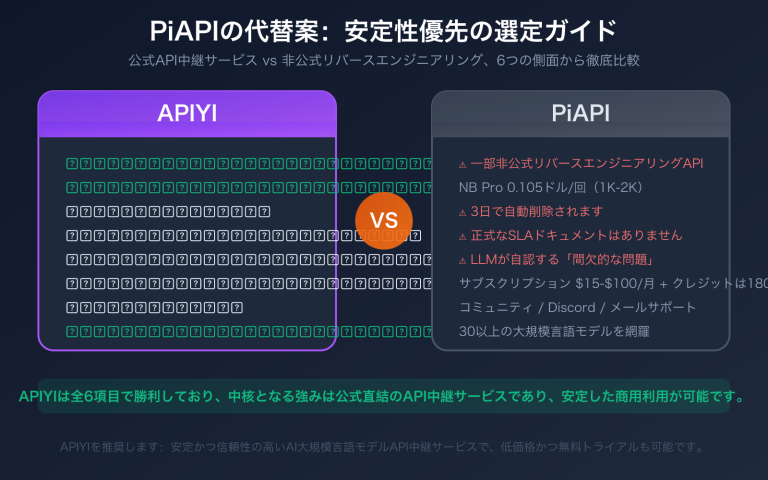

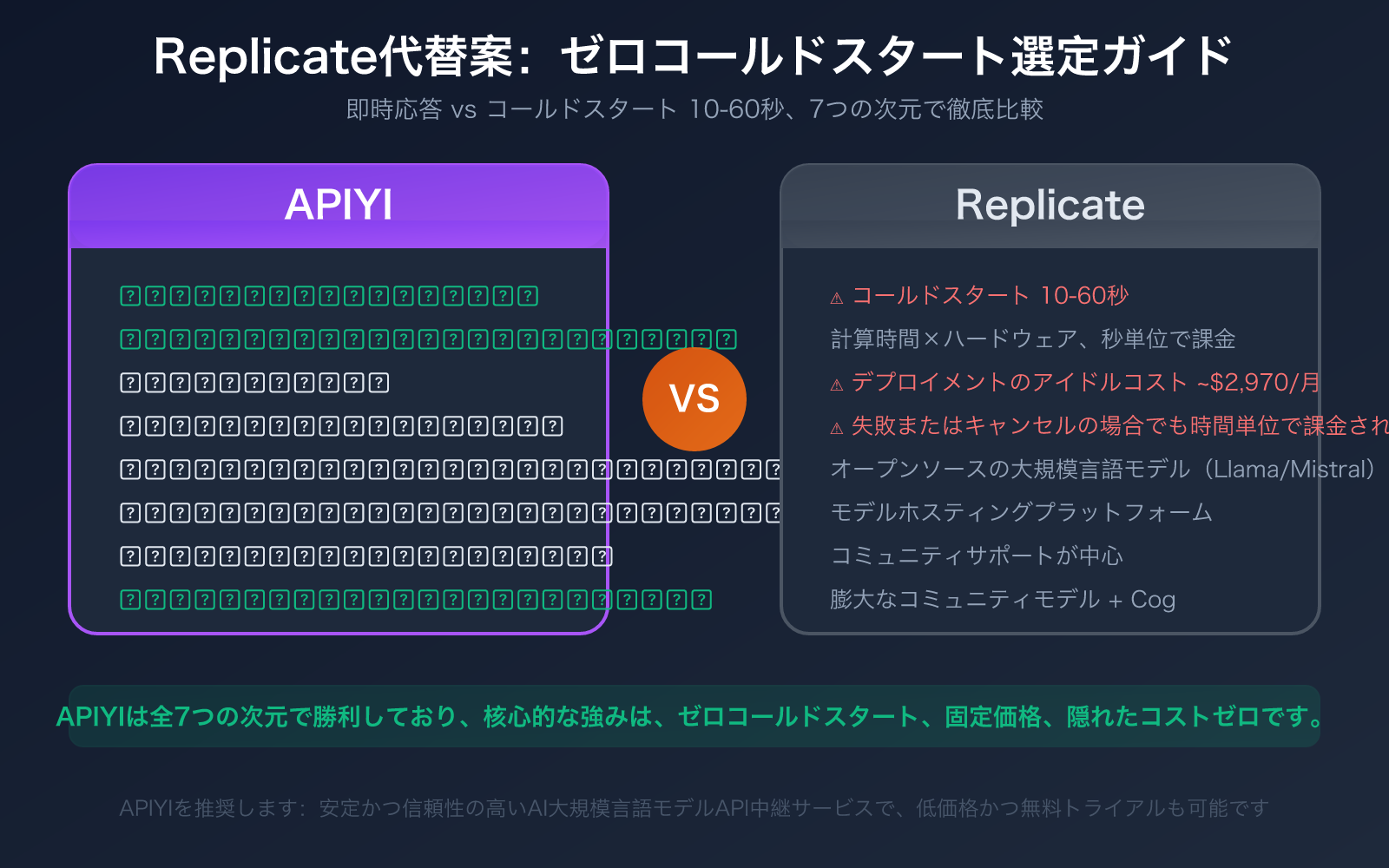

APIYI vs Replicate:7つの項目で徹底比較

| 比較項目 | APIYI | Replicate | 勝者 |

|---|---|---|---|

| コールドスタート | ゼロ遅延 / 即時応答 | 公開モデルで10〜60秒の遅延 | APIYI ✅ |

| 料金モデル | 固定価格(メディア)/ トークン(対話) | 計算時間 × ハードウェア、秒単位課金 | APIYI ✅ |

| アイドルコスト | なし | プライベートデプロイメントで発生(約$99/日) | APIYI ✅ |

| 失敗時の課金 | 返金 / 課金なし | 消費した計算時間に対して課金 | APIYI ✅ |

| プレイグラウンド | あり、全モデルのオンラインテスト対応 | Web UI(基本機能のみ) | APIYI ✅ |

| LLMサポート | 商用モデル(Claude/GPT/Gemini) | オープンソースモデルのみ(Llama/Mistral) | APIYI ✅ |

| プラットフォーム | 統合マルチモーダルプラットフォーム | モデルホスティングプラットフォーム | APIYI ✅ |

🎯 選定のアドバイス: 即時応答、固定コスト、商用LLMのサポートが必要なAI APIプラットフォームをお探しなら、APIYI (apiyi.com) が最適です。Replicateのコールドスタート問題をアーキテクチャレベルで解決し、さらにReplicateよりもはるかに安価な固定価格を提供しています。

Replicate 代替方案对比维度一:冷启动——生产环境的头号敌人

Replicate 的冷启动问题

冷启动是 Replicate 用户面临的第一大痛点。当一个模型在一段时间内未被调用时,GPU 资源会被释放。当下一次请求到来时,模型需要重新加载到 GPU 上:

| 模型类型 | 冷启动时间 | 说明 |

|---|---|---|

| 小型图像分类器 | 10-15 秒 | 最快的冷启动场景 |

| SDXL / FLUX 画像生成 | 15-30 秒 | 中等等待时间 |

| 大型 LLM(Llama 70B) | 30-60+ 秒 | 接近 1 分钟 |

| 视频生成模型 | 60+ 秒 | 最慢,大型权重文件 |

对用户的影响: 如果你在电商应用中使用 AI 画像生成,用户点击「生成产品图」后需要等待 30 秒才能看到响应——这远超用户的耐心阈值(通常为 3-5 秒)。

Replicate 的解决方案: 提供「Deployments」(私有部署),保持实例常驻。但这引入了新问题——闲置成本。一台 A100 (40GB) 的 Deployment 全天候运行成本约为 $99/天($2,970/月),即使没有任何请求。

APIYI 的零冷启动

APIYI 完全没有冷启动问题:

- 所有模型即时响应,无需加载等待

- NB Pro 作为平台日消耗第一的主力模型,始终保持热状态

- 无需为避免冷启动而支付闲置成本

- 首次请求和后续请求的响应时间保持一致

💡 架构差异: Replicate 是 Serverless GPU 计算平台——模型按需加载到 GPU 上,因此存在冷启动。APIYI 是 API 中转平台——直接连接上游模型提供商的常驻服务,从架构上就不存在冷启动问题。这不是优化的差异,而是根本架构的不同。

Replicate 代替方案对比维度二:定价模型与成本可预测性

Replicate 的计算时间计费

Replicate 按计算时间 × 硬件类型计费,按秒收费:

| GPU 类型 | 每秒费用 | 每小时费用 |

|---|---|---|

| CPU | $0.0001/秒 | $0.36/小时 |

| Nvidia T4 | $0.000225/秒 | $0.81/小时 |

| Nvidia A40 | $0.000463/秒 | $1.67/小时 |

| Nvidia A100 (40GB) | $0.00115/秒 | $4.14/小时 |

| Nvidia A100 (80GB) | $0.0014/秒 | $5.04/小时 |

| Nvidia H100 | $0.0032/秒 | $11.52/小时 |

成本不可预测的原因:

- 同一模型在不同负载下的计算时间不同

- 冷启动时间可能被计入(取决于模型)

- 分辨率、步数、参数不同导致耗时差异

- 高峰期 GPU 排队导致总耗时增加

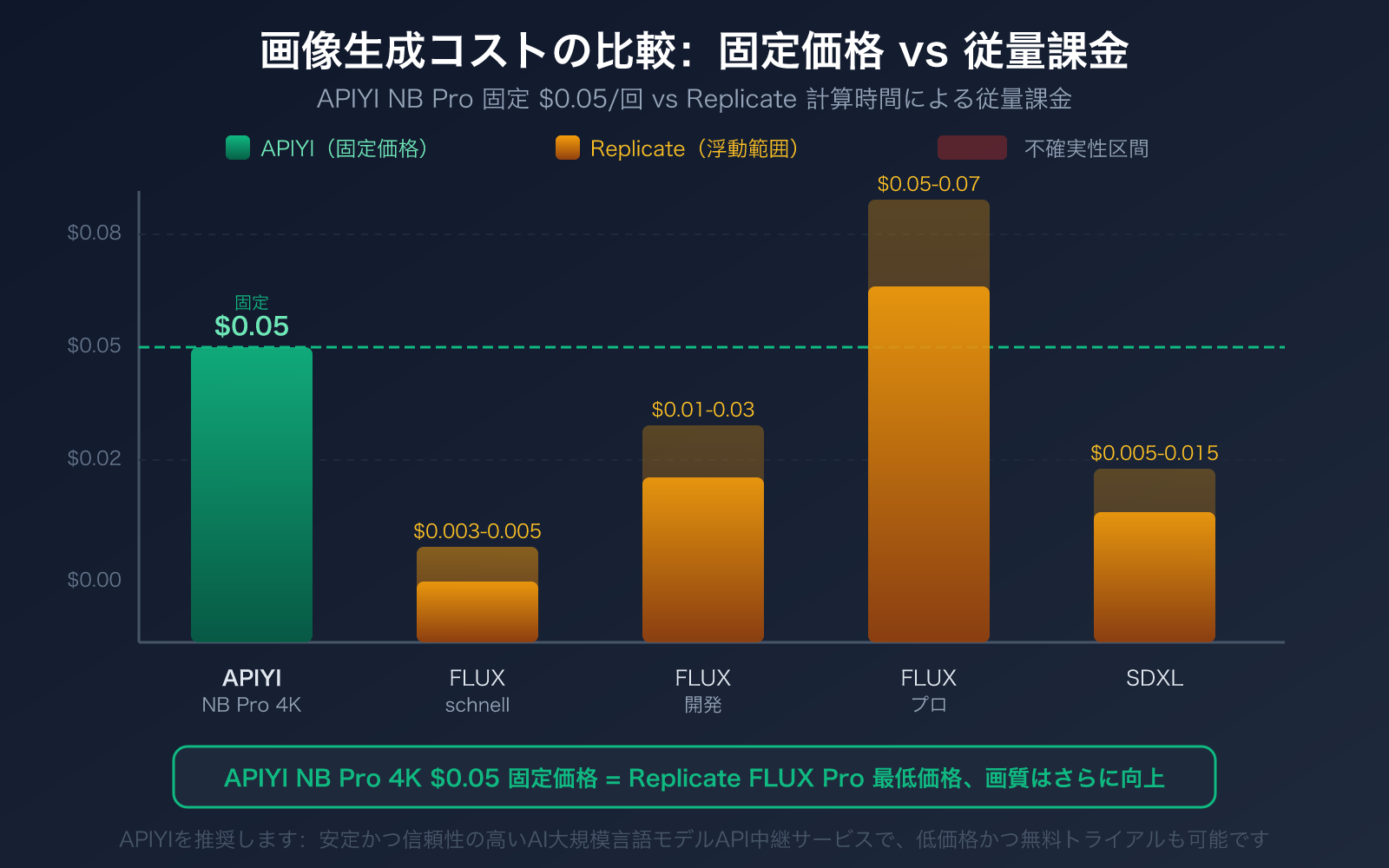

Replicate 上图像生成的实际成本:

- FLUX.1 schnell: ~$0.003-0.005/张

- FLUX.1 dev: ~$0.01-0.03/张

- FLUX.1 pro: ~$0.05-0.07/张

- SDXL: ~$0.005-0.015/张

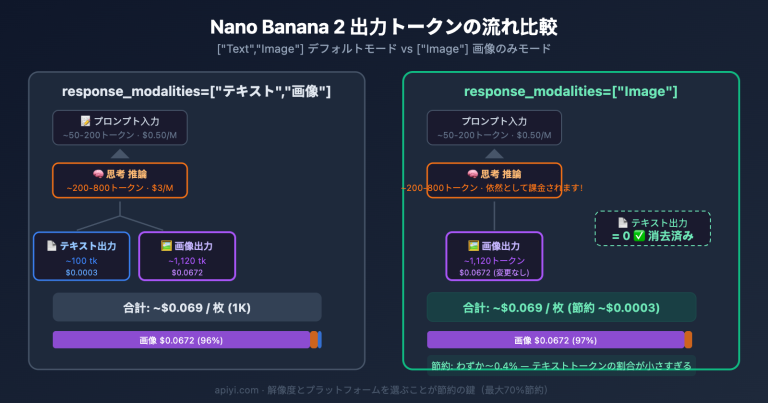

APIYI 的固定价格

APIYI 的图像生成采用固定价格,简单透明:

| 模型 | APIYI 价格 | 说明 |

|---|---|---|

| NB Pro(1K-4K) | $0.05/次 | 全分辨率统一价,官网 2 折 |

| NB 2 | $0.035/次 | 速度更快,价格更低 |

成本完全可预测: 调用前即可预知精确费用,不受计算时间、GPU 负载、冷启动影响。

💰 成本对比: APIYI NB Pro $0.05/次即可生成 4K 超高清图片,画质水平(Gemini 3 Pro 架构)远超 Replicate 上同价位的 FLUX.1 pro。通过 APIYI apiyi.com 注册即可获取免费测试额度。

Replicate 代替方案对比维度三:隐性成本——闲置费与失败收费

Replicate 的两大隐性成本

1. 闲置成本(Deployments)

为了解决冷启动问题,你必须使用 Deployments(部署)来保持实例常驻:

| GPU | 月闲置成本 | 说明 |

|---|---|---|

| A40 | ~$1,200/月 | 最低配置 |

| A100 (40GB) | ~$2,970/月 | 常用配置 |

| A100 (80GB) | ~$3,629/月 | 大规模语言模型需要 |

| H100 | ~$8,294/月 | 高性能需求 |

即使在深夜没有任何请求的情况下,这些费用依然会照常产生。

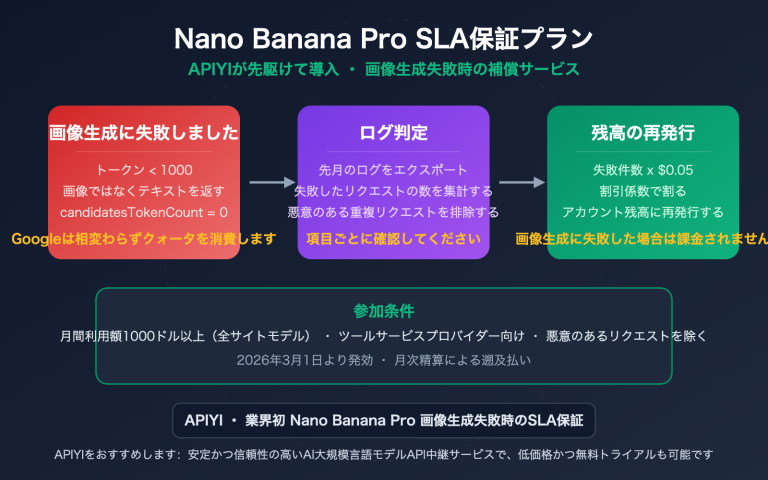

2. 失败调用仍收费

- 模型开始处理后失败 → 按已消耗的计算时间收费

- 用户取消请求 → 按取消前已消耗的时间收费

- 对于实验性模型或不稳定的社区模型,失败率可能高达 5-15%

APIYI 的零隐性成本

- 零闲置成本: 不使用则完全不产生任何费用

- 失败不收费: 服务端错误不收费,充分保护用户利益

- 无冷启动附加费: 不需要为避免冷启动支付任何额外成本

🚀 实际影响: 假设你为了避免冷启动而使用 Replicate 的 A100 Deployment,每月闲置成本高达 $2,970。即使你每月只生成 5,000 张图片,仅闲置成本就相当于每张图 $0.594。加上计算费用,实际单价远高于 APIYI 的 $0.05/次。在 APIYI apiyi.com 上,5,000 张图的总费用仅为 $250。

Replicate 代替方案对比维度四:大规模语言模型能力——商业模型 vs 仅开源

Replicate 的大规模语言模型局限

Replicate 仅支持开源大规模语言模型:

- Meta Llama 系列(Llama 2/3/3.1)

- Mistral / Mixtral

- Phi、Vicuna 等

- 不支持: GPT-4o、Claude、Gemini Pro 等商业模型

对于需要顶级推理能力的应用(如复杂代码生成、专业写作、高级分析),开源模型与商业模型之间仍存在明显差距。

APIYI 的全栈大规模语言模型支持

APIYI 原生支持所有主流商业和开源大规模语言模型:

- Claude 全系列(Opus/Sonnet/Haiku)

- GPT-4o、GPT-4.1 等 OpenAI 模型

- Gemini Pro 全系列

- DeepSeek、Qwen 等

- 统一接口,一个 APIキー 即可调用全部

| 大规模语言模型能力 | APIYI | Replicate |

|---|---|---|

| Claude Opus/Sonnet | ✅ 原生支持 | ❌ 不可用 |

| GPT-4o | ✅ 原生支持 | ❌ 不可用 |

| Gemini Pro | ✅ 原生支持 | ❌ 不可用 |

| Llama / Mistral | ✅ 支持 | ✅ 支持 |

| 与图像生成统一接口 | ✅ 一个 APIキー | ❌ 需另找服务 |

💡 架构建议: 如果你的应用需要「GPT/Claude 对话 + NB Pro 画像生成」,在 Replicate 上你需要分别接入两个不同平台并管理两套 APIキー。而在 APIYI apiyi.com 上,一个 APIキー 即可实现统一调用。

Replicate 代替案比較:第5の視点「統合体験」

Replicate の統合方法

# Replicate での画像生成呼び出し

import replicate

output = replicate.run(

"stability-ai/sdxl:latest",

input={

"prompt": "A cat sitting on a windowsill",

"width": 1024,

"height": 1024

}

)

# URLリストが返されるため、別途ダウンロードが必要

注意点:

- 返されるのは一時的なURLであり、自身でダウンロードして保存する必要があります。

- 非同期モデルの場合は、ポーリング(確認)またはWebhookの使用が必要です。

- コールドスタート中はリクエストがブロックされます。

APIYI の統合方法

# APIYI での NB Pro 呼び出し —— Google 公式 SDK、コールドスタートなし

import google.generativeai as genai

genai.configure(

api_key="your-apiyi-key",

client_options={"api_endpoint": "api.apiyi.com"}

)

model = genai.GenerativeModel("gemini-3-pro-image-preview")

response = model.generate_content(

"一只猫坐在窗台上看雨,温暖的室内灯光",

generation_config=genai.GenerativeConfig(

response_modalities=["TEXT", "IMAGE"],

image_config={"image_size": "4K", "aspect_ratio": "16:9"}

)

)

# Base64 画像データを直接返すため、追加のダウンロード処理は不要

- Google 公式ドキュメント:

ai.google.dev/gemini-api/docs/image-generation - オンライン画像生成テスト:

imagen.apiyi.com - サンプルコードのダウンロード:

xinqikeji.feishu.cn/wiki/W4vEwdiCPi3VfTkrL5hcVlDxnQf

🎯 技術的なアドバイス: APIYI (apiyi.com) は Google 公式の

generateContent形式と互換性があるため、Google 公式ドキュメントやコミュニティのリソースをそのまま活用して開発を進められます。結果は Base64 データとして直接返されるため、一時URLのダウンロードや保存ロジックを実装する必要はありません。

Replicate 代替サービス:利用シーン別のおすすめ

APIYI を選ぶべきシーン

- リアルタイム応答が必要なアプリ: コールドスタートゼロで、即座に結果を返します。

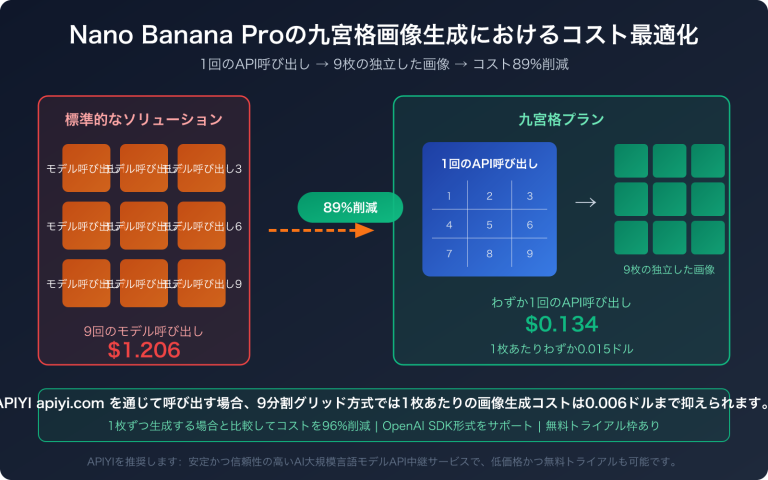

- NB Pro / NB2 画像生成: 1回あたり $0.05 の固定価格で、最高品質の画像生成が可能です。

- 商用 LLM が必要な場合: Claude/GPT/Gemini と画像生成を一括で利用したい場合に最適です。

- コスト重視のプロジェクト: 固定価格制のため、待機料金や失敗時の課金がありません。

- 商用デプロイ: 主要モデルの専用運用により、安定した商用利用が可能です。

- 予算管理: 固定価格により、財務予算を完全に予測できます。

Replicate を選ぶべきシーン

- コミュニティのオープンソースモデルが必要: Replicate にはコミュニティがアップロードした膨大な種類の特定モデルがあります。

- LoRA 微調(ファインチューニング)のニーズ: SDXL や Llama などのモデルのオンライン微調をサポートしています。

- カスタムモデルのデプロイ: Cog コンテナを使用して、独自のモデルをパッケージ化できます。

- 純粋なオープンソース技術スタック: プロジェクトの要件として、商用 API に依存しないことが求められる場合。

その他の Replicate 代替サービス比較

| 代替サービス | ポジショニング | 強み | 制限 |

|---|---|---|---|

| APIYI | フルスタック AI API プラットフォーム | コールドスタートゼロ、NB Pro 2割引、商用 LLM | カスタムモデルのデプロイ不可 |

| Fal.ai | メディア生成推論 | 高速推論、600以上のモデル | 計算時間による従量課金 |

| Together AI | オープンソースモデル推論 | FP8 によるコスト削減、高スループット | 画像生成能力に制限あり |

| Modal | Serverless GPU | Replicate より高速なコールドスタート | コールドスタートの問題は残る |

| RunPod | GPU レンタル | 完全な制御、透明な価格設定 | インフラの自己管理が必要 |

よくある質問

Q1: APIYI の NB Pro の画質は Replicate の FLUX Pro と比較してどうですか?

NB Pro は Google Gemini 3 Pro アーキテクチャに基づいており、文字のレンダリング、指示への追従性、世界知識の面で FLUX Pro よりも優れています。FLUX Pro は芸術的なスタイルの柔軟性に強みがあります。価格は両者とも同程度(APIYI NB Pro $0.05 対 Replicate FLUX Pro 約 $0.05-0.07)ですが、APIYI の NB Pro は同じ価格で 4K 出力に対応しており、Replicate で FLUX Pro を高解像度で利用するとコストがさらに高くなります。imagen.apiyi.com にて NB Pro の生成結果をオンラインでテストしてから判断することをお勧めします。

Q2: Replicate のコールドスタートは実際どの程度深刻ですか?

非常に深刻です。パブリックモデル(Deployments を使用しない場合)では、初回呼び出しや長時間呼び出しがない後のリクエストで 10〜60 秒の待ち時間が発生します。SDXL のような一般的なモデルであっても、コールドスタートには 15〜20 秒かかります。コールドスタートを解消するには Deployments(月額約 $2,970〜)が必要となり、中小規模のチームにはコストが高すぎます。APIYI (apiyi.com) は常駐サービスに直接接続するアーキテクチャを採用しているため、コールドスタートの問題は一切ありません。

Q3: Replicate から APIYI に移行する場合、コードの修正はどれくらい必要ですか?

主な変更点は、replicate.run() の呼び出しを Google 公式 SDK の generateContent に置き換えることです。コード構造は変わりますが(Replicate の URL 返却形式から Base64 データ返却形式へ)、コード量は通常より少なくなります。Google 公式ドキュメント ai.google.dev/gemini-api/docs/image-generation を参照すれば、一般的な移行は 1〜2 時間で完了します。APIYI (apiyi.com) で無料テスト枠を取得し、まずは検証してから移行を進めてください。

まとめ:Replicate代替サービスの選定における核心的なアドバイス

「Replicate代替サービス」を選定する際、APIYIとReplicateの決定的な違いはアーキテクチャの設計思想にあります。

- ゼロ・コールドスタート: APIYIは常時稼働サービスに直接接続するため待ち時間がありません。一方、ReplicateのServerless GPUは10〜60秒のコールドスタートが発生します。

- 固定料金: APIYIのNB Proは1回あたり$0.05(1K〜4Kトークン同額)です。対してReplicateは計算時間に応じた従量課金制です。

- 隠れたコストがゼロ: アイドル料金はなく、失敗時の課金もありません。Replicateのデプロイメントは月額約$2,970の固定費がかかり、失敗しても料金が発生します。

- 商用LLMへの対応: APIYIはClaude、GPT、Geminiをネイティブサポートしています。Replicateはオープンソースモデルのみが対象です。

- 統合プラットフォーム: APIYIは1つのキーでLLMと画像生成の両方を呼び出せます。Replicateでは別途LLMサービスを探す必要があります。

Nano Banana Proは、APIYIで最も利用されている主力モデルであり、商用利用に耐えうる安定性を確保するため、プラットフォーム側で多大な運用リソースを投じています。APIYI(apiyi.com)経由での接続を推奨しており、画像生成の品質は imagen.apiyi.com にてオンラインで体験いただけます。

技術サポート: APIYI apiyi.com —— ゼロ・コールドスタート、固定料金、商用利用可能な安定性を備えたAI大規模言語モデルAPI中継サービス