Replicate Alternative:当「冷启动」成为生产环境的致命瓶颈

Replicate 是开发者社区中知名的 ML 模型托管平台,凭借简洁的 API 和海量社区模型赢得了广泛认可。但在生产环境中,一个架构层面的问题持续困扰着开发者:冷启动延迟可达 10-60 秒以上,对于需要实时响应的应用来说,这是无法接受的。

更关键的是,Replicate 的按计算时间计费模式让成本变得不可预测——同一个模型在不同时段、不同负载下的费用可能相差数倍。再加上失败的调用仍然计费、私有部署产生闲置成本,开发者不得不开始搜索「replicate alternative」。

核心价值: 看完本文,你将理解 API易 在冷启动、成本可预测性、失败调用策略上与 Replicate 的根本差异——零冷启动,NB Pro 固定 $0.05/次,失败不收费。

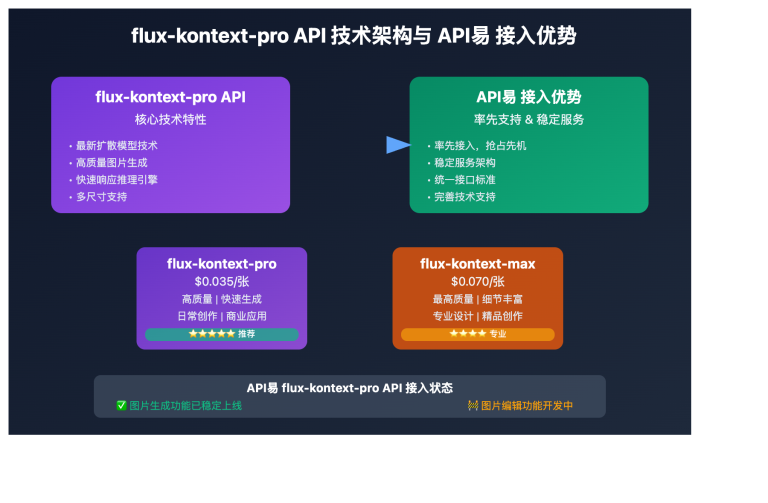

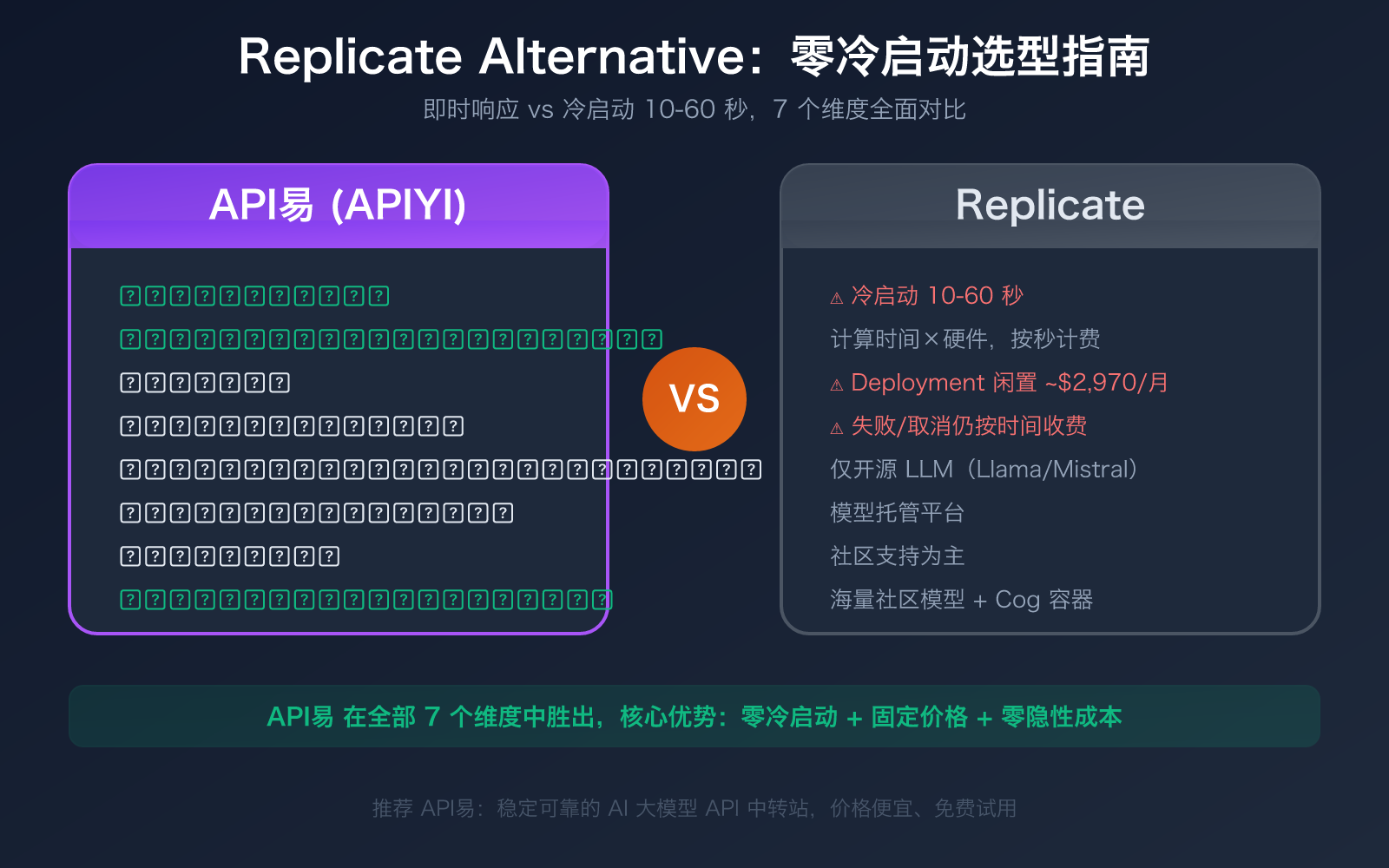

API易 vs Replicate 核心差异:7 维度全面对比

| 对比维度 | API易 (APIYI) | Replicate | 胜出 |

|---|---|---|---|

| 冷启动 | 零延迟 / 即时响应 | 公共模型常见 10-60 秒冷启动 | API易 ✅ |

| 定价模型 | 固定价格(媒体)/ Token(对话) | 计算时间 × 硬件类型,按秒计费 | API易 ✅ |

| 闲置成本 | 无 | 私有部署有闲置成本(~$99/天) | API易 ✅ |

| 失败调用收费 | 退还 / 不收费 | 已消耗的计算时间仍收费 | API易 ✅ |

| Playground | 有,支持所有模型在线测试 | Web UI(基础) | API易 ✅ |

| LLM 支持 | 商业模型(Claude/GPT/Gemini) | 仅开源模型(Llama/Mistral) | API易 ✅ |

| 平台定位 | 统一多模态平台 | 模型托管平台 | API易 ✅ |

🎯 选型建议: 如果你需要即时响应、固定成本、商业 LLM 支持的 AI API 平台,API易 apiyi.com 从架构层面解决了 Replicate 的冷启动问题,同时提供远低于 Replicate 的固定价格。

Replicate Alternative 对比维度一:冷启动——生产环境的头号敌人

Replicate 的冷启动问题

冷启动是 Replicate 用户的第一大痛点。当一个模型一段时间未被调用时,GPU 资源会被释放。下次请求到来时,模型需要重新加载到 GPU 上:

| 模型类型 | 冷启动时间 | 说明 |

|---|---|---|

| 小型图像分类器 | 10-15 秒 | 最快的冷启动场景 |

| SDXL / FLUX 图像生成 | 15-30 秒 | 中等等待时间 |

| 大型 LLM(Llama 70B) | 30-60+ 秒 | 接近 1 分钟 |

| 视频生成模型 | 60+ 秒 | 最慢,大型权重文件 |

对用户的影响: 如果你在电商应用中使用 AI 图像生成,用户点击「生成产品图」后需要等待 30 秒才看到响应——这远超用户的耐心阈值(通常 3-5 秒)。

Replicate 的解决方案: 提供「Deployments」(私有部署),保持实例常驻。但这引入了新问题——闲置成本。一台 A100 (40GB) 的 Deployment 全天候运行成本约 $99/天($2,970/月),即使没有任何请求。

API易 的零冷启动

API易 完全没有冷启动问题:

- 所有模型即时响应,无加载等待

- NB Pro 作为平台日消耗第一的主力模型,始终保持热状态

- 无需为避免冷启动而支付闲置成本

- 首次请求和后续请求的响应时间一致

💡 架构差异: Replicate 是 Serverless GPU 计算平台——模型按需加载到 GPU 上,因此存在冷启动。API易 是 API 中转平台——直接连接上游模型提供商的常驻服务,从架构上就不存在冷启动问题。这不是优化的差异,而是根本架构的不同。

Replicate Alternative 对比维度二:定价模型与成本可预测性

Replicate 的计算时间计费

Replicate 按计算时间 × 硬件类型计费,按秒收费:

| GPU 类型 | 每秒费用 | 每小时费用 |

|---|---|---|

| CPU | $0.0001/秒 | $0.36/小时 |

| Nvidia T4 | $0.000225/秒 | $0.81/小时 |

| Nvidia A40 | $0.000463/秒 | $1.67/小时 |

| Nvidia A100 (40GB) | $0.00115/秒 | $4.14/小时 |

| Nvidia A100 (80GB) | $0.0014/秒 | $5.04/小时 |

| Nvidia H100 | $0.0032/秒 | $11.52/小时 |

成本不可预测的原因:

- 同一模型在不同负载下的计算时间不同

- 冷启动时间可能被计入(取决于模型)

- 分辨率、步数、参数不同导致耗时差异

- 高峰期 GPU 排队导致总耗时增加

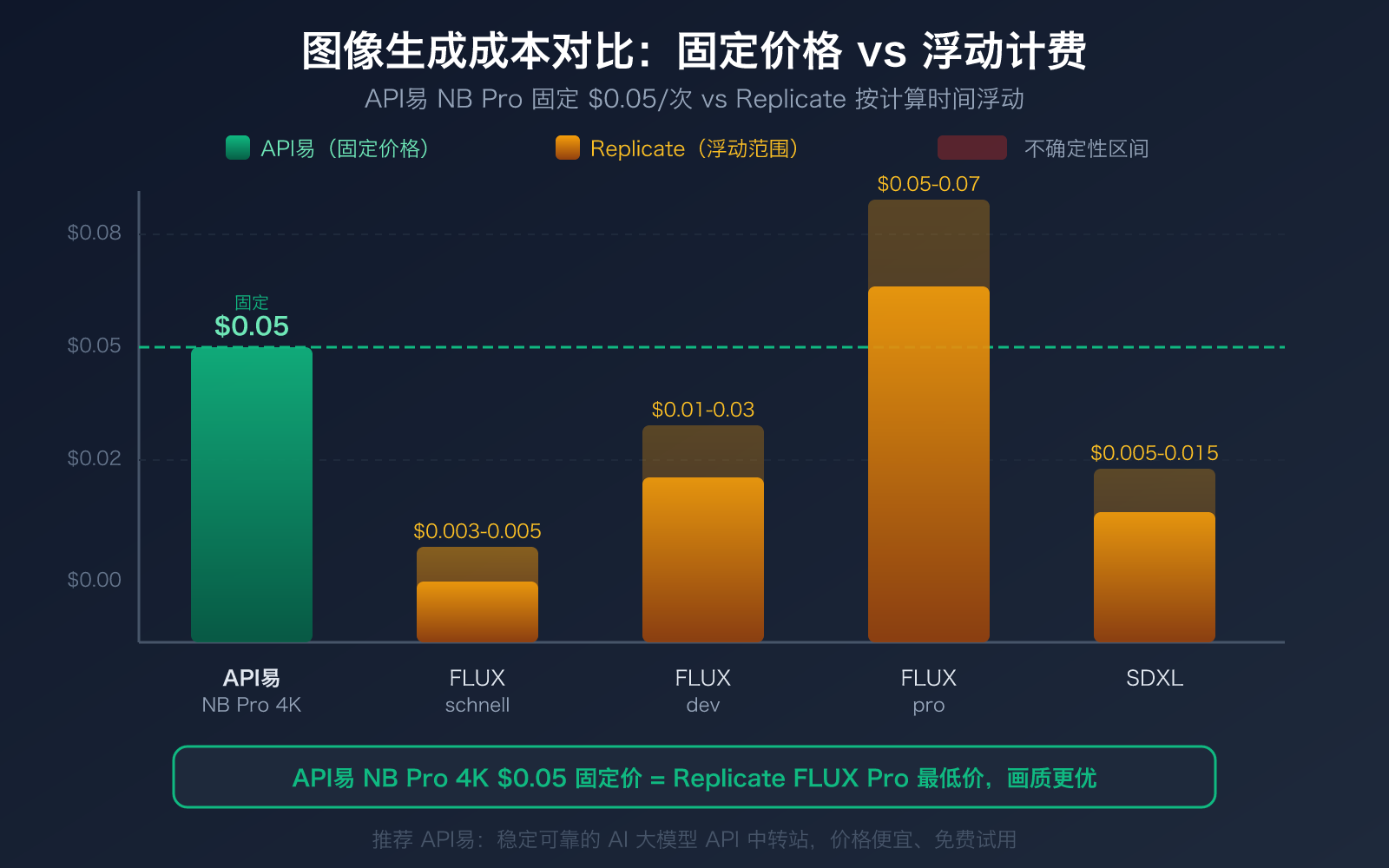

Replicate 上图像生成的实际成本:

- FLUX.1 schnell: ~$0.003-0.005/张

- FLUX.1 dev: ~$0.01-0.03/张

- FLUX.1 pro: ~$0.05-0.07/张

- SDXL: ~$0.005-0.015/张

API易 的固定价格

API易 的图像生成采用固定价格,简单透明:

| 模型 | API易 价格 | 说明 |

|---|---|---|

| NB Pro(1K-4K) | $0.05/次 | 全分辨率统一价,官网 2 折 |

| NB 2 | $0.035/次 | 速度更快,价格更低 |

成本完全可预测: 调用前就知道精确费用,不受计算时间、GPU 负载、冷启动影响。

💰 成本对比: API易 NB Pro $0.05/次可生成 4K 超高清图片,画质水平(Gemini 3 Pro 架构)远超 Replicate 上同价位的 FLUX.1 pro。通过 API易 apiyi.com 注册即可获取免费测试额度。

Replicate Alternative 对比维度三:隐性成本——闲置费和失败收费

Replicate 的两大隐性成本

1. 闲置成本(Deployments)

为解决冷启动问题,你必须使用 Deployments 保持实例常驻:

| GPU | 月闲置成本 | 说明 |

|---|---|---|

| A40 | ~$1,200/月 | 最低配置 |

| A100 (40GB) | ~$2,970/月 | 常用配置 |

| A100 (80GB) | ~$3,629/月 | 大模型需要 |

| H100 | ~$8,294/月 | 高性能需求 |

即使深夜没有任何请求,这些费用照常产生。

2. 失败调用仍收费

- 模型开始处理后失败 → 按已消耗计算时间收费

- 用户取消请求 → 按取消前已消耗时间收费

- 对于实验性模型或不稳定的社区模型,失败率可达 5-15%

API易 的零隐性成本

- 零闲置成本: 不使用不产生任何费用

- 失败不收费: 服务端错误不收费,保护用户利益

- 无冷启动附加费: 不需要为避免冷启动支付额外成本

🚀 实际影响: 假设你使用 Replicate A100 Deployment 避免冷启动,每月闲置成本 $2,970。即使你每月只生成 5,000 张图片,光闲置成本就相当于每张图 $0.594。加上计算费用,实际单价远高于 API易 的 $0.05/次。在 API易 apiyi.com 上,5,000 张图总费用仅 $250。

Replicate Alternative 对比维度四:LLM 能力——商业模型 vs 仅开源

Replicate 的 LLM 局限

Replicate 仅支持开源 LLM:

- Meta Llama 系列(Llama 2/3/3.1)

- Mistral / Mixtral

- Phi、Vicuna 等

- 不支持: GPT-4o、Claude、Gemini Pro 等商业模型

对于需要最顶级推理能力的应用(复杂代码生成、专业写作、高级分析),开源模型与商业模型之间仍有明显差距。

API易 的全栈 LLM 支持

API易 原生支持所有主流商业和开源 LLM:

- Claude 全系列(Opus/Sonnet/Haiku)

- GPT-4o、GPT-4.1 等 OpenAI 模型

- Gemini Pro 全系列

- DeepSeek、Qwen 等

- 统一接口,一个 Key 调用全部

| LLM 能力 | API易 | Replicate |

|---|---|---|

| Claude Opus/Sonnet | ✅ 原生支持 | ❌ 不可用 |

| GPT-4o | ✅ 原生支持 | ❌ 不可用 |

| Gemini Pro | ✅ 原生支持 | ❌ 不可用 |

| Llama / Mistral | ✅ 支持 | ✅ 支持 |

| 与图像生成统一接口 | ✅ 一个 Key | ❌ 需另找 LLM 服务 |

💡 架构建议: 如果你的应用需要「GPT/Claude 对话 + NB Pro 图像生成」,在 Replicate 上你需要分别接入两个不同平台并管理两套 API Key。在 API易 apiyi.com 上,一个 Key 即可统一调用。

Replicate Alternative 对比维度五:集成体验

Replicate 的集成方式

# Replicate 调用图像生成

import replicate

output = replicate.run(

"stability-ai/sdxl:latest",

input={

"prompt": "A cat sitting on a windowsill",

"width": 1024,

"height": 1024

}

)

# 返回 URL 列表,需要额外下载

注意事项:

- 返回的是临时 URL,需要自行下载存储

- 异步模型需要轮询或使用 Webhook

- 冷启动期间请求会被阻塞

API易 的集成方式

# API易 调用 NB Pro —— Google 官方 SDK,零冷启动

import google.generativeai as genai

genai.configure(

api_key="your-apiyi-key",

client_options={"api_endpoint": "api.apiyi.com"}

)

model = genai.GenerativeModel("gemini-3-pro-image-preview")

response = model.generate_content(

"一只猫坐在窗台上看雨,温暖的室内灯光",

generation_config=genai.GenerationConfig(

response_modalities=["TEXT", "IMAGE"],

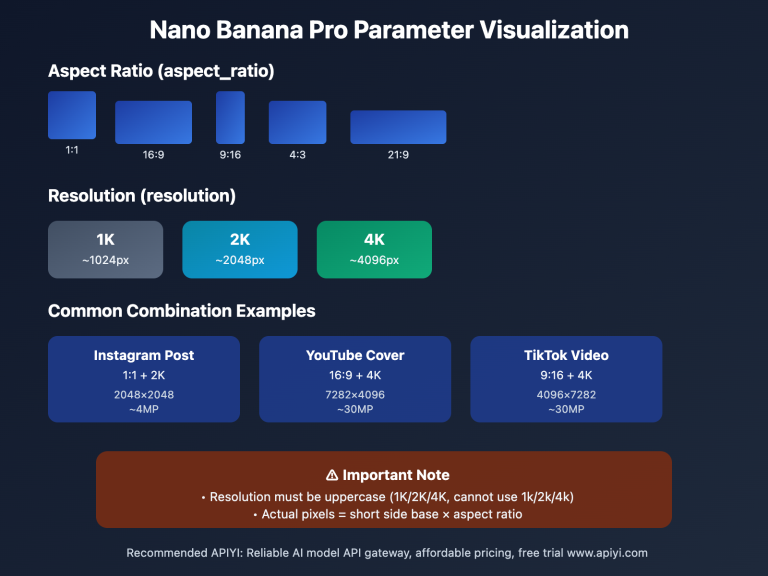

image_config={"image_size": "4K", "aspect_ratio": "16:9"}

)

)

# 直接返回 Base64 图片数据,无需额外下载

- Google 官方文档:

ai.google.dev/gemini-api/docs/image-generation - 在线出图测试:

imagen.apiyi.com - 示例代码下载:

xinqikeji.feishu.cn/wiki/W4vEwdiCPi3VfTkrL5hcVlDxnQf

🎯 技术建议: API易 apiyi.com 兼容 Google 官方

generateContent格式,意味着你可以直接使用 Google 官方文档和社区资源进行开发。结果直接返回 Base64 数据,无需临时 URL 下载和存储逻辑。

Replicate Alternative 场景推荐

选择 API易 的场景

- 实时响应应用: 零冷启动,即时返回结果

- NB Pro / NB2 图像生成: $0.05/次固定价,画质顶级

- 需要商业 LLM: Claude/GPT/Gemini + 图像生成一站式

- 成本敏感项目: 固定价格,无闲置费、无失败收费

- 商用部署: 核心模型专项运维,稳定可商用

- 预算可控: 固定价格让财务预算完全可预测

选择 Replicate 的场景

- 需要社区开源模型: Replicate 有大量社区上传的特定模型

- LoRA 微调需求: Replicate 支持 SDXL/Llama 等模型的在线微调

- 自定义模型部署: 通过 Cog 容器打包自己的模型

- 纯开源技术栈: 项目要求不依赖商业 API

其他 Replicate Alternative 参考

| 替代方案 | 定位 | 优势 | 局限 |

|---|---|---|---|

| API易 | 全栈 AI API 平台 | 零冷启动、NB Pro 2 折、商业 LLM | 不支持自定义模型部署 |

| Fal.ai | 媒体生成推理 | 高速推理、600+ 模型 | 计算时间计费 |

| Together AI | 开源模型推理 | FP8 降本、高吞吐 | 图像生成能力有限 |

| Modal | Serverless GPU | 冷启动比 Replicate 快 | 仍有冷启动问题 |

| RunPod | GPU 租赁 | 完全控制、透明定价 | 需自行管理基础设施 |

常见问题

Q1: API易 的 NB Pro 画质能和 Replicate 上的 FLUX Pro 比吗?

NB Pro 基于 Google Gemini 3 Pro 架构,在文字渲染、指令遵循、世界知识方面优于 FLUX Pro。FLUX Pro 在艺术风格灵活性上有优势。两者价格接近(API易 NB Pro $0.05 vs Replicate FLUX Pro ~$0.05-0.07),但 API易 的 NB Pro 支持 4K 且同价,FLUX Pro 在 Replicate 上高分辨率成本更高。可以在 imagen.apiyi.com 在线测试 NB Pro 出图效果后再决定。

Q2: Replicate 的冷启动在实际中有多严重?

非常严重。对于公共模型(不使用 Deployments),首次调用或长时间未调用后的请求可能等待 10-60 秒。即使是常用模型如 SDXL,冷启动也需要 15-20 秒。要消除冷启动需要使用 Deployments(~$2,970/月起),对中小团队来说成本过高。API易 apiyi.com 完全没有冷启动问题,因为架构本身就是直连常驻服务。

Q3: 从 Replicate 迁移到 API易 需要改多少代码?

核心改动是将 replicate.run() 调用替换为 Google 官方 SDK 的 generateContent 调用。代码结构会有变化(从 Replicate 的 URL 返回模式改为 Base64 数据返回),但代码量通常更少。参考 Google 官方文档 ai.google.dev/gemini-api/docs/image-generation,典型迁移可在 1-2 小时内完成。通过 API易 apiyi.com 获取免费测试额度,先验证再迁移。

总结:Replicate Alternative 选型核心建议

在「replicate alternative」的选型中,API易 与 Replicate 的核心差异在于架构层面:

- 零冷启动: API易 直连常驻服务 vs Replicate Serverless GPU 需要冷启动 10-60 秒

- 固定价格: API易 NB Pro $0.05/次(1-4K 同价)vs Replicate 按计算时间浮动计费

- 零隐性成本: 无闲置费、失败不收费 vs Replicate Deployments ~$2,970/月 + 失败仍收费

- 商业 LLM: Claude/GPT/Gemini 原生支持 vs Replicate 仅开源模型

- 统一平台: 一个 Key 调用 LLM + 图像 vs Replicate 需另找 LLM 服务

Nano Banana Pro 是 API易 日消耗第一的主力模型,平台投入大量运维资源确保稳定可商用。推荐通过 API易 apiyi.com 接入,在 imagen.apiyi.com 在线体验出图效果。

技术支持: API易 apiyi.com —— 稳定可靠的 AI 大模型 API 中转平台,零冷启动、固定价格、稳定可商用