Catatan Penulis: Model gpt-5.4-nano termurah dari OpenAI hanya dibanderol $0,20/$1,25. Dengan skor τ2-Bench 92,5%, performanya hampir menyamai versi mini. Artikel ini mengulas secara mendalam 7 skenario aplikasi yang paling cocok untuk nano, kapan harus beralih ke mini, serta strategi optimasi ekstrem dengan diskon cache 90%.

Jika aplikasi Anda memiliki lebih dari sepuluh ribu pemanggilan per hari, atau Anda sedang memilih model untuk tugas dengan throughput tinggi seperti layanan pelanggan, klasifikasi, atau perutean RAG, Anda mungkin memperhatikan bahwa OpenAI telah menekan "harga dasar" seri GPT-5.4 ke level terendah baru — gpt-5.4-nano, $0,20 untuk input / $1,25 untuk output per 1 juta token, inputnya 3,75 kali lebih murah daripada 5.4-mini.

Ini bukan sekadar "model murah versi sunat". Benchmark yang dirilis OpenAI menunjukkan bahwa nano mencapai 92,5% dalam pemanggilan alat (τ2-Bench), hampir menyamai 93,4% milik mini; dan meraih 82,8% dalam tanya jawab pengetahuan umum (GPQA Diamond), hanya terpaut 5,2 poin persentase dari mini. Ini berarti untuk banyak skenario "throughput tinggi + kompleksitas rendah", nano adalah solusi optimal yang sesungguhnya.

Nilai Inti: Artikel ini membahas 7 skenario aplikasi spesifik, menjelaskan secara rinci tugas mana yang "cukup dan lebih murah" dengan nano, tugas mana yang "wajib menggunakan mini", serta menyertakan cuplikan kode dan estimasi biaya untuk setiap skenario.

Poin Utama Skenario Aplikasi GPT-5.4 nano

| Poin | Penjelasan | Nilai |

|---|---|---|

| Harga Sangat Murah | $0,20 / $1,25 per 1 juta token | 3,75x lebih murah dari 5.4-mini |

| Cache -90% | Input cache hanya $0,02 / 1 juta | Hampir gratis untuk konteks frekuensi tinggi |

| Pemanggilan Alat Mendekati mini | τ2-Bench 92,5% vs mini 93,4% | Cukup untuk sebagian besar skenario Tool Use |

| Tanya Jawab Kuat | GPQA Diamond 82,8% | Kompeten untuk FAQ umum & pencarian pengetahuan |

| Konteks Panjang 400K | Input 400K + Output 128K | Pemrosesan batch dokumen panjang tanpa hambatan |

| Kecepatan Unggul | ~200 t/s, 10% lebih cepat dari mini | Pilihan utama untuk pipeline throughput tinggi |

Cara Menentukan "Ambang Batas Kecukupan" GPT-5.4 nano

Untuk menentukan apakah nano sudah cukup, Anda bisa menggunakan "Metode Tiga Kategori" yang sederhana:

Zona Hijau (Gunakan nano dengan percaya diri): Pemanggilan alat, ekstraksi terstruktur, anotasi klasifikasi, tanya jawab pengetahuan, perutean konten, terjemahan/ringkasan batch — untuk tugas-tugas ini, selisih skor nano dengan mini kurang dari 10 poin persentase, keunggulan harga benar-benar mengalahkan selisih kemampuan.

Zona Kuning (Evaluasi dengan hati-hati): Penalaran multi-langkah yang kompleks, orkestrasi agen rantai panjang, pembuatan kode — SWE-Bench Pro 52,4% masih mampu menangani, namun disarankan untuk menjalankan pengujian AB dengan nano terlebih dahulu sebelum memutuskan.

Zona Merah (Langsung gunakan mini): Computer Use (nano OSWorld hanya 39%), tugas panjang Terminal (46,3% cukup lemah), skenario kustom yang memerlukan Fine-tuning — dalam skenario ini, performa nano jelas tidak memadai, langsung pilih mini atau versi standar.

Skenario Aplikasi GPT-5.4 nano 1: Klasifikasi Real-time

Deskripsi Skenario

Klasifikasi real-time adalah aplikasi paling klasik untuk nano, mencakup analisis sentimen, pengenalan niat, pelabelan topik, penandaan moderasi konten, dan banyak lagi. Tugas-tugas seperti ini biasanya hanya memerlukan beberapa ratus token input dan puluhan token output per pemanggilan, sehingga sangat sensitif terhadap latensi dan biaya.

Contoh Kode Sederhana

import openai

import json

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

def classify_intent(user_query: str) -> dict:

"""Mengklasifikasikan niat kueri pengguna"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Anda adalah pengklasifikasi niat. Kembalikan format JSON: {intent, confidence, sub_category}"},

{"role": "user", "content": user_query}

],

response_format={"type": "json_object"}

)

return json.loads(response.choices[0].message.content)

# Penggunaan

result = classify_intent("Saya ingin membatalkan pesanan minggu lalu")

# {"intent": "refund_request", "confidence": 0.95, "sub_category": "subscription_cancel"}

Estimasi Biaya

| Skala Skenario | Biaya per Pemanggilan | Biaya Harian (100.000 kali) |

|---|---|---|

| Layanan Pelanggan Dasar(50 Input + 20 Output) | $0.000035 | $3.5 |

| SaaS Menengah(200 Input + 30 Output) | $0.000078 | $7.8 |

| Skala Perusahaan(500 Input + 50 Output) | $0.000163 | $16.3 |

💡 Saran Optimasi: Letakkan label klasifikasi dan contoh dalam petunjuk sistem (system prompt). Setelah mengaktifkan cache, biaya input dapat ditekan hingga 90% lebih lanjut. Saat melakukan pemanggilan melalui APIYI apiyi.com, diskon cache akan disinkronkan sepenuhnya.

Skenario Aplikasi GPT-5.4 nano 2: Ekstraksi Data

Deskripsi Skenario

Mengekstrak bidang terstruktur dari teks tidak terstruktur (seperti resume, kontrak, berita, atau email). Ini adalah keunggulan nano — dipadukan dengan Structured Outputs (batasan ketat JSON Schema), Anda bisa mencapai tingkat akurasi format hingga 99%+.

Kode Praktis

from pydantic import BaseModel

from typing import Optional

class ContactInfo(BaseModel):

name: str

email: Optional[str]

phone: Optional[str]

company: Optional[str]

role: Optional[str]

def extract_contact(text: str) -> ContactInfo:

response = client.beta.chat.completions.parse(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Ekstrak informasi kontak, kembalikan null untuk bidang yang hilang"},

{"role": "user", "content": text}

],

response_format=ContactInfo

)

return response.choices[0].message.parsed

Daftar Tugas Ekstraksi yang Cocok untuk nano

- Ekstraksi bidang kunci pada resume/CV

- Pengenalan angka pada faktur/kuitansi

- Penguraian blok tanda tangan email

- Pengenalan entitas berita (nama orang, lokasi, organisasi)

- Normalisasi data formulir

- Klasifikasi peristiwa log

GPT-5.4 nano Skenario Aplikasi 3: Pengurutan Konten

Deskripsi Skenario

Melakukan pengurutan ulang (reranking) pada hasil pencarian, daftar rekomendasi, dan antrean pesan. Biaya rendah dari nano membuat penggunaan "LLM sebagai reranker" menjadi layak secara ekonomi dalam lingkungan produksi.

Contoh Kode Pengurutan Ulang

def rerank_documents(query: str, candidates: list[str], top_k: int = 5) -> list:

"""Mengurutkan ulang dokumen kandidat berdasarkan relevansi kueri"""

docs_text = "\n".join([f"[{i}] {doc[:300]}" for i, doc in enumerate(candidates)])

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{

"role": "user",

"content": f"""Urutkan dokumen berikut berdasarkan relevansi dengan kueri "{query}".

Dokumen:

{docs_text}

Kembalikan JSON: {{"ranking": [daftar indeks dokumen, dari yang paling relevan ke yang paling tidak relevan]}}"""

}],

response_format={"type": "json_object"}

)

ranking = json.loads(response.choices[0].message.content)["ranking"]

return [candidates[i] for i in ranking[:top_k]]

🎯 Saran Skenario: Pengurutan ulang dengan nano memiliki akurasi yang lebih tinggi dibandingkan reranker tradisional berbasis BM25 + pencarian vektor, namun biayanya hanya 27% dari GPT-5.4-mini. Anda dapat mengaksesnya langsung melalui APIYI di apiyi.com, grup Default tidak memerlukan pengajuan apa pun.

GPT-5.4 nano Skenario Aplikasi 4: Lapisan Eksekusi Sub-agent

Deskripsi Skenario

Dalam arsitektur multi-Agent, Agent utama (biasanya menggunakan versi mini atau standar) bertanggung jawab atas perencanaan, sementara Sub-agent (pekerja eksekusi) bertanggung jawab atas pemanggilan alat, kueri data, dan pembaruan status secara spesifik. Skor 92,5% yang diraih nano pada τ2-Bench membuatnya sangat mumpuni untuk berperan sebagai pekerja (worker).

Contoh Kolaborasi Multi-Agent

def execute_subtask(task: dict, available_tools: list) -> dict:

"""nano sebagai Sub-agent untuk mengeksekusi sub-tugas tunggal"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": f"Anda adalah pekerja eksekusi. Alat yang tersedia: {available_tools}"},

{"role": "user", "content": f"Jalankan tugas: {task['description']}"}

],

tools=task.get("tools", []),

tool_choice="auto"

)

return {

"task_id": task["id"],

"result": response.choices[0].message.content,

"tool_calls": response.choices[0].message.tool_calls

}

# Agent utama menggunakan mini, Sub-agent menggunakan nano —— penghematan biaya 60%+

Skenario Aplikasi GPT-5.4 nano 5: Lapisan Perutean RAG

Deskripsi Skenario

Dalam sistem RAG, nano berperan sebagai "lapisan perutean" untuk menentukan jenis kueri (pertanyaan teknis / konsultasi pra-penjualan / umpan balik produk / obrolan santai) dan mendistribusikannya ke pemroses yang berbeda. Desain ini memastikan model mini/standar yang lebih mahal hanya dipanggil saat benar-benar diperlukan.

Contoh Perutean RAG

def route_query(query: str) -> str:

"""nano menentukan rute kueri ke pemroses RAG yang mana"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": """Kembalikan label rute berdasarkan jenis kueri:

- "technical_docs": Kueri dokumentasi teknis

- "product_faq": FAQ produk

- "code_help": Bantuan kode

- "small_talk": Obrolan santai (tidak perlu RAG)

- "complex_reasoning": Penalaran kompleks (alihkan ke mini/standar)"""},

{"role": "user", "content": query}

],

max_tokens=20

)

return response.choices[0].message.content.strip()

route = route_query(user_input)

if route == "complex_reasoning":

final_model = "gpt-5.4-mini" # Tingkatkan ke mini

else:

final_model = "gpt-5.4-nano" # Tetap gunakan nano

💰 Optimasi Biaya: Arsitektur "perutean nano + pemrosesan mini/standar" ini biasanya dapat menurunkan biaya pemanggilan keseluruhan sebesar 60-80%. Anda dapat beralih antar kedua model secara fleksibel di bawah satu kunci API yang sama melalui APIYI apiyi.com, cukup dengan mengubah parameter model.

Skenario Aplikasi GPT-5.4 nano 6: Ringkasan dan Terjemahan Throughput Tinggi

Deskripsi Skenario

Memproses tugas secara batch seperti ringkasan berita, terjemahan dokumen, dan penulisan ulang komentar. Dengan dukungan jendela konteks 400K, nano dapat memproses seluruh dokumen panjang sekaligus, dengan biaya per item yang hampir bisa diabaikan.

Contoh Batch API

# Menyiapkan tugas batch

batch_requests = []

for doc_id, content in documents.items():

batch_requests.append({

"custom_id": f"summary-{doc_id}",

"method": "POST",

"url": "/v1/chat/completions",

"body": {

"model": "gpt-5.4-nano",

"messages": [

{"role": "system", "content": "Ringkas konten berikut dalam 100 kata"},

{"role": "user", "content": content}

],

"max_tokens": 200

}

})

# Mengirimkan Batch API (harga sama tetapi tidak memakan kuota online)

batch = client.batches.create(

input_file_id=file_id,

endpoint="/v1/chat/completions",

completion_window="24h"

)

Skenario Aplikasi GPT-5.4 nano 7: Penggunaan Alat (Tool Use)

Deskripsi Skenario

Pada τ2-Bench, model nano meraih skor 92,5%, hampir menyamai skor 93,4% milik model mini. Untuk skenario pemanggilan fungsi (function calling) yang terstandarisasi seperti "cek cuaca, cek pesanan, atau cek dokumen", model nano sudah sangat mumpuni.

Contoh Function Calling

tools = [{

"type": "function",

"function": {

"name": "get_order_status",

"description": "Mengecek status pesanan",

"parameters": {

"type": "object",

"properties": {

"order_id": {"type": "string"}

},

"required": ["order_id"]

}

}

}]

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{"role": "user", "content": "Bagaimana status pesanan saya #12345?"}],

tools=tools,

tool_choice="auto"

)

# nano secara akurat mengidentifikasi perlunya memanggil get_order_status dan mengekstrak order_id="12345"

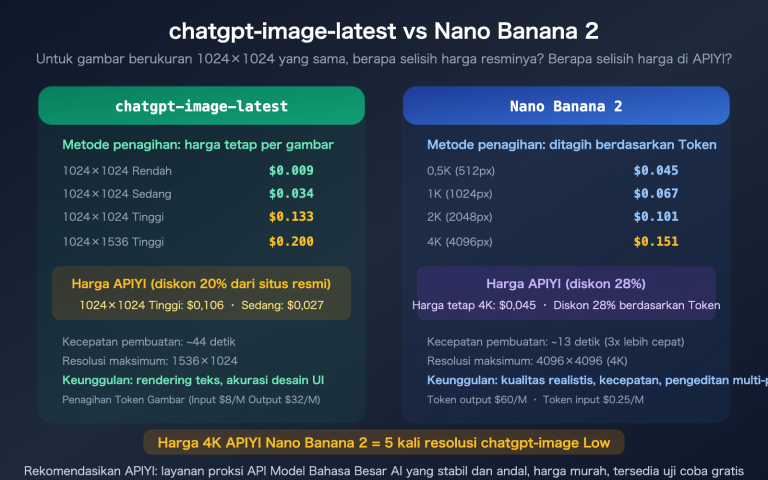

Penjelasan Harga GPT-5.4 nano

Struktur Harga Resmi

| Jenis Penagihan | Harga (per 1M token) | Keterangan |

|---|---|---|

| Input | $0,20 | Harga standar |

| Input Cache | $0,02 | Diskon 90% |

| Output | $1,25 | Termasuk token penalaran |

| Batch API | $0,20 / $1,25 | Harga sama, tidak memotong kuota online |

| Residensi Data Regional | +10% | Untuk skenario kepatuhan data |

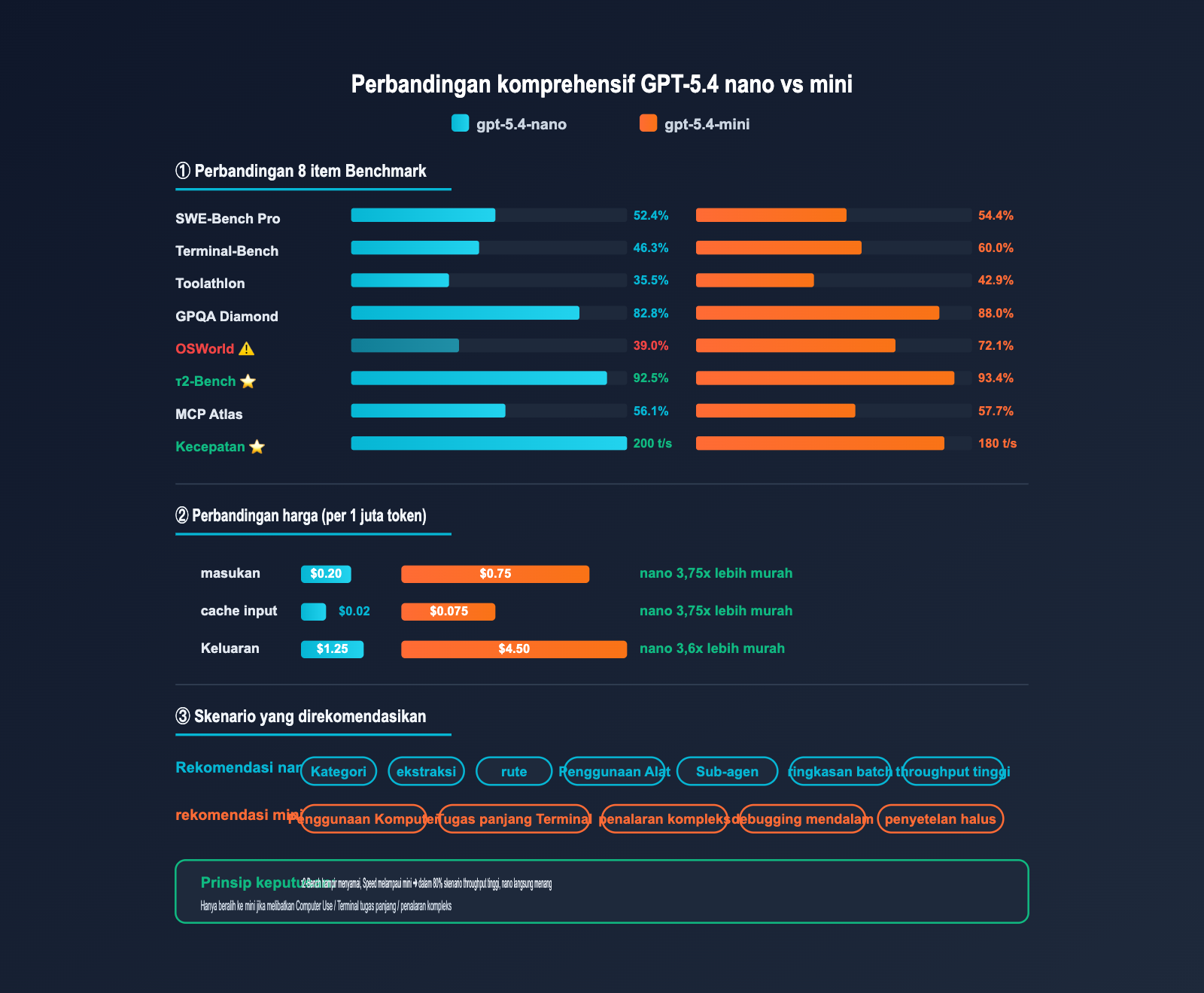

Perbandingan Harga nano vs mini

| Dimensi | gpt-5.4-nano | gpt-5.4-mini | Kelipatan |

|---|---|---|---|

| Input | $0,20 | $0,75 | nano lebih murah 3,75x |

| Input Cache | $0,02 | $0,075 | nano lebih murah 3,75x |

| Output | $1,25 | $4,50 | nano lebih murah 3,6x |

| Kecepatan Respon | ~200 t/s | ~180 t/s | nano sekitar 10% lebih cepat |

| Konteks | 400K | 400K | Setara |

| Output Maksimum | 128K | 128K | Setara |

💰 Optimasi Biaya: Untuk skenario dengan throughput tinggi mencapai jutaan permintaan per hari, selisih harga antara nano dan mini bisa mencapai ribuan dolar AS per bulan. Dengan mengakses melalui APIYI (apiyi.com), Anda juga bisa menikmati bonus 10% untuk isi ulang 100 dolar AS, yang setara dengan diskon 15% dari harga resmi, sehingga total biaya bisa hingga 25% lebih murah dibandingkan harga resmi.

Perbandingan Komprehensif Benchmark GPT-5.4 nano vs mini

| Dimensi Benchmark | gpt-5.4-nano | gpt-5.4-mini | Selisih | Apakah nano cukup? |

|---|---|---|---|---|

| SWE-Bench Pro | 52.4% | 54.4% | -2.0pp | ✅ Hampir setara |

| Terminal-Bench 2.0 | 46.3% | 60.0% | -13.7pp | ⚠️ Gunakan mini untuk tugas panjang |

| Toolathlon | 35.5% | 42.9% | -7.4pp | ✅ Cukup untuk skenario umum |

| GPQA Diamond | 82.8% | 88.0% | -5.2pp | ✅ Mumpuni untuk tanya jawab pengetahuan |

| OSWorld-Verified | 39.0% | 72.1% | -33.1pp | ❌ Wajib gunakan mini untuk Computer Use |

| τ2-Bench(Tool Use) | 92.5% | 93.4% | -0.9pp | ✅ Hampir menyamai |

| MCP Atlas | 56.1% | 57.7% | -1.6pp | ✅ Hampir setara |

| Kecepatan Respons | ~200 t/s | ~180 t/s | +10% | ✅ nano justru lebih cepat |

Saran Pengambilan Keputusan

Kapan sebaiknya memprioritaskan nano:

- Tugas termasuk dalam "zona hijau" (klasifikasi, ekstraksi, pengurutan, perutean, penggunaan alat, pemrosesan batch)

- Volume pemanggilan > 10 ribu/hari, sensitif terhadap biaya

- Membutuhkan respons latensi rendah < 1 detik

- Lapisan eksekusi sub-agen (agen utama menggunakan mini, pekerja menggunakan nano)

Kapan sebaiknya beralih ke mini:

- Melibatkan Computer Use (perbedaan krusial pada OSWorld)

- Tugas terminal yang panjang (>10 langkah operasi)

- Membutuhkan penalaran multi-langkah yang kompleks atau debugging kode mendalam

- Kualitas tugas lebih diutamakan daripada biaya

📊 Saran: Dalam 80% skenario "throughput tinggi + kompleksitas rendah", efektivitas biaya nano jauh melampaui mini. Anda dapat menggunakan layanan proksi API APIYI (apiyi.com) untuk membandingkan performa kedua model secara langsung pada tugas spesifik Anda, cukup dengan mengubah parameter model.

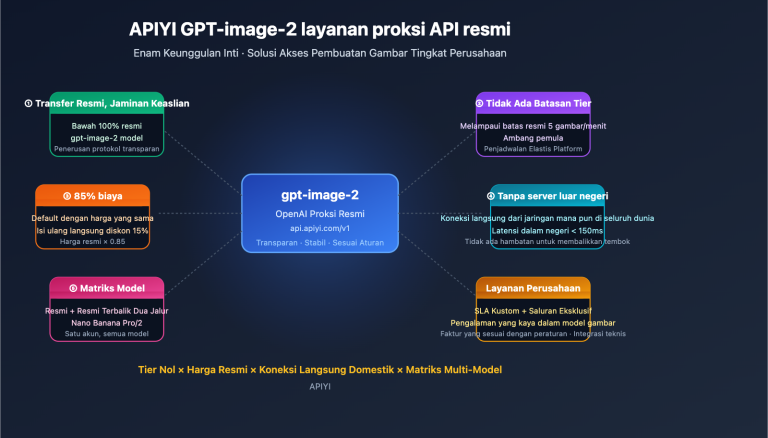

Panduan Integrasi GPT-5.4 nano di APIYI

Grup Default Langsung Tersedia

Platform APIYI menerapkan kebijakan akses yang sama untuk GPT-5.4 nano dan 5.4-mini:

- ✅ Grup Default: Terbuka sepenuhnya, dapat langsung digunakan oleh pengguna baru setelah mendaftar.

- ✅ Grup SVIP: Terbuka sepenuhnya, tanpa batasan apa pun.

- ✅ Sinkronisasi Diskon Cache: Harga cache $0,02/1M token berlaku sepenuhnya.

- ✅ Sinkronisasi Batch API: Tugas batch juga menikmati harga yang sama.

Perbandingan Biaya: APIYI vs Situs Resmi

| Item | Situs Resmi OpenAI | APIYI apiyi.com |

|---|---|---|

| Harga Dasar | $0,20 / $1,25 per 1M | $0,20 / $1,25 per 1M (Sama) |

| Diskon Cache | $0,02 / 1M (90%) | $0,02 / 1M (Sinkronisasi penuh) |

| Bonus Isi Saldo | Tidak ada | Isi $100 dapat $10 (10%) |

| Biaya Aktual | 100% harga standar | Sekitar 90% harga standar (diskon ~15%) |

| Akses Domestik | Perlu VPN | Koneksi langsung, tanpa VPN |

| Metode Pembayaran | Kartu Kredit Internasional | Mendukung Rupiah, Alipay, WeChat |

| Kompatibilitas SDK | Native OpenAI | Kompatibel penuh dengan SDK OpenAI |

| Minimum Isi Saldo | $5 | Mulai dari $1 |

💰 Optimasi Biaya: Untuk aplikasi dengan volume pemanggilan di atas jutaan per bulan, integrasi nano melalui APIYI apiyi.com memungkinkan Anda mendapatkan diskon 15% dari harga resmi ditambah optimasi cache, sehingga total biaya bisa 25-35% lebih rendah dibandingkan memanggil langsung ke situs resmi OpenAI.

FAQ (Pertanyaan yang Sering Diajukan)

Q1: Apa itu gpt-5.4-nano? Apa perbedaan utamanya dengan gpt-5.4-mini?

GPT-5.4-nano adalah model ringan termurah dan tercepat dalam seri GPT-5.4 OpenAI ($0,20/$1,25 per 1M token), dengan kecepatan respons sekitar 200 t/s. Perbedaan utama dengan 5.4-mini: 1) Harga 3,6-3,75 kali lebih murah; 2) Kemampuan Computer Use (OSWorld 39% vs 72,1%) dan tugas panjang Terminal (46,3% vs 60%) jauh lebih lemah; 3) Skenario lain (klasifikasi, ekstraksi, penggunaan alat, tanya jawab pengetahuan) biasanya memiliki selisih performa < 10pp.

Q2: Skenario aplikasi apa yang paling cocok untuk nano? Skenario mana yang wajib menggunakan mini?

Cocok untuk nano (Zona Hijau):

- Klasifikasi real-time (sentimen, niat, topik)

- Ekstraksi data terstruktur

- Pengurutan dan penyusunan ulang konten

- Lapisan eksekusi Sub-agent

- Lapisan perutean RAG

- Ringkasan/terjemahan throughput tinggi

- Pemanggilan alat standar (τ2-Bench 92,5%)

Wajib menggunakan mini (Zona Merah):

- Otomatisasi desktop Computer Use (selisih OSWorld 33pp)

- Tugas terminal panjang (>10 langkah)

- Penalaran multi-langkah yang kompleks

- Skenario khusus yang memerlukan Fine-tuning

Q3: Mengapa nano tidak direkomendasikan untuk Computer Use?

Dalam evaluasi OSWorld-Verified, skor nano hanya 39,0%, jauh di bawah 72,1% milik mini. Ini berarti tingkat kegagalan nano terlalu tinggi dalam operasi desktop multi-langkah (buka browser → cari → klik → isi formulir), sehingga tidak dapat menyelesaikan alur tugas dengan stabil. Jika skenario Anda memerlukan Computer Use, gunakanlah mini atau versi standar 5.4.

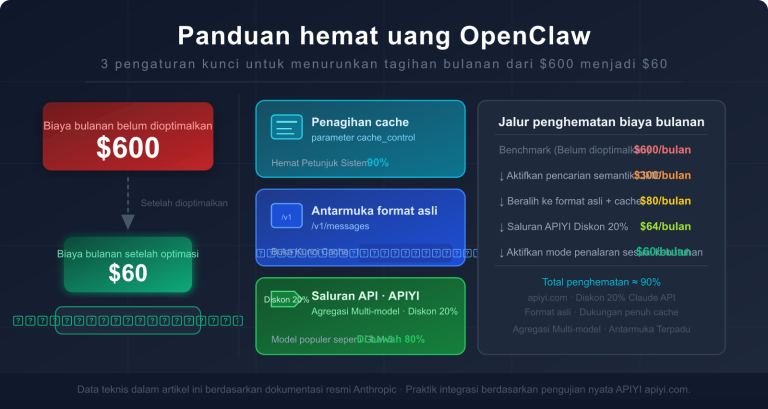

Q4: Bagaimana cara mengaktifkan diskon cache $0,02/1M untuk nano?

Mekanisme cache OpenAI terpicu secara otomatis, tanpa parameter tambahan. Cache akan aktif jika awalan prompt (biasanya system prompt + konteks bersama) sama dengan permintaan dalam 5-10 menit terakhir, sehingga mendapatkan diskon 90%.

Saran optimasi:

- Letakkan system prompt di bagian paling depan array messages.

- Ikuti dengan konteks bersama (label klasifikasi, definisi skema).

- Letakkan kueri pengguna di bagian akhir.

- Jaga frekuensi pemanggilan (akan kedaluwarsa setelah >5 menit).

Saat memanggil melalui APIYI apiyi.com, diskon cache disinkronkan sepenuhnya dengan situs resmi.

Q5: Apa praktik terbaik untuk menangani tugas batch dengan nano?

Tiga strategi kunci:

- Gunakan Batch API: Gunakan endpoint

/v1/batchesuntuk mengirimkan tugas batch. Selesai dalam 24 jam, harga tetap sama, dan tidak memakan kuota RPM online. - Bagikan system prompt: Gunakan instruksi yang sama untuk semua tugas agar memicu hit cache.

- Atur max_tokens yang wajar: Output nano memang murah, namun tetap terakumulasi. Atur batas maksimal 50-500 sesuai kebutuhan tugas.

Dengan mengirimkan tugas Batch melalui APIYI apiyi.com, Anda menikmati bonus isi saldo 10%, sehingga biaya aktual sekitar 15% lebih murah dari harga resmi.

Q6: Bagaimana cara memanggil GPT-5.4 nano melalui APIYI?

APIYI kompatibel penuh dengan SDK OpenAI, cukup tiga langkah:

- Kunjungi APIYI apiyi.com untuk mendaftar akun (tidak perlu pengajuan, Grup Default langsung tersedia).

- Dapatkan kunci API.

- Ubah

base_urldi kode Anda menjadihttps://vip.apiyi.com/v1, dan atur model kegpt-5.4-nano.

client = openai.OpenAI(

api_key="YOUR_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[...]

)

Isi saldo $100 dapat bonus 10%, setara dengan diskon sekitar 15% dari harga resmi, dengan diskon cache yang sinkron.

Q7: Kapan nano lebih hemat daripada mini? Bagaimana cara menghitungnya?

Rumus penilaian:

Kondisi hemat nano = (Toleransi penurunan kualitas tugas) × (Volume pemanggilan) × (Selisih harga)

> (Keuntungan peningkatan kualitas dari mini)

Skenario aktual:

- Volume > 10K/hari: Hemat > $30/hari ($1000/bulan)

- Volume > 100K/hari: Hemat > $300/hari ($9000/bulan)

- Volume > 1M/hari: Hemat > $3000/hari ($90000/bulan)

Untuk tugas zona hijau (klasifikasi, ekstraksi, penggunaan alat), penurunan kualitas nano biasanya < 5%, namun penghematan biaya mencapai 73% (perhitungan murni 3,6x lipat). ROI gabungan hampir selalu dimenangkan oleh nano.

Q8: Apa saja batasan yang diketahui dari GPT-5.4 nano?

Batasan utama:

- Tidak mendukung Computer Use: Skor OSWorld 39% terlalu rendah untuk otomatisasi desktop yang stabil.

- Tidak mendukung Fine-tuning: Tidak dapat melakukan fine-tuning dengan dataset kustom.

- Tidak mendukung input audio/video: Hanya input teks + gambar.

- Tugas Terminal panjang lemah: Terminal-Bench 46,3%, mudah gagal jika lebih dari 10 langkah.

- Kemampuan penalaran kompleks terbatas: GPQA 82,8% mendekati mini, namun performa menurun drastis pada tugas yang sangat sulit seperti FrontierMath.

Solusi alternatif: Jika menemui batasan ini, beralihlah langsung ke gpt-5.4-mini atau versi standar 5.4.

Poin Utama Skenario Aplikasi GPT-5.4 nano

- Harga Terjangkau: $0,20/$1,25 per 1 juta token, 3,6-3,75 kali lebih murah dibandingkan 5.4-mini.

- Diskon Cache 90%: Input serendah $0,02/1 juta token, skenario dengan konteks frekuensi tinggi hampir gratis.

- 7 Skenario Zona Hijau: Klasifikasi, ekstraksi, pengurutan, Sub-agent, perutean, pemrosesan batch, dan Penggunaan Alat (Tool Use).

- τ2-Bench 92,5%: Kemampuan pemanggilan alat hampir setara dengan versi mini, cukup untuk 90%+ skenario Function Calling.

- GPQA 82,8%: Kemampuan tanya jawab pengetahuan umum yang kuat, cocok untuk FAQ dan moderasi konten.

- Kecepatan 200 t/s: 10% lebih cepat dari versi mini, pilihan utama untuk pipeline throughput tinggi.

- Peringatan Zona Merah: Tugas panjang seperti Computer Use dan Terminal harus beralih ke versi mini.

Kesimpulan

Poin utama skenario aplikasi GPT-5.4 nano:

- Penempatan Skenario: nano adalah pilihan terbaik untuk tugas dengan throughput tinggi dan kompleksitas rendah — klasifikasi real-time, ekstraksi data, pekerja Sub-agent, perutean RAG, dan pemrosesan batch adalah medan tempur utamanya.

- Batas Kemampuan: τ2-Bench / GPQA / SWE-Bench Pro hampir setara dengan versi mini, namun kemampuan untuk tugas panjang seperti Computer Use / Terminal jauh lebih lemah.

- Cara Akses: Panggil langsung melalui grup Default APIYI apiyi.com, diskon cache disinkronkan, isi ulang 100 dapat bonus 10.

GPT-5.4 nano bukanlah produk murah yang "bisa melakukan segalanya tapi tidak maksimal", melainkan senjata ringan yang dioptimalkan secara khusus oleh OpenAI untuk skenario throughput tinggi + kompleksitas rendah. Jika aplikasi Anda termasuk dalam 7 skenario zona hijau yang disebutkan di atas, nano hampir selalu lebih hemat biaya daripada mini. Namun, jika melibatkan tugas panjang seperti Computer Use atau Terminal, beralih ke versi mini adalah pilihan yang tepat.

Direkomendasikan untuk mengakses GPT-5.4 nano dengan cepat melalui platform APIYI apiyi.com. Grup Default tidak memerlukan pengajuan, diskon cache disinkronkan sepenuhnya, ada bonus isi ulang 10%, dan koneksi domestik yang stabil.

Bacaan Lanjutan

Jika Anda tertarik dengan API GPT-5.4 nano, kami merekomendasikan untuk membaca artikel berikut:

- 📘 Panduan Peningkatan API GPT-5.4 mini – Pelajari kemampuan dan skenario penggunaan model mini tingkat sebelumnya

- 📊 Analisis Mendalam Mekanisme Cache OpenAI: Praktik Terbaik Diskon 90% – Kuasai teknik rekayasa untuk optimalisasi cache

- 🚀 Praktik Membangun Lapisan Perutean RAG Berbasis GPT-5.4 nano – Jelajahi arsitektur hibrida "perutean nano + pemrosesan mini"

📚 Referensi

-

Dokumentasi Resmi OpenAI GPT-5.4 nano: Spesifikasi model, harga, dan contoh pemanggilan

- Tautan:

developers.openai.com/api/docs/models/gpt-5.4-nano - Keterangan: Dapatkan parameter teknis resmi terbaru dan paling otoritatif

- Tautan:

-

Analisis Tolok Ukur AI Cost Check: Evaluasi dimensi penuh nano vs mini

- Tautan:

aicostcheck.com/blog/gpt-5-4-mini-nano-pricing-benchmarks - Keterangan: Evaluasi pihak ketiga, cocok untuk perbandingan kemampuan secara horizontal

- Tautan:

-

Dokumentasi Integrasi APIYI GPT-5.4 nano: Solusi pemanggilan domestik, penjelasan grup, dan promosi isi ulang

- Tautan:

docs.apiyi.com - Keterangan: Panduan praktis integrasi yang cocok untuk pengembang di Indonesia

- Tautan:

-

Halaman Harga OpenAI: Tabel harga lengkap dan penjelasan mekanisme cache

- Tautan:

developers.openai.com/api/docs/pricing - Keterangan: Standar penagihan terbaru untuk semua model

- Tautan:

Penulis: Tim Teknis APIYI

Diskusi Teknis: Jangan ragu untuk mendiskusikan pengalaman aplikasi GPT-5.4 nano Anda di kolom komentar. Untuk materi akses model lainnya, silakan kunjungi pusat dokumentasi APIYI di docs.apiyi.com