Catatan Penulis: Analisis mendalam mengenai kemampuan inti, tolok ukur performa, dan cara integrasi API untuk model MiniMax-M2.7 dan M2.7-highspeed, membantu pengembang mendapatkan kemampuan AI kelas unggulan dengan biaya yang sangat rendah.

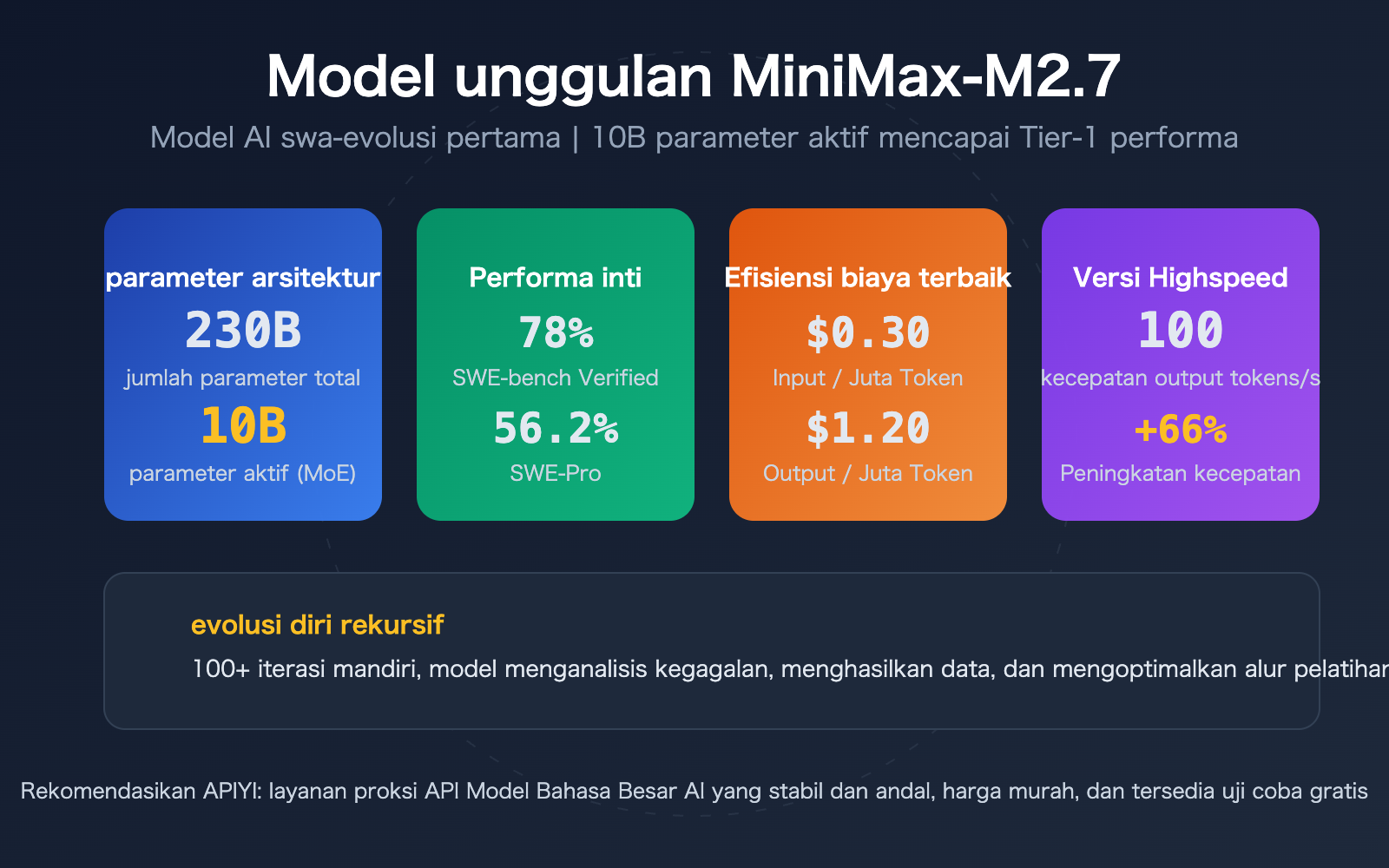

MiniMax merilis Model Bahasa Besar unggulan MiniMax-M2.7 pada 18 Maret 2026, yang merupakan model AI pertama yang berpartisipasi secara mendalam dalam proses evolusinya sendiri. Hanya dengan 10B parameter aktif, model ini mencapai performa Tier-1 setingkat Claude Opus 4.6 dan GPT-5, dengan harga hanya 1/50 dari model unggulan arus utama. Versi MiniMax-M2.7-highspeed yang dirilis bersamaan juga meningkatkan kecepatan output sebesar 66%, mencapai 100 tps.

Nilai Inti: Melalui data tolok ukur nyata dan tutorial integrasi, kami membantu Anda menentukan apakah MiniMax-M2.7 adalah pilihan model unggulan dengan rasio harga-performa terbaik saat ini.

Poin Utama MiniMax-M2.7

| Poin | Penjelasan | Nilai |

|---|---|---|

| 230B Total Parameter / 10B Aktif | Arsitektur MoE (Mixture-of-Experts), hanya mengaktifkan 10B parameter per inferensi | Performa unggulan + biaya inferensi sangat rendah |

| Pelatihan Evolusi Mandiri Rekursif | Model menjalankan 100+ putaran iterasi untuk mengoptimalkan proses pelatihannya sendiri | Peningkatan performa 30% tanpa intervensi manusia |

| SWE-bench 78% | Tolok ukur rekayasa perangkat lunak jauh melampaui 55% milik Opus 4.6 | Pilihan utama untuk tugas pemrograman dan rekayasa |

| Harga hanya 1/50 dari Opus | Input $0.30/M, Output $1.20/M token | Biaya penyebaran skala besar tingkat perusahaan turun drastis |

Penjelasan Mendalam Arsitektur Teknis MiniMax-M2.7

MiniMax-M2.7 menggunakan arsitektur Transformer Sparse Mixture-of-Experts (MoE) dengan total 230B parameter, namun hanya mengaktifkan 10B parameter per token. Desain ini menjadikan M2.7 model terkecil di kelas performanya—mencapai kinerja Tier-1 setingkat Claude Opus 4.6 dan GPT-5 dengan sumber daya komputasi paling efisien.

Jendela konteks mencapai 205K token (sekitar 307 halaman dokumen A4), mendukung skenario seperti analisis dokumen panjang dan pemahaman basis kode besar. Dalam evaluasi Artificial Analysis Intelligence Index, M2.7 menempati peringkat pertama di antara 136 model sekelas dengan skor sempurna 50.

Mekanisme Evolusi Mandiri Rekursif MiniMax-M2.7

"Evolusi mandiri rekursif" adalah sorotan teknis paling inovatif dari M2.7. Selama proses pelatihan, model secara mandiri menjalankan siklus iterasi lengkap: menganalisis jejak kegagalan → merencanakan modifikasi → memodifikasi kode perancah pelatihan → menjalankan evaluasi → membandingkan hasil → memutuskan untuk mempertahankan atau membatalkan. Proses ini berjalan sepenuhnya secara mandiri selama 100+ putaran.

Komponen inti "Agentic Researcher" menangani 30-50% alur kerja pembelajaran penguatan, termasuk analisis log dan debugging, pembuatan data sintetis, serta optimalisasi lingkungan pelatihan. Hasilnya, performa meningkat 30% tanpa intervensi manusia.

Tolok Ukur Performa dan Perbandingan Model MiniMax-M2.7

Hasil Uji Tolok Ukur MiniMax-M2.7

| Tolok Ukur | Skor M2.7 | Claude Opus 4.6 | Seri GPT-5 | Keterangan |

|---|---|---|---|---|

| SWE-bench Verified | 78% | 55% | — | Praktik rekayasa perangkat lunak, unggul jauh |

| SWE-Pro | 56.2% | ~57% | 56.2% (Codex) | Mendekati level flagship |

| VIBE-Pro | 55.6% | — | — | Pengiriman proyek end-to-end |

| Terminal Bench 2 | 57.0% | — | — | Sistem rekayasa kompleks |

| MLE-Bench Lite | 66.6% | 75.7% | 71.2% (5.4) | Kompetisi ML, 9 emas 5 perak 1 perunggu |

| GDPval-AA ELO | 1495 | — | — | Peringkat pertama produktivitas kantor |

Perbandingan Harga MiniMax-M2.7

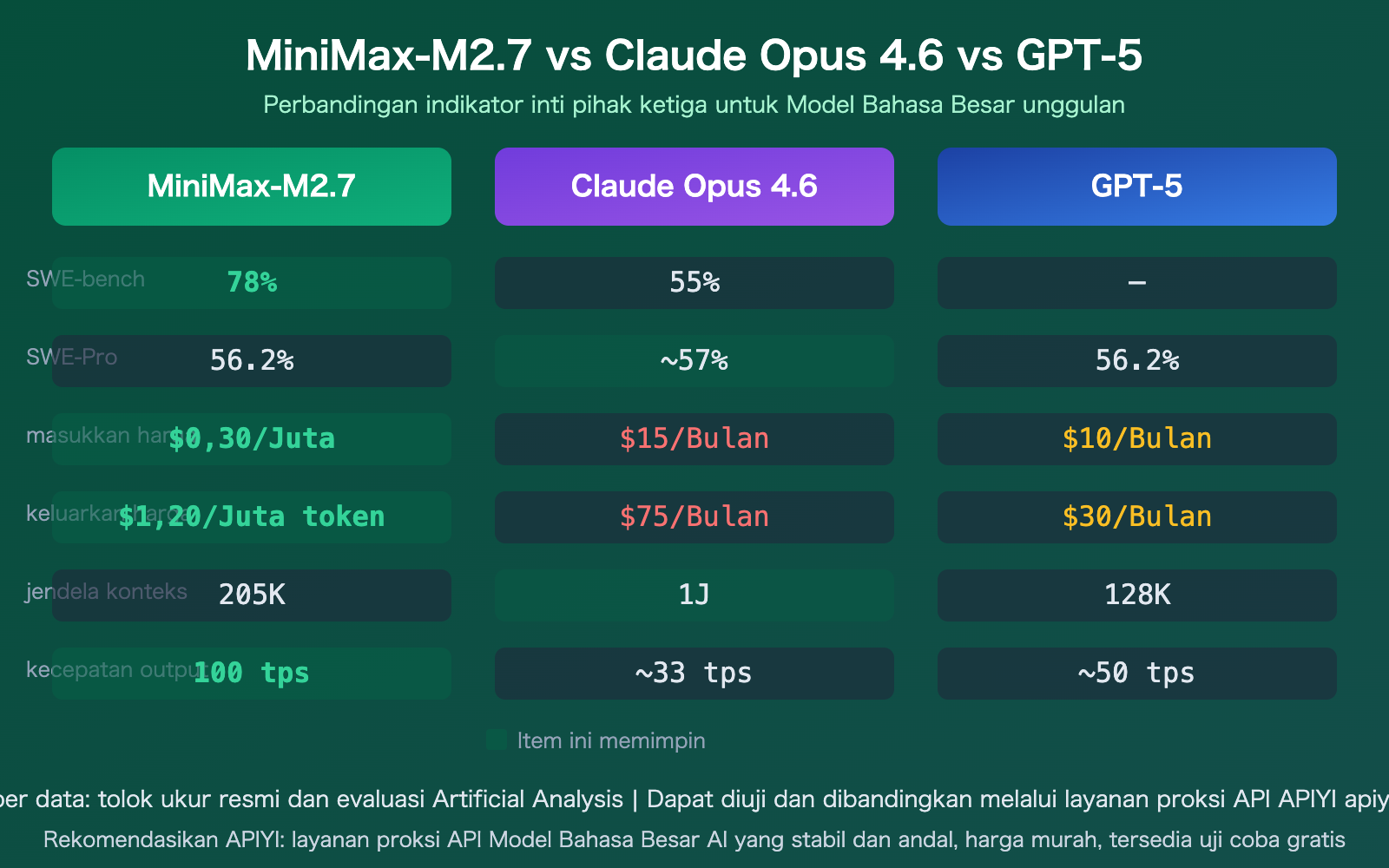

Strategi penetapan harga M2.7 sangat agresif. Dengan tingkat performa yang hampir setara, biayanya hanya sepersekian dari model flagship arus utama:

| Indikator | MiniMax-M2.7 | Claude Opus 4.6 | GPT-5 | Perbedaan Kelipatan |

|---|---|---|---|---|

| Harga Input | $0.30/M | $15/M | $10/M | 50x / 33x lebih murah |

| Harga Output | $1.20/M | $75/M | $30/M | 62x / 25x lebih murah |

| Jendela Konteks | 205K | 1M | 128K | Di antara keduanya |

| Parameter Aktif | 10B | — | — | Model Tier-1 terkecil |

🎯 Saran Pemilihan: MiniMax-M2.7 tampil luar biasa dalam tugas pemrograman dan rekayasa dengan efisiensi biaya yang sangat tinggi. Kami menyarankan untuk melakukan pengujian akses cepat melalui platform APIYI apiyi.com, yang mendukung antarmuka terpadu untuk MiniMax-M2.7 dan M2.7-highspeed, sehingga memudahkan perbandingan langsung dengan model flagship lainnya.

Penjelasan Mendalam MiniMax-M2.7-highspeed

MiniMax-M2.7-highspeed adalah versi optimasi performa dari seri flagship M2.7. Versi ini menghasilkan output yang sama persis dengan versi standar—keduanya memiliki tingkat kecerdasan yang identik, namun versi highspeed dirancang khusus untuk skenario aplikasi yang sensitif terhadap latensi.

Keunggulan Utama MiniMax-M2.7-highspeed

- Kecepatan Output: Mencapai 100 token/detik, meningkat 66% dibanding versi standar

- Latensi Sub-detik: Optimalisasi waktu respons Token pertama, cocok untuk interaksi real-time

- Arsitektur Tulang Punggung Penalaran yang Ditingkatkan: Mesin penalaran tingkat bawah dioptimalkan secara khusus, bukan sekadar penurunan kuantisasi

- Konsistensi Hasil: Output sama persis dengan versi standar, tanpa mengorbankan tingkat kecerdasan

Skenario Penggunaan MiniMax-M2.7-highspeed

| Skenario | Keterangan | Mengapa memilih highspeed |

|---|---|---|

| Asisten Pemrograman Interaktif | Pelengkapan dan refaktorisasi kode real-time di IDE | Respons sub-detik meningkatkan pengalaman coding |

| Loop Agen Real-time | Eksekusi penalaran multi-langkah Agent Loop | Mengurangi waktu tunggu per langkah, mempercepat alur kerja |

| Pipeline Perusahaan throughput tinggi | Pemrosesan dokumen batch, ekstraksi data | 100 tps secara signifikan mempersingkat waktu penyelesaian |

| Sistem Layanan Pelanggan Online | Percakapan dan tanya jawab real-time | Respons cepat yang tidak dirasakan oleh pengguna |

Saran: Jika aplikasi Anda memiliki persyaratan ketat terkait kecepatan respons, MiniMax-M2.7-highspeed adalah salah satu pilihan tercepat di antara model kelas flagship saat ini. Anda dapat memanggil model ini secara langsung melalui APIYI apiyi.com.

Panduan Cepat API MiniMax-M2.7

Contoh Sederhana

Berikut adalah kode paling ringkas untuk memanggil MiniMax-M2.7 melalui platform APIYI, hanya butuh 10 baris untuk menjalankannya:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="MiniMax-M2.7",

messages=[{"role": "user", "content": "Analisis hambatan performa kode ini dan berikan saran optimasi"}]

)

print(response.choices[0].message.content)

Lihat kode implementasi lengkap (termasuk peralihan versi highspeed)

import openai

from typing import Optional

def call_minimax_m27(

prompt: str,

model: str = "MiniMax-M2.7",

system_prompt: Optional[str] = None,

max_tokens: int = 2000,

use_highspeed: bool = False

) -> str:

"""

Memanggil MiniMax-M2.7 atau M2.7-highspeed

Args:

prompt: Input pengguna

model: Nama model

system_prompt: Petunjuk sistem

max_tokens: Jumlah token output maksimum

use_highspeed: Apakah menggunakan versi highspeed

"""

if use_highspeed:

model = "MiniMax-M2.7-highspeed"

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

response = client.chat.completions.create(

model=model,

messages=messages,

max_tokens=max_tokens

)

return response.choices[0].message.content

# Pemanggilan versi standar

result = call_minimax_m27(

prompt="Implementasikan LRU cache yang efisien menggunakan Python",

system_prompt="Anda adalah seorang insinyur Python senior"

)

# Pemanggilan versi highspeed (cocok untuk skenario real-time)

fast_result = call_minimax_m27(

prompt="Jelaskan fungsi kode ini dengan cepat",

use_highspeed=True

)

Saran: Dapatkan kuota uji coba gratis melalui APIYI apiyi.com untuk memverifikasi performa MiniMax-M2.7 dalam skenario bisnis Anda dengan cepat. Platform ini mendukung peralihan satu klik antara versi standar dan highspeed.

Perbandingan MiniMax-M2.7 dengan Model Kompetitor

| Solusi | Fitur Utama | Skenario Penggunaan | Efektivitas Biaya |

|---|---|---|---|

| MiniMax-M2.7 | 10B parameter aktif, SWE-bench 78% | Pemrograman, alur kerja Agen, deployment skala besar | Sangat Tinggi ($0.30/$1.20) |

| M2.7-highspeed | 100 tps, peningkatan kecepatan 66% | Interaksi real-time, integrasi IDE, Agent Loop | Sangat Tinggi + Cepat |

| Claude Opus 4.6 | Jendela konteks 1M, kemampuan komprehensif terbaik | Dokumen sangat panjang, penalaran kompleks, tugas serba bisa | Sedang ($15/$75) |

| GPT-5 | Ekosistem matang, dukungan multimodal | Skenario umum, aplikasi multimodal | Sedang ($10/$30) |

Catatan Perbandingan: Data di atas berasal dari pengujian benchmark resmi dan evaluasi pihak ketiga Artificial Analysis, yang dapat diverifikasi melalui perbandingan aktual di platform APIYI apiyi.com.

Pertanyaan Umum

Q1: Apakah ada perbedaan hasil antara MiniMax-M2.7 dan M2.7-highspeed?

Hasil keluarannya benar-benar identik. Versi highspeed mengoptimalkan mesin inferensi untuk mencapai kecepatan pembuatan token yang lebih cepat (100 tps), namun tidak mengubah tingkat kecerdasan atau kualitas output model. Jika skenario penggunaan Anda tidak sensitif terhadap latensi, versi standar sudah cukup.

Q2: Apakah “evolusi mandiri rekursif” pada MiniMax-M2.7 berarti model akan terus berubah?

Tidak. Evolusi mandiri rekursif adalah metode teknis yang digunakan MiniMax selama tahap pelatihan—model secara mandiri melakukan iterasi untuk mengoptimalkan proses pelatihan dan parameternya. Setelah dirilis, bobot model bersifat tetap. API yang Anda panggil akan memberikan output yang stabil dan konsisten.

Q3: Bagaimana cara memulai pengujian MiniMax-M2.7 dengan cepat?

Kami merekomendasikan penggunaan platform agregasi API yang mendukung berbagai model untuk pengujian:

- Kunjungi APIYI di apiyi.com untuk mendaftarkan akun

- Dapatkan kunci API dan kuota gratis

- Gunakan contoh kode dalam artikel ini untuk verifikasi cepat

- Cukup ubah parameter model untuk beralih antara versi standar dan versi highspeed

Kesimpulan

Poin utama pemanggilan API MiniMax-M2.7:

- Efisiensi Biaya Terbaik: Dengan 10B parameter aktif, model ini mencapai performa Tier-1 dengan harga hanya 1/50 dari Opus, menjadikannya pilihan utama untuk penyebaran skala besar.

- Kemampuan Pemrograman Unggul: Skor 78% pada SWE-bench Verified jauh mengungguli kompetitor, memberikan performa luar biasa untuk tugas rekayasa perangkat lunak.

- Versi highspeed: Kecepatan output 100 tps sangat cocok untuk interaksi real-time dan skenario perulangan Agent, dengan tingkat kecerdasan yang sama persis dengan versi standar.

Bagi pengembang dan pengguna perusahaan yang mencari efisiensi biaya, MiniMax-M2.7 adalah salah satu model unggulan yang paling layak diperhatikan di pasar saat ini.

Direkomendasikan untuk memverifikasi hasilnya dengan cepat melalui APIYI di apiyi.com, yang menyediakan kuota gratis dan antarmuka terpadu untuk berbagai model, serta mendukung peralihan satu klik antara MiniMax-M2.7 versi standar dan highspeed.

📚 Referensi

-

Rilis Resmi MiniMax M2.7: Detail arsitektur model dan teknologi swa-evolusi

- Tautan:

minimax.io/news/minimax-m27-en - Penjelasan: Blog teknis resmi, mencakup tolok ukur dan detail arsitektur

- Tautan:

-

Halaman Model MiniMax M2.7: Spesifikasi teknis dan dokumentasi API

- Tautan:

minimax.io/models/text/m27 - Penjelasan: Parameter model, harga, dan metode integrasi

- Tautan:

-

Evaluasi Artificial Analysis: Evaluasi kinerja independen pihak ketiga

- Tautan:

artificialanalysis.ai/models/minimax-m2-7 - Penjelasan: Data evaluasi independen mengenai kecepatan dan indeks kecerdasan

- Tautan:

-

Dokumentasi Platform APIYI: Integrasi cepat MiniMax-M2.7

- Tautan:

docs.apiyi.com - Penjelasan: Cara mendapatkan kunci API, daftar model, dan contoh pemanggilan model

- Tautan:

Penulis: Tim Teknis APIYI

Diskusi Teknis: Mari berdiskusi di kolom komentar, untuk materi lebih lanjut silakan kunjungi pusat dokumentasi APIYI di docs.apiyi.com