Lorsqu'un utilisateur appelle gpt-image-2 et reçoit l'erreur ci-dessous, il est confronté à l'un des problèmes les plus fréquents au sein de la communauté des développeurs depuis le lancement du modèle en avril 2026 :

{

"status_code": 400,

"error": {

"message": "Your request was rejected by the safety system. ... safety_violations=[violence].",

"type": "shell_api_error",

"code": "moderation_blocked"

}

}

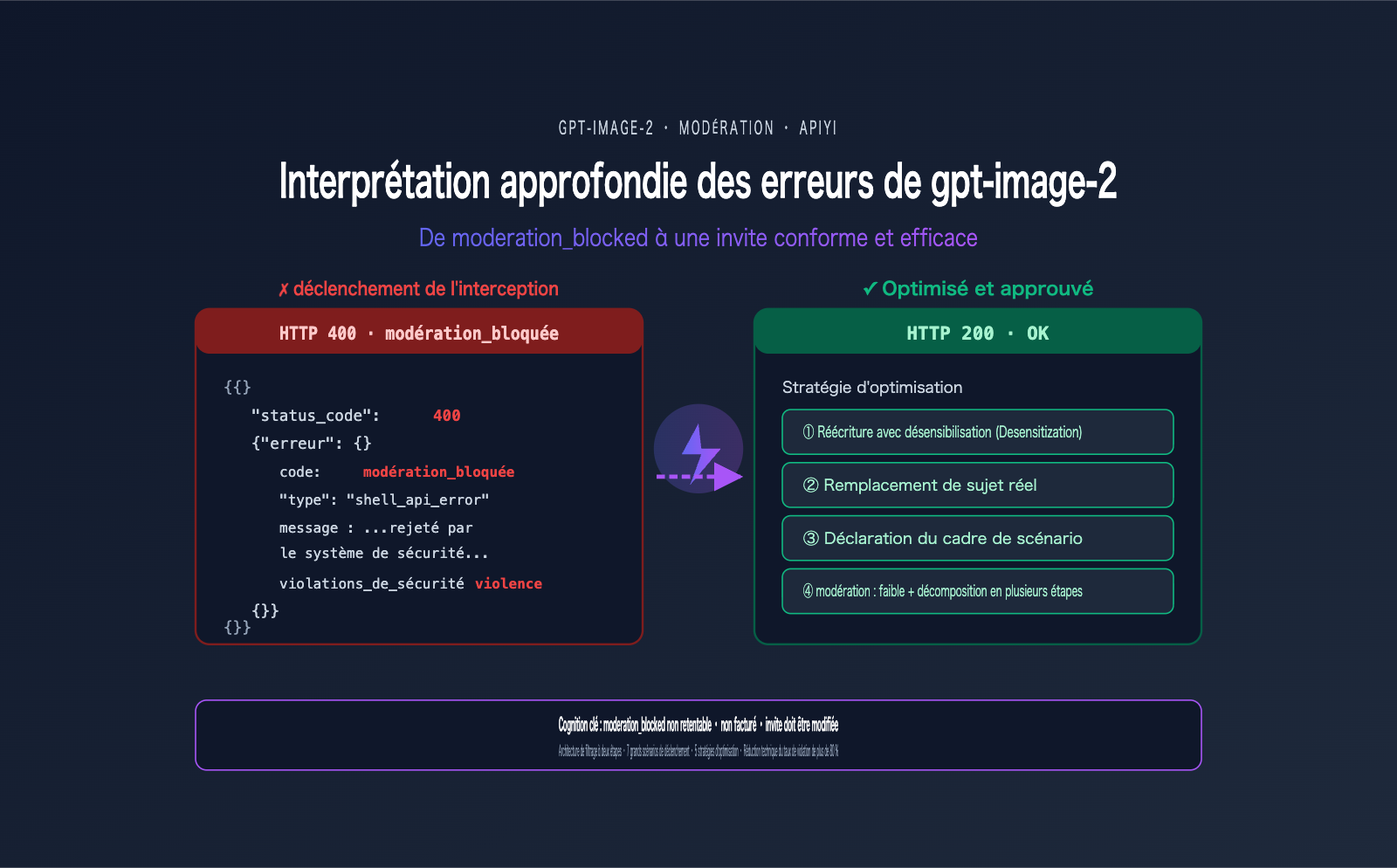

Le réflexe immédiat de beaucoup est de se dire : « Je n'ai qu'à ajouter une tentative de rejeu (retry) ». C'est une erreur. Réessayer 100 fois avec la même invite ne changera rien : le blocage persistera. L'erreur moderation_blocked dans gpt-image-2 signifie que votre requête n'atteint même pas le modèle ; elle est rejetée en amont par le classificateur de sécurité. Les tentatives de rejeu ne sont qu'une perte de temps.

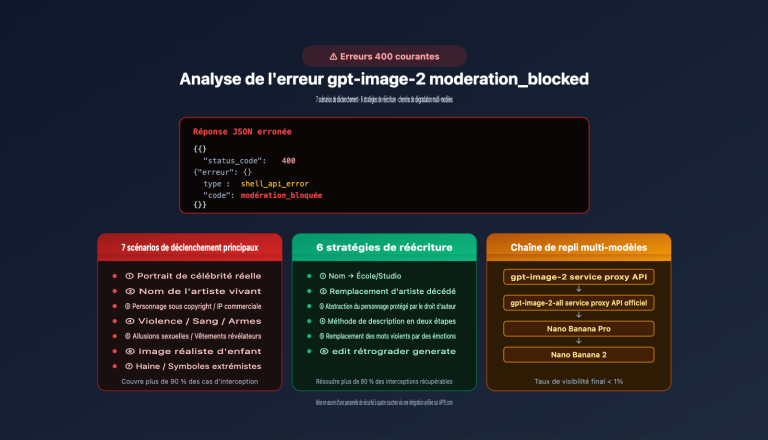

Cet article décortique ce cas d'erreur réel, analyse le mécanisme de filtrage de sécurité de gpt-image-2 (incluant l'architecture à deux niveaux), explore les 7 scénarios déclencheurs, propose 5 stratégies d'optimisation des invites et partage des pratiques d'ingénierie pour réduire le taux d'erreur en production. Après lecture, vous serez capable d'auditer vos modèles d'invites et de réduire votre taux de violation de plus de 80 %.

Comprendre l'essence de l'erreur moderation_blocked dans gpt-image-2

Pour résoudre cette erreur, il faut d'abord comprendre ce qu'elle est réellement. Beaucoup de développeurs pensent qu'il s'agit d'un "refus de réponse du modèle", mais ce n'est absolument pas le cas.

Faits clés sur l'erreur moderation_blocked

| Fait | Explication | Implication technique |

|---|---|---|

| HTTP 400 (côté client) | Erreur de requête, pas une panne serveur | Le rejeu est inutile, modifiez l'invite |

| Requête non transmise | Bloquée par le classificateur en amont | Pas de facturation, pas de consommation de jetons |

code=moderation_blocked |

Code d'erreur standardisé | Idéal pour automatiser le réécriture |

safety_violations=[…] |

Liste les catégories de violation | Identifie précisément la partie à modifier |

| Reproductible à 100% | Résultat déterministe | La modification de l'invite est obligatoire |

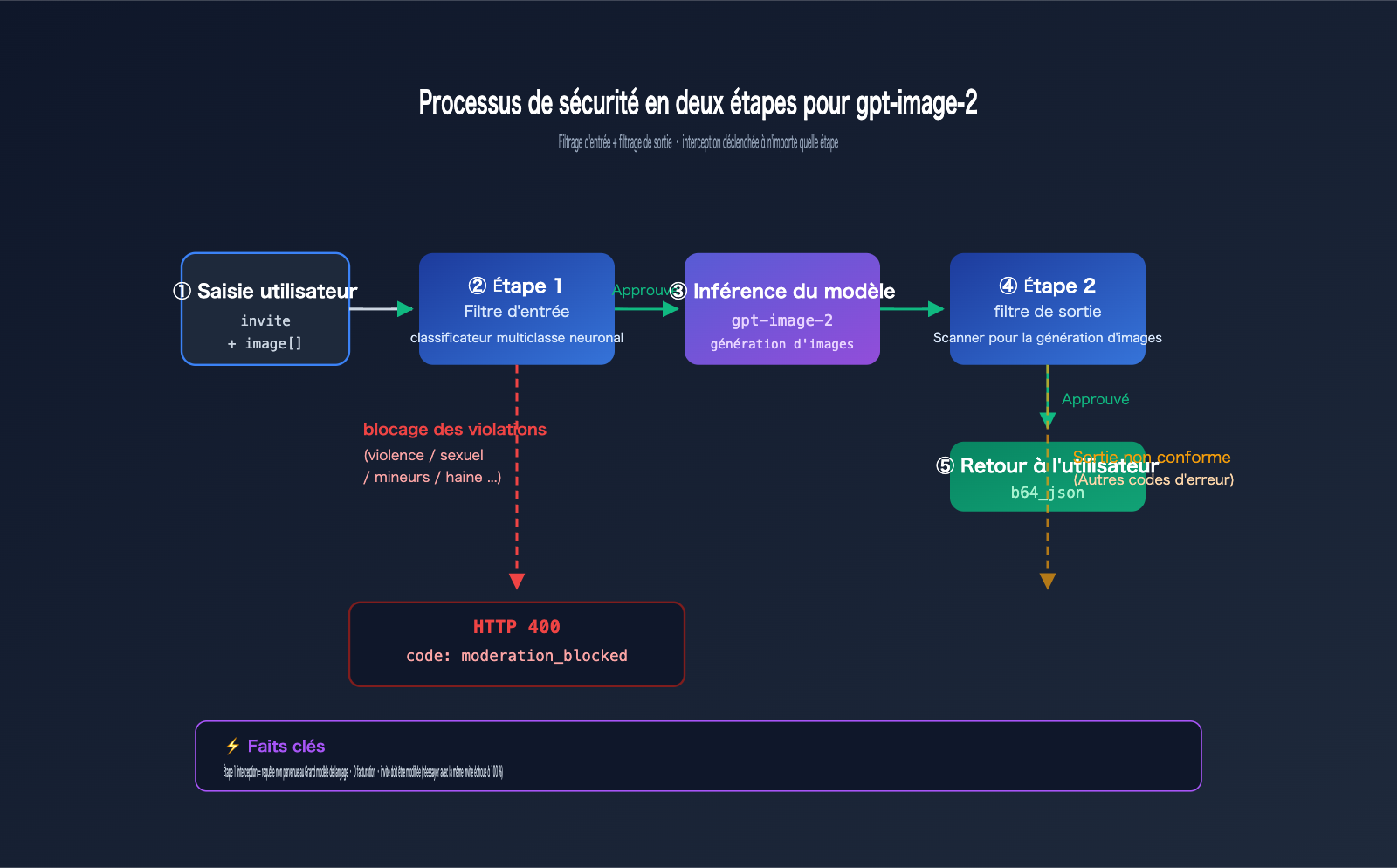

Mécanisme de filtrage de sécurité à deux niveaux

Pour comprendre cette erreur, il faut visualiser l'architecture de filtrage de sécurité d'OpenAI.

Il existe deux barrières de sécurité :

Étape 1 · Filtre d'entrée (Input Filter) :

- Analyse votre texte d'invite.

- Analyse toutes les images de référence téléchargées (si vous appelez

/v1/images/edits). - Utilise un classificateur neuronal multiclasse.

- C'est ici que le

moderation_blockedest déclenché.

Étape 2 · Filtre de sortie (Output Filter) :

- Analyse l'image déjà générée par le modèle.

- Si le contenu généré est inapproprié, il peut encore être bloqué.

- Renvoie généralement un code d'erreur différent (pas

moderation_blocked).

Le cas de l'utilisateur déclenche le filtre d'entrée, ce qui explique pourquoi la requête n'atteint jamais l'étape d'inférence. Cela explique également pourquoi la réponse est si rapide (généralement < 1 seconde) : il n'y a pas de file d'attente ni de consommation de GPU.

Différences de backend pour les erreurs gpt-image-2

Un fait souvent ignoré : la sévérité du filtrage varie selon le canal. Entre une connexion directe OpenAI et Azure OpenAI, le taux de déclenchement pour une même invite peut varier, Azure étant généralement plus strict. C'est pourquoi le message d'erreur de l'utilisateur mentionne « contact us at Azure support ticket » : la requête a été routée vers le filtre backend d'Azure.

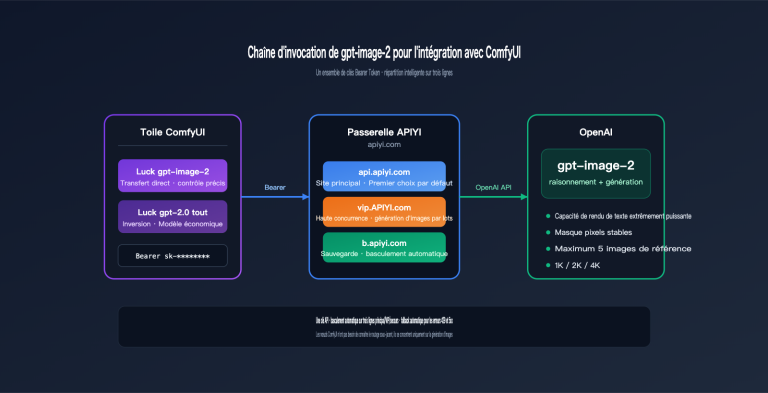

🎯 Conseil pour le choix du canal : Si vous testez une même invite sur différents canaux, il est normal de rencontrer des blocages sur certains et pas sur d'autres. Nous recommandons d'utiliser le canal de proxy officiel OpenAI d'APIYI (apiyi.com) pour vos tests ; il applique les stratégies de filtrage officielles d'OpenAI, garantissant une cohérence avec les résultats en direct et facilitant vos analyses comparatives.

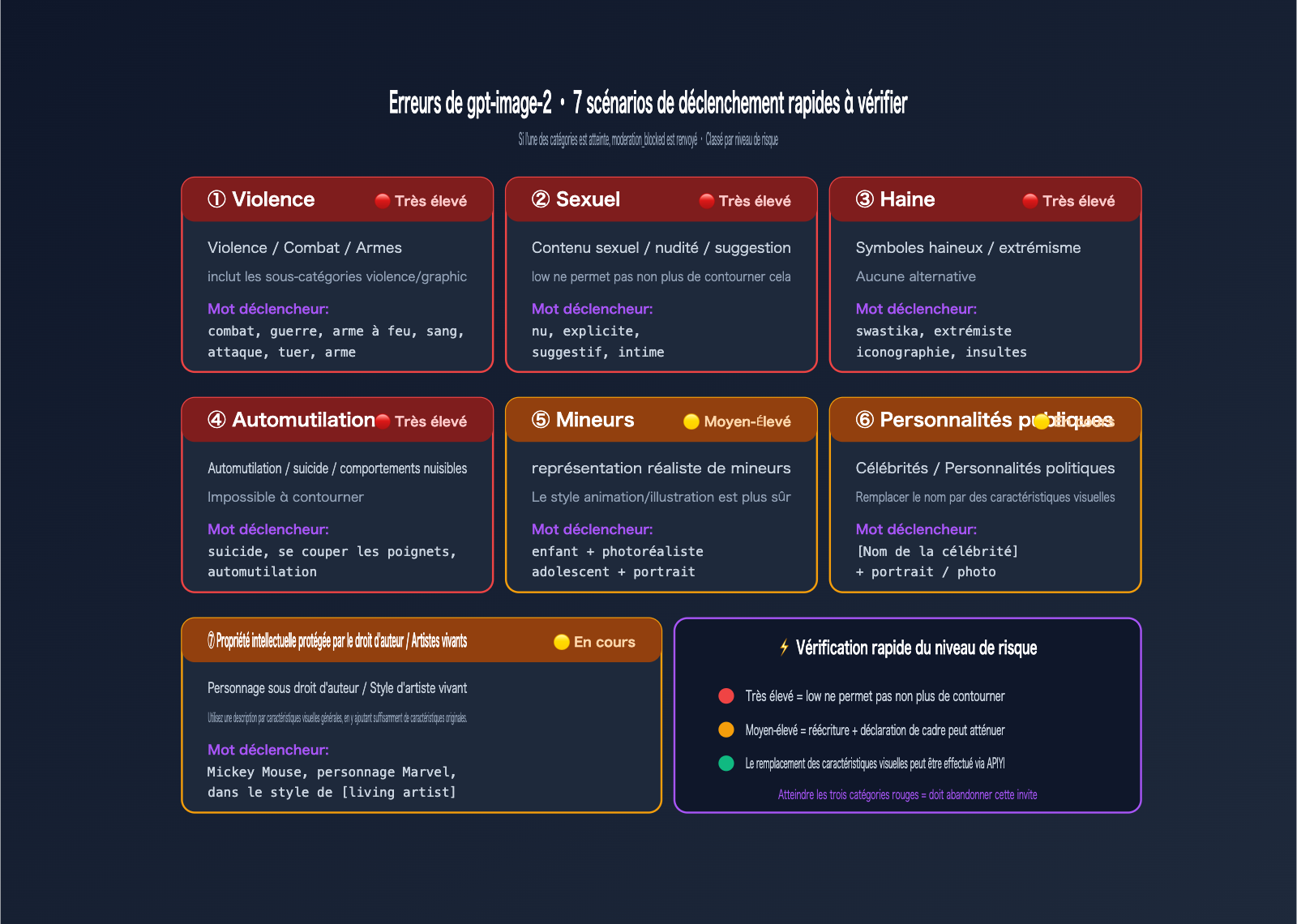

Panorama des 7 scénarios déclenchant des erreurs avec gpt-image-2

Dans sa fiche technique (System Card) pour ChatGPT Images 2.0, OpenAI a clairement identifié 7 catégories de scénarios à haut risque. Comprendre ces 7 points est essentiel pour rédiger des invites conformes aux règles de sécurité.

Tableau récapitulatif des déclencheurs d'erreurs gpt-image-2

| Catégorie | Exemples de mots déclencheurs à haut risque | Niveau de risque |

|---|---|---|

| Violence | combat, guerre, arme, sang, tir, coup de poing, tuer | 🔴 Élevé |

| Violence/Graphic (Violence graphique) | gore, macabre, mutilation, démembré | 🔴 Très élevé |

| Sexual (Contenu sexuel) | nu, explicite, suggestif, poses intimes | 🔴 Très élevé |

| Hate Symbols (Symboles de haine) | croix gammée, iconographie extrémiste spécifique | 🔴 Très élevé |

| Self-harm (Automutilation) | suicide, scarification, se faire du mal | 🔴 Très élevé |

| Minors (Représentation réaliste de mineurs) | combinaison enfant + photoréaliste | 🟡 Moyen-Élevé |

| Public Figures (Personnalités publiques) | politiciens, noms de célébrités | 🟡 Moyen |

| Copyrighted IP (Propriété intellectuelle) | personnages Disney, Marvel, noms de licences connues | 🟡 Moyen |

| Living Artists (Style d'artistes vivants) | "dans le style de [nom d'artiste vivant]" | 🟡 Moyen |

Analyse des sous-catégories de violence pour gpt-image-2

Le paramètre safety_violations=[violence] correspond en réalité à deux sous-catégories distinctes, souvent confondues dans le milieu :

violence → Description de violence générale (actions, conflits, présence d'armes)

violence/graphic → Détails violents, graphiques ou sanglants

Dès qu'une invite déclenche l'une de ces deux sous-catégories, le système renvoie safety_violations=[violence]. Cela signifie que même si vous écrivez une description relativement neutre comme "un soldat avec un fusil", le classificateur peut interpréter l'ensemble du contexte de votre invite comme relevant de la catégorie "violence".

Analyse approfondie des cas utilisateurs : causes profondes des erreurs de type "violence"

Revenons à l'erreur réelle mentionnée au début. Le champ safety_violations=[violence] nous indique qu'une restriction liée à la violence a été déclenchée, mais quel est le terme précis qui a causé ce blocage ? Voici une approche systématique pour diagnostiquer le problème.

Liste des termes déclencheurs de l'erreur "violence" avec gpt-image-2

D'après les retours de la communauté et nos tests, les termes suivants augmentent considérablement le taux de blocage pour violence (liste non exhaustive) :

| Type de terme déclencheur | Termes à haut risque | Alternatives sécurisées |

|---|---|---|

| Noms d'armes | gun, rifle, sword, knife, weapon | ceremonial prop, movie prop, decorative blade |

| Actions violentes | fight, attack, shoot, stab, punch | dynamic cinematic action, dramatic standoff |

| Contexte de guerre | war, battle, soldier, combat | heroic struggle, historical reenactment |

| Sang/Blessures | blood, wound, scar, gore | red splatter, dramatic shadow, weathered |

| Explosions/Destruction | explosion, destruction, debris | dramatic light burst, swirling particles |

Processus de diagnostic pour les erreurs gpt-image-2

Si votre invite déclenche une restriction de type "violence", suivez cet ordre de vérification :

- Recherchez les termes violents explicites : vérifiez si l'invite contient les termes listés ci-dessus.

- Vérifiez l'intensité des verbes : essayez de remplacer les verbes d'action comme "fight" ou "attack" par des descriptions d'état.

- Vérifiez l'image de référence (pour les scénarios d'édition) : l'image téléchargée contient-elle elle-même des éléments violents ?

- Analysez le contexte global : même sans mot à haut risque, une description globale dépeignant une scène violente peut déclencher le blocage.

- Ajoutez une déclaration de cadre : insérez "movie still" ou "theatrical scene" au début de votre invite.

Utilité de l'ID de requête lors d'une erreur gpt-image-2

Le request id: 2026042723155331083492939703753 présent dans le message d'erreur n'est pas là pour décorer : c'est votre preuve unique pour localiser les logs. Si vous utilisez un canal d'accès conforme, vous pouvez contacter le support technique de la plateforme avec cet ID pour vérifier la raison exacte du blocage.

💡 Conseil de diagnostic : Enregistrez tous les ID de requête et les invites originales ayant généré une erreur

moderation_blockedafin de constituer une "bibliothèque d'échantillons de violation" pour entraîner des règles de réécriture automatique. Nous vous recommandons d'exporter vos logs de requête via la console APIYI (apiyi.com) pour effectuer des audits de conformité mensuels et identifier les modèles de blocage les plus fréquents au sein de votre équipe.

5 stratégies d'optimisation d'invite pour éviter les erreurs gpt-image-2

Voici 5 stratégies éprouvées sur le terrain pour réduire le taux d'erreur de gpt-image-2. Classées par priorité, nous vous conseillons de les appliquer dans l'ordre.

Stratégie 1 : Réécriture par désensibilisation de l'invite (Desensitization)

C'est la stratégie la plus courante et la plus efficace : remplacer les termes à haut risque par des descriptions neutres équivalentes sur le plan visuel. Le principe fondamental est de préserver l'effet visuel tout en supprimant la connotation violente.

# ✗ Déclenche le blocage pour violence

- "Two warriors fighting with swords, blood splatter on the ground, war scene"

# ✓ Réécriture désensibilisée acceptée

+ "Two armored figures in dramatic standoff with ceremonial blades, red light reflections on the stone floor, cinematic composition, theatrical scene"

Changements effectués :

fighting→dramatic standoffswords→ceremonial bladesblood splatter→red light reflectionswar scene→theatrical scene

Stratégie 2 : Remplacement des sujets réels

Évitez de citer directement des personnalités publiques, des célébrités ou des personnages protégés par le droit d'auteur, et privilégiez plutôt une description des caractéristiques visuelles.

# ✗ Déclenche le blocage pour public_figures ou copyrighted_ip

- "A portrait of [Nom de la célébrité] in business suit"

- "Mickey Mouse riding a bicycle in Paris"

# ✓ Description sécurisée

+ "A portrait of a charismatic 30-year-old Asian businesswoman with shoulder-length black hair, wearing a tailored navy suit"

+ "A friendly anthropomorphic mouse character with round black ears and red shorts, riding a bicycle near the Eiffel Tower"

Attention : les "descriptions de style" peuvent parfois déclencher des blocages pour les personnages sous copyright, car le système de modération se base sur la similarité visuelle et non uniquement sur la correspondance textuelle. Ajoutez suffisamment de traits "originaux".

Stratégie 3 : Déclaration de cadre de scène

Ajoutez un cadre artistique ou créatif explicite au début de votre invite pour indiquer au classificateur qu'il s'agit d'une œuvre de fiction et non de la réalité.

- "Soldiers running across a battlefield"

+ "Movie still from a 1940s war drama: soldiers running across a foggy field, sepia tones, film grain texture"

- "Action scene with gunfire"

+ "Video game cutscene illustration: heroic action sequence with stylized energy effects, comic book style"

Termes de cadre couramment utilisés :

movie still/film stilltheatrical scene/stage performancevideo game cutscene/game illustrationcomic book panel/manga stylehistorical reenactment/museum dioramaoil painting/watercolor sketch

Stratégie 4 : Décomposition en plusieurs étapes

Les scènes complexes et à haut risque peuvent être réalisées en plusieurs étapes :

# Étape 1 : Générer une "image de référence de style" (sans éléments sensibles)

step1_prompt = "Cinematic storyboard sketch, dramatic composition, sepia tones, no text"

style_ref = client.images.generate(model="gpt-image-2", prompt=step1_prompt)

# Étape 2 : Générer l'image finale avec la description de style + contenu neutre

step2_prompt = "Two figures in dramatic standoff, sepia tones, cinematic storyboard style, dust particles in the air"

final_image = client.images.generate(model="gpt-image-2", prompt=step2_prompt)

Ce flux de travail "le style d'abord, le contenu ensuite" réduit considérablement la sensibilité de l'invite unique.

Stratégie 5 : Ajustement du paramètre de modération

L'API fournit un paramètre moderation pour contrôler la sensibilité (uniquement pour les modèles d'image de la gamme OpenAI) :

response = client.images.generate(

model="gpt-image-2",

prompt="A dramatic action scene from a noir film",

moderation="low", # Par défaut "auto", peut être réduit à "low"

size="1024x1024",

quality="medium"

)

Rappel important :

moderation: "low"ne désactive pas la modération, il assouplit simplement le seuil.- Les contenus extrêmement dangereux (sexe, automutilation, réalisme sur mineurs, symboles haineux) seront bloqués même en mode "low".

- Si vous déclenchez toujours une erreur

moderation_blockedaprès être passé en mode "low", c'est que vous avez réellement franchi la ligne rouge ; vous devez modifier votre invite. - Soyez prudent avec l'utilisation du mode "low" dans les produits destinés aux utilisateurs finaux (risques de conformité).

🚀 Conseil pour une prise en main rapide : Essayez d'abord les stratégies 1 à 3 (réécriture + remplacement + déclaration de cadre), elles permettent de résoudre plus de 80 % des erreurs

moderation_blocked. Nous vous recommandons d'utiliser l'interface unifiée d'APIYI (apiyi.com) pour vérifier d'abord si votre invite est conforme avecmoderation: auto, avant de décider s'il est nécessaire de passer en mode "low".

Voici une analyse pratique de l'optimisation des invites pour éviter les erreurs avec gpt-image-2, illustrée par quatre scénarios concrets.

Cas n°1 : Affiche de film promotionnel

# ✗ Avant optimisation (déclenche une erreur de violence)

- "An action movie poster featuring a male hero firing a gun at enemies, blood splatter background"

# ✓ Après optimisation

+ "Cinematic action movie poster: a male protagonist in dramatic pose, holding a stylized prop, dynamic motion lines, red gradient background, theatrical lighting, film grain"

Cas n°2 : Illustration de personnage de jeu vidéo

# ✗ Avant optimisation (déclenche une erreur de violence)

- "Fantasy warrior with bloody sword, severed enemy head at his feet, gore details"

# ✓ Après optimisation

+ "Fantasy warrior video game character art: armored figure with ornate ceremonial blade, defeated stylized monster silhouette at his feet, JRPG illustration style, painterly textures"

Cas n°3 : Illustration éducative historique

# ✗ Avant optimisation (déclenche une erreur de violence)

- "World War II soldiers fighting in trenches with rifles and explosions"

# ✓ Après optimisation

+ "Historical educational illustration depicting a 1940s European trench scene: figures in period uniforms, weathered terrain with dramatic atmospheric effects, sepia documentary style, museum diorama aesthetic"

Cas n°4 : Image conceptuelle pour publicité commerciale

# ✗ Avant optimisation (déclenche une erreur de personnalité publique)

- "[Nom de la célébrité] holding our coffee product in his usual style"

# ✓ Après optimisation

+ "Charismatic 35-year-old male model with confident smile, casual blazer, warmly holding a takeaway coffee cup, modern minimalist café background, professional commercial photography"

Meilleures pratiques d'ingénierie pour réduire le taux d'erreur de gpt-image-2

Si votre projet effectue des milliers d'appels à gpt-image-2 par jour, la vérification manuelle des invites n'est pas viable. Voici quelques approches d'ingénierie pour réduire le taux d'erreur de gpt-image-2.

Processus de pré-vérification pour les erreurs gpt-image-2

Avant d'appeler l'API d'image, effectuez une pré-vérification avec l'API Moderations :

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("APIYI_KEY"),

base_url="https://api.apiyi.com/v1"

)

def safe_generate(prompt: str, max_rewrites: int = 3):

# Étape 1 : Pré-vérification

mod = client.moderations.create(input=prompt)

flagged = mod.results[0].flagged

categories = mod.results[0].categories

if flagged:

offending = [k for k, v in categories.model_dump().items() if v]

raise ValueError(f"L'invite a déclenché la pré-vérification : {offending}")

# Étape 2 : Invocation du modèle

return client.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="medium"

)

La pré-vérification permet de bloquer 60 à 70 % des requêtes à haut risque, évitant ainsi les invocations inutiles.

Pipeline de réécriture automatique pour les erreurs gpt-image-2

Pour vos modèles d'invites en production, vous pouvez construire un réécrivain léger :

SENSITIVE_REPLACEMENTS = {

r"\bgun\b": "accessoire de cérémonie",

r"\bsword\b": "lame de cérémonie ornée",

r"\bblood\b": "éclaboussure rouge",

r"\bfight\b": "affrontement dramatique",

r"\bwar\b": "lutte héroïque",

r"\battack\b": "mouvement dynamique",

r"\bweapon\b": "accessoire stylisé",

r"\bkill\b": "défaite",

r"\bshoot\b": "viser",

}

import re

def desensitize(prompt: str) -> str:

out = prompt

for pattern, replacement in SENSITIVE_REPLACEMENTS.items():

out = re.sub(pattern, replacement, out, flags=re.IGNORECASE)

if not out.lower().startswith(("movie still", "video game", "theatrical")):

out = "Cinematic movie still: " + out

return out

Encapsulation de nouvelle tentative intelligente pour les erreurs gpt-image-2

Pour une stratégie de nouvelle tentative spécifique à moderation_blocked — ne réessayez jamais à l'identique, vous devez d'abord réécrire l'invite :

from openai import BadRequestError

def generate_with_rewrite(prompt: str, max_attempts: int = 3):

current = prompt

for attempt in range(max_attempts):

try:

return client.images.generate(

model="gpt-image-2",

prompt=current,

size="1024x1024"

)

except BadRequestError as e:

if "moderation_blocked" not in str(e):

raise # Les autres erreurs 400 ne doivent pas être retentées

print(f"[{attempt+1}/{max_attempts}] Blocage par la modération, application de la désensibilisation...")

current = desensitize(current)

if attempt == max_attempts - 1:

# Lors de la dernière tentative, on ajoute moderation: low

return client.images.generate(

model="gpt-image-2",

prompt=current,

moderation="low",

size="1024x1024"

)

raise RuntimeError("Toutes les stratégies de réécriture ont échoué")

Tableau de bord de conformité pour les erreurs gpt-image-2

L'environnement de production doit enregistrer les indicateurs clés de chaque violation :

| Indicateur | Usage |

|---|---|

| Taux de violation (blocages/total requêtes) | Santé globale |

Distribution par catégorie safety_violations |

Identifier les types de violations fréquents |

| Top 10 des invites déclenchant des violations | Optimiser les modèles problématiques |

| Taux de réussite après réécriture | Évaluer l'efficacité du réécrivain |

🎯 Conseil de déploiement : Considérez le taux de violation comme un indicateur SLO central. Sur une ligne de production saine, il doit être < 2 %. Un taux > 5 % indique un problème systémique dans vos modèles d'invites. Nous recommandons d'utiliser les journaux de requêtes de la console APIYI (apiyi.com) pour une analyse quotidienne et une réécriture ciblée.

FAQ sur les erreurs de gpt-image-2

Q1 : Les erreurs moderation_blocked de gpt-image-2 sont-elles facturées ?

Non. Le classificateur de sécurité intercepte la requête avant qu'elle n'atteigne le modèle, sans consommer de jetons ni de temps GPU. OpenAI et APIYI respectent cette règle. Si vous constatez des frais sur votre facture, contactez immédiatement la plateforme. Nous vous conseillons de vérifier les frais via la console APIYI (apiyi.com) pour chaque request_id afin de garantir que les requêtes bloquées sont facturées à 0.

Q2 : Pourquoi une nouvelle tentative avec la même invite échoue-t-elle ?

Parce que le classificateur de sécurité est déterministe : le résultat de classification pour une même entrée est stable, contrairement au modèle de génération qui est probabiliste. Réessayer 100 fois donnera 100 fois le même blocage. La seule solution est de modifier l'invite.

Q3 : L'option moderation: low peut-elle désactiver complètement la vérification ?

Non. low abaisse simplement le seuil de sensibilité, rendant le système plus tolérant aux contenus modérément sensibles. Cependant, les contenus extrêmement dangereux (sexe, automutilation, mineurs, symboles de haine, dirigeants politiques, etc.) seront toujours bloqués. Considérer low comme un "interrupteur" est une erreur.

Q4 : Pourquoi mon invite semble inoffensive mais est tout de même bloquée ?

Trois possibilités :

- Contexte global problématique : Les mots isolés sont inoffensifs, mais leur combinaison forme un scénario interdit.

- Polysémie : Par exemple, "shoot a photo" peut être interprété à tort comme un terme violent.

- Différences de backend : Le backend Azure est plus strict qu'une connexion directe à OpenAI.

Pour le cas n°2, ajouter un cadre contextuel ("professional photography session") aide beaucoup. Nous suggérons d'utiliser APIYI (apiyi.com) pour archiver ces "faux positifs" dans votre base de connaissances interne afin d'itérer sur vos modèles d'invites.

Q5 : Puis-je voir quel mot spécifique a déclenché l'erreur ?

L'API ne renvoie pas le mot déclencheur, uniquement la catégorie (ex: [violence]). C'est un choix de conception d'OpenAI pour éviter le contournement des filtres. Pour localiser le mot, effectuez une recherche dichotomique : divisez votre invite en deux et testez chaque partie séparément.

Q6 : Que faire en cas de violation sur une image de référence (scénario d'édition) ?

L'étape 1 du point de terminaison /v1/images/edits analyse simultanément le texte de l'invite et toutes les images de référence. Si l'image de référence elle-même est en cause :

- Vérifiez si elle contient de la violence, des allusions sexuelles ou des personnages protégés par le droit d'auteur.

- Prétraitez l'image localement (recadrage, floutage des zones sensibles).

- S'il s'agit d'une photo de personne réelle, assurez-vous de respecter les politiques sur les personnalités publiques.

Q7 : Les catégories de violation sont-elles identiques à celles de l'API Moderations d'OpenAI ?

Globalement oui, mais avec des nuances. L'API Moderations renvoie des catégories plus détaillées (11), tandis que la génération d'images utilise une granularité plus large (7-9). Utilisez l'API Moderations comme outil de pré-vérification, mais ne supposez pas une équivalence parfaite : une invite acceptée par l'API Moderations peut être bloquée par le moteur d'image.

Q8 : Peut-on contester une erreur de gpt-image-2 ?

Oui, mais avec une efficacité limitée. Le request_id de l'erreur peut être utilisé pour demander une vérification au support technique. Expérience pratique : s'il s'agit d'un faux positif (ex: contenu médical ou éducatif neutre), la plateforme peut ajouter une liste blanche. Si la règle a été réellement enfreinte, la contestation sera rejetée. Nous recommandons de soumettre vos demandes via le système de tickets d'APIYI (apiyi.com) en joignant le request_id complet et une explication du contexte métier.

Résumé : De l'erreur gpt-image-2 à une invite conforme et efficace

En parcourant les 7 chapitres de cet article, vous maîtrisez désormais l'ensemble du système de gestion des erreurs pour gpt-image-2 :

- ✅ Comprendre l'essentiel ——

moderation_blockedest une erreur 400 au niveau de la requête ; elle n'est pas facturée et ne doit pas être relancée. - ✅ Maîtriser l'architecture —— Filtrage de sécurité en deux étapes (Étape 1 : filtrage des entrées + Étape 2 : filtrage des sorties).

- ✅ Identifier les scénarios déclencheurs —— Les 7 catégories de violation et les détails des sous-catégories liées à la violence.

- ✅ Diagnostiquer les violations —— Localisation précise via le champ

safety_violations. - ✅ 5 stratégies d'optimisation —— Réécriture par désensibilisation, remplacement du sujet, déclaration de cadre, décomposition en plusieurs étapes et paramètres de modération.

- ✅ Solutions d'ingénierie —— Pré-vérification, réécriture automatique, relance intelligente et surveillance de la conformité.

Le point le plus crucial à retenir : l'erreur moderation_blocked de gpt-image-2 n'est pas un bug, mais la limite de conformité du produit. Plutôt que de se plaindre de la sévérité, il vaut mieux considérer l'« ingénierie d'invite conforme » comme une compétence de production — c'est précisément l'un des avantages concurrentiels majeurs pour le déploiement de produits IA auprès du grand public.

Si votre équipe est confrontée à des erreurs fréquentes de moderation_blocked, a besoin de mettre en place un processus d'audit de conformité des invites pour sa chaîne de production, ou souhaite utiliser des solutions d'ingénierie pour réduire le taux de violation, nous vous recommandons de demander une clé de test via APIYI (apiyi.com) et d'exécuter le modèle de code de pré-vérification et de réécriture automatique présenté dans cet article. Tous les exemples sont basés sur le SDK officiel et le service proxy API d'APIYI (champs 100 % identiques à ceux d'OpenAI), offrant une compatibilité totale pour une intégration directe dans vos propres projets.

Références

-

Fiche technique OpenAI ChatGPT Images 2.0 : Explications officielles sur les politiques de sécurité et les mécanismes de blocage.

- Lien :

deploymentsafety.openai.com/chatgpt-images-2-0/live-blocking - Note : Inclut l'architecture de filtrage en deux étapes et la liste complète des catégories de violation.

- Lien :

-

Documentation de l'API Moderations d'OpenAI : Guide officiel d'utilisation des outils de pré-vérification.

- Lien :

developers.openai.com/api/docs/guides/moderation - Note : 11 catégories de violation et méthodes d'invocation de l'API.

- Lien :

-

Politiques d'utilisation d'OpenAI : Explications faisant autorité sur les politiques d'utilisation.

- Lien :

openai.com/policies/usage-policies/ - Note : Usages interdits, responsabilités et exigences de conformité.

- Lien :

-

Guide de rédaction d'invites pour les modèles d'images GPT d'OpenAI : Meilleures pratiques officielles.

- Lien :

developers.openai.com/cookbook/examples/multimodal/image-gen-models-prompting-guide - Note : Inclut des méthodes et des exemples d'invites conformes.

- Lien :

-

Documentation d'intégration APIYI gpt-image-2 : Guide complet d'intégration en chinois.

- Lien :

docs.apiyi.com/api-capabilities/gpt-image-2/overview - Note : Inclut des explications détaillées sur les paramètres de modération et le traitement des codes d'erreur.

- Lien :

Auteur : Équipe technique APIYI

Date de publication : 27 avril 2026

Mots-clés : erreur gpt-image-2, moderation_blocked, safety_violations, modération de contenu, optimisation d'invite, APIYI, conformité OpenAI