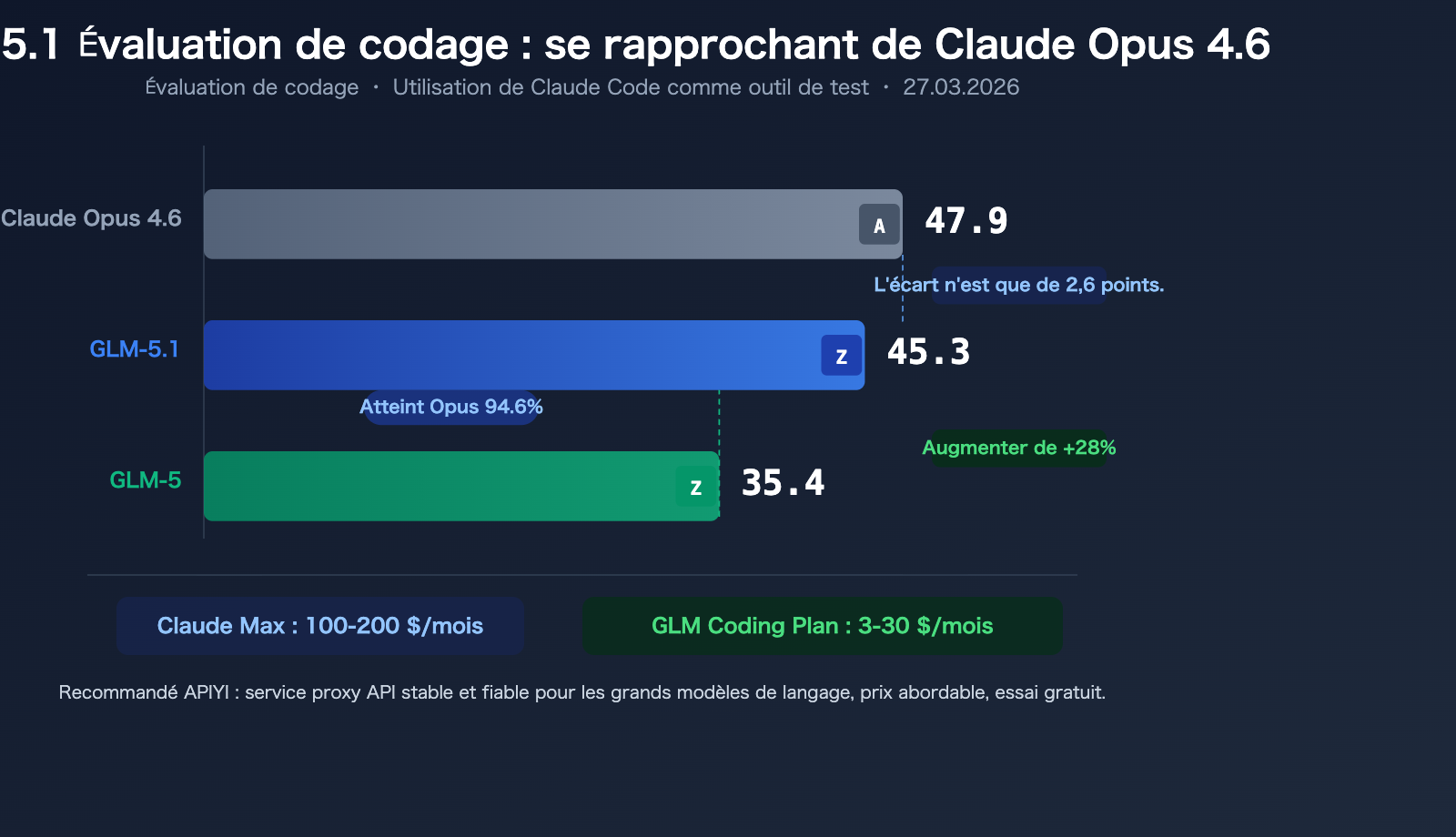

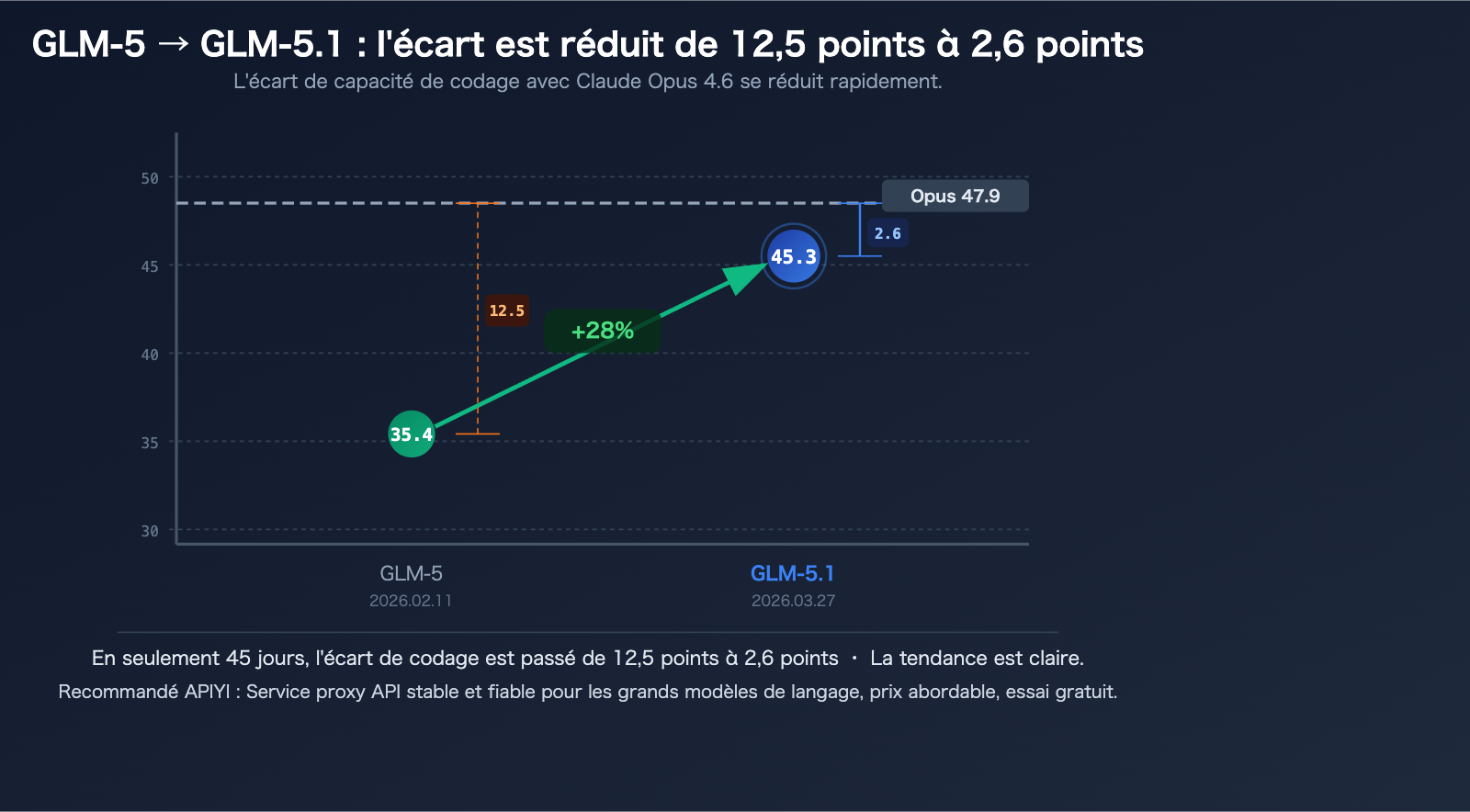

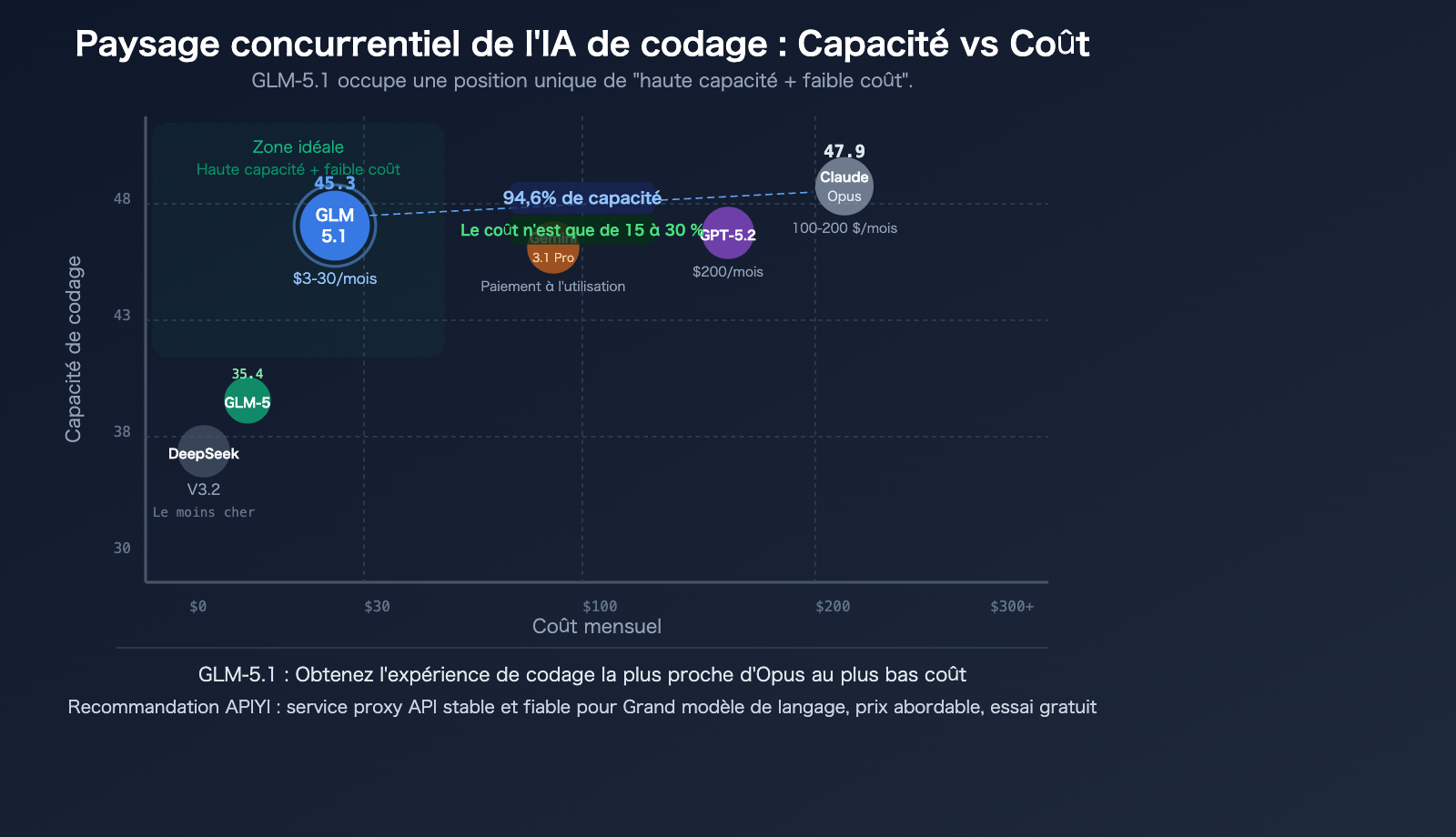

Le 27 mars 2026, Z.ai (anciennement ZhiPu AI) a officiellement annoncé : GLM-5.1 est officiellement disponible, et tous les utilisateurs du GLM Coding Plan peuvent l'utiliser. Dans un benchmark de codage utilisant Claude Code comme outil de test, GLM-5.1 a obtenu un score de 45,3 points — seulement 2,6 points de moins que les 47,9 points de Claude Opus 4.6, atteignant ainsi 94,6 % du niveau d'Opus.

Ce qui est encore plus impressionnant, c'est que GLM-5.1 a amélioré le score de 35,4 points de la génération précédente, GLM-5, de 28 % — une progression générationnelle massive.

Et quel est le prix d'entrée pour tout cela ? Le GLM Coding Plan démarre à seulement 3 $/mois (prix promotionnel), et le prix standard commence également à seulement 10 $/mois.

Valeur clé : Cet article décrypte l'amélioration des capacités de codage de GLM-5.1, les détails et le mode d'utilisation du Coding Plan, ainsi que sa valeur pratique en tant qu'alternative à haut rapport qualité-prix face aux prix officiels élevés de Claude et à une puissance de calcul occasionnellement instable. Une fois l'API disponible, APIYI l'intégrera en priorité.

Données clés : Utilisation de Claude Code comme outil de test

L'évaluation de codage (Coding Evaluation) publiée officiellement par Z.ai utilise Claude Code comme cadre de test, un détail notable — GLM-5.1 a démontré des performances proches d'Opus dans l'environnement de test de Claude lui-même.

| Modèle | Score d'évaluation de codage | Écart avec Opus | Amélioration vs GLM-5 |

|---|---|---|---|

| Claude Opus 4.6 | 47.9 | — | — |

| GLM-5.1 | 45.3 | -2.6 (94.6%) | +28% |

| GLM-5 | 35.4 | -12.5 (73.9%) | Référence |

Trois découvertes clés :

1. GLM-5.1 atteint 94.6% des performances de Claude Opus 4.6

Un écart de 2.6 points est pratiquement négligeable pour la plupart des tâches dans des scénarios de codage réels. Cela signifie que pour l'assistance au codage quotidienne, l'expérience avec GLM-5.1 est déjà très proche de celle avec Opus.

2. L'amélioration de GLM-5 à GLM-5.1 est impressionnante

De 35.4 à 45.3, soit une amélioration de 28%. Étant donné que GLM-5 a été publié en février 2026 (avec un score SWE-bench Verified de 77.8%, déjà parmi les meilleurs modèles open source), réaliser une itération aussi importante en un peu plus d'un mois témoigne de capacités d'ingénierie impressionnantes chez Z.ai.

3. Équité de l'environnement de test

L'utilisation de Claude Code comme cadre de test signifie que cette évaluation confère un avantage naturel aux modèles Claude (Claude Code étant un outil optimisé pour la série Claude). Obtenir un score de 94.6% dans ce contexte "extérieur" suggère que les capacités réelles de GLM-5.1 pourraient être encore meilleures.

Améliorations techniques de GLM-5.1 par rapport à GLM-5

Bien que le rapport technique complet de GLM-5.1 ne soit pas encore publié, on peut spéculer à partir des bases de GLM-5 et des informations connues :

| Dimension technique | GLM-5 | GLM-5.1 (connu/spéculé) |

|---|---|---|

| Paramètres totaux | 744 milliards | Non publié (estimé ≥ GLM-5) |

| Paramètres activés | 40 milliards | Non publié |

| Architecture | MoE | MoE (améliorations supposées) |

| Contexte | 200K tokens | Non publié (estimé ≥200K) |

| Données d'entraînement | 28.5T tokens | Non publié (estimé plus) |

| Licence | MIT (open source) | Confirmé open source |

| Évaluation de codage | 35.4 | 45.3 (+28%) |

Li Zixuan, responsable mondial de Z.ai, a confirmé sur Twitter le 20 mars : "Don't panic. GLM-5.1 will be open source." — Cela signifie que les poids du modèle GLM-5.1 seront finalement ouverts sous licence MIT, comme GLM-5.

🎯 Perspective de l'industrie : L'engagement open source de GLM-5.1 est très important. Cela signifie que les plateformes d'inférence tierces (y compris APIYI apiyi.com) pourront s'intégrer rapidement après le lancement officiel de l'API, et pourraient même fournir le service à un prix inférieur à celui de l'éditeur officiel.

GLM Coding Plan en détail : une solution d'IA de codage à partir de 3 dollars

Le GLM Coding Plan est un service d'IA de codage par abonnement proposé par Z.ai. Son principal argument de vente est de proposer une expérience de codage proche de celle de Claude, à un prix bien inférieur.

Comparaison des trois offres

| Offre | Prix mensuel (officiel) | Prix promotionnel | Requêtes / 5h | Recherches / mois |

|---|---|---|---|---|

| Lite | 10 $/mois | 3 $ (1er mois) | 120 | 100 |

| Pro | 30 $/mois | 15 $ (1er mois) | 600 | 1 000 |

| Max | Plus élevé | — | Plus | 4 000 |

Modèles et outils pris en charge par le Coding Plan

Modèles inclus :

- GLM-5.1 (le plus récent, score de codage 45.3)

- GLM-5 (score de codage 35.4)

- GLM-5-Turbo (version plus rapide)

- GLM-4.7

Outils de codage compatibles :

- Claude Code (via une couche de compatibilité API)

- Cline

- Kilo Code

- OpenCode

- Clawdbot / OpenClaw

Fonctionnalités supplémentaires :

- Compréhension visuelle (Vision Understanding)

- Web Search MCP

- Web Reader MCP

- Zread MCP

- Vitesse de génération de 55+ tokens/seconde

- Pas de restrictions réseau, pas de risque de suspension de compte

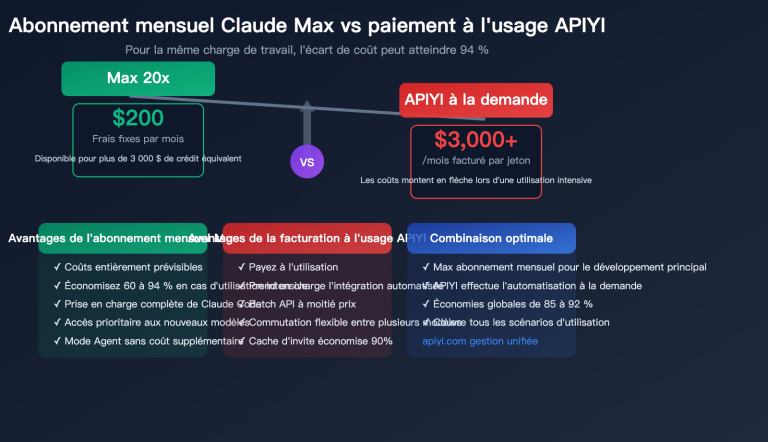

Comparaison des coûts : GLM Coding Plan vs Abonnement Claude officiel

Voici la comparaison de rapport qualité-prix la plus directe :

| Critère de comparaison | GLM Coding Lite | GLM Coding Pro | Claude Pro | Claude Max |

|---|---|---|---|---|

| Prix mensuel | 10 $ (promo 3 $) | 30 $ (promo 15 $) | 20 $ | 100-200 $ |

| Capacité de codage | 45.3 (GLM-5.1) | 45.3 (GLM-5.1) | Niveau Sonnet | Niveau Opus (47.9) |

| Pourcentage par rapport à Opus | 94,6 % | 94,6 % | ~80 % | 100 % |

| Rapport coût/capacité | Très élevé | Élevé | Moyen | Moyen à faible |

Un développeur a partagé sur Medium : "Le GLM Coding Plan me permet d'obtenir 3 fois plus d'utilisation que Claude Max pour 30 $/mois" — ce commentaire, bien que subjectif, reflète une expérience réelle de la communauté.

💰 Analyse des coûts : Si vous dépensez plus de 30 $/mois sur l'API Claude et que c'est principalement pour des tâches de codage, le plan GLM Coding Pro mérite d'être sérieusement envisagé. Obtenir un modèle dont la capacité de codage atteint 94,6 % de celle d'Opus pour 30 $/mois représente un excellent rapport qualité-prix.

Notre point de vue : Une alternative rentable lors des instabilités de Claude

En tant que plateforme d'agrégation d'API, APIYI observe quotidiennement une problématique réelle : la puissance de calcul de Claude officiel est parfois instable. Notamment pendant les heures de pointe, la latence des réponses d'Opus 4.6 augmente et les temps d'attente dans la file s'allongent, ce qui affecte la productivité des développeurs.

Pourquoi le GLM Coding Plan est-il une bonne alternative ?

Raison n°1 : La capacité de codage est déjà très proche

45,3 contre 47,9, un écart de 2,6 points est à peine perceptible dans le codage quotidien. Sauf si vous travaillez sur des architectures de code extrêmement complexes ou des tâches de raisonnement profond, GLM-5.1 est tout à fait capable.

Raison n°2 : L'écart de prix est énorme

Claude Max coûte 100-200 $/mois, GLM Coding Pro seulement 30 $. Si vous réinvestissez l'argent économisé dans des scénarios qui nécessitent vraiment Opus (via des appels API à la demande), le coût total pourrait être encore plus bas.

Raison n°3 : Pas de soucis d'instabilité de la puissance de calcul

GLM Coding Plan promet l'absence de restrictions réseau et de risque de suspension de compte. Bien que Z.ai ait lui-même rencontré des tensions sur sa capacité de calcul fin février, la gestion des ressources de son modèle par abonnement est relativement plus prévisible.

Raison n°4 : Une bonne compatibilité avec les outils

Compatibilité directe avec Claude Code — vous n'avez pas besoin de changer d'outil de codage, il suffit de modifier le point de terminaison API pour passer de Claude à GLM. Pour les développeurs habitués au flux de travail de Claude Code, le coût de migration est quasi nul.

Quand faut-il continuer à utiliser Claude ?

GLM-5.1 est une bonne alternative, mais pas la solution optimale pour tous les scénarios :

- Besoin d'une fenêtre de contexte de 1M : Claude Opus 4.6 prend en charge 1 million de tokens, la série GLM-5 est à 200K.

- Besoin d'une profondeur de raisonnement extrême : Opus conserve un avantage dans le raisonnement profond et l'analyse complexe.

- Besoin d'une sortie multimodale : La compréhension d'images et la création de longs textes de Claude sont plus performantes dans certains cas.

- Exigences de conformité en entreprise : Certaines entreprises ont des exigences spécifiques concernant leurs fournisseurs de modèles.

🎯 Stratégie recommandée : Utilisez le GLM Coding Plan comme outil principal pour le codage quotidien, et appelez Claude Opus via APIYI (apiyi.com) à la demande pour les tâches complexes. Cette combinaison "GLM quotidien + Claude artillerie lourde" peut réduire considérablement le coût total tout en garantissant les résultats.

Accès à l'API GLM-5.1 : État actuel et préparation

État actuel

Au 27 mars 2026, l'état de GLM-5.1 est le suivant :

| Canal | État | Explication |

|---|---|---|

| GLM Coding Plan (z.ai) | ✅ En ligne | Disponible pour tous les utilisateurs du Coding Plan |

| API officielle de Z.ai | ⏳ Pas encore en ligne | En attente de l'ouverture officielle |

| APIYI apiyi.com | ⏳ En attente d'intégration | Support dès la mise en ligne de l'API |

| Poids en open source | ⏳ Open source promis | Date précise non définie |

Préparatifs possibles dès maintenant

Méthode 1 : Utiliser directement GLM Coding Plan

Rendez-vous sur z.ai/subscribe pour souscrire au Coding Plan, vous pourrez alors utiliser GLM-5.1 dans Claude Code.

Méthode 2 : Appeler GLM-5 via l'API (disponible actuellement)

L'API de GLM-5 est déjà disponible, avec un tarif de 1,00 $ / M de tokens en entrée et 3,20 $ / M de tokens en sortie. Bien que son score aux benchmarks de codage (35,4) soit inférieur à celui de GLM-5.1 (45,3), il reste très performant sur d'autres tâches (SWE-bench Verified 77,8 %).

import openai

client = openai.OpenAI(

api_key="votre-clé-api",

base_url="https://api.apiyi.com/v1" # Interface unifiée d'APIYI

)

# Actuellement disponible : GLM-5

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "user", "content": "Optimise les performances de ce code Python"}

]

)

# À basculer après la mise en ligne de l'API GLM-5.1

# model="glm-5.1"

print(response.choices[0].message.content)

Voir le code complet (avec stratégie d’appel mixte GLM + Claude)

import openai

import time

# Appeler plusieurs modèles via l'interface unifiée d'APIYI

client = openai.OpenAI(

api_key="votre-clé-api",

base_url="https://api.apiyi.com/v1"

)

# Stratégie de sélection de modèle : tâches simples avec GLM, tâches complexes avec Claude

def smart_route(prompt, complexity="normal"):

"""

Sélectionne automatiquement le modèle en fonction de la complexité de la tâche

- simple : GLM-5 (coût le plus bas)

- normal : GLM-5.1 (à basculer après mise en ligne)

- complex : Claude Opus 4.6 (raisonnement le plus puissant)

"""

model_map = {

"simple": "glm-5",

"normal": "glm-5", # À changer en "glm-5.1" après mise en ligne

"complex": "claude-opus-4-6"

}

model = model_map.get(complexity, "glm-5")

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

temperature=0.7

)

elapsed = time.time() - start

return {

"model": model,

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": response.usage.total_tokens

}

# Exemple : codage quotidien avec GLM, raisonnement approfondi avec Claude

tasks = [

("Écris une implémentation Python du tri rapide", "simple"),

("Refactorise le pool de connexions à la base de données de ce microservice", "normal"),

("Conçois un mécanisme de compensation pour une transaction distribuée", "complex"),

]

for prompt, complexity in tasks:

result = smart_route(prompt, complexity)

print(f"[{complexity}] Modèle: {result['model']}")

print(f" Temps: {result['time']} | Tokens: {result['tokens']}")

print(f" Réponse: {result['content'][:100]}...\n")

🚀 Démarrage rapide : APIYI apiyi.com prend déjà en charge les appels API vers GLM-5. Dès que l'API GLM-5.1 sera officiellement mise en ligne, APIYI l'intégrera immédiatement. L'inscription offre un crédit gratuit et permet d'appeler de manière unifiée plusieurs modèles comme Claude, GPT, Gemini et GLM.

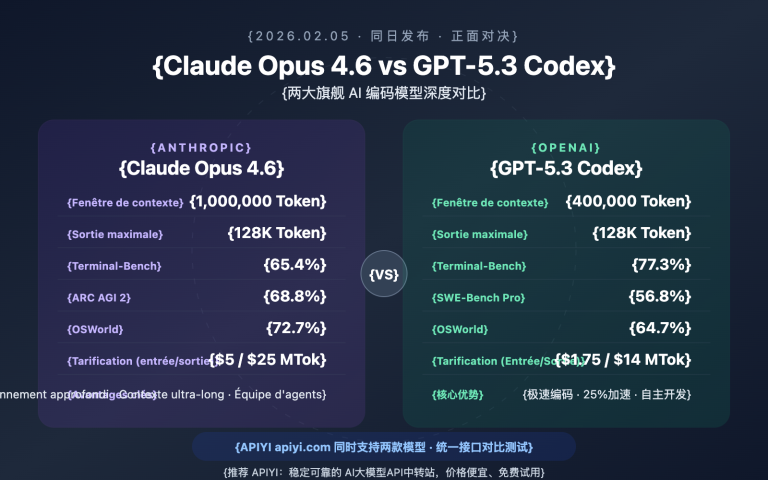

GLM-5.1 et le paysage concurrentiel des IA de codage

La sortie de GLM-5.1 rend le paysage des IA de codage encore plus intéressant :

| Modèle | Positionnement en capacité de codage | Positionnement tarifaire | État de l'API | État open source |

|---|---|---|---|---|

| Claude Opus 4.6 | Le plus puissant (47,9) | Le plus élevé | Public | Fermé |

| GLM-5.1 | Proche d'Opus (45,3) | Bas (3-30 $/mois) | Disponible via Coding Plan | Sera open source |

| Gemini 3.1 Pro | Fort (premier sur plusieurs benchmarks) | Moyen | Disponible en Preview | Fermé |

| GPT-5.2 | Fort | Élevé | Public | Fermé |

| DeepSeek V3.2 | Moyen | Le plus bas | Public | Open source |

| GLM-5 | Moyen-supérieur (35,4) | Bas | Public | Open source MIT |

Le positionnement unique de GLM-5.1 est le suivant : offrir une capacité de codage proche des modèles phares propriétaires, avec la transparence d'un modèle open source et le faible coût d'un abonnement. C'est une première – jamais un modèle open source n'avait été aussi proche du leader propriétaire en matière de capacités de codage.

Questions fréquentes

Q1 : Quand l’API GLM-5.1 sera-t-elle disponible ?

Il n'y a pas de date précise pour le moment. GLM-5.1 est déjà disponible dans le Coding Plan, mais l'interface API indépendante n'est pas encore ouverte. En se basant sur l'intervalle entre la sortie de GLM-5 et la disponibilité de son API, l'API GLM-5.1 pourrait être lancée dans quelques semaines. APIYI (apiyi.com) l'intégrera dès son ouverture officielle, vous permettant ainsi d'invoquer directement GLM-5.1 via une interface unifiée.

Q2 : Comment utiliser GLM Coding Plan avec Claude Code ?

L'API de Z.ai est compatible avec le format de l'API Anthropic. Par conséquent, Claude Code peut router les requêtes vers Z.ai en modifiant le point de terminaison de l'API. Les étapes concrètes consistent à changer, dans la configuration de Claude Code, le point de terminaison de l'API officielle d'Anthropic pour celui fourni par Z.ai, sans modifier aucun autre paramètre. Pour une configuration détaillée, référez-vous à la documentation développeur de Z.ai : docs.z.ai.

Q3 : GLM-5.1 peut-il remplacer complètement Claude Opus 4.6 ?

Sur les tâches de codage, GLM-5.1 (45,3 points) se rapproche déjà beaucoup d'Opus (47,9 points), avec une différence quasi imperceptible dans les scénarios de codage quotidiens. Cependant, Opus conserve des avantages significatifs dans les cas suivants : contexte ultra-long de 1M de tokens, raisonnement en profondeur extrême, flux de travail d'agent complexes en plusieurs étapes. Nous recommandons la stratégie "GLM quotidien + Claude pour les gros travaux" — utilisez GLM pour le codage quotidien afin de réduire les coûts, et invoquez Opus via APIYI (apiyi.com) à la demande pour les tâches complexes.

Conclusion : GLM-5.1 change la donne en matière de rapport qualité-prix pour l'IA de codage

Le lancement de GLM-5.1 est une étape importante dans le domaine de l'IA de codage en 2026 — c'est la première fois qu'un modèle open source (qui le sera prochainement) atteint 94,6 % du score de Claude Opus 4.6 dans les benchmarks de codage, pour un prix qui n'est qu'une fraction de celui d'Opus.

3 points clés :

- Capacités de codage proches du plafond : 45,3 contre 47,9, un écart de seulement 2,6 points, imperceptible au quotidien.

- Avantage prix écrasant : Coding Plan à 3-30 $/mois contre Claude Max à 100-200 $/mois.

- API à venir : APIYI intégrera l'API GLM-5.1 dès sa sortie, permettant son invocation via une interface unifiée.

À une époque où les prix officiels de Claude sont élevés et où la puissance de calcul est parfois instable, le GLM Coding Plan a déjà prouvé qu'il constituait une alternative fiable et à excellent rapport qualité-prix. Que vous choisissiez l'abonnement au Coding Plan ou que vous attendiez l'API à la demande, GLM-5.1 mérite une place dans votre boîte à outils d'IA de codage.

Auteur : APIYI Team | L'API GLM-5.1 sera prise en charge par APIYI (apiyi.com) dès son lancement. Visitez notre site pour obtenir des crédits de test gratuits et expérimenter l'invocation unifiée de multiples modèles : Claude + GLM + GPT + Gemini

📚 Références

-

Annonce officielle de Z.ai : Lancement du GLM-5.1 Coding Plan

- Lien :

z.ai/subscribe - Description : Abonnez-vous au GLM Coding Plan pour utiliser GLM-5.1

- Lien :

-

Blog officiel de Z.ai : Présentation technique du GLM-5

- Lien :

z.ai/blog/glm-5 - Description : Détails sur l'architecture, les données d'entraînement et les benchmarks du GLM-5

- Lien :

-

Documentation développeur de Z.ai : Intégration API et tarification

- Lien :

docs.z.ai/guides/overview/pricing - Description : Tarifs des modèles, spécifications d'appel API et guide d'intégration d'outils

- Lien :

-

Artificial Analysis : Évaluation indépendante du GLM-5

- Lien :

artificialanalysis.ai/models/glm-5 - Description : Données de benchmark tierces et comparaison de modèles

- Lien :

-

Dépôt GitHub GLM-5 : Poids du modèle open source

- Lien :

github.com/zai-org/GLM-5 - Description : Licence MIT open source, incluant les poids du modèle et le guide d'utilisation

- Lien :