Anmerkung des Autors: Das Modell seed-2-0-mini-260215 ist das neueste Modell der BytePlus-Plattform und der Vorreiter der Seed 2.0-Serie. Seed 2.0 Pro und Seed 2.0 Lite wurden noch nicht veröffentlicht. Aktuell ist Seed 2.0 Mini bereits auf APIYI verfügbar. Die Preise entsprechen denen der offiziellen Website, wobei Aufladungen ab 100 USD einen Bonus von mindestens 10 % erhalten – was einem Rabatt von bis zu 20 % entspricht.

Hintergrund der Entwicklung der Seed-Serie: Wie stellt man ein KI-Modell mit multimodalem Verständnis und Denkvermögen in einer Produktionsumgebung mit hoher Parallelität und geringer Latenz bereit und hält gleichzeitig die Inferenzkosten extrem niedrig? Dies ist eine zentrale Herausforderung für viele Unternehmensentwickler. In diesem Artikel wird die vollständige Methode für den Modellaufruf von Seed 2.0 Mini (seed-2-0-mini-260215) im Detail vorgestellt, damit Sie dieses leistungsstarke kleine Modell, das speziell für kostensensible Szenarien optimiert wurde, schnell beherrschen.

Kernwert: Nach der Lektüre dieses Artikels werden Sie wissen, wie Sie die 4-stufigen Schlussfolgerungsmodi von Seed 2.0 Mini konfigurieren, das 256K lange Kontextfenster für komplexe Aufgaben nutzen und in realen Projekten die kosteneffizienteste Lösung implementieren.

Seed 2.0 Mini API – Die wichtigsten Punkte

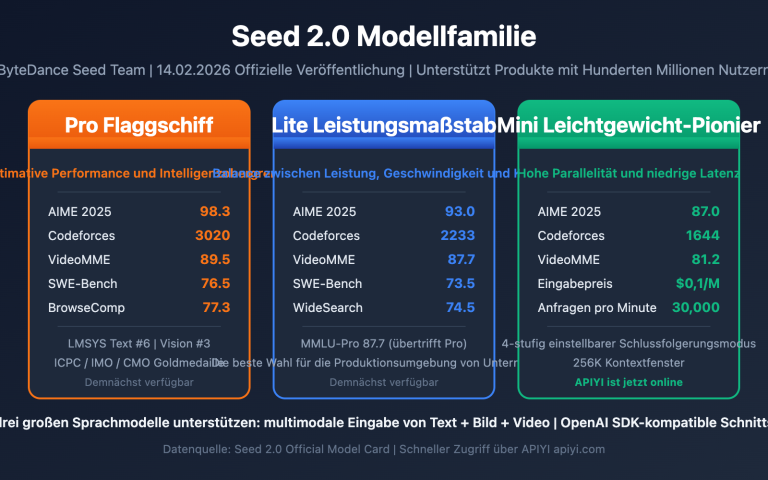

ByteDance hat am 14. Februar 2026 offiziell die Seed 2.0-Modellserie veröffentlicht, die die Varianten Pro, Lite, Mini und Code umfasst. Davon ist Seed 2.0 Mini (Modell-ID: seed-2-0-mini-260215) speziell für Anwendungen mit geringer Latenz, hoher Parallelität und Kostensensibilität konzipiert und ist das effizienteste Mitglied der gesamten Seed 2.0-Familie.

| Kernpunkt | Beschreibung | Vorteil für Entwickler |

|---|---|---|

| 4-stufiger Inferenzmodus | Einstellbar in minimal / low / medium / hi | Schlusstiefe nach Bedarf wählen, Kosten präzise steuern |

| 256K Kontextfenster | Unterstützt ultralange Texte und mehrstufige Dialoge | Verarbeitung komplexer Szenarien wie lange Dokumente oder Code-Analysen |

| Multimodales Verständnis | Unterstützt Analyse von Bildern, Videos und Dokumenten | Ein Modell für Text- und visuelle Aufgaben gleichermaßen |

| Herausragende Kosteneffizienz | Non-Reasoning-Modus verbraucht nur ca. 1/10 der Token des Reasoning-Modus | Drastische Kostensenkung bei hochfrequenten, einfachen Aufgaben |

| Stabilität auf Unternehmensniveau | Fehlerrate im Vergleich zur Vorgängergeneration um ca. 40 % gesenkt | Signifikante Steigerung der Zuverlässigkeit in ToB-Szenarien |

Seed 2.0 Mini Inferenzmodi im Detail

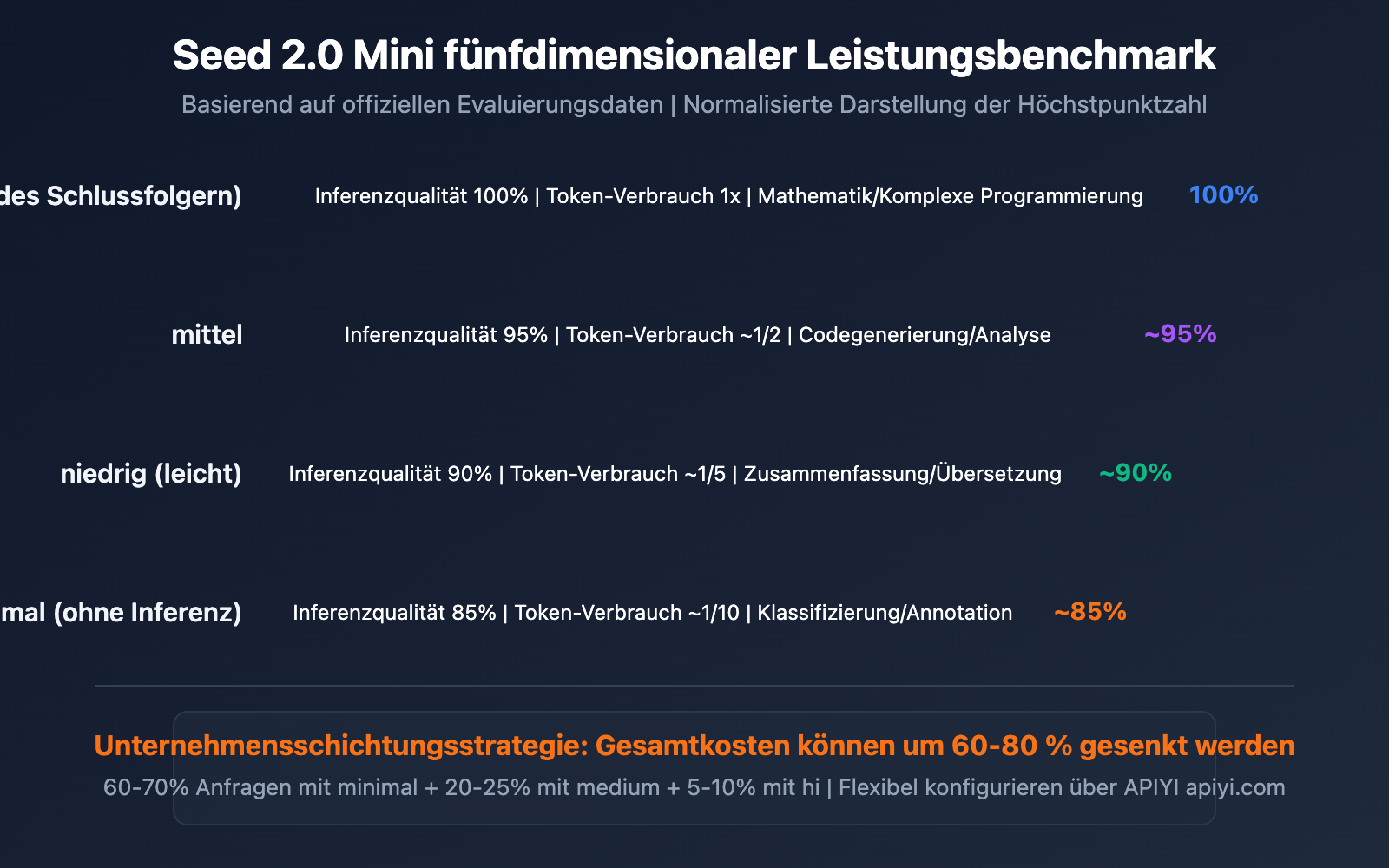

Das markanteste Merkmal von Seed 2.0 Mini ist das in vier Stufen einstellbare Inferenzsystem reasoning_effort. Entwickler können die Schlusstiefe flexibel an die Komplexität der Aufgabe anpassen:

- minimal (keine Inferenz): Überspringt die Chain-of-Thought-Inferenz vollständig und gibt das Ergebnis direkt aus. Ideal für standardisierte Aufgaben wie Klassifizierung, Formatkonvertierung oder das Ausfüllen von Vorlagen. Schnellste Reaktionszeit, niedrigster Token-Verbrauch.

- low (leichte Inferenz): Führt einfache logische Ableitungen durch. Geeignet für Informationsextraktion, einfache Fragen und Antworten sowie Zusammenfassungen.

- medium (mittlere Inferenz): Führt einen umfassenderen Inferenzprozess aus. Geeignet für Codegenerierung, Datenanalyse und Geschäftsberichte, die eine gewisse logische Tiefe erfordern.

- hi (tiefe Inferenz): Aktiviert die vollständige Chain-of-Thought-Inferenz mit maximaler Leistung. Geeignet für mathematische Beweise, komplexe Programmierung und mehrstufige logische Aufgaben.

Im minimal-Modus erreicht Seed 2.0 Mini etwa 85 % der Gesamtleistung des Denkmodus, verbraucht aber nur etwa 1/10 der Token. Das bedeutet, dass Sie in hochfrequenten, einfachen Szenarien eine extrem hohe Kosteneffizienz erzielen können.

Seed 2.0 Mini API Performance-Benchmarks

Obwohl Seed 2.0 Mini die leichteste Variante der Seed 2.0-Serie ist, überzeugt sie in zahlreichen Benchmarks und übertrifft das Vorgängermodell Seed 1.6 Flash deutlich.

Vergleich der Seed 2.0 Mini API mit der Vorgängergeneration

Seed 2.0 Mini bietet im Vergleich zum Vorgänger Seed 1.6 Flash umfassende Leistungssteigerungen. Hier ist ein Vergleich der wichtigsten Dimensionen:

| Vergleichsdimension | Seed 2.0 Mini | Seed 1.6 Flash | Steigerungsrate |

|---|---|---|---|

| Inhaltserkennung | Deutlich verbessert | Basis | Erheblich |

| Wissensbasiertes Schließen | Übertrifft Seed 1.6 Pro | Basis | Über Pro-Niveau |

| Programmierfähigkeiten | Deutlich verbessert | Basis | Erfüllt Unternehmensanforderungen |

| Agent-Fähigkeiten | Deutlich verbessert | Basis | Unterstützt komplexe Tool-Aufrufe |

| Anomalie-Muster | Reduziert um ca. 40 % | Basis | Redundanzprobleme deutlich verringert |

| Kontextlänge | 256K | — | Unterstützung für ultralangen Kontext |

| Inferenzmodi | 4 Stufen einstellbar | — | Neue Funktion |

| Visuelle Qualitätsstufen | low / high / xhigh | — | Neue Funktion |

| Multimodalität | Bild + Video + Dokument | Eingeschränkt | Umfassend erweitert |

Kernvorteile von Seed 2.0 Mini in B2B-Szenarien

Seed 2.0 Mini wurde speziell für Anwendungen auf Unternehmensebene (B2B) optimiert:

- Bildprüfung: Die Erkennungsfähigkeiten in gängigen B2B-Bereichen (Bildmoderation, Bildklassifizierung, Videoinspektion) wurden deutlich verbessert, wobei Anomalie-Muster um etwa 40 % reduziert wurden.

- Strukturierte Ausgabe: Bei der Bild-Text-Verständnis und der hochpräzisen strukturierten Ausgabe erreicht das Modell das für Unternehmen erforderliche Niveau und unterstützt die erzwungene Ausgabe per JSON Schema.

- Visuelle Qualitätskontrolle: Bietet drei Stufen für Bildqualität und Ressourcenbudget (low / high / xhigh). Der Standardmodus „high“ verbessert die Vorhersagekonsistenz, während höhere Stufen dichten Text, komplexe Diagramme und detailreiche Szenen verarbeiten können.

- Stapelverarbeitung: Speziell für Szenarien mit hoher Parallelität und Batch-Generierung optimiert. Das Modell zeigt hervorragende Leistungen bei Aufgaben wie Massenklassifizierung, Inhaltsmoderation und leichtgewichtiger Generierung.

Seed 2.0 Mini API Häufig gestellte Fragen (FAQ)

Q1: Wie wähle ich den Parameter reasoning_effort für Seed 2.0 Mini aus?

Das Kernprinzip bei der Wahl von reasoning_effort ist die „Aufgabenanpassung“. Für standardisierte Aufgaben wie Klassifizierung, Kennzeichnung oder Formatierung reicht minimal aus, um eine Genauigkeit von ca. 85 % zu erzielen, während der Token-Verbrauch nur bei etwa 1/10 liegt. Für Aufgaben, die logische Schlussfolgerungen erfordern, wie Codegenerierung oder Datenanalyse, wird medium empfohlen. Der hi-Modus ist nur für hochkomplexe Szenarien wie mathematische Beweise oder anspruchsvolles Reasoning erforderlich. Über die Plattform APIYI (apiyi.com) lassen sich die Effekte der verschiedenen Modi schnell testen, um die optimale Konfiguration zu finden.

Q2: Welche multimodalen Eingaben unterstützt Seed 2.0 Mini?

Seed 2.0 Mini unterstützt drei Eingabemodalitäten: Text, Bild und Video. Im Bereich Bild werden gängige Formate (PNG, JPEG, WebP usw.) für Analysen unterstützt, wobei drei visuelle Qualitätsstufen (low / high / xhigh) zur Verfügung stehen. Im Videobereich ermöglicht das Modell das Verständnis und die Analyse von Videoinhalten mit einem VideoMME-Score von 81,2. Auf der Plattform APIYI (apiyi.com) können Sie alle multimodalen Funktionen über eine einheitliche, OpenAI-kompatible Schnittstelle aufrufen, ohne dass zusätzliche Anpassungen erforderlich sind.

Q3: Sollte ich Seed 2.0 Mini oder Seed 2.0 Pro wählen?

Die beiden Modelle haben unterschiedliche Schwerpunkte: Mini ist auf Szenarien mit hoher Parallelität, geringer Latenz und kostensensibler Stapelverarbeitung spezialisiert. Pro hingegen strebt nach maximaler Reasoning-Leistung (AIME 2025 Score von 98,3, Codeforces-Rating von 3020). Wenn Ihre Anwendung hauptsächlich aus hochfrequenten, einfachen Aufgaben besteht (z. B. Inhaltsmoderation, Klassifizierung, Datenbereinigung), können Sie mit Mini die Kosten erheblich senken. Wenn Sie hingegen modernste Reasoning-Fähigkeiten benötigen (z. B. komplexe Mathematik, anspruchsvolle Programmierung), ist Pro die richtige Wahl.

Q4: Wie lässt sich die visuelle Qualität bei Seed 2.0 Mini stufenweise steuern?

Das visuelle Schichtsystem von Seed 2.0 Mini bietet drei Stufen: Der low-Modus eignet sich für schnelle Vorschauen und einfache Erkennung bei minimalem Ressourcenverbrauch. Der high-Modus (Standard) bietet eine höhere Konsistenz bei Vorhersagen und eine bessere Erkennungsgenauigkeit. Der xhigh-Modus wurde speziell für dichten Text, komplexe Diagramme und detailreiche Szenarien entwickelt, um anspruchsvolle visuelle Inhalte zuverlässiger zu verarbeiten. Sie können die Stufe über den Parameter image_url.detail in der API-Anfrage festlegen.

Q5: Wie migriere ich bestehende GPT/Claude-Anwendungen zu Seed 2.0 Mini?

Seed 2.0 Mini ist vollständig kompatibel mit der OpenAI SDK-Schnittstellenspezifikation, sodass der Migrationsaufwand extrem gering ist. Sie müssen lediglich die Parameter base_url und model anpassen. Der zusätzliche Parameter reasoning_effort wird über extra_body übergeben, was die bestehende Schnittstellenlogik nicht beeinträchtigt. Entwickler, die bereits die Plattform APIYI (apiyi.com) nutzen, können nahtlos wechseln, indem sie den Modellparameter einfach auf seed-2-0-mini-260215 ändern.

Seed 2.0 Mini API Zusammenfassung und Empfehlung

Seed 2.0 Mini (Modell-ID: seed-2-0-mini-260215) ist das Kernmodell der Seed 2.0-Serie von ByteDance für Szenarien mit hoher Parallelität und niedrigen Kosten. Die vier Reasoning-Stufen ermöglichen es Entwicklern, die Rechentiefe und die Kosten präzise zu steuern. Ein Kontextfenster von 256K und die multimodalen Fähigkeiten sorgen für eine hervorragende Leistung in Unternehmensanwendungen. Im Vergleich zum Vorgänger Seed 1.6 Flash bietet Seed 2.0 Mini deutliche Verbesserungen bei der Inhaltserkennung, dem Wissens-Reasoning und den Agent-Fähigkeiten, wobei Fehlermodi um etwa 40 % reduziert wurden.

Wir empfehlen den schnellen Zugriff auf die Seed 2.0 Mini API über APIYI (apiyi.com). Die Plattform bietet eine OpenAI-kompatible Schnittstelle, unterstützt den einheitlichen Modellaufruf und den flexiblen Wechsel zwischen verschiedenen gängigen Modellen. So können Sie Ihre technischen Lösungen effizient validieren und in Produktionsumgebungen bereitstellen.

Referenzen

-

Offizielle ByteDance Seed 2.0 Seite: Modellvorstellung und technische Spezifikationen

- Link:

seed.bytedance.com/en/seed2 - Beschreibung: Enthält vollständige Informationen zur Seed 2.0 Modellserie und Benchmark-Daten

- Link:

-

Seed 2.0 Model Card: Technisches Whitepaper

- Link:

github.com/ByteDance-Seed/Seed2.0 - Beschreibung: Enthält detaillierte Informationen zur Modellarchitektur, zu Trainingsmethoden und Evaluierungsdaten

- Link:

-

Seed-Modellliste: Alle verfügbaren Modelle

- Link:

seed.bytedance.com/en/models - Beschreibung: Enthält Spezifikationen für die gesamte Modellserie (Pro, Lite, Mini, Code)

- Link:

Autor: APIYI Team | Erfahren Sie mehr über Tipps für Modellaufrufe von KI-Modellen im APIYI (apiyi.com) Technik-Blog