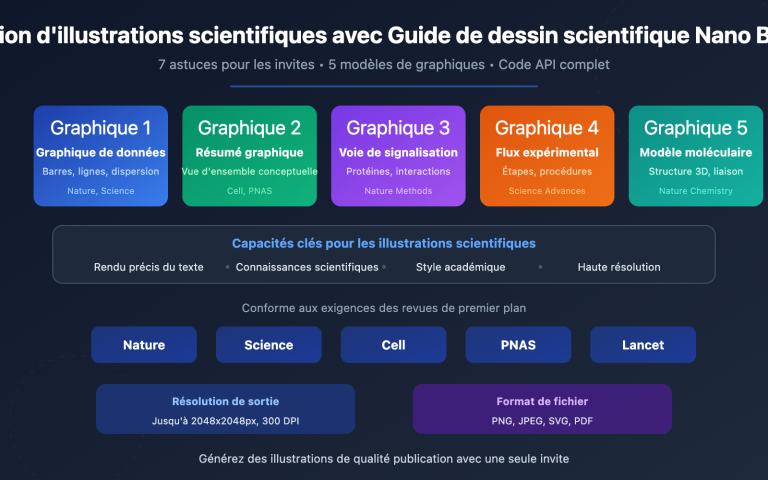

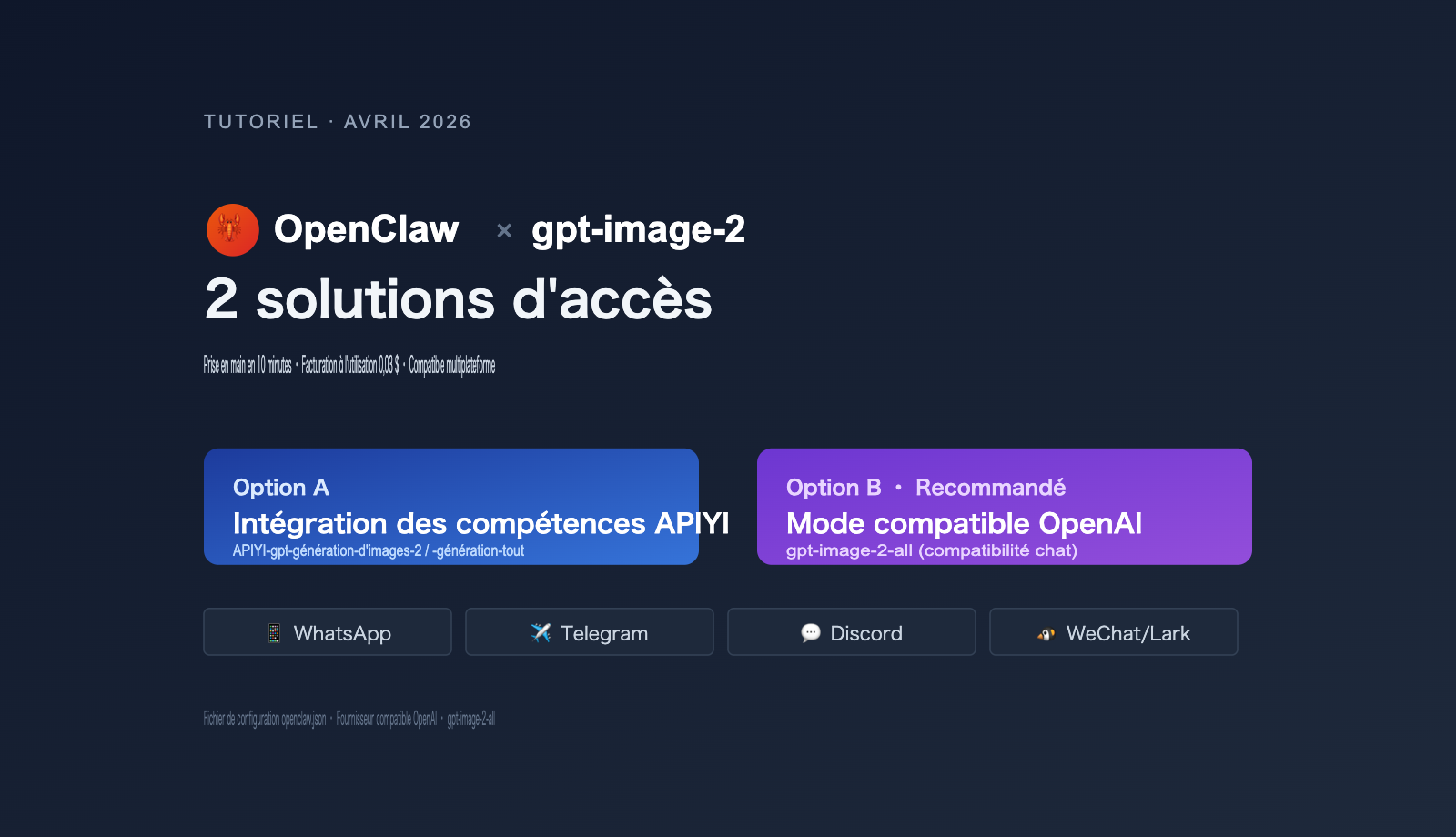

Conclusion en une phrase : il existe deux chemins pour intégrer gpt-image-2 dans OpenClaw — la solution A utilise les GPT-Image Skills d'APIYI, ce qui se fait en 5 minutes et convient aux clients prenant en charge les Skills comme Codex CLI ou Cursor ; la solution B utilise le mode de compatibilité de chat OpenAI + le modèle inverse officiel gpt-image-2-all, avec une facturation à l'utilisation (0,03 $ par requête, avant remise), ce qui est idéal pour les scénarios où OpenClaw génère des images directement via des plateformes de messagerie comme WhatsApp, Telegram ou Discord.

OpenClaw (github.com/openclaw/openclaw) est l'un des agents IA autonomes open source les plus suivis en 2026, prenant en charge plus de 20 plateformes de messagerie telles que WhatsApp, Telegram, Slack, Discord, iMessage, Feishu, WeChat et WeChat Work. Il est intrinsèquement indépendant du modèle (model-agnostic) et se connecte aux services API tiers via le protocole compatible OpenAI, ce qui offre une porte d'entrée parfaite pour des modèles d'image de premier plan comme gpt-image-2.

Cet article explique en détail les différences entre les deux solutions d'intégration, de la sélection de l'architecture à la configuration finale, et fournit le code de configuration openclaw.json prêt à l'emploi.

I. Pourquoi OpenClaw nécessite une solution spécifique pour se connecter à gpt-image-2

La première réaction de nombreux utilisateurs est : "OpenClaw ne prend-il pas déjà en charge OpenAI ? Il suffit de configurer une clé API OpenAI, non ?" Cette idée est correcte en théorie, mais il y a 3 problèmes incontournables lors de la mise en œuvre technique.

1.1 Trois limites de l'utilisation directe de l'API officielle d'OpenAI

| Limite | Manifestation concrète | Impact |

|---|---|---|

| Accès géographique | Impossible de se connecter directement à api.openai.com depuis la Chine continentale ou certaines régions d'Asie du Sud-Est | Le service ne peut pas démarrer |

| Seuil de facturation | Nécessite une carte bancaire étrangère + Tier 1 minimum (Tier 5 requis pour une utilisation stable de l'API image) | Difficile à satisfaire pour les particuliers/petites équipes |

| Vérification de l'organisation | Les paramètres haute qualité de gpt-image-2 nécessitent une vérification de l'organisation (reconnaissance faciale) | Les développeurs locaux sont bloqués à l'étape de vérification |

🎯 Conseil pour une prise en main rapide : Si vous avez déjà intégré d'autres modèles dans OpenClaw (comme Claude), il vous suffit de remplacer la configuration

models.providerspour rendregpt-image-2disponible sur toutes les plateformes de messagerie prises en charge par OpenClaw (WhatsApp/Telegram/Discord, etc.). Nous recommandons de passer par la plateforme APIYI (apiyi.com), qui a déjà résolu les trois problèmes mentionnés ci-dessus et propose des nœuds à faible latence en Chine ainsi qu'une facturation à l'utilisation.

1.2 Deux mécanismes internes d'OpenClaw pour la génération d'images

OpenClaw dispose de deux chemins d'implémentation pour la génération d'images en interne :

Chemin A : Utilisation de l'outil image_generate

- Configuration : models.providers.openai.baseUrl

- Appel : API standard OpenAI Images (POST /v1/images/generations)

- Application : gpt-image-2 / gpt-image-1 / DALL-E 3

Chemin B : Utilisation de l'outil chat completions

- Configuration : Fournisseur personnalisé compatible OpenAI

- Appel : API standard Chat (POST /v1/chat/completions)

- Application : Tout "modèle d'image conversationnel" capable de renvoyer des images dans le flux de discussion

Compréhension clé : gpt-image-2-all est un modèle d'image "compatible chat" fourni par APIYI. Il encapsule la capacité de génération d'images dans le protocole standard de chat completions, et renvoie directement l'URL de l'image dans le format de réponse. Cette conception permet à OpenClaw de l'appeler comme un modèle de conversation ordinaire, sans avoir besoin de basculer vers une API d'image dédiée.

1.3 Différences essentielles entre les deux solutions

| Dimension | Solution A : Skills | Solution B : Mode compatible OpenAI |

|---|---|---|

| Méthode d'appel | Déclenché via un Skill préinstallé | Appel standard chat completions |

| Exigences client | Nécessite la prise en charge des Skills (Codex CLI/Cursor, etc.) | Tout client compatible OpenAI |

| Adaptation OpenClaw | Support indirect (via sous-appel d'Agent) | ✅ Support direct |

| Coût de déploiement | Nécessite une installation npm + configuration des variables d'environnement | Modification de openclaw.json uniquement |

| Type de modèle | gpt-image-2 (officiel) / gpt-image-2-all (inverse officiel) | gpt-image-2-all (inverse officiel, recommandé) |

| Mode de facturation | Par jeton / Par image | 0,03 $ par requête (avant remise) |

| Scénarios d'utilisation | Génération d'images à partir de code dans les outils de développement | Génération d'images par conversation sur les plateformes de messagerie |

II. Option A : Intégrer gpt-image-2 via les Skills APIYI

Si votre flux de travail consiste à générer des images tout en exécutant des tâches via l'agent OpenClaw dans des outils de développement comme Codex CLI, Cursor, OpenCode ou Gemini CLI, l'approche par Skills est la plus élégante.

2.1 Deux modèles disponibles pour les Skills

APIYI a publié deux Skills en open source sur GitHub (auteur : wuchubuzai2018, dépôt : expert-skills-hub) :

| Nom du Skill | Modèle sous-jacent | Caractéristiques | Scénarios recommandés |

|---|---|---|---|

apiyi-gpt-image-2-gen |

gpt-image-2 (officiel) | Officiel OpenAI, qualité optimale | Projets commerciaux, besoin d'indemnisation |

apiyi-gpt-image-2-all-gen |

gpt-image-2-all (inversé) | Facturation à l'usage, accès facilité | Projets personnels, prototypage rapide |

2.2 Installation des Skills (3 commandes)

# 1. Installation de la version officielle (recommandée pour le commercial)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub --skill apiyi-gpt-image-2-gen

# 2. Ou installation de la version inversée (facturation à l'usage)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub --skill apiyi-gpt-image-2-all-gen

# 3. Configuration des variables d'environnement

export APIYI_API_KEY="sk-votre-cle-depuis-la-console-apiyi"

🎯 Obtention de la clé API : Après avoir créé votre compte, rendez-vous sur la page "API Keys" pour générer une nouvelle clé commençant par

sk-. Cette clé est universelle pour tous les services proposés, incluant les modèles officiels et inversés.

2.3 Appeler les Skills installés dans OpenClaw

OpenClaw permet, via la configuration des agents, d'effectuer des sous-appels aux Skills installés lors de l'exécution de tâches complexes :

# Extrait de configuration openclaw (exemple)

agents:

- id: image-helper

description: "Assistant de génération d'images"

skills:

- apiyi-gpt-image-2-gen

- apiyi-gpt-image-2-all-gen

triggers:

- keyword: "générer une image"

- keyword: "dessine"

En pratique, il suffit d'envoyer un message sur la plateforme connectée à OpenClaw (par exemple Telegram) :

@OpenClawBot Génère-moi une illustration de café style cyberpunk, 1024x1024

OpenClaw va alors :

- Identifier le mot-clé et activer l'agent image-helper.

- Appeler le Skill apiyi-gpt-image-2-gen.

- Invoquer le modèle

gpt-image-2via la plateforme APIYI. - Renvoyer l'URL de l'image dans la conversation.

2.4 Avantages et limites de l'approche Skills

Avantages :

- ✅ Réutilisation du code communautaire, pas besoin de gérer la logique de génération.

- ✅ Optimisation automatique des invites, gestion des erreurs et conversion de formats.

- ✅ Compatibilité native avec les outils de développement (Codex CLI/Cursor).

Limites :

- ❌ La prise en charge des Skills par OpenClaw dépend de la configuration spécifique de l'agent.

- ❌ Nécessite un environnement Node.js.

- ❌ Pas de fonctionnement "clé en main" pour les plateformes de messagerie simples (ex: WhatsApp).

Si vous utilisez OpenClaw principalement pour des plateformes de messagerie, passez directement à l'Option B.

III. Option B : Intégration via le mode compatible OpenAI pour gpt-image-2-all

C'est la méthode la plus adaptée aux scénarios classiques d'OpenClaw. Elle consiste à modifier la configuration models.providers d'OpenClaw pour enregistrer APIYI comme un fournisseur compatible OpenAI, puis à appeler le modèle gpt-image-2-all, une version optimisée pour le dialogue.

3.1 Modifier la configuration openclaw.json

Le fichier de configuration principal d'OpenClaw se trouve dans ~/.openclaw/openclaw.json (macOS/Linux) ou %APPDATA%\openclaw\openclaw.json (Windows).

{

"models": {

"providers": {

"apiyi": {

"api": "openai-completions",

"baseUrl": "https://api.apiyi.com/v1",

"apiKey": "sk-votre-cle-depuis-la-console-apiyi",

"models": [

{

"id": "gpt-image-2-all",

"name": "GPT Image 2 (compatible dialogue)",

"contextWindow": 8000,

"maxTokens": 4096,

"capabilities": ["text", "image_generation"]

}

]

}

}

},

"gateway": {

"http": {

"endpoints": {

"chatCompletions": {

"enabled": true

}

}

}

}

}

🎯 Configuration base_url : La baseUrl ci-dessus doit impérativement se terminer par

/v1. Le point de terminaison standard est parfaitement compatible avec l'interface officielle d'OpenAI, aucun autre paramètre n'est requis.

3.2 Redémarrer OpenClaw et vérifier

# Redémarrer le service OpenClaw (selon votre méthode d'installation)

openclaw restart

# Ou via systemd

sudo systemctl restart openclaw

# Vérifier que le fournisseur est bien chargé

openclaw models list | grep apiyi

Exemple de sortie réussie :

Provider: apiyi (status: ✓ healthy)

Models:

- apiyi/gpt-image-2-all (chat + image_generation)

3.3 Appeler via une plateforme de messagerie

Une fois configuré, n'importe quelle plateforme de messagerie connectée à OpenClaw peut générer des images. Exemple avec Telegram :

[Message utilisateur]

Dessine un petit chat en combinaison spatiale assis sur la surface de la lune, style cartoon

[Réponse OpenClaw]

🎨 Génération de l'image en cours...

[Image] https://files.apiyi.com/generated/xxx.png

✅ Génération terminée, coût : 0,03 $

3.4 Exemple complet d'appel chat completions (pour les développeurs)

Si vous souhaitez déboguer au niveau du code, voici comment OpenClaw appelle gpt-image-2-all en interne :

import openai

client = openai.OpenAI(

api_key="sk-votre-cle",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-image-2-all",

messages=[

{

"role": "user",

"content": "Dessine un petit chat en combinaison spatiale assis sur la surface de la lune, style cartoon"

}

]

)

# La réponse contient l'URL de l'image (format Markdown)

print(response.choices[0].message.content)

# Sortie :

📦 Version complète avec gestion des erreurs (cliquer pour dérouler)

import os

import openai

import logging

from openai import APIError, RateLimitError

client = openai.OpenAI(

api_key=os.environ["APIYI_API_KEY"],

base_url="https://api.apiyi.com/v1",

timeout=120.0 # La génération d'images nécessite un délai d'attente plus long

)

def generate_image_via_chat(prompt: str, max_retries: int = 3):

"""Appel de gpt-image-2-all via chat completions"""

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model="gpt-image-2-all",

messages=[{"role": "user", "content": prompt}],

stream=False

)

content = response.choices[0].message.content

return parse_image_url(content)

except RateLimitError:

logging.warning(f"Limite de débit atteinte, tentative {attempt+1}/{max_retries}")

continue

except APIError as e:

logging.error(f"Erreur API : {e}")

if attempt == max_retries - 1:

raise

return None

def parse_image_url(content: str) -> str:

"""Extraire l'URL de l'image de la réponse Markdown"""

import re

match = re.search(r'!\[.*?\]\((.*?)\)', content)

return match.group(1) if match else None

if __name__ == "__main__":

url = generate_image_via_chat(

"Dessine un petit chat en combinaison spatiale assis sur la surface de la lune, style cartoon"

)

print(f"URL de l'image : {url}")

IV. gpt-image-2 vs gpt-image-2-all : Choisir le bon modèle

La question qui revient le plus souvent chez les utilisateurs d'OpenClaw est : faut-il privilégier la version officielle (via service proxy API) ou la version "inversée" ? Tout dépend de votre cas d'usage et de vos priorités.

4.1 Différences clés entre les deux modèles

| Dimension | gpt-image-2 (Officiel) | gpt-image-2-all (Inversé) |

|---|---|---|

| Interface d'appel | /v1/images/generations |

/v1/chat/completions |

| Adaptation OpenClaw | Appel indirect via Skills | Outil de chat direct |

| Modèle de facturation | Par token + taille de sortie | Par requête : 0,03 $ (avant remise) |

| Coût par unité | 0,04 $ – 0,19 $ (selon qualité) | 0,03 $ fixe |

| Sécurité du contenu | Double couche OpenAI (auto/low) | Politique de sécurité source |

| Indemnisation | ✅ Applicable | ❌ Non applicable |

| Vitesse de réponse | 8-15 secondes | 10-20 secondes |

| Résolution supportée | Jusqu'à 2K | Jusqu'à 1024×1024 |

| Usage commercial | ✅ Recommandé | Interne/Prototypage uniquement |

4.2 Conseils de sélection selon le scénario

| Scénario métier | Modèle recommandé | Raison |

|---|---|---|

| Usage perso OpenClaw + Telegram | gpt-image-2-all | Moins cher à la requête, config simple |

| SaaS entreprise avec support OpenClaw | gpt-image-2 | Conformité commerciale, indemnisation |

| Génération en masse pour e-commerce | gpt-image-2 | Résolution 2K, licence commerciale |

| Outil de brainstorming interne | gpt-image-2-all | Coûts maîtrisés, suffisant pour un prototype |

| Génération d'images éducatives | gpt-image-2-all | Faible coût unitaire, idéal pour le lot |

🎯 Stratégie hybride suggérée : Pour vos projets, nous recommandons d'utiliser

gpt-image-2-alldurant la phase de développement pour contrôler les coûts, puis de basculer surgpt-image-2pour la mise en production. Sur la plateforme APIYI (apiyi.com), les deux modèles partagent la même clé API ; il suffit de modifier le champmodeldans votre requête pour effectuer la transition, ce qui rend le coût de migration quasi nul.

4.3 Comparaison des coûts

Imaginons un robot de groupe OpenClaw traitant 100 requêtes de génération d'images par jour :

| Modèle | Prix unitaire | Coût journalier | Coût mensuel (30 jours) | Coût annuel |

|---|---|---|---|---|

| gpt-image-2 (haute qualité) | 0,19 $ | 19 $ | 570 $ | 6 840 $ |

| gpt-image-2 (moyen) | 0,07 $ | 7 $ | 210 $ | 2 520 $ |

| gpt-image-2-all | 0,03 $ | 3 $ | 90 $ | 1 080 $ |

| gpt-image-2-all (après remise) | ~0,02 $ | 2 $ | 60 $ | 720 $ |

Analyse clé : Pour un déploiement OpenClaw personnel ou pour une petite équipe, choisir gpt-image-2-all permet d'économiser plus de 5 000 $ par an, sans que les différences fonctionnelles ne soient réellement perceptibles dans un contexte de messagerie.

V. Scénarios pratiques : OpenClaw + gpt-image-2

Maintenant que nous avons abordé les principes et la configuration, examinons quelques cas d'usage concrets et reproductibles.

5.1 Scénario 1 : Assistant de génération d'images pour groupe Telegram

Configuration : OpenClaw connecté à Telegram + fournisseur personnalisé APIYI + gpt-image-2-all

Expérience utilisateur :

[Membre du groupe A]

@OpenClawBot dessine-moi une illustration de dessin animé pour la réunion du lundi matin, avec un développeur fatigué et une grande tasse de café

[OpenClawBot]

🎨 Génération en cours, environ 15 secondes...

[Affichage de l'image]

✅ Généré (coût : 0,03 $)

👍 Si vous aimez, envoyez-moi une ⭐️

Points clés de configuration :

- Ajoutez la configuration du canal Telegram dans

openclaw.json. - Définissez des déclencheurs par mots-clés pour la génération d'images : "dessine", "génère une image", "draw", "create image".

- Activez la limitation de débit (rate limiting) pour éviter les abus des membres du groupe.

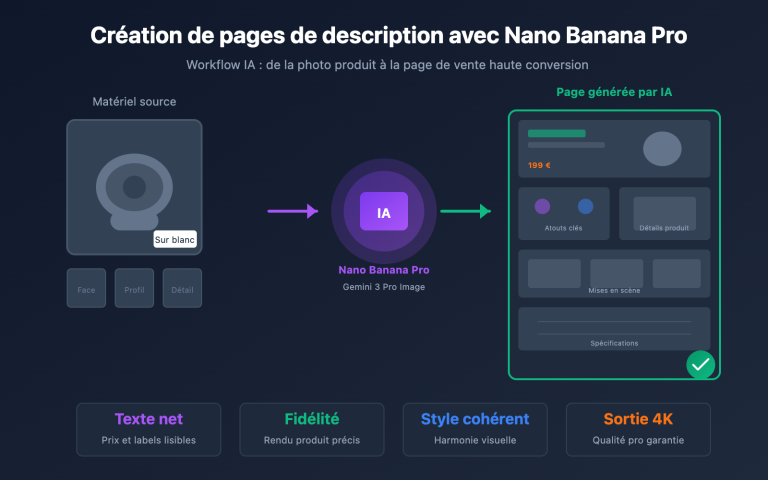

5.2 Scénario 2 : Illustration automatique pour le service client WhatsApp

Contexte métier : Un agent de service client e-commerce répond aux clients sur WhatsApp et a besoin de générer rapidement des images de mise en situation des produits.

Configuration :

{

"agents": {

"wa-cs-agent": {

"channel": "whatsapp",

"model": "apiyi/gpt-image-2-all",

"system_prompt": "Tu es un assistant de service client e-commerce. Lorsque les utilisateurs posent des questions sur un produit, tu peux générer des images de mise en situation pour illustrer tes explications.",

"tools": ["image_generate", "knowledge_search"]

}

}

}

Exemple de dialogue :

[Client]

Est-ce que ces écouteurs Bluetooth ont un beau rendu une fois portés ?

[Agent service client]

Je vous génère une image de référence montrant le produit porté 👇

[Image : Scène d'un jeune faisant du jogging en extérieur avec les écouteurs Bluetooth]

Vous pouvez vous baser sur cet exemple. Nos écouteurs ne pèsent que 8g, ils ne sont pas lourds même après une utilisation prolongée 🏃

5.3 Scénario 3 : Robot de création de contenu pour communauté Discord

Contexte métier : Sur un serveur Discord de jeu vidéo, l'administrateur souhaite que le robot puisse générer des portraits de personnages de jeu selon la description des utilisateurs.

Approche de mise en œuvre :

- Connexion d'OpenClaw à Discord.

- Utilisation de la commande slash

/generatepour déclencher la génération d'images. - Gestion des droits basée sur les rôles des utilisateurs (5 fois par jour pour les utilisateurs standards, illimité pour les membres premium).

- Appel de

gpt-image-2-allpour optimiser les coûts.

Extrait de code pour la commande Discord :

@bot.command(name="generate")

async def generate_image(ctx, *, prompt: str):

# Vérification des droits utilisateur et du quota quotidien

if not check_quota(ctx.author):

await ctx.send("❌ Quota quotidien épuisé, passez au niveau supérieur pour lever la limite")

return

# Appel du point de terminaison chat completions d'OpenClaw

image_url = await openclaw_client.generate(

model="apiyi/gpt-image-2-all",

prompt=prompt

)

await ctx.send(f"🎨 {ctx.author.mention} Voici le portrait de ton personnage :\n{image_url}")

decrement_quota(ctx.author)

5.4 Scénario 4 : Outils internes pour WeChat Entreprise et Feishu

Contexte métier : L'entreprise a besoin de générer rapidement des affiches de réunion, des images pour les réseaux sociaux ou des bannières d'événements.

Stratégie de configuration OpenClaw :

- Connexion aux deux canaux : WeChat Entreprise et Feishu.

- Configuration pour utiliser

gpt-image-2(proxy officiel, conforme pour un usage commercial). - Ajout d'une vérification par mots-clés de la marque (pour éviter de générer des logos de concurrents).

- Archivage de toutes les images générées dans un stockage objet interne pour une réutilisation ultérieure.

🎯 Conseil d'intégration en entreprise : Pour les scénarios d'entreprise, il est recommandé d'utiliser le modèle via proxy officiel (

gpt-image-2) afin de garantir une protection par indemnisation. Il est également conseillé de passer par une plateforme de service proxy API comme APIYI (apiyi.com), qui prend en charge les comptes professionnels et la facturation mensuelle, facilitant ainsi la comptabilité et l'audit de conformité.

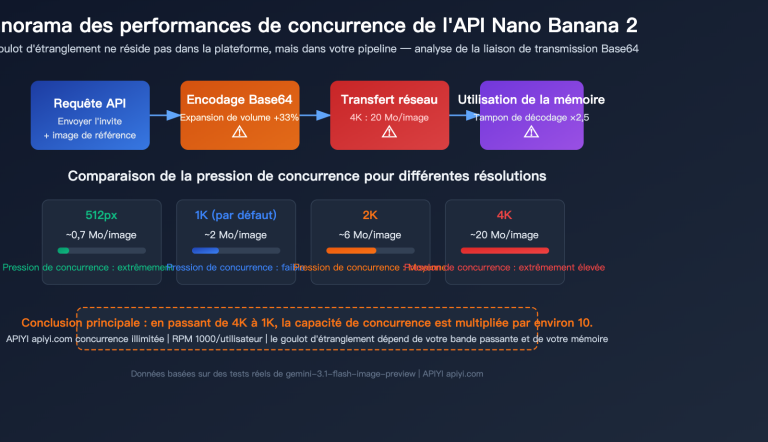

VI. Comment est calculé le tarif de 0,03 $ par invocation : Transparence des coûts

De nombreux utilisateurs s'interrogent sur la signification exacte de la « facturation par invocation ». Cette section clarifie la logique tarifaire de gpt-image-2-all.

6.1 Détails des coûts par invocation

Règles de facturation gpt-image-2-all (avant remise)

─────────────────────────────────

Coût de génération de base : 0,03 $ / invocation

├─ Résolution standard 1024×1024 : inclus

├─ 1024×1792 (image verticale) : inclus

├─ 1792×1024 (image horizontale) : inclus

└─ Requêtes échouées (violations de sécurité) : non facturées

Coûts additionnels : 0 $

├─ Pas de facturation par jeton (token)

├─ Pas de facturation par octet d'image

└─ Indépendant de la longueur de l'invite

6.2 Comparaison des coûts avec les modèles officiels

| Mode d'invocation | Prix unitaire (avant remise) | Remarques |

|---|---|---|

| gpt-image-2 basse qualité 1024² | ~0,04 $ | Calculé par jeton |

| gpt-image-2 qualité moyenne 1024² | ~0,07 $ | Calculé par jeton |

| gpt-image-2 haute qualité 1024² | ~0,19 $ | Calculé par jeton |

| gpt-image-2 haute 2K | ~0,27 $ | Prime haute résolution |

| gpt-image-2-all (toute résolution) | 0,03 $ | Prix fixe par invocation |

6.3 Coût réel après remise

La plateforme APIYI propose des remises par paliers selon le montant de la recharge :

| Montant de la recharge | Taux de remise | Prix unitaire réel gpt-image-2-all |

|---|---|---|

| < 50 $ | Aucune remise | 0,030 $ |

| 50 $ – 200 $ | 10 % | 0,027 $ |

| 200 $ – 1000 $ | 20 % | 0,024 $ |

| 1000 $ + | 30 % | 0,021 $ |

| Facturation entreprise | Prix négocié | Jusqu'à 0,018 $ |

🎯 Conseil d'optimisation des coûts : Si votre déploiement OpenClaw prévoit plus de 5 000 générations d'images par mois, nous vous recommandons de contacter l'équipe commerciale d'APIYI sur apiyi.com pour demander un plan de facturation entreprise. Vous pourrez obtenir des tarifs inférieurs à -30 %, idéal pour les développeurs et les équipes de startup spécialisées dans l'IA.

6.4 Pourquoi la facturation par invocation est plus adaptée à OpenClaw que par jeton

OpenClaw est principalement utilisé sur des plateformes de messagerie où la longueur des requêtes des utilisateurs varie considérablement :

- Invite courte : « Dessine un chat » (~5 jetons)

- Invite longue : « Dessine une vue nocturne d'une ville futuriste style cyberpunk, avec des néons se reflétant sur les rues humides, des voitures volantes au loin… » (~80 jetons)

Si la facturation était basée sur les jetons, les utilisateurs ayant de longues invites auraient une « charge mentale » les poussant à raccourcir leurs descriptions, ce qui nuirait à la qualité de l'image. La facturation par invocation permet aux utilisateurs de se concentrer sur la qualité de la description plutôt que sur la longueur des jetons — c'est le concept fondamental derrière la conception de gpt-image-2-all.

VII. FAQ sur l'utilisation de gpt-image-2 avec OpenClaw

Q1 : La configuration par défaut d'OpenClaw prend-elle en charge gpt-image-2 ?

Non. Par défaut, OpenClaw ne prend en charge que l'API officielle d'OpenAI. Les utilisateurs en Chine continentale ne peuvent pas s'y connecter directement, et gpt-image-2 nécessite un compte de niveau Tier 5 ou supérieur pour une utilisation stable. Vous devez utiliser un fournisseur personnalisé (par exemple, configurer APIYI comme service compatible OpenAI) pour pouvoir l'utiliser.

Q2 : J'ai modifié openclaw.json, mais OpenClaw ne reconnaît pas le nouveau fournisseur ?

Étapes de vérification :

- Vérification du format JSON :

cat ~/.openclaw/openclaw.json | jq .(aucune erreur signifie que le format est correct) - Redémarrage du service :

openclaw restartou la commande systemctl correspondante - Consultation des journaux :

openclaw logs --tail 100pour vérifier s'il y a des erreurs de chargement du fournisseur - Vérification de la baseUrl : assurez-vous qu'elle se termine par

/v1, sans barre oblique finale (/v1/) - Vérification de la clé API : confirmez dans le tableau de bord que la clé est toujours valide

Q3 : Lors de l'invocation de gpt-image-2-all, je reçois une erreur "model not found" ?

C'est généralement dû à l'une des raisons suivantes :

- Le champ

iddans le tableaumodelsest mal orthographié (il doit êtregpt-image-2-all, pasgpt-image-2-all-model) - Le champ

apiest défini suropenaiau lieu deopenai-completions - La version d'OpenClaw est trop ancienne (nécessite ≥ v0.45 pour une prise en charge complète des fournisseurs personnalisés)

Q4 : Les images générées par gpt-image-2-all peuvent-elles être utilisées commercialement ?

Sur le plan juridique : APIYI précise dans ses conditions d'utilisation les restrictions liées aux modèles inversés. Pour un usage commercial strict, nous recommandons d'utiliser les modèles officiels (gpt-image-2). La raison est que le canal inversé viole les conditions d'utilisation d'OpenAI, et les images produites ne sont pas couvertes par les clauses d'indemnisation.

Choix pratique :

- Projets personnels, outils internes, prototypage : ✅ Utilisez gpt-image-2-all

- Publicités, livrables clients, supports de marque : ✅ Utilisez gpt-image-2

Q5 : L'invocation de gpt-image-2-all dans WhatsApp/Telegram expire souvent ?

Le temps de génération réel d'une image est de 10 à 20 secondes. Si la plateforme de messagerie affiche une expiration, cela peut être dû à :

- Une configuration

requestTimeouttrop courte dans OpenClaw (recommandé ≥ 60 secondes) - Instabilité réseau (les nœuds de relais à Hong Kong ou Singapour peuvent améliorer la latence)

- Pic de charge du modèle (nous recommandons d'ajouter une logique de nouvelle tentative, le taux de succès après un nouvel essai est généralement > 95 %)

Q6 : Une clé API peut-elle être utilisée simultanément par plusieurs instances OpenClaw ?

Oui. Mais nous recommandons :

- De limiter le QPS total par clé à 50 (pour éviter le bridage)

- D'utiliser plusieurs clés pour répartir la charge lors de déploiements à grande échelle (10+ instances)

- D'activer les « journaux d'utilisation » dans le tableau de bord pour faciliter le dépannage entre instances

Q7 : Comment enregistrer définitivement les images générées par OpenClaw dans mon propre stockage objet ?

Par défaut, OpenClaw renvoie directement l'URL de l'image à la plateforme de messagerie, mais ces URL ont généralement une durée de validité limitée (24-72 heures). Si vous avez besoin d'un stockage permanent :

# Configuration dans le hook de l'agent OpenClaw

async def post_image_generation_hook(image_url: str):

# Télécharger l'image localement

image_data = await download(image_url)

# Téléverser vers le stockage objet de l'entreprise

permanent_url = await upload_to_oss(image_data, bucket="ai-images")

return permanent_url

Q8 : Comment limiter le nombre quotidien de générations d'images par utilisateur dans OpenClaw ?

OpenClaw dispose d'un mécanisme de limitation de débit (rate limiting) intégré, configurable dans openclaw.json :

{

"rateLimits": {

"imageGeneration": {

"perUser": {

"daily": 50,

"hourly": 10

},

"perChannel": {

"daily": 500

}

}

}

}

Q9 : gpt-image-2-all ne prend-il pas en charge l'édition avec image de référence (image vers image) ?

La version actuelle ne le prend pas en charge. Si vous avez besoin d'éditer avec une image de référence, deux solutions s'offrent à vous :

- Utiliser le modèle officiel

gpt-image-2via le point de terminaison/v1/images/edits(nécessite une intégration via Skills) - Attendre la variante

gpt-image-2-all-editqu'APIYI lancera prochainement (prévue dans la feuille de route)

Q10 : L'utilisation de gpt-image-2 via OpenClaw transmet-elle des données d'utilisation à OpenAI ?

L'invocation de l'API le fait systématiquement. Toute invite et toute image générée via l'API sont enregistrées dans les journaux des serveurs d'OpenAI (pour des raisons de sécurité, conservées par défaut pendant 30 jours). Cependant, OpenAI s'engage explicitement à ne pas utiliser les données d'API pour entraîner ses modèles, point stipulé dans ses conditions de service.

VIII. Conclusion : Meilleures pratiques pour intégrer OpenClaw à gpt-image-2

En résumé, le choix de votre stratégie d'intégration peut se résumer en trois points clés.

8.1 Recommandations décisionnelles en trois points

✅ Si vous utilisez uniquement OpenClaw + plateformes de messagerie (WhatsApp/Telegram/Discord)

→ Choisissez l'option B : mode compatible OpenAI + gpt-image-2-all

Raison : configuration simplifiée, facturation à l'usage transparente et compatibilité native avec les flux de chat.

✅ Si vous développez avec Codex CLI / Cursor + OpenClaw

→ Choisissez l'option A : APIYI Skills (apiyi-gpt-image-2-gen)

Raison : l'écosystème Skills est mieux adapté aux chaînes d'outils de développement.

✅ Si vous créez un produit commercial de niveau entreprise

→ Choisissez l'option A + conversion officielle gpt-image-2

Raison : protection juridique (indemnisation), conformité commerciale et résolution 2K.

8.2 Checklist complète d'intégration

Une fois l'intégration terminée, utilisez cette liste pour effectuer vos dernières vérifications :

| Élément à vérifier | Standard de validation |

|---|---|

| Format openclaw.json | Validation réussie via jq |

| Configuration baseUrl | Se termine par /v1, sans barre oblique finale |

| Vérification de la clé API | Test curl renvoyant une réponse valide |

| Point de terminaison chatCompletions | enabled: true configuré |

| Liste des modèles | openclaw models list affiche apiyi/* |

| Test messagerie | "Dessine un chat" renvoie bien une image |

| Journaux d'erreurs | openclaw logs ne montre aucune erreur |

| Limite de débit (Rate limit) | Seuils anti-abus configurés |

8.3 Pistes d'optimisation supplémentaires

L'intégration n'est qu'un début. En environnement de production, vous pouvez aller plus loin :

- Amélioration des invites (Prompts) : Ajoutez une invite système dans la configuration de l'agent OpenClaw pour compléter automatiquement les descriptions courtes des utilisateurs avec des paramètres de style, de composition, etc.

- Mise en cache des images : Hachez les invites identiques pour éviter de rappeler l'API si la requête a déjà été traitée.

- Fallback multi-modèles : En cas d'échec du modèle principal (gpt-image-2-all), basculez automatiquement vers un modèle de secours (par exemple, Imagen 4).

- Journalisation des générations : Enregistrez les invites et les résultats générés dans une base de données pour faciliter l'audit et l'analyse des données.

🎯 Conseil global : La combinaison de

gpt-image-2etOpenClawest l'une des associations les plus prometteuses pour le déploiement d'agents IA en 2026. Intégrer un modèle d'image de pointe directement dans vos plateformes de messagerie quotidiennes abaisse considérablement la barrière à l'entrée des outils IA. Nous vous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour une intégration rapide, car elle prend en charge à la fois les modes de conversion officiels et inversés, offrant une flexibilité totale selon vos besoins.

L'architecture ouverte d'OpenClaw lui permet de se connecter à presque n'importe quel service compatible OpenAI, tandis que gpt-image-2 s'impose comme l'un des modèles les plus puissants en génération d'images. En combinant les deux, vous obtenez un assistant de génération d'images de niveau SOTA fonctionnant sur WhatsApp, Telegram ou Discord — une capacité qui semblait impensable il y a encore un an.

Pour conclure : "La valeur d'un outil ne réside pas dans la quantité de ses fonctionnalités, mais dans la rapidité avec laquelle il s'intègre à votre flux de travail quotidien." Le duo OpenClaw + gpt-image-2 répond parfaitement à ce critère : 10 minutes de configuration, et vous êtes opérationnel. C'est là toute sa force.

Auteur : APIYI Team — Plateforme d'accès API pour grands modèles de langage en entreprise (apiyi.com). Nous proposons des interfaces unifiées pour plus de 200 modèles majeurs, dont gpt-image-2, gpt-image-2-all, Claude 4.7 et Gemini 3 Pro. Compatibilité avec le protocole OpenAI et adaptation aux clients OpenClaw, Cursor, Codex CLI, Open WebUI, etc.

Références : Documentation officielle OpenClaw docs.openclaw.ai · GPT-Image Skills GitHub : github.com/wuchubuzai2018/expert-skills-hub