Note de l'auteur : Le tout dernier modèle d'OpenAI, gpt-5.5-pro, est désormais disponible via API. Il prend en charge une fenêtre de contexte de 1M de tokens et offre des capacités de raisonnement de premier plan. Cet article détaille ses spécifications techniques, sa structure tarifaire, les restrictions de groupe SVIP et les solutions d'accès depuis la Chine.

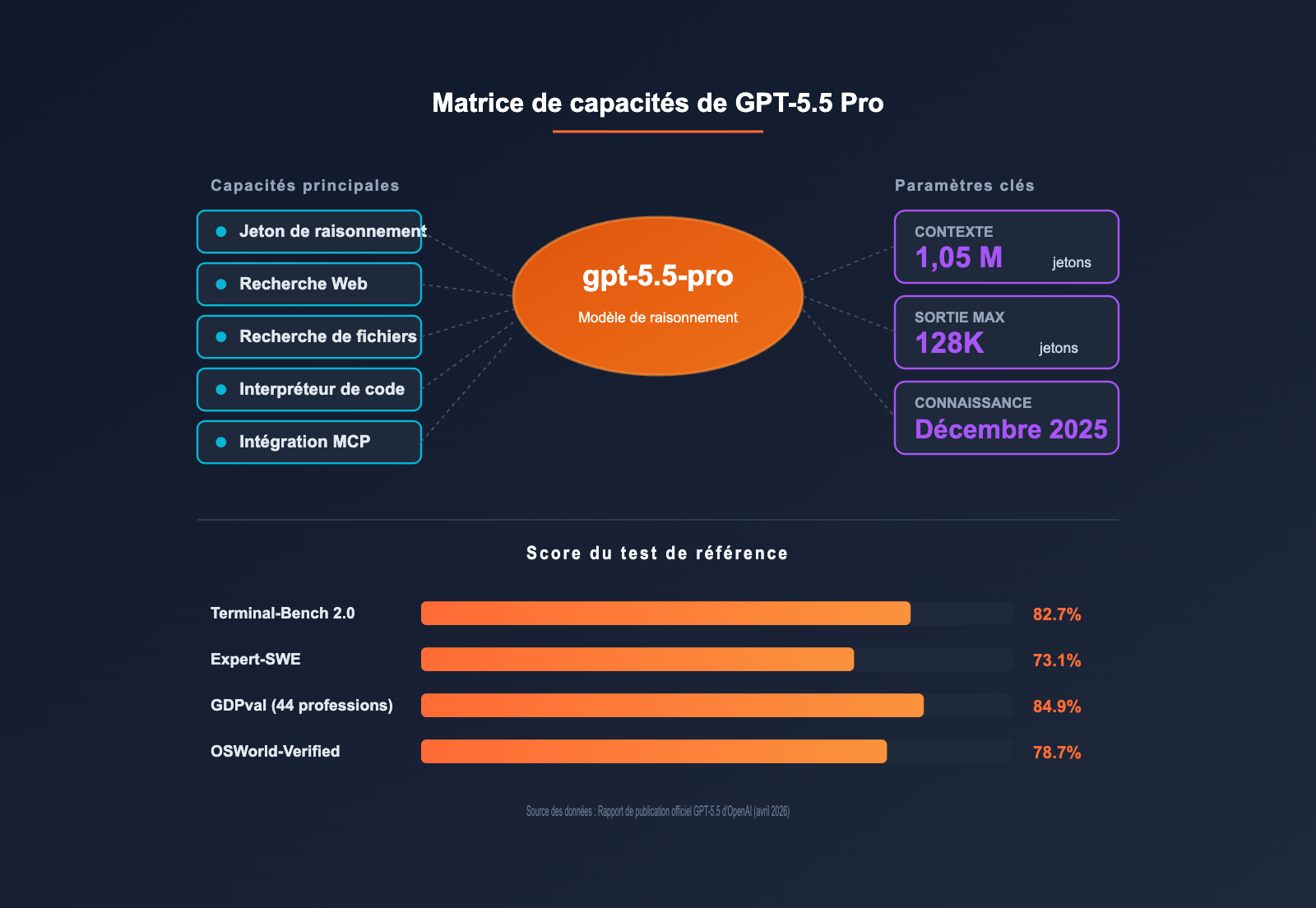

OpenAI a officiellement lancé GPT-5.5 le 23 avril 2026 et a ouvert l'accès à la version de raisonnement avancé gpt-5.5-pro via API le 24 avril 2026. Il s'agit du modèle phare de la série GPT-5.5, conçu spécifiquement pour les tâches complexes à étapes multiples, le raisonnement approfondi et les scénarios à haute valeur ajoutée. Il offre une fenêtre de contexte de 1 050 000 tokens et une sortie maximale de 128K.

Il ne s'agit pas d'un produit marketing survendu : la documentation officielle d'OpenAI est en ligne et les développeurs peuvent appeler l'API directement. Cependant, comme son prix est six fois plus élevé que celui du GPT-5.5 standard (30 $ / 180 $ par million de tokens), le coût d'un seul appel peut atteindre plusieurs dollars, ce qui pose des défis uniques en matière de contrôle des coûts pour les utilisateurs en Chine.

Valeur ajoutée : Cet article analyse l'accès à l'API GPT-5.5 Pro sous quatre angles : spécifications du modèle, structure tarifaire, données de benchmark et mécanisme de protection des groupes SVIP, tout en fournissant des exemples d'appel minimalistes prêts à l'emploi.

Points clés de l'API GPT-5.5 Pro

| Point clé | Description | Valeur |

|---|---|---|

| Contexte ultra-long 1M+ | 1 050 000 tokens en entrée + 128K en sortie | Analyse de livres entiers ou de bases de code massives en une fois |

| Capacité de raisonnement supérieure | 52,4 % sur les niveaux 1-3 de FrontierMath | Idéal pour les maths, la recherche et les décisions complexes |

| Expert en codage Agentic | 82,7 % sur Terminal-Bench 2.0 | Autonomie sur des tâches complexes de 20 heures |

| Compréhension multimodale | Entrée/sortie texte + entrée image | Analyse de documents, compréhension d'UI, raisonnement visuel |

| Accès groupe SVIP | Disponible uniquement pour le groupe SVIP sur APIYI | Évite les appels accidentels coûteux, contrôle des coûts |

Différences majeures entre GPT-5.5 Pro et la version standard

GPT-5.5 Pro est une version optimisée par OpenAI pour le raisonnement approfondi et les tâches de haute précision. La description officielle indique qu'il "produit des réponses plus intelligentes et plus précises", utilisant une puissance de calcul accrue pour améliorer la justesse. La version Pro prend en charge le mécanisme complet de "Reasoning Token", où le modèle génère en interne des chaînes de raisonnement invisibles avant de fournir la réponse finale. Cela lui permet de surpasser nettement les autres modèles dans les évaluations exigeantes comme FrontierMath ou Expert-SWE.

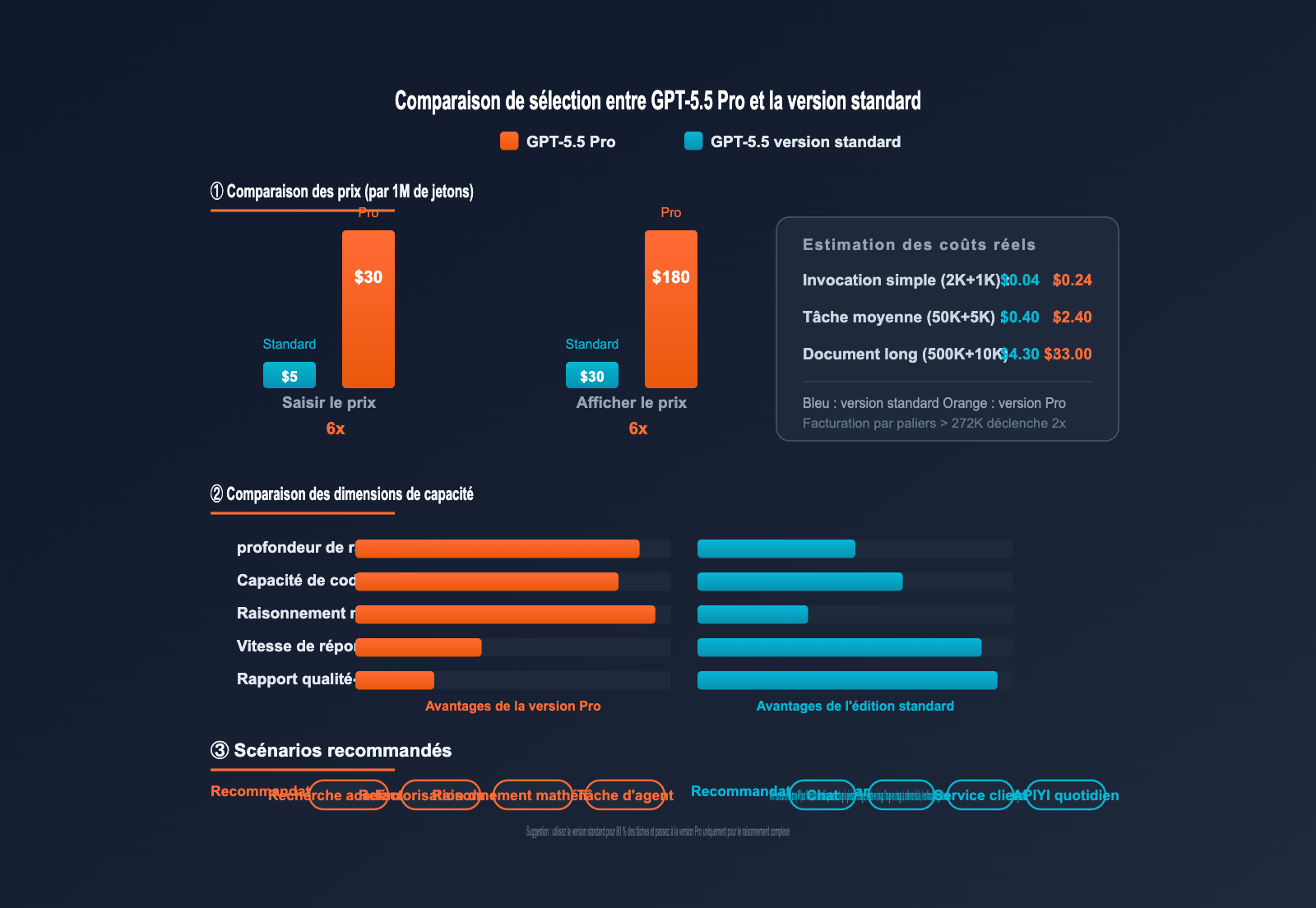

Sur le plan tarifaire, le prix d'entrée de la version Pro est 6 fois plus élevé que celui de la version standard (30 $ contre 5 $), tout comme le prix de sortie (180 $ contre 30 $). Cela signifie que le coût d'un appel de raisonnement complexe peut passer de quelques centimes à plusieurs dollars. Par conséquent, choisir précisément quand utiliser la version Pro est crucial pour maîtriser vos coûts d'API.

Démarrage rapide avec l'API GPT-5.5 Pro

Exemple Python minimaliste

Voici la méthode la plus simple pour invoquer GPT-5.5 Pro, entièrement compatible avec le SDK OpenAI :

import openai

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=[

{"role": "user", "content": "Démontrez la proposition équivalente de l'hypothèse de Riemann : la partie réelle de tous les zéros non triviaux est 1/2."}

]

)

print(response.choices[0].message.content)

Exemple cURL minimaliste

curl https://vip.apiyi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer VOTRE_CLE_API" \

-d '{

"model": "gpt-5.5-pro",

"messages": [

{"role": "user", "content": "Analysez cette base de code de 200K jetons et refactorisez-la"}

]

}'

Voir le code complet pour un environnement de production (avec gestion d’erreurs et estimation des coûts)

import openai

from typing import Optional, List, Dict

# Tarifs de la version Pro (par million de jetons)

PRICE_INPUT_BASE = 30.0 # Prix entrée 0-272K

PRICE_OUTPUT_BASE = 180.0 # Prix sortie 0-272K

PRICE_INPUT_HIGH = 60.0 # Prix entrée >272K

PRICE_OUTPUT_HIGH = 270.0 # Prix sortie >272K

def call_gpt55_pro(

messages: List[Dict],

api_key: str,

max_tokens: int = 4096,

estimate_cost: bool = True

) -> Dict:

"""

Appel de GPT-5.5 Pro en production, incluant estimation des coûts et gestion d'erreurs

Args:

messages: Liste des messages

api_key: Clé API

max_tokens: Jetons de sortie maximum

estimate_cost: Indique s'il faut afficher l'estimation des coûts

Returns:

Dictionnaire contenant le contenu de la réponse et le coût réel

"""

client = openai.OpenAI(

api_key=api_key,

base_url="https://vip.apiyi.com/v1"

)

try:

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=messages,

max_tokens=max_tokens

)

usage = response.usage

input_tokens = usage.prompt_tokens

output_tokens = usage.completion_tokens

# Calcul de la tarification par paliers

if input_tokens <= 272_000:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_BASE

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_BASE

else:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_HIGH

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_HIGH

total_cost = input_cost + output_cost

if estimate_cost:

print(f"📊 Jetons d'entrée : {input_tokens:,}")

print(f"📊 Jetons de sortie : {output_tokens:,}")

print(f"💰 Coût de l'appel : ${total_cost:.4f}")

return {

"content": response.choices[0].message.content,

"input_tokens": input_tokens,

"output_tokens": output_tokens,

"cost_usd": total_cost

}

except openai.RateLimitError:

return {"error": "Limite de débit atteinte, veuillez vérifier votre quota de groupe SVIP"}

except openai.APIError as e:

return {"error": f"Erreur API : {str(e)}"}

# Exemple d'utilisation

result = call_gpt55_pro(

messages=[

{"role": "system", "content": "Vous êtes un expert en mathématiques"},

{"role": "user", "content": "Dérivez la forme aux dérivées partielles de l'équation de Black-Scholes"}

],

api_key="VOTRE_CLE_API"

)

print(result["content"])

🎯 Conseil de démarrage : Le coût par appel de GPT-5.5 Pro est élevé. Nous vous recommandons d'obtenir d'abord les droits d'accès au groupe SVIP via la plateforme APIYI (apiyi.com). La plateforme prend en charge une compatibilité totale avec le SDK OpenAI. Pour tout rechargement de 100 $, recevez 10 % de bonus, ce qui équivaut à une réduction d'environ 15 % par rapport aux tarifs officiels, avec un accès direct sans VPN.

Détails des tarifs de l'API GPT-5.5 Pro

Structure de tarification officielle par paliers

OpenAI a mis en place un mécanisme de tarification par paliers pour les contextes longs sur la série GPT-5.5 : lorsque les jetons d'entrée d'une requête dépassent 272K, le prix est automatiquement ajusté.

| Plage d'entrée | Prix de l'invite (par 1M jetons) | Prix de la complétion (par 1M jetons) |

|---|---|---|

| 0 – 272K jetons | 30,00 $ | 180,00 $ |

| 272K – ∞ jetons | 60,00 $ (x2) | 270,00 $ (x1,5) |

⚠️ Avis important : La tarification par paliers est calculée sur l'ensemble de la requête, et non uniquement sur la partie excédentaire. Cela signifie que dès que l'entrée dépasse 272K, l'intégralité de l'entrée et de la sortie sera facturée au tarif supérieur. Il est conseillé d'évaluer une stratégie de découpage préalable pour l'analyse de documents longs.

Comparaison des prix : version Pro vs version Standard

| Modèle | Prix entrée | Prix sortie | Facteur de coût | Fenêtre de contexte |

|---|---|---|---|---|

| gpt-5.5 | 5,00 $ / 1M | 30,00 $ / 1M | 1x (base) | 1M jetons |

| gpt-5.5-pro | 30,00 $ / 1M | 180,00 $ / 1M | 6x | 1,05M jetons |

Exemples de calcul de coûts réels :

- Appel simple (2K entrée + 1K sortie) : Standard 0,04 $ vs Pro 0,24 $

- Tâche moyenne (50K entrée + 5K sortie) : Standard 0,40 $ vs Pro 2,40 $

- Analyse de document long (500K entrée + 10K sortie) : Standard 4,30 $ vs Pro 33,00 $

💡 Conseil d'optimisation des coûts : Pour les tâches courantes ne nécessitant pas un raisonnement approfondi, privilégiez la version standard de GPT-5.5. La valeur de la version Pro ne se justifie que dans les scénarios nécessitant réellement des capacités de raisonnement de haut niveau. Vous pouvez basculer entre les deux versions de manière transparente sur la plateforme APIYI (apiyi.com) pour une gestion à la demande.

Benchmark des performances de l'API GPT-5.5 Pro

Données de test officielles

OpenAI a rendu publics les résultats de la série GPT-5.5 sur plusieurs jeux de tests faisant autorité. La version Pro affiche des avantages particulièrement marqués en mathématiques et sur les tâches complexes :

| Jeu de test | Dimension évaluée | Score GPT-5.5 Pro | Remarques |

|---|---|---|---|

| Terminal-Bench 2.0 | Exécution de commandes terminal | 82,7 % | Capacité clé pour les tâches longues autonomes |

| Expert-SWE | Tâche de programmation de 20h | 73,1 % | Refactorisation de bases de code complexes |

| SWE-Bench Pro | Problèmes GitHub réels | 58,6 % | Correction de code en environnement de production |

| GDPval (44 métiers) | Couverture des métiers du savoir | 84,9 % | Tâches spécialisées inter-domaines |

| OSWorld-Verified | Manipulation informatique | 78,7 % | Automatisation "Computer Use" |

| FrontierMath Tier 1-3 | Mathématiques avancées | 52,4 % | Performance de haut niveau en raisonnement mathématique |

| FrontierMath Tier 4 | Problèmes mathématiques extrêmes | 39,6 % | Percée exclusive à la version Pro |

Analyse du Benchmark

Terminal-Bench 2.0 à 82,7 % : Cela signifie que GPT-5.5 Pro peut accomplir de manière autonome des opérations complexes de plusieurs dizaines d'étapes dans un terminal, incluant la configuration d'environnement, l'installation de dépendances et le débogage. Pour les flux de travail de codage par agents, la stabilité de la version Pro est nettement supérieure à celle de la version standard.

FrontierMath Tier 4 à 39,6 % : FrontierMath Tier 4 représente le niveau le plus difficile des tests mathématiques, incluant des problèmes du niveau de la médaille Fields. La version Pro est le premier modèle public à dépasser les 35 % sur ce palier, marquant une avancée majeure de l'IA dans la recherche mathématique de pointe.

Comparaison de sélection : GPT-5.5 Pro vs Édition Standard

| Dimension de comparaison | GPT-5.5 Pro | GPT-5.5 Standard | Choix recommandé |

|---|---|---|---|

| Raisonnement mathématique | FrontierMath 52,4 % | Moins de 30 % | Pro |

| Capacités de programmation | Expert-SWE 73,1 % | Expert-SWE ~55 % | Pro (tâches complexes) |

| Conversation courante | Plus lent, coût élevé | Rapide, coût réduit | Standard |

| Résumé de longs documents | Contexte de 1,05 M | Contexte de 1 M | Les deux |

| Service client / Traduction | Performances excessives | Largement suffisant | Standard |

| Recherche / Académique | Profondeur de raisonnement de pointe | Profondeur de raisonnement moyenne | Pro |

| Flux de travail Agent | Terminal 82,7 % | Terminal ~70 % | Pro (haute complexité) |

| Coût par requête | 0,24 $ – 33 $+ | 0,04 $ – 4,30 $ | Selon les besoins |

Conseils pour votre choix

Analyse comparative de la version Pro : Le GPT-5.5 Pro reste en tête sur les évaluations de haute difficulté comme FrontierMath et Expert-SWE. Cependant, son prix, six fois plus élevé, le rend inadapté aux tâches courantes. En comparaison, le coût de la version Pro ne se justifie que lorsque la tâche nécessite réellement une profondeur de raisonnement supérieure (recherche scientifique, refactorisation de code complexe, tâches d'agent de longue durée).

Analyse comparative de la version Standard : Le GPT-5.5 Standard excelle en termes de rapport coût-performance et de vitesse. Toutefois, il montre ses limites sur des tâches extrêmement difficiles comme le niveau 4 de FrontierMath. Pour 80 % des scénarios d'invocation du modèle au quotidien, la version Standard reste le choix le plus judicieux.

📊 Conseil de sélection : Commencez par utiliser le GPT-5.5 Standard pour accomplir 80 % de vos tâches courantes, et ne basculez vers la version Pro que pour les scénarios de raisonnement complexe que la version Standard ne parvient pas à résoudre. Vous pouvez facilement changer le paramètre

modelvia la plateforme APIYI (apiyi.com) sans avoir à modifier le reste de votre code.

Scénarios d'utilisation de l'API GPT-5.5 Pro

Le coût élevé du GPT-5.5 Pro le destine uniquement à des scénarios à haute valeur ajoutée :

- Recherche académique et raisonnement mathématique : Problèmes mathématiques de niveau 4 FrontierMath, déductions physiques, démonstrations de théorèmes.

- Refactorisation de bases de code ultra-longues : Refactorisation au niveau de l'architecture pour des bases de code complètes dépassant 200 000 jetons en entrée unique.

- Recherche scientifique approfondie : Conception de voies de synthèse chimique, analyses complexes en bio-informatique, raisonnement pour le diagnostic médical.

- Automatisation "Computer Use" : Tâches nécessitant plusieurs heures d'opérations multi-étapes, avec une stabilité garantie à 78,7 % sur OSWorld.

- Flux de travail Agent multi-étapes : Tâches complexes impliquant la recherche, l'étude, la génération de documents et l'exécution de code.

- Applications de décision à haute valeur : Analyse de contrats juridiques, rapports de recherche en investissement, déductions de stratégies commerciales.

🎯 Évaluation du scénario : Si votre tâche peut être accomplie par GPT-4o-mini ou GPT-5.5 Standard, n'utilisez pas la version Pro. La valeur de la version Pro ne se manifeste que lorsque la version Standard est mise en échec. Nous vous recommandons de tester d'abord avec la version Standard via la plateforme APIYI (apiyi.com), puis de passer à la version Pro uniquement après avoir confirmé que les capacités sont insuffisantes.

Guide d'accès à GPT-5.5 Pro sur APIYI

Pourquoi l'accès est-il réservé au groupe SVIP ?

Étant donné que le coût d'une seule invocation de GPT-5.5 Pro peut atteindre plusieurs dollars, la plateforme APIYI a mis en place un mécanisme de protection par segmentation :

- ✅ Groupe SVIP : accès complet à l'invocation de gpt-5.5-pro.

- ❌ Groupe par défaut (Default) : accès non autorisé pour l'instant, afin d'éviter toute dépense accidentelle due à une mauvaise manipulation par les nouveaux utilisateurs.

La raison principale de cette conception est simple : de nombreux utilisateurs ne connaissent pas la différence de prix entre la version Pro et la version standard lors de leur première intégration API. Une erreur dans le code pourrait consommer tout le budget mensuel en une seule fois. L'isolation via le groupe SVIP garantit que seuls les utilisateurs pleinement conscients des coûts du modèle peuvent invoquer la version Pro.

Comment demander l'accès au groupe SVIP

- Connectez-vous à votre espace utilisateur sur APIYI (apiyi.com).

- Contactez le service client en fournissant une description de votre cas d'usage.

- Une fois vos besoins vérifiés par le support, les droits d'accès au groupe SVIP seront activés.

- Spécifiez le paramètre

group=sviplors de vos invocations API (ou utilisez le point de terminaison dédié).

Comparaison des coûts : APIYI vs Site officiel

| Élément | Site officiel OpenAI | APIYI (apiyi.com) |

|---|---|---|

| Prix de base | $30 / $180 par 1M | $30 / $180 par 1M (identique) |

| Bonus de recharge | Aucun | $10 offerts pour $100 rechargés (10%) |

| Coût réel | 100% du prix standard | Environ 90% du prix standard (soit ~15% de réduction) |

| Accès en Chine | Nécessite un VPN | Connexion directe, sans VPN |

| Paiement | Carte bancaire internationale | Supporte RMB, Alipay, WeChat Pay |

| Compatibilité SDK | Natif OpenAI | Entièrement compatible avec le SDK OpenAI |

| Recharge minimale | $5 | À partir de $1 |

💰 Optimisation des coûts : Grâce au mécanisme de 10% offerts pour 100 $ rechargés sur APIYI (apiyi.com), le prix réel équivaut à une réduction d'environ 15% par rapport au site officiel. Pour les équipes utilisant intensivement GPT-5.5 Pro, cette offre permet de réduire considérablement les coûts API sur une année.

Foire aux questions (FAQ)

Q1 : Qu’est-ce que GPT-5.5 Pro ? Quelle est la différence majeure avec la version standard ?

GPT-5.5 Pro est une version de raisonnement avancée lancée par OpenAI le 24/04/2026, optimisée pour les tâches de raisonnement profond et de haute précision. Différence clé : le prix de la version Pro est de $30/$180 par 1M de tokens (6 fois plus cher que la version standard), mais elle obtient des scores nettement supérieurs sur des tâches complexes comme FrontierMath ou Expert-SWE. La version Pro prend en charge un mécanisme de "Reasoning Token" plus approfondi, générant des chaînes de raisonnement plus longues en interne.

Q2 : Quand GPT-5.5 Pro a-t-il été publié ? Sur quelles plateformes est-il disponible ?

OpenAI a officiellement lancé la série GPT-5.5 le 23/04/2026 et a ouvert le modèle gpt-5.5-pro via API le 24/04/2026. Il est actuellement disponible via l'API officielle d'OpenAI, OpenRouter, et des plateformes d'agrégation comme APIYI (apiyi.com). Notez que sur APIYI, seul le groupe SVIP y a accès.

Q3 : Pourquoi APIYI réserve-t-il GPT-5.5 Pro au groupe SVIP ?

Il s'agit d'un mécanisme de protection des coûts d'APIYI. Le coût d'une seule invocation de GPT-5.5 Pro peut atteindre plusieurs dollars, et les nouveaux utilisateurs peuvent facilement générer des dépenses imprévues par erreur. L'isolation par groupe SVIP garantit que seuls les utilisateurs avertis peuvent l'utiliser. Les utilisateurs souhaitant y accéder peuvent contacter le service client d'APIYI pour demander les droits SVIP.

Q4 : Quels sont les cas d’usage idéaux pour GPT-5.5 Pro ? Quand l’utiliser plutôt que la version standard ?

La version Pro est recommandée uniquement pour les scénarios à haute valeur ajoutée :

- Recherche académique : Problèmes mathématiques/scientifiques de niveau FrontierMath Tier 4.

- Refactorisation de code complexe : Refactorisation globale de bases de code dépassant 200K tokens.

- Tâches d'Agent multi-étapes : Automatisation de type "Computer Use" durant plusieurs heures.

- Applications de décision profonde : Audit de contrats juridiques, rapports de recherche en investissement.

Principe de décision : Testez d'abord avec la version standard. Si elle suffit, ne passez pas à la version Pro. Le prix de la version Pro est 6 fois supérieur ; ne l'utilisez que lorsque les capacités de la version standard sont insuffisantes.

Q5 : Comment invoquer GPT-5.5 Pro via APIYI ? Faut-il modifier la base_url ?

APIYI est entièrement compatible avec le SDK OpenAI. Voici comment procéder :

- Inscrivez-vous sur APIYI (apiyi.com) et demandez l'accès au groupe SVIP.

- Obtenez votre clé API.

- Modifiez la

base_urlde votre code enhttps://vip.apiyi.com/v1. - Réglez le paramètre

modelsurgpt-5.5-pro.

client = openai.OpenAI(

api_key="VOTRE_CLE",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=[...]

)

Profitez des 10% offerts pour toute recharge de 100 $, soit un prix équivalent à environ 85% du tarif officiel.

Q6 : Que se passe-t-il au niveau de la facturation si la fenêtre de contexte de 1M dépasse 272K tokens ?

La série GPT-5.5 utilise une facturation par paliers : lorsque l'entrée d'une requête dépasse 272K tokens, le prix de l'entrée pour toute la requête est multiplié par 2 ($60/1M), et le prix de sortie est multiplié par 1,5 ($270/1M). Attention : la facturation par palier s'applique à l'ensemble de la requête, et non seulement à la partie excédentaire. Pour l'analyse de longs documents, nous recommandons une stratégie de segmentation : divisez vos documents en plusieurs requêtes d'environ 250K tokens pour éviter de déclencher le palier tarifaire supérieur.

Q7 : Quelles sont les limitations connues de GPT-5.5 Pro ?

Les principales limitations sont :

- Pas de streaming : Vous devez attendre la réponse complète pour obtenir le résultat, ce qui n'est pas idéal pour les interactions en temps réel.

- Pas de réduction de cache : Contrairement à la version standard, la version Pro ne bénéficie pas des réductions liées au "prompt caching".

- Vitesse de réponse lente : En raison du raisonnement profond, une invocation prend généralement entre 30 secondes et plusieurs minutes.

- Entrée image uniquement : Ne prend pas en charge la génération d'images (nécessite l'utilisation d'autres modèles).

- Surcoût de 10% pour la résidence des données : L'utilisation de points de terminaison avec résidence des données entraîne des frais supplémentaires.

Pour les scénarios exigeant une forte réactivité, nous recommandons d'utiliser la version standard de GPT-5.5.

Q8 : Comment contrôler précisément les coûts lors de l’utilisation de GPT-5.5 Pro ?

Trois stratégies clés pour le contrôle des coûts :

- Planification hiérarchisée : Utilisez la version standard pour les tâches courantes et la version Pro uniquement pour les tâches complexes.

- Définir une limite

max_tokens: Évitez les sorties trop longues ; nous recommandons de définir une limite raisonnable entre 1K et 8K tokens selon la tâche. - Surveiller l'utilisation des tokens : Calculez en temps réel les tokens d'entrée/sortie dans votre code de production et estimez les coûts.

- Éviter le palier des 272K : Traitez les longs documents par segments pour éviter de déclencher le tarif doublé.

Grâce à la plateforme APIYI (apiyi.com), vous pouvez également bénéficier de 10% offerts sur vos recharges pour réduire davantage vos coûts réels.

Points clés de l'API GPT-5.5 Pro

- Référence absolue en raisonnement : Franchit le cap des 39,6 % sur FrontierMath Tier 4, établissant le record actuel pour un modèle public.

- Contexte ultra-long de 1M+ : 1,05M de jetons en entrée et 128K en sortie, permettant de traiter un livre technique entier en une seule fois.

- Roi des agents : Atteint 82,7 % sur Terminal-Bench 2.0, capable d'accomplir de manière autonome des tâches de codage complexes sur 20 heures.

- Tarification (6x la version standard) : 30 $/180 $ par million de jetons, une planification précise est indispensable.

- Protection par groupe SVIP : Disponible uniquement via les groupes SVIP sur APIYI pour éviter les coûts élevés (plusieurs dollars par requête) dus à une mauvaise utilisation par des débutants.

- Accès local avec 15 % de réduction : Rechargez 100 et recevez 10 offerts via APIYI (apiyi.com), soit un coût équivalent à 85 % du tarif officiel.

- Compatibilité SDK totale : Remplacez simplement la

base_urlparvip.apiyi.comdans votre SDK OpenAI pour commencer l'invocation du modèle.

Résumé

Les points essentiels de l'API GPT-5.5 Pro :

- Positionnement des capacités : Conçu spécifiquement pour le raisonnement approfondi et les tâches à haute valeur ajoutée, il s'agit du modèle le plus performant d'OpenAI à ce jour.

- Structure tarifaire : 30 $/180 $ par million de jetons. Au-delà de 272K, une tarification échelonnée x2 s'applique ; une gestion rigoureuse est donc nécessaire.

- Méthode d'accès : Appel via les groupes SVIP sur APIYI (apiyi.com), avec une offre de 100 rechargés pour 110 crédités et une connexion directe sans VPN depuis la Chine.

Le GPT-5.5 Pro n'est pas un modèle destiné à un usage quotidien, mais un outil professionnel dédié au raisonnement complexe, à la recherche scientifique, à la refactorisation de bases de code massives et aux tâches d'agents multi-étapes. Pour 80 % des invocations de modèle classiques, la version standard de GPT-5.5 reste une option bien plus économique. Avant d'utiliser la version Pro, nous vous conseillons d'évaluer si votre tâche nécessite réellement une capacité de raisonnement de haut niveau.

Nous vous recommandons d'accéder rapidement au GPT-5.5 Pro via la plateforme APIYI (apiyi.com) pour bénéficier de la protection des coûts des groupes SVIP, de la remise de 10 % sur vos recharges et de la stabilité d'une connexion directe.

Lectures complémentaires

Si le GPT-5.5 Pro API vous intéresse, nous vous recommandons de poursuivre votre lecture avec ces articles :

- 📘 Guide d'intégration de l'API GPT-5.5 Standard – Découvrez la version d'entrée de gamme de la série GPT-5.5 et les meilleures pratiques pour 80 % des cas d'usage.

- 📊 Analyse comparative approfondie : GPT-5.5 Pro vs Claude Opus 4.7 – Maîtrisez les différences de capacités et les conseils de sélection entre ces deux modèles de raisonnement phares.

- 🚀 Pratique des flux de travail OpenAI Agent : GPT-5.5 Pro + Computer Use – Explorez le déploiement en environnement de production pour des tâches automatisées complexes et multi-étapes.

📚 Références

-

Documentation officielle du modèle OpenAI GPT-5.5 Pro : Spécifications du modèle, points de terminaison API, informations tarifaires

- Lien :

developers.openai.com/api/docs/models/gpt-5.5-pro - Note : Obtenez les paramètres techniques les plus récents et officiels du GPT-5.5 Pro.

- Lien :

-

Blog de lancement de la série OpenAI GPT-5.5 : Capacités du modèle, données de benchmark, cas d'utilisation

- Lien :

openai.com/index/introducing-gpt-5-5 - Note : Positionnement officiel des capacités de la série GPT-5.5.

- Lien :

-

Documentation d'intégration APIYI pour GPT-5.5 Pro : Solutions d'invocation en Chine, procédure de demande de groupe SVIP

- Lien :

docs.apiyi.com - Note : Guide pratique d'intégration adapté aux développeurs locaux.

- Lien :

-

Page de tarification OpenAI : Tableau complet des tarifs et règles de facturation par paliers

- Lien :

developers.openai.com/api/docs/pricing - Note : Normes de facturation les plus récentes pour tous les modèles.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à discuter de votre expérience avec le GPT-5.5 Pro dans la section des commentaires. Pour plus d'informations sur l'intégration des modèles, consultez le centre de documentation APIYI sur docs.apiyi.com.