Note de l'auteur : Le GPT-5.5, fleuron d'OpenAI, est désormais disponible sur la plateforme APIYI. Nous proposons des ressources officielles avec une tarification alignée sur le site d'OpenAI. Profitez de notre offre : pour tout rechargement de 100 $, nous vous offrons 10 $ supplémentaires, ce qui équivaut à une réduction de 15 % par rapport aux tarifs officiels. Prêt à l'emploi.

Le 23 avril 2026, OpenAI a officiellement lancé GPT-5.5 et ouvert ses accès API dans la foulée. Il s'agit du premier modèle de base entièrement réentraîné depuis le GPT-4.5. Il prend en charge une fenêtre de contexte de 1 million de tokens, avec une tarification officielle de 5 $ par million de tokens en entrée et 30 $ par million de tokens en sortie.

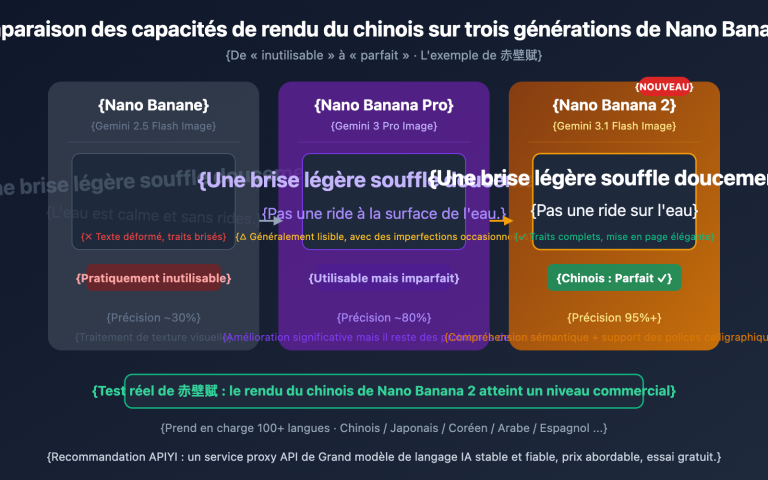

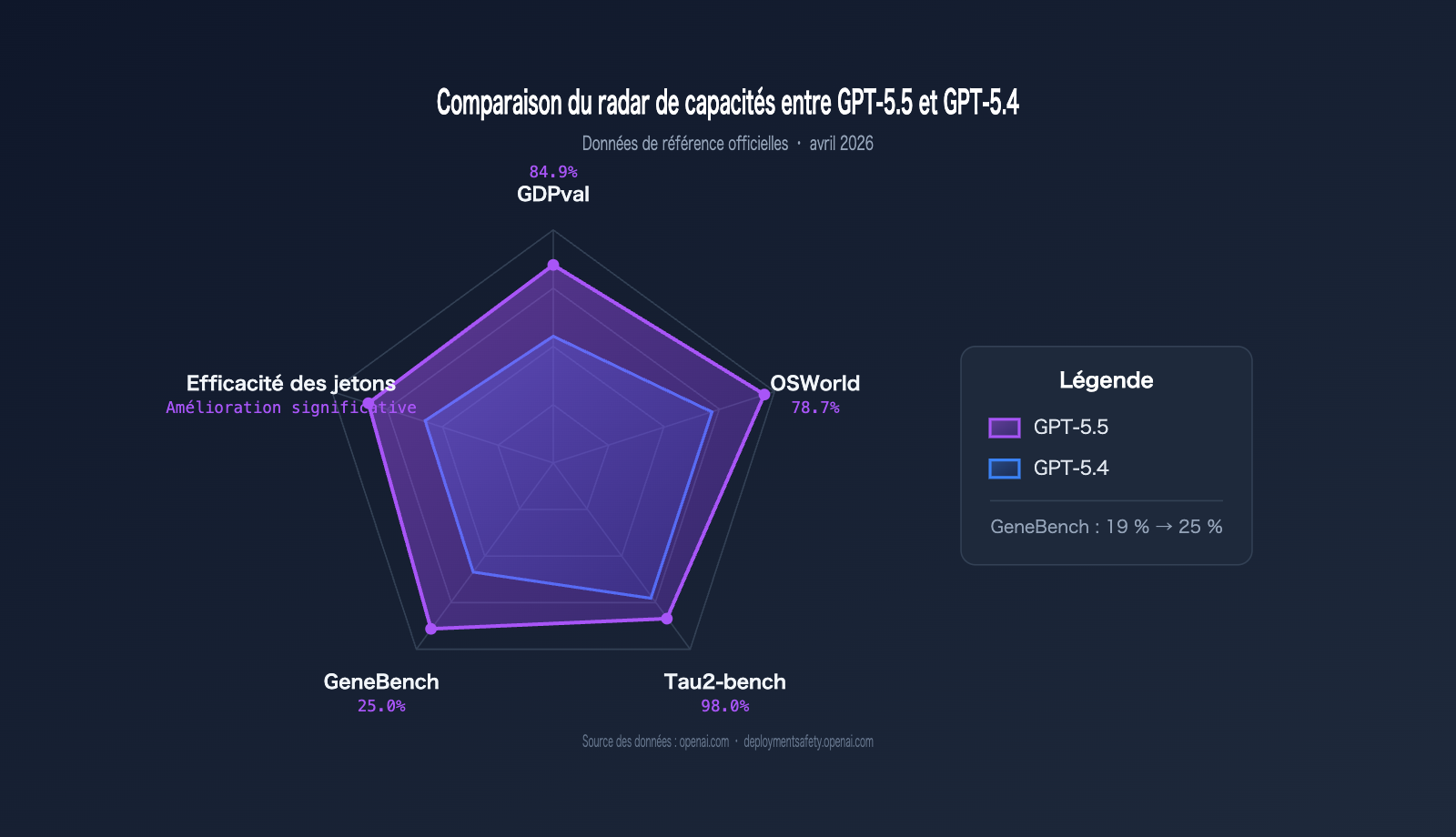

Il ne s'agit pas d'une simple mise à jour mineure. OpenAI décrit lui-même GPT-5.5 comme « une nouvelle classe d'intelligence ». Il atteint 84,9 % sur le benchmark de référence des travaux intellectuels trans-professionnels GDPval et 78,7 % sur les tâches de contrôle d'environnement informatique réel via OSWorld-Verified. Cette annonce a été confirmée par le dépôt GitHub officiel ainsi que par plusieurs médias spécialisés (TechCrunch, CNBC, The New Stack).

Pour permettre aux développeurs francophones d'y accéder immédiatement, APIYI (apiyi.com) propose dès maintenant des ressources GPT-5.5 officielles. La tarification est identique à celle d'OpenAI, et grâce à notre offre de bienvenue, vous bénéficiez d'une réduction équivalente à 15 %. Pas besoin de carte bancaire étrangère ou de configuration complexe de proxy réseau : le mode d'invocation du modèle est strictement identique au SDK officiel d'OpenAI.

Valeur ajoutée : Découvrez en 3 minutes les limites des capacités du GPT-5.5, sa tarification officielle, la méthode d'intégration via APIYI et comment réduire vos coûts d'utilisation pour ce « modèle généraliste le plus intelligent à ce jour ».

Points clés de l'API GPT-5.5

| Point clé | Information officielle | Valeur ajoutée par APIYI |

|---|---|---|

| Date de sortie | 23 avril 2026, sortie officielle OpenAI | Disponible immédiatement pour invocation |

| Tarification | 5 $ / M tokens (entrée), 30 $ / M tokens (sortie) | Identique au site officiel (ressources officielles) |

| Fenêtre de contexte | 1 million de tokens, 400k pour Codex | Entièrement préservée, aucune limitation |

| Offre bienvenue | Facturation à l'usage | 100 $ rechargés + 10 $ offerts, ~15 % de réduction |

| Accès | Carte bancaire étrangère + compte OpenAI requis | Rechargement local, connexion directe via SDK OpenAI |

Analyse détaillée des capacités du GPT-5.5

GPT-5.5 représente le premier modèle de base entièrement réentraîné par OpenAI depuis le GPT-4.5, ce n'est pas une simple mise à jour ou un réglage fin de la série GPT-5. Ses gains en matière de codage, de tâches d'agents intelligents et d'utilisation d'outils de recherche scientifique sont nettement supérieurs au rythme habituel des itérations mineures. Le modèle a atteint un score de 84,9 % sur le benchmark GDPval (couvrant 44 professions intellectuelles) et 98,0 % sur le benchmark de processus de service client Tau2-bench Telecom sans aucun réglage d'invite, établissant de nouveaux records pour OpenAI.

Il convient de noter tout particulièrement le bond en avant du GPT-5.5 dans les tâches de recherche scientifique. Sur le benchmark GeneBench, axé sur l'analyse de données de génétique et de biologie quantitative multi-étapes, GPT-5.5 a obtenu 25,0 %, contre 19,0 % pour le GPT-5.4, soit une amélioration de 6 points. L'annonce officielle indique clairement que ce nouveau modèle est « plus intelligent que le GPT-5.4, avec une efficacité en tokens nettement supérieure ». Cela signifie que, même avec une augmentation du prix unitaire, le coût total pour accomplir des tâches identiques peut effectivement diminuer — un point que nous confirmerons lors de nos prochains tests chez APIYI.

Tarification officielle et spécifications de contexte de l'API GPT-5.5

Tableau récapitulatif des tarifs

| Modèle / Mode | Prix Entrée | Prix Sortie | Cache Entrée | Fenêtre de contexte |

|---|---|---|---|---|

| GPT-5.5 | 5,00 $ / million de tokens | 30,00 $ / million de tokens | 0,50 $ / million de tokens | 1 000 000 |

| GPT-5.5 Pro | 30,00 $ / million de tokens | 180,00 $ / million de tokens | Non communiqué | 1 000 000 |

| Batch (asynchrone) | 50% du tarif standard | 50% du tarif standard | S.O. | Identique au standard |

| Flex (élastique) | 50% du tarif standard | 50% du tarif standard | S.O. | Identique au standard |

Note tarifaire : Les prix ci-dessus proviennent de l'annonce officielle d'OpenAI (developers.openai.com/api/docs/pricing) et s'appliquent aux accès directs à l'API OpenAI. En utilisant le service proxy API APIYI (apiyi.com) pour invoquer GPT-5.5, le règlement s'effectue directement en yuans selon le taux de change officiel, avec des bonus sur le premier rechargement. Cela équivaut globalement à une remise d'environ 15 % par rapport aux tarifs officiels, le tout sans avoir besoin de carte bancaire étrangère ou de configuration réseau complexe.

Comparatif tarifaire avec la gamme GPT-5

Le prix unitaire du GPT-5.5 est environ deux fois supérieur à celui du GPT-5.4. Cependant, lors de la conférence de presse, l'éditeur a insisté sur un point clé : « Le nombre total de tokens requis par GPT-5.5 pour accomplir la même tâche est nettement réduit ». Plusieurs médias (the-decoder.com, apidog.com) ont confirmé ce constat : sur une même chaîne d'opérations d'agent, la consommation de tokens de GPT-5.5 représente environ 60 à 70 % de celle du GPT-5.4. Par conséquent, le coût réel par tâche n'est pas nécessairement plus élevé que celui du GPT-5.4.

| Modèle | Prix Entrée | Prix Sortie | Efficacité des tokens | Scénarios recommandés |

|---|---|---|---|---|

| GPT-5.5 | 5,00 $ | 30,00 $ | Élevée (moins de consommation) | Agents complexes, programmation, recherche |

| GPT-5.5 Pro | 30,00 $ | 180,00 $ | Élevée | Raisonnement poussé, décisions critiques |

| GPT-5.4 | ~2,50 $ | ~15,00 $ | Moyenne | Tâches de complexité moyenne |

| GPT-5 mini | 0,25 $ | 2,00 $ | Moyenne | Appels fréquents à faible complexité |

Conseil de sélection : Si vos chaînes d'agents dépassent 5 étapes et nécessitent l'utilisation d'outils ainsi qu'une mémoire contextuelle longue, GPT-5.5 offre actuellement le meilleur rapport qualité-prix. N'hésitez pas à tester le modèle via APIYI (apiyi.com) avec le crédit offert pour comparer vos performances sur l'ensemble de votre chaîne avant de configurer votre environnement de production.

Comment intégrer l'API GPT-5.5 via APIYI

Exemple d'appel ultra-simplifié

Entièrement compatible avec le SDK officiel d'OpenAI, il vous suffit de remplacer les champs base_url et api_key :

from openai import OpenAI

client = OpenAI(

api_key="VOTRE_CLE_APIYI",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5",

messages=[

{"role": "user", "content": "Implémente un tri rapide en code et explique les étapes clés"}

]

)

print(response.choices[0].message.content)

Voir le code complet de qualité production (avec gestion des erreurs et réponse en flux)

from openai import OpenAI

from typing import Optional, Iterator

import os

class GPT55Client:

"""Encapsulation de l'API GPT-5.5 via APIYI"""

def __init__(self, api_key: Optional[str] = None):

self.client = OpenAI(

api_key=api_key or os.getenv("APIYI_API_KEY"),

base_url="https://vip.apiyi.com/v1"

)

self.model = "gpt-5.5"

def chat(

self,

prompt: str,

system: Optional[str] = None,

max_tokens: int = 4096,

temperature: float = 0.7

) -> str:

"""Mode d'invocation classique"""

messages = []

if system:

messages.append({"role": "system", "content": system})

messages.append({"role": "user", "content": prompt})

try:

resp = self.client.chat.completions.create(

model=self.model,

messages=messages,

max_tokens=max_tokens,

temperature=temperature

)

return resp.choices[0].message.content

except Exception as e:

return f"Échec de l'appel : {str(e)}"

def stream(

self,

prompt: str,

system: Optional[str] = None

) -> Iterator[str]:

"""Mode d'invocation en streaming"""

messages = []

if system:

messages.append({"role": "system", "content": system})

messages.append({"role": "user", "content": prompt})

stream = self.client.chat.completions.create(

model=self.model,

messages=messages,

stream=True

)

for chunk in stream:

content = chunk.choices[0].delta.content

if content:

yield content

# Exemple d'utilisation

if __name__ == "__main__":

bot = GPT55Client()

# Mode 1 : Appel classique

print(bot.chat("Explique les améliorations majeures du GPT-5.5 par rapport au GPT-5.4"))

# Mode 2 : Réponse en flux (streaming)

for token in bot.stream("Écris un décorateur Python pour limiter le taux d'appel d'une API"):

print(token, end="", flush=True)

Conseil pour démarrer : Après votre inscription sur APIYI (apiyi.com), vous recevrez des crédits de test pour exécuter le code ci-dessus immédiatement. Il vous suffit de remplacer

base_urlparhttps://vip.apiyi.com/v1. Tous les SDK officiels (Python, Node, Go) d'OpenAI sont compatibles ; aucune modification de votre logique métier n'est requise.

Noms des modèles et variantes

| Nom d'appel | Capacité correspondante | Scénario recommandé |

|---|---|---|

gpt-5.5 |

GPT-5.5 standard | La plupart des tâches de production |

gpt-5.5-pro |

Version Pro | Décisions critiques, raisonnement long |

gpt-5.5-codex |

Version optimisée Codex | Génération de code, agents programmeurs |

gpt-5.5-batch |

Asynchrone par lots | Traitement de données hors ligne |

Choix du modèle : Si vous hésitez sur l'intérêt de la différence de coût entre

gpt-5.5etgpt-5.5-pro, nous vous recommandons d'exécuter 100 fois vos invites (prompts) métiers réels sur APIYI (apiyi.com) pour comparer la qualité des réponses avant de valider votre configuration en production.

Comparatif : GPT-5.5 via transfert officiel vs accès direct à l'API

| Dimension de comparaison | OpenAI Officiel | Transfert officiel APIYI |

|---|---|---|

| Tarification | $5 / $30 prix standard | $5 / $30, identique à l'officiel |

| Offre de bienvenue | Aucune | 10$ offerts dès 100$ de recharge |

| Paiement | Carte bancaire étrangère (Visa/Master) | CNY, Alipay, WeChat |

| Réseau | Environnement réseau étranger stable | Connexion directe, sans proxy |

| Compatibilité API | Protocole officiel OpenAI | 100% compatible protocole OpenAI |

| Support client | Tickets en anglais | Support technique 7j/7, 24h/24 en chinois |

| Facturation | Facture étrangère, gestion fiscale complexe | Facture électronique locale, éligible frais d'entreprise |

Analyse du comparatif

Analyse de la connexion directe officielle : OpenAI conserve l'avantage en termes de priorité des fonctionnalités et de complétude de la documentation API. Cependant, pour les développeurs locaux, les obstacles tels que l'exigence d'une carte bancaire étrangère, la stabilité du réseau, la conformité des paiements d'entreprise et les fluctuations des taux de change constituent des coûts cachés, particulièrement fastidieux lors de la gestion de la facturation en équipe. À cet égard, APIYI (apiyi.com) est beaucoup plus adapté aux PME et aux entreprises grâce à sa conformité de paiement locale, son support client en chinois et sa facturation unifiée.

Analyse des agrégateurs tiers : Pour maximiser leurs marges, certains agrégateurs tiers utilisent des « canaux mixtes » ou des « interfaces inversées », ce qui entraîne des problèmes latents comme une instabilité de la qualité des réponses ou des tronquages de contexte. En revanche, les canaux GPT-5.5 d'APIYI sont clairement identifiés comme du « transfert officiel », garantissant des entrées/sorties strictement identiques à l'original. Avec des tarifs au prix public et des bonus de recharge permettant d'obtenir jusqu'à 15% de réduction, c'est une option bien plus robuste pour ceux qui exigent la stabilité en environnement de production.

Source des données : Ce comparatif se base sur la documentation officielle d'OpenAI (developers.openai.com) et les déclarations publiques sur apiyi.com. Vous pouvez effectuer des tests de recharge sur les deux plateformes en soumettant la même invite pour vérifier la cohérence des réponses.

Cas d'utilisation de l'API GPT-5.5

Avec sa fenêtre de contexte d'un million de jetons (tokens) et ses capacités d'agent renforcées, le GPT-5.5 apporte une valeur ajoutée significative dans les domaines suivants :

- Programmation par agent et refactorisation de code : Refactorisation de bases de code multi-fichiers, correction de bugs et génération de tests automatisés. L'intégration de Codex peut gérer 400 000 jetons de contexte, idéale pour des refontes à l'échelle d'un projet entier.

- Automatisation des flux complexes de service client : Avec un score de 98 % sur le benchmark Tau2-Telecom, le GPT-5.5 peut gérer en toute autonomie des scénarios clients impliquant plusieurs étapes, outils et branches décisionnelles.

- Recherche scientifique et analyse de données : Une progression de 6 points sur GeneBench indique que le GPT-5.5 est l'un des modèles de base les plus puissants pour les analyses multi-étapes en biomédecine, économétrie et prédiction de réactions chimiques.

- Traitement intelligent de longs documents : La fenêtre de contexte de 1 million de jetons permet d'ingérer intégralement un roman de taille moyenne ou un ensemble complet de contrats juridiques sans avoir besoin de les segmenter.

- Assistant de travail pour les entreprises : Avec un score de 84,9 % sur le benchmark GDPval, couvrant 44 professions (avocats, comptables, consultants, médecins, etc.), le GPT-5.5 est désormais prêt pour une utilisation en environnement de production.

Conseil d'utilisation : Si votre application couvre plusieurs des domaines mentionnés, je vous recommande d'utiliser directement APIYI (apiyi.com) pour basculer facilement entre les modèles

gpt-5.5etgpt-5.5-proavec une clé API unique, vous évitant ainsi la gestion fastidieuse de comptes et de clés pour chaque fournisseur.

Analyse de l'impact du GPT-5.5 sur l'industrie

La sortie du GPT-5.5 impacte directement trois piliers : la couche applicative de l'IA, les frameworks d'agents et les services aux entreprises. En tenant compte des annonces officielles d'OpenAI et de l'intégration de Codex par NVIDIA (déjà déployé en interne pour la maintenance des centres de données), voici les trois axes majeurs de cette évolution.

Impact sur la couche applicative des agents

Ces six derniers mois, les frameworks d'agents (LangGraph, AutoGen, Crew AI, etc.) ont été freinés par les capacités de planification multi-étapes des modèles sous-jacents. Le GPT-5.4 perdait en stabilité dès que la chaîne d'appel d'outils dépassait 8 étapes. Avec un score de 78,7 % sur OSWorld-Verified, le GPT-5.5 franchit le seuil de viabilité commerciale pour le contrôle automatisé de systèmes informatiques.

| Cas d'utilisation | État du GPT-5.4 | Amélioration du GPT-5.5 | Valeur commerciale |

|---|---|---|---|

| Agent de code | Stable sur un fichier, requiert une intervention sur plusieurs | Refonte complète réalisable en autonomie | Réduction des coûts de refactorisation |

| Agent de support | Requiert un ajustement des invites pour les décisions | 98 % de taux de réussite sans ajustement | Déploiement en quelques semaines |

| Agent d'analyse | Perte d'état lors des inférences longues | Mémoire stable avec 1M de contexte | Analyses complexes enfin possibles |

Analyse d'impact : Dans les 3 à 6 prochains mois, les frameworks d'agents principaux adopteront le GPT-5.5 comme moteur d'inférence par défaut. Si vous développez des applications basées sur des agents, je vous conseille de tester dès maintenant leur stabilité via APIYI (apiyi.com).

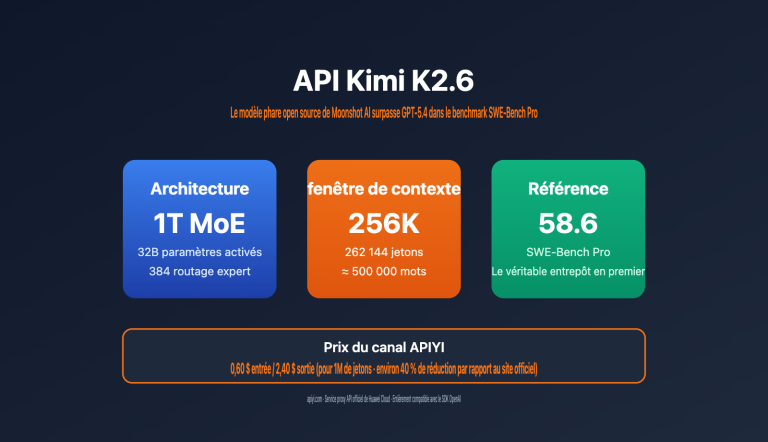

Impact sur les services proxy API

Le coût unitaire du GPT-5.5 étant environ le double de celui du GPT-5.4, les exigences en termes de conformité et de stabilité des ressources pour les plateformes de proxy sont revoyues à la hausse. L'écart entre les « ressources officielles » et les « canaux mixtes » deviendra flagrant : les premières garantissent la stabilité en production, tandis que les secondes, bien que moins chères, présentent des risques accrus. APIYI a clairement marqué l'accès au GPT-5.5 comme « ressources officielles », tout en maintenant une tarification identique à celle d'OpenAI, anticipant ainsi cette tendance.

Impact sur les investissements IA en entreprise

Le score de 84,9 % sur GDPval prouve que le GPT-5.5 a atteint un niveau d'« expert junior » dans 44 professions spécialisées. OpenAI précise que les entreprises peuvent désormais « intégrer le GPT-5.5 dans leurs processus métier critiques », une déclaration beaucoup plus affirmée que pour la série GPT-5 précédente.

Guide pratique de migration : passer de GPT-5.4 à GPT-5.5

Matrice de décision pour la migration

| Type de tâche | Migration recommandée ? | Raison |

|---|---|---|

| Chaînes d'agents complexes | ✅ Immédiate | L'amélioration de l'efficacité des jetons compense l'augmentation tarifaire |

| Traitement de documents à long contexte | ✅ Immédiate | Contexte de 1M bien supérieur aux 256K de GPT-5.4 |

| Génération et refactorisation de code | ✅ Immédiate | Intégration de Codex offrant une expérience intergénérationnelle |

| Dialogue simple et classification | ⚠️ À différer | Meilleur rapport coût-performance avec GPT-5 mini |

| Traitement de données par lots | ⚠️ Évaluer d'abord | Attendre l'évaluation après remise de 50 % en mode Batch |

Coûts de migration au niveau du code

GPT-5.5 est 100 % compatible avec le protocole API de GPT-5.4, ce qui rend la migration extrêmement simple :

# Avant la migration : GPT-5.4

response = client.chat.completions.create(

model="gpt-5.4", # Seule cette ligne doit être modifiée

messages=messages

)

# Après la migration : GPT-5.5

response = client.chat.completions.create(

model="gpt-5.5", # Il suffit de remplacer par gpt-5.5

messages=messages

)

Voir le code complet du test A/B (à exécuter avant la migration)

from openai import OpenAI

import time

from typing import Dict, Any

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://vip.apiyi.com/v1"

)

def benchmark_model(

model: str,

test_prompts: list[str]

) -> Dict[str, Any]:

"""Test comparatif de la qualité de réponse et de l'efficacité en jetons d'un modèle"""

total_input = 0

total_output = 0

total_time = 0

responses = []

for prompt in test_prompts:

start = time.time()

resp = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

elapsed = time.time() - start

total_input += resp.usage.prompt_tokens

total_output += resp.usage.completion_tokens

total_time += elapsed

responses.append(resp.choices[0].message.content)

return {

"model": model,

"total_input_tokens": total_input,

"total_output_tokens": total_output,

"avg_latency": total_time / len(test_prompts),

"responses": responses

}

# Préparation de 5 prompts métier réels

test_prompts = [

"Aide-moi à refactoriser ce code Python pour qu'il soit plus conforme à la norme PEP 8...",

"Analyse ces données de vente et fournis des prévisions de tendances ainsi que les anomalies...",

"Conçois un script de dialogue à plusieurs tours pour notre système de support client...",

"Résume les principaux points de risque de ce contrat juridique de 50 pages...",

"Implémente un composant de tableau de bord glisser-déposer avec React + TypeScript..."

]

# Comparaison entre GPT-5.4 et GPT-5.5

result_54 = benchmark_model("gpt-5.4", test_prompts)

result_55 = benchmark_model("gpt-5.5", test_prompts)

# Calcul des coûts ($)

cost_54 = (result_54["total_input_tokens"] * 2.5 +

result_54["total_output_tokens"] * 15) / 1_000_000

cost_55 = (result_55["total_input_tokens"] * 5 +

result_55["total_output_tokens"] * 30) / 1_000_000

print(f"Coût total GPT-5.4 : ${cost_54:.4f}")

print(f"Coût total GPT-5.5 : ${cost_55:.4f}")

print(f"Latence moyenne GPT-5.5 : {result_55['avg_latency']:.2f}s")

Conseil de migration : Exécutez ce code de comparaison avec vos propres prompts métier avant de décider de basculer. Sur APIYI (apiyi.com), une seule clé API permet d'appeler les modèles

gpt-5.4etgpt-5.5, facilitant ainsi une comparaison objective.

Trois points d'attention après la migration

- Limites de débit différentes : Au lancement, les limites de débit pour GPT-5.5 sont plus strictes (environ 500 RPM pour le niveau 1). Il peut être nécessaire de demander une augmentation pour les tâches à haute concurrence.

- Valeur accrue de la stratégie de cache : GPT-5.5 propose un prix de $0,50/M tokens pour le cache d'entrée (soit 1/10 du prix standard). Assurez-vous d'activer le cache pour les invites système fréquemment utilisées.

- Utilisation prudente de la version Pro : Avec un prix de $30/$180, la version GPT-5.5 Pro coûte 6 fois plus cher que la version standard. N'optez pour cette version que si la version standard ne suffit pas à accomplir vos tâches de manière stable.

FAQ (Foire aux questions)

Q1 : Qu’est-ce que l’API GPT-5.5 ? Quel est son rapport avec les autres modèles de la série GPT-5 ?

GPT-5.5 est le modèle d'API phare lancé par OpenAI le 23 avril 2026. Il s'agit du premier modèle de base entièrement réentraîné depuis GPT-4.5, et non d'une simple version affinée de GPT-5 ou GPT-5.4. Il prend en charge une fenêtre de contexte d'un million de jetons, est tarifé à $5 en entrée et $30 en sortie par million de jetons, et surpasse nettement GPT-5.4 pour les tâches d'agent, la programmation et l'analyse scientifique.

Q2 : Quelle est la différence entre GPT-5.5 et GPT-5.5 Pro ?

La version standard de GPT-5.5 ($5/$30) est destinée à la plupart des tâches de production, offrant une fenêtre de 1M de jetons et des capacités d'agent de haut niveau. GPT-5.5 Pro ($30/$180) est plus performant pour le raisonnement sur de longues chaînes, la planification en plusieurs étapes et la résolution de problèmes scientifiques, pour un prix 6 fois supérieur. Si vos tâches sont déjà accomplies de manière stable par la version standard, il est inutile de passer à la version Pro ; inversement, Pro est recommandé pour réduire les coûts de reprise de travail.

Q3 : Quand l’API GPT-5.5 sera-t-elle disponible ? Est-elle déjà intégrée sur APIYI ?

OpenAI a publié et ouvert l'accès à l'API le 23 avril 2026, parallèlement aux abonnements ChatGPT Plus, Pro, Business et Enterprise. APIYI (apiyi.com) a mis en ligne les ressources GPT-5.5 dès le jour de l'annonce. Les identifiants de modèles sont gpt-5.5 et gpt-5.5-pro, sélectionnables directement dans la « Liste des modèles » de votre tableau de bord.

Q4 : Pour quelles applications GPT-5.5 est-il le plus adapté ?

Il est idéal pour :

- Programmation avec agents multi-étapes : refactorisation de bibliothèques de code, tests automatisés, débogage inter-fichiers.

- Automatisation des flux de support client en entreprise : gestion des tickets, appels multi-outils, prise de décision complexe.

- Analyse scientifique et biomédicale : traitement de données expérimentales, revues de littérature, validation d'hypothèses.

- Travail basé sur un contexte long : contrats juridiques, rapports de recherche étendus, traitement de documents de la taille d'un livre.

- Tâches de planification multi-tours : planification de voyages, gestion de projet, aide à la décision complexe.

Q5 : Comment appeler rapidement GPT-5.5 via APIYI ?

C'est entièrement compatible avec le SDK officiel d'OpenAI. Trois étapes suffisent :

- Visitez APIYI (apiyi.com) pour créer un compte et effectuer votre premier dépôt (à partir de $100 déposés, $10 offerts).

- Récupérez votre clé API dans le tableau de bord.

- Remplacez l'URL

base_urldans votre code parhttps://vip.apiyi.com/v1et réglezmodelsurgpt-5.5.

Les SDK officiels OpenAI pour Python, Node.js et Go sont parfaitement compatibles ; aucune modification de votre logique métier n'est nécessaire.

Q6 : Quelles sont les limitations ou points d’attention de l’API GPT-5.5 ?

Quelques limites à noter :

- Augmentation des prix : Le prix unitaire est environ deux fois supérieur à celui de GPT-5.4, bien qu'OpenAI souligne une meilleure efficacité des jetons.

- Limites de débit : Au lancement, OpenAI applique des limitations de fréquence d'appel en escalier (environ 500 RPM pour les utilisateurs de niveau 1).

- Surcoût de la version Pro : Le prix de GPT-5.5 Pro étant 6 fois plus élevé, évaluez bien si votre tâche en justifie le coût.

- Solutions alternatives : Pour des scénarios à haute fréquence et faible complexité, les modèles moins coûteux comme GPT-5 mini ou GPT-4o-mini restent recommandés ; la plateforme APIYI permet de basculer en un clic.

Q7 : L’appel de GPT-5.5 via APIYI affecte-t-il la qualité des réponses ?

Non. Le canal GPT-5.5 d'APIYI est clairement identifié comme une « ressource officielle transférée ». Les entrées et sorties sont strictement identiques à l'interface officielle d'OpenAI, sans réécriture d'invites, sans tronquage de réponse ni remplacement de modèle. Tout en maintenant une parité tarifaire avec le site officiel, les bonus sur premier dépôt et les méthodes de paiement conformes pour les entreprises permettent d'obtenir un avantage réel sur les coûts d'environ 15 %, sans compromis sur la qualité.

Q8 : Comment sont calculées les remises sur le premier dépôt chez APIYI ? Quelle est la réduction réelle ?

APIYI propose actuellement une politique de premier dépôt pour GPT-5.5 et les autres modèles phares : à partir de $100 déposés, $10 sont offerts, avec un ratio de bonus croissant selon le montant. Pour un dépôt de $100 avec $10 offerts, cela équivaut à payer $90 pour obtenir $100 de crédit d'appel API au tarif officiel, soit une réduction d'environ 15 %. Veuillez consulter les annonces du tableau de bord d'apiyi.com pour les offres les plus récentes. Les clients entreprises peuvent également demander des remises sur volume supplémentaires.

Points clés du GPT-5.5 API

- GPT-5.5, une nouvelle génération de modèle de base : Le premier entraînement complet depuis GPT-4.5, lancé le 23 avril 2026, avec une fenêtre de contexte de 1M.

- Tarification officielle transparente : Version standard à 5 $/30 $, version Pro à 30 $/180 $, et entrée en cache aussi basse que 0,50 $.

- Amélioration majeure des capacités d'Agent et de programmation : GDPval à 84,9 %, OSWorld à 78,7 %, Tau2-bench à 98 %, avec une optimisation significative de l'efficacité des jetons (tokens).

- Lancement du service proxy API sur APIYI : Alignement sur les tarifs officiels, avec une offre de lancement (10 $ offerts pour 100 $ rechargés), soit environ 15 % de réduction.

- Accès conforme en Chine : APIYI (apiyi.com) prend en charge les paiements en RMB, le service client en chinois, les factures d'entreprise, et assure une compatibilité à 100 % avec le SDK OpenAI.

- Combinaison recommandée pour la production : Utilisez

gpt-5.5pour les agents complexes,gpt-5.5-propour le raisonnement critique, et GPT-5 mini pour les tâches simples à haute fréquence.

Synthèse

Voici les points essentiels concernant l'arrivée de l'API GPT-5.5 sur APIYI :

- Niveau de performance : GPT-5.5 est le premier modèle de base entièrement réentraîné par OpenAI depuis GPT-4.5, apportant des avancées générationnelles dans les domaines des agents, de la programmation et de la recherche scientifique.

- Parité avec les tarifs officiels : APIYI propose des ressources via un service proxy API dont la tarification est identique à celle du site officiel d'OpenAI, sans aucune baisse de qualité.

- Offre de premier rechargement : Recevez 10 $ offerts pour un premier rechargement de 100 $, soit une réduction globale d'environ 15 %. De plus, la prise en charge des paiements en RMB, le support en chinois et les factures d'entreprise rendent l'outil bien plus accessible aux développeurs locaux.

Si vous souhaitez accéder à GPT-5.5 immédiatement depuis la Chine, tout en évitant les coûts cachés liés aux cartes bancaires étrangères et aux proxys réseau, nous vous recommandons de passer par APIYI (apiyi.com) pour intégrer GPT-5.5. La plateforme offre des bonus de rechargement, une facturation centralisée et une compatibilité totale avec le SDK OpenAI ; il vous suffit de remplacer l'URL de base (base_url) dans votre code pour être opérationnel.

延伸阅读 Articles connexes

Si le GPT-5.5 API vous intéresse, nous vous recommandons de poursuivre votre lecture avec ces articles :

- 📘 Comparatif approfondi des capacités de programmation : GPT-5.5 vs Claude Opus 4.7 – Plongez dans les différences de génération de code entre ces deux modèles de pointe.

- 📊 Test réel de la longue fenêtre de contexte du GPT-5.5 : qu'en est-il des 1 million de tokens ? – Vérification des promesses officielles concernant la fenêtre de contexte.

- 🚀 Guide complet pour migrer de GPT-5.4 vers GPT-5.5 – Pour une mise à niveau en douceur de vos environnements de production.

📚 Références

-

Annonce officielle d'OpenAI : Notes de version du GPT-5.5

- Lien :

openai.com/index/introducing-gpt-5-5 - Description : Informations de première main, description des capacités et données de benchmark.

- Lien :

-

Tarification de l'API OpenAI : Page tarifaire officielle

- Lien :

developers.openai.com/api/docs/pricing - Description : Informations complètes sur les tarifs GPT-5.5 / GPT-5.5 Pro / Batch / Flex.

- Lien :

-

Fiche technique du GPT-5.5 (System Card) : Analyse du déploiement, de la sécurité et des capacités

- Lien :

deploymentsafety.openai.com/gpt-5-5 - Description : Évaluations de sécurité et résultats de benchmark publiés officiellement.

- Lien :

-

Reportage de TechCrunch : Analyse de l'impact sectoriel du GPT-5.5

- Lien :

techcrunch.com/2026/04/23/openai-chatgpt-gpt-5-5-ai-model-superapp - Description : Analyse de la portée de cette sortie selon une perspective médiatique tierce.

- Lien :

-

Documentation de la plateforme APIYI : Guide d'intégration du service proxy API pour le GPT-5.5

- Lien :

docs.apiyi.com - Description : Guide complet pour les développeurs souhaitant intégrer le GPT-5.5, incluant les tarifs, les modèles et des exemples de SDK.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à partager vos expériences pratiques avec l'API GPT-5.5 dans les commentaires. Pour plus de documentation sur l'intégration, visitez le centre de documentation APIYI sur docs.apiyi.com.