Al utilizar recientemente Nano Banana Pro de Google (correspondiente a gemini-3-pro-image-preview), muchos desarrolladores se han topado con el siguiente mensaje de error:

{

"status_code": 503,

"error": {

"message": "Deadline expired before operation could complete. (request id: 2026...)",

"type": "",

"code": 503

}

}

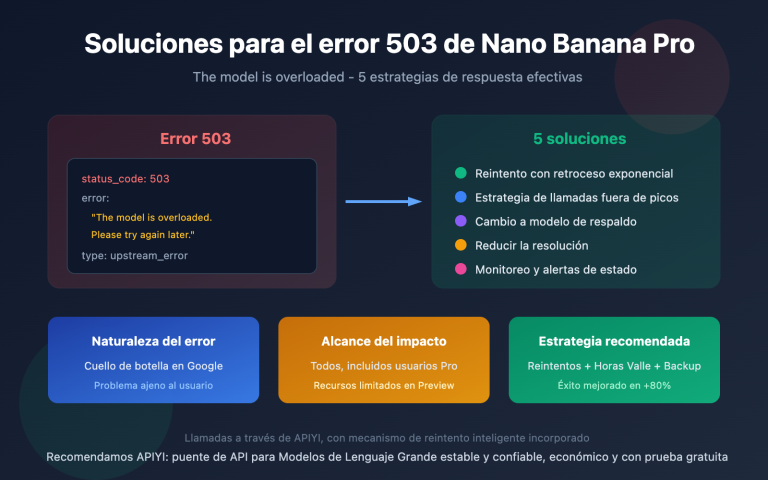

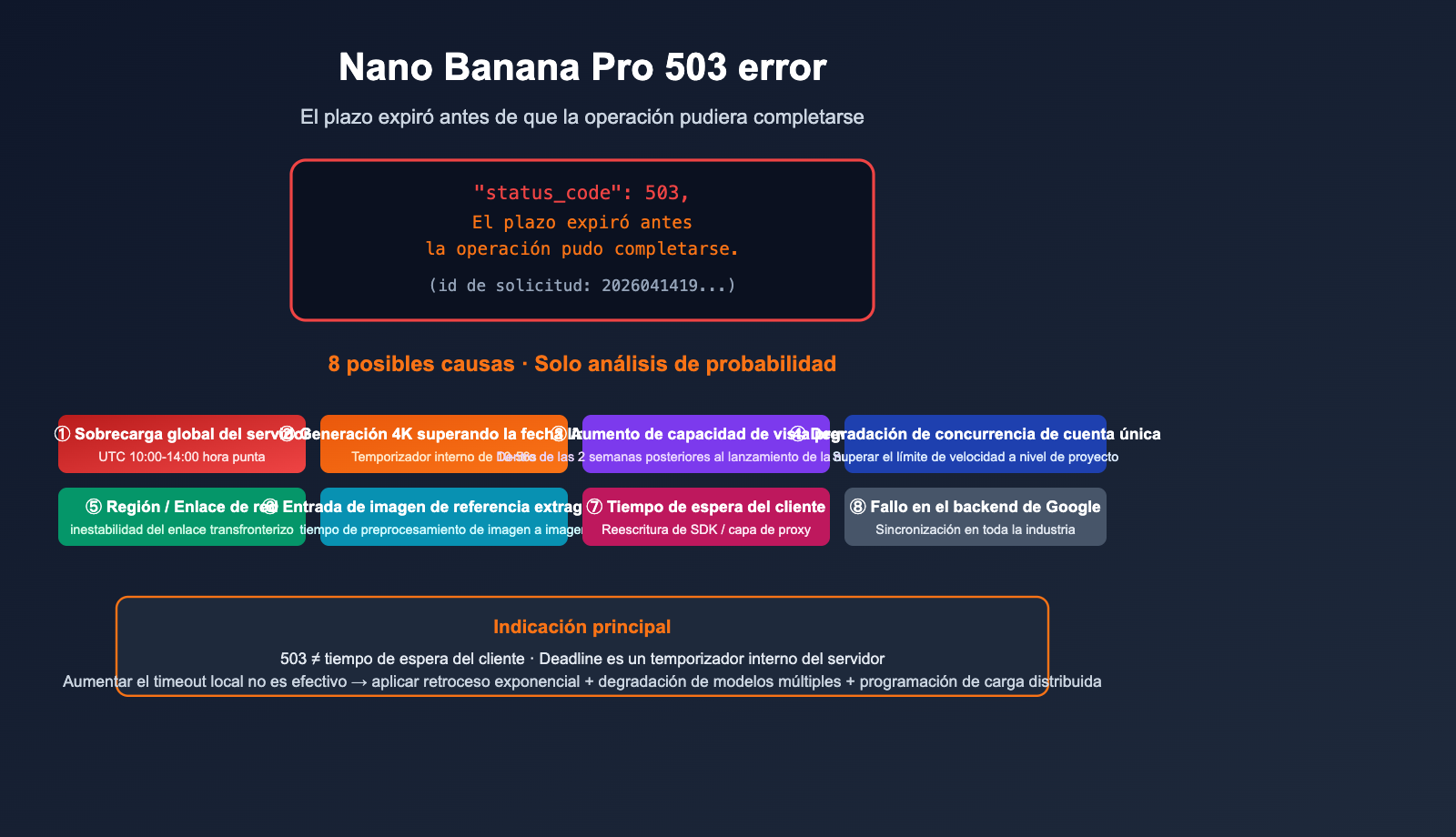

A primera vista parece un "tiempo de espera agotado", pero la semántica HTTP del código 503 es, en realidad, Service Unavailable (Servicio no disponible), no un simple tiempo de espera del cliente. Al analizar los foros oficiales de Google, los issues de GitHub y los cambios recientes en el estado de la API de imágenes de Gemini, este error no es provocado por una causa única, sino que es el resultado de la superposición de factores del lado del servidor, del cliente y de la lógica de negocio.

Este artículo solo ofrece un análisis de posibilidades y no pretende dar una solución definitiva de "haz esto y funcionará al 100%" (al fin y al cabo, la esencia del 503 es que no puedes ver el estado interno del servidor). A continuación, enumeramos 8 causas comunes ordenadas de mayor a menor probabilidad, junto con sus escenarios de activación y pistas de diagnóstico, para ayudarte a identificar rápidamente la "más probable" cuando te encuentres con este error.

Entendiendo el error: Desglose semántico de 503 y Deadline expired

Antes de profundizar en la investigación, analicemos qué significa este mensaje, de lo contrario, es fácil sacar conclusiones erróneas.

HTTP 503 ≠ Tiempo de espera del cliente

- 503 UNAVAILABLE en la API de Google Gemini significa: El servidor ha determinado que no puede procesar la solicitud en ese momento, lo que generalmente está relacionado con la capacidad, sobrecarga o degradación del backend.

Deadline expired before operation could completees un mensaje del temporizador interno del servidor que indica: "La tarea no se completó dentro del tiempo límite de procesamiento asignado".- No es igual a un tiempo de espera de red del cliente curl/SDK. El tiempo de espera del cliente suele manifestarse como una interrupción de la conexión o un

TimeoutErrorlocal, no como un 503.

Diferencias entre 504 / 429

| Código de error | Semántica | Significado común |

|---|---|---|

| 503 | Service Unavailable | Sobrecarga del servidor / limitación de tasa / tiempo de espera agotado en cola |

| 504 | Gateway Timeout | La solicitud fue recibida, pero la tarea de generación no se completó a tiempo |

| 429 | Too Many Requests | Límite de tasa de tu cuenta / clave API / proyecto |

| 500 | Internal Error | Excepción en el servidor, generalmente se puede reintentar |

Conclusión clave: Al ver 503 + Deadline expired, primero sospecha de problemas de capacidad / cola del servidor en lugar de modificar el tiempo de espera local.

🎯 Consejo de diagnóstico: Si el mismo ID de solicitud sigue dando 503 al reintentar durante 5 minutos, generalmente es un problema del lado del servidor; si solo ocurre un 1% de las veces, probablemente sea una sobrecarga instantánea. Al realizar la invocación del modelo de Nano Banana Pro a través de APIYI (apiyi.com), puedes verificar los registros detallados de las solicitudes en el panel de administración para determinar rápidamente si se trata de una sobrecarga general o de un problema de tu cuenta individual.

Posible causa 1: Sobrecarga en los servidores de Google (la más frecuente)

Características del problema

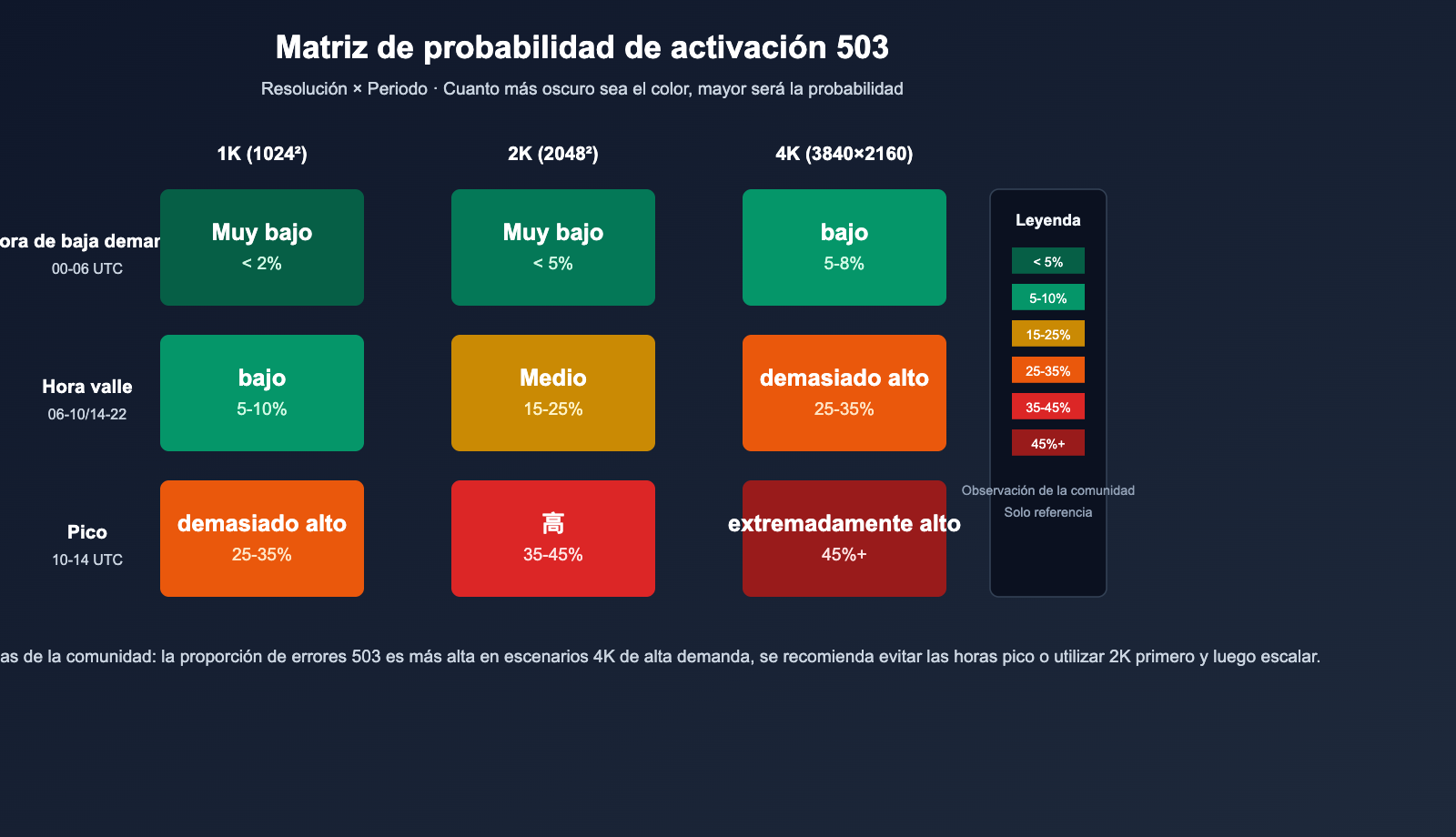

- Ocurre principalmente durante las horas pico (10:00-14:00 UTC, aproximadamente 18:00-22:00 hora de Pekín);

- Se soluciona tras un par de intentos y casi nunca ocurre durante la madrugada;

- Reportado simultáneamente en varias comunidades (foros de Google AI Developers, GitHub Issue #1808).

Mecanismo detrás

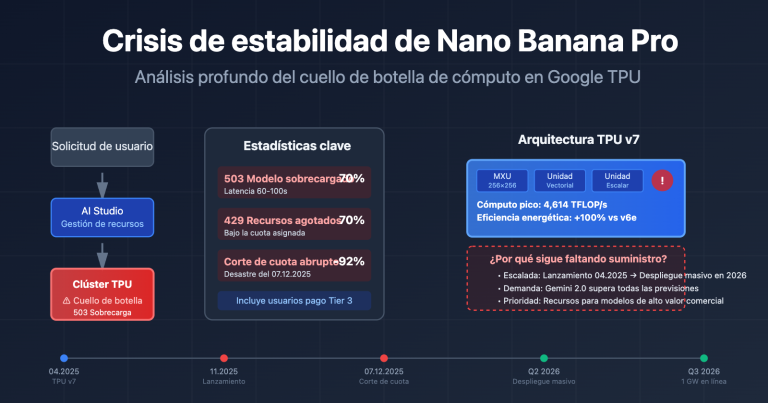

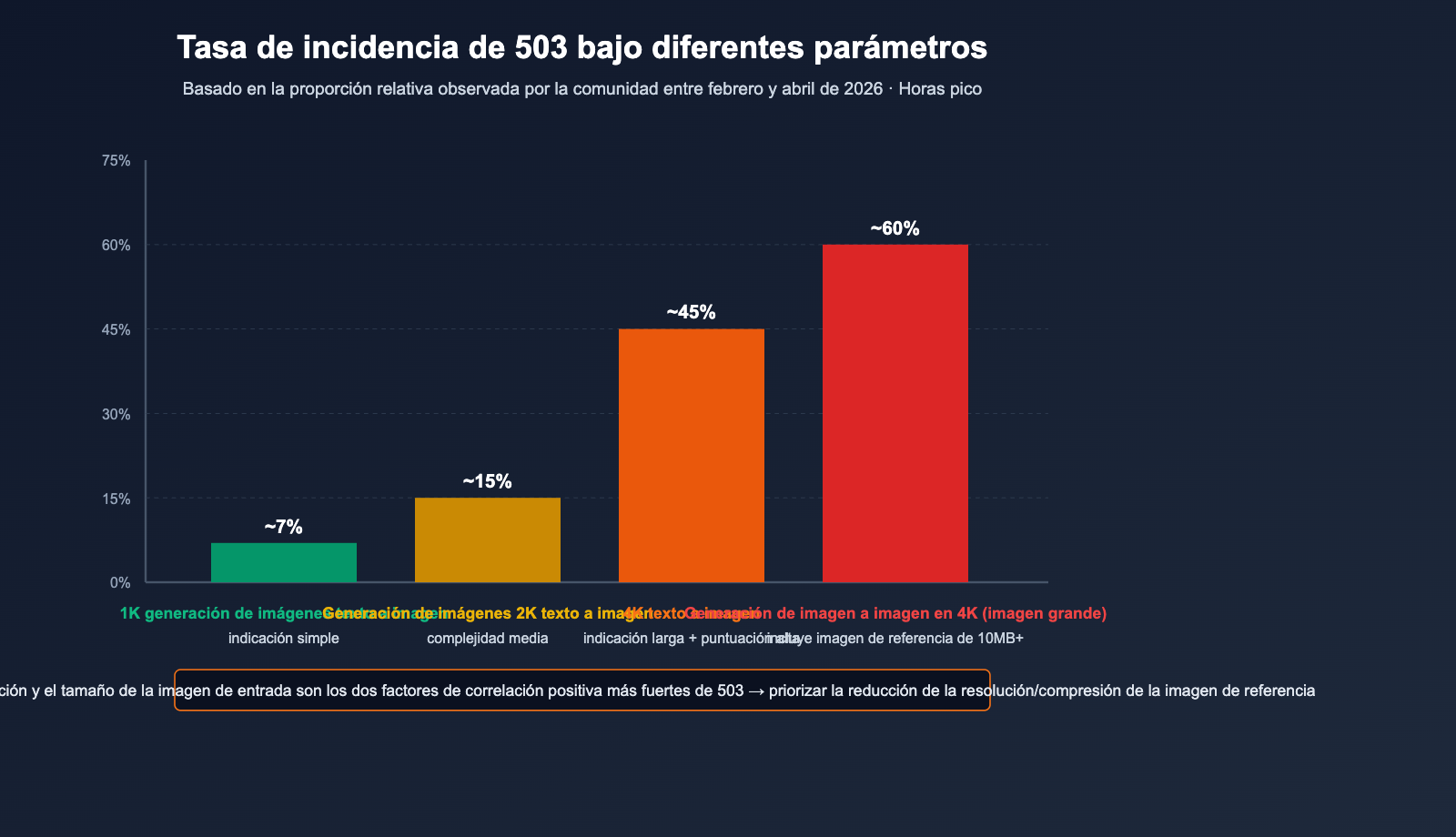

Nano Banana Pro, conocido internamente como gemini-3-pro-image-preview, sigue siendo un modelo en versión preliminar (Preview), por lo que la capacidad de cómputo asignada por Google es significativamente menor que la de los modelos GA (Disponibilidad General). Si a esto le sumamos el aumento masivo en la demanda de generación de imágenes tras los lanzamientos de Gemini 3.1 Pro (19 de febrero) y Nano Banana 2 (26 de febrero), vemos que, en horas punta, hasta el 45% de las solicitudes han llegado a activar el error 503.

Método de diagnóstico

- Comprueba si el momento de la solicitud coincide con el pico de 10:00-14:00 UTC;

- Intenta realizar la petición en horas de baja demanda (00:00-06:00 UTC) para ver si la tasa de error disminuye significativamente;

- Verifica si todas las claves API de la misma cuenta fallan en el mismo periodo.

Posible causa 2: La generación de alta resolución (4K) o prompts complejos supera el tiempo límite interno

Características del problema

- Solo aparece en escenarios de "4K / 2048×2048 o superior" o con "prompts extremadamente largos y complejos";

- Las salidas de 1K/2K funcionan sin problemas, pero al aumentar el tamaño, el error 503 se vuelve frecuente;

- El mismo prompt funciona de forma estable a 1024×1024, pero da error al intentar generar en 4K.

Mecanismo detrás

La salida 4K de Nano Banana Pro puede tardar entre 10 y 56 segundos o incluso más en procesarse en el servidor. Google tiene establecida una fecha límite estricta (hard deadline) para cada tarea de generación; una vez que el tiempo de espera en cola y el tiempo de generación real superan este límite, el sistema lanza un error Deadline expired y devuelve un 503.

Esto no tiene nada que ver con el tiempo de espera de tu cliente: aunque configures tu timeout local a 5 minutos, no servirá de nada, ya que el límite es un temporizador del lado del servidor.

Método de diagnóstico

- Cambia la resolución del mismo prompt a 1024×1024 para verificar si funciona correctamente;

- Simplifica el prompt y vuelve a intentarlo;

- Durante las horas pico, reduce proactivamente la salida a 2K y deja las tareas 4K para cuando baje el tráfico.

Posible causa 3: Inestabilidad durante la fase de escalado de capacidad de los modelos Preview

Características del fenómeno

- Alta incidencia de fallos justo después de un lanzamiento (dentro de las primeras 2 semanas).

- Las notas de lanzamiento oficiales indican claramente "Preview".

- A veces, el tiempo de recuperación es prolongado, entre 30 y 120 minutos (mucho más lento que los 5-15 minutos de Gemini 2.5 Flash).

Mecanismo subyacente

La capacidad de servicio de los modelos Preview se asigna según la demanda interna estimada. Si el tráfico real supera significativamente las estimaciones, Google prioriza el SLA de los modelos GA (General Availability), mientras que los modelos Preview pueden sufrir una reducción de carga pasiva o incluso límites temporales.

Posible causa 4: Concurrencia demasiado alta / Limitación y degradación de cuenta individual

Características del fenómeno

- La proporción de errores 503 aumenta repentinamente durante tareas concurrentes por lotes bajo la misma cuenta.

- La tasa de error disminuye significativamente al reducir la concurrencia.

- Ocurren errores 429 de forma esporádica, pero la gran mayoría son 503.

Mecanismo subyacente

Google impone límites en el número de solicitudes por minuto y en la concurrencia para cada proyecto o clave API. Al excederlos:

- Se prioriza la devolución de errores 429.

- En situaciones extremas, se devuelve directamente un 503 a través del canal de "protección contra sobrecarga".

En este caso, el error no es una "sobrecarga global", sino que "tu cuenta ha activado un proceso de degradación".

Método de diagnóstico

- Observa si otras cuentas funcionan normalmente durante el mismo intervalo de tiempo.

- Reduce la concurrencia a menos de 5 solicitudes y vuelve a intentar.

- Divide las tareas por lotes en pequeños grupos de transmisión (streaming).

🎯 Sugerencia de optimización de concurrencia: Nano Banana Pro es muy sensible a la concurrencia. Para escenarios de generación de imágenes por lotes, recomendamos conectarse a través de APIYI (apiyi.com); la concurrencia ilimitada puede amortiguar los picos de limitación del lado de Google, actuando como una capa de búfer frontal adicional que reduce significativamente la probabilidad de encontrar errores 503.

Posible causa 5: Latencia excesiva a nivel de red o en la ruta regional

Características del fenómeno

- La tasa de errores es mucho mayor cuando se conecta directamente a los endpoints de Google desde el ámbito nacional en comparación con el uso de un servicio proxy de API.

- El problema se resuelve al cambiar la VPN o la IP de la región.

traceroutemuestra múltiples saltos en el enlace transfronterizo.

Mecanismo subyacente

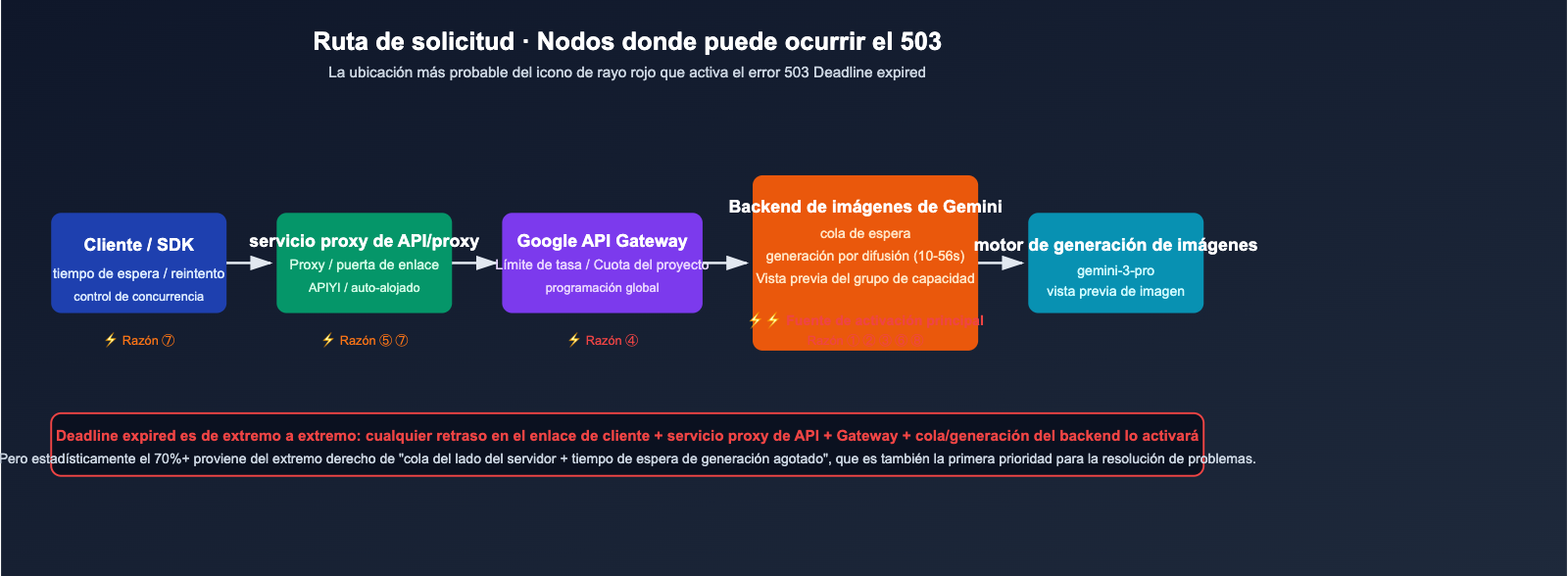

El deadline (plazo límite) en el error Deadline expired es de extremo a extremo: Cliente → Enlace proxy → Nodo perimetral de Google → Backend real. Si la red transfronteriza sufre inestabilidad o el enlace TLS presenta anomalías, el tiempo disponible que "percibe" el servidor se reduce, lo que provoca que el deadline se dispare prematuramente.

Métodos de diagnóstico

- Intente cambiar a diferentes nodos regionales y vuelva a probar.

- Compare la tasa de errores utilizando un servicio proxy de API nacional (como APIYI apiyi.com).

- Verifique si la resolución DNS está apuntando correctamente al nodo perimetral de Google más cercano.

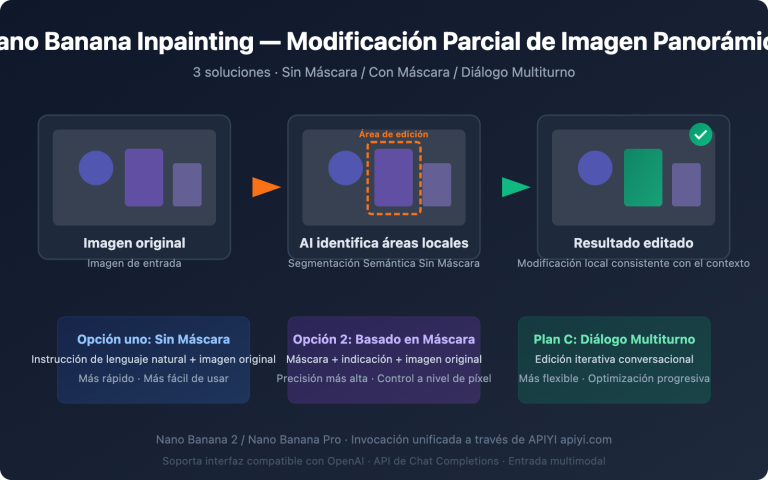

Posible causa 6: Entrada de imágenes muy pesadas o carga de imágenes de referencia que ralentizan la generación

Características del fenómeno

- La función de texto a imagen funciona correctamente, pero la generación de imagen a imagen arroja errores frecuentes.

- Cuanto más grande es la imagen subida, mayor es la probabilidad de recibir un error 503.

- La misma imagen funciona tras ser comprimida, pero el archivo original falla.

Mecanismo subyacente

En el modo de imagen a imagen, el servidor debe realizar primero la decodificación, preprocesamiento y extracción de características de la imagen de referencia antes de pasar a la generación por difusión. Las imágenes extremadamente grandes (superiores a 10 MB o 4000 px) consumen una parte significativa del cupo de tiempo asignado para la generación, agotando el deadline.

Sugerencias de manejo

- Comprima la imagen de referencia en el cliente a un tamaño de 1024-2048 px.

- Evite que el archivo supere los 4 MB.

- Realice recortes (crop) antes de combinar varias imágenes de referencia.

Posible causa 7: Estrategias de tiempo de espera (timeout) y reintento inadecuadas en el SDK del cliente o capa HTTP

Características del fenómeno

- Solo tu sistema arroja errores, mientras que otros usuarios en la misma región y con la misma cuenta operan con normalidad.

- Los registros del cliente muestran que la solicitud ha sido cancelada.

- Los ID de error son siempre diferentes y no aparecen en los registros del lado del servidor.

Mecanismo detrás del problema

Este tipo de "falso 503" es poco frecuente, pero existe:

- El tiempo de espera predeterminado del cliente es demasiado corto, por lo que se desconecta antes de que Google termine de procesar la solicitud.

- Algunas capas de proxy reescriben las respuestas de tiempo de espera como errores 503.

- Falta una implementación de reintento idempotente, lo que provoca que la misma tarea se encole repetidamente, compitiendo por cumplir con el plazo.

Recomendaciones de manejo

- Configura el tiempo de espera del cliente en ≥ 90 segundos para dejar margen suficiente a la generación de imágenes 4K.

- Implementa reintentos con retroceso exponencial: 1s → 2s → 4s → 8s → 16s → 32s.

- Respeta la cabecera

Retry-After(si está presente).

Posible causa 8: Mantenimiento del backend de Google o fallos regionales

Características del fenómeno

- Durante un periodo determinado (desde unos minutos hasta horas), todos los usuarios reciben errores 503 simultáneamente.

- Existe un evento registrado en la página de estado oficial de Google.

- Aparecen una gran cantidad de incidencias en la comunidad al mismo tiempo.

Mecanismo detrás del problema

Este es el tipo de fallo menos frecuente, pero el que tiene mayor impacto; se trata de una avería a nivel de infraestructura de Google. No puede ser resuelto por el usuario, por lo que solo queda esperar a que se restablezca el servicio o cambiar de modelo.

Plan de contingencia

- Cambia a Nano Banana 2 (

gemini-3.1-flash-image-preview). - Cambia a la serie Imagen u otros modelos de generación de imágenes.

- Utiliza el servicio proxy de API de APIYI (apiyi.com) para una degradación automática a través de su conjunto de modelos de respaldo.

🎯 Consejo de alta disponibilidad: No vincules los sistemas de producción a un único modelo de vista previa. En APIYI (apiyi.com) puedes configurar simultáneamente rutas para múltiples modelos como Nano Banana Pro, Nano Banana 2 y GPT-image-1; así, si el modelo principal arroja un 503, se redirigirá automáticamente a un modelo de respaldo, evitando que tu servicio quede totalmente inoperativo.

Tabla de consulta rápida: 8 causas probables

| # | Causa probable | Fenómeno típico | Método de diagnóstico | Sugerencia accionable |

|---|---|---|---|---|

| 1 | Sobrecarga global del servidor | Fallos masivos en horas pico | Revisar franja horaria + foros | Reintentar fuera de hora / retroceso exponencial |

| 2 | Exceso de plazo en generación 4K | Error solo en imágenes grandes | Reproducir bajando resolución | 2K primero y luego 4K / Simplificar la indicación |

| 3 | Inestabilidad en modelo Preview | Frecuente 2 semanas tras lanzamiento | Anuncios oficiales | Cambiar temporalmente a modelo GA |

| 4 | Degradación por concurrencia | Fallo al procesar por lotes | Prueba con menor concurrencia | Limitar a < 5 / Usar servicio proxy de API |

| 5 | Enlace de red / regional | Frecuente con conexión directa | Probar con otros nodos | Usar un servicio proxy de API estable |

| 6 | Entrada de imagen muy grande | Alta tasa en imagen a imagen | Comprimir imagen y reintentar | Comprimir por debajo de 2K |

| 7 | Timeout incorrecto en cliente | Solo en tu sistema | Ajustar timeout + logs | Timeout de 90s + retroceso exponencial |

| 8 | Fallo en backend de Google | Problema generalizado | Revisar página de estado | Cambiar a modelo de respaldo |

Inicio rápido: Plantilla de invocación con autorreparación ante 503 (solo como referencia)

Ejemplo de retroceso exponencial en Python

import time, random

from openai import OpenAI

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_API_KEY",

)

def generate_with_retry(prompt, size="2048x2048", max_attempts=6):

delay = 1

for attempt in range(max_attempts):

try:

return client.images.generate(

model="nano-banana-pro",

prompt=prompt,

size=size,

)

except Exception as e:

# Identificar 503 / Deadline expired

if "503" in str(e) or "Deadline" in str(e):

jitter = random.uniform(0, 0.5)

time.sleep(delay + jitter)

delay = min(delay * 2, 32)

continue

raise

raise RuntimeError("Se agotaron los reintentos por 503")

📎 Desplegar para ver pseudocódigo de fallback con degradación multimodelo

MODEL_CHAIN = ["nano-banana-pro", "nano-banana-2", "gpt-image-1"]

for model in MODEL_CHAIN:

try:

return generate_with_retry(prompt, model=model)

except Exception:

continue

raise RuntimeError("Fallaron todos los modelos")

🎯 Consejo de implementación: El retroceso simple solo resuelve la "sobrecarga global momentánea". Para cubrir las 8 causas de golpe, lo más sólido es combinar "retroceso exponencial + degradación multimodelo + buffer de concurrencia mediante servicio proxy de API". Al integrar estas tres capas a través de APIYI (apiyi.com), puedes lograr una alta disponibilidad de nivel productivo con solo unas pocas líneas de código.

Preguntas Frecuentes (FAQ)

P1: ¿Aumentar el tiempo de espera (timeout) del cliente soluciona el error 503?

Generalmente no. El error Deadline expired es un informe del temporizador del servidor, no del tiempo de espera del cliente. Aumentar el timeout del cliente no ayuda directamente con el 503; al contrario, podría hacer que la detección del fallo sea más lenta.

P2: ¿Por qué Nano Banana 2 reporta menos errores que Nano Banana Pro?

Nano Banana 2 corresponde a gemini-3.1-flash-image-preview y utiliza un grupo de cómputo de nivel Flash, lo que significa que el tiempo de generación por solicitud es más corto, tiene un mayor margen de deadline y la capacidad total es relativamente más holgada. Durante las horas punta, puedes desviar las tareas que no sean 4K a Nano Banana 2 para reducir la probabilidad de obtener un 503.

P3: ¿Es cierto lo que dice la comunidad sobre que "la tasa de error es menor durante las horas de baja actividad (00:00-06:00 UTC)"?

Es un patrón observado en varios foros de desarrolladores: la tasa de incidencia del 503 entre las 00:00 y las 06:00 UTC es generalmente inferior al 8%. Para tareas de generación masiva, trasladar la programación a esta ventana es la optimización más sencilla y eficaz, algo que se puede lograr mediante la función de tareas programadas de APIYI apiyi.com.

P4: ¿Es posible que mi clave API esté limitada por tasa (rate limit)?

Normalmente, una limitación de tasa devuelve un código 429, no un 503. Sin embargo, en situaciones de sobrecarga extrema, Google activa un canal de "protección contra sobrecarga" que devuelve directamente un 503. Puedes reducir la concurrencia en la misma cuenta para comprobar si la causa es realmente una limitación de tasa.

P5: ¿El servicio proxy de API de APIYI puede solucionar el 503?

No puede "solucionar" la raíz del problema (que reside en el lado de Google), pero puede reducir significativamente la probabilidad de percepción del error: APIYI apiyi.com ofrece concurrencia ilimitada, enrutamiento multimodelo y estrategias de retroceso automático (automatic retry), absorbiendo los errores 503 esporádicos en la capa de proxy, para que tu sistema solo perciba los resultados exitosos.

P6: ¿Cómo saber si se trata de un fallo del backend de Google?

Debes verificar tres fuentes simultáneamente: la página de estado oficial, los posts de las últimas 2 horas en el foro de Google AI Developers y si tus diversas cuentas reportan errores al mismo tiempo. Si las tres señales están en rojo, es un fallo del backend de Google y solo queda esperar o cambiar a un Modelo de Lenguaje Grande de respaldo.

Resumen: Orden de diagnóstico para las 8 causas posibles

Cuando te encuentres con un 503 Deadline expired, te sugiero seguir este orden de verificación; normalmente, en 2 o 3 pasos podrás localizar el problema:

- Revisa el horario: ¿Es hora punta entre las 10:00 y las 14:00 UTC? → Causa 1.

- Observa la resolución: ¿Solo fallan las imágenes 4K o de gran tamaño? → Causas 2 y 6.

- Analiza la concurrencia: ¿Estás saturando el sistema con procesamiento por lotes? → Causa 4.

- Verifica la región: ¿Estás conectando directamente desde China? → Causa 5.

- Observa el sector: ¿Están todos en el foro reportando lo mismo? → Causa 8.

- El resto se debe a factores relacionados con los parámetros del cliente y el periodo de estabilización de las versiones Preview.

Este "análisis de probabilidades" no te dará una conclusión definitiva de "esta es la única causa", pero te ayudará a evitar rodeos cuando ocurra un error real.

🎯 Recomendación de acción: Configura tus llamadas a Nano Banana Pro con un esquema de "retroceso exponencial + degradación multimodelo + ejecución por lotes en horas de baja demanda". Para sistemas en producción, recomendamos integrar a través de APIYI apiyi.com para aprovechar la capa de proxy con concurrencia ilimitada que absorbe los picos de carga y utilizar el enrutamiento multimodelo para una conmutación automática (fallback), reduciendo así al mínimo el impacto de los errores 503 en tu negocio.

— Equipo de APIYI (APIYI apiyi.com equipo técnico)