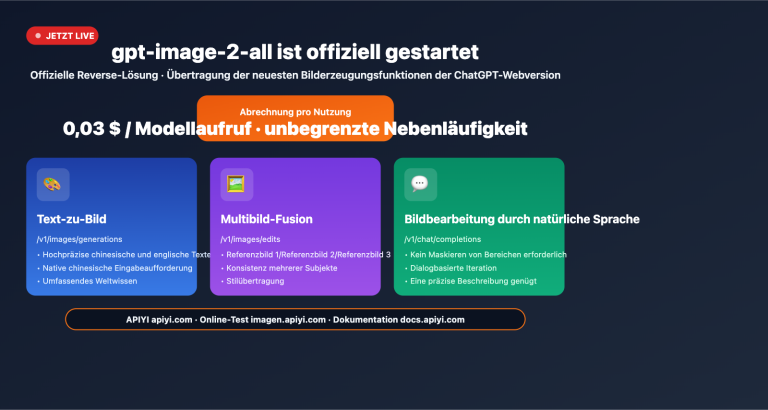

Anmerkung des Autors: In diesem Beitrag zeige ich Ihnen Schritt für Schritt, wie Sie gpt-image-2 über einen benutzerdefinierten Endpunkt in Chatbox einbinden. Zudem analysieren wir tiefgreifend, warum Chatbox keine kontinuierliche Bildbearbeitung wie die ChatGPT-Weboberfläche unterstützt – der Grund liegt in der architektonischen Trennung der drei Endpunkte images/generations, chat/completions und Responses API.

Viele Nutzer konfigurieren ihren OpenAI API-Schlüssel in der Chatbox-App und versuchen, mit gpt-image-2 direkt Bilder zu generieren, erhalten jedoch Fehlermeldungen oder Zeichensalat. Dieser Artikel liefert Ihnen zwei Antworten: Erstens: Der korrekte Weg zur Einbindung von gpt-image-2 in Chatbox (benutzerdefinierter Endpunkt https://api.apiyi.com/v1/images/generations); zweitens, und das ist noch wichtiger: Warum Chatbox nicht wie die ChatGPT-Weboberfläche "ein Bild generieren und dieses dann im Dialog anpassen" kann.

Dies ist kein Bug in Chatbox, sondern liegt daran, dass OpenAI die Bilderzeugung, die Dialogvervollständigung und die mehrstufige Bearbeitung auf drei völlig unterschiedliche API-Endpunkte verteilt hat. Der Standardpfad, den Chatbox nutzt, unterstützt schlichtweg keine kontinuierliche Bildbearbeitung.

Kernnutzen: Nach dem Lesen dieses Artikels werden Sie die Grenzen und Fähigkeiten der drei OpenAI-Kernendpunkte genau verstehen. Sie wissen, wann Chatbox ausreicht, wann Sie zur Responses API wechseln müssen und wie Sie den API-Proxy-Dienst von APIYI nutzen, um jeden Endpunkt in China stabil anzusteuern.

Die richtige Methode zur Einbindung von gpt-image-2 in Chatbox

Zuerst das Wichtigste – wenn Sie gpt-image-2 sofort in Chatbox zum Laufen bringen möchten, folgen Sie diesen Schritten, um das Ziel in 5 Minuten zu erreichen.

Kernkonfiguration für gpt-image-2 in Chatbox

Chatbox ruft die API standardmäßig als "Chat-Dialog-Vervollständigung" auf (d. h. über den Endpunkt /v1/chat/completions), aber gpt-image-2 ist kein Dialogmodell, sondern ein reines Modell zur Bilderzeugung, dessen Endpunkt /v1/images/generations lautet. Daher müssen Sie die Standardadresse über die Funktion "Benutzerdefinierter Endpunkt" in Chatbox anpassen.

Vollständige Konfigurationsschritte:

| Schritt | Aktion | Parameter |

|---|---|---|

| 1 | Chatbox-Einstellungen → Modellanbieter → Benutzerdefinierten Anbieter hinzufügen | OpenAI API-Kompatibilitätsmodus wählen |

| 2 | API-Host | https://api.apiyi.com |

| 3 | API-Pfad (wichtig!) | /v1/images/generations |

| 4 | API-Schlüssel | Bearer-Token aus dem APIYI-Dashboard |

| 5 | Modell-Feld | gpt-image-2 |

| 6 | Timeout | Auf ≥ 360 Sekunden setzen |

Minimales Aufrufbeispiel für gpt-image-2 in Chatbox

Hier ist das offiziell empfohlene curl-Beispiel, mit dem Sie vorab prüfen können, ob Ihr API-Schlüssel funktioniert:

curl --request POST \

--url https://api.apiyi.com/v1/images/generations \

--header 'Authorization: Bearer sk-your-apiyi-key' \

--header 'Content-Type: application/json' \

--data '{

"model": "gpt-image-2",

"prompt": "横版 16:9 电影画幅,黄昏时的海边老灯塔"

}'

Sobald dieser curl-Befehl funktioniert, können Sie den Endpunkt in Chatbox auf /v1/images/generations umstellen und das Modell nutzen.

🎯 Konfigurationshinweis: Bei der ersten Einrichtung eines benutzerdefinierten Endpunkts in Chatbox empfiehlt es sich, den API-Schlüssel und den Endpunktpfad zunächst per curl zu verifizieren. Wir empfehlen, über die Plattform APIYI (apiyi.com) Testguthaben zu beziehen; das kostenlose Kontingent reicht aus, um die gesamte Konfiguration zu validieren.

Häufige Konfigurationsfehler bei der Einbindung von gpt-image-2

Hier sind die 5 häufigsten Fehler, die Nutzer machen:

| Fehlerbild | Ursache | Lösung |

|---|---|---|

Rückgabe model not found |

Endpunkt /v1/chat/completions verwendet |

Auf /v1/images/generations ändern |

Rückgabe invalid prompt format |

Chat-Messages-Format verwendet | prompt-Feld (String) verwenden |

| Request-Timeout nach 60 Sek. | Standard-Timeout zu kurz | Auf ≥ 360 Sek. erhöhen (für High-Quality-Bilder) |

| Bild wird nicht angezeigt | Chatbox parst kein b64_json | Antwort im url-Format anfordern |

| Chinesischer Prompt fehlerhaft | Kodierungsproblem | Content-Type: application/json; charset=utf-8 sicherstellen |

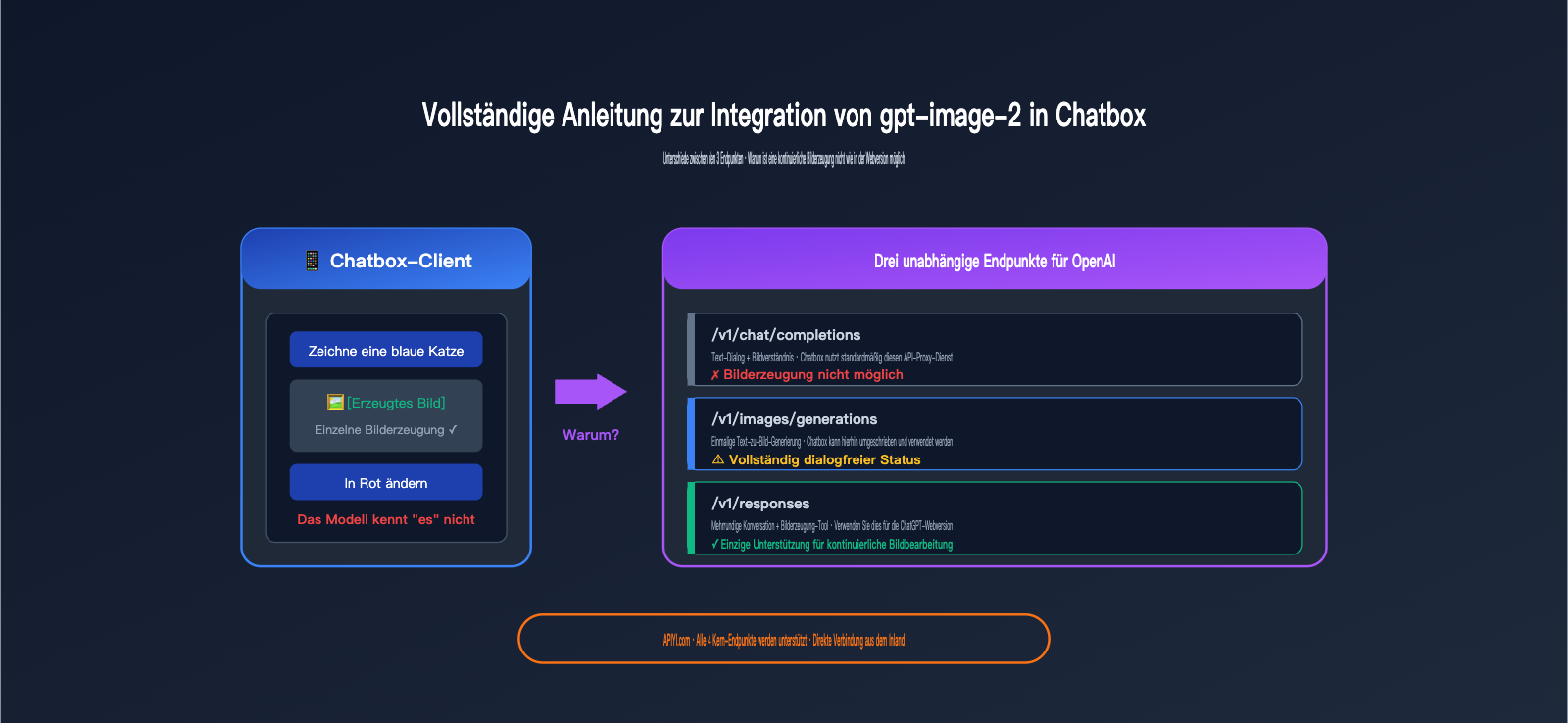

Das ist der entscheidende technische Punkt dieses Artikels – viele Nutzer fragen nach der Konfiguration: „Warum kann ich in Chatbox ein Bild generieren, aber wenn ich danach sage ‚Ändere den Himmel in Blau‘, versteht das Modell überhaupt nichts mehr? Während die ChatGPT-Weboberfläche unendlich viele Änderungen hintereinander erlaubt?“

Die Antwort liegt nicht an einem Bug in Chatbox, sondern daran, dass der Endpunkt selbst dies nicht unterstützt.

Die architektonischen Einschränkungen des Endpunkts bei der Einbindung von gpt-image-2 in Chatbox

Um dieses Problem zu verstehen, müssen wir uns die drei völlig unabhängigen Endpunkte ansehen, die OpenAI offiziell bereitstellt:

| Endpunkt | Pfad | Design-Ziel | Unterstützt Bilderzeugung | Verfügt über Dialogstatus |

|---|---|---|---|---|

| Chat Completions | /v1/chat/completions |

Text-Dialogvervollständigung | ❌ Nur Bildeingabe | ❌ Client-seitig verwaltet |

| Image Generations | /v1/images/generations |

Einmalige Text-zu-Bild-Erzeugung | ✅ Nur Erzeugung | ❌ Komplett zustandslos |

| Image Edits | /v1/images/edits |

Einmalige Bild-zu-Bild-Bearbeitung | ✅ Bearbeitung | ❌ Komplett zustandslos |

| Responses API | /v1/responses |

Mehrrunden-Dialog + Tool-Aufruf | ✅ Tool-Aufruf | ✅ Server-seitig verwaltet |

Die entscheidende Wahrheit:

- Chatbox nutzt standardmäßig

/v1/chat/completions– dieser Endpunkt unterstützt keine Bilderzeugung. - Wenn Sie den Pfad auf

/v1/images/generationsändern, können Sie zwar Bilder erzeugen, aber dieser Endpunkt ist komplett zustandslos – jede Anfrage ist isoliert. - Die ChatGPT-Weboberfläche nutzt im Hintergrund

/v1/responses– sie hat einen integriertenimage_generation-Tool-Aufruf sowie einen server-seitigen Dialogstatus.

Warum die ChatGPT-Weboberfläche Bilder kontinuierlich bearbeiten kann

Der Arbeitsablauf hinter der ChatGPT-Weboberfläche sieht wie folgt aus:

- Sie geben ein: „Zeichne eine blaue Katze“.

- ChatGPT ruft den Endpunkt

/v1/responsesauf, das Modell entscheidet sich für den Tool-Aufrufimage_generation. - Das Tool gibt eine Bild-ID zurück (z. B.

ig_abc123) und speichert diese gleichzeitig im server-seitigen Status der aktuellen Sitzung. - Sie sagen daraufhin: „Ändere sie in Rot“.

- ChatGPT ruft erneut

/v1/responsesauf und übergibt dieprevious_response_id. - Das Modell erkennt anhand des Kontextes, dass sich „sie“ auf das vorherige Bild bezieht, und ruft die

edit-Aktion desimage_generation-Tools auf. - Das Tool bearbeitet das vorherige Bild und gibt ein neues Bild zurück.

Der Schlüssel des gesamten Prozesses liegt in der Kombination aus previous_response_id + server-seitigem Dialogstatus + integriertem image_generation-Tool – all diese Fähigkeiten besitzt der Endpunkt /v1/images/generations nicht.

Die Grenzen der aktuellen Chatbox-Architektur

Chatbox ist ein Client im Chat-Completions-Stil – sein Kern-Datenmodell ist ein „Messages-Array“ (system / user / assistant Nachrichten für mehrere Runden). Sein Arbeitsmechanismus:

- Jede Nachricht des Nutzers wird an das Messages-Array angehängt.

- Ein Endpunkt im Chat-Stil wird aufgerufen (standardmäßig

/v1/chat/completions). - Die Antwort wird an das Messages-Array angehängt.

- Wiederholung.

Wenn Sie den Endpunkt auf /v1/images/generations umstellen, ändert Chatbox lediglich den Anforderungspfad – aber das Messages-Array wird weiterhin im Chat-Format gesendet, und der Endpunkt akzeptiert nur eine einzelne Eingabeaufforderung, wodurch der Dialogstatus überhaupt nicht übertragen werden kann.

💡 Technische Interpretation: Das Kerndesign von Chatbox geht davon aus, dass „der Endpunkt im Chat-Stil vorliegt“, während OpenAI Bilderzeugung und Bildbearbeitung als separate RESTful-Ressourcen-Endpunkte konzipiert hat. Dies ist eine architektonische Diskrepanz. Wir empfehlen, den Endpunkt

/v1/images/generationsfür die einmalige Bilderzeugung über die Plattform APIYI (apiyi.com) zu testen. Sobald die Ergebnisse validiert sind, können Sie planen, ob ein Wechsel zur Responses API erforderlich ist.

Chatbox-Integration: Funktionsumfang und Alternativen für gpt-image-2

Nachdem wir die Einschränkungen kennen, können wir eine klare Liste erstellen, was möglich ist und wo die Grenzen liegen.

Was mit Chatbox + gpt-image-2 möglich ist

| Szenario | Unterstützt | Anmerkung |

|---|---|---|

| Einzelbild-Erzeugung per Prompt | ✅ | Standard-Anwendungsfall |

| Englische/Deutsche Prompts | ✅ | Nativ von gpt-image-2 unterstützt |

| Festlegung von Größe/Seitenverhältnis | ✅ | Über den Parameter size |

| Festlegung der Bildqualität (standard/high) | ✅ | Über den Parameter quality |

| Ausgabe als URL oder Base64 | ✅ | Über den Parameter response_format |

Was mit Chatbox + gpt-image-2 nicht möglich ist

| Szenario | Unterstützt | Alternative |

|---|---|---|

| Nachträgliche Änderung ("Ändere es in Rot") | ❌ | Wechsel zur Responses API |

| Iterative Anpassung von Bilddetails | ❌ | Wechsel zur Responses API |

| Bild-Upload + Prompt für lokale Bearbeitung | ❌ Chatbox unterstützt dies nicht | Wechsel zu /v1/images/edits oder Responses API |

| Fusion mehrerer Referenzbilder | ❌ Chatbox unterstützt dies nicht | Wechsel zur Responses API |

| Serverseitige Speicherung der Dialoghistorie | ❌ | Wechsel zur Responses API |

Minimaler Code für die kontinuierliche Bilderzeugung mit der Responses API

Wenn Sie eine "dialogbasierte Bildbearbeitung" benötigen, müssen Sie auf den Chatbox-Client verzichten und den Endpunkt /v1/responses direkt ansprechen:

from openai import OpenAI

client = OpenAI(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com/v1",

timeout=600.0

)

# Erste Runde: Generierung des Ausgangsbildes

resp1 = client.responses.create(

model="gpt-5", # Responses API benötigt die gpt-5-Serie

input="Zeichne eine blaue Katze, die im Mondlicht spazieren geht, realistischer Stil",

tools=[{"type": "image_generation"}]

)

response_id_1 = resp1.id

print("Erstes Bild:", resp1.output[-1])

# Zweite Runde: Modifikation basierend auf der vorherigen Runde (entscheidend ist previous_response_id)

resp2 = client.responses.create(

model="gpt-5",

previous_response_id=response_id_1, # Verknüpfung des Dialogstatus

input="Ändere die Farbe in Orange und den Hintergrund in einen Sonnenaufgang",

tools=[{"type": "image_generation"}]

)

print("Nach der Änderung:", resp2.output[-1])

Beachten Sie dabei einige wichtige Punkte:

- Sie müssen

gpt-5oder ein neueres Modell verwenden (gpt-image-2 kann nicht direkt als Dialogmodell aufgerufen werden). - Sie müssen

tools=[{"type": "image_generation"}]übergeben, um das Tool zu aktivieren. - Sie müssen

previous_response_idverwenden, um die Dialoghistorie zu verknüpfen, da das Modell sonst nicht weiß, worauf sich "es" bezieht.

🚀 Integrations-Tipp: Setzen Sie für die kontinuierliche Bilderzeugung mit der Responses API die

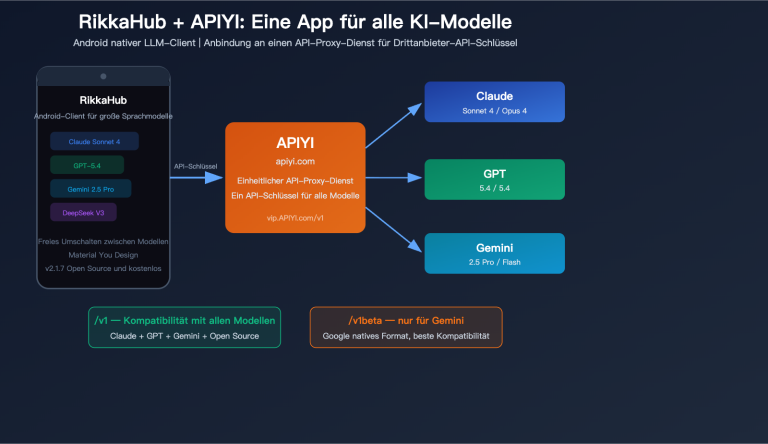

base_urlaufhttps://api.apiyi.com/v1. Diese ist vollständig kompatibel mit den offiziellen OpenAI-Feldern; Sie müssen lediglich diebase_urlin Ihrem bestehenden OpenAI-SDK-Code anpassen. Wir empfehlen die Anbindung über APIYI (apiyi.com) für eine stabile Verbindung aus dem Inland.

Praxis-Konfigurationsleitfaden für die Anbindung von gpt-image-2 an Chatbox

Nachdem wir die theoretischen Grundlagen geklärt haben, finden Sie hier eine vollständige Schritt-für-Schritt-Anleitung für den Einstieg.

Schritt 1: API-Schlüssel von der APIYI-Plattform abrufen

- Besuchen Sie das APIYI-Dashboard unter

api.apiyi.com. - Melden Sie sich an und navigieren Sie zur Seite „API-Token“.

- Erstellen Sie ein neues Token (es wird empfohlen, für verschiedene Projekte separate Token zu verwenden).

- Kopieren Sie das vollständige Bearer-Token (beginnt mit

sk-).

Schritt 2: Chatbox-Anbieter konfigurieren

Führen Sie in Chatbox folgende Schritte aus:

- Öffnen Sie „Einstellungen“ → „Modellanbieter“.

- Klicken Sie auf „Hinzufügen“ → wählen Sie „Benutzerdefinierter OpenAI-kompatibler Anbieter“.

- Füllen Sie die folgenden Felder aus:

Name: APIYI - Bilderzeugung

API Host: https://api.apiyi.com

API Path: /v1/images/generations # Wichtig! Muss angepasst werden

API Key: sk-your-apiyi-key

Standardmodell: gpt-image-2

- Erweiterte Einstellungen:

- Anfrage-Timeout: 600 Sekunden

- Wiederholungsversuche: 2

- Zeichenkodierung: UTF-8

Schritt 3: Test-Eingabeaufforderung senden

Geben Sie im Chatbox-Dialog Folgendes ein:

Querformat 16:9 Film-Look, alter Leuchtturm am Meer bei Dämmerung,

weiche warme Farbtöne, leichter Nebel über dem Wasser, 2K-Auflösung

Wenn die Konfiguration korrekt ist, sollten Sie das generierte Bild innerhalb von 1–3 Minuten erhalten.

Schritt 4: Schnelle Fehlerbehebung

| Problem | Prüfpunkt |

|---|---|

| Kein Inhalt wird zurückgegeben | Prüfen Sie, ob der API-Schlüssel vollständig ist und Berechtigungen zur Bilderzeugung vorliegen |

| Fehlercode 401 | API-Schlüssel falsch oder abgelaufen, neu abrufen |

| Fehlercode 404 | API-Pfad falsch geschrieben, bestätigen Sie /v1/images/generations |

| Fehlercode 429 | Ratenbegrenzung erreicht, einige Minuten warten und erneut versuchen |

| Timeout | Timeout-Zeit zu kurz, auf 600 Sekunden erhöhen |

💡 Profi-Tipp: Wenn Sie gpt-image-2 in Ihre eigene Anwendung statt in einen Desktop-Client integrieren möchten, empfiehlt es sich, direkt das offizielle OpenAI-SDK für den Aufruf von

/v1/images/generationszu verwenden – das ist wesentlich flexibler als Chatbox. Wir empfehlen die Anbindung über APIYI (apiyi.com), wobei Sie diebase_urleinfach durchhttps://api.apiyi.com/v1ersetzen.

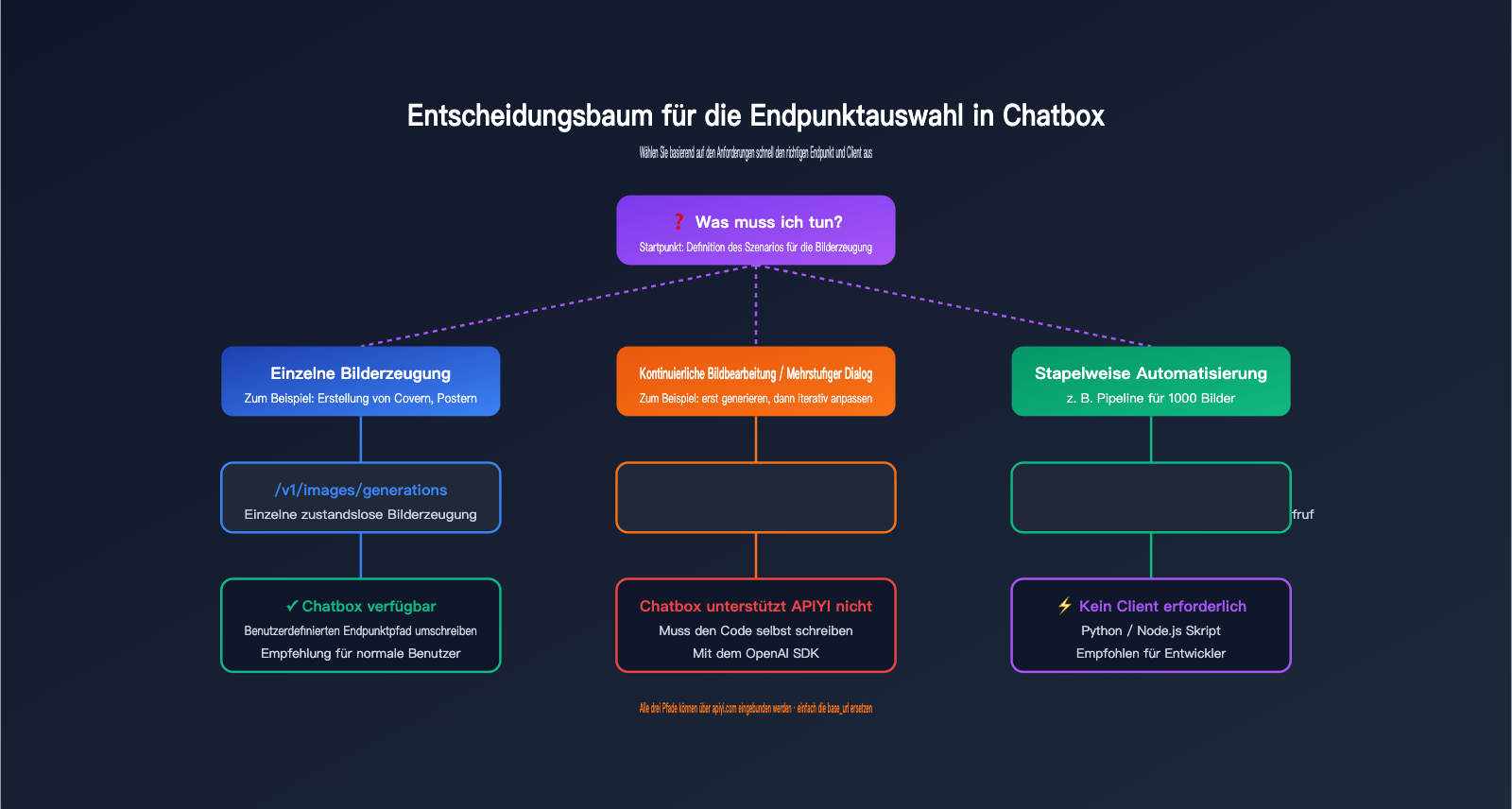

Entscheidungsleitfaden für die drei Endpunkte

Die folgende Tabelle hilft Ihnen bei der schnellen Entscheidung, welcher Endpunkt für welches Szenario geeignet ist:

| Ihr Bedarf | Empfohlener Endpunkt | Geeigneter Client |

|---|---|---|

| Einmalige Text-zu-Bild-Generierung | /v1/images/generations |

Chatbox / curl / SDK |

| Einmalige Bildbearbeitung (mit Maske) | /v1/images/edits |

curl / SDK (Chatbox nicht ideal) |

| Kontinuierliche Bildänderung im Dialog | /v1/responses |

Eigener Code (Chatbox nicht unterstützt) |

| Nur Text-Dialog | /v1/chat/completions |

Chatbox / beliebiger Chat-Client |

| Text-Dialog + Bildverständnis | /v1/chat/completions |

Von Chatbox unterstützt |

FAQ zur Anbindung von gpt-image-2 an Chatbox

Frage 1: Warum unterstützt Chatbox offiziell kein kontinuierliches Generieren von Bildern mit gpt-image-2?

Dies ist kein Designfehler von Chatbox, sondern eine grundsätzliche Einschränkung von Client-Anwendungen. Das Datenmodell von Chatbox basiert auf einem messages-Array (Chat-Stil), während das Responses-API-Modell auf previous_response_id und einem serverseitigen Dialogstatus basiert – beides sind grundlegend inkompatible Paradigmen. Damit Chatbox dies unterstützen könnte, müsste die gesamte Dialog-Engine neu geschrieben werden.

Frage 2: Kann ich nach der Konfiguration eines benutzerdefinierten Endpunkts in Chatbox Bilder hochladen, damit gpt-image-2 sie bearbeitet?

Theoretisch ja, praktisch ist es sehr umständlich. Der Endpunkt /v1/images/edits erfordert einen Upload im Format multipart/form-data, während das Chat-Fenster von Chatbox nur Texteingaben unterstützt. Eine erzwungene Konfiguration führt zu einem 415-Fehler. Empfohlene Alternative: Verwenden Sie curl, Postman oder ein eigenes Skript, um /v1/images/edits direkt anzusprechen.

Frage 3: Unterstützt der API-Proxy-Dienst von APIYI die Responses API?

Vollständig. APIYI ist ein offizieller Proxy-Dienst, bei dem die Anfrage-/Antwortfelder zu 100 % mit OpenAI synchron sind. Dies umfasst alle vier Kern-Endpunkte: /v1/responses, /v1/images/generations, /v1/images/edits und /v1/chat/completions. Wir empfehlen, die Responses API über APIYI (apiyi.com) für die kontinuierliche Bilderzeugung zu nutzen, da dies eine stabile direkte Verbindung aus China ohne Proxy ermöglicht.

Frage 4: Wie lang darf das Feld "prompt" sein, wenn ich gpt-image-2 über Chatbox aufrufe?

OpenAI begrenzt das Prompt-Feld offiziell auf 32.000 Zeichen. In der Praxis empfehlen wir jedoch, unter 1.000 Zeichen zu bleiben – zu lange Prompts führen oft dazu, dass das Modell die Aufmerksamkeit verliert, was die Qualität der Bilderzeugung verschlechtert.

Frage 5: Kann ich in Chatbox gleichzeitig ein Chat-Modell und ein Modell zur Bilderzeugung konfigurieren?

Ja, Chatbox unterstützt die Konfiguration mehrerer "benutzerdefinierter Anbieter". Wir empfehlen, zwei Profile zu erstellen:

APIYI - Chat→ Endpunkt/v1/chat/completions→ Modellgpt-5/claude-sonnet-4-6etc.APIYI - Bilderzeugung→ Endpunkt/v1/images/generations→ Modellgpt-image-2

Durch den Wechsel des Anbieters können Sie einfach zwischen den beiden Modi umschalten.

Frage 6: Wie stelle ich fest, ob ein Fehler bei der Nutzung von gpt-image-2 in Chatbox an Chatbox oder an der API liegt?

Der schnellste Weg ist, die API direkt mit curl anzusprechen. Wenn curl funktioniert, liegt das Problem bei der Chatbox-Konfiguration. Wenn auch curl fehlschlägt, liegt das Problem beim API-Schlüssel oder der Netzwerkverbindung. Das curl-Beispiel am Anfang dieses Artikels kann direkt kopiert und verwendet werden.

Frage 7: Was ist der Unterschied zwischen der Nutzung über APIYI und dem offiziellen OpenAI-Dienst?

Die Felder sind identisch, da APIYI ein offizieller Proxy-Dienst ist. Die Unterschiede liegen hauptsächlich in drei Punkten: Direkte Verbindung aus China ohne Proxy, spezieller technischer Support auf Chinesisch und transparente Abrechnung. Wir empfehlen Entwicklern in China, gpt-image-2 über APIYI (apiyi.com) anzubinden, um Netzwerkinstabilitäten zu vermeiden.

Frage 8: Wann sollte ich Chatbox aufgeben und stattdessen eigenen Code für die Responses API schreiben?

Drei klare Anzeichen:

- Sie benötigen eine "dialogbasierte Bildbearbeitung" – einmal generieren, mehrfach feinabstimmen.

- Sie benötigen eine gemischte Ausgabe aus Bild und Text (erst eine Erklärung, dann ein Bild, dann weitere Erklärungen und Bilder).

- Sie entwickeln ein Produkt und kein privates Projekt und müssen den Dialogstatus serverseitig verwalten.

Wenn eine dieser Bedingungen erfüllt ist, sollten Sie auf die Responses API umsteigen.

Wichtige Erkenntnisse zur Anbindung von gpt-image-2 an Chatbox

- Chatbox nutzt standardmäßig

/v1/chat/completions– dieser Endpunkt unterstützt keine Bilderzeugung; er muss auf/v1/images/generationsumgestellt werden. /v1/images/generationsist ein zustandsloser Endpunkt – jede Anfrage ist unabhängig, eine "kontinuierliche Bearbeitung" ist hier nicht möglich.- Die kontinuierliche Bilderzeugung in ChatGPT basiert auf der Responses API – durch das integrierte

image_generation-Tool und denprevious_response_id-Dialogstatus. - Dass Chatbox keine kontinuierliche Bilderzeugung unterstützt, ist kein Bug – es ist ein grundlegender Unterschied zwischen Chat-Clients und dem Responses-API-Paradigma.

- Alternative: Wenn Sie kontinuierliche Bilderzeugung benötigen, schreiben Sie eigenen Code mit dem OpenAI SDK für

/v1/responsesund verwenden Sie Modelle der gpt-5-Serie. - Empfehlung für die Nutzung in China: Anbindung über APIYI (apiyi.com); alle 4 Kern-Endpunkte werden unterstützt, einfach die

base_urlersetzen. - Schnelle Fehlerbehebung: Bei Konfigurationsfehlern erst mit curl testen. Wenn curl funktioniert, liegt das Problem am Client, nicht an der API.

Zusammenfassung

Das Problem bei der "Konfiguration" von Chatbox für die Anbindung von gpt-image-2 ist nur die Oberfläche. Was Entwickler wirklich verstehen müssen, ist die Architektur der drei unabhängigen Endpunkte von OpenAI – sie sind für unterschiedliche Anwendungsszenarien konzipiert und haben völlig unterschiedliche Leistungsgrenzen:

- Chat Completions ist der Endpunkt für "Textdialoge + Bildverständnis", kann jedoch keine Bilder erzeugen.

- Images Generations / Edits ist ein zustandsloser Endpunkt für die "einmalige Bilderzeugung/Bearbeitung", einfach und direkt, unterstützt aber keine mehrstufigen Iterationen.

- Responses API ist der Endpunkt für "mehrstufige Dialoge + Werkzeugaufrufe" und der einzige Weg, eine "dialogbasierte Bildbearbeitung" zu realisieren.

Da Chatbox ein Client im Chat-Stil ist, kann er nur eine der beiden erstgenannten Modi perfekt adaptieren – durch die Anpassung des benutzerdefinierten Endpunkts zur Unterstützung der einmaligen Bilderzeugung. Um jedoch das "unendliche dialogbasierte Bearbeiten" wie in der ChatGPT-Webversion zu erreichen, müssen Sie auf Client-Tools verzichten und den Aufruf der Responses API selbst programmieren.

Sobald Sie dies verstanden haben, wird die Wahl Ihres Workflows klar:

- Kleiner Maßstab, einmalige Bilderzeugung, private Nutzung → Chatbox +

/v1/images/generations - Kontinuierliche Bildbearbeitung, produktionsreife Integration → Responses API + eigener Code

- Batch-Bilderzeugung, automatisierte Pipelines → Direkter SDK-Aufruf von

/v1/images/generations

✨ Abschließende Empfehlung: Für Entwickler im deutschsprachigen Raum (und darüber hinaus) empfehlen wir die Anbindung über die Plattform APIYI (apiyi.com) – alle 4 Kern-Endpunkte werden unterstützt, die Felder sind zu 100 % mit denen von OpenAI identisch, die Verbindung ist stabil und die Abrechnung erfolgt transparent nach Token. Neue Nutzer erhalten ein kostenloses Testguthaben, das ausreicht, um sowohl die Chatbox-Konfiguration als auch die Responses API zu validieren.

Autor: APIYI Team

Letzte Aktualisierung: 02.05.2026