Fazit in einem Satz: Die Einbindung von gpt-image-2 über einen offiziellen API-Proxy-Dienst (Official Relay) birgt bei angemessener Nutzung keine zusätzlichen rechtlichen Risiken – die Risikostruktur ist identisch mit der direkten Nutzung der offiziellen OpenAI-API durch ein Unternehmen. Wenn der API-Proxy-Dienst jedoch Reverse-Engineering-Kanäle nutzt, übertragen sich die Compliance-Risiken entlang der Aufrufkette auf das Unternehmen. Dieser Artikel bietet eine präzise Beurteilungsmethode und eine 8-Punkte-Checkliste für die Rechtsabteilung.

Seit der offiziellen Veröffentlichung von gpt-image-2 durch OpenAI am 21. April 2026 wird das Modell im inländischen B2B-Bereich breit eingesetzt. Die drei häufigsten Fragen der Rechtsabteilungen von Unternehmen lauten: Dürfen wir das direkt nutzen? Bestehen Compliance-Risiken? Wem gehören die generierten Bilder?

Diese Fragen wirken simpel, betreffen jedoch die Servicebedingungen von OpenAI, die Nutzungsrichtlinien, Entschädigungsklauseln, Sicherheitsmechanismen für Inhalte, kommerzielle Eigentumsrechte sowie die bei inländischen Unternehmen oft übersehenen "Unterschiede bei den API-Proxy-Diensten". Ohne die englischen Originaltexte der OpenAI-Verträge vollständig gelesen zu haben, neigen Juristen oft zu konservativen, aber falschen Schlussfolgerungen.

Dieser Artikel gliedert das Compliance-Spektrum von gpt-image-2 in der Reihenfolge der tatsächlichen Genehmigungsprozesse von Unternehmen auf.

I. Die zwei Kanäle, die vor der Einbindung von gpt-image-2 unterschieden werden müssen

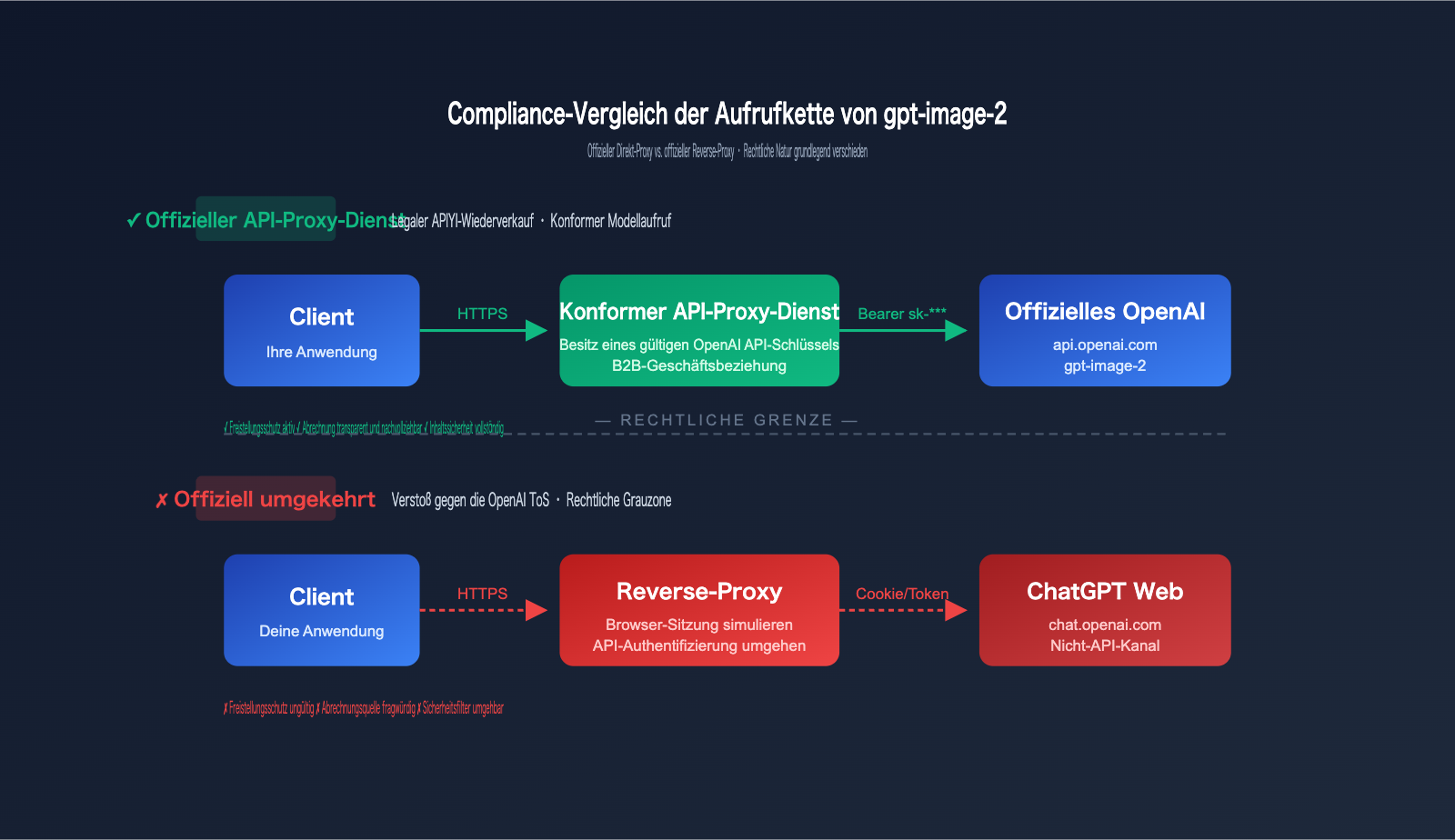

Bei der Compliance-Prüfung von KI-Diensten durch inländische Rechtsabteilungen geht es im Kern nicht um das Modell selbst, sondern darum, ob die "Aufrufkette bis zur rechtmäßigen Autorisierung zurückverfolgbar ist". Deshalb muss die Rolle des "API-Proxy-Dienstes" klar definiert werden.

1.1 Offizieller Relay vs. Reverse-Engineering: Grundlegende rechtliche Unterschiede

| Kanaltyp | Technische Umsetzung | OpenAI-Authentifizierung | Abrechnungsquelle | Rechtliche Einordnung |

|---|---|---|---|---|

| Offizieller Relay | Anbieter besitzt gültigen OpenAI API-Schlüssel, nimmt Anfragen entgegen und leitet sie weiter | Standard Authorization: Bearer sk-xxx |

Zahlung über offizielle OpenAI-Rechnung | Rechtmäßiger API-Wiederverkauf |

| Reverse-Engineering | Umgehung der API-Authentifizierung via ChatGPT-Websession/Account | Simulation von Browser-Session/Cookie | Multi-Account-Polling/Umgehung der Abrechnung | Verstoß gegen OpenAI ToS, rechtliche Grauzone |

| Selbst gehostet | Unternehmen besitzt eigenen API-Schlüssel für direkten Aufruf | Eigener Schlüssel | Eigene Zahlung | Standardnutzer, vollständig konform |

Wichtige Entscheidung: Wenn Sie eine Anfrage an einen Endpunkt wie https://api.example.com/v1/images/generations senden, müssen Sie wissen, wie der Anbieter im Hintergrund die Verbindung zu OpenAI herstellt.

🎯 Wichtiger Hinweis: Achten Sie bei der Wahl eines API-Proxy-Dienstes darauf, dass der Anbieter einen offiziellen Relay-Kanal verwendet. Die Plattform APIYI (apiyi.com) bindet beispielsweise die offizielle OpenAI-API an und verwendet intern rechtmäßig erworbene API-Schlüssel auf Unternehmensebene, was eine standardmäßige B2B-Geschäftsbeziehung mit OpenAI darstellt. Dies bestimmt den Compliance-Rahmen für nachgelagerte Unternehmenskunden.

1.2 Warum "Reverse-Engineering" für Unternehmen ein Mitrisiko darstellt

Die [Servicebedingungen] von OpenAI legen eindeutig fest, dass API-Nutzer die Zugriffsbeschränkungen von OpenAI nicht "umgehen, behindern oder stören" dürfen. Wenn der Anbieter durch Reverse-Engineering von ChatGPT arbeitet, gilt:

- Die vertragliche Haftung überträgt sich entlang der Vertragskette: Vertragsbruch durch den Anbieter → Das Unternehmen als nachgelagerter Nutzer kann bei nachgewiesener Unkenntnis dennoch als "indirekt vertragsbrüchig" eingestuft werden.

- Die Entschädigungsklausel (Indemnification) von OpenAI greift nicht: Dies wird später detailliert erläutert, aber kurz gesagt: Bei Reverse-Engineering-Kanälen erhalten Sie nicht den Schutz von OpenAI gegen Vorwürfe der Verletzung geistigen Eigentums Dritter.

- Sicherheitsmechanismen für Inhalte könnten umgangen werden: Reverse-Engineering-Kanäle modifizieren häufig Sicherheitsparameter wie

moderation, was dazu führen kann, dass vom Unternehmen generierte Bilder gegen von OpenAI explizit verbotene Kategorien verstoßen, ohne dass das Unternehmen davon weiß.

1.3 Wie man den Typ des API-Proxy-Kanals schnell identifiziert

Unternehmensjuristen können bei der Due-Diligence-Prüfung von Anbietern folgende Fragen nutzen, um den Kanal schnell zu identifizieren:

✅ Checkliste zur Prüfung der Compliance-Kanäle

F1: "Bitte legen Sie einen Nachweis über Ihre API-Dienstbeziehung mit OpenAI vor

(z. B. OpenAI-Kontotyp, Screenshot des Unternehmenskontos, monatliche Abrechnung)."

F2: "Ist der von Ihnen aufgerufene Endpunkt api.openai.com oder

eine von chat.openai.com abgeleitete Schnittstelle?"

F3: "Wenn unsere Anfrage die Inhaltsmoderation von OpenAI auslöst,

wird der Fehlercode unverändert zurückgegeben? Oder wird er von Ihnen umgeschrieben?"

Offizielle Relays können die ersten beiden Fragen in der Regel direkt beantworten, und die Antwort auf die dritte Frage lautet "unveränderte Rückgabe von 400/safety_violations". Reverse-Engineering-Dienste antworten oft ausweichend oder verweigern die Vorlage von Nachweisen.

II. Kommerzielle Grenzen von gpt-image-2 unter den offiziellen OpenAI-Bedingungen

Nachdem die Konformität des Kanals bestätigt wurde, lautet die nächste rechtliche Frage: "Dürfen wir die generierten Bilder direkt kommerziell nutzen?" Dieser Bereich wird durch die drei Dokumente von OpenAI definiert: Nutzungsbedingungen (Terms of Use), Servicebedingungen (Service Terms) und Nutzungsrichtlinien (Usage Policies).

2.1 Eigentumsrechte am Output: OpenAI überträgt diese explizit an den Nutzer

Abschnitt 3 "Content" der OpenAI Terms of Use legt klar fest:

"OpenAI hereby assigns to you all its right, title and interest in and to Output."

Wichtige Punkte zur Übersetzung:

- Der Nutzer behält das Eigentum an der Eingabe (Input).

- Der Nutzer besitzt die vollständigen Rechte am Output; OpenAI überträgt diese Rechte aktiv an den Nutzer.

- Das bedeutet: Bei Bildern, die von

gpt-image-2generiert wurden, sind Sie rechtlich gesehen der Rechteinhaber.

2.2 Kommerzieller Umfang: Alle geschäftlichen Handlungen inklusive Weiterverkauf

| Kommerzielle Handlung | Erlaubt? | Grundlage der OpenAI-Bedingungen |

|---|---|---|

| Interne Unternehmensnutzung (Werbung/PPT/Prototypen) | ✅ Erlaubt | Terms §3 |

| Marketing- und Werbekampagnen | ✅ Erlaubt | Terms §3 |

| Produktverpackungen/Druckerzeugnisse | ✅ Erlaubt | Terms §3 |

| E-Commerce-Produktbilder/Direktverkauf (Druck) | ✅ Erlaubt | Terms §3 |

| Weiterverkauf als SaaS-Dienst (API-Aufruf für Kunden) | ✅ Erlaubt | Terms §3 + Service Terms |

| Training von Konkurrenzmodellen | ❌ Verboten | Service Terms §2(c) |

Die einzige rote Linie: Es ist untersagt, den Output von gpt-image-2 zum Training von Modellen zu verwenden, die in direktem Wettbewerb zu den Diensten von OpenAI stehen. Dies ist die einzige kommerzielle Nutzung, die OpenAI ausdrücklich verbietet.

🎯 Empfehlung für Unternehmen: Wenn Ihr Geschäftsmodell darin besteht, Kunden einen "KI-Bilderzeugungs-SaaS" anzubieten, ist dieser Weg durch die OpenAI-Bedingungen abgedeckt. Wir empfehlen, die Plattform APIYI (apiyi.com) für parallele Modelltests zu nutzen. Diese unterstützt eine einheitliche Schnittstelle für führende Bildmodelle wie

gpt-image-2,Imagen 4undFlux 1.1 Pro, was Unternehmen die technische Auswahl unter Einhaltung der Compliance erleichtert.

2.3 Die Realität des Urheberrechtsschutzes: Sie "besitzen" es, können es aber schwer "geltend machen"

Dies ist der Punkt, an dem es für Rechtsabteilungen am häufigsten zu Verwirrungen kommt. Dass OpenAI Ihnen die "Rechte" überträgt, bedeutet nicht automatisch, dass dieses Bild unter dem "Urheberrechtsschutz" steht.

| Dimension | OpenAI-Bedingungen | Urheberrecht (Rechtspraxis in den USA/China) |

|---|---|---|

| Eigentum | OpenAI überträgt alle Rechte an den Nutzer | Je nach Einzelfall |

| Vollständiges Urheberrecht | Wird nicht zugesichert | US Copyright Office: Rein KI-generierte Werke sind nicht urheberrechtlich geschützt; in China erkennen einige Präzedenzfälle menschliche Beiträge an |

| Kommerzielle Rechte | Vollständig erlaubt, inkl. Weiterverkauf | Unabhängig davon – dies sind vertragliche Rechte, getrennt vom Urheberrecht |

| Schutz vor Diebstahl | Keine Exklusivität zugesichert | Geltendmachung von Urheberrechtsverletzungen oft schwierig |

Fazit für die Praxis: Sie können die von gpt-image-2 generierten Bilder bedenkenlos kommerziell nutzen, aber gehen Sie nicht davon aus, dass sie denselben Urheberrechtsschutz genießen wie handgezeichnete Werke eines Designers. Bei hochwertigen IP-Materialien (z. B. Markenlogos, Maskottchen) empfehlen wir, dass menschliche Designer auf Basis des KI-Outputs eine substanzielle kreative Überarbeitung vornehmen, um die Urheberrechtsfähigkeit zu gewährleisten.

III. Sicherheitsmechanismen von gpt-image-2 und die Prüfungspflicht des Unternehmens

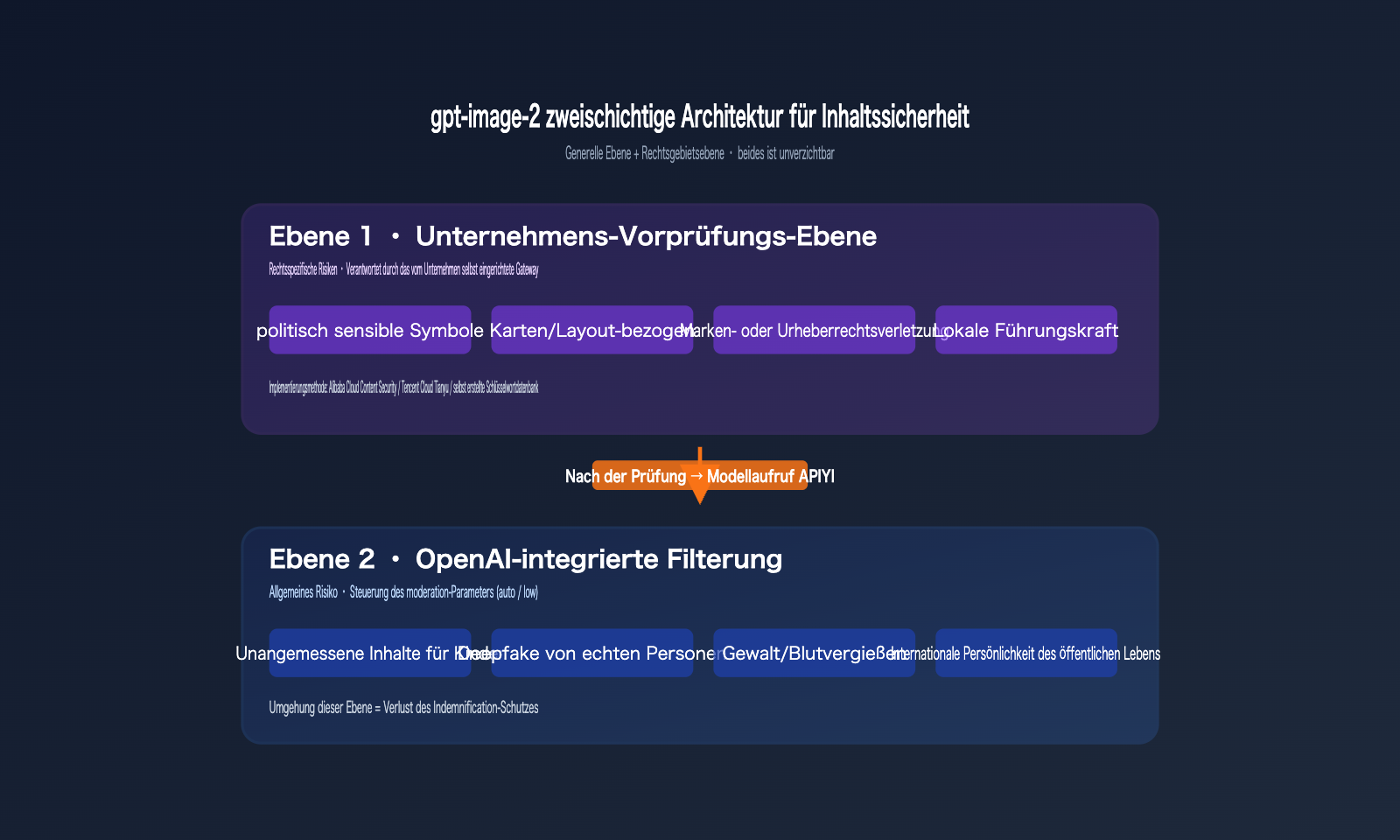

Die Inhaltssicherheit von OpenAI ist ein oft unterschätzter Teil des Compliance-Spektrums. Viele Rechtsabteilungen gehen fälschlicherweise davon aus, dass "die Sicherheitsfilter des Modells ausreichen" – ein gefährlicher Irrtum.

3.1 Die zwei Sicherheitsebenen von gpt-image-2

Die gpt-image-2 API verfügt bei der Bilderzeugung über zwei integrierte Sicherheitsebenen:

# Erste Ebene: Prüfung der Eingabeaufforderung (vor der Generierung)

# Zweite Ebene: Prüfung des generierten Bildes (vor der Rückgabe)

# Vom Unternehmen steuerbare Parameter:

{

"model": "gpt-image-2",

"prompt": "Ihre Eingabeaufforderung hier",

"moderation": "auto", # Standardwert, Standardfilterung

# "moderation": "low", # Optional, lockere Filterung, kann aber nicht deaktiviert werden

"size": "1024x1024",

"quality": "high"

}

Wichtig: Der Parameter moderation kann nur zwischen auto (Standard) und low gewählt werden, es gibt keine "off"-Option. Das bedeutet, dass OpenAI immer eine grundlegende Filterung beibehält – beispielsweise werden Inhalte, die Minderjährigen schaden oder Deepfakes realer Personen darstellen, in jedem Modus abgelehnt.

3.2 Inhaltskategorien, die von den OpenAI-Filtern nicht abgedeckt werden

Die Filter von OpenAI konzentrieren sich auf allgemeine, universelle Risiken, decken jedoch keine lokalen rechtlichen Risiken am Standort des Unternehmens ab:

| Risikokategorie | OpenAI-Filter | Anforderungen in Festlandchina |

|---|---|---|

| Unangemessene Inhalte für Kinder | ✅ Starke Filterung | ✅ Konsistent |

| Deepfakes realer Personen | ✅ Starke Filterung | ✅ Konsistent |

| Gewalt/Blutvergießen | ⚠️ Je nach Schweregrad | ✅ Strenge Kontrolle |

| Politisch sensible Symbole | ⚠️ Teilweise abgedeckt | ❗️ Erfordert unternehmensseitige Prüfung |

| Abbildungen nationaler Führungspersonen | ⚠️ Nur internationale Personen | ❗️ Erfordert unternehmensseitige Prüfung |

| Karten/Territoriale Darstellungen | ❌ Nicht abgedeckt | ❗️ Erfordert unternehmensseitige Prüfung |

| Kommerzielle Logos/Markenverletzungen | ❌ Nicht abgedeckt | ❗️ Erfordert unternehmensseitige Prüfung |

Wichtige Erkenntnis: Die Inhaltssicherheit von OpenAI ist die allgemeine Ebene; Unternehmen in Festlandchina haben darüber hinaus lokale Compliance-Pflichten. Selbst bei Nutzung eines konformen Kanals für gpt-image-2 muss das Unternehmen eine "vorgelagerte Inhaltsprüfung" auf Client- oder Gateway-Ebene durchführen.

🎯 Integrationsvorschlag: In der Praxis empfehlen wir Unternehmen, vor dem Aufruf von

gpt-image-2eine Ebene mit einer lokalen Inhalts-API (z. B. Alibaba Cloud Content Security oder Tencent Cloud Tianyu) zur Schlüsselwortfilterung zu nutzen. Nach Erhalt des Bildes sollte eine weitere Prüfung durch eine Bild-Content-Audit-API erfolgen. API-Proxy-Dienste wie APIYI (apiyi.com) geben diesafety_violations-Fehlercodes von OpenAI unverändert zurück, was es Unternehmen erleichtert, die Ergebnisse beider Prüfschichten einheitlich zu protokollieren.

3.3 Sicherheit, Compliance und die Bindung an die Freistellung (Indemnification)

Dies ist das rechtliche Detail, das am leichtesten übersehen wird. Abschnitt 7 der OpenAI Service Terms bietet eine Indemnification-Klausel (Freistellung):

Wenn ein API-Nutzer den Output innerhalb des rechtmäßigen Rahmens verwendet und von einem Dritten wegen Verletzung geistiger Eigentumsrechte verklagt wird, übernimmt OpenAI die Kosten für die Verteidigung und einen angemessenen Schadensersatz.

Dieser Schutz hat jedoch zwei Ausnahmen:

- Der Nutzer weiß oder sollte wissen, dass der Output möglicherweise Rechte verletzt, und verwendet ihn dennoch.

- Der Nutzer deaktiviert oder umgeht die von OpenAI bereitgestellten Sicherheitsmechanismen.

Bedeutung für die Praxis: Wenn Sie darauf bestehen, moderation: low zu verwenden, oder die Sicherheitsfilter von OpenAI durch technische Mittel umgehen, verzichten Sie aktiv auf den Schutz durch die Freistellung. Selbst wenn Sie einen perfekten API-Output erhalten haben, wird OpenAI Sie im Falle einer Klage wegen Rechtsverletzung nicht vor Gericht vertreten.

IV. PIPL und Datensicherheitsgesetz bei der Nutzung von gpt-image-2

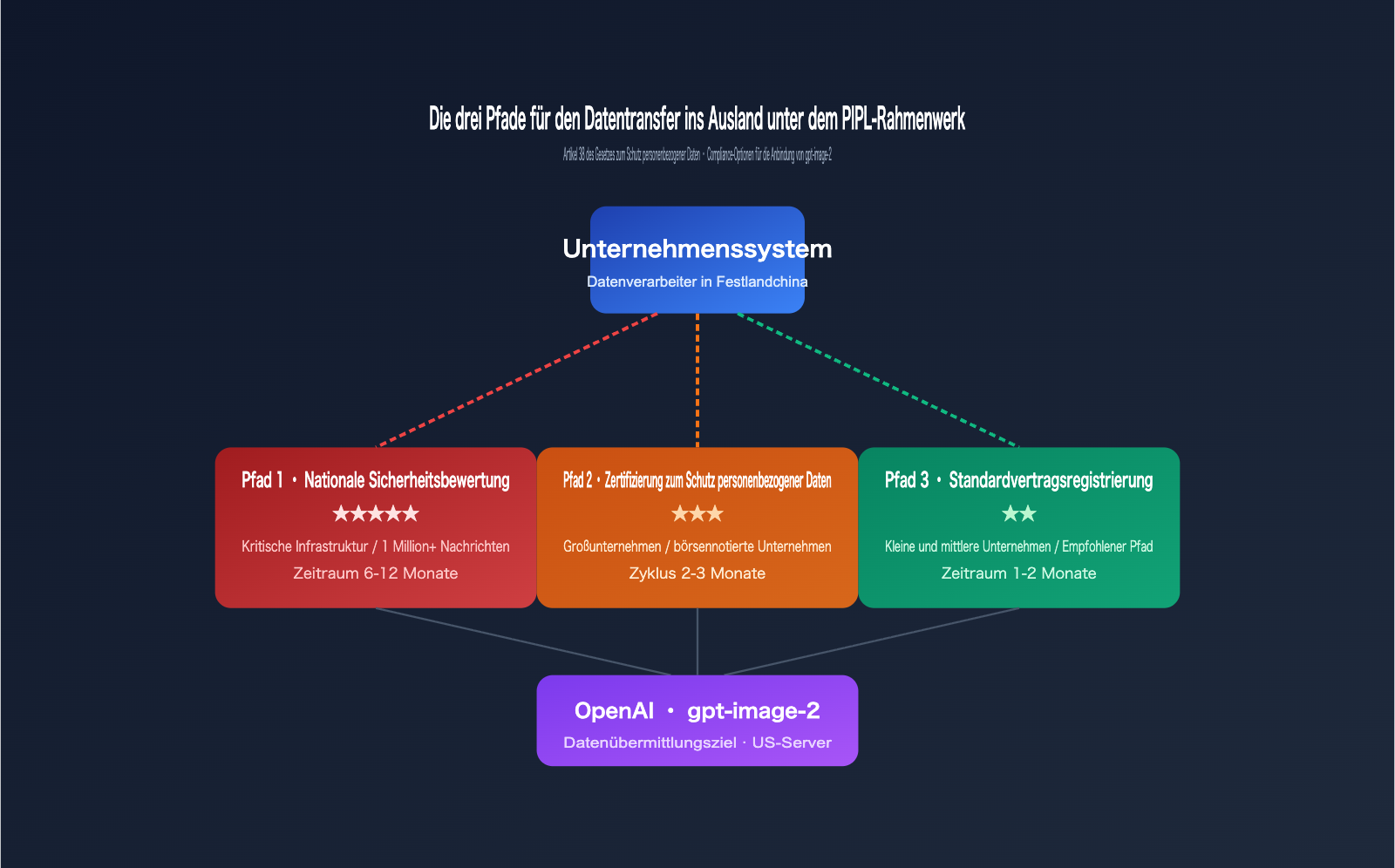

Wenn Unternehmen in Festlandchina gpt-image-2 integrieren, steht ein Problem an, das früher und grundlegender ist als die Wahl des API-Proxy-Dienstes: die Compliance bei der Datenübermittlung ins Ausland. Obwohl dies rechtlich von höchster Relevanz ist, wird es von vielen technischen Teams bei der Technologieauswahl oft übersehen.

4.1 Welche Daten gelten als "ins Ausland übermittelt"?

Die Server für die Verarbeitung der OpenAI-API befinden sich in den USA. Jede Anfrage an gpt-image-2 beinhaltet somit eine Datenübermittlung ins Ausland. Speziell bei der Bilderzeugung werden folgende Daten übertragen:

| Datentyp | Übermittlung | PIPL-Sensibilität |

|---|---|---|

| Prompt-Text | ✅ Ja | Je nach Inhalt |

| Referenzbild (Bild-zu-Bild) | ✅ Ja | Hoch (kann Gesichter/Szenen enthalten) |

| Erzeugtes Bild | ✅ Ja (Rückübertragung) | Mittel |

| Benutzer-IP/UA | ✅ Ja (bei Direktverbindung) | Niedrig |

| Geschäftsbezogene Daten (user_id, session_id) | ⚠️ Abhängig von Implementierung | Mittel |

🎯 Empfehlung für den Datenübertragungspfad: Durch die Nutzung eines konformen inländischen API-Proxy-Dienstes (z. B. APIYI, apiyi.com) gelangen Prompts zunächst auf einen inländischen Server, bevor sie über das inländische Netzwerk ins Ausland geleitet werden. Dies reduziert das Compliance-Risiko einer "direkten Verbindung des Benutzerendgeräts mit dem Ausland". Die Architektur des inländischen Gateways dieser Plattform entspricht den PIPL-Anforderungen an die Rolle des "Datenverarbeiters".

4.2 Drei Compliance-Pfade unter dem PIPL-Rahmenwerk

Artikel 38 des Gesetzes zum Schutz persönlicher Informationen (PIPL) legt drei Wege für die Datenübermittlung ins Ausland fest:

Pfad 1: Sicherheitsbewertung durch die nationale Cybersicherheitsbehörde

- Anwendbar für: Betreiber kritischer Informationsinfrastrukturen, Verarbeitung von Daten von > 1 Mio. Personen

- Schwierigkeit: ★★★★★ (Behördliche Prüfung, Dauer 6-12 Monate)

Pfad 2: Zertifizierung zum Schutz persönlicher Informationen

- Anwendbar für: Allgemeine Unternehmen, Zertifizierung durch Fachorganisationen

- Schwierigkeit: ★★★ (Organisationszertifizierung, Dauer 2-3 Monate)

Pfad 3: Standardvertrag (SCC)

- Anwendbar für: Die meisten Unternehmen, Abschluss und Hinterlegung eines Standardvertrags

- Schwierigkeit: ★★ (Relativ einfach, erfordert jedoch laufende Überwachung)

Für die Integration von gpt-image-2 ist für die allermeisten Unternehmen Pfad 3 (Standardvertrag) der richtige Weg. Das bedeutet:

- Abschluss einer Vereinbarung mit SCC-Klauseln mit den nachgelagerten Nutzern.

- Bewertung der Art und Sensibilität der übermittelten Daten.

- Hinterlegung bei der lokalen Cybersicherheitsbehörde.

4.3 Best Practices zur Reduzierung der Datensensibilität

Um die Compliance-Komplexität zu verringern, ohne das Geschäft zu beeinträchtigen, gibt es mehrere Ansätze:

| Methode | Implementierungskosten | Compliance-Nutzen |

|---|---|---|

| Standardisierte Prompt-Vorlagen (keine dynamische Einbettung von Privatsphäre) | Niedrig | Hoch |

| Anonymisierung von Referenzbildern (Gesichtsverpixelung/Hintergrundersatz) | Mittel | Hoch |

| Hashing von Benutzer-IDs (keine Übertragung echter user_id) | Niedrig | Mittel |

| Lokale Vorverarbeitung (Filterung sensibler Schlüsselwörter) | Mittel | Hoch |

| Konformer API-Proxy-Dienst (Abwicklung durch inländischen Anbieter) | Niedrig | Hoch |

4.4 PIPL-Compliance und gpt-image-2 Geschäftsszenarien

| Geschäftsszenario | Komplexität der Datenübermittlung | Empfohlener Compliance-Pfad |

|---|---|---|

| Bebilderung interner Unternehmensdokumente | Niedrig (keine personenbezogenen Daten) | Standardvertrag ausreichend |

| Erstellung von Marketingmaterial (ohne Gesichter) | Niedrig | Standardvertrag |

| Erstellung von Nutzerprofilen (mit Gesichtern) | Hoch | Zertifizierung + SCC |

| E-Commerce-Produktbilder (mit Models) | Mittel | Standardvertrag + Model-Release |

| Erstellung von Social-Media-Avataren (mit Nutzerfotos) | Hoch | Zertifizierung + explizite Zustimmung |

V. 8-Punkte-Checkliste für die rechtliche Prüfung bei der Implementierung von gpt-image-2 in Unternehmen

Hier ist die zusammengefasste Checkliste, die Sie direkt an Ihre Rechts- oder Compliance-Abteilung weitergeben können.

5.1 Vollständige Checkliste (nach Prüfungsreihenfolge)

| Nr. | Prüfpunkt | Standard für die Genehmigung | Risikostufe |

|---|---|---|---|

| 1 | Kanaltyp des API-Proxy-Dienstes | Muss offizielle Direktweiterleitung sein; Nachweis der OpenAI-Rechnungsbelege erforderlich | Hoch |

| 2 | Unternehmensqualifikation des Anbieters | Legal registriertes Unternehmen (Inland/Ausland) mit ICP/Betriebslizenz | Hoch |

| 3 | Datenübertragungspfad | Klärung, ob Prompt/Bild SSL-verschlüsselt sind und ob eine Protokollierung erfolgt | Mittel |

| 4 | Vorgelagerte Inhaltsprüfung | Doppeltes Prüfmechanismus: unternehmenseigene Prompt-Prüfung + Prüfung der generierten Bilder | Hoch |

| 5 | Strategie für moderation-Parameter |

Standardmäßig auto; bei low ist eine schriftliche Ausnahmegenehmigung erforderlich |

Mittel |

| 6 | Erklärung zur kommerziellen Nutzung | Ausschluss der Nutzung für das Training konkurrierender Modelle in den ToS | Mittel |

| 7 | Übertragung der Bildrechte | Klare vertragliche Vereinbarung über Eigentumsrechte mit Kunden/Endnutzern | Mittel |

| 8 | Notfallplan | Reaktionsprozess bei Beschwerden oder Klagen aufgrund generierter Bilder | Hoch |

5.2 Prioritätsunterschiede nach Unternehmensrolle

| Unternehmensrolle | Wichtige Prüfpunkte | Fokus der Rechtsabteilung |

|---|---|---|

| Direkter Aufruf (intern) | 1, 4, 5 | Compliance des API-Proxy-Kanals, Inhaltssicherheit |

| SaaS-Anbieter (Wiederverkauf) | 1, 6, 7 | Kommerzielle Grenzen, Rechtevereinbarungen mit Kunden |

| Börsennotierte/Staatsunternehmen | Alle 8 Punkte | Vollständiger Audit-Trail, nachvollziehbare Belege |

| Grenzüberschreitender E-Commerce | 1, 4, 7 | Compliance in mehreren Rechtsgebieten, Rechtezuordnung |

🎯 Empfehlung für den Implementierungspfad: Für börsennotierte Unternehmen und Staatsbetriebe empfehlen wir API-Proxy-Dienste, die vollständige Rechnungen, Firmenzahlungen und SLA-Vereinbarungen bieten. Die Plattform APIYI (apiyi.com) unterstützt die Rechnungsstellung über Firmenkonten und den Abschluss formeller Serviceverträge, was alle Anforderungen für Compliance-Audits erfüllt.

5.3 Vorlage für eine „Compliance-Verpflichtungserklärung des Dienstleisters“

Um die oben genannte Checkliste vertraglich abzusichern, empfehlen wir, bei Vertragsabschluss mit dem API-Proxy-Dienstleister die schriftliche Bestätigung folgender Punkte einzufordern:

Wichtige Klauseln der Compliance-Verpflichtungserklärung (für die Rechtsabteilung)

1. Kanal-Compliance: Der Dienstleister garantiert, dass alle API-Weiterleitungen über den offiziellen OpenAI-API-Endpunkt (api.openai.com) erfolgen und keine Reverse-Engineering- oder Umgehungsmethoden genutzt werden.

2. Nachweispflicht: Der Dienstleister verpflichtet sich, Belege über die Geschäftsbeziehung zu OpenAI für mindestens 36 Monate aufzubewahren und bei Compliance-Audits des Kunden vorzulegen.

3. Transparenz der Sicherheitsparameter: Der Dienstleister garantiert, die vom Kunden übermittelten moderation-Parameter nicht zu verändern; Änderungen bedürfen einer vorherigen schriftlichen Mitteilung.

4. Weiterleitung von Fehlercodes: Der Dienstleister verpflichtet sich, alle von OpenAI zurückgegebenen Fehlercodes zu Sicherheits- oder Richtlinienverstößen unverändert an den Kunden weiterzuleiten.

5. Keine Datenspeicherung: Der Dienstleister garantiert, Prompts und Bilder nur temporär während der Verarbeitung zu speichern und diese spätestens N Stunden nach Abschluss zu löschen.

VI. Praxisbeispiel: Minimaler, regelkonformer Code für gpt-image-2

Nach der rechtlichen Einordnung folgt hier ein minimaler, ausführbarer Code mit vorgelagerter Prüfung, der Ihrem Technik-Team hilft, eine Compliance-Basis zu schaffen.

6.1 Minimaler Aufruf-Code

# pip install openai

from openai import OpenAI

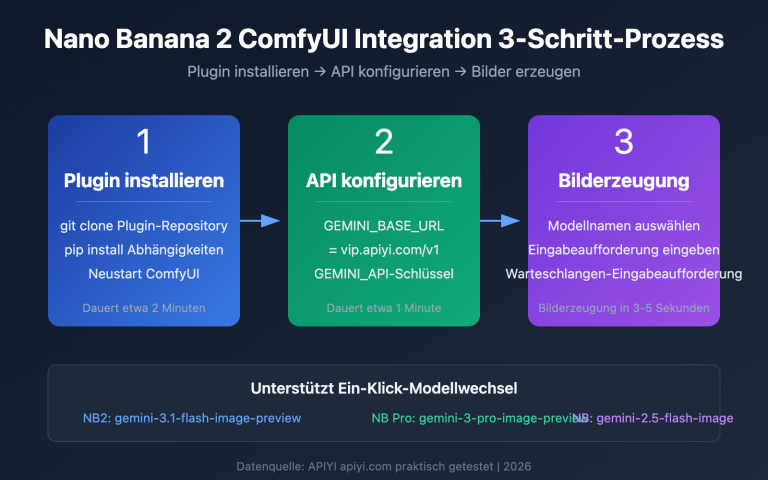

# Nutzung über konformen API-Proxy (Beispiel: APIYI apiyi.com), Standard-OpenAI-SDK

client = OpenAI(

api_key="sk-your-key",

base_url="https://api.apiyi.com/v1" # Ersetzen durch den konformen Proxy-Endpunkt

)

response = client.images.generate(

model="gpt-image-2",

prompt="A modern minimalist office workspace, natural lighting",

size="1024x1024",

quality="high",

moderation="auto" # Standardwert, behält den Indemnification-Schutz bei

)

print(response.data[0].url)

📦 Vollständige Version mit zweistufiger Prüfung (zum Ausklappen)

import os

import logging

from openai import OpenAI

from openai import BadRequestError

# Ersetzen durch Ihren konformen Proxy-Endpunkt, z.B. APIYI apiyi.com

client = OpenAI(

api_key=os.environ["OPENAI_API_KEY"],

base_url="https://api.apiyi.com/v1"

)

def pre_check_prompt(prompt: str) -> bool:

"""

Vorgelagerte Prüfung: Aufruf einer Inhalts-Sicherheits-API

Platzhalter-Beispiel, in der Praxis z.B. Alibaba/Tencent Cloud Content Security

"""

forbidden_keywords = [

# Rechtsgebiet-spezifische Begriffe

"Staatsoberhaupt", "politisch sensible Begriffe",

# Kommerzielle Risikobegriffe

"Markenname + Fälschung", "Logo der Konkurrenz"

]

return not any(kw in prompt for kw in forbidden_keywords)

def post_check_image(image_url: str) -> bool:

"""

Nachgelagerte Prüfung: Aufruf einer Bild-Prüf-API

Platzhalter-Beispiel, in der Praxis Integration eines Bild-Sicherheitsdienstes

"""

# In der Realität: Aufruf der Bildprüfung von Alibaba/Tencent Cloud

return True

def generate_compliant_image(prompt: str):

# Schritt 1: Vorgelagerte Prüfung

if not pre_check_prompt(prompt):

logging.warning("Prompt hat die vorgelagerte Prüfung nicht bestanden")

return None

# Schritt 2: Aufruf von gpt-image-2

try:

response = client.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="high",

moderation="auto" # Standardwert muss beibehalten werden für Indemnification

)

image_url = response.data[0].url

except BadRequestError as e:

# OpenAI safety_violations werden hier unverändert durchgereicht

logging.error(f"OpenAI hat die Generierung abgelehnt: {e}")

return None

# Schritt 3: Nachgelagerte Prüfung

if not post_check_image(image_url):

logging.warning("Bild hat die nachgelagerte Prüfung nicht bestanden")

return None

return image_url

if __name__ == "__main__":

url = generate_compliant_image(

"A modern minimalist office workspace, natural lighting"

)

print(f"Konforme Bild-URL: {url}")

6.2 Drei-Ebenen-Protokollierung: Vorbereitung für Audits

Ein oft übersehenes Detail bei der Compliance ist die Protokollierung. Wir empfehlen die Speicherung auf drei Ebenen:

[L1] Protokollierung der Anfrage

- request_id, Zeitstempel, user_id

- Prompt (anonymisiert oder gehasht)

- moderation-Parameterwert

[L2] Protokollierung der Antwort

- Von OpenAI zurückgegebener status_code

- Bei safety_violations: Dokumentation des Fehlertyps

- URL und Hash des generierten Bildes

[L3] Protokollierung der Prüfung

- Ergebnis der vorgelagerten Prüfung (bestanden/abgelehnt)

- Ergebnis der nachgelagerten Prüfung (bestanden/abgelehnt)

- Ablehnungsgrund und gefundene Schlüsselwörter

🎯 Empfehlung zur Protokollspeicherung: Rechts-Audits erfordern in der Regel eine Aufbewahrung der vollständigen Protokolle von mindestens 6-12 Monaten. APIYI (apiyi.com) bietet für Unternehmenskunden eine Abfragefunktion für Protokolle auf Anfrageebene, die eine Suche nach user_id, Zeiträumen oder Fehlertypen ermöglicht und so die Compliance-Audits Ihres Unternehmens unterstützt.

VII. Risikomatrix für gpt-image-2: Compliance-Prioritäten nach Geschäftsbereichen

Nicht jedes Anwendungsszenario für gpt-image-2 erfordert eine "maximale Compliance". Eine Risikomatrix hilft dem Rechtsteam dabei, dem Business-Team Prioritäten bei der Zuweisung von Compliance-Ressourcen zu geben.

7.1 Risikomatrix (nach den Dimensionen "Datensensibilität × kommerzielle Nutzung")

| Geschäftsszenario | Datensensibilität | Kommerzielle Nutzung | Gesamtrisiko | Empfohlene Compliance-Stufe |

|---|---|---|---|---|

| Interne PPT-Grafiken | Niedrig | Niedrig (intern) | 🟢 Niedrig | Basis: SCC-Registrierung |

| Marketingmaterial (ohne Gesichter) | Niedrig | Mittel (extern) | 🟡 Mittel | Standard: SCC + allgemeine Inhaltsprüfung |

| E-Commerce-Produktbilder | Mittel | Hoch (direkter Verkauf) | 🟡 Mittel | Standard: SCC + Prüfung auf Markenrechte/IP |

| Generierung von Avataren (mit Gesichtern) | Hoch | Mittel (Nutzeranwendung) | 🟠 Hoch | Fortgeschritten: PIPL-Zertifizierung + explizite Zustimmung |

| Generierung von Promi-Bildern | Hoch | Beliebig | 🔴 Extrem hoch | Nicht empfohlen: Zu hohes rechtliches Risiko |

| Regierungs-/Gemeinnützige Projekte | Hoch | Niedrig | 🟠 Hoch | Fortgeschritten: Sicherheitsbewertung + heimische Alternativen |

| SaaS-Wiederverkauf | Mittel | Hoch | 🟠 Hoch | Fortgeschritten: Vollständige Compliance-Kette + Nutzungsvereinbarung |

7.2 Compliance-Pfade für drei typische Unternehmenstypen

Typ A: Kleine und mittlere Internetunternehmen (Mitarbeiter < 100)

Compliance-Strategie: Pragmatisch

- Kanal: Wahl eines seriösen inländischen API-Proxy-Dienstes

- Dokumentation: Standardvertrag (SCC) ausreichend

- Inhaltsprüfung: Content-Security-API von Alibaba Cloud/Tencent Cloud

- Protokolle: 6 Monate Aufbewahrungsfrist

- Budget: 50.000 - 100.000 RMB / Jahr

Typ B: Großunternehmen / börsennotierte Unternehmen

Compliance-Strategie: Rigoros

- Kanal: Bevorzugung von zertifizierten (Xinchuang/MLPS) API-Proxy-Diensten

- Dokumentation: Standardvertrag + PIPL-Zertifizierung + internes Compliance-Handbuch

- Inhaltsprüfung: Zweistufige Prüfung + manuelle Stichproben

- Protokolle: 12 Monate Aufbewahrungsfrist, revisionssicher

- Budget: 300.000 - 500.000 RMB / Jahr

Typ C: Staatsunternehmen / Regierungsprojekte

Compliance-Strategie: Risikovermeidung

- Kanal: Ausschließlich Xinchuang-zertifizierte Anbieter, bevorzugt heimische Modelle

- Dokumentation: Sicherheitsbewertung durch die Cyberspace Administration of China (CAC)

- Inhaltsprüfung: Dreistufige Prüfung (vorher/während/nachher)

- Protokolle: Über 36 Monate, vollständiger Audit-Trail

- Budget: 1 Mio. RMB+ / Jahr

7.3 Notfallplan für Risikoereignisse

Egal wie gut die Compliance ist, ein Notfallplan ist unerlässlich. Risiken im Zusammenhang mit gpt-image-2 lassen sich in drei Kategorien einteilen:

| Ereignistyp | Auslöser | Sofortige Reaktion | Aktion innerhalb von 7 Tagen |

|---|---|---|---|

| Nutzerbeschwerde wegen Urheberrechtsverletzung | Kundenservice erhält Vorwurf von Dritten | Bild sofort offline nehmen | OpenAI-Indemnification-Prozess starten |

| Datenleck / Inhaltsverstoß | Schreiben der Aufsichtsbehörde | Dienst sofort pausieren, alle Inhalte offline nehmen | Mit Behörden kooperieren, vollständige Logs vorlegen |

| Compliance-Probleme beim API-Proxy-Dienst | Anbieter wird gemeldet / stellt Betrieb ein | Auf Backup-Endpoint umschalten | Bestandsdatenrisiko bewerten, Nutzer informieren |

| Prompt-Injection-Angriff | Nutzer umgeht Prompt-Template für schädliche Inhalte | User-Input-Funktion temporär deaktivieren | Vorab-Prüfmechanismus aktualisieren |

🎯 Aufbau von Notfallkapazitäten: Eine vollständige Reaktion erfordert, dass der API-Proxy-Dienst eine "schnelle Suche in Anforderungs-Logs" ermöglicht. APIYI (apiyi.com) bietet unternehmensweite Log-Schnittstellen, die eine Echtzeitsuche nach

request_id,user_id, Zeiträumen und Fehlertypen unterstützen, was die Reaktionszeit bei behördlichen Prüfungen oder Nutzerbeschwerden erheblich verkürzt.

7.4 Balance zwischen Compliance-Kosten und Geschäftswert

Betrachtung des ROI aus Sicht der Geschäftsführung:

| Investitionsbereich | Einmalige Kosten | Laufende Kosten | Geschäftswert |

|---|---|---|---|

| Wahl des richtigen API-Proxy-Dienstes | 0 | Nahe 0 | ⭐⭐⭐⭐⭐ |

| Implementierung zweistufiger Inhaltsprüfung | 50-150 Tsd. | 10-20 Tsd./Monat | ⭐⭐⭐⭐⭐ |

| SCC-Standardvertragsregistrierung | 20-50 Tsd. | 0 | ⭐⭐⭐⭐ |

| PIPL-Zertifizierung | 100-300 Tsd. | 0 | ⭐⭐⭐ |

| Sicherheitsbewertung | 500-1000 Tsd. | 0 | ⭐⭐⭐ |

| Vollständiges Audit-Log-System | 50-100 Tsd. | 10 Tsd./Monat | ⭐⭐⭐⭐⭐ |

Fazit: Die Wahl des richtigen API-Proxy-Dienstes ist die Compliance-Entscheidung mit dem höchsten ROI – die Kosten sind nahezu null, decken aber über 60 % der Compliance-Risiken ab.

VIII. Häufige Fragen (FAQ) zur Compliance von gpt-image-2

F1: Gilt die Nutzung von gpt-image-2 für unser Unternehmen in China als "illegaler Zugriff auf ausländische Dienste"?

Nein. Das chinesische Cybersicherheitsgesetz und das Datensicherheitsgesetz verbieten Unternehmen nicht die Nutzung ausländischer APIs für geschäftliche Zwecke. Die eigentlichen Compliance-Punkte sind: (a) Ist der Datentransfer ins Ausland konform (enthält der Prompt personenbezogene Daten)? (b) Hat der Dienstleister eine rechtliche Präsenz in China? Durch die Nutzung eines inländischen API-Proxy-Dienstes wird der Datenpfad bereits beim inländischen Anbieter verarbeitet, was die Compliance-Reibung bei einer Direktverbindung erheblich reduziert.

F2: Wenn etwas schiefgeht, wer haftet?

Die Haftung sollte über die Vertragskette definiert werden:

- OpenAI: Haftung für Urheberrechtsverletzungen Dritter (unter der Voraussetzung der konformen Nutzung, via Indemnification).

- API-Proxy-Dienst: Haftung für Kanal-Compliance, Echtheit der API-Schlüssel und Genauigkeit der Abrechnung.

- Unternehmen selbst: Haftung für die Rechtmäßigkeit der Eingaben, den beabsichtigten Verwendungszweck und die Nutzervereinbarungen.

- Endnutzer: Haftung für die sekundäre Nutzung (falls Sie ein SaaS-Anbieter sind).

Diese vier Verantwortungsebenen sollten in den Verträgen klar getrennt vereinbart werden, anstatt nur einen "Standard-Servicevertrag" zu unterzeichnen.

F3: Was hat sich rechtlich von gpt-image-1 zu gpt-image-2 geändert?

Auf Ebene der API-Bedingungen gibt es keine Änderungen – beide unterliegen denselben OpenAI Service Terms und Usage Policies. Technisch gesehen führt gpt-image-2 agentisches Denken ein, was bedeutet, dass die Inhaltsfilterung intelligenter, aber auch strenger ist. Einige Grenzfälle, die bei gpt-image-1 durchkamen, könnten bei gpt-image-2 abgelehnt werden. Es wird empfohlen, bei Versions-Upgrades einen Rücktest der historischen Prompts durchzuführen.

F4: Können wir mit gpt-image-2 generierte Bilder urheberrechtlich schützen lassen?

Theoretisch ja, aber die Erfolgsquote hängt von der Rechtsordnung ab:

- US Copyright Office: Akzeptiert explizit keine Urheberrechtsregistrierung für rein KI-generierte Inhalte.

- China: Einige Gerichtsurteile erkennen an, dass "Prompt-Ingenieure einen kreativen Beitrag leisten", aber dies muss von Fall zu Fall entschieden werden.

- EU: Eher konservativ, tendiert dazu, KI-Inhalte nicht zu schützen.

Praktischer Rat: Bei Kern-IP-Assets (z. B. Markenlogos, IP-Charaktere) sollte nach dem ersten Entwurf durch gpt-image-2 eine substanzielle Überarbeitung durch einen Designer erfolgen, um die Erfolgschancen bei der Registrierung zu erhöhen.

F5: Wenn der API-Proxy-Dienst den Betrieb einstellt, können wir die generierten Bilder noch nutzen?

Ja. OpenAI hat das Eigentum an den Bildern dem "Nutzer, der die API aufruft" (d. h. dem nachgelagerten Unternehmen) zugewiesen. Dies ist ein vertragliches Recht, das unabhängig vom Fortbestand des API-Proxy-Dienstes ist. Voraussetzung ist, dass Sie die vollständigen Anforderungs-/Antwort-Logs als Nachweis aufbewahrt haben.

F6: Müssen Unternehmen die Nutzung von gpt-image-2 in den AGB / Datenschutzrichtlinien erwähnen?

Dringend empfohlen. Legen Sie drei Dinge offen:

- Ihr Produkt/Dienst nutzt das OpenAI gpt-image-2 Modell zur Bilderzeugung.

- Die vom Nutzer eingegebenen Prompts werden an OpenAI/den API-Proxy-Dienst übertragen.

- Der Nutzungsumfang der generierten Bilder (kommerziell/nicht-kommerziell, exklusiv/nicht-exklusiv).

Eine klare Offenlegung in der Datenschutzrichtlinie ist nicht nur eine Anforderung des chinesischen PIPL, sondern hilft dem Unternehmen auch, bei Streitigkeiten auf eine "informierte Zustimmung des Nutzers" zu verweisen.

F7: Können Regierungsbehörden/öffentliche Einrichtungen gpt-image-2 nutzen?

Ja, aber mit zwei zusätzlichen Schritten:

- Wahl eines API-Proxy-Dienstes mit "Xinchuang/MLPS"-Zertifizierung, um die Konformität des Tech-Stacks sicherzustellen.

- Strenge Anonymisierung der Prompt-Inhalte; niemals vertrauliche oder politische Informationen übertragen.

F8: Müssen mit gpt-image-2 generierte Bilder als "KI-generiert" gekennzeichnet werden?

Dringend empfohlen. Artikel 12 der "Interim-Bestimmungen zur Verwaltung von generativen KI-Diensten" der chinesischen Cyberspace Administration besagt:

"Anbieter müssen generierte Inhalte wie Bilder und Videos gemäß den 'Bestimmungen zur Verwaltung der Deep-Synthesis-Technologie für Internet-Informationsdienste' kennzeichnen."

Es gibt zwei Möglichkeiten der Umsetzung:

- Explizite Kennzeichnung: Einbettung des Hinweises "KI-generiert" in der Ecke des Bildes oder in den Metadaten.

- Implizites Wasserzeichen: Hinzufügen eines unsichtbaren digitalen Wasserzeichens (Provenance Watermark) in die Bildebene.

Bilder von gpt-image-2 enthalten standardmäßig C2PA-Metadaten (Content Provenance and Authenticity), den internationalen Standard für die Herkunftszertifizierung von KI-Inhalten. Unternehmen müssen jedoch gemäß den lokalen Vorschriften zusätzlich eine explizite Kennzeichnung vornehmen.

F9: Wie sieht es mit dem Urheberrecht aus, wenn Nutzer Bilder für i2i (Bild-zu-Bild) hochladen?

Dies ist ein häufiges Szenario bei gpt-image-2, das besondere Aufmerksamkeit erfordert:

| Szenario | Urheberrecht Eingabebild | Urheberrecht Ausgabebild |

|---|---|---|

| Nutzer lädt eigenes Foto hoch | Nutzer | Nutzer (sekundäre Schöpfung) |

| Nutzer lädt fremdes Werk hoch | Dritter | Hohes rechtliches Risiko |

| Nutzer lädt Foto mit Promi-Gesicht hoch | Persönlichkeitsrecht | Extrem hohes rechtliches Risiko |

Best Practice: Verlangen Sie in den AGB, dass Nutzer selbst sicherstellen, dass die Urheber- und Persönlichkeitsrechte der hochgeladenen Bilder gewahrt sind, und führen Sie Protokolle über das Nutzerverhalten.

F10: Was passiert, wenn OpenAI den Zugriff aus China plötzlich einschränkt?

In der Vergangenheit hat OpenAI die Zugriffsstrategien für Festlandchina mehrfach angepasst. Konforme inländische API-Proxy-Dienste verfügen in der Regel über Übersee-Knotenpunkte und Multi-Endpoint-Konfigurationen, die bei Strategieänderungen ein nahtloses Umschalten ermöglichen. Dies ist einer der Hauptgründe, warum Unternehmen API-Proxy-Lösungen einer direkten Eigenentwicklung vorziehen sollten. Es wird empfohlen, bei Vertragsabschluss mit dem API-Proxy-Dienst eine "Endpoint-Hochverfügbarkeits-SLA" in die Klauseln aufzunehmen.

IX. Fazit: Die drei Kernkriterien für die rechtliche Compliance von gpt-image-2

Kommen wir auf die Eingangsfrage zurück. Wenn Sie die Bedenken Ihrer Unternehmensrechtsabteilung auf die prägnanteste Weise ausräumen möchten, genügen diese drei Punkte:

9.1 Drei Kernkriterien

✅ Kriterium 1: Die kommerzielle Nutzung von gpt-image-2 birgt keine zusätzlichen rechtlichen Risiken

Voraussetzung: Nutzung über offizielle Kanäle + keine Umgehung von Sicherheitsmechanismen + keine Verwendung zum Training von Konkurrenzmodellen

✅ Kriterium 2: Das Eigentum an den generierten Bildern liegt beim Unternehmenskunden, der den Modellaufruf tätigt

Hinweis: Eigentum ist nicht gleichbedeutend mit vollständigem Urheberrecht; für zentrale IP-Assets wird eine menschliche Nachbearbeitung empfohlen

✅ Kriterium 3: Unternehmen haben eine Pflicht zur "vorgelagerten Inhaltsprüfung"

Grund: OpenAI führt nur allgemeine Filterungen durch; für rechtsspezifische Risiken ist das Unternehmen selbst verantwortlich

9.2 Drei Handlungsempfehlungen für die Rechtsabteilung

- Erstellung einer Due-Diligence-Checkliste für API-Proxy-Dienste: Diese sollte mindestens die Kanaltypen, die Unternehmensqualifikationen und die Datenaufbewahrung abdecken.

- Etablierung eines zweistufigen Inhalts-Sicherheitsmechanismus: Sicherheitsfilter von OpenAI + lokale Inhalts-Sicherheits-API, um sicherzustellen, dass rechtsspezifische Risiken abgedeckt sind.

- Aufbau eines vollständigen Protokollierungssystems für Modellaufrufe: Bewahren Sie Anforderungs-, Antwort- und Prüfprotokolle für mindestens 12 Monate zu Revisionszwecken auf.

9.3 Empfehlungen für Best Practices

🎯 Gesamtempfehlung:

gpt-image-2kann in Unternehmensszenarien bedenkenlos eingesetzt werden, sofern die richtige Anbindung gewählt und ein begleitender Compliance-Mechanismus implementiert wird. Wir empfehlen Unternehmen den Zugang über API-Proxy-Plattformen wie APIYI (apiyi.com), die eine lückenlose Compliance-Kette bieten. Diese Plattformen unterstützen die Rechnungsstellung für Unternehmen, stellen vollständige Aufrufprotokolle bereit und leiten Sicherheitsfehlercodes unverändert weiter, was den Prüfstandards der meisten Rechtsabteilungen entspricht.

Compliance dient nicht dazu, das Geschäft zu blockieren, sondern Risiken transparent zu machen. Wenn Sie der Rechtsabteilung ein vollständiges Konzept mit "Nachweis der Kanal-Compliance + zweistufiger Sicherheit + 12-monatigen Audit-Logs" vorlegen können, verläuft die Genehmigung für gpt-image-2 in der Regel sehr reibungslos.

gpt-image-2 ist eines der leistungsfähigsten Modelle zur Bilderzeugung von OpenAI und überzeugt bei 2K-Auflösung, Textdarstellung und komplexen Kompositionen. Wenn Sie Ihre Hausaufgaben in Sachen Compliance machen, werden die anschließenden Produktiterationen und die Kommerzialisierung deutlich einfacher.

Ein letzter Satz an die Rechtsabteilungen: "Das Ziel der Compliance-Prüfung ist nicht das Nein, sondern die Klärung, wie eine sichere Nutzung möglich ist." Dieser Artikel soll als Ausgangspunkt für Ihre Entscheidung dienen, ob Sie gpt-image-2 einsetzen oder nicht.

Sollten während der Compliance-Prüfung spezifische Fragen auftreten – etwa zu Checklisten für die Anbieterprüfung, SCC-Vertragsvorlagen oder der Auswahl von Inhalts-Sicherheits-APIs –, sind dies Themen, die wir in weiteren Artikeln mit praktischen Leitfäden behandeln werden.

Autor: APIYI Team — Plattform für die Anbindung von KI-Großsprachmodellen auf Unternehmensebene (apiyi.com). Unterstützt die einheitliche Schnittstellenanbindung von über 200 Modellen wie gpt-image-2, Claude 4.7 und Gemini 3 Pro. Wir unterstützen börsennotierte Unternehmen, staatliche Betriebe und internationale Konzerne bei der rechtskonformen Anbindung.

Referenzbedingungen: OpenAI Terms of Use, OpenAI Service Terms, OpenAI Usage Policies, OpenAI Indemnification Policy. Dieser Artikel stellt keine Rechtsberatung dar; für spezifische Compliance-Entscheidungen konsultieren Sie bitte Ihre interne Rechtsabteilung oder einen spezialisierten Anwalt.