Wenn Sie die gpt-image-2 API für produktionsreife Bilderzeugung nutzen, stoßen Sie als Entwickler häufig auf diesen verwirrenden 400-Fehler:

{

"status_code": 400,

"error": {

"message": "Your request was rejected by the safety system. If you believe this is an error, contact us at Azure support ticket and include the request ID 76fd2cbc-63ee-4e30-8bea-5fc2a2e1faa3.",

"type": "shell_api_error",

"code": "moderation_blocked"

}

}

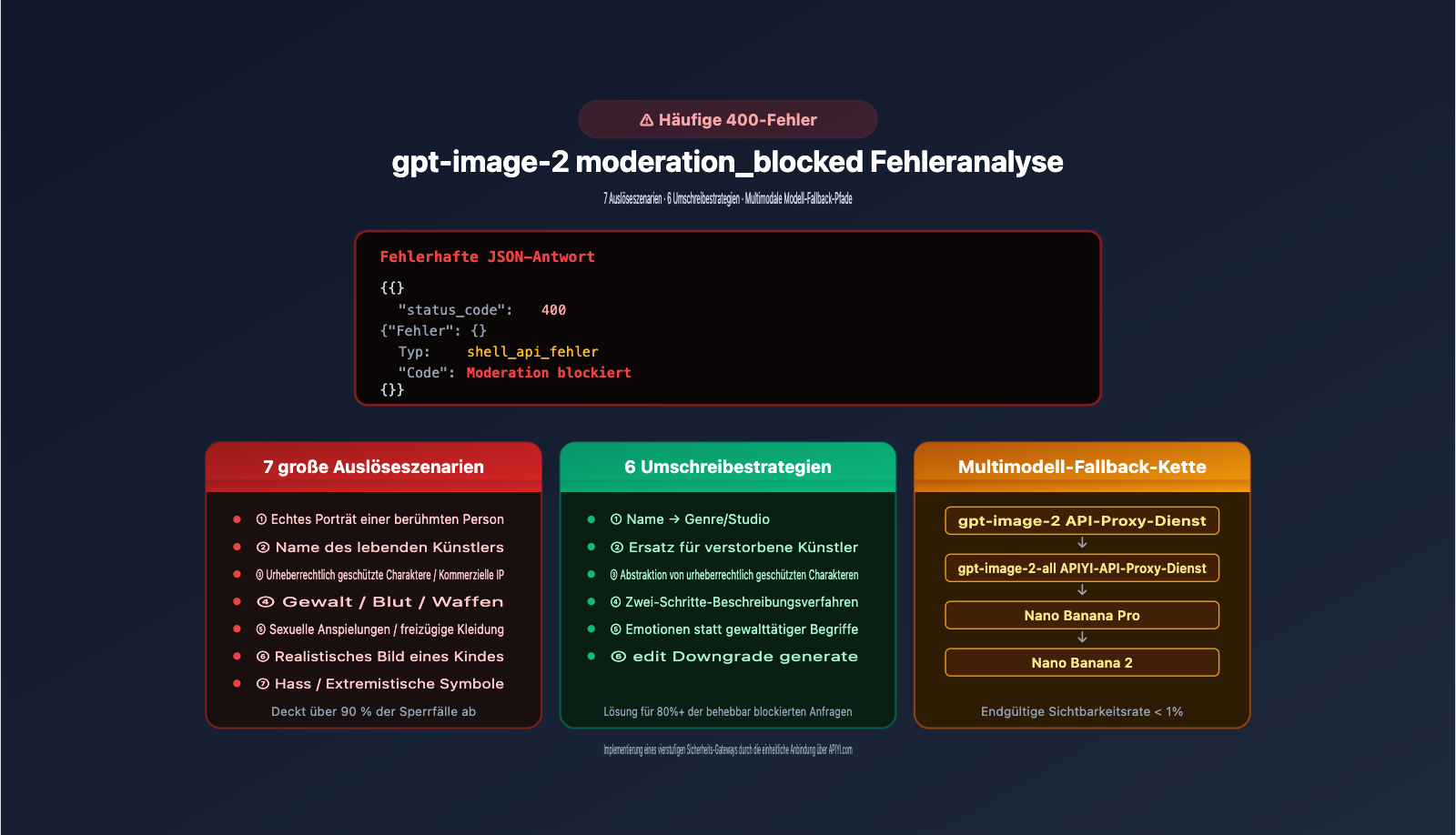

Dieser moderation_blocked-Fehler stammt vom Sicherheitssystem von OpenAI/Azure. Er blockiert aktiv Anfragen, die als richtlinienwidrig eingestuft werden, noch bevor oder direkt nachdem die Modellinferenz stattfindet. Im Gegensatz zu einer gewöhnlichen 429-Drosselung oder einem 500-Serverfehler verschwindet moderation_blocked nicht von selbst – ohne Anpassung der Eingabeaufforderung führt auch der zehntausendste Versuch zum gleichen Ergebnis.

Dieser Artikel analysiert systematisch das technische Prinzip des moderation_blocked-Fehlers, die 7 häufigsten Auslöseszenarien sowie Diagnose- und Reproduktionsmethoden. Zudem stellen wir 6 Strategien zur Umformulierung von Eingabeaufforderungen sowie Backup-Lösungen mit anderen Modellen vor, damit Sie die Fehlerquote auf ein akzeptables Maß senken können.

I. Technische Grundlagen des Fehlers "moderation_blocked" (400) bei gpt-image-2

1.1 Aufschlüsselung der Fehlerstruktur

Der Fehler-Body enthält einige entscheidende Felder:

| Feld | Bedeutung |

|---|---|

status_code: 400 |

HTTP 400 Bad Request, weist auf eine abgelehnte Client-Anfrage hin |

type: shell_api_error |

Fehler auf Ebene des API-Gateways, kein Fehler bei der Modellinferenz |

code: moderation_blocked |

Kern-Fehlercode: Blockierung durch das Inhaltssicherheitssystem |

message |

Menschlich lesbare Erklärung, enthält die Request-ID |

request id |

Tracking-ID für Support-Anfragen oder Fehlerbehebung |

Beachten Sie, dass die Nachricht auf ein "Azure support ticket" hinweist – dies ist ein wichtiger Hinweis: Bestimmte gpt-image-2-Bereitstellungsketten werden letztlich von Azure OpenAI gehostet, weshalb das Sicherheitssystem der Inhaltsfilter von Azure ist. Die Filterregeln von Azure sind strenger als bei einer direkten Anbindung an OpenAI. Dies ist der grundlegende Grund dafür, warum die Rate der moderation_blocked-Ereignisse je nach Kanal stark variieren kann.

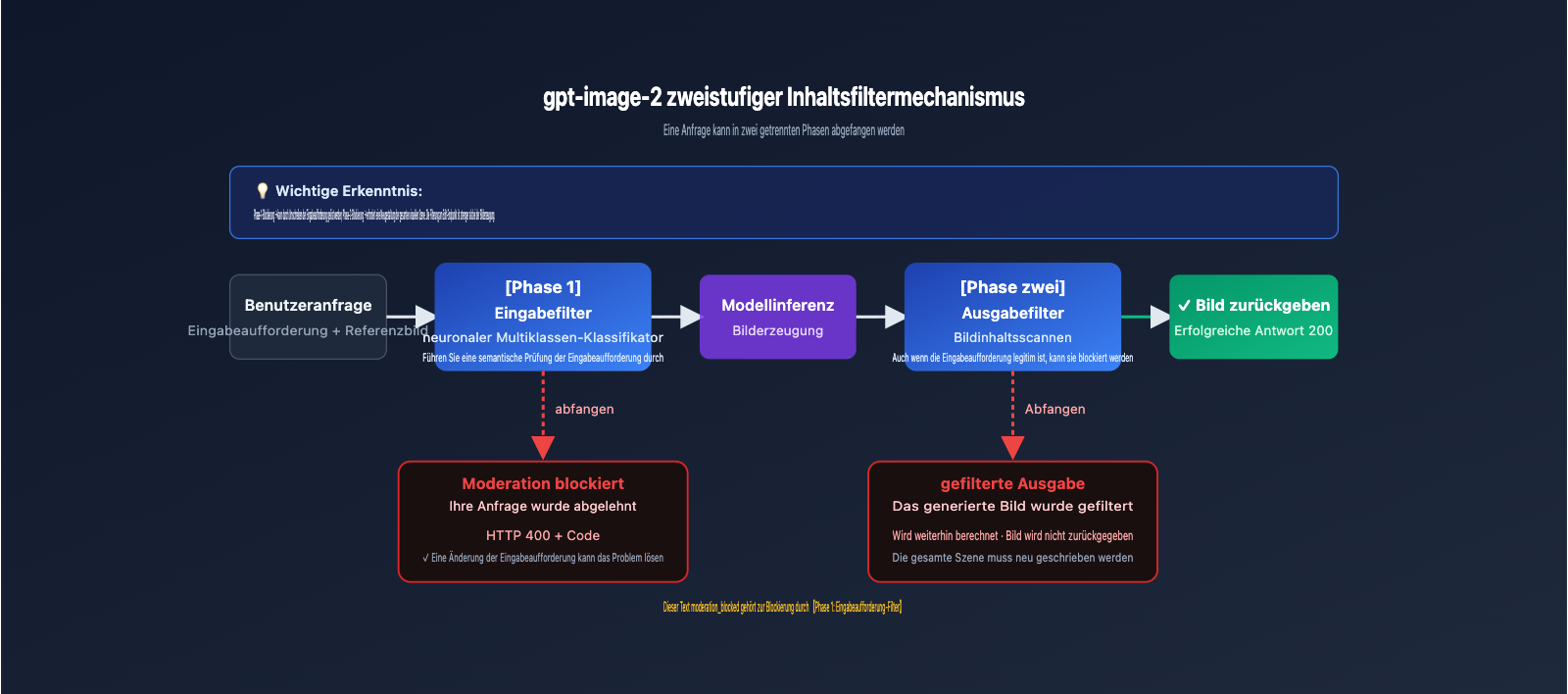

1.2 Der zweistufige Inhaltsfilter-Mechanismus von gpt-image-2

Gemäß der offiziellen System Card für ChatGPT Images 2.0 von OpenAI und der Azure OpenAI-Dokumentation verwendet gpt-image-2 einen zweistufigen Filterprozess:

Benutzeranfrage

↓

【Stufe 1: Eingabefilter (Input Filter)】

↓ (bestanden)

Modellinferenz zur Bilderzeugung

↓

【Stufe 2: Ausgabefilter (Output Filter)】

↓ (bestanden)

Rückgabe des Bildes an den Benutzer

Stufe 1 (Eingabefilter): Vor der Modellinferenz erfolgt eine Klassifizierungsprüfung des Prompts und des Referenzbildes. Hierbei wird ein neuronaler Multiklassen-Klassifikator verwendet, um Inhalte zu erkennen, die gegen die Richtlinien von OpenAI verstoßen (Hassrede, Gewalt, sexuelle Inhalte, Selbstverletzung, Personen des öffentlichen Lebens, Urheberrechte usw.).

Stufe 2 (Ausgabefilter): Nach der Bilderzeugung erfolgt ein erneuter Scan. Selbst wenn der Prompt zulässig war, wird das Bild blockiert, wenn das generierte Ergebnis "verdächtig" erscheint.

Wichtige Unterschiede:

- Wenn die Fehlermeldung lautet

"Your request was rejected"→ Blockierung in der Eingabephase, kann durch Anpassung des Prompts gelöst werden. - Wenn die Fehlermeldung lautet

"Generated image was filtered"→ Blockierung in der Ausgabephase, das gesamte Szenario muss umgeschrieben werden.

Der hier besprochene moderation_blocked-Fehler gehört zur ersten Kategorie – Blockierung in der Eingabephase, was bedeutet, dass eine Optimierung auf Prompt-Ebene nach wie vor der effektivste Lösungsansatz ist.

1.3 Strengere Filterung beim edit-Endpunkt von gpt-image-2

Ein oft übersehener Fakt: Die Filterstrategie des Endpunkts /v1/images/edits ist deutlich strenger als die von /v1/images/generations.

Azure gibt offiziell an, dass bei der Bildbearbeitung zusätzliche Sicherheitsprüfungen über die Standard-Filterung hinaus angewendet werden. Das bedeutet: Derselbe Prompt + dasselbe Bild können am Generation-Endpunkt akzeptiert werden, während sie am Edits-Endpunkt mit moderation_blocked abgelehnt werden. Dies ist ein bewusstes Design, um zu verhindern, dass Benutzer unzulässige Änderungen an bestehenden Fotos vornehmen (z. B. Deepfakes oder das Entfernen von Kleidung).

II. Die 7 häufigsten Auslöser für den Fehler moderation_blocked bei gpt-image-2

Die folgenden 7 Szenarien sind nach ihrer tatsächlichen Häufigkeit sortiert und decken über 90 % der moderation_blocked-Fälle ab.

2.1 Szenario 1: Porträts realer Personen und Namen von Prominenten

Dies ist der häufigste Grund für eine Blockierung. Jede Eingabeaufforderung in der folgenden Form führt fast immer zu einem Fehler:

❌ Hochrisiko-Muster:

- Foto von Elon Musk auf dem Mars generieren

- Ein gemeinsames Foto von Trump und Obama

- Die Bühne eines Taylor-Swift-Konzerts

- Eine Schauspielerin, die Scarlett Johansson imitiert

OpenAI schützt standardmäßig Prominenten-Porträts, die nicht explizit für Opt-out freigegeben sind. Seit dem Vorfall um Bryan Cranston im Oktober 2025 wurde diese Strategie weiter verschärft. Selbst wenn Sie nur jemanden generieren wollen, der „jemandem ähnlich sieht“, ohne den Namen direkt zu verwenden, wird die Anfrage blockiert, sobald der Name einer öffentlichen Person in der Eingabeaufforderung auftaucht.

2.2 Szenario 2: Lebende Künstler und stilisierte Ausdrucksformen

Die Namen lebender Künstler oder Schöpfer sind starke Filterbegriffe:

❌ Hochrisiko:

- Illustration im Stil von Hayao Miyazaki

- Städtische Nachtszene in den Farben von Makoto Shinkai

- Street-Art-Graffiti im Stil von Banksy

✅ Risikoarme alternative Schreibweise:

- Stil von Ghibli / heller, moderner japanischer Animationsstil

- Farbsaturierte japanische Jugend-Animationsszene

- Moderne Street-Art-Stilistik

Regel: Ersetzen Sie „Künstlernamen“ durch „Genre/Studio/Stilbezeichnungen“. Verstorbene Künstler (Van Gogh, Monet) werden in der Regel nicht blockiert.

2.3 Szenario 3: Urheberrechtlich geschützte Charaktere und kommerzielle IP

Namentlich genannte Charaktere aus IPs wie Disney, Marvel, Ghibli, Pixar, Nintendo usw. sind hart blockiert:

❌ Hochrisiko:

- Spider-Man schwingt durch die Stadt

- Partyszene mit Micky Maus

- Ein Pikachu im Wald

✅ Risikoarme alternative Schreibweise:

- Ein origineller Vigilanten-Charakter in rot-blauem Superhelden-Kostüm, der mit Spinnweben durch eine Neon-Metropole schwingt

- Eine Retro-Party, moderiert von einer cartoonartigen, anthropomorphen Maus

- Ein gelbes, elektrisches Cartoon-Wesen im Wald

Regel: Verwenden Sie „inspiriert von“ oder „ähnlicher Stil“, anstatt den Charakter direkt zu benennen.

2.4 Szenario 4: Gewalt, Blut und Waffendetails

❌ Hochrisiko:

- Nahaufnahme einer blutenden Wunde

- Blut spritzt bei einer Explosion

- Detailliertes Produktfoto einer AK-47

✅ Umgehungsschreibweise:

- Abstrakte Darstellung mit dunkelroten Farbspritzern

- Superhelden-Szene mit hellem Lichtblitz und Trümmern

- Konzeptzeichnung einer Waffe aus einem Taktikspiel (stilisiert, nicht realistisch)

Regel: Ersetzen Sie „realistische, detaillierte, klinische“ Beschreibungen durch „künstlerische, abstrakte, stilisierte“ Begriffe.

2.5 Szenario 5: Sexuelle Andeutungen und freizügige Kleidung

Dies ist einer der strengsten Bereiche für gpt-image-2. Alles, was als sexuelle Andeutung interpretiert werden könnte, wird blockiert, einschließlich scheinbar harmloser Beschreibungen:

❌ Hochrisiko (scheinbar harmlos, wird aber blockiert):

- Bikini-Strandszene

- Frau mit entblößten Schultern

- Eng anliegende Kleidung, die den Körper betont

- Verführerische Pose

✅ Umgehungsschreibweise:

- Sommerliche Strandurlaub-Szene, Totale

- Frau in einem eleganten Abendkleid

- Sportbekleidungs-Shooting im Modemagazin-Stil

- Selbstbewusste Pose eines Models

Regel: Vermeiden Sie Adjektive wie „eng, freizügig, sexy, verführerisch“ und verwenden Sie stattdessen neutrale Begriffe wie „elegant, modisch, selbstbewusst“.

2.6 Szenario 6: Realistische Bilder mit Kindern

OpenAI verfolgt eine Null-Toleranz-Politik bei der realistischen Generierung von Kindern. Alles Folgende wird blockiert:

❌ Hochrisiko:

- Realistisches Foto eines 8-jährigen Mädchens

- Kind in Badekleidung am Pool

- Detaillierte Nahaufnahme eines Babys

✅ Sichere Schreibweise:

- Illustration einer Kindheitsszene im Cartoon-Stil

- Realistische Familienszene in der Totalen, ohne Fokus auf eine Einzelperson

- Künstlerische Illustration einer Mutter, die ein Baby hält

Regel: Verwenden Sie für Kinder nach Möglichkeit Illustrationen/Cartoon-Stile und vermeiden Sie Begriffe wie „realistisch, Nahaufnahme, detailliert, fotorealistisch“.

2.7 Szenario 7: Hass, extreme Politik und sensible Symbole

Hasssymbole, extremistische politische Totems und religiöse Konfliktdarstellungen sind hart blockiert:

❌ Hochrisiko:

- Hakenkreuz

- Szenen extremer politischer Konfrontation

- Konfliktnarrative bestimmter Länder

Für solche Inhalte gibt es kaum Spielraum bei der Umformulierung der Eingabeaufforderung; es wird empfohlen, dieses Themenfeld komplett zu meiden.

III. Diagnoseprozess für moderation_blocked-Fehler bei gpt-image-2

3.1 Diagnosediagramm

Wenn Sie einen moderation_blocked-Fehler erhalten, gehen Sie bei der Diagnose wie folgt vor:

Schritt 1. Vollständige Fehlermeldung + Request-ID protokollieren

↓

Schritt 2. Prüfen, ob "rejected" (Eingabeblockade) oder "filtered" (Ausgabeblockade)

↓

Schritt 3. Ursache anhand der 7 Szenarien lokalisieren

↓

Schritt 4. Schrittweise Kürzung der Eingabeaufforderung mittels binärer Suche

↓

Schritt 5. Entsprechende Umformulierung wählen (siehe Kapitel 4)

↓

Schritt 6. Nach Umformulierung erneut versuchen und Erfolgsrate protokollieren

3.2 Binäre Suche zur Identifizierung von Trigger-Wörtern

Wenn Sie nicht sicher sind, welches Wort in Ihrer Eingabeaufforderung die Blockierung ausgelöst hat, können Sie die binäre Suche verwenden:

from openai import OpenAI

client = OpenAI(

api_key="IHR_APIYI_SCHLUESSEL",

base_url="https://api.apiyi.com/v1"

)

def binary_search_trigger(full_prompt: str):

"""Binäre Suche zur Identifizierung von Wörtern, die moderation_blocked auslösen"""

words = full_prompt.split()

mid = len(words) // 2

left_half = " ".join(words[:mid])

right_half = " ".join(words[mid:])

for test_prompt in [left_half, right_half]:

try:

client.images.generate(

model="gpt-image-2",

prompt=test_prompt,

size="1024x1024",

quality="low",

n=1

)

print(f"✓ Erfolg: {test_prompt[:40]}...")

except Exception as e:

if "moderation_blocked" in str(e):

print(f"✗ Trigger gefunden: {test_prompt[:40]}...")

binary_search_trigger("Ursprünglicher Inhalt der Eingabeaufforderung ...")

Führen Sie dieses Skript über APIYI (apiyi.com) aus und nutzen Sie quality="low", um die Kosten pro Test auf ein Minimum ($0,006/Bild) zu reduzieren und Trigger-Wörter schnell zu lokalisieren.

3.3 Vorabprüfung mit der OpenAI Moderations API

OpenAI bietet einen kostenlosen /v1/moderations-Endpunkt an, mit dem Sie den Text der Eingabeaufforderung vor dem eigentlichen Bildgenerierungsaufruf vorab prüfen können:

def pre_check_prompt(prompt: str):

result = client.moderations.create(

model="omni-moderation-latest",

input=prompt

)

categories = result.results[0].categories

scores = result.results[0].category_scores

flagged_categories = [

(cat, scores.model_dump()[cat])

for cat, flagged in categories.model_dump().items()

if flagged

]

if flagged_categories:

print(f"⚠️ Eingabeaufforderung markiert: {flagged_categories}")

return False

return True

Hinweis: Die Vorabprüfung kann nur die Textebene prüfen und erkennt keine „semantischen Blockaden“ wie Urheberrechte oder Prominente. Sie ist jedoch sehr genau bei offensichtlichen Verstößen wie „Gewalt, Sex oder Hass“.

IV. 6 Strategien zur Umformulierung von Eingabeaufforderungen bei „moderation_blocked“-Fehlern in gpt-image-2

4.1 Strategie 1: Namen durch Genres oder Studios ersetzen

| Ursprüngliche Schreibweise | Umformulierung |

|---|---|

| Hayao Miyazaki Stil | Ghibli / Heller, moderner japanischer Animationsstil |

| Makoto Shinkai Stil | Japanische Jugendanimation mit gesättigten Farben |

| Disney Stil | Klassischer amerikanischer Cartoon-Stil |

| Anne Hathaway | Eine 35-jährige, elegante Schauspielerin |

| Elon Musk | Ein Technologie-Gründer im Anzug |

4.2 Strategie 2: Verstorbene statt lebende Künstler verwenden

Lebende Künstler → Verstorbene Künstler desselben Stils:

| Lebender Künstler (blockiert) | Verstorbener Künstler (nicht blockiert) |

|---|---|

| Banksy-Stil Graffiti | Basquiat-Stil Graffiti / Street Art der 80er Jahre |

| Makoto Shinkai Stil | (Direkt „japanischer Animationsstil“ verwenden) |

| Hayao Miyazaki | („Ghibli“ verwenden) |

| Takashi Murakami | Pop-Art-Stil / Andy Warhol-Stil |

Klassische Meister wie Van Gogh, Monet, Picasso, Rembrandt oder Hokusai sind sichere Referenzen.

4.3 Strategie 3: Abstraktion von urheberrechtlich geschützten Charakteren

Abstrahieren Sie bekannte IPs zu „allgemeinen Merkmalen + narrativer Beschreibung“:

Ursprünglich: Spider-Man schwingt über New York

Umformuliert: Ein junger Mann in einem rot-blauen, hautengen Superheldenkostüm mit Maske, der sich an Spinnenfäden zwischen den Wolkenkratzern einer Neon-Metropole schwingt, voller Dynamik und Energie

Ursprünglich: Pikachu im Wald

Umformuliert: Ein rundliches, niedliches gelbes elektrisches Cartoon-Wesen mit roten Wangen und spitzen Ohren, das durch einen dichten grünen Wald springt

Kern-Tipp: Visuelle Merkmale beibehalten, Namen entfernen.

4.4 Strategie 4: Zwei-Schritte-Beschreibung (Two-Step Description)

Verwenden Sie bei komplexen Szenarien, die an die Grenzen stoßen, ein zweistufiges Verfahren:

Schritt 1: Lassen Sie Gemini Pro oder Claude 4 Sonnet Ihre ursprüngliche Idee in eine reine Beschreibung visueller Elemente „übersetzen“ und entfernen Sie dabei aktiv alle Prominenten, IPs oder sensiblen Begriffe.

Schritt 2: Verwenden Sie die Ausgabe aus Schritt 1 als tatsächliche Eingabeaufforderung für gpt-image-2.

def two_step_generate(raw_idea: str):

# Der Rewriter-Aufruf bereinigt den Prompt

rewriter_response = client.chat.completions.create(

model="gemini-3-pro",

messages=[

{

"role": "system",

"content": (

"Du bist ein Experte für visuelle Beschreibungen. Schreibe die Idee des Nutzers in eine reine Beschreibung visueller Elemente um:"

"Entferne alle echten Namen, Markennamen, urheberrechtlich geschützten Charaktere und sensible Begriffe;"

"Behalte bei: Farben, Komposition, Licht, Bewegung, Atmosphäre, Material, Kameraeinstellungen."

"Gib einen zusammenhängenden Text von 150-250 Wörtern aus, keine Listen."

)

},

{"role": "user", "content": raw_idea}

]

)

safe_prompt = rewriter_response.choices[0].message.content

return client.images.generate(

model="gpt-image-2",

prompt=safe_prompt,

size="1024x1024",

quality="medium"

)

Dieser Ansatz nutzt die multimodale Integration von APIYI (apiyi.com), um ein LLM als „Sicherheits-Filterebene“ vorzuschalten, was die Rate der „moderation_blocked“-Fehler bei der Bilderzeugung drastisch senkt.

4.5 Strategie 5: Emotionen/Atmosphäre statt Gewalt/sexueller Begriffe

| Ursprünglicher Begriff | Neutrale Alternative |

|---|---|

| Blutig (bloody) | Tiefrote Töne / dramatisch |

| Gewalt (violent) | Intensiv / spannungsgeladen |

| Sexy | Elegant / selbstbewusst / attraktiv |

| Nackt (naked/nude) | Klassischer Skulpturen-Stil / künstlerischer Akt |

| Verführerisch (seductive) | Faszinierende Ausstrahlung |

| Töten (killing) | Dramatische Konfrontation |

| Waffe (weapon) | Requisite / Werkzeug |

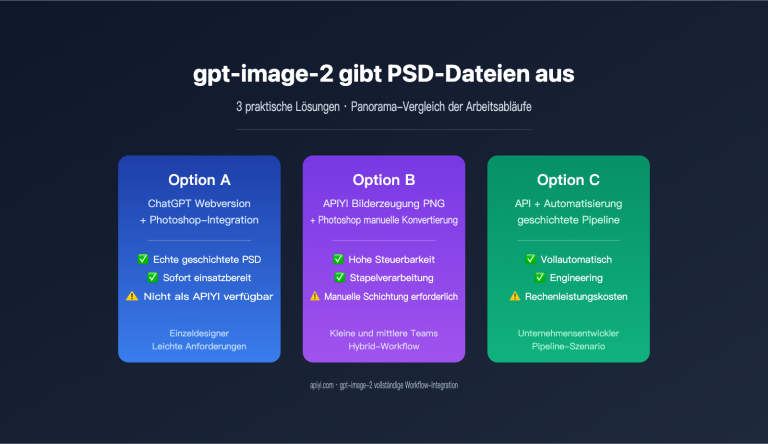

4.6 Strategie 6: Wechsel vom Edit-Endpunkt zum Generate-Endpunkt

Wie bereits erwähnt, sind die Filter für den Edits-Endpunkt strenger. Wenn Ihre Aufgabe darin besteht, ein bestehendes Bild zu bearbeiten, versuchen Sie Folgendes:

Ursprünglicher Ablauf: /v1/images/edits (wird blockiert)

Alternativer Ablauf:

- Nutzen Sie ein LLM, um die visuellen Elemente des Originalbildes zu beschreiben.

- Fügen Sie die „Änderungswünsche“ hinzu.

- Verwenden Sie

/v1/images/generationsfür eine komplette Neugenerierung.

Obwohl dies die pixelgenaue Konsistenz opfert, umgeht es die strengen Filter für Bildbearbeitungen.

V. Multi-Modell-Backup-Lösungen bei „moderation_blocked“-Fehlern in gpt-image-2

Wenn ein einzelnes Modell auf eine harte Blockade stößt, ist Multi-Modell-Routing der Standard für Unternehmensanwendungen.

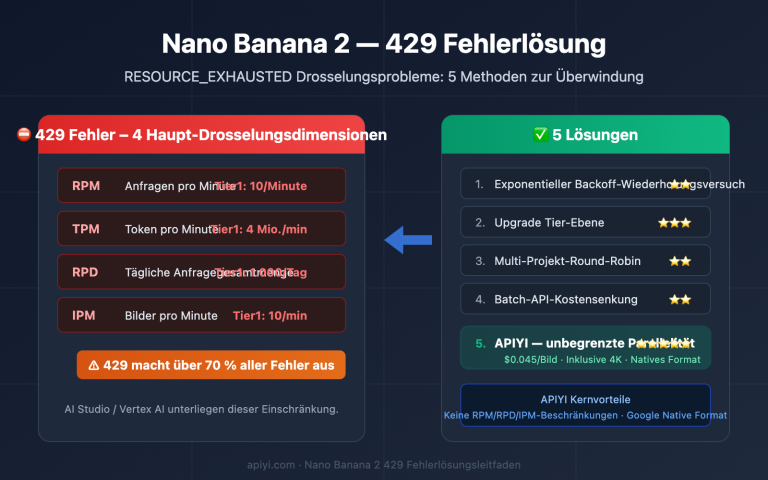

5.1 Vergleich der Filterstrenge von Bildmodellen

| Modell | Filterstrenge | Prominenten-Toleranz | IP-Toleranz | Künstlerischer Ausdruck |

|---|---|---|---|---|

gpt-image-2 (offiziell) |

🔴 Streng | Sehr streng | Streng | Konservativ |

gpt-image-2-all (offiziell) |

🟡 Mittel | Mittel | Mittel | Flexibler |

| Nano Banana Pro | 🟢 Lockerer | Mittel | Mittel | Flexibel |

| Nano Banana 2 | 🟢 Lockerer | Mittel | Mittel | Flexibel |

| Imagen-Serie | 🟡 Mittel | Streng | Mittel | Mittel |

Praktische Empfehlung: Wenn gpt-image-2 (offiziell) blockiert, können Sie nacheinander auf folgende Modelle ausweichen:

gpt-image-2 (offiziell) [moderation_blocked]

↓

gpt-image-2-all (offiziell) [möglicherweise erfolgreich]

↓

Nano Banana Pro [höhere Wahrscheinlichkeit für Erfolg]

↓

Nano Banana 2 [am flexibelsten, Qualität etwas geringer]

5.2 Code-Beispiel für automatische Fallbacks

from openai import OpenAI

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

MODEL_FALLBACK_CHAIN = [

("gpt-image-2", "images"),

("gpt-image-2-all", "chat"),

("gemini-3-pro-image-preview", "images"),

("gemini-3.1-flash-image-preview", "images"),

]

def generate_with_fallback(prompt: str):

last_error = None

for model_id, endpoint in MODEL_FALLBACK_CHAIN:

try:

if endpoint == "images":

return client.images.generate(

model=model_id,

prompt=prompt,

size="1024x1024"

)

else:

return client.chat.completions.create(

model=model_id,

messages=[{"role": "user", "content": prompt}]

)

except Exception as e:

if "moderation_blocked" in str(e) or "content_policy" in str(e):

print(f"Modell {model_id} blockiert, versuche nächstes")

last_error = e

continue

raise

raise Exception(f"Alle Modelle blockiert, letzter Fehler: {last_error}")

Der Kernwert dieses Musters: Unter demselben APIYI (apiyi.com)-Konto können Sie durch einfaches Ändern des Modell-Parameters ein Multi-Modell-Fallback realisieren, ohne mehrere Dienste registrieren oder verschiedene Anmeldedaten verwalten zu müssen.

5.3 Fortgeschrittene Strategie: Routing nach Inhaltstyp

Ein noch präziserer Ansatz ist die Vorab-Auswahl des am besten geeigneten Modells basierend auf dem Inhaltstyp:

| Inhaltstyp | Bevorzugtes Modell | Grund |

|---|---|---|

| Unternehmens-Branding | gpt-image-2 (offiziell) | Stabil, konform |

| Poster mit chinesischem Text | gpt-image-2-all (offiziell) | Native Optimierung für Chinesisch |

| Kreativbilder mit möglicher IP | Nano Banana Pro | Lockerere Filter |

| Schnelle Massenproduktion | Nano Banana 2 | Schnell, kostengünstig |

| Spezielle Kunststile | Nano Banana Pro | Flexibler künstlerischer Ausdruck |

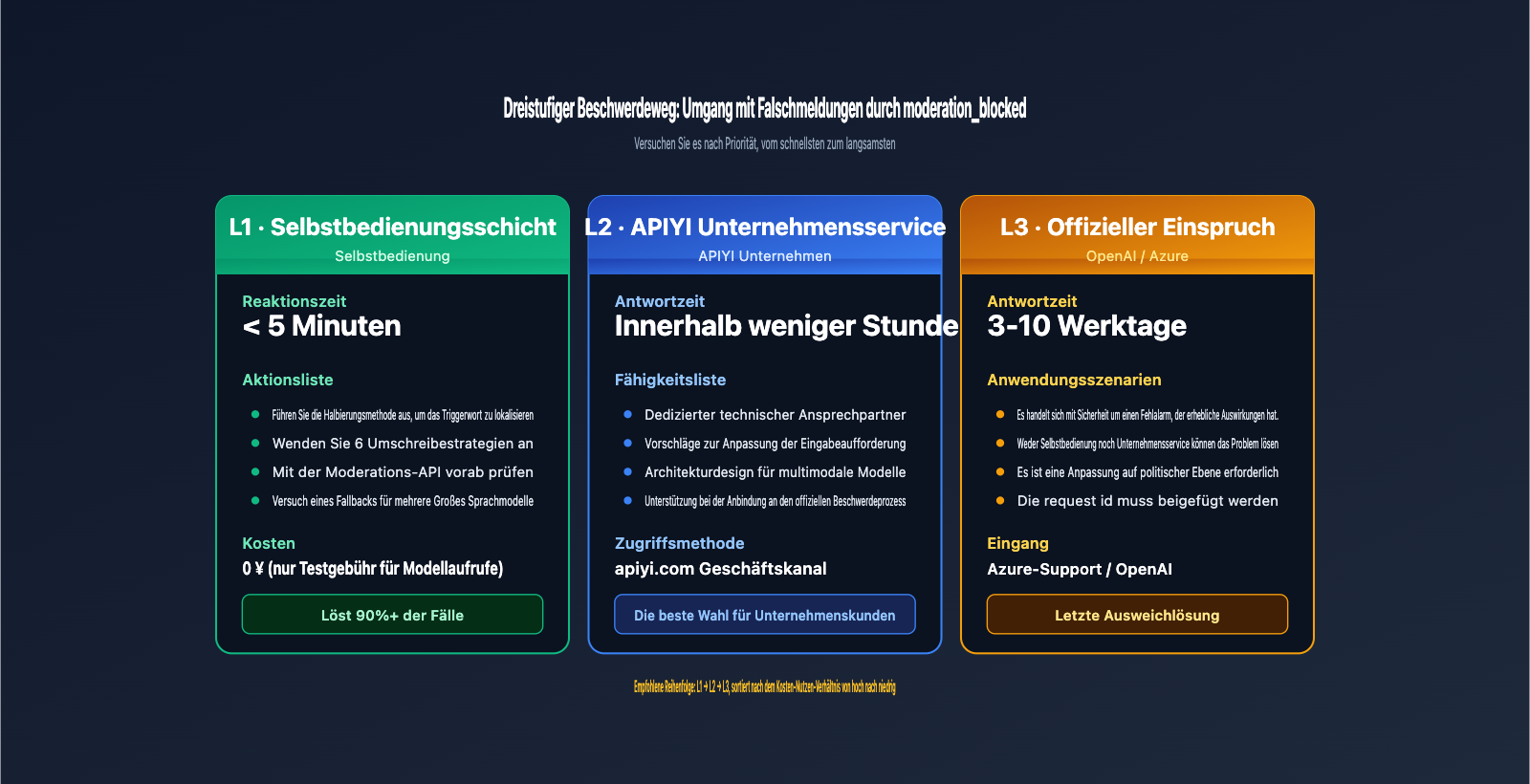

VI. gpt-image-2 moderation_blocked: Unternehmensweiter Einspruchsprozess

Wenn Sie sicher sind, dass Ihre Eingabeaufforderung (Prompt) legitim ist und nicht hätte blockiert werden dürfen (Fehlalarm), können Sie ein Einspruchsverfahren einleiten.

6.1 Checkliste für notwendige Informationen

Bevor Sie einen Einspruch einreichen, stellen Sie bitte folgende Informationen zusammen:

- Vollständige Fehlermeldung (inkl. Request-ID)

- Der vollständige Prompt, der den

moderation_blocked-Fehler ausgelöst hat - Zeitstempel des Aufrufs

- Ihre Konto-ID

- Erläuterung des Geschäftsszenarios (Warum wird dieser Prompt benötigt?)

- Reproduktionsschritte (Ist der Fehler stabil reproduzierbar?)

6.2 Einspruchskanäle

L1: Self-Service-Ebene (Am schnellsten)

Versuchen Sie zunächst die 6 Umschreibestrategien aus Kapitel 4. Über 90 % der moderation_blocked-Fälle können auf dieser Ebene ohne zusätzliche Kosten gelöst werden.

L2: APIYI Enterprise-Service-Kanal (Empfohlen)

Für Unternehmenskunden bietet APIYI (apiyi.com) dedizierte technische Unterstützung. Wir bieten für spezifische moderation_blocked-Fälle:

- Vorschläge zur Umformulierung von Prompts

- Design von Fallback-Lösungen mit mehreren Modellen

- Unterstützung beim Einspruchsprozess gegenüber OpenAI/Azure

Diese Ebene bietet eine schnelle Reaktion, und das APIYI-Team verfügt über umfangreiche Erfahrung bei der Einspruchsführung gegen Fehlalarme bei Bildmodellen, was deutlich effizienter ist als die direkte Kommunikation über offizielle Support-Tickets.

L3: Offizieller Einspruch (Am langsamsten, aber endgültig)

Reichen Sie den Einspruch über das in der Fehlermeldung genannte Azure-Support-Ticket oder das offizielle OpenAI-Hilfezentrum ein und fügen Sie die vollständige Request-ID bei. Die Bearbeitungszeit beträgt in der Regel 3–10 Werktage.

6.3 Engineering-Praktiken zur systematischen Senkung der Blockierrate

Für Produktionssysteme mit hohem Aufkommen empfehlen wir den Aufbau eines Prompt-Sicherheits-Gateways:

Ursprüngliche Benutzeranfrage

↓

[1] Keyword-Blacklist-Vorfilterung (im Sekundenbereich)

↓

[2] OpenAI Moderations-API-Vorprüfung (kostenlos, 300ms)

↓

[3] Text-LLM-Umschreibung in einen sicheren Prompt (optional, 1-2 Sekunden)

↓

[4] Aufruf von gpt-image-2

↓

[5] Automatische Umstellung auf ein Ersatzmodell bei moderation_blocked

↓

Ergebnisrückgabe

Durch diese 5-stufige Absicherung lässt sich die für den Endbenutzer sichtbare Rate von moderation_blocked auf unter 1 % senken.

🎯 Implementierungsempfehlung: Alle externen Aufrufe dieser Sicherheits-Gateway-Architektur (Moderations-API, Text-LLM, verschiedene Bildmodelle) können über den zentralen APIYI-Zugangspunkt (apiyi.com) abgewickelt werden. Dies ermöglicht eine einheitliche Abrechnung und Protokollierung, was die technische Komplexität erheblich reduziert.

VII. Häufige Fragen (FAQ) zu gpt-image-2 moderation_blocked

F1: Warum funktioniert dieselbe Eingabeaufforderung heute, wird aber morgen mit moderation_blocked abgelehnt?

Die Sicherheitsfilter von OpenAI und Azure werden kontinuierlich aktualisiert, insbesondere nach bedeutenden politischen Ereignissen oder Richtlinienänderungen (z. B. Opt-out von Prominenten). Es empfiehlt sich, in Produktionssystemen Schnappschüsse der Eingabeaufforderungen zu speichern, die zu einem moderation_blocked geführt haben, um sie später analysieren zu können.

F2: Kann ich moderation_blocked mit gpt-image-2-all (offizielle Reverse-Proxy-Variante) umgehen?

In manchen Fällen ja, aber es ist kein Allheilmittel. Auch die Reverse-Proxy-Kanäle haben eigene Sicherheitsprüfungen, nur die Schwellenwerte und Regeln unterscheiden sich leicht. Bei bestimmten Sperren (z. B. Namen von Prominenten) blockieren beide Modelle. Wir empfehlen, über APIYI (apiyi.com) A/B-Tests zwischen den Modellen durchzuführen, um den Pfad zu finden, der für Ihr Geschäftsszenario toleranter ist.

F3: Werden bei einem moderation_blocked-Fehler Kosten berechnet?

Nein. Ein 400-Fehler ist ein Client-Fehler; weder OpenAI noch APIYI berechnen Kosten für blockierte Anfragen. Sie können also unbesorgt mit Ihren Eingabeaufforderungen experimentieren.

F4: Warum lösen chinesische Eingabeaufforderungen häufiger ein moderation_blocked aus als englische?

Das liegt nicht an der chinesischen Sprache selbst, sondern daran, dass chinesische Eingabeaufforderungen bei der Übersetzung in die interne Modellrepräsentation unerwartete englische Trigger-Begriffe enthalten können. Empfehlung: (1) Vermeiden Sie in chinesischen Eingabeaufforderungen die direkte Nennung von Prominenten/IPs. (2) Versuchen Sie es mit gpt-image-2-all, da dieses Modell nativ für chinesische Eingabeaufforderungen optimiert ist.

F5: Werden auch Fotos meiner eigenen Mitarbeiter für interne Zwecke blockiert?

Sehr wahrscheinlich. Das Sicherheitssystem von OpenAI kann nicht beurteilen, ob "Sie die Person auf dem Bild sind". Sobald es als Porträt einer echten Person erkannt wird, erfolgt eine Sperre. Wir empfehlen den Edit-Endpunkt (Hochladen des Originalbilds + Maske zur Bearbeitung) oder die Verwendung einer "stilisierten künstlerischen Bearbeitung" anstelle von realistischen Fotos.

F6: Können Unternehmenskunden eine Senkung der Filter-Schwellenwerte beantragen?

Bei einer direkten Verbindung zu OpenAI ist das nahezu unmöglich. Bei Azure OpenAI können einige Unternehmenskunden eine Anpassung der Content-Filter-Stufen beantragen (genehmigungspflichtig). Über den Unternehmensservice von APIYI (apiyi.com) können wir Sie bei der Abstimmung mit dem Azure-Genehmigungsprozess unterstützen oder maßgeschneiderte Multimodell-Lösungen anbieten, um Einschränkungen einzelner Anbieter zu umgehen.

F7: Ist die Filterung bei Nano Banana Pro wirklich lockerer als bei gpt-image-2?

In zahlreichen Tests zeigte sich, dass Nano Banana Pro bei künstlerischen Darstellungen und lockeren IP-Referenzen tatsächlich toleranter ist. Bei Kernbereichen wie Inhalten mit Minderjährigen, sexuellen Inhalten oder extremer Gewalt stimmt das Modell jedoch fast vollständig mit OpenAI überein – kein gängiges Modell kann diese roten Linien umgehen.

F8: Was bedeutet der Hinweis auf ein Azure Support Ticket in der Fehlermeldung?

Dies deutet darauf hin, dass die zugrunde liegende Verbindung über Azure OpenAI läuft. Verschiedene API-Proxy-Dienste nutzen unterschiedliche Backends; manche verbinden direkt mit OpenAI, andere über Azure. Die Strenge der Filterung variiert je nach Backend, weshalb dieselbe Eingabeaufforderung bei verschiedenen Anbietern unterschiedlich reagieren kann.

VIII. Fazit: Strategien gegen gpt-image-2 moderation_blocked Fehler

Nachdem wir die Fehlermeldung nun analysiert haben, wissen wir:

- Wesen des Fehlers:

moderation_blockedist kein Problem der Modellkapazität, sondern eine proaktive Blockade durch den Sicherheitsfilter vor der Modellinferenz. - Fehler nicht wiederholbar: Ohne Änderung der Eingabeaufforderung führt auch der zehntausendste Versuch zum gleichen Ergebnis.

- 7 Haupt-Trigger: Prominente / lebende Künstler / urheberrechtlich geschützte IPs / Gewalt / sexuelle Anspielungen / realistische Darstellungen von Kindern / Hasssymbole.

- 6 Umschreibestrategien: Namensersetzung / Verstorbene statt Lebende / Abstraktion von Charakteren / zweistufige Beschreibung / Emotionen statt Gewalt / Downgrade auf Edit-Endpunkt.

- Multimodell-Backup: Fallback-Kette von gpt-image-2 → gpt-image-2-all → Nano Banana Pro → Nano Banana 2.

- Technische Absicherung: Vierstufiges Gateway (Vorprüfung + Umschreibung + Fallback + Einspruch), um die Fehlerrate auf unter 1 % zu senken.

Für Teams, die gpt-image-2 produktiv einsetzen, lautet das Kernprinzip: Kämpfen Sie nicht gegen das Sicherheitssystem, sondern etablieren Sie Prompt-Engineering und Multimodell-Routing als systemische Fähigkeit. Ein moderation_blocked-Fehler bedeutet oft, dass in Ihrer Prompt-Ebene oder Architektur noch zehn weitere ähnliche Fehler lauern.

Wir empfehlen, über die einheitliche Schnittstelle von APIYI (apiyi.com) gleichzeitig auf mehrere Modelle wie gpt-image-2, gpt-image-2-all und Nano Banana Pro/2 zuzugreifen, um unter demselben Konto und derselben Codebasis schnell Fallback-Routings zu implementieren. Dies ist der schnellste Weg, um moderation_blocked von einem "geschäftskritischen Ausfall" zu einer "unbemerkten Optimierung" zu degradieren.

Über den Autor: Das technische Team von APIYI verfügt über umfassende Erfahrung in der Implementierung von Bilderzeugungsmodellen in Unternehmen, bei Einsprüchen zur Inhaltssicherheit und in der Architektur von Multimodell-Routing-Systemen. Besuchen Sie die offizielle Website von APIYI unter apiyi.com für Zugangslösungen zu gängigen Modellen wie gpt-image-2, gpt-image-2-all und Nano Banana Pro sowie für technischen Support auf Unternehmensebene bei Problemen wie moderation_blocked.