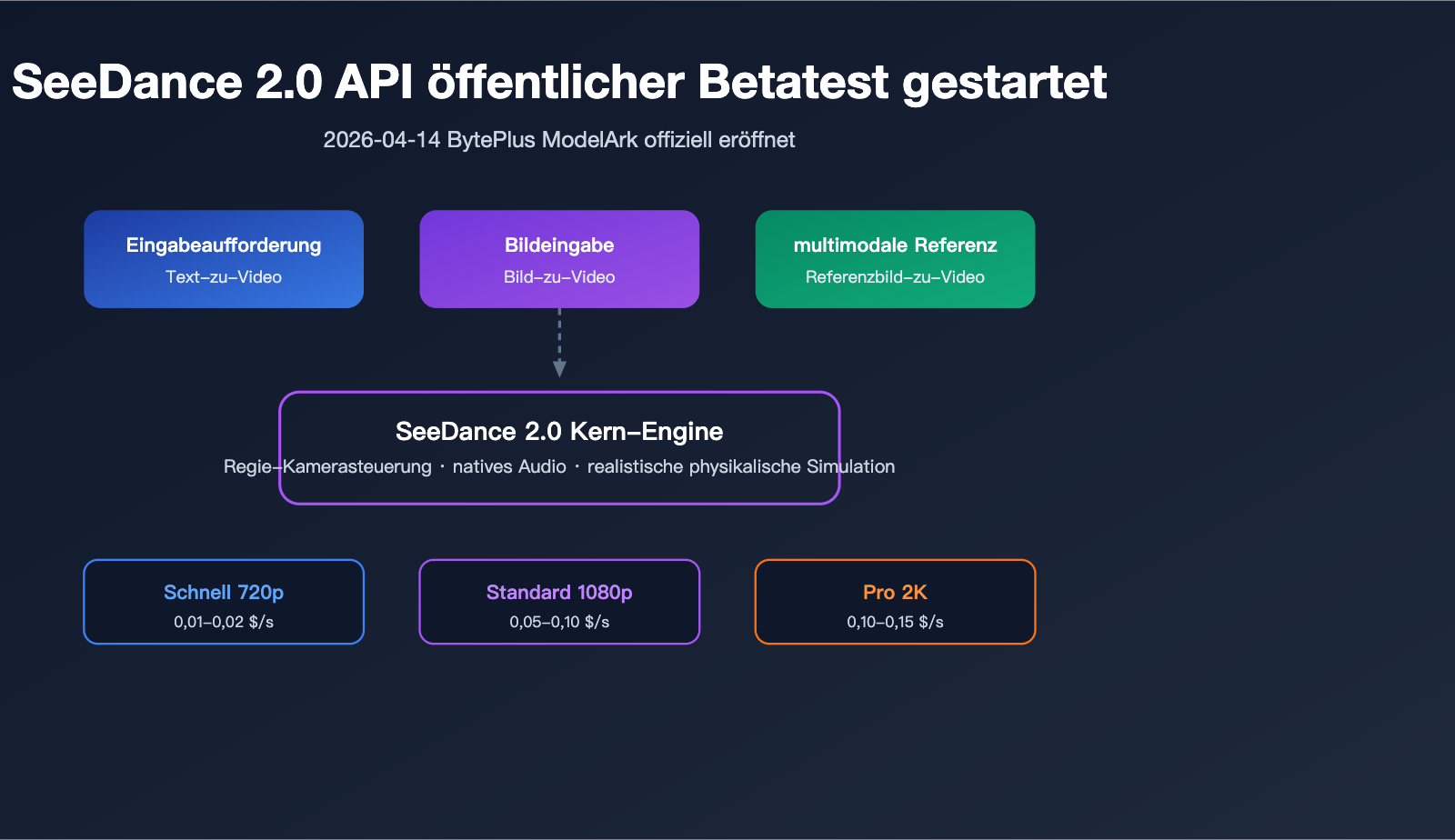

Am 14. April 2026 startete ByteDance offiziell den öffentlichen Betatest seines Videogenerierungsmodells SeeDance 2.0 auf der BytePlus ModelArk-Plattform. Damit erhalten Entwickler endlich Zugriff auf diese branchenführende Videogenerierungstechnologie über eine Standard-API. Im Vergleich zum Start am 9. April, als das Modell nur im Experience Center verfügbar war, unterstützt der öffentliche Betatest nun multimodale Schnittstellen für Text-zu-Video, Bild-zu-Video und Referenzbild-zu-Video. Zudem stehen die Varianten Fast, Standard und Pro zur Verfügung, um unterschiedlichen Anforderungen an Qualität und Kosten gerecht zu werden.

Dieser Artikel basiert auf Informationen aus der offiziellen BytePlus-Dokumentation (docs.byteplus.com/en/docs/ModelArk/2291680) und kombiniert diese mit Praxistests der internationalen Version. Wir erläutern systematisch die Modellmatrix, Parameter-Spezifikationen, den asynchronen Aufrufprozess und die praktische Implementierung der SeeDance 2.0 API. Egal, ob Sie eine Kurzvideo-Produktionslinie aufbauen oder nach Alternativen zu Veo 3 oder Kling 2 suchen – dieser Artikel bietet Ihnen eine klare Entscheidungsgrundlage.

Überblick über die Kernpunkte des SeeDance 2.0 API-Betatests

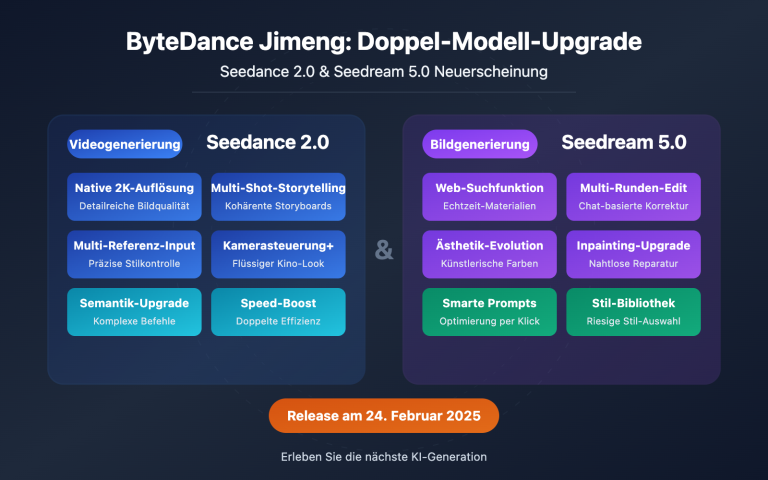

SeeDance 2.0 ist das Videogenerierungsmodell der zweiten Generation von ByteDance, das nach SeeDance 1.5 Pro veröffentlicht wurde. Es zeichnet sich durch vier wesentliche Upgrades aus: filmreife Bildqualität, natives Audio, realistische Physik und regieartige Kamerakontrolle. Nach dem Start des öffentlichen Betatests am 14. April sind die offiziellen API-Funktionen mit denen des Experience Centers identisch; Entwickler erhalten über die Standard-Inferenz-Schnittstelle von ModelArk vollen Zugriff.

Wichtige Upgrades im Vergleich zu 1.5 Pro

Im Vergleich zur Vorgängerversion bietet die SeeDance 2.0 API signifikante Verbesserungen in folgenden Bereichen:

| Fähigkeitsdimension | SeeDance 1.5 Pro | SeeDance 2.0 | Upgrade-Umfang |

|---|---|---|---|

| Maximale Auflösung | 1080p | 2K (Pro-Stufe) | +1 Stufe |

| Maximale Dauer | 10 Sekunden | 15 Sekunden | +50% |

| Natives Audio | Nicht unterstützt | Unterstützt (Umgebungsgeräusche + Sprache) | Neue Funktion |

| Kamerakontrolle | Einfache Eingabeaufforderung | Regieartige Parametrisierung | Qualitativer Sprung |

| Referenzeingabe | Max. 3 Bilder | 9 Bilder + 3 Videos + 3 Audios | 4-fache Erweiterung |

| Physikalische Simulation | Begrenzt | Echte physikalische Engine | Qualitativer Sprung |

🎯 Anbindungsempfehlung: Die SeeDance 2.0 API ist derzeit sowohl in der internationalen Version von BytePlus als auch auf einigen Aggregator-Plattformen verfügbar. Wir empfehlen die Nutzung der Plattform APIYI (apiyi.com) für den einheitlichen Aufruf von SeeDance 2.0 und anderen gängigen Videomodellen. Die Plattform bietet eine fertige Schnittstellenkapselung und unterstützt den Zugriff aus dem Inland, wodurch Netzwerkinstabilitäten bei direkten Auslandsverbindungen vermieden werden.

Voraussetzungen und Kontingente für den Betatest

Während des öffentlichen Betatests von BytePlus steht das Modell normalen Entwicklern offen, unterliegt jedoch bestimmten Ratenbegrenzungen:

- Zugangsweg: Nach Abschluss der Identitätsprüfung in der ModelArk-Konsole kann der Zugriff beantragt werden; eine Whitelist ist nicht erforderlich.

- Kostenloses Kontingent: Während der Betaphase erhält jedes Konto monatlich 20 kostenlose Aufrufe der Fast-Stufe.

- Ratenbegrenzung: QPS = 2 pro Konto; bei Überschreitung wird HTTP 429 zurückgegeben.

- Gleichzeitige Aufgaben: Maximal 3 laufende Aufgaben gleichzeitig.

SeeDance 2.0 API Modellmatrix und Endpunkt-Beschreibung

BytePlus bietet für die SeeDance 2.0 API eine Matrixkombination aus drei Qualitätsvarianten und drei Eingabemodalitäten, aus denen Entwickler je nach Szenario flexibel wählen können.

Vergleich der Modellvarianten

Die drei Varianten unterscheiden sich deutlich in Bezug auf Generierungsdauer, Bildqualität und Kosten:

| Variante | Modell-ID | Standardauflösung | Typische Generierungsdauer | Ziel-Szenario |

|---|---|---|---|---|

| Fast | seedance-2.0-fast |

720p | 30–60 Sekunden | Schnelle Prototypen, Social-Media-Inhalte |

| Standard | seedance-2.0 |

1080p | 60–90 Sekunden | Kommerzielle Kurzvideos, Werbung |

| Pro | seedance-2.0-pro |

2K | 90–150 Sekunden | Filmreife Previsualisierungen, High-End-Produktionen |

Drei Eingabe-Endpunkte

Je nach Eingabemodalität ist die SeeDance 2.0 API in drei separate Endpunkte unterteilt:

- Text-zu-Video (Text-to-Video): Erfordert nur eine Eingabeaufforderung, ideal für skriptbasierte Inhaltserstellung.

- Bild-zu-Video (Image-to-Video): Eingabe eines oder mehrerer Referenzbilder + optionale Eingabeaufforderung, zur Erstellung erweiterter Animationen.

- Referenzvideo (Reference-to-Video): Gemischte Eingabe von Bildern, Videoclips und Audio für multimodale Fusionen.

💡 Aufruf-Empfehlung: Wenn Sie in einem einzigen Aufruf verschiedene Modalitäten wie Bilder, Audio und Videos kombinieren möchten, sollten Sie den Referenzvideo-Endpunkt verwenden und im Array

referencesfür jeden Eintrag eine Rolle (subject/environment/motion/audio) festlegen. Über den API-Proxy-Dienst von APIYI (apiyi.com) erhalten Sie eine einheitliche Ansicht für Authentifizierung und Abrechnung, was die Kostenerfassung innerhalb Ihres Teams erleichtert.

Detaillierte Parameter der SeeDance 2.0 API

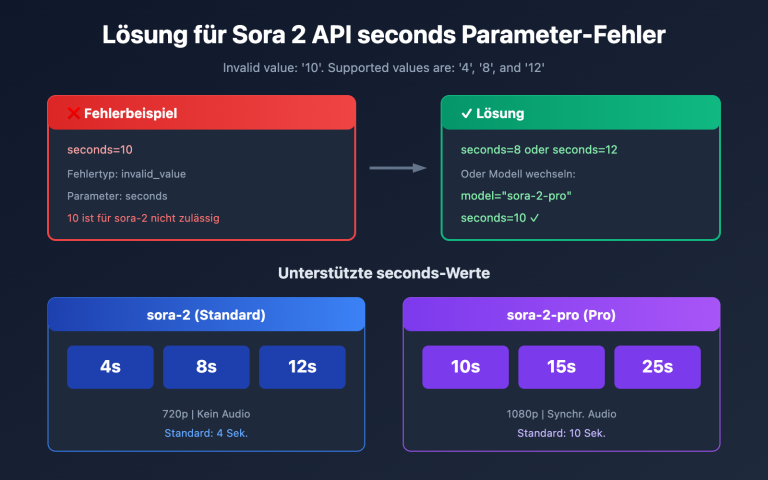

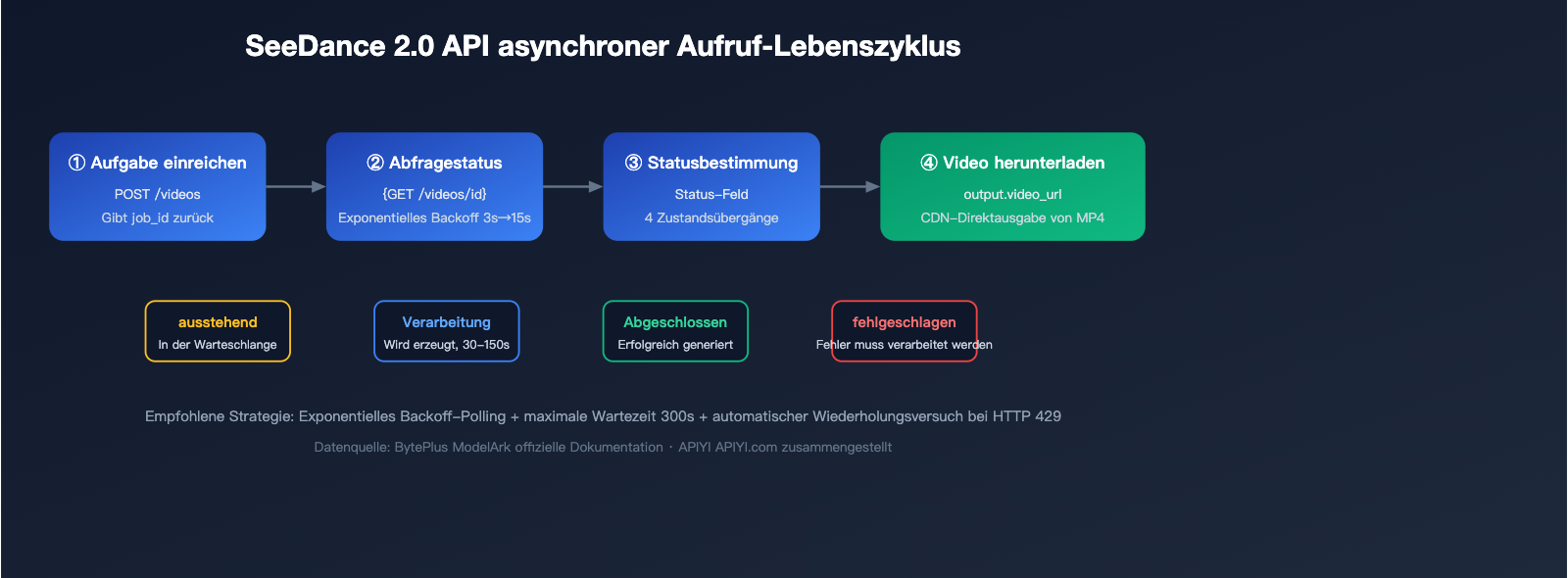

Die SeeDance 2.0 API verwendet ein asynchrones Aufgabenmodell: Nach dem Absenden der Anfrage wird eine job_id zurückgegeben, über die der Entwickler per Polling die endgültige Video-URL abruft.

Zentrale Parameterliste

Die folgende Tabelle zeigt die vollständige Parameterspezifikation für den Text-zu-Video-Endpunkt:

| Parameter | Typ | Wertebereich | Erforderlich | Beschreibung |

|---|---|---|---|---|

model |

String | seedance-2.0 / -fast / -pro |

Ja | Modell-ID |

prompt |

String | ≤ 2000 Zeichen | Ja | Englisch oder Chinesisch |

resolution |

String | 480p / 720p / 1080p / 2k |

Nein | Standard je nach Modellstufe |

duration |

Integer | 4–15 (Sekunden) | Nein | Standard 5 Sekunden |

aspect_ratio |

String | 21:9 / 16:9 / 4:3 / 1:1 / 3:4 / 9:16 | Nein | Standard 16:9 |

audio |

Boolean | true / false | Nein | Natives Audio generieren |

seed |

Integer | Beliebige Ganzzahl | Nein | Fester Seed zur Reproduzierbarkeit |

negative_prompt |

String | ≤ 500 Zeichen | Nein | Ausschluss von Elementen |

style |

String | cinematic / anime / realistic / 3d_render | Nein | Stil-Voreinstellung |

Beispielcode für den schnellen Einstieg

Das folgende Beispiel zeigt einen minimalen Text-zu-Video-Aufruf und verdeutlicht den standardmäßigen Prozess: Absenden – Polling – Herunterladen:

import requests

import time

BASE_URL = "https://api.apiyi.com/seedance/v1" # Zugang über APIYI-Proxy

API_KEY = "your_apiyi_key"

# Schritt 1: Aufgabe absenden

submit_resp = requests.post(

f"{BASE_URL}/videos",

headers={"Authorization": f"Bearer {API_KEY}"},

json={

"model": "seedance-2.0",

"prompt": "Eine orangefarbene Katze spaziert durch einen Kirschblütenregen, filmische geringe Schärfentiefe, warme Abendstimmung",

"resolution": "1080p",

"duration": 5,

"aspect_ratio": "16:9",

"audio": True,

"seed": 42

}

)

job_id = submit_resp.json()["job_id"]

# Schritt 2: Status abfragen (Polling)

while True:

status_resp = requests.get(

f"{BASE_URL}/videos/{job_id}",

headers={"Authorization": f"Bearer {API_KEY}"}

)

data = status_resp.json()

if data["status"] == "completed":

video_url = data["output"]["video_url"]

print(f"Video-Generierung abgeschlossen: {video_url}")

break

elif data["status"] == "failed":

raise Exception(f"Generierung fehlgeschlagen: {data.get('error')}")

time.sleep(5)

Dieses Beispiel nutzt APIYI (apiyi.com) als Zugangspunkt, wodurch Entwickler ohne Konfiguration eines Ausland-Proxys direkt zugreifen können. Bei Verwendung des offiziellen BytePlus-Endpunkts ersetzen Sie einfach die BASE_URL durch https://api.byteplus.com/seedance/v1, alle weiteren Parameter sind vollständig kompatibel.

Fortgeschrittene Parameter für Bild-zu-Video und Referenzvideo

Der Bild-zu-Video-Endpunkt ergänzt den Text-zu-Video-Endpunkt um die Felder image_url oder image_base64:

{

"model": "seedance-2.0",

"image_url": "https://example.com/start_frame.jpg",

"prompt": "Kamera zoomt langsam heran, Person dreht sich um und lächelt",

"duration": 8,

"camera_motion": "dolly_in"

}

Das Array references des Referenzvideo-Endpunkts kann bis zu 12 Elemente enthalten (9 Bilder + 3 Videos + 3 Audioaufnahmen), wobei für jeden Eintrag role und type angegeben werden müssen:

{

"references": [

{"type": "image", "role": "subject", "url": "https://..."},

{"type": "image", "role": "environment", "url": "https://..."},

{"type": "audio", "role": "audio", "url": "https://..."}

]

}

Preisstrategie und Kostenoptimierung der SeeDance 2.0 API

Während der öffentlichen Testphase wird die SeeDance 2.0 API nach der tatsächlichen Videolänge in Sekunden abgerechnet. Die folgende Tabelle zeigt die aktuellen offiziellen Richtpreise:

| Stufe | Auflösung | Preis pro Sekunde (USD) | Kosten für 5 Sek. Video | Kosten für 10 Sek. Video |

|---|---|---|---|---|

| Fast | 720p | $0,01 – $0,02 | $0,05 – $0,10 | $0,10 – $0,20 |

| Standard | 1080p | $0,05 – $0,10 | $0,25 – $0,50 | $0,50 – $1,00 |

| Pro | 2K | $0,10 – $0,15 | $0,50 – $0,75 | $1,00 – $1,50 |

⚡ Tipps zur Kostenoptimierung: Für Batch-Workflows empfiehlt es sich, zunächst die Fast-Stufe zur Auswahl der Entwürfe Ihrer Eingabeaufforderung zu nutzen. Sobald das gewünschte Ergebnis feststeht, kann die finale Version mit der Standard/Pro-Stufe generiert werden, was mehr als 60 % der Kosten einspart. Durch die Nutzung der APIYI-Plattform (apiyi.com) profitieren Sie von einer Abrechnung in RMB und einer aggregierten Rechnungsstellung, was die Buchhaltung und Kostenaufteilung erheblich vereinfacht.

Beispielrechnung für die tatsächlichen Kosten

Angenommen, ein Kurzvideo-Account produziert täglich 20 fertige Videos à 8 Sekunden in 1080p:

- Kosten pro Video: 8 Sekunden × $0,075 ≈ $0,60

- Tägliche Kosten: 20 Videos × $0,60 = $12

- Monatliche Kosten: $12 × 30 ≈ $360

Wenn Sie für die ersten drei Entwurfsrunden die Fast-Stufe verwenden und erst für das finale Video zur Standard-Stufe wechseln, können die monatlichen Kosten auf etwa $180 gesenkt werden.

Die sechs Kernfähigkeiten der SeeDance 2.0 API in der Praxis

Fähigkeit 1: Kamerasteuerung auf Regie-Niveau

SeeDance 2.0 unterstützt nativ mehr als 10 Arten von Kamerabewegungsbefehlen, die über den Parameter camera_motion oder durch natürliche Beschreibungen in der Eingabeaufforderung ausgelöst werden können:

dolly_in/dolly_out: Zoom-Fahrt (rein/raus)pan_left/pan_right: Schwenk (links/rechts)tilt_up/tilt_down: Neigen (hoch/runter)orbit_left/orbit_right: Umkreisencrane_up/crane_down: Kranbewegung (hoch/runter)zoom_in/zoom_out: Zoom (ran/weg)

Fähigkeit 2: Native Audiogenerierung

Wenn Sie in der Anfrage audio: true festlegen, generiert das Modell passend zum Bildinhalt Hintergrundgeräusche, Stimmen oder Musik. Bei der Szene "Café im Regen" werden beispielsweise automatisch Regengeräusche und atmosphärische Musik hinzugefügt – ganz ohne aufwendige Nachbearbeitung.

Fähigkeit 3: Realistische physikalische Simulation

Die Physik-Engine von SeeDance 2.0 verarbeitet komplexe Interaktionen wie spritzende Flüssigkeiten, flatternde Stoffe oder Aufprallkollisionen und steigert damit die Glaubwürdigkeit der Bilder, wodurch der typische "KI-Look" minimiert wird.

Fähigkeit 4: Multimodale Referenz-Integration

Der Reference-to-Video-Endpunkt ermöglicht es Entwicklern, Charakterbilder, Szenenreferenzen, Bewegungsreferenzvideos und Umgebungsaudio gleichzeitig zu übermitteln. Das Modell entkoppelt und kombiniert diese Elemente automatisch. Dies ist entscheidend für IP-Inhalte und die Produktion von Serien.

Fähigkeit 5: Stabile Generierung bei längerer Dauer

SeeDance 2.0 unterstützt eine kontinuierliche Generierung von bis zu 15 Sekunden in einem Durchgang, wobei sowohl die Bildkonsistenz als auch die Stabilität der Charaktere die Standardwerte von Kling 2 (5 Sekunden) und Veo 3 (8 Sekunden) übertreffen.

Fähigkeit 6: 2K-Ausgabe mit hoher Auflösung

Die Pro-Stufe unterstützt nativ die 2K-Auflösung und deckt damit Anforderungen für vertikale Kurzvideos, Breitbild-Werbung, Information-Feed-Platzierungen und mehr ab.

SeeDance 2.0 API-Fehlerbehandlung und Rate-Limiting-Strategien

Die während des Modellaufrufs häufig auftretenden Statuscodes und die empfohlenen Strategien finden Sie hier:

| HTTP-Status | Bedeutung | Empfohlene Maßnahme |

|---|---|---|

| 200 | Anfrage erfolgreich | Antwort normal verarbeiten |

| 400 | Parameterfehler | Prüfen Sie die Länge der Eingabeaufforderung und die Gültigkeit der Auflösung |

| 401 | Authentifizierung fehlgeschlagen | Validieren Sie die Gültigkeit Ihres API-Schlüssels |

| 429 | Ratenlimit überschritten | Exponentielles Backoff für Wiederholungen (empfohlener Startwert: 2s) |

| 500 | Interner Serverfehler | Nach 2-3 Versuchen auf die "Fast"-Stufe zurückgreifen |

| 503 | Dienst vorübergehend nicht verfügbar | Zu einem Backup-Endpunkt wechseln oder 30s warten |

Best Practices für asynchrones Polling

Es wird eine Strategie bestehend aus exponentiellem Backoff + maximalem Timeout empfohlen:

def poll_with_backoff(job_id, max_wait=300):

start = time.time()

delay = 3

while time.time() - start < max_wait:

resp = get_job_status(job_id)

if resp["status"] in ("completed", "failed"):

return resp

time.sleep(delay)

# Verzögerung bei jedem Schritt erhöhen

delay = min(delay * 1.5, 15)

raise TimeoutError("Aufgaben-Timeout")

Häufig gestellte Fragen (FAQ)

F1: Was unterscheidet die SeeDance 2.0 API von der Erstversion vom 9. April?

Als SeeDance 2.0 am 9. April im BytePlus Experience Center debütierte, war nur die Web-Vorschau verfügbar, kein öffentlicher API-Zugriff. Seit der öffentlichen Beta am 14. April können Entwickler über die ModelArk-Konsole volle API-Rechte erhalten, die die drei Stufen Fast/Standard/Pro sowie drei Eingabe-Endpunkte abdecken. Für eine schnelle Anbindung ohne Konfigurationsaufwand empfehlen wir die direkte Nutzung über die Plattform APIYI apiyi.com, was die Prüfung ausländischer Konten überflüssig macht.

F2: Unterstützt die SeeDance 2.0 API chinesische Eingabeaufforderungen?

Ja. SeeDance 2.0 verwendet einen multilingualen Text-Encoder. Eingabeaufforderungen auf Chinesisch, Englisch oder Japanisch können direkt eingegeben werden. Tests zeigen, dass die Genauigkeit des semantischen Verständnisses bei Chinesisch weitgehend der von Englisch entspricht. Es wird empfohlen, eine vierstufige Struktur für die Eingabeaufforderung zu verwenden: Aktion + Szene + Stil + Kameraführung. Beispiel: "Eine orangefarbene Katze schlendert durch die Straßen von Kyoto, während Kirschblüten fallen, Ukiyo-e-Stil, Weitwinkel-Nachführung".

F3: Wie nutze ich das System weiter, wenn das kostenlose Kontingent der öffentlichen Beta aufgebraucht ist?

Die offizielle Beta gewährt jedem Konto monatlich 20 kostenlose Aufrufe der Stufe "Fast". Bei Überschreitung erfolgt die Abrechnung gemäß den Standardtarifen. Wenn Sie höhere Kapazitäten oder ein unternehmensweites SLA benötigen, ziehen Sie Folgendes in Betracht:

- Upgrade auf ein BytePlus-Unternehmenskonto (erfordert ausländische Qualifikationen)

- Kauf eines einheitlichen API-Proxy-Dienstes über die Plattform APIYI apiyi.com, der nutzungsbasierte Abrechnung und Zahlungen in RMB unterstützt und Ihnen den Ärger mit ausländischen Rechnungen erspart.

F4: Was sind die häufigsten Ursachen für Fehler bei der Bilderzeugung?

Zu den häufigsten Fehlern zählen: Eingabeaufforderung verstößt gegen Sicherheitsrichtlinien (ca. 40 %), das Referenzbild hat eine Auflösung unter 512px (ca. 25 %), Netzwerk-Timeouts (ca. 20 %) und Überschreitung der Nebenläufigkeitsgrenzen (ca. 15 %). Wir empfehlen lokale Prüfungen vor dem Aufruf: Bereinigung der Eingabeaufforderung, Vorverarbeitung des Bildes auf 1024px+ und Implementierung eines 429-Wiederholungsmechanismus.

F5: Wie entscheide ich mich zwischen SeeDance 2.0, Veo 3 und Kling 2?

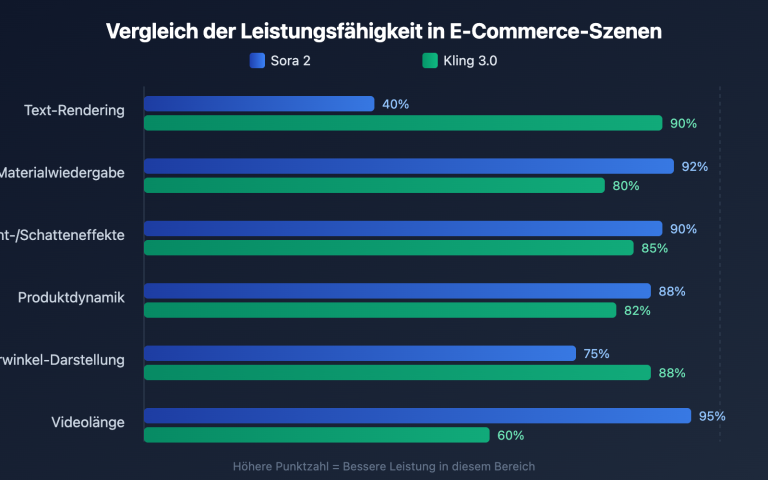

Ein einfaches Entscheidungsprinzip: Physikalischen Realismus + natives Audio bevorzugen → SeeDance 2.0, höchste Bildqualität + westliche Ästhetik → Veo 3, schnelle Iterationen + chinesische Szenarien → Kling 2. Bei ausreichendem Budget empfiehlt sich ein A/B-Test aller drei Modelle, um die optimale Lösung für die jeweiligen Szenarien zu ermitteln.

Zusammenfassung

Am 14. April 2026 startete die öffentliche Beta-Phase für die SeeDance 2.0 API, was einen Meilenstein darstellt, da das Videogenerierungsmodell von ByteDance nun offiziell in die Phase der kommerziellen Nutzung für Entwickler eingetreten ist. Die Kombination aus drei Modellvarianten, drei Endpunkttypen, multimodaler Eingabe, nativem Audio und Regie-Kamerasteuerung macht das Modell äußerst wettbewerbsfähig in Bezug auf physikalische Authentizität, Verständnis der chinesischen Sprache und Kostenkontrolle.

Für Entwickler, die SeeDance 2.0 schnellstmöglich integrieren möchten, empfiehlt sich die Plattform APIYI (apiyi.com). Sie bietet bereits optimierte Schnittstellenkapselungen und Netzwerk-Performances. Der Dienst unterstützt alle Leistungsstufen (Fast/Standard/Pro), ermöglicht Zahlungen in Renminbi und bietet technischen Support auf Unternehmensebene – der effizienteste Weg, um Videogenerierungsfunktionen produktiv zu implementieren.

📌 Autorenhinweis: Dieser Artikel wurde vom Technik-Team von APIYI (apiyi.com) erstellt und veröffentlicht. Er basiert auf der offiziellen BytePlus-Dokumentation sowie Praxistests der internationalen Version. Alle Preise und Parameter beziehen sich auf die Ankündigung der öffentlichen Beta vom 14.04.2026.