Das dramatischste KI-Ereignis im März 2026: Ein anonymes Modell namens "Hunter Alpha" tauchte plötzlich auf OpenRouter auf, verbrauchte wöchentlich 500 Milliarden Token und lieferte eine Leistung, die fast an GPT-5.2 und Claude Opus 4.6 heranreichte. Entwickler weltweit rätselten: "Ist das etwa DeepSeek V4?"

Die Antwort überraschte alle – es ist das MiMo V2 Pro von Xiaomi. Ein Smartphone-Hersteller, der in weniger als einem Jahr ein globales Spitzenmodell mit Billionen von Parametern entwickelt hat.

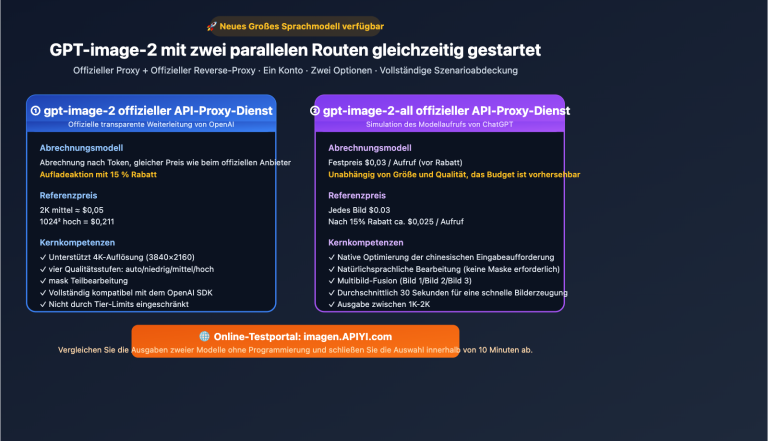

Zeitgleich wurde MiMo V2 Omni veröffentlicht – ein multimodales Modell, das nativ Text, Bilder, Videos und über 10 Stunden kontinuierliches Audio verarbeiten kann. Beide Modelle sind jetzt auf der APIYI-Plattform verfügbar und können direkt von Entwicklern aufgerufen werden.

Kernnutzen: Nach dem Lesen dieses Artikels kennen Sie die tatsächlichen Fähigkeiten von MiMo V2 Pro und Omni, die Unterschiede im Vergleich zur Konkurrenz und wissen, warum sie derzeit zu den KI-Modellen mit dem besten Preis-Leistungs-Verhältnis gehören.

Die Hunter Alpha-Affäre: Wie Xiaomi die KI-Welt schockierte

Zeitplan

| Datum | Ereignis |

|---|---|

| Anfang 2026 | Ein Modell mit dem Codenamen "Hunter Alpha" geht anonym auf OpenRouter online |

| Über mehrere Wochen | Wöchentlicher Verbrauch von 500 Milliarden Token; weltweite Nutzung durch Entwickler |

| Community-Diskussion | Leistung nahe an Top-Closed-Source-Modellen; allgemeine Vermutung: DeepSeek V4 |

| 18.-19.03.2026 | Xiaomi enthüllt offiziell: Hunter Alpha = MiMo V2 Pro |

| Am selben Tag | MiMo V2 Omni und MiMo V2 Flash werden zeitgleich veröffentlicht |

| Tag der Enthüllung | Xiaomis Aktienkurs steigt um ca. 4 % |

Warum dieses Ereignis so beeindruckend ist: Ein Unternehmen, das für Smartphones und Smart-Home-Technik bekannt ist, hat in weniger als einem Jahr ein Großes Sprachmodell mit Billionen von Parametern trainiert, dessen Leistung direkt in die Top 10 weltweit einsteigt. Noch überraschender ist, dass der leitende Verantwortliche, Luo Fuli, zuvor einer der Kernentwickler der bahnbrechenden DeepSeek-Modelle war.

🎯 Verfügbarkeit: MiMo V2 Pro und MiMo V2 Omni sind auf der APIYI-Plattform (apiyi.com) verfügbar und können direkt von Entwicklern aufgerufen werden. Angesichts der Leistungsfähigkeit von MiMo V2 Pro und dem Preis von 1/3 ist dies eines der derzeit kosteneffizientesten Modelle für den Modellaufruf.

MiMo V2 Pro: Ein Billion-Parameter-Inferenzmodell

Kernspezifikationen

| Parameter | Details |

|---|---|

| Modellname | MiMo V2 Pro (ehemals Hunter Alpha) |

| Veröffentlichungsdatum | 18.–19. März 2026 |

| Gesamtparameter | ca. 1 Billion (MoE-Architektur) |

| Aktive Parameter | 42B (pro Inferenzschritt) |

| Kontextfenster | 1.048.576 Token (1M) |

| Maximale Ausgabe | 131.072 Token (128K) |

| Eingabe/Ausgabe | Nur Text |

| Inferenzfähigkeit | Unterstützt erweitertes Denken (<think>-Tag) |

| Open-Source-Status | Derzeit nicht quelloffen (API-Zugriff) |

| Projektleitung | Luo Fuli (ehemals Kernmitglied bei DeepSeek) |

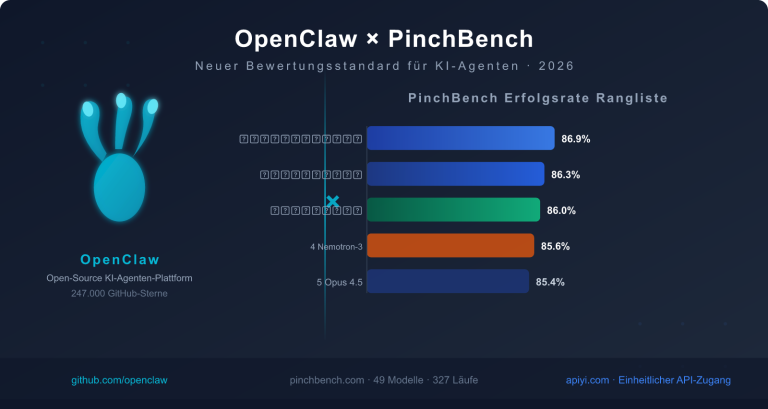

Benchmark-Leistung: Weltweit Platz 8, China Platz 2

| Benchmark | MiMo V2 Pro | Ranking |

|---|---|---|

| Artificial Analysis Intelligenzindex | 49 | Weltweit #8 |

| PinchBench | 84,0 | Weltweit #3 |

| ClawEval (Agentenfähigkeiten) | 61,5 | Weltweit #3 |

| GDPval-AA | 1434 Elo | China-Modell #1 |

| Mathematische Genauigkeit | 94,0 % | Spitzenklasse |

| Kodierungsgenauigkeit | 92,5 % | Übertrifft Claude Sonnet 4.6 |

| Halluzinationsrate | 30 % | Besser als vergleichbare Modelle |

Wichtige Erkenntnisse: MiMo V2 Pro belegt bei agentenbasierten Aufgaben (ClawEval) weltweit den 3. Platz – nur hinter Claude Opus 4.6 (66,3) und einem weiteren Modell. Dies bedeutet, dass es bei mehrstufigen Schlussfolgerungen, Werkzeugaufrufen und der autonomen Aufgabenausführung hervorragende Leistungen erbringt.

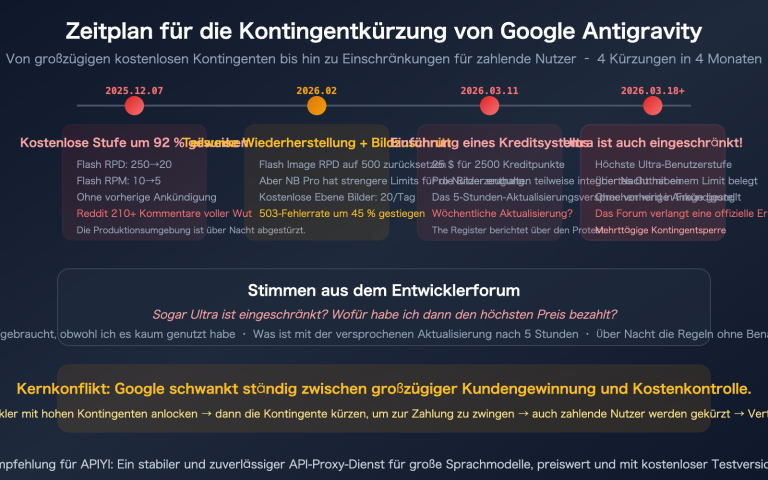

Preisgestaltung: 1/6 des Preises bei vergleichbarer Leistung

| Kontextbereich | Eingabe (pro Million Token) | Ausgabe (pro Million Token) |

|---|---|---|

| ≤ 256K | $1,00 | $3,00 |

| 256K – 1M | $2,00 | $6,00 |

Preisvergleich mit Wettbewerbern:

| Modell | Eingabe | Ausgabe | Relativ zu MiMo V2 Pro |

|---|---|---|---|

| MiMo V2 Pro | $1,00 | $3,00 | Basis |

| Claude Sonnet 4.6 | $3,00 | $15,00 | 5x teurer |

| Claude Opus 4.6 | $15,00 | $75,00 | 25x teurer |

| GPT-5.2 | ~$7,50 | ~$30,00 | 10x teurer |

Die Kodierungsfähigkeit von MiMo V2 Pro übertrifft Claude Sonnet 4.6, kostet aber nur 1/5 des Preises. Die Agentenfähigkeit kommt Claude Opus 4.6 nahe, kostet jedoch nur 1/25.

💡 Preis-Leistungs-Empfehlung: MiMo V2 Pro ist derzeit eines der leistungsstärksten kostengünstigen Modelle auf dem Markt. Über den API-Proxy-Dienst APIYI (apiyi.com) ist es direkt abrufbar – ideal für kostenbewusste Entwicklungsszenarien, die keine Kompromisse bei der Qualität eingehen wollen.

MiMo V2 Omni: Das multimodale KI-Modell

MiMo V2 Omni ist das multimodale Flaggschiff von Xiaomi – ein Modell, das in einer einheitlichen Architektur nativ Text, Bilder, Videos und Audio unterstützt.

Kernspezifikationen

| Parameter | Details |

|---|---|

| Modellname | MiMo V2 Omni |

| Veröffentlichungsdatum | 18.-19. März 2026 |

| Kontextfenster | 256K Token |

| Eingabemodalitäten | Text + Bild + Video + Audio |

| Ausgabemodalität | Text |

| Audioverarbeitung | Unterstützt 10+ Stunden kontinuierliches Audio (branchenweit führend) |

| Preisgestaltung | Eingabe $0,40/MTok · Ausgabe $2,00/MTok |

Highlights der multimodalen Fähigkeiten

1. Visuelle Schlussfolgerung übertrifft Claude Opus 4.6

Bei den Benchmarks MMMU-Pro (multidisziplinäres visuelles Schlussfolgern) und CharXiv RQ (Analyse komplexer Diagramme) übertrifft MiMo V2 Omni das Modell Claude Opus 4.6 und nähert sich dem Niveau von Gemini 3 an.

2. 10 Stunden kontinuierliches Audio-Verständnis

Dies ist eine branchenweit einzigartige Fähigkeit: In einer einzigen Anfrage können über 10 Stunden kontinuierliches Audiomaterial verarbeitet werden, ohne dass ein Qualitätsverlust auftritt. Anwendungsbereiche:

- Vollständige Analyse und Zusammenfassung von Konferenzaufzeichnungen

- Extraktion von Inhalten aus Podcasts/Interviews

- Verständnis langer Sprachdialoge

- Kombinierte Audio- und Videoanalyse

3. Native Werkzeugnutzung und UI-Positionierung

Das Omni-Modell verfügt über integrierte Funktionen für strukturierte Werkzeugaufrufe, Funktionsausführung und die Lokalisierung von UI-Elementen – es kann direkt in KI-Agenten-Frameworks verwendet werden, ohne dass zusätzliche Kapselungen erforderlich sind.

4. Praxis-Demo

Xiaomi demonstrierte auf der Konferenz einen vollständigen Workflow mit Omni:

Benutzer gibt eine Anforderung in einem Satz ein

↓

Omni schreibt eigenständig ein Skript

↓

Aufnahme von 4 Szenen

↓

Schnitt, Sprachsynthese, Korrektur von Rendering-Fehlern

↓

Hochladen und Veröffentlichen eines 15-sekündigen Kurzvideos

Der gesamte Prozess läuft vollkommen autonom ab.

Preisgestaltung: Maximale Wirtschaftlichkeit für multimodale Modelle

| Abrechnungsposten | Preis |

|---|---|

| Eingabe | $0,40 / Million Token |

| Ausgabe | $2,00 / Million Token |

Dies ist derzeit eines der günstigsten multimodalen Modelle auf dem Markt. Im Vergleich zu Gemini 3.1 Pro ($2/$12) und Claude Opus 4.6 ($15/$75) bietet Omni einen enormen Preisvorteil.

🚀 Anwendungsbereiche: Wenn Ihre Anwendung Bilder, Videos oder lange Audiospuren verarbeiten muss, ist MiMo V2 Omni eine äußerst kosteneffiziente Wahl. Über APIYI (apiyi.com) können Sie es direkt aufrufen; es unterstützt das standardmäßige OpenAI-kompatible Format.

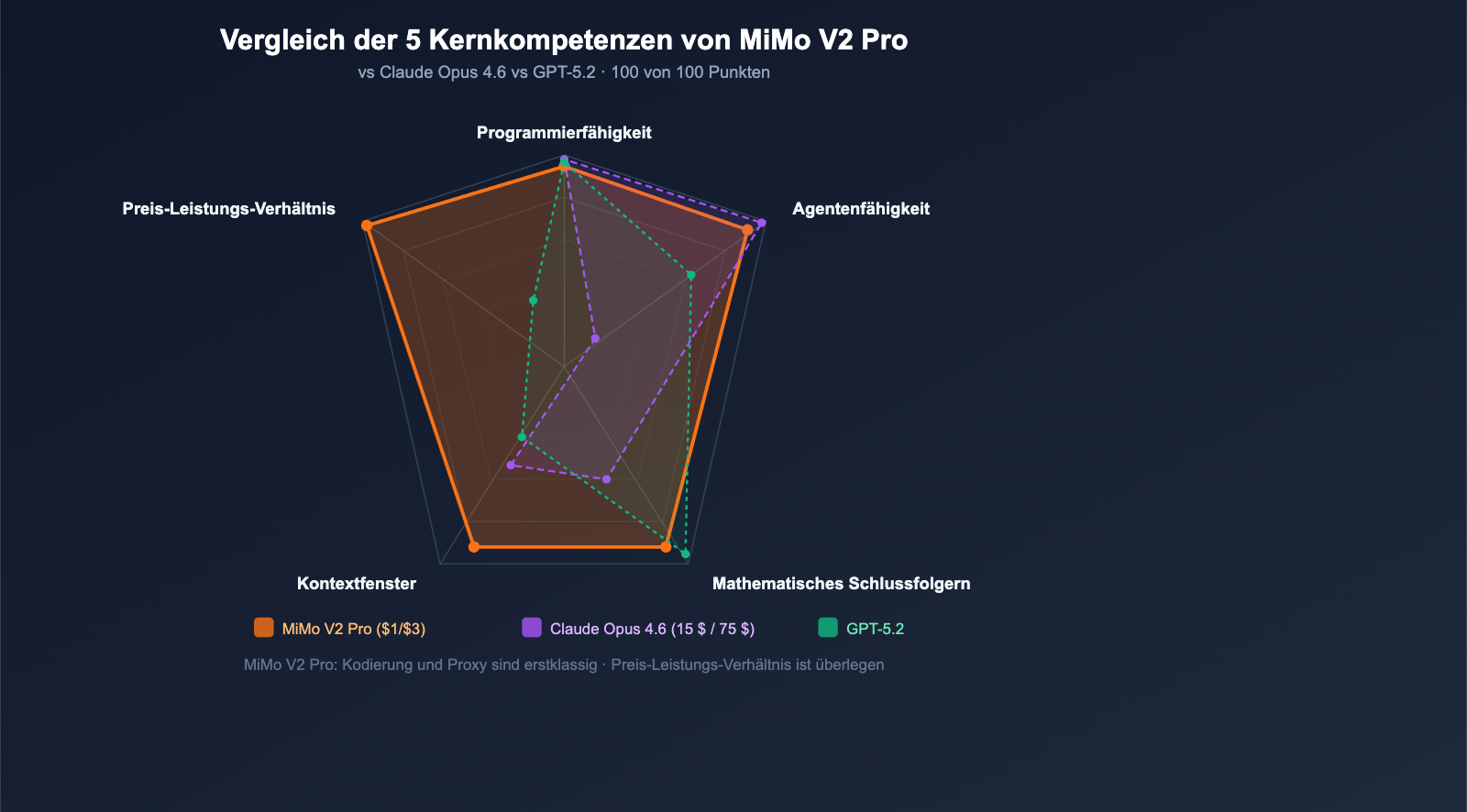

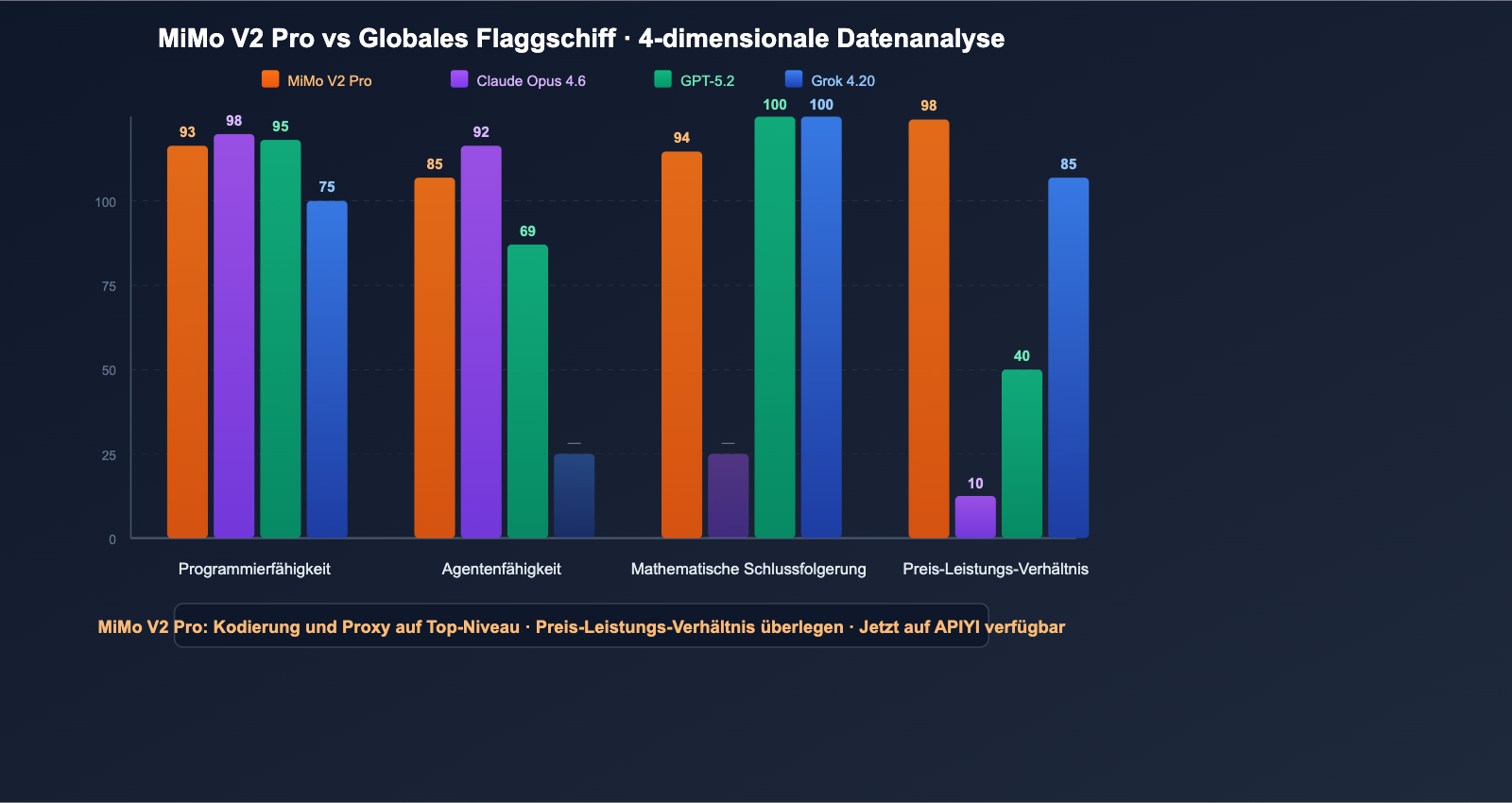

MiMo V2 Pro im Vergleich zu globalen Spitzenmodellen

Vergleich über alle Dimensionen

| Dimension | MiMo V2 Pro | Claude Opus 4.6 | GPT-5.2 | Grok 4.20 |

|---|---|---|---|---|

| Architektur | 1T MoE (42B aktiv) | geschlossen | geschlossen | geschlossenes MoE |

| Codiergenauigkeit | 92,5% | Stärkstes (SWE 81,4%) | Stark (SWE ~80%) | SWE ~75% |

| Agentenfähigkeit (ClawEval) | 61,5 (#3) | 66,3 (#1) | 50,0 | — |

| Mathematik | 94,0% | — | AIME 100% | AIME 100% |

| Kontext | 1M | 1M | modellabhängig | 2M |

| Eingabepreis | $1,00 | $15,00 | ~$7,50 | $2,00 |

| Ausgabepreis | $3,00 | $75,00 | ~$30,00 | $6,00 |

| Inferenzmodus | <think>-Tags |

Adaptive Thinking | Erweiterte Inferenz | Inferenz/keine Inferenz |

| Multimodal | ❌ (Pro nur Text) | ✅ | ✅ | ✅ begrenzt |

Positionierung von MiMo V2 Pro

Leistung: Nahe an Claude Opus 4.6 (Abstand bei Agentenfähigkeit nur 5 Punkte)

Preis: Etwa 1/25 von Opus

↓

Positionierung: "Opus für Sparfüchse" / Preis-Leistungs-König

Am besten geeignet für MiMo V2 Pro:

- Kostenbewusste Anwendungen, die dennoch starke Inferenzfähigkeiten benötigen

- Agentenbasierte Aufgaben (mehrstufiges Schlussfolgern, Werkzeugaufrufe)

- Umfangreiche Codegenerierung und -analyse

- Mathematische und logische Schlussfolgerungen

- Reine Textanwendungen ohne Bedarf an Multimodalität

Szenarien, in denen Claude Opus 4.6 weiterhin überlegen ist:

- Extrem komplexe Softwareentwicklung (SWE-bench-Abstand ca. 6 Prozentpunkte)

- Bedarf an 128K extrem langen Ausgaben

- Sicherheits- und Compliance-Anforderungen auf Unternehmensebene

- Bedarf an Adaptive Thinking (selbstanpassendes Schlussfolgern)

💰 Auswahlempfehlung: Für die tägliche Entwicklung und Batch-Aufgaben spart MiMo V2 Pro ($1/$3) massiv Kosten. Für sicherheitskritische und architektonische Aufgaben empfiehlt sich Claude Opus 4.6. Über APIYI (apiyi.com) können Sie mit einem einzigen Schlüssel beide Modelle aufrufen und je nach Bedarf wechseln.

Übersicht der MiMo V2-Modellfamilie

Xiaomi hat auf einen Schlag drei Modelle veröffentlicht, die alle Anwendungsszenarien von ultraleicht bis hin zum Flaggschiff abdecken.

| Modell | Parameter | Positionierung | Preis (Eingabe) | Preis (Ausgabe) | Open Source |

|---|---|---|---|---|---|

| MiMo V2 Flash | 309B (15B aktiv) | Leicht & schnell | $0,09 | $0,29 | ✅ MIT |

| MiMo V2 Pro | ~1T (42B aktiv) | Schlussfolgerungs-Flaggschiff | $1,00 | $3,00 | ❌ API |

| MiMo V2 Omni | — | Multimodal | $0,40 | $2,00 | ❌ API |

Zusätzliche Hinweise zu MiMo V2 Flash:

- Vollständig Open Source unter der MIT-Lizenz, Gewichte auf HuggingFace verfügbar

- SWE-bench Verified: 73,4 % (führend bei Open-Source-Modellen)

- AIME 2025: 94,1 %

- Inferenzgeschwindigkeit: 150+ Token/Sekunde

- Übertrifft DeepSeek-R1-0528 in 7 von 8 Testkategorien

🎯 Strategie für die Modellfamilie: Nutzen Sie Flash für einfache Aufgaben ($0,09/$0,29 extrem günstig), Pro für komplexe Schlussfolgerungen ($1/$3 bestes Preis-Leistungs-Verhältnis) und Omni für multimodale Aufgaben ($0,40/$2,00). Über den API-Proxy-Dienst APIYI (apiyi.com) können Sie alle MiMo V2-Modelle zentral anbinden.

Praxisbeispiel für den Modellaufruf

Aufruf von MiMo V2 Pro

import openai

client = openai.OpenAI(

api_key="DEIN_API_SCHLUESSEL",

base_url="https://api.apiyi.com/v1" # Einheitliche APIYI-Schnittstelle

)

response = client.chat.completions.create(

model="mimo-v2-pro",

messages=[

{"role": "system", "content": "Du bist ein erfahrener Softwareentwickler, spezialisiert auf Code-Reviews und Architekturdesign."},

{"role": "user", "content": "Überprüfe den folgenden Python-Code auf Nebenläufigkeitssicherheit..."}

],

max_tokens=8192

)

print(response.choices[0].message.content)

Aufruf von MiMo V2 Omni (multimodal)

# Beispiel für Bildverständnis

response = client.chat.completions.create(

model="mimo-v2-omni",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Analysiere den Datenfluss in diesem Architekturdiagramm"},

{"type": "image_url", "image_url": {"url": "data:image/png;base64,..."}}

]

}

]

)

Testcode für den Vergleich: MiMo V2 Pro vs. Claude Sonnet 4.6

import openai

import time

client = openai.OpenAI(

api_key="DEIN_API_SCHLUESSEL",

base_url="https://api.apiyi.com/v1"

)

models = ["mimo-v2-pro", "claude-sonnet-4-6"]

prompt = "Implementiere in Python einen LRU-Cache mit Unterstützung für Nebenläufigkeit, der threadsicher sein muss"

for model in models:

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=4096

)

elapsed = time.time() - start

usage = response.usage

print(f"\n{'='*50}")

print(f"Modell: {model}")

print(f"Dauer: {elapsed:.1f}s")

print(f"Token: Eingabe {usage.prompt_tokens} / Ausgabe {usage.completion_tokens}")

print(f"Vorschau: {response.choices[0].message.content[:200]}...")

🚀 Schnellstart: Registrieren Sie sich bei APIYI (apiyi.com), um Ihren API-Schlüssel zu erhalten und MiMo V2 Pro sowie Omni sofort zu nutzen. Mit einem einzigen Schlüssel greifen Sie auf über 200 Modelle von Xiaomi, Claude, GPT und mehr zu.

Häufig gestellte Fragen

Q1: Hat das MiMo V2 Pro wirklich eine Billion Parameter? Warum ist es so günstig?

Ja, die Gesamtanzahl der Parameter liegt bei etwa einer Billion, aber es verwendet eine MoE-Architektur (Mixture of Experts), bei der pro Inferenz nur etwa 42 Mrd. Parameter aktiviert werden. Das bedeutet, dass die Inferenzkosten weit unter denen eines dichten Modells mit gleicher Parameteranzahl liegen. Dies ist derselbe technische Ansatz, den auch Modelle wie DeepSeek oder Grok verfolgen. Über APIYI (apiyi.com) können Sie dieses Billionen-Parameter-Modell zu einem Bruchteil der Kosten (1/3) nutzen.

Q2: Kann MiMo V2 Pro Claude bei der Code-Überprüfung ersetzen?

In einigen Szenarien ja. Die Codierungsgenauigkeit (92,5 %) und die Agentenfähigkeiten (ClawEval 61,5) von MiMo V2 Pro sind äußerst stark. Für tägliche Code-Reviews und Fehleranalysen ist es eine äußerst kosteneffiziente Wahl. Für sicherheitskritische Audits und die Umstrukturierung sehr großer Architekturen bleibt Claude Opus 4.6 jedoch zuverlässiger. Wir empfehlen, über APIYI (apiyi.com) beide Modelle anzubinden und je nach Aufgabe flexibel zu wechseln.

Q3: Ist die 10-Stunden-Audioverarbeitung von MiMo V2 Omni zuverlässig?

Xiaomi gibt an, dass dies eine branchenweit erste Funktion ist – eine einzelne Anfrage unterstützt das Verständnis von über 10 Stunden kontinuierlichem Audio ohne Qualitätsverlust. Dies eignet sich für Szenarien mit langen Audioaufnahmen wie Konferenzanalysen oder die Extraktion von Podcast-Inhalten. Da es sich jedoch um ein neu veröffentlichtes Modell handelt, empfehlen wir, es zunächst bei nicht kritischen Aufgaben zu testen. Über APIYI (apiyi.com) können Sie dies kostengünstig ($0,40/$2,00) testen.

Q4: Wird MiMo V2 Pro Open Source?

Xiaomi hat Pläne angekündigt, das Modell zu öffnen, "sobald es stabil genug ist". Die MiMo V2 Flash-Serie ist bereits unter der MIT-Lizenz auf HuggingFace verfügbar. Angesichts der positiven Haltung von Xiaomi gegenüber Open Source (auch MiMo V1 wurde bereits veröffentlicht) ist eine Open-Source-Version von V2 Pro nur eine Frage der Zeit.

Q5: Wie wähle ich zwischen MiMo V2 Pro, Flash und Omni?

Wählen Sie nach Bedarf: Für reine Text-Inferenzaufgaben wählen Sie Pro ($1/$3, stärkste Inferenz); für extrem niedrige Preise oder lokale Bereitstellung wählen Sie Flash ($0,09/$0,29, Open Source und selbst hostbar); für die Verarbeitung von Bildern, Videos oder Audio wählen Sie Omni ($0,40/$2,00). Über APIYI (apiyi.com) können Sie alle drei Modelle mit einem einzigen API-Schlüssel aufrufen.

Fazit: Xiaomis KI-Ambitionen sind nicht zu unterschätzen

Die Veröffentlichung der MiMo V2-Serie markiert den offiziellen Aufstieg Xiaomis vom "Smartphone-Hersteller, der KI macht" zu einem "globalen KI-Vorreiter". Die anonyme Einführung von Hunter Alpha war eine lehrbuchartige Produktveröffentlichung – erst durch Leistung überzeugen, dann die Identität enthüllen.

3 Kernpunkte:

- MiMo V2 Pro ist das derzeit kosteneffizienteste Inferenzmodell: Agentenfähigkeiten weltweit auf Platz 3, Codierung übertrifft Sonnet 4.6, Preis bei nur 1/25 von Opus.

- Die multimodalen Fähigkeiten von MiMo V2 Omni sind bemerkenswert: Die 10-stündige Audioverarbeitung ist ein echter Alleinstellungsmerkmal.

- Die Umsetzungsstärke des Xiaomi KI-Teams ist beeindruckend: Von Null auf ein Billionen-Parameter-Modell in weniger als einem Jahr; das Kernteam stammt von DeepSeek.

Wir empfehlen, die gesamte MiMo V2-Serie über APIYI (apiyi.com) zu testen, um KI-Inferenzleistung auf Top-Niveau zu den branchenweit niedrigsten Preisen zu erhalten.

Referenzen

-

Offizielle Seite des Xiaomi MiMo V2 Pro: Technische Spezifikationen und Benchmark-Daten

- Link:

mimo.xiaomi.com/mimo-v2-pro

- Link:

-

Artificial Analysis: Benchmark-Bewertung des MiMo V2 Pro

- Link:

artificialanalysis.ai/models/mimo-v2-pro

- Link:

-

VentureBeat: Bericht zur Veröffentlichung des Xiaomi MiMo V2 Pro

- Link:

venturebeat.com

- Link:

-

OpenRouter: Preisgestaltung und API-Informationen für das MiMo V2-Modell

- Link:

openrouter.ai

- Link:

Autor: APIYI Team | Wir stellen die neuesten KI-Modelle sofort bereit. Besuchen Sie APIYI unter apiyi.com, um die gesamte Xiaomi MiMo V2-Modellreihe zu testen.