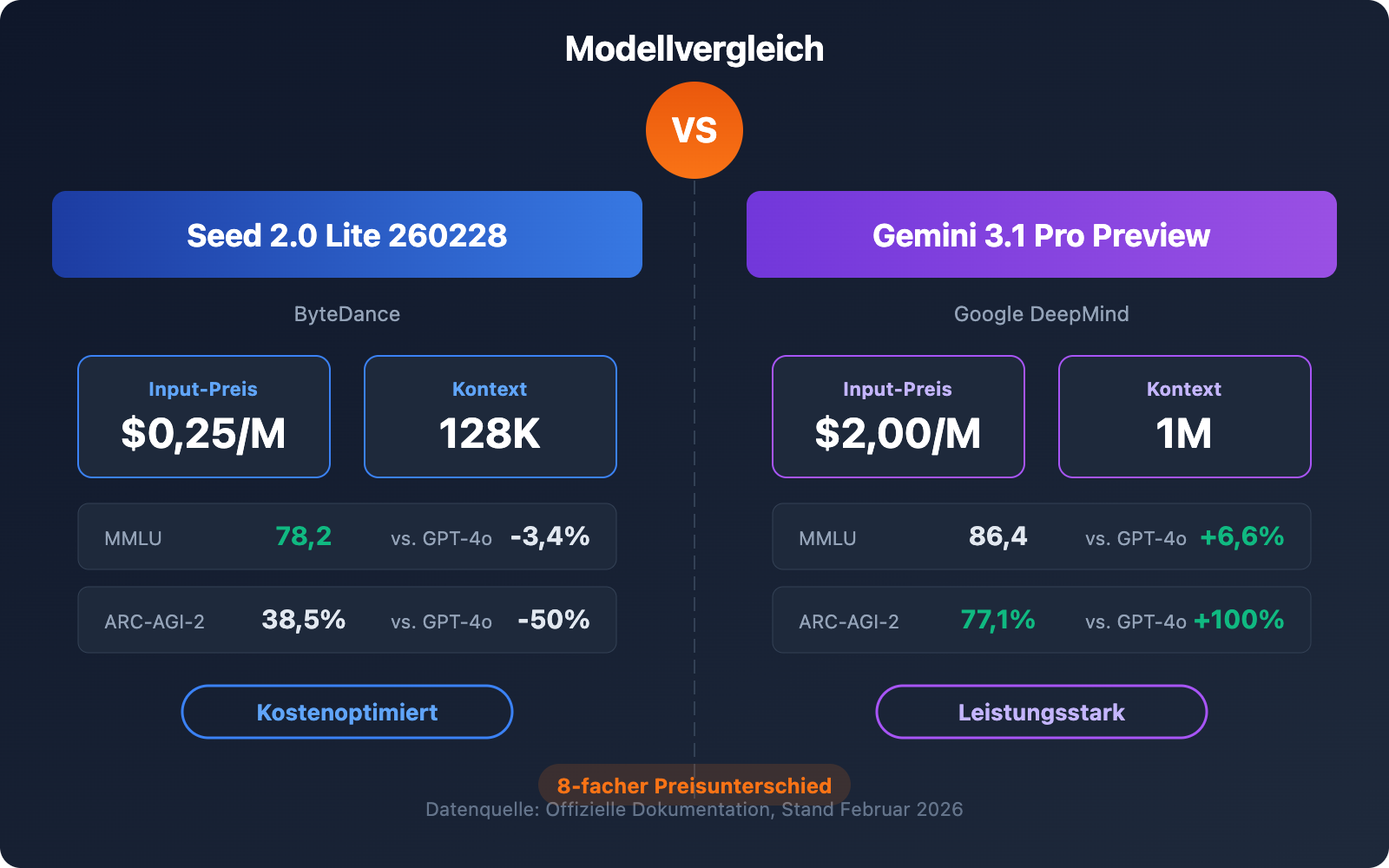

Anmerkung des Autors: Seed 2.0 Lite 260228 kostet nur $0,25/M Tokens für Input. Gemini 3.1 Pro Preview bietet ein 1M-Kontextfenster und 77,1 % Reasoning-Fähigkeit im ARC-AGI-2-Benchmark. Dieser Artikel vergleicht die beiden Modelle in 6 Dimensionen: Benchmark-Leistung, Preisgestaltung, Kontextfenster und mehr.

Im Februar 2026 kamen zwei Modelle mit völlig unterschiedlichen Positionierungen auf den Markt. ByteDances Seed 2.0 Lite 260228 wurde über den offiziellen BytePlus-Proxy-Dienst veröffentlicht und setzt auf maximales Preis-Leistungs-Verhältnis. Google DeepMinds Gemini 3.1 Pro Preview stellte mit einer Verdoppelung der Reasoning-Fähigkeiten im ARC-AGI-2-Benchmark einen neuen Rekord auf.

Kernaussage: Nach diesem Artikel wissen Sie, ob Sie Seed 2.0 Lite 260228 oder Gemini 3.1 Pro Preview für Ihre spezifischen Anwendungsfälle wählen sollten und wie Sie die optimale Lösung im Spannungsfeld des 8-fachen Preisunterschieds finden.

Kernunterschiede: Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro Preview

| Dimension | Seed 2.0 Lite 260228 | Gemini 3.1 Pro Preview | Unterschiedsanalyse |

|---|---|---|---|

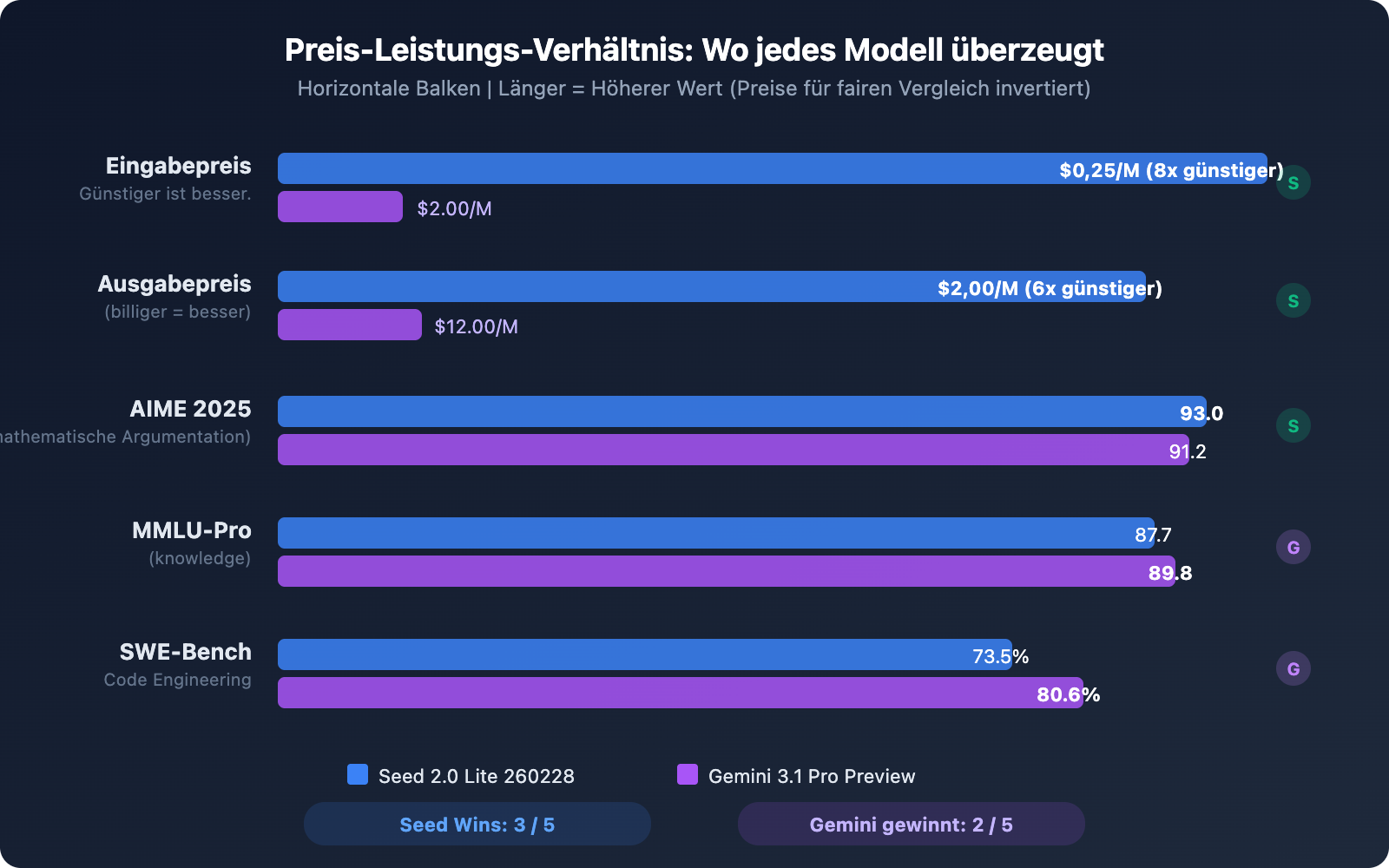

| Eingabepreis | $0,25/M Tokens | $2,00/M Tokens | Seed ist 8x günstiger |

| Ausgabepreis | $2,00/M Tokens | $12,00/M Tokens | Seed ist 6x günstiger |

| Kontextfenster | 256K Tokens | 1M Tokens | Gemini ist 4x größer |

| AIME 2025 | 93,0 | 91,2 | Seed leicht besser |

| MMLU-Pro | 87,7 | 89,8 | Gemini leicht besser |

| SWE-Bench Verified | 73,5% | 80,6% | Gemini führt um 7 Punkte |

Unterschiede in der Positionierung: Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro

Die Positionierung dieser beiden Modelle unterscheidet sich grundlegend. Seed 2.0 Lite 260228 ist ein Mittelklassemodell der Seed 2.0-Serie von ByteDance und zielt auf ein kosteneffizientes, universelles Modell für den Produktionseinsatz ab. Gemini 3.1 Pro Preview hingegen ist das Flaggschiffmodell von Google DeepMind und bietet eine deutliche Verbesserung der Schlussfolgerungsfähigkeiten gegenüber Gemini 3 Pro.

Preislich betrachtet sind die Eingabekosten von Seed 2.0 Lite nur ein Achtel der Kosten von Gemini 3.1 Pro. Gemini 3.1 Pro bietet jedoch ein 4-mal größeres Kontextfenster und stärkere Fähigkeiten im Bereich Softwareentwicklung. Die Wahl des Modells hängt letztendlich von den spezifischen Anforderungen Ihrer Anwendung an Kosten und Leistungsfähigkeit ab.

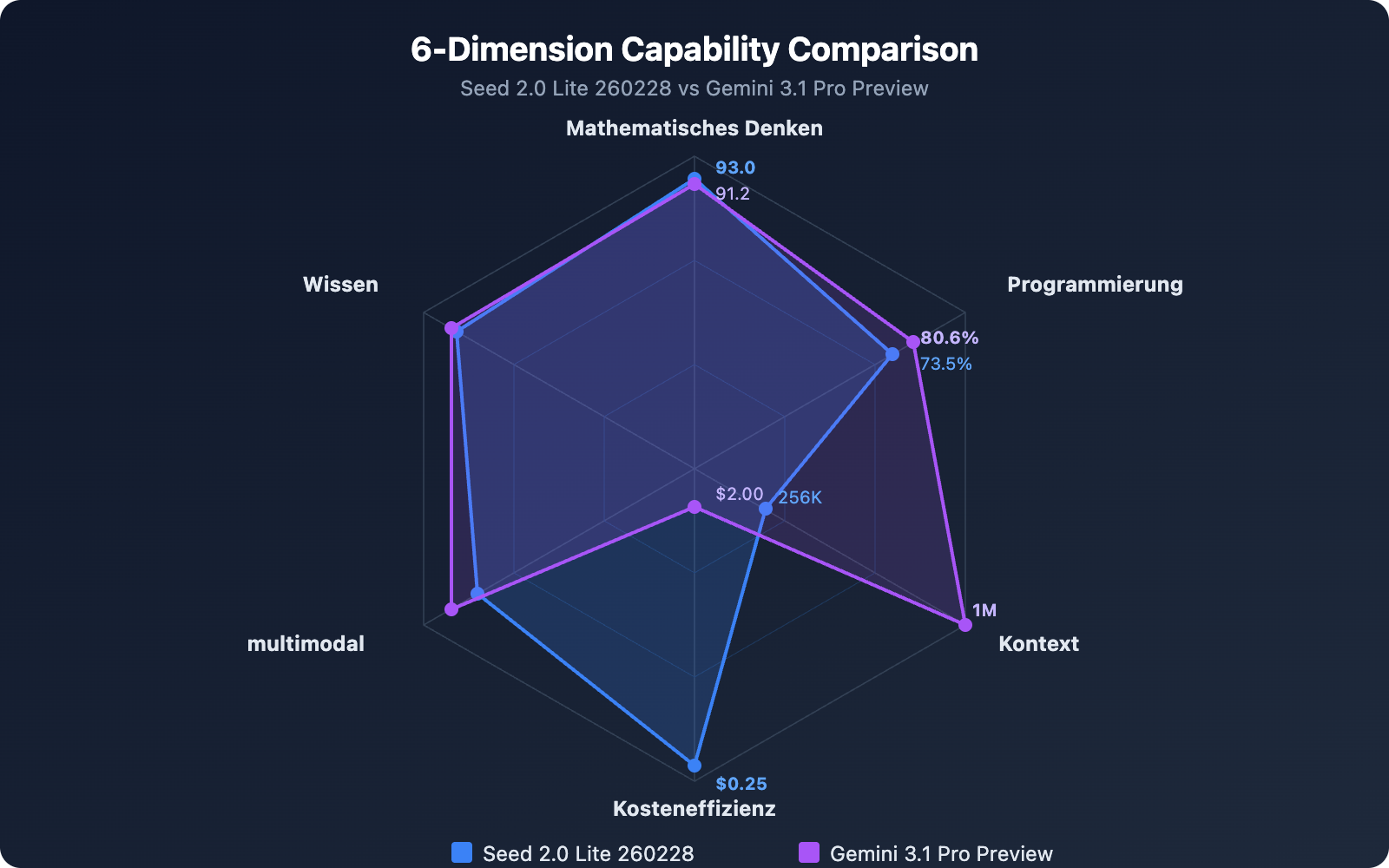

Vergleich der Benchmark-Tests: Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro Preview

Vergleich der mathematischen Denkfähigkeit

Im AIME 2025 Benchmark-Test für mathematisches Denken erzielte Seed 2.0 Lite 260228 eine Punktzahl von 93,0 und lag damit knapp vor Gemini 3.1 Pro Preview mit 91,2. Dieses Ergebnis ist durchaus überraschend – ein Modell im mittleren Preissegment übertrifft ein Flaggschiff-Modell in mathematischem Denken.

Es ist erwähnenswert, dass Seed 2.0 Pro (die Flaggschiff-Version) bei AIME 2025 98,3 Punkte erreicht, was zeigt, dass die Seed-Serie von ByteDance über fundierte technische Expertise im Bereich des mathematischen Denkens verfügt, von der auch die Lite-Version profitiert.

Vergleich der Wissensverständnisfähigkeit

MMLU-Pro ist ein Kern-Benchmark zur Messung des umfassenden Wissensverständnisses eines Modells. Gemini 3.1 Pro Preview erzielte in diesem Test 89,8 Punkte und liegt damit etwa 2 Prozentpunkte vor Seed 2.0 Lite 260228 mit 87,7. Der Unterschied ist gering, beide Modelle bewegen sich auf einem ähnlichen Niveau.

Vergleich der Programmierfähigkeit

Die Programmierfähigkeit ist der Bereich mit dem deutlichsten Unterschied zwischen den beiden Modellen.

Gemini 3.1 Pro Preview zeigt mit 80,6 % auf SWE-Bench Verified und einer LiveCodeBench Pro Elo-Bewertung von 2887 hervorragende Leistungen. Seed 2.0 Lite 260228 erzielt 73,5 % auf SWE-Bench Verified und eine Codeforces-Bewertung von 2233.

Bei praktischen Software-Engineering-Aufgaben (SWE-Bench) liegt Gemini 3.1 Pro etwa 7 Prozentpunkte vorn – ein Unterschied, der für code-intensive Projekte durchaus relevant ist.

Vollständiger Benchmark-Vergleich: Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro Preview

| Benchmark-Test | Seed 2.0 Lite 260228 | Gemini 3.1 Pro Preview | Vorteil bei |

|---|---|---|---|

| AIME 2025 | 93.0 | 91.2 | Seed Lite |

| MMLU-Pro | 87.7 | 89.8 | Gemini |

| SWE-Bench Verified | 73.5% | 80.6% | Gemini |

| Codeforces / LiveCodeBench | 2233 | 2887 Elo | Gemini |

| ARC-AGI-2 | – | 77.1% | Gemini |

| GPQA Diamond | – | 94.3% | Gemini |

Insgesamt ist Gemini 3.1 Pro Preview in den Bereichen Programmierung und Denkfähigkeit insgesamt stärker, insbesondere bei den Leistungen in ARC-AGI-2 und SWE-Bench. Seed 2.0 Lite 260228 hingegen übertrifft in mathematischem Denken (AIME) und zeigt nur einen geringen Abstand im Wissensverständnis (MMLU-Pro).

Auswahl-Empfehlung: Wenn Ihre Kernanforderungen Code-Engineering und komplexes Denken sind, bietet Gemini 3.1 Pro mit 80,6 % auf SWE-Bench mehr Sicherheit. Bei begrenztem Budget, aber dem Bedarf an umfassenden allgemeinen Fähigkeiten, bietet Seed 2.0 Lite für ein Achtel des Preises 90 % der mathematischen Denkfähigkeit. Über die Plattform APIYI (apiyi.com) können Sie beide Modelle parallel aufrufen, um ihre tatsächliche Leistung in Ihrem spezifischen Anwendungsfall schnell zu vergleichen.

Preisvergleich: Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro Preview

Die Preisgestaltung ist der größte Unterschied zwischen diesen beiden Modellen. Hier ist der vollständige Kostenvergleich:

Vergleich der Staffelpreise: Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro Preview

| Preis-Dimension | Seed 2.0 Lite 260228 | Gemini 3.1 Pro Preview |

|---|---|---|

| Eingabe (Standard-Bereich) | $0,25/M Tokens (0-128K) | $2,00/M Tokens (0-200K) |

| Eingabe (Langtext-Bereich) | $0,50/M Tokens (128K-256K) | $4,00/M Tokens (200K-1M) |

| Ausgabe (Standard-Bereich) | $2,00/M Tokens (0-128K) | $12,00/M Tokens (0-200K) |

| Ausgabe (Langtext-Bereich) | $4,00/M Tokens (128K-256K) | $18,00/M Tokens (200K-1M) |

| Abrechnungsmodell | Nutzungsbasierte Bezahlung (Chat) | Nutzungsbasierte Bezahlung |

| Gratis-Kontingent | Für neue BytePlus-Nutzer | Kostenlose Stufe in Google AI Studio |

Simulation der tatsächlichen Kosten: Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro Preview

Hier sind die geschätzten monatlichen Kosten für verschiedene Nutzungsszenarien:

| Nutzungsszenario | Monatliches Aufrufvolumen | Kosten Seed 2.0 Lite 260228 | Kosten Gemini 3.1 Pro Preview | Ersparnis |

|---|---|---|---|---|

| Leichte Nutzung (tägliche Konversation) | 10M in + 5M out | $12,50 | $80,00 | 84% |

| Mittlere Nutzung (Dokumentenverarbeitung) | 50M in + 20M out | $52,50 | $340,00 | 85% |

| Intensive Nutzung (Code-Generierung) | 200M in + 100M out | $250,00 | $1.600,00 | 84% |

In allen Nutzungsstufen liegen die Kosten für Seed 2.0 Lite 260228 etwa 84-85 % unter denen von Gemini 3.1 Pro Preview. Für einzelne Entwickler und kleine Teams mit einem monatlichen API-Budget unter 100 US-Dollar ist der Kostenvorteil von Seed 2.0 Lite sehr deutlich.

Kostenoptimierungs-Empfehlung: Eine gemischte Nutzung beider Modelle ist die optimale Strategie. Übergeben Sie tägliche Konversationen und Dokumentenverarbeitung an Seed 2.0 Lite und komplexes Code-Engineering sowie tiefgreifendes Denken an Gemini 3.1 Pro. Die APIYI-Plattform (apiyi.com) unterstützt den Aufruf beider Modelle über eine einheitliche Schnittstelle. Ein Wechsel ist durch Änderung des

model-Parameters möglich, ohne dass zwei separate SDKs gepflegt werden müssen.

Seed 2.0 Lite 260228 vs Gemini 3.1 Pro Preview Schnellstart

Minimalistisches Beispiel — Zwei Modelle über eine einheitliche Schnittstelle nutzen

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI einheitliche Schnittstelle

)

# Seed 2.0 Lite 260228 aufrufen (für kostengünstige Alltagsaufgaben)

response = client.chat.completions.create(

model="seed-2-0-lite-260228",

messages=[{"role": "user", "content": "Fasse die Kernpunkte dieses Berichts zusammen"}]

)

print("Seed Lite:", response.choices[0].message.content)

# Gemini 3.1 Pro Preview aufrufen (für komplexe Denkaufgaben)

response = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "Analysiere die Sicherheitslücken in diesem Code und schlage Lösungen vor"}]

)

print("Gemini Pro:", response.choices[0].message.content)

Vollständigen Vergleichscode anzeigen (mit Zeit- und Kostenberechnung)

import openai

import time

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

MODELS = {

"seed-2-0-lite-260228": {"input_price": 0.25, "output_price": 2.00},

"gemini-3.1-pro-preview": {"input_price": 2.00, "output_price": 12.00},

}

def compare_models(prompt: str, system_prompt: str = None):

"""Vergleicht Antwortqualität, Geschwindigkeit und Kosten zweier Modelle"""

results = {}

for model_name, pricing in MODELS.items():

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

start = time.time()

response = client.chat.completions.create(

model=model_name,

messages=messages,

max_tokens=2000

)

elapsed = time.time() - start

usage = response.usage

cost = (usage.prompt_tokens * pricing["input_price"]

+ usage.completion_tokens * pricing["output_price"]) / 1_000_000

results[model_name] = {

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": f"{usage.prompt_tokens}+{usage.completion_tokens}",

"cost": f"${cost:.6f}"

}

for name, r in results.items():

print(f"\n{'='*50}")

print(f"Modell: {name}")

print(f"Zeit: {r['time']} | Tokens: {r['tokens']} | Kosten: {r['cost']}")

print(f"Antwort: {r['content'][:200]}...")

compare_models("Erkläre die Zeitkomplexitätsanalyse des Quicksort-Algorithmus")

Schnellstart: Über die APIYI-Plattform apiyi.com können Sie mit einem einzigen API-Schlüssel sowohl Seed 2.0 Lite als auch Gemini 3.1 Pro aufrufen und sparen sich die separate Registrierung bei BytePlus und Google Cloud. Die Plattform bietet kostenloses Testguthaben, der Anschluss ist in 5 Minuten erledigt.

Seed 2.0 Lite 260228 vs. Gemini 3.1 Pro Preview: Einsatzempfehlungen

Aufgrund der unterschiedlichen Fähigkeiten und Preismodelle der beiden Modelle, hier Empfehlungen für verschiedene Anwendungsfälle:

Szenarien für Seed 2.0 Lite 260228:

- Alltagsdialoge und Kundenservice-Systeme: Geringe Kosten von $0.25/M Tokens, ideal für hochfrequente Aufrufe.

- Dokumentenzusammenfassung und Informationsextraktion: Die Werte AIME 93.0 und MMLU-Pro 87.7 zeigen ausreichendes Wissensverständnis.

- Budgetbewusste Startup-Projekte: Monatliche Kosten betragen nur 15-16% der Kosten von Gemini.

- Multimodale Inhaltsverständnis: Unterstützt Text-, Bild- und Videoeingaben, 256K Kontextfenster deckt die meisten Anforderungen ab.

- Batch-Datenverarbeitung: Der niedrige Stückpreis macht die Gesamtkosten für die Verarbeitung großer Datenmengen kalkulierbar.

Szenarien für Gemini 3.1 Pro Preview:

- Komplexe Code-Engineering-Aufgaben: SWE-Bench 80.6% bietet mehr Zuverlässigkeit bei realen Entwicklungsaufgaben.

- Analyse extrem langer Dokumente: 1M Tokens Kontextfenster ermöglicht die Verarbeitung ganzer Bücher oder großer Codebasen.

- Anspruchsvolle Reasoning-Aufgaben: ARC-AGI-2 77.1% und GPQA Diamond 94.3% repräsentieren Spitzenleistungen im logischen Schlussfolgern.

- Aufgaben, die tiefgehendes Denken erfordern: Der

thinking_level-Parameter unterstützt vier Stufen (low/medium/high/max). - Code-Sicherheitsaudits: LiveCodeBench Pro 2887 Elo zeigt wettbewerbsfähige Programmierfähigkeiten.

Praxis-Tipp: Die beste Vorgehensweise ist ein gemischter Einsatz beider Modelle. Die Plattform APIYI (apiyi.com) unterstützt einen einheitlichen API-Endpunkt. Sie können auf Anwendungsebene Anfragen basierend auf der Aufgabenkomplexität automatisch an das geeignete Modell weiterleiten, um so das optimale Gleichgewicht zwischen Leistung und Kosten zu erreichen.

Häufig gestellte Fragen

F1: Seed 2.0 Lite 260228 übertrifft Gemini 3.1 Pro im mathematischen Reasoning. Warum sollte man dann überhaupt Gemini wählen?

AIME 2025 ist nur eine Dimension des mathematischen Reasonings. Gemini 3.1 Pro zeigt seine Stärken in anderen Bereichen: ARC-AGI-2 (77.1%) testet die Fähigkeit, völlig neue logische Muster zu erschließen, und GPQA Diamond (94.3%) prüft wissenschaftliches Reasoning auf Postgraduierten-Niveau. Darüber hinaus ist die praktische Code-Engineering-Fähigkeit von SWE-Bench 80.6% für viele Entwickler ein entscheidendes Kriterium. Wenn Ihr Anwendungsfall mathematische Berechnungen betont, ist Seed Lite tatsächlich kosteneffizienter. Liegt der Schwerpunkt auf komplexem Reasoning und Code, ist Gemini die bessere Wahl.

F2: Ist der 8-fache Preisunterschied gerechtfertigt? Wann sollte man das teurere Gemini 3.1 Pro wählen?

Die Wahl von Gemini lohnt sich, wenn folgende Bedingungen zutreffen: (1) Eine einzelne Aufgabe erfordert die Verarbeitung von mehr als 256K Tokens Eingabe. (2) Es wird eine Code-Engineering-Zuverlässigkeit auf SWE-Bench 80%+-Niveau benötigt. (3) Die Aufgabe stellt extrem hohe Anforderungen an die Tiefe des Reasonings (erfordert thinking_level=max). Für die meisten alltäglichen API-Aufrufe ist die Leistung von Seed 2.0 Lite völlig ausreichend. Der 8-fache Kostenunterschied bedeutet, dass Sie mit demselben Budget die 8-fache Anzahl an Aufrufen tätigen können. Über APIYI (apiyi.com) können Sie flexibel zwischen den Modellen wechseln und müssen sich nicht für eines entscheiden.

F3: Wie kann ich schnell die Leistung beider Modelle für meinen spezifischen Anwendungsfall vergleichen?

Der schnellste Weg:

- Besuchen Sie APIYI (apiyi.com), registrieren Sie ein Konto und erhalten Sie einen einheitlichen API-Schlüssel.

- Verwenden Sie den in diesem Artikel bereitgestellten Vergleichstest-Code und geben Sie Ihre tatsächlichen Geschäfts-Eingabeaufforderungen ein.

- Vergleichen Sie Antwortqualität, Geschwindigkeit und Kosten der beiden Modelle und wählen Sie das passendste aus.

Zusammenfassung

Kernaussagen zum Vergleich Seed 2.0 Lite 260228 vs Gemini 3.1 Pro Preview:

- Preisunterschied 8-fach: Seed Lite Eingabe $0,25/M vs Gemini $2,00/M, Ausgabe $2,00/M vs $12,00/M. Mit gleichem Budget sind 6-8 Mal mehr Aufrufe mit Seed möglich.

- Mathematisches Denken: Seed leicht vorne: Bei AIME 2025 erreicht Seed Lite 93,0 und übertrifft damit Gemini mit 91,2 – Flaggschiff-Niveau zu mittlerem Preis.

- Code-Engineering: Gemini führt: SWE-Bench 80,6 % vs 73,5 %, LiveCodeBench 2887 vs Codeforces 2233. Gemini ist bei realen Entwicklungsaufgaben zuverlässiger.

- Kontext: Gemini dominiert: 1M vs 256K. Gemini eignet sich ideal für die Analyse extrem langer Dokumente und großer Codebasen.

- Beste Strategie: Kombinierter Einsatz: Alltagsaufgaben mit Seed Lite für Kosteneffizienz, komplexe Denkaufgaben mit Gemini für Qualitätssicherung.

Empfehlung: Beide Modelle über APIYI (apiyi.com) einheitlich anbinden. Die Plattform bietet kostenloses Guthaben und eine OpenAI-kompatible Schnittstelle. Mit einem einzigen API-Schlüssel können Sie frei zwischen den Modellen wechseln.

Referenzen

-

ByteDance Seed 2.0 Offizielle Einführung: Fähigkeiten und Benchmark-Daten der Seed 2.0 Modellserie

- Link:

seed.bytedance.com/en/seed2 - Beschreibung: Technische Spezifikationen und Testergebnisse der gesamten Pro/Lite/Mini-Serie

- Link:

-

Google Gemini 3.1 Pro Offizieller Blog: Veröffentlichungsinformationen und detaillierte Fähigkeitsbeschreibung von Gemini 3.1 Pro

- Link:

blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro/ - Beschreibung: Kern-Benchmark-Ergebnisse (z.B. ARC-AGI-2, SWE-Bench) und Funktionsmerkmale

- Link:

-

Gemini 3.1 Pro Model Card: Offizielle Model Card von Google DeepMind

- Link:

deepmind.google/models/model-cards/gemini-3-1-pro/ - Beschreibung: Detaillierte technische Spezifikationen, Sicherheitsbewertungen und Nutzungsrichtlinien

- Link:

-

BytePlus ModelArk Preisgestaltung: Offizielle API-Preise für Seed-Modelle

- Link:

docs.byteplus.com/en/docs/ModelArk/1544106 - Beschreibung: Details zur Staffelpreisgestaltung und Preislisten für alle Modelle

- Link:

-

Artificial Analysis – Modellvergleich: Unabhängige Drittanbieter-Evaluierungsplattform

- Link:

artificialanalysis.ai/models/gemini-3-1-pro-preview - Beschreibung: Umfassende Analysedaten zu Leistung, Preis und Latenz

- Link:

Autor: APIYI Technikteam

Technischer Austausch: Teilen Sie gerne Ihre Erfahrungen mit Seed 2.0 Lite und Gemini 3.1 Pro in den Kommentaren. Weitere Modellvergleichsleitfäden finden Sie im APIYI Dokumentationszentrum unter docs.apiyi.com.