Anmerkung des Autors: GPT-5.4 ist offiziell das neue Flaggschiff-Modell von OpenAI. Es bietet native Computersteuerung, die menschliche Benchmarks übertrifft, ein Kontextfenster von einer Million Token, integrierte Codex-Programmierfähigkeiten und eine um 33 % reduzierte Halluzinationsrate. Dieser Artikel analysiert die technischen Details, Bewertungsdaten und die Auswirkungen der Stilllegung von GPT-4o.

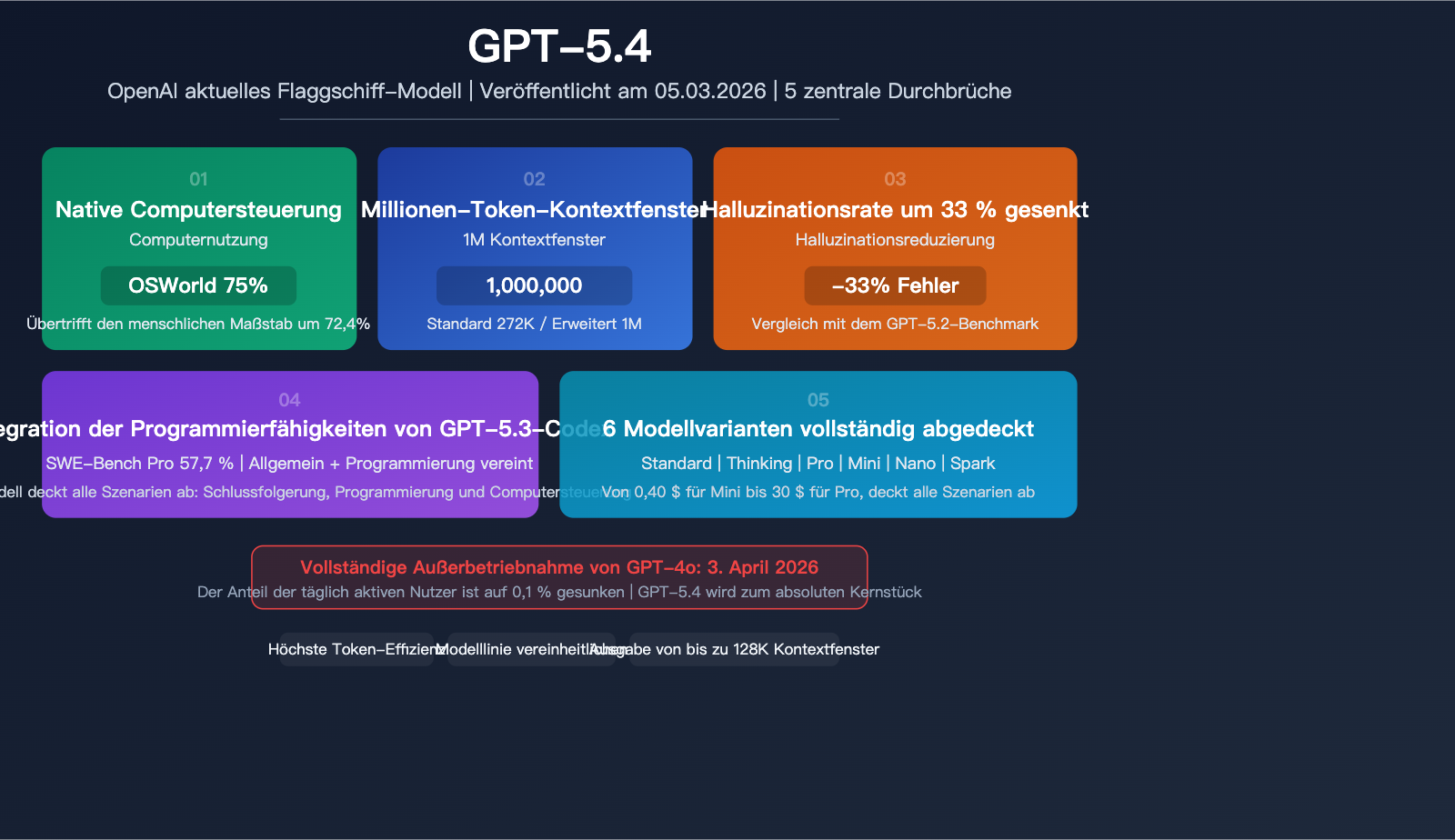

Am 5. März 2026 hat OpenAI offiziell GPT-5.4 veröffentlicht. Dies ist das erste einheitliche Flaggschiff-Modell, das native Computersteuerung, ein Kontextfenster von einer Million Token und Codex-Programmierfähigkeiten integriert. Gleichzeitig wird GPT-4o am 3. April vollständig eingestellt, was das Ende einer Ära markiert. Dieser Artikel analysiert die fünf zentralen Durchbrüche von GPT-5.4 anhand der drei Dimensionen technische Architektur, Bewertungsdaten und praktische Anwendung.

Kernwert: Erfahren Sie in 5 Minuten alles über die Kernfähigkeiten von GPT-5.4, die Preisgestaltung, den Vergleich mit Wettbewerbern und die Migrationsstrategie nach der Stilllegung von GPT-4o.

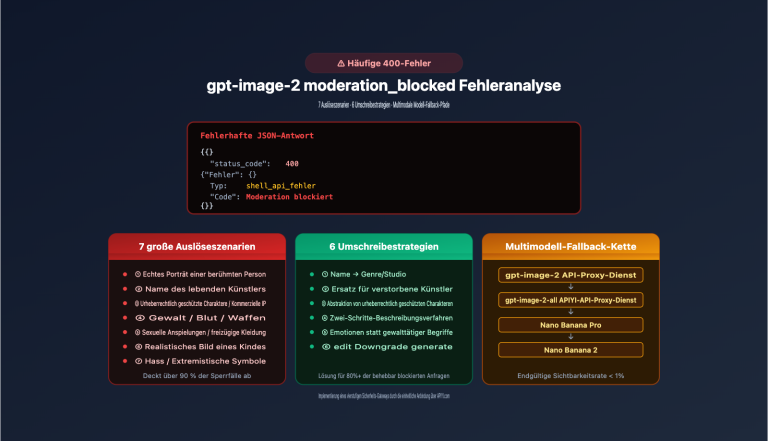

GPT-5.4 Kerninformationen auf einen Blick

| Informationspunkt | Details |

|---|---|

| Veröffentlichungsdatum | 5. März 2026 |

| Herausgeber | OpenAI |

| Positionierung | Aktuelles Flaggschiff-Modell, ersetzt die GPT-5.2-Serie |

| Kern-Durchbrüche | Native Computersteuerung, 1 Million Token Kontext, Codex-Integration |

| Halluzinationsrate | 33 % niedriger als bei GPT-5.2 |

| OSWorld-Bewertung | 75 % (übertrifft den menschlichen Benchmark von 72,4 %) |

| SWE-Bench Pro | 57,7 % (übertrifft die 56,8 % von GPT-5.3-Codex) |

| Modellvarianten | Standard / Thinking / Pro / Mini / Nano / Spark |

| Einstellung GPT-4o | Vollständige Einstellung am 3. April 2026 |

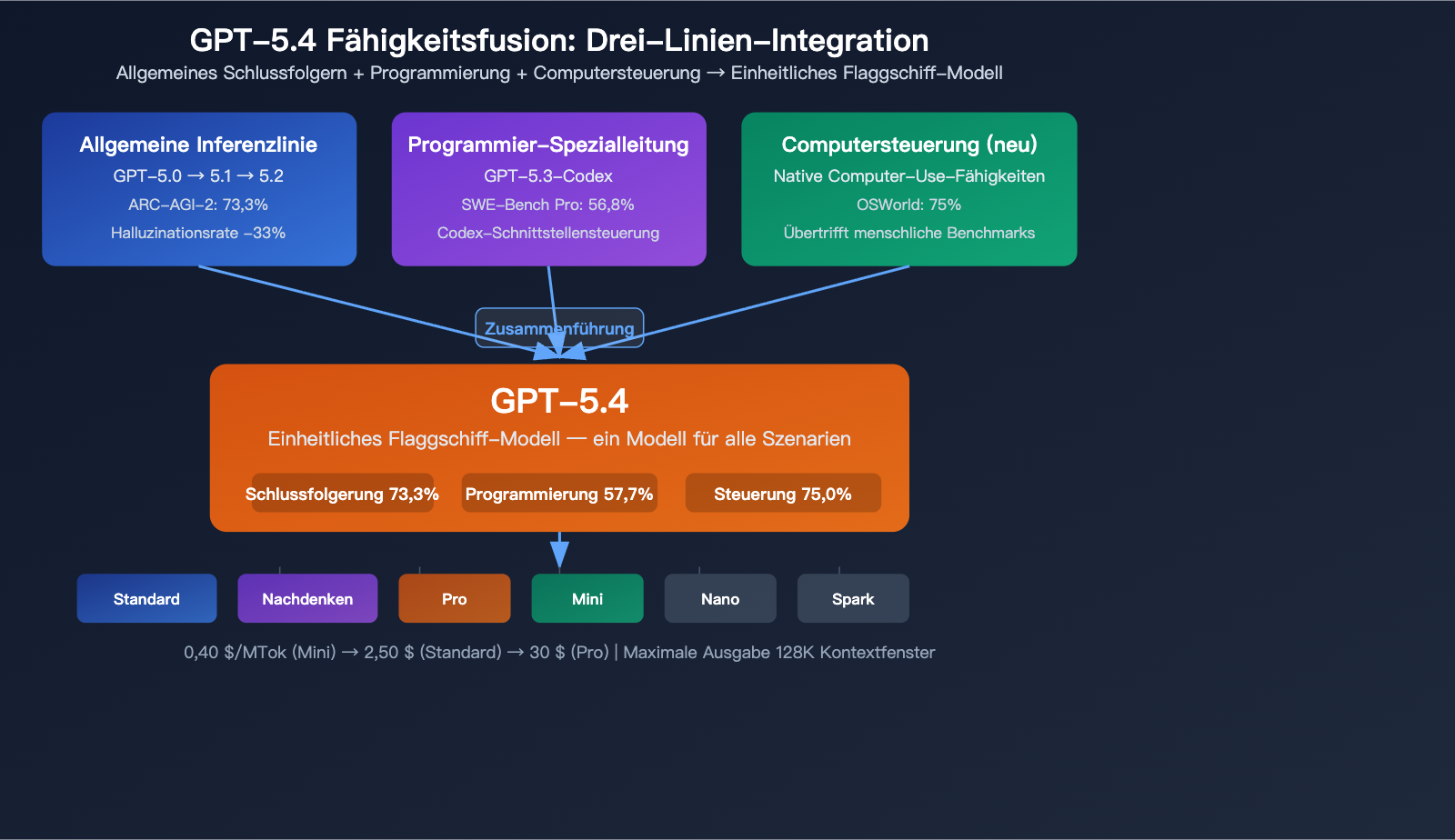

Die historische Einordnung von GPT-5.4

GPT-5.4 ist kein gewöhnliches Versions-Update, sondern eine bedeutende Zusammenführung der OpenAI-Modellreihe. Zuvor unterhielt OpenAI zwei separate Modelllinien: allgemeine Schlussfolgerung (GPT-5.x) und spezialisierte Programmierung (GPT-5.3-Codex). GPT-5.4 vereint diese beiden Linien erstmals zu einem einheitlichen Flaggschiff-Modell – es ist sowohl das leistungsfähigste Modell für allgemeine Schlussfolgerungen als auch das stärkste Programmiermodell und zudem das erste Modell mit nativer Computersteuerung.

Das bedeutet für Entwickler, dass sie nicht mehr zwischen „GPT-5.2 für Schlussfolgerungen“ und „Codex für Programmierung“ hin- und herwechseln müssen. Ein einziges GPT-5.4-Modell deckt alle Szenarien ab.

Die fünf Kerndurchbrüche von GPT-5.4 im Detail

Durchbruch 1: Native Computersteuerung (Computer Use)

Die auffälligste neue Fähigkeit von GPT-5.4 ist die native Computersteuerung (Computer Use). Dies wird nicht durch Plugins oder externe Tools erreicht, sondern ist eine direkt in das Modell integrierte Funktion – GPT-5.4 kann Bildschirminhalte direkt erfassen, die Maus bewegen, auf Schaltflächen klicken und Text eingeben, um komplexe Arbeitsabläufe wie ein Mensch am Computer auszuführen.

| Bewertungs-Benchmark | GPT-5.4 | Menschlicher Experten-Benchmark | Bewertung |

|---|---|---|---|

| OSWorld-Verified | 75,0 % | 72,4 % | Übertrifft Menschen |

Im OSWorld-Verified-Benchmark erreichte GPT-5.4 75 % und übertraf damit erstmals den menschlichen Experten-Benchmark (72,4 %). Dies bedeutet, dass GPT-5.4 bei der automatisierten Ausführung praktischer Aufgaben am Computer zuverlässiger ist als ein durchschnittlicher menschlicher Experte.

Zu den praktischen Einsatzszenarien dieser Fähigkeit gehören:

- Automatisierte Büroabläufe: Automatische Dateneingabe und Berichterstellung in Excel, CRM, ERP usw.

- Anwendungsübergreifende Workflows: Informationen aus E-Mails extrahieren, Aufgaben in Projektmanagement-Tools erstellen und die entsprechenden Personen benachrichtigen.

- Web-Automatisierung: Automatisches Surfen auf Webseiten, Ausfüllen von Formularen und Einreichen von Anträgen.

- Softwaretests: Automatisierte GUI-Bedienung für End-to-End-Tests.

Durchbruch 2: 1 Million Token Kontextfenster

Das Kontextfenster von GPT-5.4 wurde auf 1 Million Token (API-Modus) erweitert, im Standardmodus sind es 272K Token. Dies ermöglicht es dem Modell, extrem lange Dokumente, vollständige Code-Bibliotheken und komplexe, mehrstufige Agenten-Aufgaben zu verarbeiten.

| Kontextmodus | Kapazität | Einsatzszenario |

|---|---|---|

| Standardmodus | 272K Token | Tägliche Konversationen und allgemeine Aufgaben |

| Erweiterter Modus | 1M Token | Analyse langer Dokumente, Code-Bibliotheken |

| Maximale Ausgabe | 128K Token | Generierung langer Texte |

Der Kernwert des 1-Million-Token-Kontexts liegt in der Unterstützung langfristiger Agenten-Planung – das Modell kann einen vollständigen Kreislauf aus Planung, Ausführung und Validierung in einer einzigen Sitzung abschließen, ohne wichtige Informationen durch Kontextüberlauf zu verlieren.

Durchbruch 3: 33 % geringere Halluzinationsrate

OpenAI hat bei GPT-5.4 eine signifikante Verbesserung der faktischen Genauigkeit erzielt:

- Fehlerrate bei Einzelaussagen: 33 % niedriger als bei GPT-5.2

- Gesamtfehlerrate bei Antworten: 18 % niedriger als bei GPT-5.2

Dies macht GPT-5.4 bei faktischen Anfragen deutlich zuverlässiger. Für Unternehmensanwendungen, medizinische Beratung, Rechtsanalysen und andere Szenarien mit hohen Genauigkeitsanforderungen ist dies ein entscheidender Fortschritt.

Durchbruch 4: Integration der GPT-5.3-Codex-Programmierfähigkeiten

GPT-5.4 enthält alle Programmierfähigkeiten von GPT-5.3-Codex und baut diese weiter aus:

| Programmier-Benchmark | GPT-5.4 | GPT-5.3-Codex | Veränderung |

|---|---|---|---|

| SWE-Bench Pro | 57,7 % | 56,8 % | +0,9 % |

| SWE-Bench Verified | ~80 % | – | Spitzenwert |

GPT-5.4 erzielte bei SWE-Bench Pro 57,7 % und übertraf damit leicht die 56,8 % von GPT-5.3-Codex. Das bedeutet, dass Sie kein separates Codex-Modell mehr für Programmieraufgaben benötigen – GPT-5.4 deckt Schlussfolgerungen, Programmierung und Computersteuerung in einem Modell ab.

Die Codex-Schnittstelle bleibt bestehen, wird jedoch nun von GPT-5.4 angetrieben.

Durchbruch 5: Intelligente Werkzeugsuche (Tool Search)

GPT-5.4 führt die Fähigkeit zur Werkzeugsuche ein, die es dem Modell ermöglicht, automatisch das am besten geeignete Werkzeug in einem umfangreichen Ökosystem zu entdecken und aufzurufen, ohne dass Menschen jeden Zugriff manuell konfigurieren müssen. Dies erhöht die Autonomie von Agenten in komplexen Arbeitsabläufen erheblich.

🎯 Empfehlung für Entwickler: Diese Durchbrüche von GPT-5.4 bedeuten, dass Sie alle Szenarien – Schlussfolgerung, Programmierung und Automatisierung – mit einem einzigen Modell abdecken können. Über die Plattform APIYI (apiyi.com) können Sie mit einem einzigen API-Schlüssel alle Varianten von GPT-5.4 aufrufen und gleichzeitig zu Konkurrenzmodellen wie Claude oder Gemini wechseln, um die Ergebnisse zu vergleichen.

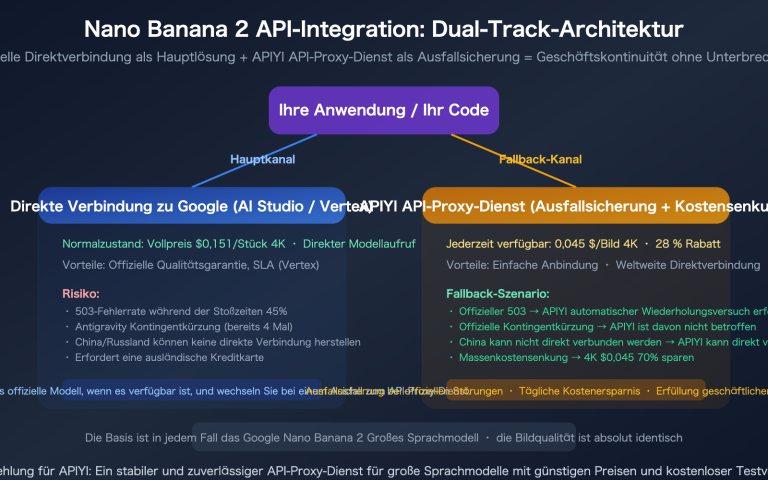

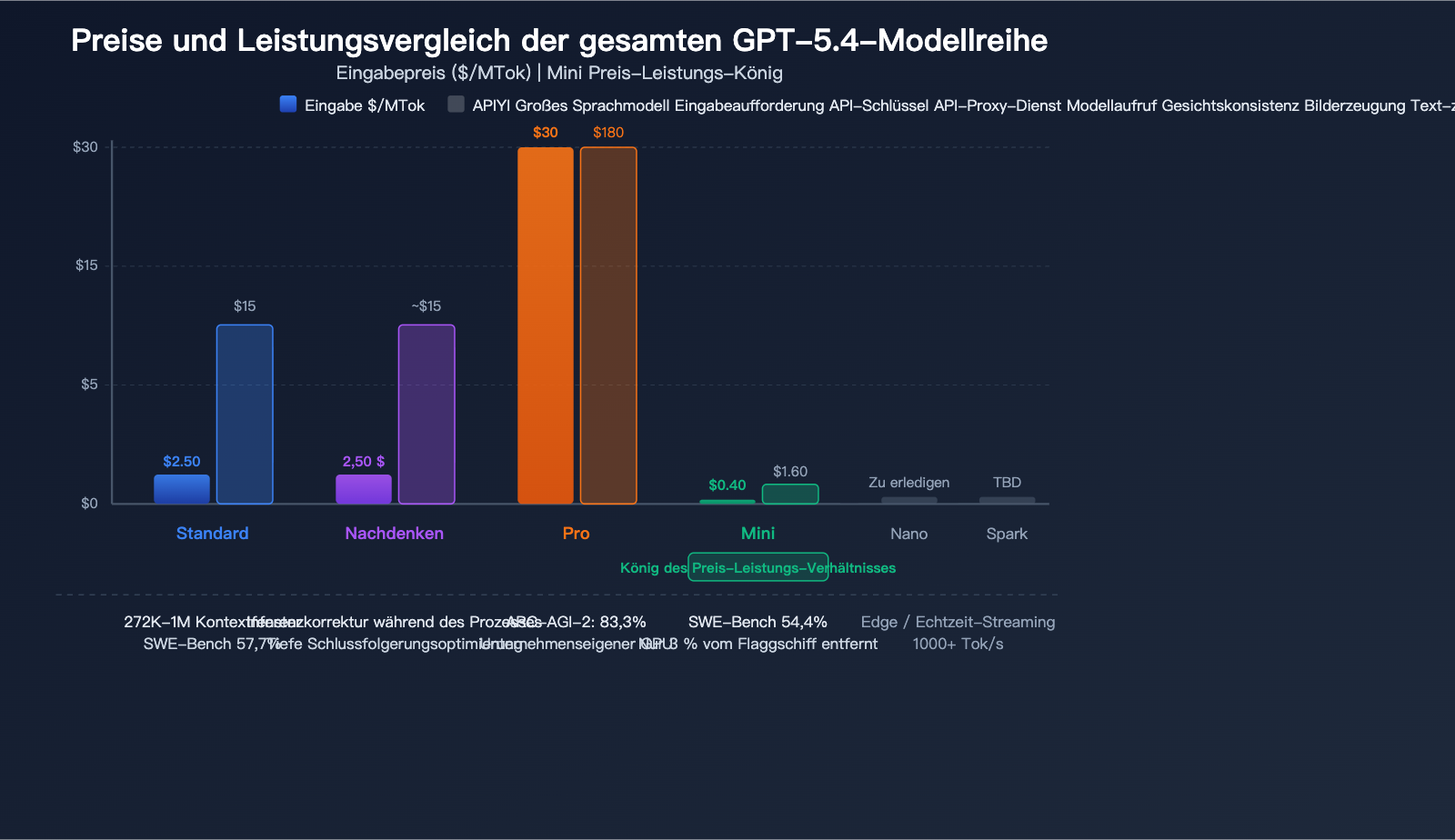

GPT-5.4 Modellvarianten und Preisgestaltung

Die GPT-5.4 Modellreihe

GPT-5.4 bietet 6 Modellvarianten, die alle Anforderungen von High-End-Anwendungen bis hin zu leichtgewichtigen Lösungen abdecken:

| Modellvariante | Positionierung | Eingabepreis ($/MTok) | Ausgabepreis ($/MTok) | Besonderheiten |

|---|---|---|---|---|

| GPT-5.4 | Flaggschiff | $2,50 | $15,00 | Standard 272K Kontextfenster |

| GPT-5.4 (>272K) | Langer Kontext | $5,00 | $15,00 | Erweiterbar auf 1M Kontextfenster |

| GPT-5.4 Thinking | Tiefgründiges Denken | – | – | Unterstützt Korrekturen während der Schlussfolgerung |

| GPT-5.4 Pro | Enterprise-Niveau | $30,00 | $180,00 | Dedizierte GPU, höchste Präzision |

| GPT-5.4 Mini | Leicht & effizient | ~$0,40 | ~$1,60 | Exzellentes Preis-Leistungs-Verhältnis |

| GPT-5.4 Spark | Echtzeit-Streaming | – | – | 1000+ Token/Sekunde |

Preisanalyse: Der Eingabepreis für die Standardversion von GPT-5.4 liegt bei $2,50/MTok, die Ausgabe bei $15,00/MTok. GPT-5.4 Mini ist mit ca. $0,40/$1,60 extrem kostengünstig und ideal für großflächige Implementierungen. GPT-5.4 Pro richtet sich an Unternehmen, die höchste Präzision benötigen, ist jedoch entsprechend teurer.

💰 Kostenoptimierung: Für die meisten Entwicklungsaufgaben ist GPT-5.4 Mini völlig ausreichend und bietet ein hervorragendes Preis-Leistungs-Verhältnis. Über die APIYI-Plattform (apiyi.com) können Sie flexiblere Abrechnungsmodelle nutzen und die verschiedenen GPT-5.4-Varianten sowie Konkurrenzmodelle direkt vergleichen.

Das einzigartige Design von GPT-5.4 Thinking

Die herausragende Fähigkeit von GPT-5.4 Thinking ist die Korrektur während der Schlussfolgerung – das Modell kann eigene Fehler bereits während des Denkprozesses erkennen und in Echtzeit korrigieren, anstatt diese erst im Endergebnis offenzulegen. Dies ist besonders wertvoll für komplexe, mehrstufige Aufgaben.

Die beeindruckende Leistung von GPT-5.4 Mini

Das am 17. März veröffentlichte GPT-5.4 Mini erreichte im SWE-Bench Pro einen Score von 54,38 %. Das sind nur 3 Prozentpunkte weniger als beim Flaggschiff, bei etwa 6-mal niedrigeren Kosten. Damit ist Mini eines der derzeit effizientesten Modelle für die Programmierung.

GPT-5.4 Evaluierungsdaten und Vergleich mit Wettbewerbern

GPT-5.4 Kernleistung bei der Evaluierung

| Evaluierungs-Benchmark | GPT-5.4 | GPT-5.4 Pro | Erläuterung |

|---|---|---|---|

| OSWorld-Verified | 75,0 % | – | Computersteuerung, übermenschlicher Benchmark |

| SWE-Bench Pro | 57,7 % | – | Programmierfähigkeiten |

| SWE-Bench Verified | ~80 % | – | Code-Reparatur |

| ARC-AGI-2 | 73,3 % | 83,3 % | Allgemeine Schlussfolgerung |

| GDPval | – | 83 % | Wissensarbeit |

Effizienzsteigerung der Token bei GPT-5.4

GPT-5.4 wird von OpenAI als das "Inferenzmodell mit der höchsten Token-Effizienz" bezeichnet – bei der Lösung derselben Probleme verbraucht GPT-5.4 deutlich weniger Token als GPT-5.2, was sich direkt in geringeren Kosten und höherer Geschwindigkeit niederschlägt.

Für Produktionsumgebungen mit häufigen Modellaufrufen bedeutet dies:

- Kostensenkung: Dieselben Aufgaben verbrauchen weniger Token.

- Geschwindigkeitssteigerung: Weniger Token bedeuten schnellere Antworten.

- Längeres effektives Kontextfenster: Das Modell kann Kontextinformationen innerhalb eines Millionen-Token-Fensters effizienter nutzen.

🎯 Vergleichsempfehlung: GPT-5.4 zeigt Spitzenleistungen bei der Computersteuerung und Programmierung, während die Claude-Serie bei reinen Schlussfolgerungsaufgaben ihre eigenen Stärken hat. Es empfiehlt sich, über die Plattform APIYI (apiyi.com) sowohl GPT-5.4 als auch Claude einzubinden, um je nach spezifischer Aufgabe das optimale Modell zu wählen.

Ruhestand von GPT-4o: Das Ende einer Ära

Zeitplan für den Ruhestand von GPT-4o

Der Ruhestand von GPT-4o erfolgt schrittweise:

| Zeitpunkt | Ereignis |

|---|---|

| 13. Februar 2026 | GPT-4o wird aus den meisten ChatGPT-Plänen entfernt |

| 13. Februar 2026 | Gleichzeitiger Ruhestand: GPT-4.1, GPT-4.1 Mini, o4-mini |

| 3. April 2026 | Vollständiger Ruhestand von GPT-4o aus Enterprise/Education-Versionen |

| API-Ebene | Vorläufig beibehalten, eine baldige Migration wird jedoch empfohlen |

Auswirkungen des Ruhestands von GPT-4o

Vor der Ankündigung des Ruhestands war der Anteil der täglich aktiven Nutzer von GPT-4o bereits auf unter 0,1 % gesunken. Die überwiegende Mehrheit der Nutzer ist bereits auf die GPT-5.x-Serie umgestiegen. Für die folgenden Szenarien hat der Ruhestand jedoch Auswirkungen:

Migration von Unternehmenssystemen: Interne Unternehmenssysteme, die auf GPT-4o basieren, müssen an das API-Format und die Leistungsmerkmale von GPT-5.4 angepasst werden.

Custom GPTs: Benutzerdefinierte GPTs, die auf GPT-4o basieren, müssen bis zum 3. April auf ein neues Modell umgestellt werden.

Azure-Nutzer: Azure AI Foundry hat einen eigenen Zeitplan für den Ruhestand, der nicht vollständig mit dem von OpenAI synchronisiert ist.

Empfehlungen für die Migration von GPT-4o auf GPT-5.4

| Migrationsdimension | GPT-4o | GPT-5.4 | Hinweise |

|---|---|---|---|

| Kontext | 128K | 272K-1M | Deutliche Erhöhung der Länge |

| Preisgestaltung | Niedriger | $2,50/$15 | Standardversion etwas teurer |

| Programmierung | Durchschnittlich | SWE-Bench 57,7 % | Deutliche Verbesserung |

| Computersteuerung | Nicht unterstützt | Nativ unterstützt | Ganz neue Fähigkeit |

| Genauigkeit | Benchmark | Halluzinationsrate um 33 %+ gesenkt | Massive Verbesserung |

💡 Migrationsempfehlung: Wenn Ihr System noch GPT-4o verwendet, wird empfohlen, die Migration bis zum 3. April abzuschließen. Sie können zunächst auf GPT-5.4 Mini (preislich am nächsten an GPT-4o) umsteigen, um die Kompatibilität zu testen, und anschließend je nach Bedarf die passende Variante wählen. Über die Plattform APIYI (apiyi.com) können Sie das Modell mit einem Klick wechseln, ohne den Code ändern zu müssen, was die Migrationskosten senkt.

Schneller Zugriff auf GPT-5.4

Minimalistisches API-Aufrufbeispiel

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{"role": "user", "content": "Analysiere die Leistungsengpässe dieses Codes"}]

)

print(response.choices[0].message.content)

Beispiel für den GPT-5.4 Computer Use-Aufruf anzeigen

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# GPT-5.4 Computer Use Modus

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{

"role": "user",

"content": "Öffne den Browser, suche nach den neuesten KI-Papers und erstelle eine Tabelle daraus"

}],

tools=[{

"type": "computer_use",

"display_width": 1920,

"display_height": 1080

}]

)

print(response.choices[0].message.content)

🚀 Schnellstart: Wir empfehlen, den API-Schlüssel über APIYI (apiyi.com) zu beziehen. Die Plattform unterstützt die gesamte GPT-5.4-Variantenreihe sowie einheitliche Schnittstellenaufrufe für Konkurrenzmodelle wie Claude und Gemini. Mit nur einem Schlüssel können Sie flexibel wechseln und vergleichen.

Häufig gestellte Fragen

Q1: Sollte ich GPT-5.4 oder GPT-5.3-Codex wählen?

Wählen Sie direkt GPT-5.4. GPT-5.4 integriert bereits die vollständigen Programmierfähigkeiten von GPT-5.3-Codex und übertrifft Codex mit 57,7 % gegenüber 56,8 % im SWE-Bench Pro. Die Codex-Schnittstelle bleibt zwar bestehen, wird aber nun von GPT-5.4 angetrieben. Über APIYI (apiyi.com) können Sie per Klick zwischen den verschiedenen GPT-5.4-Varianten wechseln und diese testen.

Q2: Gibt es eine Alternative nach der Stilllegung von GPT-4o?

GPT-5.4 Mini ist der Ersatz, der der Positionierung von GPT-4o am nächsten kommt. Mit einem Preis von ca. $0,40/$1,60 pro Million Token und einem Score von 54,38 % im SWE-Bench Pro übertrifft es GPT-4o deutlich. Wenn Ihr System auf GPT-4o basiert, können Sie über die APIYI-Plattform (apiyi.com) nahtlos auf GPT-5.4 Mini umsteigen, ohne Ihre Code-Struktur anpassen zu müssen.

Q3: Ist die Computer Use-Funktion von GPT-5.4 sicher?

OpenAI hat für die Computer Use-Funktion mehrstufige Sicherheitsmechanismen implementiert, darunter Bestätigungsabfragen für Aktionen, die Blockierung sensibler Vorgänge und Audit-Logs. In Unternehmensumgebungen wird die Verwendung in Verbindung mit einer entsprechenden Berechtigungssteuerung empfohlen. Derzeit ist die Computer Use-Funktion hauptsächlich über die API und die Codex-Schnittstelle verfügbar; für Endnutzer in ChatGPT ist sie noch nicht vollständig freigeschaltet.

Zusammenfassung

Die 5 wichtigsten Durchbrüche des Flaggschiff-Modells GPT-5.4:

- Native Computersteuerung: Mit 75 % Überlegenheit gegenüber dem menschlichen Benchmark in OSWorld ist es das erste universelle Modell mit nativer Computer-Use-Fähigkeit.

- Millionen-Token-Kontextfenster: 272K Standard / 1M erweitert, unterstützt ultra-lange Agenten-Aufgabenplanungen.

- 33 % weniger Halluzinationen: Deutlich gesteigerte faktische Genauigkeit, was das Modell für Unternehmensszenarien zuverlässiger macht.

- Codex-Programmierintegration: 57,7 % bei SWE-Bench Pro – ein Modell deckt nun sowohl logisches Schlussfolgern als auch Programmierung ab.

- 6 Modellvarianten: Von $0,40 Mini bis $30 Pro, deckt alle Anforderungen ab.

Die Veröffentlichung von GPT-5.4 markiert eine neue Phase, in der OpenAI von einer "Multi-Linien-Strategie" zu einem "einheitlichen Flaggschiff" übergeht. Mit der vollständigen Außerbetriebnahme von GPT-4o am 3. April wird GPT-5.4 zum absoluten Kern des OpenAI-Ökosystems. Wir empfehlen den schnellen Zugriff auf die gesamte GPT-5.4-Modellreihe über APIYI (apiyi.com). Die Plattform bietet eine einheitliche Schnittstelle und die Möglichkeit, flexibel zwischen Modellen zu wechseln, um Entwicklern eine effiziente Migration und Modellauswahl zu ermöglichen.

📚 Referenzen

-

Offizielle Ankündigung von OpenAI – GPT-5.4: Maßgebliche Modelleinführung und Bewertungsdaten

- Link:

openai.com/index/introducing-gpt-5-4 - Hinweis: Enthält vollständige technische Spezifikationen, Bewertungsdaten und Details zur Veröffentlichung.

- Link:

-

Ankündigung zur Außerbetriebnahme von OpenAI GPT-4o: Zeitplan für GPT-4o und ältere Modelle

- Link:

openai.com/index/retiring-gpt-4o-and-older-models - Hinweis: Enthält Zeitpläne für die Außerbetriebnahme der verschiedenen Pläne sowie Migrationsleitfäden.

- Link:

-

Vollständiger Leitfaden zu GPT-5.4 – NxCode: Umfassende Analyse von Funktionen, Bewertungen und Preisen

- Link:

nxcode.io/resources/news/gpt-5-4-complete-guide-features-pricing-models-2026 - Hinweis: Enthält Preisgestaltung aller Varianten und detaillierte Vergleichsbewertungen.

- Link:

-

Vergleich: GPT-5.4 vs. GPT-5.3-Codex: Lohnt sich ein Umstieg von Codex?

- Link:

nxcode.io/resources/news/gpt-5-4-vs-gpt-5-3-codex-upgrade-comparison-2026 - Hinweis: Detaillierte Analyse der Funktionen und Leistungsunterschiede beider Modelle.

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren über Ihre Erfahrungen mit GPT-5.4. Weitere Informationen zur Anbindung von KI-Modellen finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com.