Am 11. Mai 2026 entdeckten mehrere Reddit-Nutzer in der Gemini-App-Oberfläche eine Modellkarte namens Omni mit der Beschreibung: „Create with Gemini Omni: meet our new video model, remix your videos, edit directly in chat, try templates, and more“. Google hat sich bisher nicht offiziell dazu geäußert, doch dieser Leak hat Gemini Omni ins Rampenlicht gerückt – nur eine Woche vor der Google I/O 2026, die vom 19. bis 20. Mai stattfindet.

Dieser Artikel fasst die neuesten Berichte englischsprachiger Medien wie 9to5google, TestingCatalog, ChromeUnboxed, Digit und WaveSpeed zusammen und bündelt die bestätigten Informationen zum Gemini Omni Videomodell in 8 Kernpunkten. Diese decken die Produktpositionierung, die Kernfähigkeiten, die Leistungsgrenzen und den Veröffentlichungszeitplan ab. Entwickler und Content-Teams, die vor der Konferenz ihre technologische Strategie bewerten möchten, können diesen Beitrag als fundierte Informationsquelle nutzen.

Kernnutzen: Verstehen Sie in 3 Minuten die Positionierung, Fähigkeiten, Leistung und den Zeitplan von Gemini Omni und erhalten Sie Handlungsempfehlungen für die Zeit vor der I/O 2026.

Kurzüberblick: Die wichtigsten Fakten zum Gemini Omni Videomodell

Um Gemini Omni richtig einzuordnen, ist es wichtig, Fakten von Spekulationen zu trennen. Die folgende Tabelle fasst die Informationen zusammen, die von sechs englischsprachigen Medien verifiziert wurden, um Verwirrung durch verstreute Leaks zu vermeiden.

| Informationspunkt | Details |

|---|---|

| Erstmals gesichtet | 11.05.2026, Omni-Modellkarte in der Gemini-App-UI |

| Quelle | Screenshots von Reddit-Nutzern, Berichterstattung durch 9to5google und TestingCatalog |

| Modelltyp | Multimodales Modell für Bilderzeugung und Videobearbeitung |

| Kernbeschreibung | Create with Gemini Omni: meet our new video model |

| Gezeigte Demos | Tafel-Szenen mit mathematischen Beweisen, Dialoge in einem Strandrestaurant |

| Sichtbare Ebene | Vermutlich Flash-Ebene, Pro-Ebene noch nicht geleakt |

| Verbrauchssignal | Zwei Videogenerierungen verbrauchten 86 % des Tageskontingents des AI Pro-Tarifs |

| Voraussichtliche Veröffentlichung | Google I/O 2026, 19.-20. Mai, San Francisco |

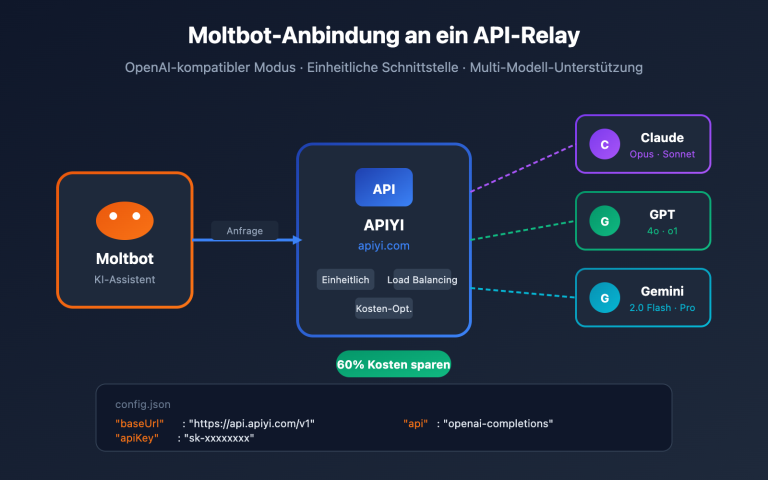

Es ist wichtig zu betonen, dass die geleakte UI-Karte lediglich beweist, dass Google Omni in die Phase der Beta-Tests überführt hat. Dies bedeutet nicht zwangsläufig, dass alle Funktionen am Tag der I/O für alle Nutzer verfügbar sein werden. Entwicklern, die die Dynamik von Gemini Omni verfolgen, empfehlen wir, sich bei APIYI (apiyi.com) zu registrieren und die base_url für die einheitliche Schnittstelle vorzubereiten. So können Sie nach der offiziellen Veröffentlichung durch Google sofort innerhalb desselben Codes zwischen den Modellen wechseln und sparen sich den Aufwand, die Aufrufkette separat aufzubauen.

Die 5 bekannten Fähigkeiten des Gemini Omni Videomodells

Gemini Omni ist kein reines „Text-zu-Bild“-Tool. Betrachtet man die UI-Beschreibung und frühe Demos, wird deutlich, dass es Generierung, Bearbeitung, Vorlagen und chatbasierte Interaktion zu einem einheitlichen System verschmilzt. Die folgenden fünf Fähigkeiten wurden von mehreren Medien bestätigt, befinden sich jedoch noch in einer Phase schneller Entwicklung.

Erstens die chatbasierte Videobearbeitung. Nutzer können ihre Änderungswünsche direkt im Dialogfenster äußern, etwa um ein Hauptobjekt auszutauschen, die Szene umzuschreiben oder eine bestimmte Bewegungssequenz anzupassen. Das Modell erstellt daraufhin basierend auf dem vorhandenen Clip ein neues Ergebnis, anstatt den Nutzer zu zwingen, manuell an einer Zeitleiste zu schneiden. Diese Fähigkeit konkurriert direkt mit traditionellen Postproduktions-Tools und ist das entscheidende Merkmal, das Omni von Veo 3.1 unterscheidet.

Zweitens die Entfernung von Wasserzeichen und Objektaustausch. Frühe Tester berichten, dass Omni bei Befehlen wie „remove watermark“ (Wasserzeichen entfernen) und „swap object“ (Objektaustausch) deutlich besser abschneidet als bei der reinen Bildgenerierung, was als Alleinstellungsmerkmal von Omni gilt. Da solche Vorgänge hochsensibel sind, wird Google bei der offiziellen Veröffentlichung höchstwahrscheinlich Urheberrechts- und Compliance-Prüfungen integrieren.

Drittens die native audiovisuelle Generierung. Analysen von WaveSpeed und GeminiOmniAI deuten in dieselbe Richtung: Omni gibt in einem einzigen Inferenzschritt sowohl das Bild als auch den dazu synchronen räumlichen Ton aus, anstatt erst das Video zu erstellen und dann den Ton hinzuzufügen. Diese gemeinsame Modellierung kann typische KI-Videoprobleme wie mangelnde Lippensynchronität oder inkonsistente Umgebungsgeräusche reduzieren.

Viertens das Kontextfenster für extrem lange Skripte. Mehrere Medien berichten, dass Omni längere Eingabeaufforderungen und Skriptkontexte akzeptiert als Veo 3, was sich ideal für das Storytelling mit mehreren Kameraeinstellungen oder lange Produktpräsentationen eignet. In Kombination mit dem für die Gemini-Serie typischen exzellenten Management langer Kontexte würde diese Fähigkeit, sollte sie sich bewahrheiten, einen deutlichen Vorsprung gegenüber Modellen wie Sora schaffen, die sich auf Kurzvideos konzentrieren.

Fünftens die Konsistenz durch Referenzbilder. Omni unterstützt die Verwendung von Referenzbildern als Anker für Identität, Licht und Farbe, wodurch die visuellen Merkmale von Personen oder Szenen bei der Generierung beibehalten werden. Dies ist ideal für Markenwerbung, IP-Videos und Inhalte mit digitalen Avataren.

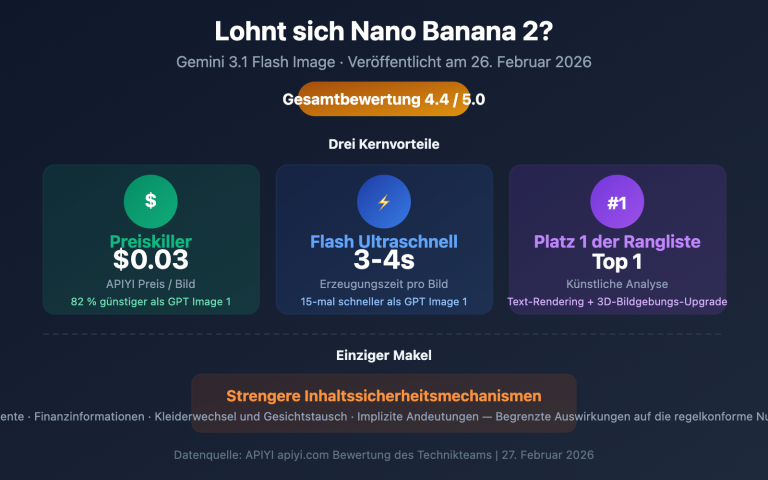

💡 Tipp für den schnellen Einstieg: Bevor Gemini Omni offiziell verfügbar ist, können Sie auf der APIYI-Plattform (apiyi.com) mit aktuellen Videomodellen wie Veo 3.1, Seedance 2 oder Hailuo Ihre gesamte Strategie für die Eingabeaufforderung optimieren. Sobald Omni erscheint, können Sie nahtlos wechseln und so Ihre Testkosten minimieren.

Vermutungen zur zweistufigen Architektur: Gemini Omni Flash und Pro

Sowohl TestingCatalog als auch WaveSpeed haben bemerkt, dass in der geleakten UI zwar nur eine Omni-Bezeichnung zu sehen ist, die Benennungsregeln der Modellkarten, die Parameteroptionen und die Verarbeitungsgeschwindigkeit jedoch stark mit der „Flash + Pro“-Struktur der anderen Gemini-Mitglieder übereinstimmen. Die folgende Tabelle fasst die vermuteten Unterschiede der beiden Produktlinien zusammen, um Entwicklern die Auswahl zu erleichtern.

| Stufe | Vermutete Positionierung | Vermutete Merkmale | Anwendungsbereiche |

|---|---|---|---|

| Gemini Omni Flash | Ebene für hohe Frequenz | Schnell, geringer Verbrauch pro Clip, mittlere Bildqualität | Social-Media-Kurzvideos, Werbe-A/B-Tests, Masseninhalte |

| Gemini Omni Pro | Ebene für High-End-Produktion | Langsame Inferenz, detaillierte Bildqualität, raffinierterer nativer Ton | Markenfilme, Langvideoskripte, filmreife Aufnahmen |

Dass die derzeit öffentlichen Demos aus der Flash-Stufe stammen, lässt sich an zwei Indizien festmachen: Erstens übertreffen die frühen Szenen (wie die mathematische Tafel oder das Restaurant) in ihrer Qualität nicht das Niveau von Veo 3.1, und zweitens wird die Pro-Stufe üblicherweise zusammen mit rechenintensiven Funktionen wie „Deep Think“ angekündigt. Sobald Google am Tag der I/O 2026 die Pro-Stufe und die Preisgestaltung bekannt gibt, können Entwickler entscheiden, ob sie beide Produktlinien je nach Szenario einsetzen möchten.

Für Teams, die Anwendungen zur Videogenerierung entwickeln, ist es am realistischsten, zunächst auf die aggregierte Multi-Modell-Schnittstelle von APIYI (apiyi.com) zu setzen. So lässt sich das Management der Eingabeaufforderungen, Parameter und Rückrufprozesse als „modellunabhängige“ Zwischenschicht aufbauen. Sobald Omni Flash und Pro verfügbar sind, kann das System durch einfaches Umschalten des model-Feldes ohne Ausfallzeiten auf die neuen Funktionen zugreifen.

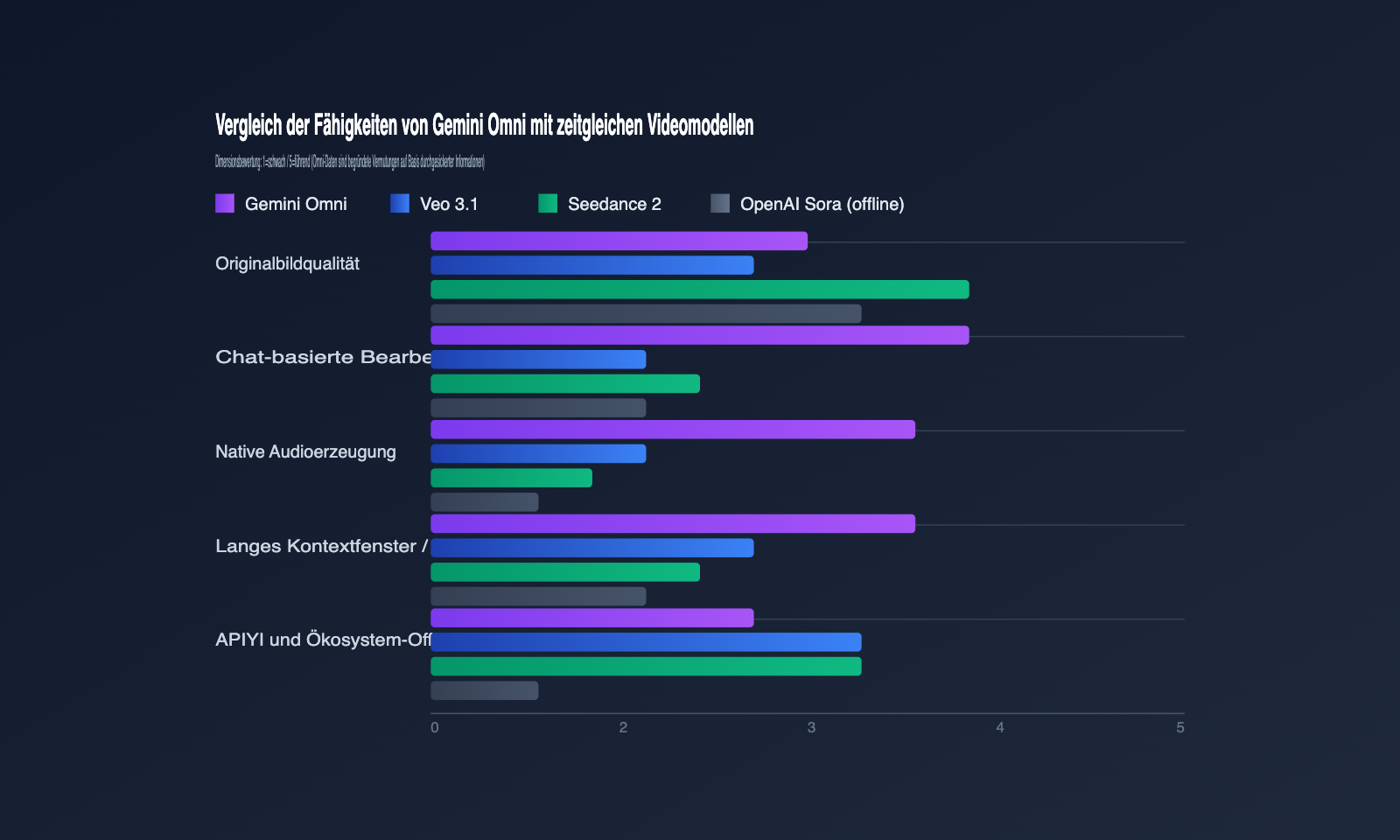

Analyse der Beziehung zwischen Gemini Omni, Veo 3.1, Seedance 2 und Sora

Um die Marktposition von Gemini Omni zu verstehen, muss man es in den Kontext der aktuellen Videomodell-Landschaft einordnen. Die folgende Vergleichstabelle fasst die Kapazitätsunterschiede der derzeit beachtenswertesten Modelle (Stand: 12. Mai 2026) zusammen. Bitte beachten Sie, dass die Daten zu Omni noch auf Schätzungen basieren.

| Dimension | Gemini Omni | Veo 3.1 | Seedance 2 | OpenAI Sora |

|---|---|---|---|---|

| Hauptfokus | Bilderzeugung + Chat-Bearbeitung | Bilderzeugung | High-Fidelity Bilderzeugung | Anfang 2026 eingestellt |

| Bildqualität | Überdurchschnittlich (geschätzt) | Mittel | Branchenstandard | Historisch hoch |

| Chat-Bearbeitung | Erstklassiges Highlight | Nicht unterstützt | Schwache Unterstützung | Keine Weiterentwicklung |

| Natives Audio | Synchron bei Inferenz | Erfordert Nachbearbeitung | Erfordert Nachbearbeitung | Historisch kein natives Audio |

| API-Offenheit | Voraussichtlich mit I/O | Vertex AI / Gemini API | Volcengine | Geschlossen |

| Kommerzielle Lizenz | Offiziell ausstehend | Kommerziell verfügbar | Kommerziell verfügbar | Pausiert |

Der wahre Trumpf von Gemini Omni ist nicht der Ersatz von Modellen wie Seedance 2, die durch Bildqualität glänzen, sondern die Nutzung der multimodalen Fähigkeiten von Gemini, um den Workflow "Generieren → Bearbeiten → Neu generieren" direkt in das Chat-Fenster zu integrieren. Für Entwickler bedeutet dies, dass sich das Produktformat von Video-Generierungs-Apps von "Editor + Modell" hin zu "Dialog + Modell" wandeln könnte.

Die Lücke im Content-Ökosystem, die OpenAI Anfang 2026 durch die Abschaltung von Sora hinterlassen hat, bietet Gemini Omni die perfekte Gelegenheit zum Aufstieg. Falls Ihr Team noch evaluiert, auf welches Video-Generierungs-Ökosystem es setzen soll, empfehlen wir, über die einheitliche API-Proxy-Schnittstelle von APIYI (apiyi.com) zunächst Veo 3.1 und Seedance 2 anzubinden und nach der offiziellen Veröffentlichung von Omni eine weitere Aufrufkette hinzuzufügen. So können Sie die Entscheidung über die Modellauswahl auf die Zeit nach der Konferenz verschieben.

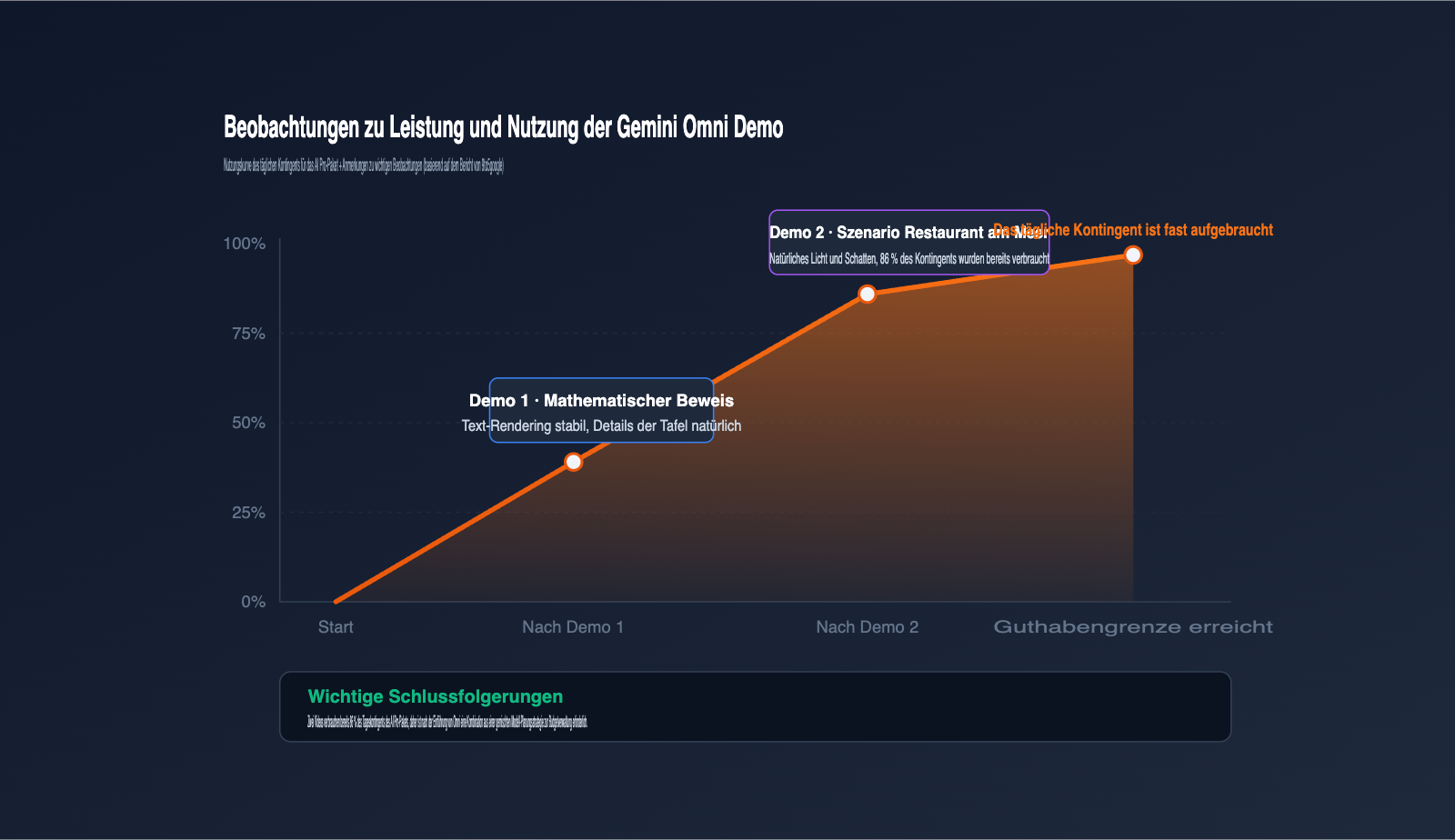

Beobachtungen aus dem Gemini Omni Demo-Test und Nutzungsgrenzen

Neben der Funktionsliste und den Kapazitätsschätzungen ist ein weiterer interessanter Aspekt die Leistung der frühen Demos und die Nutzungsdaten. 9to5google berichtete über zwei öffentliche Demos, die schwierige Bereiche wie Text-Rendering und Langzeit-Narrative abdeckten.

| Demo-Thema | Schlüsselwörter der Eingabeaufforderung | Beobachtung |

|---|---|---|

| Mathe-Tafel | Professor schreibt trigonometrische Identitäten an die Tafel | Text-Rendering stabil, aber noch kleine Fehler bei der Zeichenverbindung |

| Strandrestaurant | Zwei Männer genießen Pasta in einem gehobenen Restaurant | Kameraführung, Licht und Stimmung wirken sehr natürlich |

| Nutzungsumfang | Zwei Video-Prompts | Verbraucht 86 % des täglichen AI Pro-Limits |

Die Nutzungsdaten sind das am leichtesten zu übersehende Detail dieses Leaks. Zwei Videos verbrauchen bereits den Großteil des Tageskontingents, was bedeutet, dass Omni bei der Rechenleistung deutlich anspruchsvoller ist als herkömmliche Modelle wie Imagen 4 oder Gemini 2.5 Flash. Google hat in einer anderen Ankündigung bereits explizite Nutzungslimits für Gemini-Konten angekündigt, was darauf hindeutet, dass Omni nach dem Start wahrscheinlich eine restriktive Kontingentstrategie verfolgen wird.

Für kleine und mittlere Teams ist es am sinnvollsten, die Videogenerierung nicht an einen einzigen Kanal zu binden. Wir empfehlen, bei der Nutzung der Gemini-Serie über die APIYI-Plattform (apiyi.com) das tägliche Budget auf eine Mischung aus verschiedenen Modellen aufzuteilen: Nutzen Sie Veo 3.1 oder Seedance 2 für häufige Inhalte und reservieren Sie Omni für wichtige Präsentationen. So profitieren Sie von den einzigartigen Fähigkeiten von Omni, ohne dass die Kontingentstrategie einer einzelnen Plattform Ihren Cashflow blockiert.

Auswirkungen des Gemini Omni Videomodells auf Entwickler und die Branche

Wenn wir diese Signale zusammenführen, können wir die potenziellen Auswirkungen von Gemini Omni sowohl aus der Perspektive der Entwickler als auch der Branche bewerten. Dies ist weder eine bloße Wiederholung technischer Spezifikationen noch ein übermäßig optimistischer Hype, sondern eine fundierte Schlussfolgerung auf Basis bekannter Informationen.

Auswirkungen auf Entwickler von Videogenerierungs-Anwendungen

Die erste Welle, die direkt betroffen ist, sind Teams, die SaaS-Lösungen für die Videogenerierung entwickeln. Da Omni die chatbasierte Bearbeitung zu einem erstklassigen Feature macht, bedeutet dies, dass traditionelle Benutzeroberflächen für Videoeditoren nicht mehr zwingend erforderlich sind. Entwickler müssen neu bewerten, ob sie die Dialogschnittstelle als einzigen Einstiegspunkt nutzen oder die Zeitleiste als Sicherheitsnetz beibehalten wollen.

Die zweite Welle betrifft KI-Video-Content-Ersteller und MCNs. Die native, kombinierte Audio- und Videogenerierung wird den Arbeitsaufwand für die Postproduktion erheblich reduzieren, wobei knappe Tageskontingente die Produktionsmenge pro Person einschränken könnten. Ein soliderer Ansatz wäre, Omni als „Key-Shot-Verstärker“ einzusetzen, während reguläre Inhalte weiterhin auf kostengünstigeren Modellen basieren.

Wenn Ihr Produkt auf APIs zur Videogenerierung angewiesen ist, empfehle ich, ab sofort einige Schritte auf der Plattform APIYI (apiyi.com) zu unternehmen: Erstens, vereinheitlichen Sie die Kapselungsschicht für alle Modellaufrufe; zweitens, bauen Sie eine A/B-Testbibliothek für Eingabeaufforderungen auf; und drittens, bereiten Sie für kritische Geschäftsabläufe drei Backup-Voreinstellungen mit Omni, Veo und Seedance vor, um Schwankungen bei den Kontingenten am Tag der Veröffentlichung zu vermeiden.

Auswirkungen auf die KI-Video-Landschaft

Seit dem Rückzug von OpenAI Sora wechselt die Führungsposition im Bereich KI-Video ständig zwischen Veo, Seedance und Runway Gen-4. Sobald Gemini Omni tatsächlich natives Audio/Video und ein langes Kontextfenster unterstützt, wird dies den „multimodalen Burggraben von Google“ direkt auf den Bereich der Videogenerierung übertragen und Druck auf andere Anbieter ausüben.

Aus ökologischer Sicht ist es sehr wahrscheinlich, dass Google Omni über drei Kanäle gleichzeitig verbreitet: die Gemini-App, Vertex AI und AI Studio. Das bedeutet, dass Omni sowohl im Consumer-Chat als auch als Entwickler-API und Unternehmens-Agenten-Tool in bestehende Produkte eingebettet wird. Wenn Teams die Aufrufe unternehmensintern zentral verwalten müssen, können sie über APIYI (apiyi.com) mehrere Aufrufkanäle von Omni, Veo und Seedance unter einer einzigen Rechnung und einem gemeinsamen Audit-Log zusammenführen.

Zeitplan rund um das Gemini Omni Videomodell I/O 2026

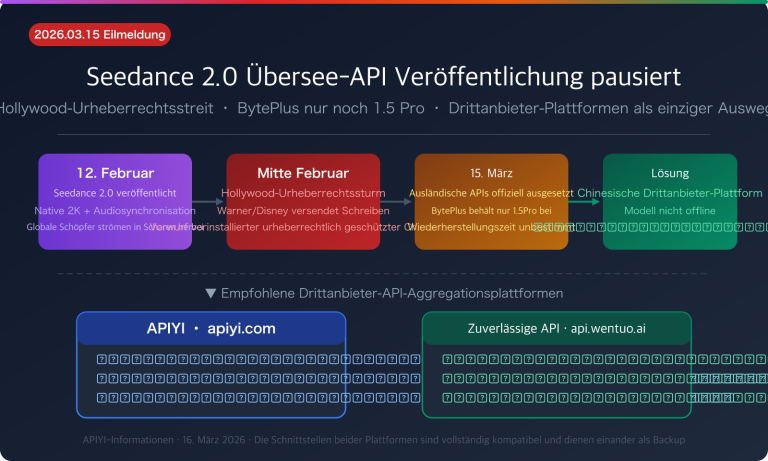

Um Teams bei der Planung der Anbindung zu unterstützen, sind die derzeit öffentlich verfügbaren Informationen chronologisch geordnet. Bitte beachten Sie: Daten vor dem 19. Mai sind bestätigte Ereignisse, danach handelt es sich um geschätzte Zeitabläufe.

| Phase | Zeit | Wichtiges Ereignis |

|---|---|---|

| Graustufentest | vor 11.05.2026 | Interne Tests der Omni-Modellkarte bei Google |

| UI-Leak | 11.05.2026 | Reddit-Screenshots aufgetaucht, mehrere englischsprachige Medien berichten |

| Geheimdienstphase | 12.05. bis 18.05.2026 | Analyse und Vorbereitung durch Hersteller und Medien |

| Offizielle Veröffentlichung | 19.05. bis 20.05.2026 | Google I/O 2026 Keynote und Entwicklerzugang |

| API-Start | nach 20.05.2026 | Gemini API / Vertex AI / AI Studio schrittweise verfügbar |

| Inländischer Proxy-Start | Synchron mit API-Start | Aggregationsplattformen wie APIYI (apiyi.com) folgen mit Konfiguration |

Häufig gestellte Fragen

Q1: Wird Gemini Omni wirklich auf der I/O 2026 veröffentlicht?

Betrachtet man Googles Namenskonventionen und den bisherigen Rhythmus der Leaks, ist die I/O 2026 das plausibelste Zeitfenster für eine Veröffentlichung. Ob die API jedoch bereits am 19. Mai freigeschaltet wird, hängt von der offiziellen Ankündigung vor Ort ab. Wir empfehlen, den Veröffentlichungszeitraum auf den 19. bis 20. Mai einzugrenzen und einen Puffer von einer Woche für eine schrittweise Einführung einzuplanen.

Q2: In welcher Beziehung stehen Gemini Omni und Veo 3.1 zueinander?

Derzeit gibt es drei gängige Interpretationen: Omni ist der neue externe Name für Veo, Omni ist ein eigenständiges Modell neben Veo, oder Omni ist ein übergeordnetes "Omni-Modell", das Bild und Video vereint. In Anbetracht der Beschreibungen in den geleakten Benutzeroberflächen ist die dritte Variante am wahrscheinlichsten, bedarf aber noch der offiziellen Bestätigung durch Google.

Q3: Können Entwickler in China Gemini Omni nutzen?

Sobald Google den Modellaufruf für Omni in der Gemini API und Vertex AI freigibt, können Entwickler in China über API-Proxy-Dienste wie APIYI (apiyi.com) darauf zugreifen. Es empfiehlt sich, die base_url für die Gemini-Serie auf dieser Plattform bereits im Voraus zu konfigurieren, um am Tag der Veröffentlichung keine Zeit mit der Einrichtung zu verlieren.

Q4: Die Bildqualität der frühen Demos wirkt schwächer als bei Seedance 2. Heißt das, Omni ist nicht leistungsstark?

Das lässt sich so einfach nicht beurteilen. Mehrere Medien vermuten, dass die aktuellen Demos auf der Flash-Ebene basieren und das Omni Pro-Modell noch nicht öffentlich ist. Zudem liegt die Stärke von Omni in der Bearbeitungsfähigkeit und dem nativen Audio, nicht primär im reinen Vergleich der Bildqualität.

Q5: Welches Videomodell sollte man nutzen, wenn man nicht auf Omni warten möchte?

Wir empfehlen Veo 3.1 als Allround-Lösung, Seedance 2 für hohe Bildqualität und Hailuo für kostenbewusste Projekte. Über APIYI (apiyi.com) können Sie alle drei Modelle zentral einbinden und bei Verfügbarkeit von Omni einfach eine vierte Aufrufkette hinzufügen.

Zusammenfassung

Die vorzeitige Enthüllung von Gemini Omni hat die Diskussion über Videomodelle im Vorfeld der Google I/O 2026 massiv angeheizt. Den bekannten Informationen zufolge liegt das Hauptverkaufsargument nicht allein in der Bildqualität, sondern in der Kombination aus dialogbasierter Bearbeitung, nativem Audio/Video und einem großen Kontextfenster. Das Ziel ist es, den Workflow der Bilderzeugung und Videogenerierung direkt in den Chat zu verlagern.

Die klügste Strategie vor dem 19. Mai ist es, nicht über Details zu spekulieren, sondern die Infrastruktur für die Videogenerierung vorzubereiten. Wenn Sie eine einheitliche Schnittstelle für mehrere Modelle, eine Bibliothek für Eingabeaufforderungen und ein Monitoring der Nutzung etablieren, wird der Wechsel zu Omni mit minimalem Aufwand möglich sein. Wir empfehlen Teams, sich über Aggregationsplattformen wie APIYI (apiyi.com) vorzubereiten, um den Integrationsaufwand für Gemini Omni auf 1-2 Tage zu begrenzen.

Autor: APIYI Technik-Team

Kontakt: Erhalten Sie den Leitfaden zur sofortigen Integration von Gemini Omni über APIYI (apiyi.com)

Aktualisiert am: 12.05.2026