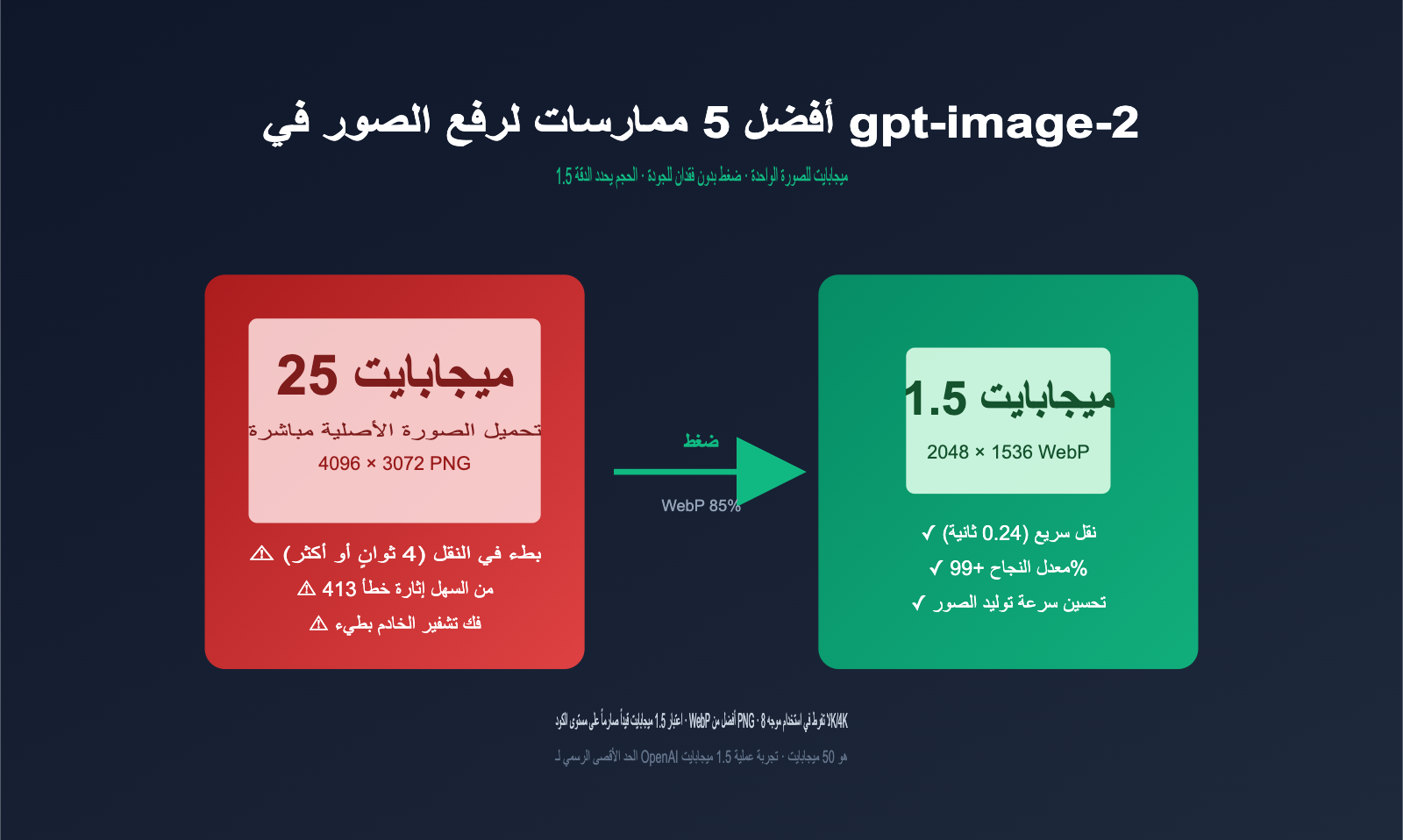

عندما يبدأ العديد من المطورين في دمج واجهة تحرير الصور gpt-image-2 لأول مرة، فإنهم يميلون تلقائيًا إلى إرسال الصورة الأصلية عبر طلب POST مباشرة؛ ففي النهاية، تنص الوثائق الرسمية بوضوح على أن الحد الأقصى لحجم الصورة الواحدة هو 50 ميجابايت، أليس من الأفضل استغلال هذه المساحة؟ ولكن إذا قمت بإجراء عشرات الاختبارات العملية، ستكتشف أن سرعة توليد الصور عند استخدام صورة أصلية بحجم 20 ميجابايت مقارنة بصورة مضغوطة بحجم 1.5 ميجابايت قد تختلف بمقدار 3 أضعاف أو أكثر، كما أن معدل الفشل (خاصة خطأ 413 Request Entity Too Large) يرتفع بشكل كبير.

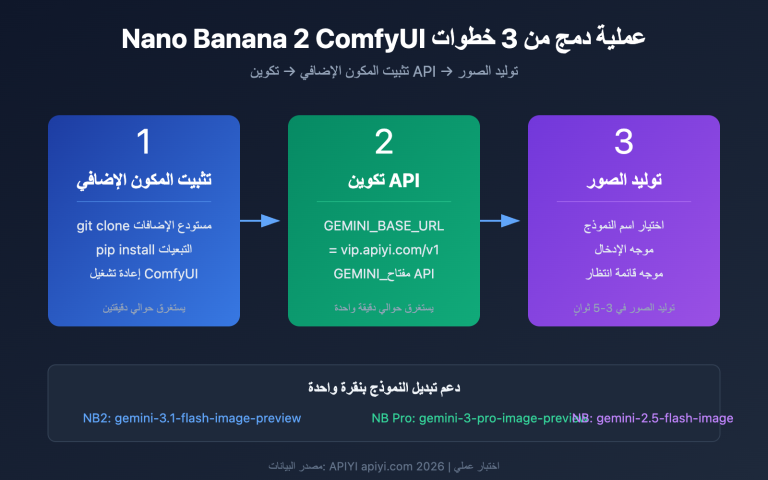

يقدم هذا المقال، استنادًا إلى خبرة عملية واسعة، 5 ممارسات مثالية لرفع الصور في gpt-image-2، مع التركيز على الإجابة عن سؤالين يواجههما المطورون غالبًا: ما هو الحجم المناسب لضغط الصورة؟ وما الذي يحدد دقة المخرجات فعليًا؟

🎯 الخلاصة الجوهرية: يُنصح بالتحكم في حجم الصورة الواحدة المرفوعة إلى gpt-image-2 بحيث لا تتجاوز 1.5 ميجابايت؛ أما دقة المخرجات فيتم تحديدها بواسطة معامل

size، وكتابة "8K" أو "4K" في الموجه لا فائدة منها على الإطلاق. يمكن تشغيل جميع الأكواد البرمجية في هذا المقال مباشرة عبر خدمة وكيل APIYI (apiyi.com)، دون الحاجة إلى بيئة شبكة خارجية.

مواصفات رفع الصور في gpt-image-2: الحد الأقصى الرسمي مقابل الحد العملي

تعتبر وثائق OpenAI الرسمية مواصفات إدخال الصور لـ gpt-image-2 مرنة للغاية، وللوهلة الأولى يبدو أنه لا توجد قيود تدعو للقلق. لكن "القدرة على الاستخدام" و"الاستخدام الأمثل" أمران مختلفان تمامًا، لذا يجب عليك في التطبيق العملي وضع خط أحمر أكثر صرامة.

يقارن الجدول التالي بين الحدود القصوى الرسمية والقيم العملية الموصى بها في هذا المقال، والتي تستند إلى إحصائيات وتجارب عدد كبير من المطورين:

| البعد | الحد الأقصى الرسمي | التوصية العملية | سبب الاختلاف |

|---|---|---|---|

| حجم الصورة الواحدة | 50 ميجابايت | ≤ 1.5 ميجابايت | زيادة كبيرة في إجمالي وقت النقل وفك التشفير على الخادم |

| عدد الصور في الطلب الواحد | 16 صورة | 1-4 صور | تكديس الصور يقلل من معدل النجاح لكل طلب |

| التنسيقات المدعومة | PNG / WEBP / JPG | WEBP / JPG (مضغوطة) | عادة ما يكون حجم PNG كبيرًا جدًا، وWEBP هو الأكثر كفاءة |

| بكسلات الجانب الواحد | بحد أقصى 3840 | لا تتجاوز 2048 | يتم إجراء استخراج الميزات وتقليل العينات داخليًا |

| نسبة العرض إلى الارتفاع | 1:3 ~ 3:1 | قريبة من نسبة المخرجات | عدم تطابق النسبة يؤدي إلى عمليات حشو/قص إضافية |

لماذا حددنا السقف بـ 1.5 ميجابايت؟ لأنها القيمة المثالية التي توازن بين وقت النقل، ووقت فك التشفير، واستقرار الشبكة. عندما يكون الحجم أقل من 1.5 ميجابايت، يمكن لمعظم اتصالات الإنترنت المنزلية إتمام النقل في غضون ثانية أو ثانيتين؛ أما عند تجاوز 5 ميجابايت، فإن إجمالي وقت النقل وفك التشفير ينمو بشكل غير خطي، وستلاحظ بوضوح أن الواجهة "تتعثر".

💡 تجربة عملية: ننصح بجعل حجم 1.5 ميجابايت قيدًا صارمًا في الكود البرمجي، واستخدام مكتبات مثل PIL لإجراء ضغط تلقائي قبل الاستدعاء. عند استدعاء gpt-image-2 عبر APIYI (apiyi.com)، ستلاحظ تحسنًا ملحوظًا في سرعة نقل الملفات الصغيرة عبر عقد مراكز البيانات المحلية.

لماذا يُنصح بضغط الصورة الواحدة إلى أقل من 1.5 ميجابايت؟

يسأل العديد من المطورين: بما أن المواصفات الرسمية تدعم حتى 50 ميجابايت، فلماذا نصر على 1.5 ميجابايت؟ في الواقع، هناك أربعة أسباب هندسية وراء ذلك، وأي واحد منها كافٍ لجعلك تتعامل بجدية مع حجم الصور.

السبب الأول هو تأخير النقل (Transmission Latency)، وهو الجانب الأكثر استهانة. الصورة بحجم 25 ميجابايت تحتاج إلى حوالي 4 ثوانٍ للنقل الصافي عبر سرعة رفع (Upload) تبلغ 50 ميجابت في الثانية، بينما عند ضغطها إلى 1.5 ميجابايت، يستغرق الأمر 0.24 ثانية فقط. هذا الوقت يُضاف مباشرة إلى إجمالي زمن استجابة الـ API.

السبب الثاني هو مخاطر خطأ 413. ليس من النادر رؤية خطأ 413 Request Entity Too Large عند استخدام gpt-image-1 أو gpt-image-2. حتى لو لم تتجاوز حد الـ 50 ميجابايت، فقد يتم حظر الطلب في إحدى بوابات الشبكة (مثل CDN، أو الوكيل العكسي، أو موازن الأحمال). ضغط الصورة إلى أقل من 1.5 ميجابايت يجنبك هذه الأخطاء تماماً ويعزز من استقرار الاستدعاء.

السبب الثالث هو وقت فك التشفير على الخادم. بعد استلام الصورة، يحتاج خادم OpenAI إلى فك تشفيرها، واستخراج الميزات، وتحويلها إلى متجهات (Embedding). الوقت المستغرق في هذه الخطوات يرتبط طردياً بإجمالي عدد بكسلات الصورة. حتى لو لم تكن سرعة الشبكة هي العائق، فإن الصور الكبيرة ستؤدي إلى إبطاء سرعة توليد النتائج.

السبب الرابع هو تكلفة إعادة المحاولة. إذا فشل استدعاء صورة كبيرة، فستحتاج إلى إعادة رفع الـ 25 ميجابايت بالكامل. أما في حالة الصورة بحجم 1.5 ميجابايت، فإن إعادة المحاولة تكون غير محسوسة تقريباً، مما يجعل الموثوقية الشاملة من الطرف إلى الطرف (End-to-End) مختلفة تماماً.

عند قياس هذه الأسباب بناءً على بيانات اختبار حقيقية، ستجد المقارنة أكثر وضوحاً: عند رفع نفس الصورة بأحجام (25 ميجابايت / 5 ميجابايت / 1.5 ميجابايت / 500 كيلوبايت) إلى واجهة تحرير gpt-image-2 وتكرار العملية 50 مرة بنفس الموجه (Prompt) ومعاملات الحجم، يظهر منعطف واضح في إجمالي الوقت المستغرق ومعدل النجاح. 1.5 ميجابايت هي النقطة المثالية في هذا المنحنى؛ فالمزيد من الضغط لا يقدم تحسناً ملموساً في التجربة، ولا داعي للتضحية بجودة الصورة من أجل حجم أصغر.

🔧 نصيحة للتحسين: عند استدعاء

gpt-image-2في بيئة الإنتاج، نوصي بشدة بجعل "الضغط قبل الرفع" خطوة قياسية في الكود وليست خياراً. من خلال استخدام عقدة الوكيل في apiyi.com لتنفيذ المهام المجمعة مع استراتيجية ضغط 1.5 ميجابايت، يمكن خفض معدل فشل الدفعة الواحدة من 5-8% إلى أقل من 1%. هذا الفارق يصبح كبيراً جداً عند تجاوز حجم الاستدعاءات الشهرية عشرات الآلاف.

الضغط لا يعني فقدان الجودة: خرافة مبالغ فيها

هذه واحدة من أكثر المفاهيم الخاطئة انتشاراً بين المطورين: "الضغط = فقدان الجودة = التأثير على نتائج الذكاء الاصطناعي". قد يكون هذا الحكم صحيحاً في عصر JPEG عام 2010، لكن في عصر WebP وJPEG عالي الجودة عام 2026، أصبح هذا الاعتقاد قديماً جداً.

يوضح الجدول التالي المقارنة بين المفاهيم الخاطئة والحقائق لمساعدتك في بناء حدس صحيح حول معالجة الصور:

| المفهوم الخاطئ | الحقيقة |

|---|---|

| الضغط يقلل الجودة دائماً | WebP بجودة 85+ غير قابل للتمييز بصرياً، وكذلك JPEG 90+ |

| كلما كانت الصورة أكبر، كان فهم الذكاء الاصطناعي لها أوضح | gpt-image-2 يقوم بعملية "أخذ عينات فرعية" (Downsampling) داخلياً، وأي دقة تتجاوز دقة عمل النموذج هي هدر |

| PNG هو الأفضل لأنه بدون فقدان | حجم PNG عادة ما يكون 3-5 أضعاف WebP، لكن النتائج بعد فك التشفير متطابقة تقريباً |

| أدوات الضغط تغير الألوان | الأدوات الرئيسية (Squoosh / TinyPNG / Sharp) تحافظ على ملفات تعريف الألوان ICC |

| لا داعي للضغط إذا كان الموجه قوياً | الموجه وحجم الصورة بعدان مستقلان، الضغط يؤثر على النقل فقط ولا يؤثر على الفهم |

بالنسبة لاختيار الأدوات، يمكنك اختيار ما يناسب سيناريو عملك:

| الأداة | سيناريو الاستخدام | الميزة |

|---|---|---|

| PIL / Pillow | المعالجة المجمعة في خلفية Python | سهولة دمج الكود، إمكانية تعديل الجودة تكرارياً حتى الوصول للهدف |

| Sharp (Node.js) | خدمات Node.js | الأفضل من حيث الأداء، تعالج عشرات الصور في الثانية على نواة واحدة |

| Squoosh | ضغط الصور الفردي في المتصفح | يعمل عبر WASM، لا حاجة لرفع الصور للخادم |

| TinyPNG | المعالجة المجمعة اليدوية للمصممين | تقليل ذكي للوحة الألوان، جودة بصرية لا تتأثر |

| أدوات لقطة الشاشة | macOS / Windows | اختيار JPEG 80% يكفي تماماً |

إن اعتبار "الضغط" خطوة "تحضيرية ضرورية" بدلاً من كونه "تنازلاً يضر بالنتائج" هو الأساس النفسي لاستخدام واجهات برمجة تطبيقات الصور بشكل صحيح.

نقطة أخيرة للتوضيح: يقوم gpt-image-2 داخلياً بعملية "أخذ عينات فرعية" للصور الكبيرة جداً، حيث أن "دقة العمل الداخلية" للنموذج أقل بكثير من الحد الأقصى الذي يمكنك رفعه. هذا يعني أنك إذا رفعت صورة بدقة 4000×3000 بكسل، فقد يرى النموذج نسخة مصغرة بدقة 1024×1024، مما يجعل البكسلات الإضافية التي رفعتها مهدرة تماماً.

بعد فهم هذه النقطة، يصبح "تطابق النتائج قبل وبعد الضغط" استنتاجاً مبنياً على أساس تقني وليس مجرد حدس. ضغط الصورة إلى نطاق 1024-2048 بكسل يضعها تماماً ضمن دقة عمل النموذج، مما يضمن عدم الهدر وعدم خسارة الجودة.

دقة مخرجات gpt-image-2: معامل size هو المفتاح الوحيد

إذا كان الاعتقاد بأن "الضغط لا يفقد الجودة" هو أكبر سوء فهم في جانب الرفع، فإن الاعتقاد بأن "كتابة 8K في الموجه ستنتج صورة بدقة 8K" هو أكبر سوء فهم في جانب المخرجات. في هذا القسم، سنوضح تماماً كيف يتم تحديد دقة مخرجات gpt-image-2.

المعامل الوحيد الذي يؤثر على دقة المخرجات هو size، ولا شيء غيره. هذه قاعدة حاسمة ولكن يساء فهمها بشكل واسع، لذا سأستخدم تجربة مقارنة لمساعدتك في بناء حدس حولها:

| إعداد استدعاء API | دقة المخرجات الفعلية |

|---|---|

size="1024x1024" + موجه بدون كلمات 4K/8K |

1024×1024 |

size="1024x1024" + موجه يحتوي على "8K resolution" |

تبقى 1024×1024 |

size="1024x1024" + موجه يحتوي على "ultra HD 4K" |

تبقى 1024×1024 |

size="1536x1024" + موجه يحتوي على "low resolution" |

1536×1024 (الأولوية لـ size) |

size="3840x2160" + أي موجه |

3840×2160 (تجريبي) |

الاستنتاج واضح جداً: حشو الموجه بكلمات مثل "8K" أو "4K" أو "ultra HD" أو "HQ" لن يجعل صورتك أكبر أو أكثر وضوحاً، بل سيستهلك ميزانية التوكنز (token) الخاصة بالموجه بلا داعٍ.

إذاً، ما هي القيم التي يدعمها معامل size؟ يتميز gpt-image-2 بمرونة أكبر بكثير من الجيل السابق، فهو يدعم الإعدادات المسبقة والتخصيص:

| طريقة الإعداد | نطاق القيم | ملاحظات |

|---|---|---|

| إعدادات مسبقة قياسية | 1024×1024 / 1536×1024 / 1024×1536 | الأكثر استقراراً، نوصي بها للاستخدام اليومي |

| تخصيص (عادي) | العرض والارتفاع من مضاعفات 16 | مثال: 1280×720، 1600×900 |

| تخصيص (صور كبيرة) | الحد الأقصى للجانب الواحد 3840px | ما يتجاوز 2560×1440 يعتبر تجريبياً |

| قيود نسبة العرض للارتفاع | بين 1:3 و 3:1 | النسب المتطرفة جداً غير مدعومة |

| قيود إجمالي البكسلات | 655,360 ~ 8,294,400 | توجد حدود عليا وسفلى |

اترك "أوصاف الدقة" للمحتوى الأكثر قيمة في الموجه، مثل الأسلوب ("oil painting style")، التكوين ("low angle shot")، الإضاءة ("golden hour lighting")، والخامات ("matte ceramic surface")، فهذه هي العناصر التي تؤثر حقاً على جودة الصورة الناتجة.

هناك تفصيل آخر غير بديهي ولكنه مهم جداً: اختيار حجم أكبر في معامل size لا يعني بالضرورة صورة أكثر دقة. فعند اختيار دقة عالية تجريبية مثل 3840×2160، يقوم النموذج داخلياً بالتوليد بدقة منخفضة ثم إجراء "أخذ عينات فائق" (upsampling)، لذا لا تزداد كثافة التفاصيل خطياً مع عدد البكسلات، بل قد ينخفض الاتساق بسبب زيادة وقت التوليد. الخيار الأمثل لسير العمل اليومي هو 1024×1024 أو 1536×1024، فهي سريعة، غنية بالتفاصيل، وأسعار الـ API الخاصة بها هي الأكثر اقتصادية.

📌 نصيحة لتنظيف الموجه: قبل استدعاء gpt-image-2، احذف جميع الكلمات غير الفعالة من الموجه مثل "8K" و"4K" و"ultra HD" و"high resolution"، لتوفير مساحة للأوصاف المفيدة حقاً. نوصي باستخدام منصة apiyi.com لمقارنة تأثير نفس الموجه مع معاملات

sizeمختلفة، مما سيساعدك على بناء حدس دقيق حول العلاقة بين الدقة وكثافة الصورة.

تطبيق عملي لـ gpt-image-2: الكود الكامل للضغط والرفع باستخدام Python

بعد الانتهاء من الجانب النظري، دعنا ننتقل مباشرة إلى الكود القابل للتنفيذ. يقوم كود Python التالي بتنفيذ عملية كاملة تتضمن: "الضغط التلقائي للصورة لتكون أقل من 1.5 ميجابايت ← استدعاء واجهة تحرير gpt-image-2 ← حفظ النتيجة". يمكنك نسخ هذا الكود واستخدامه في مشروعك الخاص.

import io

import base64

from PIL import Image

from openai import OpenAI

# الاستدعاء عبر خدمة وكيل APIYI، لا حاجة لاتصال خارجي

client = OpenAI(

base_url="https://vip.apiyi.com/v1",

api_key="مفتاح API الخاص بك في APIYI"

)

def compress_image(input_path: str, target_kb: int = 1500) -> bytes:

"""ضغط الصورة تلقائياً لتكون أقل من الحجم المحدد، مع تفضيل صيغة WebP"""

img = Image.open(input_path).convert("RGB")

# تحديد الحد الأقصى للأبعاد بـ 2048، مع تغيير الحجم تناسبياً إذا تجاوزت ذلك

if max(img.size) > 2048:

img.thumbnail((2048, 2048), Image.LANCZOS)

# البدء بجودة 90، وتقليلها بمقدار 5 في كل مرة حتى الوصول للهدف

quality = 90

while quality >= 50:

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=quality)

if len(buf.getvalue()) <= target_kb * 1024:

return buf.getvalue()

quality -= 5

# خيار أخير: أقل جودة ممكنة

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=50)

return buf.getvalue()

# استدعاء واجهة تحرير gpt-image-2

image_bytes = compress_image("./input.png", target_kb=1500)

result = client.images.edit(

model="gpt-image-2",

image=("input.webp", image_bytes, "image/webp"),

prompt="حول هذه الصورة إلى نمط سايبربانك، إضاءة نيون، مشهد شارع في ليلة ممطرة",

size="1536x1024", # دقة المخرجات يتم تحديدها من هنا

output_format="webp", # صيغة المخرجات

output_compression=85 # مستوى ضغط المخرجات 0-100

)

# حفظ المخرجات

output_b64 = result.data[0].b64_json

with open("./output.webp", "wb") as f:

f.write(base64.b64decode(output_b64))

هناك بضع نقاط أساسية في هذا الكود تستحق التوضيح. الأولى هي أن دالة compress_image تستخدم استراتيجية "تقليل الجودة التكراري"، حيث تبدأ من 90 وتنقص بمقدار 5 حتى يصل حجم الملف إلى الهدف، مما يضمن أقصى استفادة من مساحة الضغط مع الحفاظ على جودة الصورة.

النقطة الثانية هي output_compression=85 في جانب المخرجات، حيث يعمل هذا المعامل فقط مع صيغ WebP / JPEG، ويُستخدم للتحكم في مستوى ضغط الصورة المعادة (الافتراضي هو 100 أي بدون ضغط). إذا كنت بحاجة لعرض الصورة المولدة مباشرة على صفحة ويب، فإن ضبطها بين 80-90 يوفر توازناً ممتازاً بين الجودة وسرعة التحميل.

النقطة الثالثة هي أن السطر size="1536x1024" هو الذي يحدد فعلياً دقة المخرجات، بغض النظر عما تكتبه في الموجه، ستكون الصورة الناتجة دائماً بدقة 1536×1024.

🚀 نصيحة للربط: يتوافق gpt-image-2 مع مكتبة OpenAI الأصلية، لذا يمكنك تشغيل الكود أعلاه على منصة APIYI (apiyi.com) بمجرد تغيير

base_urlوapi_key. توفر المنصة تحسيناً خاصاً للشبكة لواجهات الصور، مما يقلل بشكل كبير من احتمالية حدوث أخطاء المهلة (Timeout) أو أخطاء 413.

الأسئلة الشائعة حول رفع الصور لـ gpt-image-2

س1: أيهما أفضل للرفع، PNG أم WebP؟

تعد WebP أصغر بـ 3 إلى 5 مرات من PNG بنفس الجودة، بينما يكون التأثير بعد فك التشفير داخل gpt-image-2 متطابقاً تقريباً، لذا يُفضل استخدام WebP. ما لم تكن صورتك تحتوي على قناة شفافية (Alpha) ضرورية جداً (مثل شعار مفرغ)، فلا يوجد سبب لاستخدام PNG.

س2: كم عدد الصور المرجعية التي يمكن رفعها في المرة الواحدة؟

الحد الأقصى الرسمي هو 16 صورة، ولكن من الناحية العملية، تنخفض نسبة النجاح بشكل ملحوظ بعد تجاوز 4 صور، كما يتشتت تركيز النموذج على الصور المرجعية. ننصح باستخدام صورة مرجعية رئيسية واحدة + 1-2 صورة مرجعية للنمط، فكثرة الصور قد تؤدي إلى تشتت نمط المخرجات.

س3: هل كتابة "8K" في الموجه تعني أنني لست بحاجة للضغط؟

كلمة "8K" في الموجه هي كلمة مفتاحية غير فعالة؛ فهي لا تجعل المخرجات بدقة 8K (هذا يعتمد على size)، ولا تسمح لـ gpt-image-2 بتجاوز عملية الضغط. ننصحك بمقارنة النتائج قبل وبعد الضغط عبر لوحة تحكم apiyi.com، وستجد أن الفرق البصري يكاد لا يُذكر.

س4: ما هي أقصى دقة مخرجات يدعمها النموذج؟

يدعم size دقة تصل إلى 3840×2160، ولكن ما يتجاوز 2560×1440 يعتبر "تجريبياً" من قبل الجهة الرسمية، حيث تنخفض الاستقرارية والاتساق. في بيئة الإنتاج اليومية، نوصي بالتوقف عند دقة 1536×1024، فهي سريعة ومستقرة.

س5: هل يمكن تعديل مناطق محددة في الصورة بعد رفعها؟

نعم، يمكنك استخدام معامل mask لتحديد صورة قناع (Mask) بنفس الأبعاد، حيث سيقوم النموذج بتوليد محتوى جديد فقط في المناطق الشفافة من القناع، مع الاحتفاظ ببقية الأجزاء كما هي. هذه قدرة قوية جداً لواجهة تحرير gpt-image-2، وهي مثالية لإعادة التوليد الجزئي وتغيير الملابس.

س6: ماذا أفعل إذا كان معدل فشل استدعاء gpt-image-2 مرتفعاً؟

الاتصال المباشر بـ OpenAI من داخل البلاد غالباً ما يواجه مهلة اتصال أو فشل في مصافحة SSL، خاصة مع واجهات الصور لأن حجم البيانات (Payload) كبير. تحويل base_url إلى بوابة وكيل مثل apiyi.com، مع استخدام استراتيجية الضغط لـ 1.5 ميجابايت، يرفع نسبة النجاح الإجمالية إلى أكثر من 99%.

س7: هل جودة الصورة بعد الضغط تبدو مختلفة حقاً؟ وهل هناك احتمال للضغط الزائد؟

عند جودة WebP فوق 85 أو JPEG فوق 90، لا يوجد فرق بصري في الصور الطبيعية (الأشخاص، المناظر الطبيعية، المنتجات). ولكن في المشاهد التي تحتوي على نصوص كثيفة (ملصقات، لقطات شاشة لعروض تقديمية) أو خطوط حادة (رسومات تقنية، فن البكسل)، نوصي برفع الجودة إلى 92-95 أو استخدام PNG مباشرة، لتجنب ظهور تشوهات طفيفة حول حواف النصوص. دالة الضغط المقترحة في المقال تبدأ من 90، وهي كافية لمعظم السيناريوهات.

س8: ما الفرق بين gpt-image-2 و gpt-image-1.5 في استراتيجية الرفع؟

الاستراتيجية متطابقة بشكل عام؛ قواعد 1.5 ميجابايت للصورة الواحدة / تفضيل WebP / تحديد الدقة عبر size تنطبق على كلا النموذجين. الفرق يكمن في دعم gpt-image-2 للدقة المخصصة (مع قيد مضاعفات الرقم 16) والدقة العالية التجريبية، بينما يدعم gpt-image-1.5 إعدادات مسبقة ثابتة فقط. إذا كنت تقوم بالترحيل، يمكنك إعادة استخدام نفس كود الضغط بكل ثقة.

ملخص

بالعودة إلى السؤالين الجوهريين في بداية المقال، أصبحت الإجابات الآن واضحة تماماً.

السؤال الأول: ما هو الحجم المناسب لرفع الصور في gpt-image-2؟ تقول الوثائق الرسمية 50 ميجابايت، ولكن من الناحية العملية، يرجى ضبط الحد الأقصى الصارم ليكون أقل من 1.5 ميجابايت. هذا هو النطاق المثالي الذي يوازن بين تأخير النقل، مخاطر خطأ 413، وقت فك التشفير، وتكلفة إعادة المحاولة. الضغط بحد ذاته لا يؤدي إلى فقدان ملحوظ في الجودة بفضل الخوارزميات الحديثة، لذا لا داعي للتمسك برفع الصور الأصلية.

السؤال الثاني: ما الذي يحدد دقة المخرجات؟ الإجابة الوحيدة هي معامل size وليس الموجه. يرجى حذف كلمات وصف الدقة مثل "8K" أو "4K" أو "ultra HD" من قوالب الموجه الخاصة بك تماماً، وتوفير ميزانية الـ token الثمينة لوصف الأسلوب، والتكوين، والإضاءة التي تهمك فعلياً.

اجعل هذه القواعد جزءاً من ممارساتك البرمجية، وستلاحظ تحسناً نوعياً في سرعة استدعاء النموذج ونسبة نجاحه. ننصحك بالبدء مباشرة باستخدام كود ضغط الصور بلغة Python المذكور في هذا المقال، والاتصال بالواجهة البرمجية عبر apiyi.com للتحقق السريع، وقضاء يوم أو يومين في تجربة أفضل توليفة من المعاملات تناسب احتياجاتك.

📌 المؤلف: فريق APIYI — نركز على الممارسات الهندسية لواجهات برمجة التطبيقات متعددة الوسائط من OpenAI وAnthropic وGoogle. للمزيد من الاستخدامات المتقدمة لـ gpt-image-2 وقوالب الموجه، تفضل بزيارة مركز توثيق apiyi.com.