طرح أحد عملائنا مؤخراً سؤالاً حول صفحة "عناصر التحكم في البيانات" (Data Controls) في لوحة تحكم OpenAI، حيث لاحظ وجود مفتاحين للتبديل: "مشاركة بيانات التقييم والضبط الدقيق مع OpenAI" (Share evaluation and fine-tuning data with OpenAI) و"مشاركة المدخلات والمخرجات مع OpenAI" (Share inputs and outputs with OpenAI). كل مفتاح يتيح ثلاثة خيارات: "معطل" (Disabled)، "مفعل لجميع المشاريع" (Enabled for all projects)، أو "مفعل لمشاريع محددة" (Enabled for selected projects). يظهر بجانب المفتاح الأول تنبيه أخضر يقول: "أنت مؤهل للحصول على ما يصل إلى 7 تقييمات مجانية أسبوعياً"، بينما يشير الثاني إلى أنك "مسجل للحصول على رموز (Tokens) يومية مجانية". يبدو الأمر وكأنه عرض للحصول على موارد مجانية، لكن العميل لم يكن متأكداً مما إذا كان تفعيلها يستحق العناء، وما هي التكلفة الخفية وراء ذلك.

في جوهرها، تعد هذه المفاتيح بمثابة صفقة تبادلية بين OpenAI والمستخدم: "أرصدة مجانية" مقابل "بيانات للتدريب والتقييم". إن ثمن التفعيل حقيقي وملموس، حيث ستستخدم OpenAI بيانات التقييم ومدخلات ومخرجات الـ API الخاصة بك لتحسين نماذجها المستقبلية. من خلال عملنا مع عملاء APIYI (عبر apiyi.com)، رأينا حالات قام فيها المستخدمون بتفعيل هذه الخيارات لأشهر قبل أن يدركوا أنها ثغرة في خصوصية بياناتهم، ورأينا آخرين عطلوا هذه الخيارات لشهور ثم اكتشفوا أنهم أهدروا ملايين الرموز (Tokens) المجانية يومياً. في هذا المقال، سنقوم بتفكيك الدور الحقيقي لهذين المفتاحين، وحجم الأرصدة المتاحة، وتأثيرهما على الخصوصية، مع تقديم توصيات واضحة للإعدادات المثالية.

التعريف الأساسي لإعدادات التحكم في بيانات OpenAI

عند فتح صفحة Settings → Data Controls → Sharing، ستجد خيارين منفصلين غالبًا ما يتم الخلط بينهما. يختلف هذان الخياران في المحتوى الذي تتم مشاركته، والعوائد، وتأثير الخصوصية، لذا فإن فهم الحدود الفاصلة بينهما هو شرط أساسي لاتخاذ القرار الصحيح.

| إعداد | مشاركة بيانات التقييم والضبط الدقيق (Fine-tuning) | مشاركة المدخلات والمخرجات |

|---|---|---|

| المحتوى المشترك | موجهات التقييم + النتائج + منطق التقييم + بيانات الضبط الدقيق | جميع مدخلات ومخرجات استدعاء النموذج عبر API |

| العائد المجاني | ما يصل إلى 7 عمليات تقييم مجانية أسبوعيًا | دعم يومي بالرموز (Tokens) (يُوزع حسب المستوى ومجموعة النماذج) |

| استخدام البيانات | تحسين خط أنابيب التقييم + تدريب النماذج المستقبلية | تُستخدم مباشرة لتدريب / تحسين النماذج |

| الحالة الافتراضية | معطل (Disabled) | معطل (Disabled) |

| دقة التحكم | ثلاث مستويات: معطل / الكل / محدد | ثلاث مستويات: معطل / الكل / محدد |

| صلاحيات التشغيل | مالك المؤسسة فقط | مالك المؤسسة فقط |

| نطاق التأثير | البيانات الناتجة بعد التفعيل فقط | حركة البيانات الناتجة بعد التفعيل فقط |

| سهولة الإيقاف | يمكن التبديل في أي وقت | يمكن التبديل في أي وقت |

🎯 نصيحة للفهم السريع: إذا كنت ترغب فقط في "الحصول على الرصيد المجاني بأمان"، يمكنك ضبط المفتاح على "Enabled for selected projects"، وإنشاء مشروع اختبار منفصل لتشغيل البرامج النصية (Scripts) الداخلية أو التطويرية، مع توجيه حركة مرور API للمشروع الرئيسي والإنتاجي عبر خدمة وكيل API من APIYI (apiyi.com)، لتجنب تعريض جميع مشاريعك لخط أنابيب تدريب البيانات دفعة واحدة.

شرح مفصل لإعداد مشاركة بيانات التقييم والضبط الدقيق (Eval/FT)

المعنى الحرفي لهذا المفتاح هو "مشاركة بيانات التقييم والضبط الدقيق"، ولكن النطاق الفعلي للمشاركة أوسع مما يوحي به الاسم. بمجرد التفعيل، لن تحصل OpenAI على موجهات التقييم (eval prompts) والمخرجات (completions) فحسب، بل ستحصل أيضًا على منطق التقييم (grading logic) الذي تحدده، بالإضافة إلى الموجهات والمخرجات الموجودة في مجموعات بيانات الضبط الدقيق. هذا يعني أن كيفية تقييمك للنموذج، وما تعتبره إجابة جيدة، والمعرفة المتخصصة في بيانات التدريب الخاصة بك، سيتم جمعها جميعًا بواسطة OpenAI.

العائد هو ما يصل إلى 7 عمليات تقييم مجانية أسبوعيًا. توضح OpenAI في مركز المساعدة أن "عمليات التقييم التي تشاركها مع OpenAI تتم معالجتها حاليًا بدون تكلفة لما يصل إلى 7 عمليات في الأسبوع". أي تجاوز لهذا الحد أو استخدام نماذج لا تشارك في العرض المجاني سيتم محاسبته وفقًا لأسعار الرموز القياسية. قد يبدو هذا الرقم صغيرًا، لكن بالنسبة للفرق التي تجري مقارنات لاختيار النماذج بشكل متكرر، يمكن أن توفر هذه العمليات المجانية مئات الدولارات من تكاليف التقييم.

من الجدير بالذكر أن هذا المفتاح يسري فقط على البيانات التي يتم إنشاؤها بعد التفعيل؛ فالبيانات التاريخية لن يتم مشاركتها بأثر رجعي، كما أن إيقاف التشغيل لا يعني "سحب" البيانات التي تمت مشاركتها بالفعل. لذا يجب أن يستند قرارك إلى "كمية بيانات التقييم التي تنوي مشاركتها خلال الـ 6-12 شهرًا القادمة"، وليس "ما هي البيانات الموجودة لدي الآن".

| البعد | فوائد التفعيل | تكلفة التفعيل |

|---|---|---|

| الفوائد المباشرة | 7 عمليات تقييم مجانية أسبوعيًا | / |

| الفوائد غير المباشرة | تحسين خط أنابيب التقييم من قبل OpenAI | / |

| تكلفة البيانات | / | جمع موجهات التقييم، المخرجات، ومعايير التقييم |

| تكلفة الأعمال | / | تسريب المعرفة المتخصصة (Know-how) من مجموعات بيانات الضبط الدقيق |

| القابلية للعكس | يمكن إيقافه في أي وقت | البيانات المشتركة لا يمكن استردادها |

🎯 متى يجب تفعيل مشاركة Eval/FT: إذا كان تقييمك يعتمد على معايير قياسية عامة (Benchmarks) أو مجموعات اختبار غير حساسة، فإن التفعيل غير ضار أساسًا؛ أما إذا كانت موجهات التقييم تحتوي على بيانات عملاء حقيقية، أو قواعد عمل داخلية، أو منطق تقييم خاص، فمن المستحسن ضبطه على وضع "Selected" وتفعيله فقط لمشاريع "صندوق الرمل" (Sandbox).

شرح إعدادات مشاركة المدخلات والمخرجات (Share inputs and outputs)

يُعد هذا الخيار أحد المفتاحين اللذين يحملان "تكلفة أعلى، ولكن عائداً أكبر". عند تفعيله، فإن أي استدعاء للنموذج (API call) يمر عبر هذا المشروع، سيتم جمع الموجه (prompt) المدخل والمخرجات (completion) الناتجة عنه بواسطة OpenAI واستخدامها لتدريب أو تحسين نماذجها. يختلف هذا الأمر جوهرياً عن سلوك API الافتراضي؛ فمنذ مارس 2023، أكدت OpenAI صراحةً أنها لا تستخدم بيانات API لتدريب نماذجها، لذا فإن تفعيل هذا الخيار يعني التنازل طواعية عن هذه الحماية.

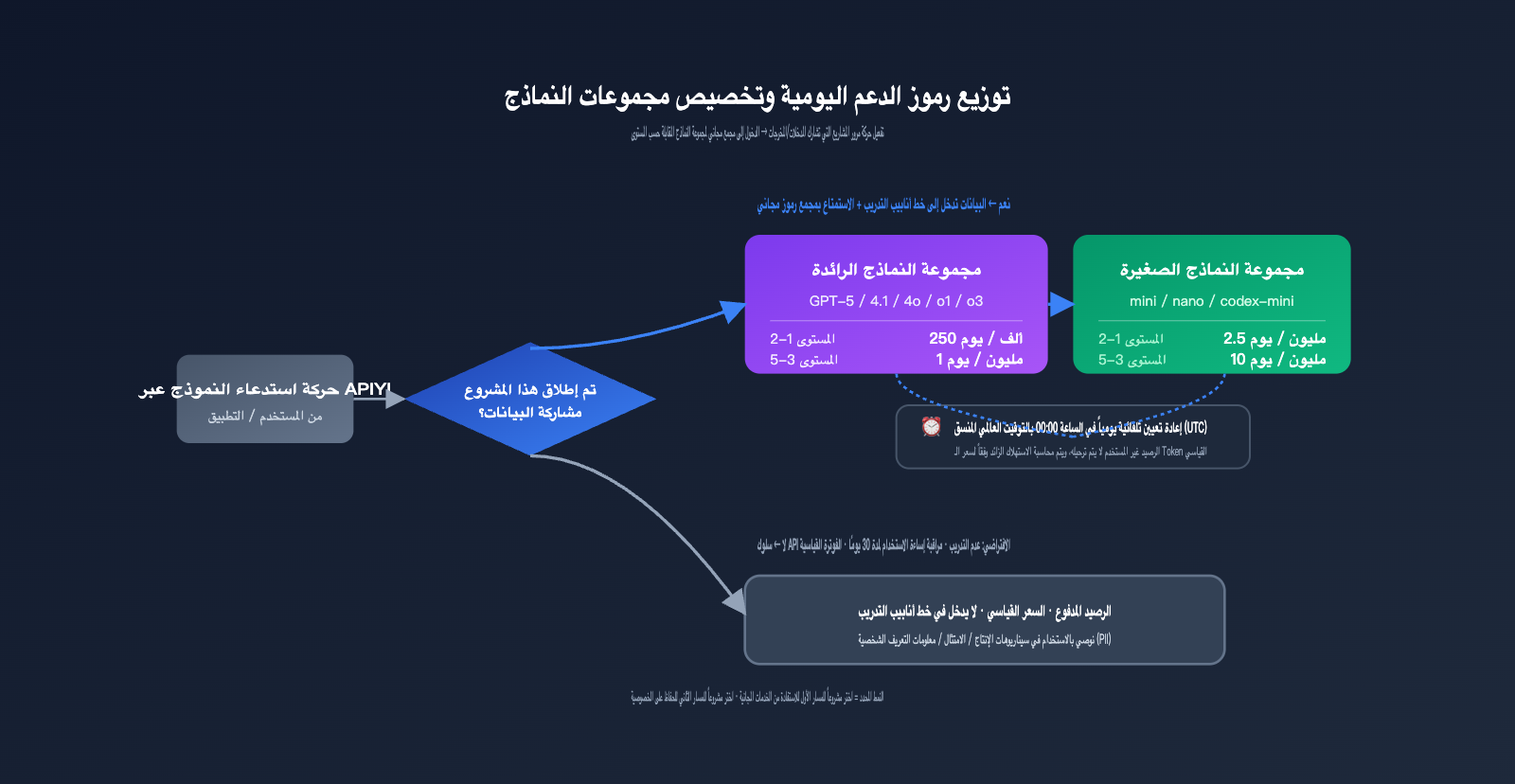

في المقابل، ستحصل على "رموز يومية مجانية" (complimentary daily tokens)، تُمنح بناءً على فئة حسابك (Tier) ومجموعة النماذج. تُعد هذه الخطة أوضح نظام حصص مجانية في بيانات OpenAI المعلنة، ويتم إعادة تعيينها تلقائياً في الساعة 00:00 بالتوقيت العالمي المنسق (UTC).

| مجموعة النماذج | الحد اليومي (Tier 1-2) | الحد اليومي (Tier 3-5) | وقت إعادة التعيين |

|---|---|---|---|

| مجموعة النماذج الرائدة | 250,000 رمز | 1,000,000 رمز | 00:00 UTC |

| مجموعة النماذج الصغيرة | 2,500,000 رمز | 10,000,000 رمز | 00:00 UTC |

لا يتم تقسيم هذه المجموعات بناءً على الأداء فحسب، بل وفق قائمة محددة بوضوح من قبل OpenAI؛ حيث لا تُحتسب استدعاءات النماذج خارج هذه القائمة ضمن الحصة المجانية.

| مجموعة النماذج | النماذج المشمولة |

|---|---|

| المجموعة الرائدة | gpt-5, gpt-5-codex, gpt-5-chat-latest, gpt-4.5-preview, gpt-4.1, gpt-4o, o1, o3, o1-preview |

| المجموعة الصغيرة | gpt-5-mini, gpt-5-nano, gpt-4.1-mini, gpt-4.1-nano, gpt-4o-mini, o1-mini, o4-mini, codex-mini-latest |

🎯 القيمة الحقيقية لحصص الرموز: بناءً على تقدير تكلفة gpt-4o-mini بـ $0.15 للمليون رمز للمدخلات و$0.60 للمليون رمز للمخرجات، فإن 2.5 مليون رمز يومي للنماذج الصغيرة في Tier 1-2 تعادل حوالي $1-2 من الرصيد المجاني يومياً، مما يوفر $30-60 شهرياً؛ بينما في Tier 3-5 ترتفع الحصة إلى 10 مليون رمز يومي، مما يوفر $120-240 شهرياً. إذا كان هدفك هو الحصول على هذه الحصة فقط، فليس من المجدي تفعيل المشاركة على مستوى المؤسسة بالكامل، بل يُنصح بإنشاء مشروع اختبار مستقل وتعيينه على وضع "محدد" (Selected).

الفرق الحقيقي بين خصوصية API الافتراضية وتفعيل المشاركة

لا يزال الكثير من الفرق يسيئون فهم مسألة "هل يتم استخدام بيانات API الافتراضية في التدريب؟". السياسة الفعلية لشركة OpenAI هي: لا تُستخدم بيانات API الافتراضية في التدريب، ولكنها تُحتفظ بها لمدة 30 يومًا لأغراض مراقبة إساءة الاستخدام (Abuse Monitoring). أما "الاحتفاظ الصفري بالبيانات" (Zero Data Retention – ZDR) فهو أمر مختلف تمامًا، ويتطلب من عملاء المؤسسات التواصل مع فريق مبيعات OpenAI لطلبه، ولا يمكن تفعيله بضغطة زر من لوحة التحكم.

بعد فهم هذا الأساس، يصبح تأثير الخيارات الأخرى واضحًا: تفعيل خيار (Inputs/Outputs) يعني "التنازل الطوعي عن حماية التدريب المطبقة منذ عام 2023"، وتفعيل خيار (Eval/FT) يعني "المساهمة الإضافية في منهجية التقييم". كلاهما لا يؤثر على فترة الاحتفاظ لمدة 30 يومًا للمراقبة، ولا يمكن دمجهما مع ميزة ZDR.

| البعد | API الافتراضي (كلاهما مغلق) | تفعيل Inputs/Outputs | تفعيل Eval/FT Data |

|---|---|---|---|

| هل تُستخدم للتدريب | ❌ لا تُستخدم | ✅ تُستخدم للتدريب | ✅ تدريب + تقييم |

| الاحتفاظ للمراقبة | 30 يومًا | 30 يومًا | 30 يومًا |

| هل يمكن استرداد البيانات | / | ❌ لا يمكن استردادها | ❌ لا يمكن استردادها |

| توافق ZDR | ✅ يمكن طلب ZDR | ❌ يتعارض مع الخيار | ❌ يتعارض مع الخيار |

| سيناريو الاستخدام | الإنتاج / الامتثال / PII | التطوير / الاختبار / بيانات عامة | تقييم المعايير العامة |

🎯 نصيحة بشأن خصوصية البيانات: إذا كان عملك يتطلب أي متطلبات امتثال (مثل GDPR أو HIPAA أو اتفاقيات عدم الإفصاح أو بيانات العملاء الشخصية PII)، فيجب إبقاء كلا الخيارين معطلين (Disabled)، وتوجيه حركة البيانات عالية الحساسية عبر بوابة APIYI (apiyi.com) أو طلب ميزة ZDR. أما إذا كانت مشاريع شخصية أو أدوات داخلية أو عروضاً تجريبية، فيمكنك تفعيلها (Enabled) بكل ثقة.

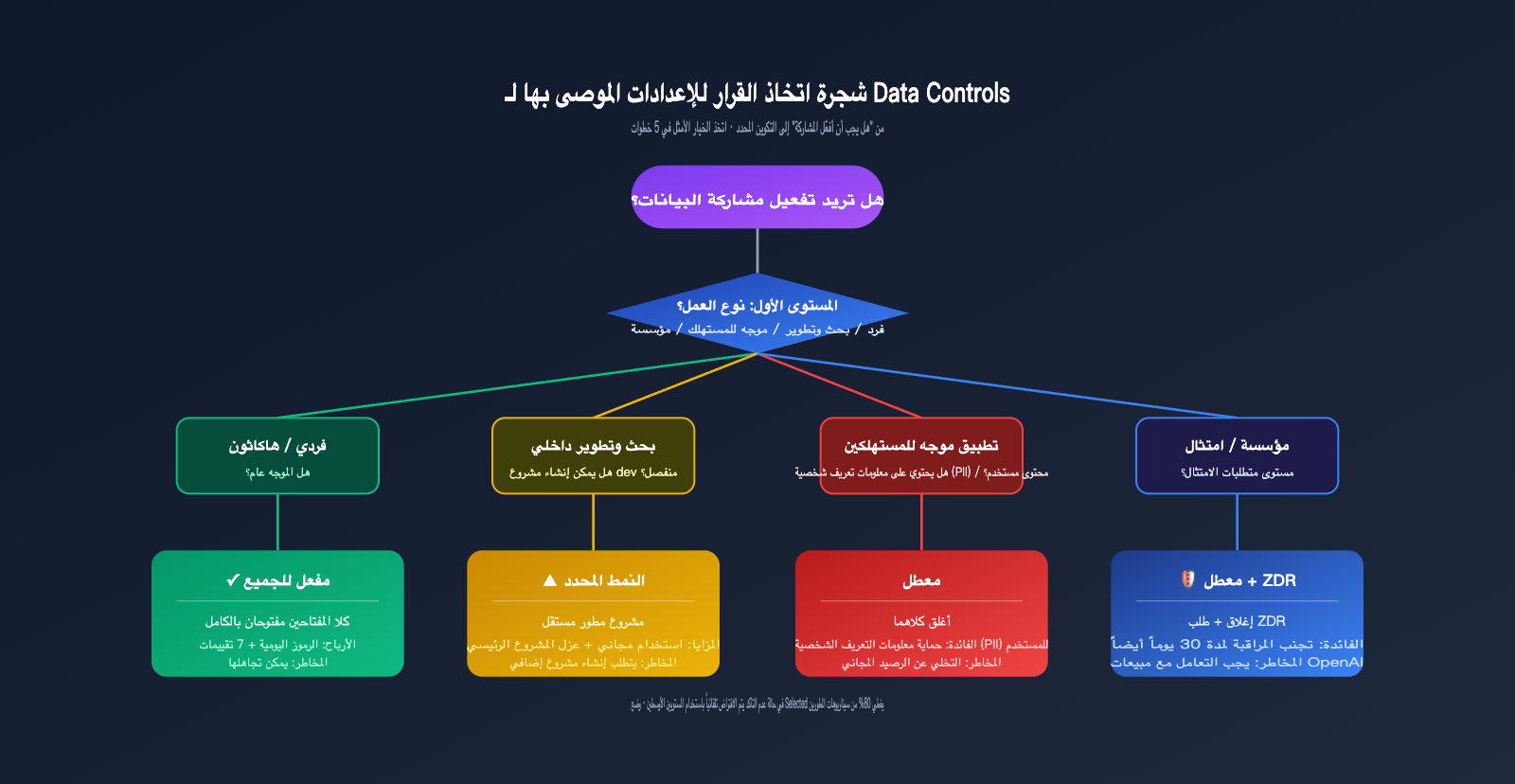

إطار عمل لاتخاذ القرار: هل يستحق تفعيل عناصر التحكم في بيانات OpenAI؟

تقديم إجابة "نعم/لا" مباشرة ليس دقيقًا. سنستخدم مصفوفة مكونة من 4 فئات من سيناريوهات الأعمال، حيث لكل فئة تكوينها المناسب. يعتمد القرار على بُعدين أساسيين: حساسية البيانات (هل المحتوى الذي تعالجه يتضمن خصوصية أو أسرارًا تجارية؟) وحجم الاستدعاءات (ما القيمة الفعلية التي يمكنك الحصول عليها من الحصص المجانية؟).

| نوع العمل | حساسية البيانات | توصية Inputs/Outputs | توصية Eval/FT |

|---|---|---|---|

| تطوير شخصي / Hackathon | منخفضة | Enabled for all | Enabled for all |

| بحث وتطوير داخلي | متوسطة | Enabled for selected | Enabled for selected |

| تطبيقات To-C (تتضمن PII) | عالية | Disabled أو Selected | Disabled |

| مؤسسات / سيناريوهات امتثال | عالية جداً | Disabled + ZDR | Disabled |

الفئة الأولى هي المشاريع الشخصية أو الـ Hackathon. في هذه الحالة، استهلاك الـ Token يكون عادةً لموجهات (prompts) عامة، لذا فإن تفعيل المشاركة يمنحك دعمًا يوميًا دون كشف أي معلومات حساسة. الفئة الثانية هي البحث والتطوير الداخلي، ونوصي باستخدام نمط "Selected" — أي إنشاء مشروع منفصل باسم "data-share-test" مخصص للتجارب القابلة للمشاركة، مع إبقاء المشاريع الرئيسية معطلة.

الفئة الثالثة هي تطبيقات To-C، والتي غالبًا ما تتضمن مدخلات المستخدم أو سجل المحادثات أو معلومات شخصية. في هذه الحالة، يُنصح بإغلاق كلا الخيارين، حيث أن الحصة المجانية لا تقدم فائدة كبيرة مقارنة بمخاطر تسرب بيانات المستخدمين. الفئة الرابعة هي المؤسسات أو سيناريوهات الامتثال (مثل الرعاية الصحية أو التمويل)، حيث يجب استخدام ZDR أو بوابة امتثال مثل APIYI (apiyi.com) لتجنب حتى فترة الـ 30 يومًا للمراقبة.

🎯 كيف تختار بين الخيارات الثلاثة: إذا قررت تفعيل خيار ما، فامنح الأولوية لـ "Enabled for selected projects" بدلاً من "Enabled for all projects". بهذه الطريقة، يمكنك تخصيص مشروع "training-eligible" للاختبار والتطوير، مع إبقاء مشاريع الإنتاج معزولة، مما يجعل تكلفة التغيير المستقبلية منخفضة للغاية.

الأسئلة الشائعة حول عناصر التحكم في بيانات OpenAI

س1: هل ستأخذ OpenAI جميع بياناتي التاريخية فور تفعيل خيارات المدخلات/المخرجات (Inputs/Outputs)؟

لا. كلا المفتاحين ينصان بوضوح على: "Only traffic sent after turning this setting on will be shared" / "Only evaluation and fine-tuning data created after turning this setting on will be shared". أي أن المفاتيح تسري فقط على البيانات التي يتم إنشاؤها بعد التفعيل، ولن يتم استرجاع أو مشاركة البيانات التاريخية.

س2: هل الرموز (Tokens) المجانية هي نفس منح الائتمان (Credit Grants)؟

ليست نفس الشيء ولكن بينهما ارتباط. ما تحصل عليه من مشاركة المدخلات/المخرجات هو "مجمع رموز يومي" (Daily Token Pool) يُعاد تعيينه تلقائيًا في الساعة 00:00 بالتوقيت العالمي المنسق (UTC)؛ أما "السنتاوات الصغيرة" التي تراها في قسم منح الائتمان (Credit Grants) في لوحة تحكم OpenAI فهي مجرد محاسبة لاحقة لقيمة هذا المجمع بالدولار بناءً على الاستخدام، ويمكنك اعتبارها طريقتين لعرض نفس المشروع.

س3: إذا قمت بتفعيل وضع "محدد" (Selected) لمشروع واحد فقط، هل تكون حركة مرور المشروع الرئيسي آمنة تمامًا؟

آمنة تمامًا. تتيح لك واجهة إعدادات OpenAI اختيار المشاريع التي تشارك في عملية التدريب بدقة، أما حركة مرور المشاريع غير المحددة فتُعامل وفقًا لسلوك API الافتراضي — أي لا يتم تدريب النموذج عليها، مع الاحتفاظ بها لمدة 30 يومًا لأغراض مراقبة الانتهاكات. إذا كان لديك قلق إضافي، يمكنك توجيه حركة مرور المشروع الرئيسي عبر خدمة وكيل API مثل APIYI (apiyi.com) لعزلها تمامًا من الناحية المعمارية.

س4: كيف يتم احتساب "7 تقييمات مجانية أسبوعيًا" (7 free weekly evals)؟

يتم احتسابها بناءً على "عدد مرات التشغيل"، وليس بناءً على عدد الرموز (Tokens). كل مرة تشغيل للتقييم (بغض النظر عن عدد العينات المعالجة) تُحسب كمرة واحدة، بحد أقصى 7 مرات مجانية أسبوعيًا. بعد تجاوز هذا الحد، يتم المحاسبة وفقًا لسعر الرموز القياسي للنموذج المستخدم، علمًا بأن بعض النماذج ليست ضمن قائمة التقييم المجاني وسيتم محاسبتك عليها عند التشغيل.

س5: هل يمكن استعادة البيانات التي تم جمعها بالفعل بعد إيقاف تشغيل خيارات المدخلات/المخرجات؟

لا. تنص سياسة OpenAI بوضوح على أن البيانات التي تمت مشاركتها لا يمكن التراجع عنها، وإيقاف المفاتيح يمنع فقط دخول البيانات المستقبلية إلى خط أنابيب التدريب. ولهذا السبب ننصح دائمًا باستخدام خدمة وكيل API مثل APIYI (apiyi.com) لحركة مرور الإنتاج لتحقيق "عزل صلب" — حيث لا تدخل البيانات افتراضيًا إلى خط أنابيب تدريب OpenAI، وهو إجراء أكثر موثوقية من "الإيقاف اللاحق".

3 خلاصات حول عناصر التحكم في بيانات OpenAI

أولاً، هذان المفتاحان هما "صفقة تبادلية" حقيقية: أنت تستخدم بيانات قابلة للقياس (منهجية التقييم، مدخلات ومخرجات API) مقابل ميزات مجانية قابلة للقياس (7 تقييمات أسبوعيًا، ملايين الرموز يوميًا). فهم أن هذا تبادل وليس مجرد عطاء سيجعل قراراتك أكثر دقة.

ثانياً، واجهة API الافتراضية لا تستخدم بياناتك للتدريب، لكن مراقبة الانتهاكات لمدة 30 يومًا لا تزال قائمة. إذا كان عملك يتطلب امتثالًا صارمًا للخصوصية، فيجب تعطيل كلا المفتاحين (Disabled)، واستخدام طلب ZDR أو خدمة وكيل API مثل APIYI (apiyi.com) لتعزيز القيود. المفاتيح تقرر فقط "هل يتم منح تفويض إضافي للتدريب"، ولا تقرر "هل يتم مراقبة البيانات".

ثالثاً، استخدم وضع "محدد" (Selected) لعزل المشاريع. أنشئ مشروعًا مستقلاً مخصصًا لبيانات التطوير (dev) والاختبار التي يمكن مشاركتها، وافصل مشروع الإنتاج والبيانات الحساسة تمامًا. بهذه الطريقة تحصل على الميزات المجانية دون السماح لأي بيانات مستخدم بالتدفق إلى خط أنابيب التدريب، وهي الطريقة الأكثر كفاءة من حيث التكلفة.

إذا كنت توازن بين هذين المفتاحين، فإن الطريقة الأكثر أمانًا هي تصنيف عملك إلى أربع فئات (شخصي / داخلي / موجه للمستهلك / مؤسسي)، ثم استخدام وضع "محدد" (Selected) لإنشاء مشروع اختبار مستقل للحصول على الميزات المجانية، مع توجيه حركة مرور الإنتاج الرئيسية عبر بوابة APIYI (apiyi.com) لتحقيق العزل المعماري. بهذه الطريقة، يمكنك الاستمتاع بسياسات OpenAI المجانية مع الحفاظ على خصوصية بيانات المستخدمين ومعرفة العمل (know-how).

📌 الكاتب: فريق APIYI التقني — نتابع باستمرار تغييرات السياسات الرئيسية مثل OpenAI Data Controls، وZDR، واستراتيجيات الفوترة، ونقدم للمطورين تجربة بوابة API متعددة النماذج مع فوترة موحدة وخصوصية قابلة للتحكم. لمعرفة المزيد، تفضل بزيارة APIYI (apiyi.com).