أعلنت OpenAI رسمياً عبر إشعارات المطورين في 24 مارس 2026: تحديد موعد إيقاف Sora-2 API في 24 سبتمبر 2026. وهذا يعني أن جميع أعمال توليد الفيديو التي تعتمد على sora-2 و sora-2-pro وواجهة برمجة تطبيقات الفيديوهات (Videos API) يجب أن تكتمل عملية ترحيلها في أقل من ستة أشهر.

والأمر الأكثر إثارة للقلق هو أن ما يسمى بـ "Sora API العكسي" الذي انتشر في السوق خلال الأشهر الستة الماضية أصبح غير قابل للاستخدام تقريباً بعد أن شددت OpenAI إجراءات التحكم في المخاطر؛ لذا فإن الاستمرار في الاعتماد على هذا المسار لن يؤدي إلا إلى تعثر أعمالكم. يقدم هذا المقال تحليلاً كاملاً لجدول إيقاف Sora-2 API، ونطاق التأثير الرسمي، ويوصي ببديلين جاهزين للإنتاج الفعلي بناءً على بيانات الاختبار الحقيقية: SeeDance 2.0 من ByteDance و Wan 2.7 من Alibaba Tongyi.

إذا كنت تستخدم Sora-2 API في إنتاج محتوى الفيديو، فنحن نوصي بإجراء اختبارات مقارنة بين SeeDance 2.0 و Wan 2.7 عبر منصة APIYI (apiyi.com)، حيث قامت المنصة بدمج العديد من نماذج توليد الفيديو السائدة بشكل موحد، مما يساعد في تقليل تكاليف الترحيل إلى أدنى حد.

جدول إيقاف Sora-2 API ونطاق التأثير

الجدول الزمني الرسمي لإيقاف Sora-2 API

اعتمدت OpenAI استراتيجية إغلاق على مرحلتين لمنتج Sora: إيقاف تطبيقات المستخدمين العاديين (C-end) أولاً، ثم إيقاف واجهة برمجة التطبيقات (API) للمطورين (B-end) لاحقاً، مع ترك فترة انتقالية تبلغ حوالي 5 أشهر للمطورين للترحيل. تعد هذه واحدة من أكثر عمليات "الهبوط الناعم" اكتمالاً في تاريخ OpenAI لخط إنتاج معين، لكن النافذة الزمنية المتاحة للمطورين لا تزال ضيقة للغاية.

| التاريخ | الحدث | الفئة المتأثرة | الفترة الانتقالية |

|---|---|---|---|

| 2026-03-24 | صدور الإشعار الرسمي | جميع مستخدمي Sora-2 API | T+0 |

| 2026-04-26 | إغلاق موقع وتطبيق Sora | المستخدمون العاديون وصناع المحتوى | T+33 يوم |

| 2026-09-24 | الإيقاف الرسمي لـ Sora-2 API | جميع الأعمال المعتمدة على API | T+184 يوم |

| بعد 2026-09-25 | ظهور خطأ 410 Gone | انقطاع كامل للأعمال غير المُرَحَّلة | — |

توصي OpenAI بوضوح في مركز المساعدة الخاص بها: إذا كنت ترغب في الاحتفاظ بمحتوى الفيديو الذي تم إنشاؤه مسبقاً على Sora، فتأكد من تصدير البيانات قبل إغلاق التطبيق في 26 أبريل. ولكن بالنسبة للمطورين الذين يعتمدون على واجهة برمجة التطبيقات، فإن الموعد النهائي الحقيقي هو 24 سبتمبر.

تجدر الإشارة إلى أن OpenAI لم تعد بأي إمكانية "للتمديد". وبالنظر إلى حالات إيقاف النماذج السابقة من OpenAI منذ عام 2025، فقد أصبح الإغلاق عند انتهاء الموعد إجراءً قياسياً، لذا لا ينبغي المراهنة على أي استثناءات.

قائمة النماذج المتأثرة بإيقاف Sora-2 API

تعتقد العديد من الفرق أن اسم المستعار sora-2 فقط هو الذي سيتوقف، ولكن في الواقع، هذا الإيقاف يشمل مجموعة كاملة من نماذج Videos API:

| معرف النموذج (Model ID) | النوع | الحالة | البديل المقترح |

|---|---|---|---|

sora-2 |

إصدار قياسي | متوقف | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

إصدار عالي الدقة | متوقف | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

لقطة إصدار قياسي | متوقف | SeeDance 2.0 |

sora-2-2025-12-08 |

لقطة إصدار قياسي | متوقف | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

لقطة إصدار Pro | متوقف | Wan 2.7 (يتضمن وضع التفكير) |

| Videos API (مجموعة الواجهات) | نقطة نهاية API | إيقاف كلي | منصة تجميع متوافقة مع البروتوكول |

بمعنى آخر، لن تحتفظ OpenAI بأي مدخل لـ API توليد الفيديو، واعتباراً من 25 سبتمبر، ستعيد جميع الطلبات التي تبدأ بـ videos خطأ 410 Gone أو خطأ في الخدمة. يختلف هذا تماماً عن الممارسات السابقة لسلسلة نماذج GPT التي كانت "توقف اللقطات (snapshots) ولكن تحتفظ بالأسماء المستعارة"، فهذا خروج كامل على مستوى خط الأعمال.

🎯 معلومات أساسية: هذا يعني أنه لا يمكنك ببساطة "تغيير اسم النموذج" لإتمام الترحيل، بل يجب عليك الانتقال إلى API مختلف تماماً لتوليد الفيديو. نوصي بإكمال اختبارات الوصول للحلول الجديدة قبل نهاية يونيو، ويمكنك المقارنة بين SeeDance 2.0 و Wan 2.7 عبر منصة تجميع لتجنب ضغوط الترحيل في الشهرين الأخيرين.

الأسباب الحقيقية لإيقاف Sora-2 API

لم تقدم OpenAI تفسيراً مفصلاً، ولكن بناءً على تحليلات وسائل إعلام أجنبية مثل The Decoder و Futurum Group و Wikipedia، يمكن تلخيص الأسباب الرئيسية في ثلاثة مستويات:

- تكاليف الحوسبة غير المستدامة: تتطلب عملية توليد الفيديو الواحدة وقتاً من وحدات معالجة الرسومات (GPU) يعادل عشرات أضعاف نماذج النصوص، ولم تغطِ الإيرادات التجارية هذه التكاليف. بعد إطلاق Sora-2، اضطرت OpenAI لفرض قيود صارمة على حصة كل مستخدم لفترة طويلة، مما أدى بدوره إلى تثبيط رغبة المطورين في التكامل.

- مخاطر أمن المحتوى العالية: حتى مع وجود علامات مائية وفحص للمحتوى، استمر ظهور حالات تزييف عميق ونزاعات حقوق طبع ونشر، مما جعل التكاليف القانونية والامتثال تتجاوز قيمة النموذج نفسه.

- التركيز الاستراتيجي: تعطي OpenAI الأولوية لموارد الحوسبة لخطوط أعمال GPT و Operator و Agent، ولم يعد الفيديو اتجاهاً أساسياً في الوقت الحالي.

إن فهم هذه الأسباب مهم جداً لاختيار البديل؛ فالشركات التي يمكنها الاستمرار في الاستثمار في توليد الفيديو هي حتماً تلك التي تعتبر الفيديو مساراً استراتيجياً رئيسياً. وقد اعتبرت كل من ByteDance و Alibaba توليد الفيديو اتجاهاً استراتيجياً مهماً، مما يجعل وتيرة تحديث منتجاتهما أسرع بكثير من OpenAI، وهو السبب الجوهري وراء قدرتهما على استيعاب قاعدة مستخدمي Sora-2 بسرعة في عام 2026.

لماذا لم تعد "واجهة برمجة تطبيقات Sora العكسية" خياراً قابلاً للاستمرار

الوضع الراهن لواجهات برمجة تطبيقات Sora العكسية في عام 2026

على مدار الأشهر الستة الماضية، انتشرت في الأوساط التقنية واجهات برمجة تطبيقات (API) عكسية تدعي القدرة على "استدعاء Sora-2 دون الحاجة إلى حساب OpenAI"، بأسعار تتراوح بين جزء بسيط إلى جزء من عشرة من السعر الرسمي. ومع ذلك، وبناءً على ملاحظات المطورين في مجتمعات تقنية متعددة، أصبحت هذه الواجهات غير قابلة للاستخدام عملياً بعد الربع الأول من عام 2026:

- قامت OpenAI في يناير 2026 بتحديث قواعد الحماية الخاصة بـ Cloudflare، مما أدى إلى حظر عدد كبير من الواجهات العكسية وإرجاع خطأ 403.

- يعتمد بعض مزودي الخدمات العكسية على "مجمعات حسابات"، وقد شددت OpenAI إجراءات حظر الحسابات غير الطبيعية، مما أدى إلى تعطل المجمعات بالكامل.

- حتى في الحالات التي تنجح فيها عملية الاستدعاء، تكون سرعة التوليد بطيئة للغاية ومعدل النجاح أقل من 30%، مما يجعلها غير صالحة للاستخدام في بيئات الإنتاج.

- بدأ المزيد من مزودي هذه الخدمات في التوقف عن العمل أو تغيير نشاطهم، مما يعرض الأرصدة المدفوعة مسبقاً لخطر الضياع.

والأهم من ذلك، بما أن OpenAI قررت إيقاف واجهة برمجة التطبيقات الرسمية في 24 سبتمبر، فإن "المصدر" الذي تعتمد عليه هذه الواجهات العكسية سيختفي تماماً، وستصبح هذه المسارات بلا قيمة بعد سبتمبر.

3 أسباب تدعوك للتوقف عن الاستثمار في الحلول العكسية

| بُعد المخاطر | المظاهر العملية | العواقب على الأعمال |

|---|---|---|

| مخاطر الاستقرار | حظر الواجهات في أي وقت، غياب اتفاقية مستوى الخدمة (SLA) | انقطاع مفاجئ في بيئة الإنتاج |

| مخاطر الامتثال | انتهاك شروط خدمة OpenAI، احتمالية التورط في بيع الحسابات | عرقلة الشؤون القانونية والتعاون التجاري |

| التكاليف الغارقة | إيقاف الخدمة الرسمية بعد سبتمبر، مما يبطل الحلول العكسية | هدر الموارد في عمليات الترحيل المتكررة |

| مخاطر البيانات | إمكانية وصول الوكلاء الخارجيين إلى الموجهات والمحتوى المولد | تسريب الأسرار التجارية |

⚠️ توصية قوية: إذا كان فريقك لا يزال يستخدم أي شكل من أشكال واجهات برمجة تطبيقات Sora العكسية، يرجى التوقف فوراً عن تطوير ميزات جديدة، وتقييم البدائل الرسمية المتوافقة. نوصي بالاتصال عبر منصات التجميع المعتمدة للوصول إلى SeeDance 2.0 أو Wan 2.7، لضمان استقرار الخدمة وتجنب مشاكل الامتثال المستقبلية.

البديل الأول لواجهة برمجة تطبيقات Sora-2: SeeDance 2.0

الموقع الاستراتيجي لـ SeeDance 2.0

يعد SeeDance 2.0 نموذجاً رائداً لتوليد الفيديو، أطلقه فريق نماذج اللغة الكبيرة "Doubao" التابع لشركة ByteDance رسمياً في 9 فبراير 2026. وقد تم إتاحته للاختبار العام على منصة BytePlus ModelArk في 14 أبريل، وأصبح متاحاً للاستدعاء عبر منصة fal في 9 أبريل. في قائمة تصنيف نماذج الفيديو على موقع Artificial Analysis، حقق SeeDance 2.0 نتيجة Elo 1269، متجاوزاً نماذج Google Veo 3 وOpenAI Sora 2 وRunway Gen-4.5، ليحتل المركز الأول في التصنيفات العامة الحالية.

تكمن ميزته الكبرى في اعتماده على بنية موحدة لتوليد الصوت والفيديو متعدد الوسائط، حيث لا يحتاج إلى توليد الفيديو أولاً ثم إضافة الصوت، بل يخرج محتوى صوتياً ومرئياً بجودة سينمائية يصل طوله إلى 15 ثانية في استنتاج واحد. هذه القدرة على "التزامن بين الصوت والصورة" هي ميزة لا يمكن لـ Sora-2 مضاهاتها، حيث يعتمد الأخير على توليد الفيديو ثم ربطه بنظام تحويل النص إلى كلام (TTS) خارجي.

نظرة عامة على القدرات الرئيسية لـ SeeDance 2.0

| بُعد القدرة | أداء SeeDance 2.0 | مقارنة بـ Sora-2 |

|---|---|---|

| أقصى مدة للمقطع | 15 ثانية | متساوٍ |

| مزامنة الصوت | توليد صوت وفيديو أصلي وموحد | Sora-2 يتطلب TTS خارجي |

| أنماط الإدخال | نص / صورة / صوت / فيديو | Sora-2 يقتصر على نص + صورة |

| التحكم في الكاميرا | أوامر توجيه سينمائية | Sora-2 أضعف نسبياً |

| الواقعية الفيزيائية | رائدة في المجال | متساوٍ |

| تصنيف Artificial Analysis Elo | 1269 (المركز الأول) | ~1180 |

| قنوات الاستدعاء المتاحة | BytePlus ModelArk / fal / منصات التجميع | OpenAI الرسمية (ستتوقف) |

| فهم الموجهات الصينية | ممتاز | متوسط |

يتوفر SeeDance 2.0 حالياً للاختبار الداخلي عبر منصة APIYI (apiyi.com). إذا كنت تبحث عن بديل لـ Sora-2، يمكنك التواصل مع خدمة عملاء المنصة للحصول على حصة تجريبية لـ SeeDance 2.0، واستدعاء النموذج باستخدام بروتوكول متوافق مع OpenAI.

مثال على استدعاء SeeDance 2.0

فيما يلي مثال مبسط لاستدعاء SeeDance 2.0 عبر واجهة متوافقة مع OpenAI:

from openai import OpenAI

# إعداد العميل باستخدام مفتاح API الخاص بك

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# استدعاء توليد الفيديو

response = client.videos.generate(

model="seedance-2.0",

prompt="قطة برتقالية تقفز من حافة النافذة إلى الأريكة، أشعة الشمس تتسلل من خلال الستائر، والكاميرا تتبع القطة ببطء",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 مثال استدعاء كامل (يتضمن معالجة الاستثناءات والاستطلاع)

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

# بدء مهمة التوليد

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

# استطلاع حالة المهمة

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"فشل المهمة: {status.error}")

time.sleep(5) # الانتظار 5 ثوانٍ قبل المحاولة التالية

except Exception as e:

print(f"خطأ في الاستدعاء: {e}")

return None

url = generate_seedance_video(

prompt="حافلة لندن حمراء كلاسيكية ذات طابقين تمر عبر شوارع لندن بعد المطر، انعكاس أضواء الشارع يظهر على نوافذ الحافلة",

duration=12

)

print(url)

سيناريوهات استخدام SeeDance 2.0

- مقاطع الفيديو القصيرة للعلامات التجارية: مزامنة صوتية أصلية + حركة كاميرا سينمائية، مثالية للإعلانات والمواد الترويجية.

- الإبداع متعدد الوسائط: دعم إدخال الصوت والفيديو كمرجع، مناسب لإنشاء محتوى مشتق من الملكيات الفكرية (IP).

- اتساق الشخصيات: قدرات مرجعية متعددة الوسائط ممتازة، مناسبة لإنتاج المحتوى المتسلسل.

- النشر على وسائل التواصل الاجتماعي العالمية: دعم نسب عرض متعددة (16:9 / 9:16 / 1:1)، مما يجعلها متوافقة مباشرة مع TikTok وYouTube وInstagram.

- الفيديوهات الموسيقية (MV): التوليد الموحد للصوت والفيديو يضمن توافقاً طبيعياً بين المشاهد وإيقاع الموسيقى.

البديل الثاني لـ Sora-2 API: نموذج Wan 2.7

التموضع الاستراتيجي لنموذج Wan 2.7

يُعد Wan 2.7 الجيل الجديد من نماذج توليد الفيديو الذي أطلقته مختبرات "علي بابا تونغي" (Alibaba Tongyi) في مارس 2026. يعتمد النموذج على معمارية MoE (خليط من الخبراء) بـ 27 مليار بارامتر، ويستخدم تقنيات Diffusion Transformer و Flow Matching. أصبح النموذج متاحاً عبر منصتي DashScope من علي بابا و WaveSpeedAI، وهو أول نموذج فيديو MoE محلي يوفر واجهة برمجة تطبيقات (API) عامة.

على عكس SeeDance 2.0 الذي يركز على الدمج متعدد الوسائط، يتميز Wan 2.7 بميزتين فريدتين: وضع التفكير (Thinking Mode) و التحكم الدقيق في الإطارين الأول والأخير؛ حيث يمكنه "التفكير" في هيكل اللقطات قبل توليد الفيديو، كما يتيح تحديد الإطارات الرئيسية للبداية والنهاية، وهي قدرات يفتقر إليها Sora-2 API حالياً.

نظرة سريعة على قدرات Wan 2.7

| بُعد القدرة | أداء Wan 2.7 | مقارنة بـ Sora-2 |

|---|---|---|

| معمارية النموذج | 27B MoE | غير معلن |

| أقصى مدة للفيديو | 15 ثانية | متساوٍ |

| أعلى دقة | 1080p | متساوٍ |

| وضع التفكير | ✅ يدعم التفكير في اللقطات | ❌ لا يدعم |

| التحكم في الإطارات | ✅ تحديد الإطار الأول والأخير | ❌ يدعم الأول فقط |

| صور مرجعية (9 شبكات) | ✅ يدعم حتى 9 صور مرجعية | ❌ لا يدعم |

| مرجع الجسم + الصوت | ✅ يدعم المراجع المركبة | ❌ لا يدعم |

| الحد الأقصى للموجه | 5000 حرف | ~1000 حرف |

| قنوات الاستدعاء | DashScope / WaveSpeedAI / منصات وسيطة | OpenAI الرسمي (سيتوقف) |

| السعر المرجعي | يبدأ من $0.10/ثانية | يبدأ من $0.50/ثانية |

🎯 نصيحة للاستخدام: إذا كانت سيناريوهات توليد الفيديو لديك تتطلب متطلبات دقيقة لمشاهد البداية والنهاية (مثل مقدمات وخواتيم العلامات التجارية، أو عد تنازلي للإعلانات)، فإن قدرة Wan 2.7 على التحكم في الإطارات لا غنى عنها ولا يمكن لـ Sora-2 تعويضها. نوصي بالاستدعاء المباشر عبر المنصات الوسيطة لتجنب عناء التعامل مع SDK وتوقيعات علي بابا.

مثال على استدعاء Wan 2.7

from openai import OpenAI

# إعداد العميل للاتصال عبر APIYI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="شوارع نيون بأسلوب السايبربانك، الكاميرا ترتفع ببطء من الأرض لتطل على المدينة بأكملها",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 مثال كامل لاستخدام صور مرجعية متعددة في Wan 2.7 (إدخال 9 صور + وضع التفكير)

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# قائمة الصور المرجعية

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"البطل يعبر 9 مشاهد مختلفة،"

"كل مشهد يتوافق مع صورة من الصور المرجعية،"

"مع الحفاظ على اتساق مظهر الشخصية والملابس في الفيديو بالكامل"

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

سيناريوهات الاستخدام المناسبة لـ Wan 2.7

- مقدمات وخواتيم العلامات التجارية: تحكم دقيق في الإطارات دون الحاجة لتعديلات لاحقة.

- سلاسل الشخصيات المتسقة: استخدام الصور المرجعية لضمان عدم تغير ملامح الشخصية عبر لقطات متعددة.

- اللقطات المعقدة: وضع التفكير يخطط تلقائياً لهيكل اللقطات، وهو مثالي للأفلام القصيرة والإعلانات.

- التحرير القائم على التعليمات: دعم تعديل الفيديوهات الموجودة بناءً على تعليمات نصية طبيعية.

- سرد القصص عبر 9 لقطات: إدخال صور مفتاحية متعددة لتوليد فيديو سردي مترابط.

مقارنة شاملة: SeeDance 2.0 مقابل Wan 2.7 مقابل Sora-2

مقارنة المؤشرات الأساسية للنماذج الثلاثة

| وجه المقارنة | Sora-2 (سيُحال للتقاعد) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| الشركة المطورة | OpenAI | ByteDance | Alibaba Tongyi |

| تاريخ الإصدار | أكتوبر 2025 | 09 فبراير 2026 | مارس 2026 |

| حالة الخدمة | إيقاف في 24-09-2026 | متاح للتجربة العامة | متاح للتجربة العامة |

| أقصى مدة | 15 ثانية | 15 ثانية | 15 ثانية |

| أعلى دقة | 1080p | 1080p | 1080p |

| صوت أصلي | ✅ | ✅ (توليد مشترك) | ✅ |

| مدخلات متعددة الوسائط | نص + صورة | نص+صورة+صوت+فيديو | نص + صور مرجعية متعددة |

| التحكم بالإطار الأول والأخير | ❌ | ❌ | ✅ ثنائي الاتجاه |

| وضع التفكير (Thinking Mode) | ❌ | ❌ | ✅ |

| تقييم Artificial Analysis | ~1180 | 1269 (الأول) | لم يُدرج بعد |

| دعم اللغة العربية | متوسط | ممتاز | ممتاز |

| الامتثال المحلي | ❌ | ✅ | ✅ |

| سعر الوحدة التقريبي | $0.50/ثانية | $0.30/ثانية | بدءاً من $0.10/ثانية |

توصيات الاختيار حسب سيناريو العمل

| سيناريو العمل | الحل المفضل | السبب |

|---|---|---|

| إعلانات الفيديو التجارية | SeeDance 2.0 | مزامنة الصوت + حركات كاميرا سينمائية |

| المسلسلات القصيرة/المحتوى المتسلسل | Wan 2.7 | شبكة 9 مربعات لضمان اتساق الشخصيات |

| تخصيص مقدمات ونهايات الفيديوهات | Wan 2.7 | تحكم دقيق في الإطار الأول والأخير |

| إعادة إنتاج المحتوى متعدد الوسائط | SeeDance 2.0 | يدعم مدخلات الصوت والفيديو كمرجع |

| توليد يعتمد على نصوص عربية | كلاهما | فهم العربية أفضل من Sora-2 |

| الأولوية للجودة القصوى | SeeDance 2.0 | الأول في تقييم Artificial Analysis |

| التوليد بكميات كبيرة (حساسية التكلفة) | Wan 2.7 | يبدأ من $0.10/ثانية، ميزة سعرية واضحة |

| محتوى منصات التواصل العالمية | SeeDance 2.0 | مخرجات بنسب أبعاد أصلية متعددة |

| فيديوهات المنتجات للتجارة الإلكترونية | Wan 2.7 | مرجع الجسم يضمن اتساق صورة المنتج |

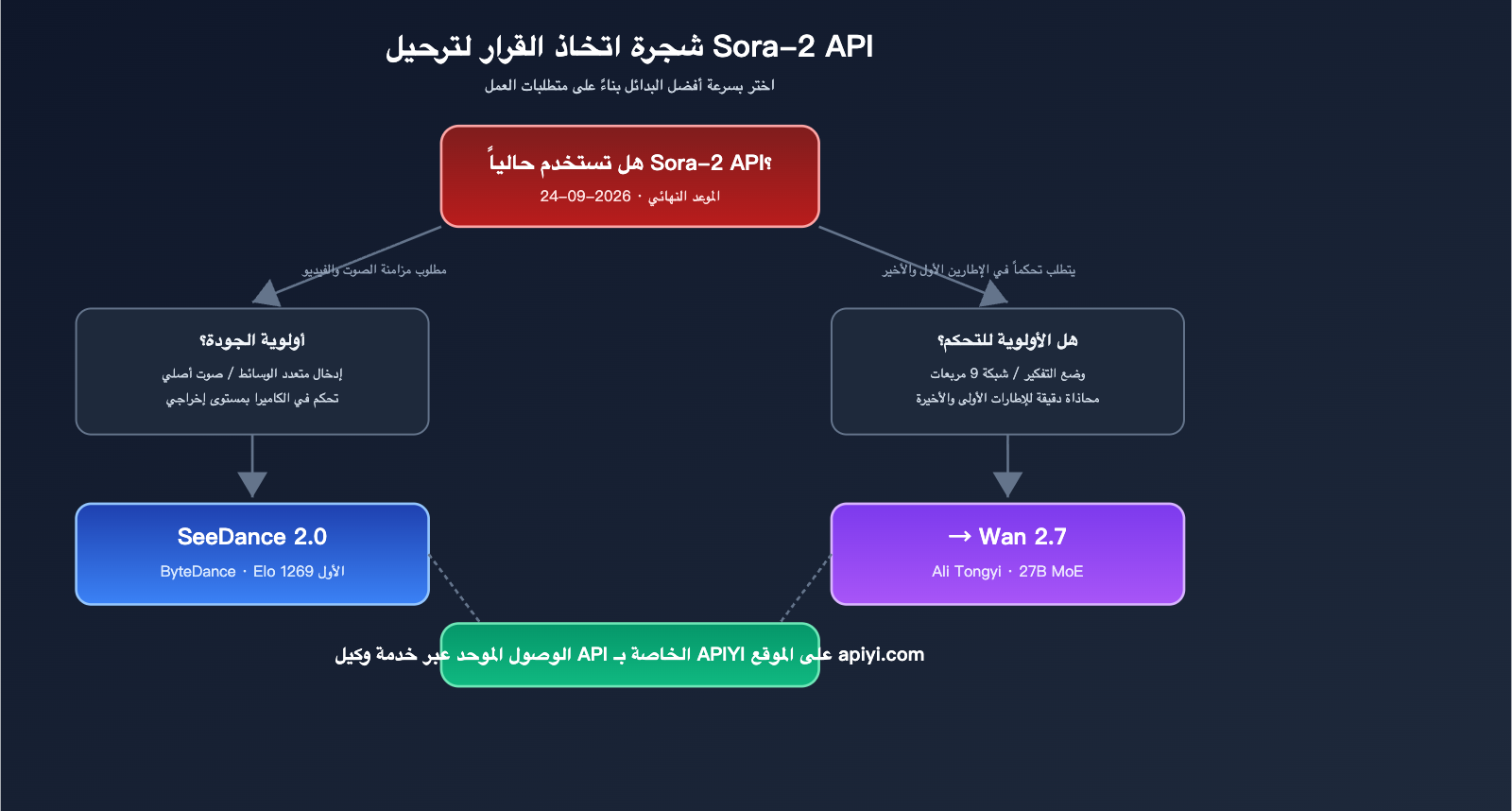

💡 نصيحة للاختيار: إذا كان بإمكانك اختيار نموذج واحد فقط على المدى القصير، فإن SeeDance 2.0 مناسب لسيناريوهات "أولوية الجودة"، بينما Wan 2.7 مناسب لسيناريوهات "أولوية التحكم" و"أولوية التكلفة". يُنصح بتفعيل صلاحيات استدعاء النموذجين عبر منصة تجميع واحدة، والتوجيه الديناميكي بناءً على طلبات العمل، مما يمنحك أقصى قدر من المرونة خلال فترة الانتقال.

تقدير تكاليف النماذج الثلاثة (فيديو 10 ثوانٍ بدقة 1080p)

| النموذج | التكلفة التقديرية للمرة الواحدة | التكلفة التقديرية لـ 10 آلاف عملية شهرياً | ملاحظات |

|---|---|---|---|

| Sora-2 | ~$5.00 | ~$50,000 | غير متاح بعد سبتمبر |

| SeeDance 2.0 | ~$3.00 | ~$30,000 | يشمل الصوت الأصلي |

| Wan 2.7 | ~$1.00 | ~$10,000 | سعر ابتدائي |

ملاحظة: البيانات أعلاه مجمعة من مصادر عامة، والأسعار الفعلية تعتمد على أحدث قوائم الشركات. الاستدعاء عبر منصات التجميع يوفر عادةً خصومات إضافية مقارنة بالحسابات المباشرة.

دليل البدء السريع للانتقال من Sora-2 API إلى البدائل

شجرة اتخاذ قرار مسار الانتقال

يمكن تقسيم عملية الانتقال من Sora-2 API إلى البدائل إلى 4 خطوات:

- جرد استدعاءات Sora-2 الحالية: تحديد جميع مسارات الكود التي تستدعي

sora-2أو Videos API، وإدراج قوالب الموجه (Prompt)، ومعاملات الإدخال، ومنطق معالجة المخرجات. - اختيار النموذج المستهدف: تحديد النموذج الأساسي بناءً على توصيات الاختيار المذكورة أعلاه.

- استبدال

base_urlواسم النموذج: استبدالbase_urlالخاص بـ OpenAI بـbase_urlالخاص بمنصة التجميع، مثلhttps://api.apiyi.com/v1، وتغيير اسم النموذج إلىseedance-2.0أوwan-2.7. - اختبار الانحدار (Regression Testing): تشغيل سلسلة كاملة باستخدام مجموعة من الموجهات التمثيلية، ومقارنة جودة المخرجات وزمن الاستجابة بين القديم والجديد.

الوصول إلى البديلين عبر منصة تجميع واحدة

from openai import OpenAI

# تهيئة العميل باستخدام مفتاح API الخاص بمنصة APIYI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

# اختيار النموذج ديناميكياً

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

# استدعاء النماذج بسهولة

video_a = generate_video("إعلان منتج: مكبر صوت ذكي يشغل الموسيقى", prefer="seedance")

video_b = generate_video("مقدمة علامة تجارية: شعار يظهر تدريجياً من بقعة ضوء", prefer="wan")

تكمن ميزة هذه الطريقة في استخدام SDK واحد، ومفتاح API واحد، وbase_url واحد لاستدعاء البديلين معاً. بعد إيقاف Sora-2 في 24 سبتمبر، ستحتاج فقط لتغيير model="sora-2" إلى model="seedance-2.0" أو model="wan-2.7" دون الحاجة لتعديل باقي الكود.

قائمة التحقق للانتقال (يُنصح بطباعتها)

| المرحلة | عنصر التحقق | الوقت المتوقع |

|---|---|---|

| الجرد | إدراج جميع نقاط دخول Sora-2 | 0.5 يوم |

| الجرد | تجهيز 50-100 موجه تمثيلي | 1 يوم |

| الربط | طلب حساب في منصة التجميع وتحديد الحصص | 0.5 يوم |

| الربط | تعديل base_url وحقول النموذج |

1 يوم |

| الاختبار | تشغيل مجموعة اختبارات الانحدار | 2-3 أيام |

| الاختبار | تقييم الجودة من قبل فريق المنتج/التصميم | 1 أسبوع |

| التدرج | تحويل 10%-30% من حركة المرور | 1 أسبوع |

| التدرج | تحويل 100% من حركة المرور | — |

| الإنهاء | إيقاف كود استدعاء Sora-2 | 0.5 يوم |

باتباع هذا الجدول، يمكن إكمال الانتقال بالكامل خلال 4-6 أسابيع، مما يترك نافذة تشغيل مستقرة لمدة شهرين على الأقل قبل الموعد النهائي في 24 سبتمبر.

🎯 نصيحة للانتقال: لا تنتظر حتى سبتمبر للبدء. ابدأ فوراً بفتح حساب على منصة التجميع، وقم باستنساخ كود Sora-2 الحالي، وقم بتغيير

base_urlإلىhttps://api.apiyi.com/v1لتتمكن من إجراء تجارب مقارنة موازية باستخدام بيانات عمل حقيقية.

نصائح للتحكم في التكاليف أثناء الانتقال

تكلفة توليد الفيديو أعلى بكثير من نماذج النصوص، لذا إذا لم تقم بالتحسين، فقد تتضاعف فاتورة API. يُنصح باتباع الاستراتيجيات التالية:

- استراتيجية التخفيض: استخدم دقة 720p / 5 ثوانٍ في مرحلة الاختبار، ثم انتقل إلى 1080p / 15 ثانية بعد التأكد من جودة الموجه.

- إعادة استخدام التخزين المؤقت: استخدم التخزين المؤقت (Hash) للطلبات التي لها نفس الموجه والمعاملات لتجنب التوليد المتكرر.

- الفواتير المجمعة: تجنب حد أدنى للاستهلاك عبر منصات متعددة باستخدام منصة تجميع واحدة.

- التوليد بالدفعات (Batch): استخدم وضع الدفعات الليلي للحصول على خصومات تتراوح بين 30%-50%.

- تحسين الموجه: تقليل عدد مرات إعادة التوليد عبر موجهات أكثر دقة يوفر 20%-40% من التكاليف.

مشاكل الانتقال الشائعة والحلول

| المشكلة | السبب | الحل |

|---|---|---|

| عدم اتساق نسبة العرض | اختلاف aspect_ratio الافتراضي |

تحديد المعامل aspect_ratio صراحة |

| اختلاف سقف المدة | بعض النماذج تحاسب بالثانية | تحديد duration حسب الحاجة |

| فقدان الصوت | اختلاف واجهة الصوت بين Sora-2 والجديد | تفعيل audio=True صراحة |

| انحراف أسلوب الموجه | تفضيلات مختلفة لكل نموذج | تحسين الموجه لكل نموذج على حدة |

| اختلاف آليات الاستجابة | بعض المنصات تدعم الاستطلاع فقط | استخدام الـ Webhook الخاص بمنصة التجميع |

الأسئلة الشائعة حول إيقاف Sora-2 API

س1: بعد إيقاف Sora-2 API، هل ستظل الفيديوهات التي تم إنشاؤها مسبقاً قابلة للاستخدام؟

نعم. ملفات الفيديو نفسها بمجرد تحميلها محلياً أو على خدمة التخزين السحابي (OSS) لن تتأثر بإيقاف الـ API. ولكن إذا كنت تشير مباشرة إلى رابط الفيديو (video_url) الذي توفره OpenAI، فإن هذه الروابط ستصبح غير صالحة بعد إيقاف الخدمة. لذا، تأكد من نقل جميع الفيديوهات إلى مساحة التخزين الخاصة بك قبل 24 سبتمبر. إذا كان حجم الفيديوهات كبيراً، يمكنك استخدام قدرات وكيل الفيديو في منصة APIYI (apiyi.com) للتحميل الجماعي، حيث تقوم المنصة تلقائياً بإدارة حدود التزامن وإعادة المحاولة عند الفشل.

س2: هل ستطلق OpenAI خدمة Sora-3 API لاحقاً؟

لم تقدم OpenAI أي جدول زمني رسمي بخصوص Sora-3. من الناحية الاستراتيجية، تعطي OpenAI حالياً الأولوية لتوجيه قدرات الحوسبة نحو خط إنتاج GPT وأعمال الوكلاء (Agents)، لذا فإن احتمالية إعادة إطلاق API لتوليد الفيديو على المدى القريب منخفضة. كما أشارت تحليلات Wikipedia و Futurum Group إلى أن عدم تحقيق Sora للنتائج التجارية المرجوة هو السبب الرئيسي وراء هذا الإيقاف. ننصح بعدم بناء خطط عملك على فرضية "ربما تعود Sora-3"، ويجب عليك إكمال الانتقال إلى SeeDance 2.0 أو Wan 2.7.

س3: هل يمكن استدعاء SeeDance 2.0 و Wan 2.7 باستقرار داخل الصين؟

نعم. يتم تشغيل النموذجين بواسطة ByteDance و Alibaba على التوالي، وتوجد عقد الخدمة داخل الصين، مما يجعل استقرار الشبكة أفضل بكثير من استدعاء خدمات OpenAI عبر الحدود. إذا كنت تحتاج سابقاً إلى استخدام وكيل أو خادم خارجي لاستخدام Sora-2، فبعد الانتقال إلى هذين النموذجين يمكن تبسيط بنية الشبكة، حيث يمكنك حل مشكلتي الاستقرار والامتثال الضريبي (الفواتير) دفعة واحدة عبر منصات التجميع المحلية الممتثلة.

س4: هل لا تزال هناك قيمة انتقالية في استخدام Sora API عبر الهندسة العكسية؟

لا ننصح بذلك. فقد انخفض استقرار الـ API المعتمد على الهندسة العكسية بشكل حاد بعد الربع الأول من عام 2026، ومع اختفاء المصدر الرسمي بعد شهر سبتمبر، ستصبح واجهات الهندسة العكسية غير مجدية تماماً. إن الاستمرار في الاستثمار في حلول الهندسة العكسية يعني إضافة أكواد جديدة فوق بنية تقنية من المعروف أنها ستُلغى، مما سيزيد من تكاليف الانتقال لاحقاً. الخيار الأكثر اقتصاداً هو الانتقال المباشر إلى SeeDance 2.0 أو Wan 2.7.

س5: كيف يمكن تقييم فعالية البدائل أثناء عملية الانتقال؟

نقترح إجراء تقييم ثلاثي الأبعاد: جودة الرؤية (تقييم ذاتي)، مدى الالتزام بالموجّه (مقارنة موضوعية)، والتكلفة لكل عملية (حسابات مالية). الطريقة العملية هي اختيار 50 موجهاً تمثيلياً من سجلات استدعاء Sora-2 السابقة، وإعادة تشغيلها على SeeDance 2.0 و Wan 2.7، ثم إجراء تقييم أعمى من قبل فريق المنتج. يُنصح بإجراء الاختبارات المقارنة عبر منصة تجميع توفر فوترة وسجلات موحدة لاتخاذ القرار الأنسب لعملك بسرعة.

س6: هل ستتغير مواصفات واجهة API بعد الانتقال إلى منصة تجميع؟

عادةً ما تقوم منصات التجميع بمواءمة بروتوكولات متوافقة مع OpenAI، مما يعني أنه يمكنك الاحتفاظ بهيكل الكود الخاص بك الذي كنت تستخدمه مع Sora-2، مع تعديل حقلي base_url و model فقط. قد تختلف معلمات طلب توليد الفيديو (مثل الموجّه، المدة، الصوت، الدقة، إلخ) قليلاً بين النماذج، وستقوم منصة التجميع بمواءمة هذه المعلمات، ويمكنك مراجعة وثائق المنصة لمعرفة الفروقات المحددة.

س7: هل يجب أن أنتقل فوراً أم أنتظر حتى شهر سبتمبر؟

نوصي بشدة بالبدء في الاختبار فوراً وإكمال الانتقال قبل نهاية يونيو. لثلاثة أسباب:

- كلما اقتربنا من 24 سبتمبر، سيزداد الضغط على منصات التجميع والنماذج البديلة بسبب تزاحم مستخدمي Sora-2.

- الانتقال المبكر يتيح لك مقارنة البديلين بشكل كافٍ وتجنب التغيير الاضطراري في اللحظات الأخيرة.

- المطورون الأوائل عادةً ما يحصلون على حصص تجريبية أفضل وأسعار أكثر تنافسية.

س8: أيهما أكثر دعماً للموجّهات (Prompts) باللغة الصينية: SeeDance 2.0 أم Wan 2.7؟

كلاهما يتفوق بشكل ملحوظ على Sora-2 في فهم اللغة الصينية. SeeDance 2.0 أكثر دقة في التعبير عن المشاعر الصينية ووصف الحركات، بينما Wan 2.7 يدعم موجّهات طويلة تصل إلى 5000 حرف مع "وضع التفكير" (Thinking Mode)، مما يجعله أكثر استقراراً في سيناريوهات السرد الصيني المعقد. إذا كانت موجّهاتك عادةً أقل من 200 حرف، اختر SeeDance 2.0؛ أما إذا كنت تحتاج لوصف لقطات معقدة، فاختر Wan 2.7.

س9: كيف يمكن ضمان عدم انقطاع الخدمة أثناء فترة الانتقال؟

الطريقة الأكثر أماناً هي استخدام نظام القراءة والكتابة المزدوجة: أثناء فترة التبديل، قم باستدعاء كل من Sora-2 والنموذج المستهدف، واحفظ مخرجات كليهما، مع توجيه حركة المرور من الواجهة الأمامية (A/B testing). بهذه الطريقة، إذا واجه النموذج المستهدف أي مشكلة، يمكنك العودة فوراً إلى Sora-2 (قبل 24 سبتمبر)، مما يقلل المخاطر إلى أدنى حد. تدعم منصات التجميع عادةً التوجيه الديناميكي بناءً على حقل model، مما يجعل تكلفة تنفيذ هذا النظام منخفضة جداً.

الخلاصة: المسار الأمثل بعد إيقاف Sora-2 API

لقد حددت OpenAI تاريخ 24 سبتمبر 2026 موعداً نهائياً لإيقاف Sora-2 API، مما يترك أقل من نصف عام لجميع الأعمال القائمة على توليد الفيديو. لقد فقدت "الحلول الانتقالية الرخيصة" عبر الهندسة العكسية قيمتها تحت ضغط تشديد الرقابة والإيقاف الرسمي، والاستمرار فيها لن يؤدي إلا إلى تراكم تكاليف الانتقال.

لحسن الحظ، شهد عام 2026 تشكلاً صحياً ومتعدداً في سوق توليد الفيديو: SeeDance 2.0 أصبح المعيار الذهبي للجودة بفضل تصنيفه في Artificial Analysis Elo 1269، وهو بارع في المدخلات متعددة الوسائط والتوليد المتزامن للصوت والصورة. بينما أسس Wan 2.7 ميزة تنافسية فريدة بفضل "وضع التفكير" والتحكم في الإطارات الأولى والأخيرة، مما يجعله مناسباً للسيناريوهات التي تتطلب تحكماً دقيقاً في الصورة. يتفوق كلا النموذجين على Sora-2 في دعم اللغة الصينية، والامتثال المحلي، واستقرار الاستدعاء.

نصيحتنا هي: لا تضع بيضك في سلة واحدة. استخدم منصة APIYI (apiyi.com) للوصول إلى كل من SeeDance 2.0 و Wan 2.7، وقم بالتوجيه الديناميكي بناءً على متطلبات عملك؛ المحتوى الذي يعطي الأولوية للجودة يوجه إلى SeeDance 2.0، والمشاهد التي تتطلب تحكماً دقيقاً توجه إلى Wan 2.7. هذه البنية ثنائية النموذج تضمن الاستقرار أثناء الانتقال وتضمن استمرارية أعمال Sora-2 الأصلية بسلاسة بعد سبتمبر.

النقطة الأكثر أهمية: ابدأ الآن. الانتظار حتى أغسطس أو سبتمبر لبدء الانتقال سيجعل مواءمة النماذج، وتحسين الموجّهات، وطلب الحصص أكثر صعوبة بكثير. نوصي ببدء اختبار PoC هذا الأسبوع، ونسخ كود استدعاء Sora-2 الحالي للاختبار الموازي، واتخاذ القرار النهائي بناءً على بيانات عمل حقيقية، لضمان تشغيل البديل بسلاسة لمدة شهرين على الأقل قبل موعد الإيقاف في 24 سبتمبر.

المؤلف: فريق APIYI — متخصصون في خدمات وكيل API لنماذج اللغة الكبيرة وخدمات تجميع نماذج توليد الفيديو.