title: "Sora-2 API 即将下线:如何平滑迁移至 SeeDance 2.0 与 Wan 2.7"

date: 2026-03-25

tags: [AI, Sora, API, 视频生成, 迁移指南]

Компания OpenAI официально уведомила разработчиков 24 марта 2026 года: Sora-2 API будет отключен 24 сентября 2026 года. Это означает, что у всех проектов, использующих sora-2, sora-2-pro и Videos API, есть менее полугода на миграцию.

Важно понимать: так называемые «реверс-инжиниринг API для Sora», которые появлялись на рынке в последние полгода, практически перестали работать после того, как OpenAI ужесточила контроль. Продолжать полагаться на них — значит обрекать свой бизнес на постоянные сбои. В этой статье мы разберем график отключения Sora-2 API, масштаб изменений и предложим два надежных решения для продакшена: SeeDance 2.0 от ByteDance и Wan 2.7 от Alibaba Tongyi.

Если вы используете Sora-2 API для генерации видео, рекомендую протестировать SeeDance 2.0 и Wan 2.7 через платформу APIYI (apiyi.com). Она объединяет множество популярных моделей генерации видео, что позволит максимально упростить процесс перехода.

График отключения Sora-2 API и масштаб влияния

Официальные сроки отключения

OpenAI выбрала двухэтапную стратегию закрытия: сначала отключаются потребительские приложения, затем — API для бизнеса. Между ними предусмотрен пятимесячный «буфер» для разработчиков. Это одна из самых «мягких» посадок в истории OpenAI, но времени все равно в обрез.

| Дата | Событие | Кого затрагивает | Буфер |

|---|---|---|---|

| 24.03.2026 | Официальное уведомление | Все пользователи Sora-2 API | T+0 |

| 26.04.2026 | Закрытие веб-версии и приложения Sora | B2C-пользователи, креаторы | T+33 дня |

| 24.09.2026 | Официальное отключение Sora-2 API | Все бизнес-интеграции | T+184 дня |

| После 25.09.2026 | API возвращает ошибку 410 Gone | Все немигрировавшие сервисы | — |

В справочном центре OpenAI четко сказано: если вам нужны видео, созданные в Sora, экспортируйте их до закрытия приложения 26 апреля. Однако для разработчиков, использующих API, критическая дата — 24 сентября.

Важно: OpenAI не давала обещаний о «продлении». Судя по опыту отключения других моделей с 2025 года, отключение в срок — это стандартная практика, поэтому не стоит надеяться на чудо.

Список затронутых моделей

Многие команды думают, что отключат только алиас sora-2, но на самом деле под сокращение попадает весь стек Videos API:

| ID модели | Тип | Статус | Рекомендация |

|---|---|---|---|

sora-2 |

Стандартный алиас | Отключено | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

HD-алиас | Отключено | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

Снапшот | Отключено | SeeDance 2.0 |

sora-2-2025-12-08 |

Снапшот | Отключено | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

Pro-снапшот | Отключено | Wan 2.7 (вкл. Thinking Mode) |

| Videos API (весь набор) | API-эндпоинты | Полное отключение | Агрегаторы с поддержкой протоколов |

Это значит, что OpenAI полностью закрывает доступ к генерации видео через API. С 25 сентября все запросы с префиксом videos будут возвращать ошибку 410 Gone. Это не просто обновление модели, а полный вывод продукта из эксплуатации.

🎯 Ключевой момент: Вы не сможете просто «сменить название модели» — придется переходить на совершенно другой API. Рекомендую завершить тестирование новых решений до конца июня. Используйте агрегаторы для сравнения SeeDance 2.0 и Wan 2.7, чтобы не спешить в последние два месяца.

Истинные причины отключения Sora-2 API

OpenAI не давала подробных объяснений, но анализ западных СМИ (The Decoder, Futurum Group, Wikipedia) указывает на три основные причины:

- Неустойчивые затраты на вычислительные мощности: Генерация видео требует в десятки раз больше GPU-времени, чем текстовые модели, а доходы не покрывают расходы. После запуска Sora-2 OpenAI была вынуждена жестко ограничивать квоты, что снизило интерес разработчиков.

- Высокие риски безопасности: Несмотря на водяные знаки и модерацию, Sora часто становилась инструментом для дипфейков и нарушений авторских прав. Юридические и комплаенс-расходы превысили пользу от модели.

- Стратегический фокус: OpenAI перенаправляет мощности на развитие GPT, Operator и агентских систем. Видео временно перестало быть приоритетом.

Понимание этих причин важно при выборе альтернативы: выбирайте компании, для которых видео — это стратегическое направление. ByteDance и Alibaba сделали ставку на генерацию видео, поэтому их темпы итераций намного выше, чем у OpenAI. Именно поэтому они стали главными преемниками аудитории Sora-2 в 2026 году.

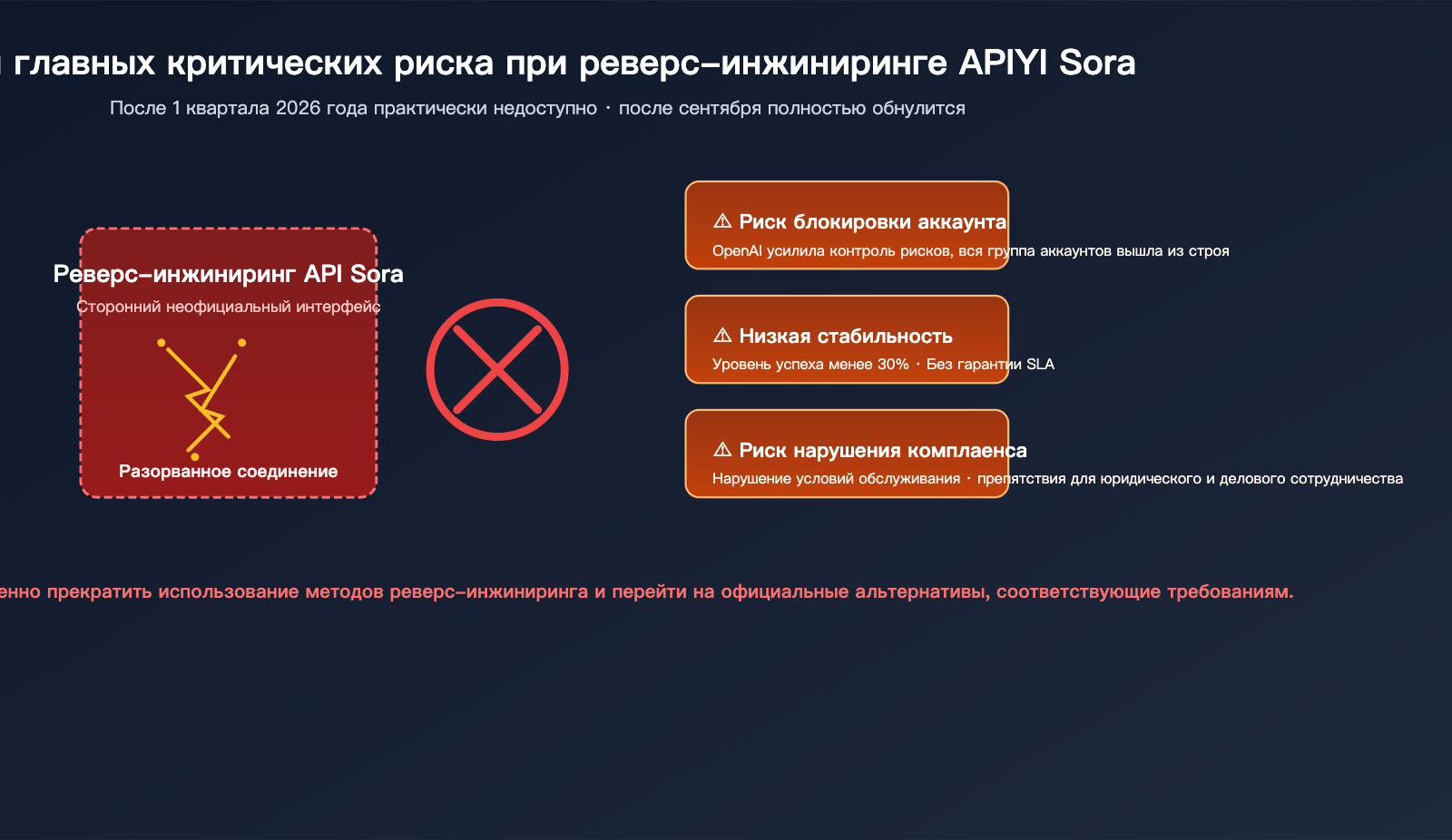

Почему «реверс-инжиниринг Sora API» больше не является рабочим вариантом

Текущая ситуация с реверс-инжинирингом Sora API в 2026 году

Последние полгода в китайском сегменте интернета активно распространялись «реверс-инжиниринговые» интерфейсы, которые якобы позволяли вызывать Sora-2 без аккаунта OpenAI. Цены на них варьировались от доли до десятой части стоимости официального API. Однако, судя по отзывам в сообществах разработчиков, после первого квартала 2026 года эти решения стали практически неработоспособными:

- В январе 2026 года OpenAI обновила правила защиты Cloudflare, из-за чего большинство таких интерфейсов начали выдавать ошибку 403.

- Провайдеры использовали пулы аккаунтов, но OpenAI усилила борьбу с массовыми подозрительными учетными записями, что привело к блокировке целых пулов.

- Даже если соединение удавалось установить, скорость генерации была крайне низкой, а процент успешных запросов не превышал 30%, что делает их непригодными для продакшена.

- Все больше сервисов-прокси API закрываются или меняют профиль деятельности, из-за чего предоплаченные средства пользователей рискуют просто исчезнуть.

Более того, поскольку OpenAI официально объявила о закрытии своего API 24 сентября, «источник» для всех этих реверс-инжиниринговых решений исчезнет окончательно. После сентября этот путь станет тупиковым.

3 причины, почему не стоит продолжать инвестировать в «реверс»

| Риск | Описание | Последствия для бизнеса |

|---|---|---|

| Стабильность | Интерфейсы блокируются в любой момент, нет SLA | Постоянные сбои в работе сервиса |

| Комплаенс | Нарушение ToS OpenAI, возможная связь с торговлей аккаунтами | Юридические проблемы и срыв партнерств |

| Невозвратные затраты | После отключения официального API в сентябре все перестанет работать | Потеря ресурсов на повторную миграцию |

| Безопасность данных | Сторонние прокси имеют доступ к вашим промптам и контенту | Утечка коммерческой тайны |

⚠️ Настоятельная рекомендация: если ваша команда все еще использует какие-либо формы реверс-инжиниринга Sora API, немедленно прекратите разработку новых функций на их основе и переключитесь на официальные альтернативы. Рекомендуем подключаться через легальные агрегаторы к SeeDance 2.0 или Wan 2.7 — это обеспечит стабильность и избавит от проблем с комплаенсом.

Альтернатива Sora-2 API №1: SeeDance 2.0

Основное позиционирование SeeDance 2.0

SeeDance 2.0 — это флагманская модель генерации видео, представленная командой больших языковых моделей Doubao (ByteDance) 9 февраля 2026 года. 14 апреля она стала доступна для публичного тестирования на платформе BytePlus ModelArk, а с 9 апреля — через сервис fal. В рейтинге видеомоделей Artificial Analysis модель SeeDance 2.0 набрала 1269 баллов Elo, обойдя Google Veo 3, OpenAI Sora 2 и Runway Gen-4.5, заняв первое место в публичных бенчмарках.

Главное отличие заключается в единой мультимодальной архитектуре совместной генерации аудио и видео. Вместо того чтобы сначала создавать видео, а потом накладывать звук, модель выдает до 15 секунд кинематографичного контента с синхронным аудио за один проход. Такая способность «единого происхождения звука и изображения» недоступна для Sora-2, которая вынуждена использовать сторонний TTS.

Ключевые возможности SeeDance 2.0

| Возможность | SeeDance 2.0 | Сравнение с Sora-2 |

|---|---|---|

| Макс. длительность | 15 секунд | На уровне |

| Синхронный звук | Нативная генерация | Sora-2 требует внешний TTS |

| Входные модальности | Текст / Изображение / Аудио / Видео | Только текст + изображение |

| Управление камерой | Режиссерские команды | У Sora-2 слабее |

| Физическая реалистичность | Лидер отрасли | На уровне |

| Artificial Analysis Elo | 1269 (#1) | ~1180 |

| Каналы доступа | BytePlus ModelArk / fal / Агрегаторы | Официальный API OpenAI (закрывается) |

| Понимание промптов (RU/CN) | Отличное | Среднее |

В настоящее время SeeDance 2.0 доступна для закрытого тестирования через платформу APIYI (apiyi.com). Если вы ищете замену для Sora-2, вы можете обратиться в службу поддержки платформы для получения квот на использование SeeDance 2.0 с поддержкой протокола, совместимого с OpenAI.

Пример вызова SeeDance 2.0

Ниже приведен простой пример вызова SeeDance 2.0 через совместимый с OpenAI интерфейс:

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="seedance-2.0",

prompt="Рыжий кот прыгает с подоконника на диван, закатное солнце пробивается сквозь жалюзи, камера медленно следует за котенком",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 Полный пример вызова (с обработкой исключений и опросом статуса)

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"Ошибка задачи: {status.error}")

time.sleep(5)

except Exception as e:

print(f"Ошибка вызова: {e}")

return None

url = generate_seedance_video(

prompt="Ретро-автобус красного цвета проезжает по улицам Лондона после дождя, в окнах отражаются уличные фонари",

duration=12

)

print(url)

Сценарии использования SeeDance 2.0

- Брендовые короткие видео: Нативное аудио и кинематографичная работа камеры идеально подходят для рекламы.

- Мультимодальное творчество: Поддержка аудио и видео в качестве эталонного изображения для создания производного контента.

- Согласованность лиц: Отличные возможности мультимодальной привязки для создания серийного контента.

- Продвижение в соцсетях: Нативная поддержка форматов 16:9, 9:16 и 1:1 для TikTok, YouTube и Instagram.

- Музыкальные клипы: Совместная генерация звука и видео позволяет добиться идеальной синхронизации картинки с ритмом музыки.

Альтернатива API Sora-2 №2: Wan 2.7

Основное позиционирование Wan 2.7

Wan 2.7 — это видеогенеративная модель нового поколения, представленная лабораторией Alibaba Tongyi в марте 2026 года. Она построена на архитектуре MoE (Mixture-of-Experts) с 27 млрд параметров и использует технологический стек Diffusion Transformer + Flow Matching. Модель уже доступна через платформы Alibaba Cloud DashScope и WaveSpeedAI. Это первая китайская MoE-модель для генерации видео с открытым API.

В отличие от SeeDance 2.0, ориентированной на мультимодальную интеграцию, главные фишки Wan 2.7 — это Thinking Mode (режим «мышления») и точное управление начальным и конечным кадрами. Модель может сначала «обдумать» структуру раскадровки перед генерацией, а также позволяет задавать ключевые кадры в начале и в конце видео — возможности, которых нет в текущем API Sora-2.

Ключевые возможности Wan 2.7

| Характеристика | Wan 2.7 | Сравнение с Sora-2 |

|---|---|---|

| Архитектура | 27B MoE | Не раскрыто |

| Макс. длительность | 15 сек | Аналогично |

| Макс. разрешение | 1080p | Аналогично |

| Thinking Mode | ✅ Поддержка планирования | ❌ Нет |

| Контроль кадров | ✅ Начальный + конечный | ❌ Только начальный |

| Сетка 9 референсов | ✅ До 9 изображений | ❌ Нет |

| Референс объекта+голоса | ✅ Поддерживается | ❌ Нет |

| Лимит промпта | 5000 символов | ~1000 символов |

| Доступ к API | DashScope / WaveSpeedAI / Агрегаторы | Официальный OpenAI (скоро закроют) |

| Цена (от) | $0.10/сек | $0.50/сек |

🎯 Совет по применению: Если для ваших задач критически важно точное соответствие начального и конечного кадров (например, для заставок брендов или рекламных отсчетов), то возможности Wan 2.7 станут незаменимыми. Рекомендуем вызывать Wan 2.7 через сервисы-прокси API, чтобы не возиться с SDK и механизмами подписи Alibaba Cloud.

Пример вызова Wan 2.7

from openai import OpenAI

# Используем сервис-прокси APIYI для удобного доступа

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="Неоновая улица в стиле киберпанк, камера медленно поднимается от земли к панорамному виду на город",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 Полный пример с использованием нескольких референсов (сетка 9 изображений + Thinking Mode)

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# Список из 9 эталонных изображений

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"Главный герой проходит через 9 различных сцен,"

"каждая сцена соответствует одному из референсов,"

"сохраняя согласованность внешности и одежды персонажа"

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

Сценарии использования Wan 2.7

- Брендовые заставки: точный контроль первого и последнего кадра без необходимости пост-обработки.

- Серии с одним персонажем: использование сетки из 9 референсов гарантирует, что герой не «поплывет» при смене ракурсов.

- Сложная раскадровка: Thinking Mode автоматически планирует структуру кадра, идеально для короткометражек и рекламы.

- Редактирование по инструкции: поддержка редактирования существующих видео на основе естественного языка.

- Сюжетная сетка: создание связного видеоряда на основе нескольких ключевых кадров.

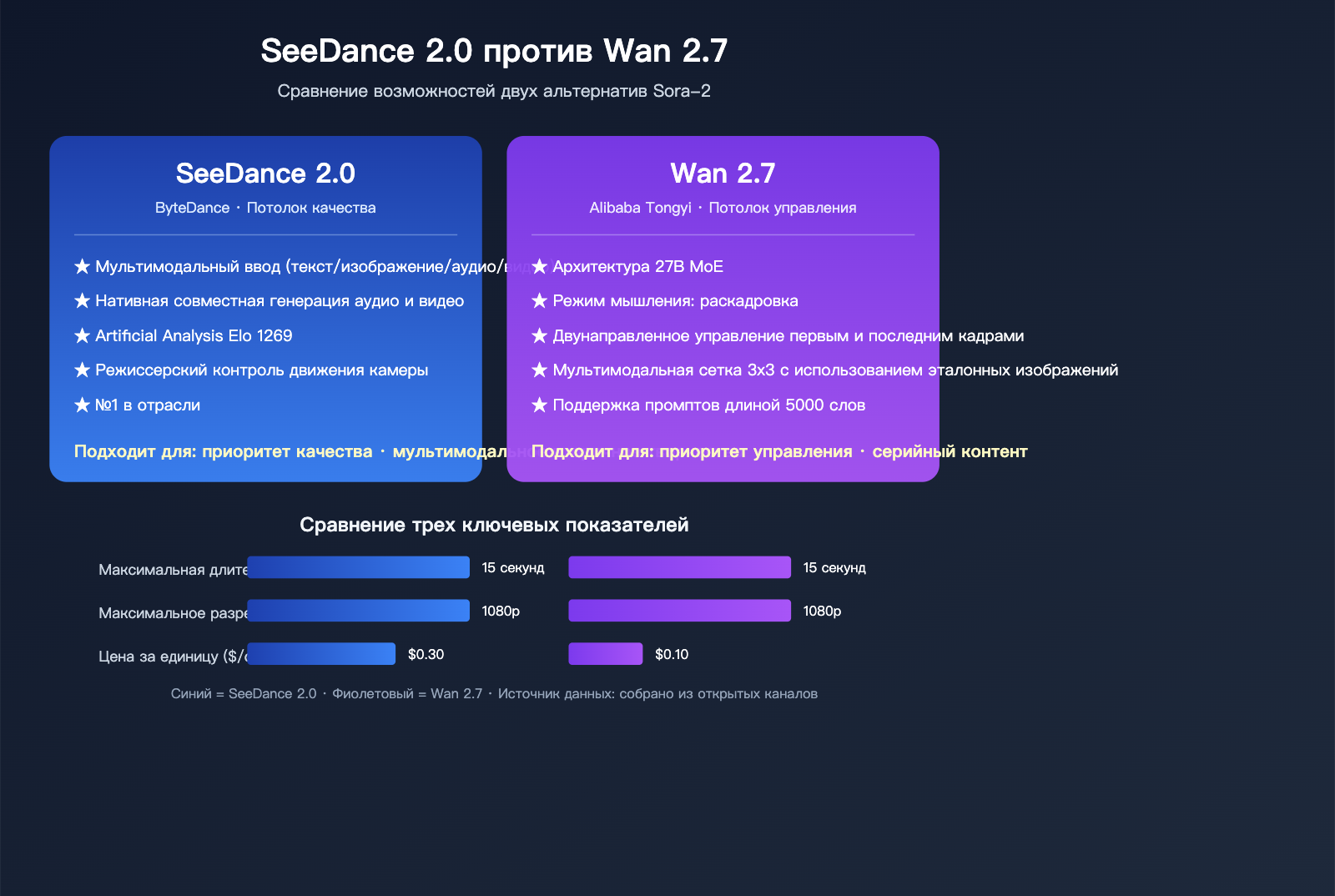

Сравнение SeeDance 2.0, Wan 2.7 и Sora-2: полный разбор

Сравнение ключевых характеристик трех моделей

| Параметр | Sora-2 (скоро отключится) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| Разработчик | OpenAI | ByteDance | Alibaba Tongyi |

| Дата релиза | Октябрь 2025 | 09.02.2026 | Март 2026 |

| Статус | Отключение 24.09.2026 | Открытый бета-тест | Открытый бета-тест |

| Макс. длительность | 15 с | 15 с | 15 с |

| Макс. разрешение | 1080p | 1080p | 1080p |

| Нативный звук | ✅ | ✅ (совместная генерация) | ✅ |

| Мультимодальный ввод | Текст+изображение | Текст+изображение+аудио+видео | Текст+несколько эталонных изображений |

| Контроль нач./кон. кадров | ❌ | ❌ | ✅ Двусторонний |

| Режим размышления | ❌ | ❌ | ✅ |

| Artificial Analysis Elo | ~1180 | 1269 (#1) | Еще не в рейтинге |

| Поддержка китайского | Средняя | Отличная | Отличная |

| Доступность в КНР | ❌ | ✅ | ✅ |

| Цена (ориентир) | $0.50/сек | $0.30/сек | от $0.10/сек |

Рекомендации по выбору сценария

| Бизнес-сценарий | Рекомендуемое решение | Почему? |

|---|---|---|

| Рекламные ролики | SeeDance 2.0 | Синхронный звук + кинематографичные пролеты |

| Веб-сериалы/серии | Wan 2.7 | Сетка из 9 эталонных изображений для консистентности персонажей |

| Заставки/титры | Wan 2.7 | Точный контроль начального и конечного кадров |

| Мультимодальный креатив | SeeDance 2.0 | Поддержка аудио и видео в качестве референсов |

| Генерация по тексту на кит. | Обе модели | Понимание лучше, чем у Sora-2 |

| Максимальное качество | SeeDance 2.0 | Первое место в Artificial Analysis |

| Массовая генерация (бюджет) | Wan 2.7 | Цена от $0.10/сек, явное преимущество |

| Контент для соцсетей (зарубеж) | SeeDance 2.0 | Нативный вывод в разных пропорциях |

| Товарные видео для e-commerce | Wan 2.7 | Референсы объекта гарантируют узнаваемость товара |

💡 Совет по выбору: Если нужно выбрать только одно решение, SeeDance 2.0 подойдет для задач с упором на качество, а Wan 2.7 — для задач с упором на контроль и стоимость. Рекомендуем подключить оба API через единую платформу-агрегатор, чтобы динамически переключаться между ними — это обеспечит максимальную гибкость в период миграции.

Расчет стоимости трех моделей (10 секунд видео 1080p)

| Модель | Оценка за 1 генерацию | Оценка за 10 000 генераций/мес | Примечание |

|---|---|---|---|

| Sora-2 | ~$5.00 | ~$50,000 | Недоступно после сентября |

| SeeDance 2.0 | ~$3.00 | ~$30,000 | Включая нативный звук |

| Wan 2.7 | ~$1.00 | ~$10,000 | Стартовая цена |

Примечание: Данные основаны на открытых источниках, актуальные цены уточняйте у провайдеров. Использование агрегаторов часто выгоднее, чем прямая подписка у вендоров.

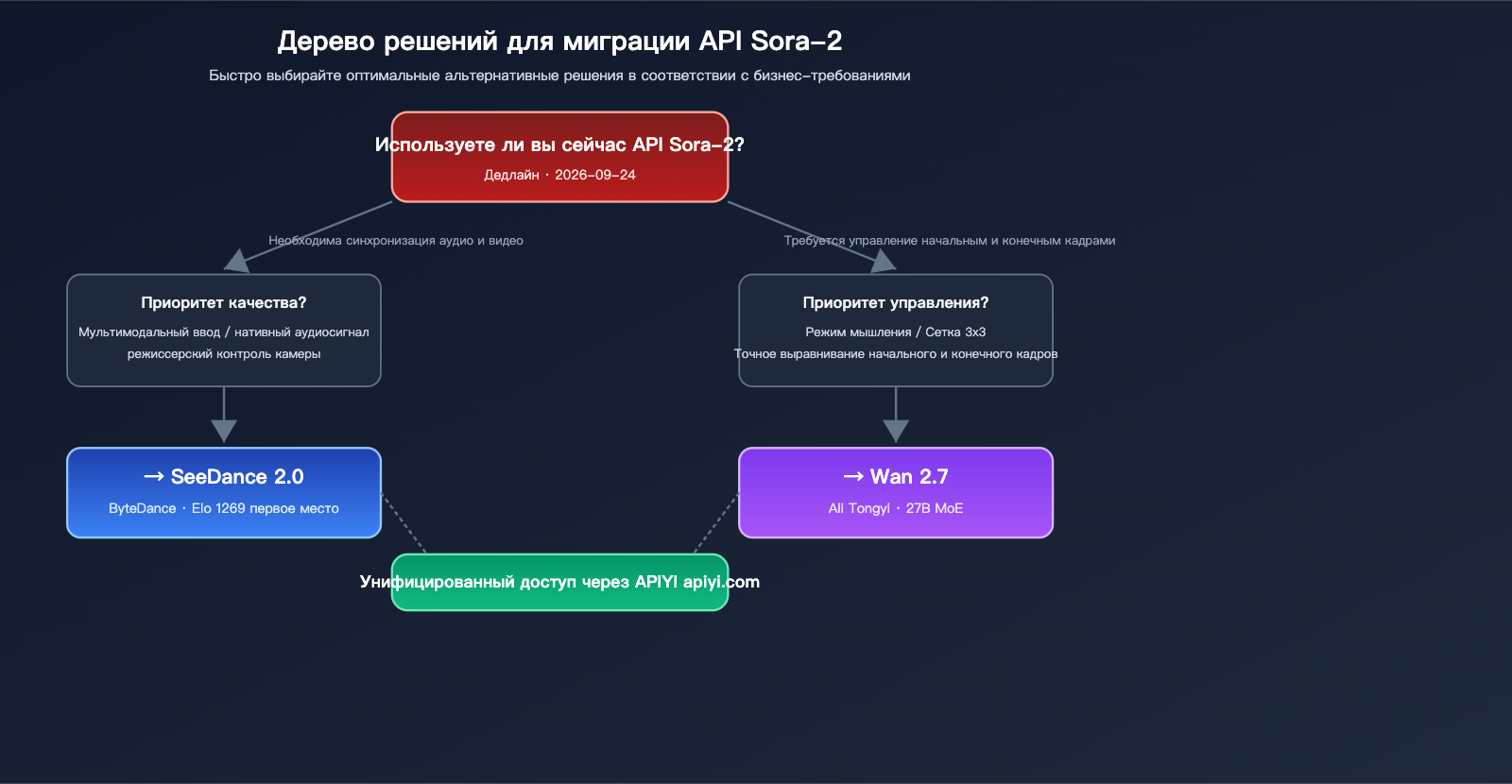

Быстрый старт: миграция с Sora-2 API

Дерево решений для миграции

Миграцию с Sora-2 можно разбить на 4 шага:

- Аудит текущих вызовов Sora-2: Найдите все места в коде, где вызывается

sora-2или Videos API, выпишите шаблоны промптов, параметры ввода и логику обработки ответа. - Выбор целевой модели: Определите основную модель на основе рекомендаций выше.

- Замена base_url и названия модели: Замените

base_urlOpenAI на адрес агрегатора (например,https://api.apiyi.com/v1), а название модели — наseedance-2.0илиwan-2.7. - Регрессионное тестирование: Прогоните набор типичных промптов, чтобы сравнить качество и задержки.

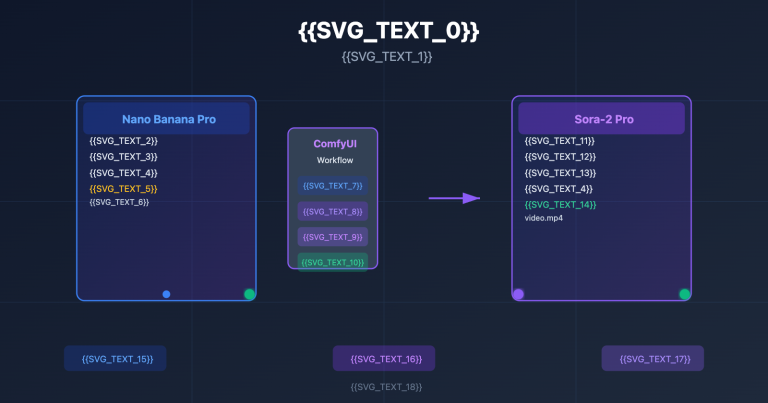

Подключение двух альтернатив через агрегатор

from openai import OpenAI

# Используем API-ключ от агрегатора

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

# Выбор модели в зависимости от предпочтений

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

# Генерация через разные модели

video_a = generate_video("Реклама продукта: умная колонка играет музыку", prefer="seedance")

video_b = generate_video("Заставка бренда: логотип проявляется из бликов", prefer="wan")

Преимущество такого подхода: один SDK, один API-ключ, один base_url для доступа к обоим решениям. После отключения Sora-2 24 сентября вам останется только сменить model="sora-2" на нужную альтернативу, не меняя остальной код.

Чек-лист миграции (рекомендуем распечатать)

| Этап | Задача | Время |

|---|---|---|

| Аудит | Список всех точек вызова Sora-2 | 0.5 дня |

| Аудит | Подготовка 50-100 эталонных промптов | 1 день |

| Интеграция | Регистрация на платформе-агрегаторе | 0.5 дня |

| Интеграция | Замена base_url и параметров модели | 1 день |

| Тесты | Запуск регрессионного набора | 2-3 дня |

| Тесты | Слепое тестирование качества (дизайнеры/продакты) | 1 неделя |

| Градиент | Переключение 10-30% трафика | 1 неделя |

| Градиент | Переключение на 100% | — |

| Финал | Удаление старого кода Sora-2 | 0.5 дня |

При таком графике миграция займет 4-6 недель, что оставляет запас времени до 24 сентября.

🎯 Совет: Не ждите сентября. Откройте аккаунт на агрегаторе прямо сейчас, продублируйте вызовы Sora-2 и замените

base_urlнаhttps://api.apiyi.com/v1. Это позволит проводить A/B-тесты в реальных условиях.

Контроль затрат в период миграции

Генерация видео стоит дороже текстовых моделей, поэтому без оптимизации счета могут вырасти. Рекомендуем:

- Стратегия понижения: На этапе тестов используйте 720p / 5 секунд, и только после проверки промпта переходите на 1080p / 15 секунд.

- Кэширование: Кэшируйте результаты по хешу промпта и параметров, чтобы не платить за повторы.

- Агрегированные платежи: Использование платформы-агрегатора помогает избежать минимальных порогов оплаты у каждого вендора отдельно.

- Пакетная генерация: Используйте Batch-режимы (ночная генерация), это дает скидки 30-50%.

- Оптимизация промптов: Точные промпты снижают количество перегенераций, экономя 20-40% бюджета.

Типичные проблемы и их решения

| Проблема | Причина | Решение |

|---|---|---|

| Разные пропорции кадра | Разные значения по умолчанию | Явно задавайте параметр aspect_ratio |

| Разница в лимитах длительности | Разные модели — разные правила | Указывайте duration явно |

| Отсутствие звука | Различия в API | Явно включайте audio=True |

| "Дрейф" стиля промпта | Разные предпочтения моделей | Оптимизируйте промпты под каждую модель отдельно |

| Различия в callback | Не все платформы поддерживают webhook | Используйте webhook агрегатора |

FAQ: Часто задаваемые вопросы об отключении Sora-2 API

Q1: Можно ли будет использовать видео, созданные до отключения Sora-2 API?

Да. Сами видеофайлы, если вы уже скачали их на локальный диск или в OSS, никак не пострадают от отключения API. Однако, если вы использовали прямые ссылки video_url, возвращаемые OpenAI, они перестанут работать после отключения API. Обязательно сохраните все видео в своем объектном хранилище до 24 сентября. Если объем данных большой, вы можете воспользоваться возможностями видео-прокси на платформе APIYI (apiyi.com) для пакетной загрузки — платформа автоматически настроит параллелизм и повторные попытки при сбоях.

Q2: Выпустит ли OpenAI API для Sora-3 в будущем?

Официального графика для Sora-3 от OpenAI нет. С точки зрения стратегии, OpenAI сейчас направляет вычислительные мощности на основную линейку GPT и агентские сервисы, поэтому вероятность перезапуска API для генерации видео в краткосрочной перспективе крайне мала. Аналитика Wikipedia и Futurum Group также указывает на то, что коммерческие показатели Sora не оправдали ожиданий, что и стало основной причиной закрытия. Не стоит строить бизнес-планы на надежде, что «Sora-3 когда-нибудь вернется» — обязательно завершите миграцию на SeeDance 2.0 или Wan 2.7.

Q3: Можно ли стабильно вызывать SeeDance 2.0 и Wan 2.7 из материкового Китая?

Да. Эти модели управляются ByteDance и Alibaba соответственно, их серверы находятся внутри страны, а стабильность сети значительно выше, чем при работе с OpenAI через границу. Если раньше для Sora-2 вам требовались прокси или зарубежные серверы, то после перехода на эти модели сетевую архитектуру можно упростить. Прямое использование через отечественные агрегаторы позволяет решить вопросы стабильности и получения закрывающих документов (счетов-фактур) одновременно.

Q4: Есть ли смысл использовать реверс-инжиниринг Sora API в качестве переходного этапа?

Не рекомендуем. Стабильность реверс-инжиниринговых API резко упала после первого квартала 2026 года, а после сентября, когда исчезнет официальный источник, такие интерфейсы окончательно перестанут работать. Инвестиции в подобные решения — это создание нового кода на заведомо мертвом стеке, что лишь увеличит затраты на последующую миграцию. Самый экономичный путь — сразу перейти на SeeDance 2.0 или Wan 2.7.

Q5: Как оценить реальную эффективность альтернатив при миграции?

Рекомендуем проводить трехмерную оценку: визуальное качество (субъективная оценка), точность следования промпту (объективное сравнение) и стоимость одного вызова (финансовый расчет). Практический подход: возьмите 50 репрезентативных промптов из истории вызовов Sora-2, прогоните их через SeeDance 2.0 и Wan 2.7 и проведите «слепое» тестирование силами продуктовой команды. Рекомендуем использовать агрегатор для тестов: единая биллинг-система и логи позволят быстро выбрать вариант, идеально подходящий для вашего бизнеса.

Q6: Изменится ли спецификация API при переходе на агрегатор?

Агрегаторы обычно поддерживают протоколы, совместимые с OpenAI. Это значит, что ваш текущий код для Sora-2 можно оставить почти без изменений — достаточно поправить поля base_url и model. Параметры запросов для генерации видео (промпт, длительность, аудио, разрешение и т.д.) могут немного отличаться, но агрегаторы проводят выравнивание параметров. Подробности можно найти в документации платформы.

Q7: Стоит ли мигрировать сейчас или подождать до сентября?

Настоятельно рекомендуем начать тестирование прямо сейчас и завершить миграцию до конца июня. Есть три причины:

- Чем ближе 24 сентября, тем выше нагрузка на ресурсы агрегаторов и альтернативных моделей из-за наплыва пользователей Sora-2.

- Ранняя миграция позволит тщательно сравнить альтернативы и избежать спешки.

- Разработчики, перешедшие раньше, обычно получают лучшие квоты на тестирование и более выгодные тарифы.

Q8: Какая модель, SeeDance 2.0 или Wan 2.7, лучше работает с промптами на китайском языке?

Обе модели значительно превосходят Sora-2 в понимании китайского языка. SeeDance 2.0 лучше передает эмоции и детализацию движений, а Wan 2.7, благодаря поддержке длинных промптов (до 5000 символов) и режиму Thinking Mode, показывает более стабильные результаты в сложных повествовательных сценариях. Если ваши промпты обычно короче 200 иероглифов — выбирайте SeeDance 2.0; если нужно описывать сложные раскадровки — выбирайте Wan 2.7.

Q9: Как избежать перебоев в обслуживании во время миграции?

Самый безопасный способ — двойная запись и двойное чтение (dual-write/dual-read): во время перехода вызывайте и Sora-2, и целевую модель, сохраняя оба результата, а на фронтенде переключайте трафик по схеме A/B. Если с новой моделью возникнут проблемы, вы сможете мгновенно откатиться на Sora-2 (до 24 сентября), минимизировав риски. Агрегаторы обычно поддерживают динамическую маршрутизацию на основе поля model, что делает реализацию такой схемы очень простой.

Итог: лучший путь после отключения Sora-2 API

OpenAI зафиксировала дату отключения Sora-2 API на 24 сентября 2026 года, и у бизнеса осталось менее полугода. Реверс-инжиниринг, бывший когда-то «дешевым переходным решением», потерял смысл на фоне ужесточения контроля и официального закрытия.

К счастью, в 2026 году в сфере генерации видео сложилась здоровая конкурентная среда: SeeDance 2.0 с показателем Artificial Analysis Elo 1269 стала эталоном качества, отлично справляясь с мультимодальным вводом и генерацией аудио-видео; Wan 2.7 заняла свою нишу благодаря Thinking Mode и контролю первого/последнего кадра, что идеально подходит для сценариев с точной визуальной настройкой. Оба решения превосходят уходящую Sora-2 по поддержке китайского языка, соответствию требованиям регуляторов и стабильности.

Наш совет: не кладите все яйца в одну корзину. Подключитесь к SeeDance 2.0 и Wan 2.7 через платформу APIYI (apiyi.com) и используйте динамическую маршрутизацию: контент, где важно качество — через SeeDance 2.0, а задачи с необходимостью точного контроля — через Wan 2.7. Такая архитектура обеспечит стабильность при миграции и позволит бесшовно продолжить работу после сентября.

Самое главное: начинайте сейчас. Если отложить старт до августа или сентября, адаптация моделей, настройка промптов и получение квот станут гораздо сложнее. Рекомендуем запустить PoC-тестирование на этой неделе, клонировать текущий код Sora-2 для параллельных тестов и принимать решения на основе реальных данных. Это гарантирует, что к 24 сентября ваша альтернативная система будет работать стабильно уже как минимум два месяца.

Автор: Команда APIYI — специализируемся на проксировании API для больших языковых моделей и агрегации сервисов генерации видео.