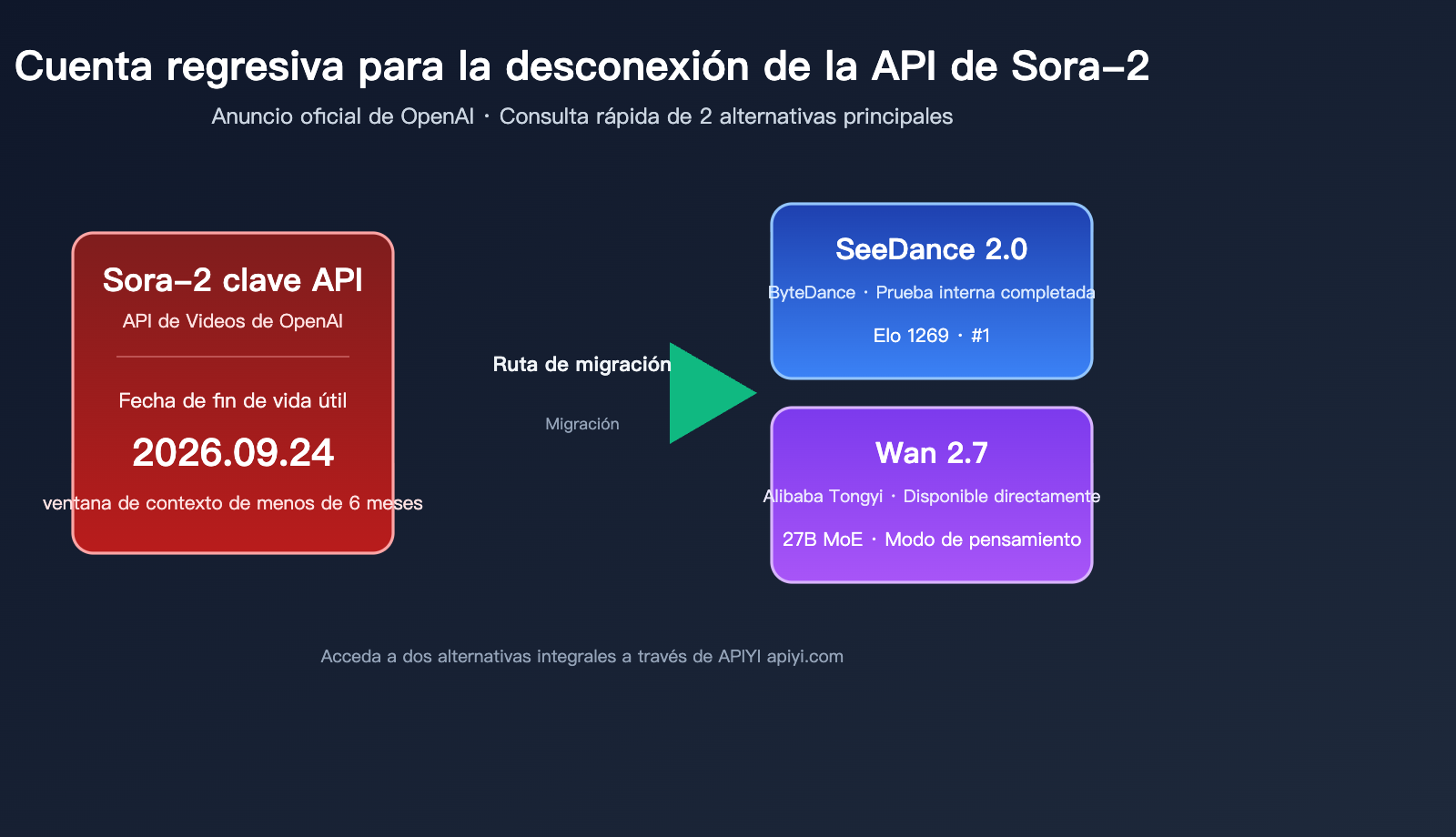

title: "Guía de migración: Qué hacer ante el cierre de la API de Sora-2"

description: "OpenAI cerrará la API de Sora-2 el 24 de septiembre de 2026. Analizamos el cronograma, el impacto y las mejores alternativas: SeeDance 2.0 y Wan 2.7."

OpenAI anunció oficialmente el 24 de marzo de 2026 a través de un aviso a desarrolladores: la fecha de cierre de la API de Sora-2 es el 24 de septiembre de 2026. Esto significa que todos los servicios de generación de video que dependen de sora-2, sora-2-pro y la API de Videos deben completar su migración en menos de seis meses.

Más preocupante aún es que las llamadas "API de Sora inversas" que circularon en el mercado durante el último semestre son prácticamente inutilizables tras el endurecimiento de los controles de riesgo de OpenAI; seguir dependiendo de esta vía solo llevará a que tu negocio siga enfrentando problemas. Este artículo analiza en detalle el cronograma de cierre de la API de Sora-2, su alcance oficial y recomienda dos alternativas listas para producción basadas en datos reales: SeeDance 2.0 de ByteDance y Wan 2.7 de Alibaba Tongyi.

Si estás utilizando la API de Sora-2 para la producción de contenido de video, te recomendamos comparar y probar SeeDance 2.0 y Wan 2.7 directamente a través de la plataforma APIYI (apiyi.com), la cual ya ha integrado de forma unificada varios modelos de generación de video líderes, lo que puede reducir al máximo tus costos de migración.

Cronograma de cierre y alcance del impacto de la API de Sora-2

Hitos oficiales del cierre de la API de Sora-2

OpenAI ha adoptado una estrategia de cierre en dos etapas para el producto Sora: primero se cierran las aplicaciones para el usuario final (C-end) y luego la API para empresas (B-end), dejando un periodo de gracia de unos 5 meses para que los desarrolladores migren. Es el "aterrizaje forzoso" más completo en la historia de una línea de productos de OpenAI, pero el margen de tiempo para los desarrolladores sigue siendo muy ajustado.

| Hito temporal | Evento | Afectados | Periodo de gracia |

|---|---|---|---|

| 24-03-2026 | Aviso oficial | Todos los usuarios de la API Sora-2 | T+0 |

| 26-04-2026 | Cierre de web y App de Sora | Usuarios finales, creadores | T+33 días |

| 24-09-2026 | Cierre oficial de la API de Sora-2 | Todos los servicios integrados | T+184 días |

| Después del 25-09-2026 | El endpoint devuelve 410 Gone | Servicios sin migrar interrumpidos | — |

En su centro de ayuda, OpenAI recomienda explícitamente: si deseas conservar el contenido de video generado anteriormente en Sora, asegúrate de exportar los datos antes del cierre de la App el 26 de abril. Sin embargo, para los desarrolladores que integran vía API, la fecha límite real es el 24 de septiembre.

Cabe destacar que OpenAI no ha prometido ninguna posibilidad de "prórroga". A juzgar por cómo se han gestionado los cierres de modelos desde 2025, el cierre al llegar la fecha es el procedimiento estándar, por lo que no conviene hacerse ilusiones.

Lista completa de modelos afectados por el cierre

Muchos equipos creen que solo el alias sora-2 dejará de funcionar, pero en realidad, este retiro afecta a toda la línea de modelos de la API de Videos:

| ID del modelo | Tipo | Estado | Alternativa sugerida |

|---|---|---|---|

sora-2 |

Alias estándar | Cerrado | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

Alias HD | Cerrado | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

Snapshot estándar | Cerrado | SeeDance 2.0 |

sora-2-2025-12-08 |

Snapshot estándar | Cerrado | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

Snapshot Pro | Cerrado | Wan 2.7 (incluye Thinking Mode) |

| API de Videos (interfaz completa) | Endpoint API | Retirado | Plataformas agregadoras compatibles |

En otras palabras, OpenAI no mantendrá ningún punto de entrada para la API de generación de video. A partir del 25 de septiembre, todas las solicitudes con el prefijo videos devolverán un error 410 Gone o de obsolescencia. Esto es totalmente distinto a la práctica anterior de la serie GPT, donde solo se retiraban los "snapshots" pero se mantenían los alias; esto es una salida a nivel de línea de negocio.

🎯 Información clave: Esto significa que no puedes simplemente "cambiar el nombre del modelo" para completar la migración; debes cambiar a una API de generación de video completamente distinta. Se recomienda completar las pruebas de integración de las nuevas soluciones antes de finales de junio. Puedes usar una plataforma agregadora para comparar SeeDance 2.0 y Wan 2.7 de una sola vez y evitar el estrés de la migración en los últimos dos meses.

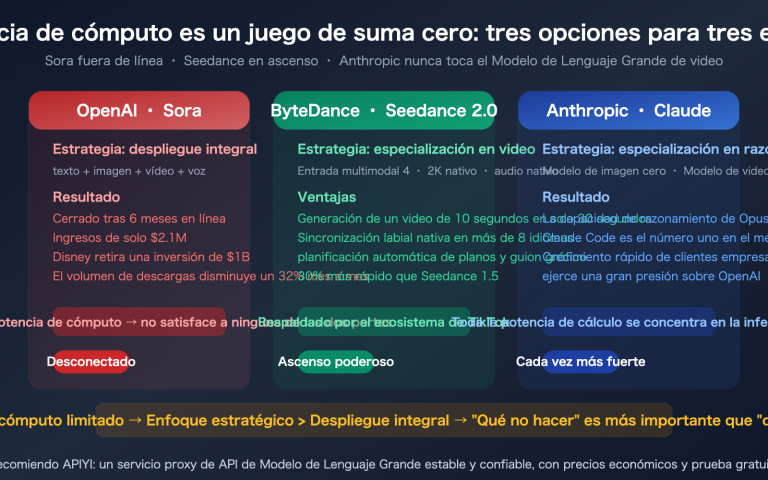

Razones reales del cierre de la API de Sora-2

OpenAI no ha dado explicaciones detalladas, pero combinando los análisis de medios como The Decoder, Futurum Group y Wikipedia, las razones principales se pueden resumir en tres niveles:

- Costos de cómputo insostenibles: El tiempo de GPU requerido por cada invocación de generación de video es decenas de veces superior al de los modelos de texto, y los ingresos comerciales no han logrado cubrir los costos. Tras el lanzamiento de Sora-2, OpenAI tuvo que imponer restricciones estrictas a las cuotas por usuario, lo que a su vez frenó la voluntad de integración de los desarrolladores.

- Altos riesgos de seguridad de contenido: Incluso con marcas de agua y moderación de contenido, Sora siguió generando controversias sobre deepfakes y derechos de autor; los costos legales y de cumplimiento superaron con creces el valor del modelo en sí.

- Enfoque estratégico: OpenAI está priorizando sus recursos de cómputo en la línea principal de GPT, Operator y los negocios de agentes; el video ya no es una dirección central por el momento.

Entender estas razones es muy importante para elegir una alternativa: las empresas que pueden invertir continuamente en generación de video son, inevitablemente, aquellas que consideran el video como una ruta estratégica principal. ByteDance y Alibaba consideran la generación de video como una dirección estratégica importante, lo que hace que su ritmo de iteración de productos sea mucho más rápido que el de OpenAI, y es la razón fundamental por la que pueden absorber rápidamente a la base de usuarios de Sora-2 en 2026.

title: "¿Por qué la 'API inversa de Sora' ya no es una opción viable?"

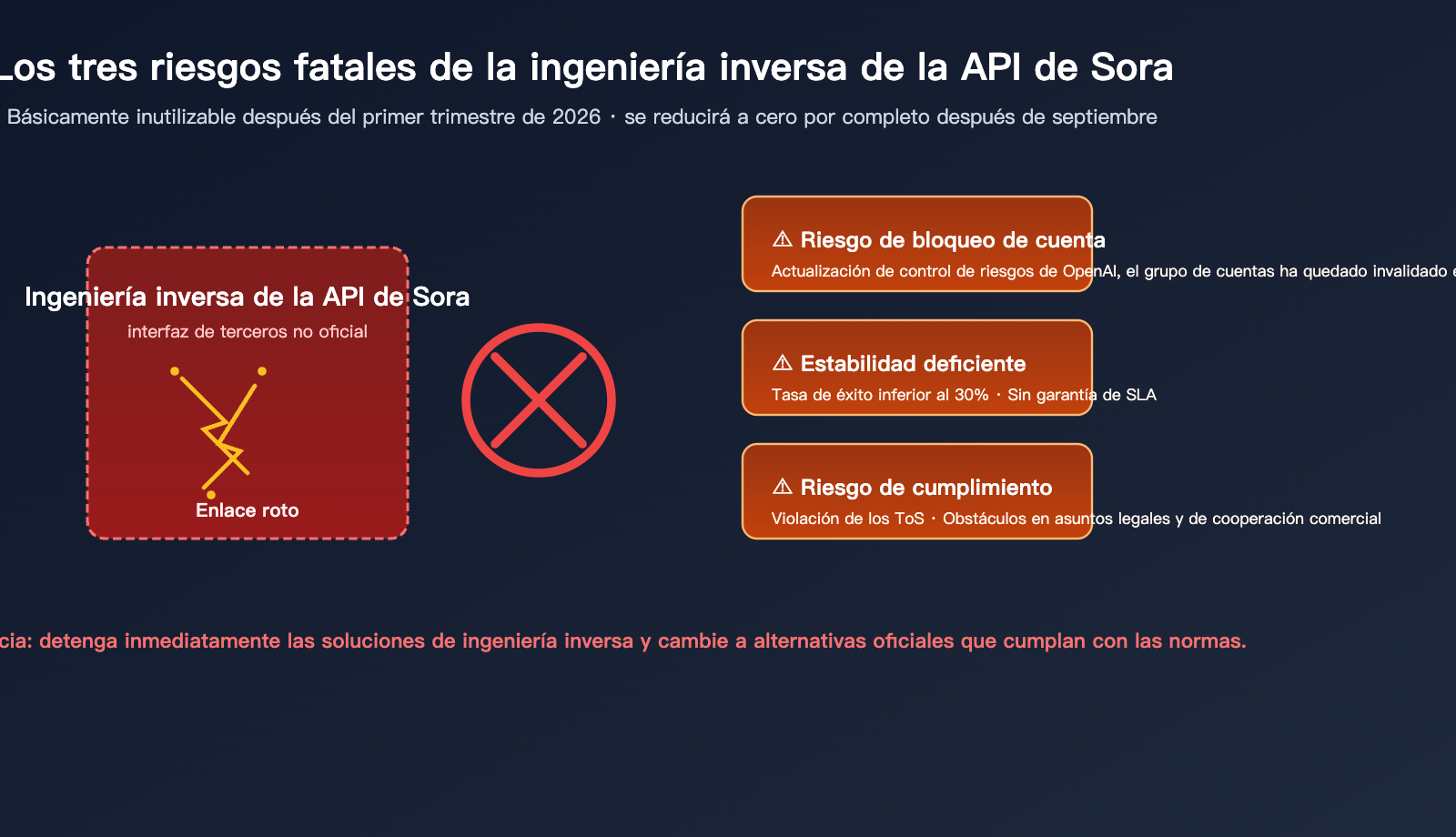

¿Por qué la "API inversa de Sora" ya no es una opción viable?

Estado actual de la API inversa de Sora en 2026

Durante el último semestre, han circulado en la comunidad china múltiples interfaces inversas que prometían "invocar Sora-2 sin necesidad de una cuenta de OpenAI", con precios que oscilaban entre una fracción y una décima parte del costo oficial. Sin embargo, según los comentarios de diversas comunidades de desarrolladores, estas interfaces han quedado prácticamente inutilizables después del primer trimestre de 2026:

- En enero de 2026, OpenAI actualizó sus reglas de control de riesgos de Cloudflare, provocando que una gran cantidad de interfaces inversas devuelvan directamente un error 403.

- Algunos proveedores de servicios inversos utilizan grupos de cuentas (pools), pero OpenAI ha reforzado el bloqueo de cuentas masivas anómalas, lo que provoca que todo el grupo quede inhabilitado.

- Incluso cuando funcionan ocasionalmente, la velocidad de generación es extremadamente lenta y la tasa de éxito es inferior al 30%, lo que las hace totalmente inviables para entornos de producción.

- Cada vez más proveedores de servicios inversos están "desapareciendo" o cambiando de modelo de negocio, lo que pone en riesgo de pérdida total los saldos prepagados.

Más importante aún, dado que OpenAI ha decidido retirar la API oficial el 24 de septiembre, el "origen" de estas interfaces inversas desaparecerá por completo; este camino llegará a cero después de septiembre.

3 razones por las que no deberías seguir invirtiendo en soluciones inversas

| Dimensión de riesgo | Manifestación específica | Consecuencia empresarial |

|---|---|---|

| Riesgo de estabilidad | Interfaz bloqueada en cualquier momento, sin garantía de SLA | Interrupción constante en producción |

| Riesgo de cumplimiento | Violación de los ToS de OpenAI, posible implicación en compraventa de cuentas | Obstáculos legales y comerciales |

| Costos hundidos | Cierre oficial en septiembre, las soluciones inversas dejarán de funcionar | Desperdicio de recursos en una segunda migración |

| Riesgo de datos | Los proxies de terceros pueden acceder a sus indicaciones y contenido generado | Fuga de secretos comerciales |

⚠️ Recomendación: Si su equipo sigue utilizando cualquier forma de API inversa de Sora, detenga inmediatamente el desarrollo de nuevas funciones y priorice la evaluación de alternativas oficiales y conformes. Recomendamos integrar SeeDance 2.0 o Wan 2.7 a través de plataformas de agregación conformes, lo que garantiza la estabilidad del servicio y evita problemas de auditoría.

Alternativa a la API de Sora-2: SeeDance 2.0

Posicionamiento central de SeeDance 2.0

SeeDance 2.0 es el modelo insignia de generación de video lanzado oficialmente por el equipo de Modelos de Lenguaje Grandes de Doubao (ByteDance) el 9 de febrero de 2026. El 14 de abril se abrió la beta pública en la plataforma BytePlus ModelArk de Volcano Engine, y desde el 9 de abril ya está disponible para invocación en la plataforma fal. En el ranking de modelos de video de Artificial Analysis, SeeDance 2.0 alcanzó un Elo de 1269, superando a Google Veo 3, OpenAI Sora 2 y Runway Gen-4.5, posicionándose como el número uno en los rankings públicos actuales.

Su mayor diferencia radica en la adopción de una arquitectura unificada de generación multimodal de audio y video, lo que significa que no es necesario generar el video y luego añadir el audio; en una sola inferencia, produce hasta 15 segundos de contenido audiovisual con calidad cinematográfica. Esta capacidad de "origen común para audio y video" es algo que Sora-2 no puede igualar, ya que requiere generar el video primero y luego añadir un TTS externo.

Resumen de capacidades clave de SeeDance 2.0

| Dimensión de capacidad | Rendimiento de SeeDance 2.0 | Comparativa con Sora-2 |

|---|---|---|

| Duración máxima por vez | 15 segundos | Igual |

| Audio sincronizado | Generación nativa conjunta | Sora-2 requiere TTS externo |

| Modalidades de entrada | Texto / Imagen / Audio / Video | Sora-2 solo texto + imagen |

| Control de cámara | Instrucciones de dirección cinematográfica | Sora-2 es más limitado |

| Realismo físico | Líder en la industria | Igual |

| Elo de Artificial Analysis | 1269 (#1) | ~1180 |

| Canales de acceso público | BytePlus ModelArk / fal / Plataformas agregadoras | Oficial de OpenAI (se retirará) |

| Comprensión de indicaciones en chino | Excelente | Normal |

SeeDance 2.0 está actualmente disponible para pruebas internas a través de la plataforma APIYI (apiyi.com). Si está buscando una alternativa para Sora-2, puede contactar al servicio al cliente de la plataforma para obtener una cuota de prueba de SeeDance 2.0, invocándolo de manera unificada a través del protocolo compatible con OpenAI.

Ejemplo de invocación de SeeDance 2.0

A continuación, se muestra un ejemplo sencillo para invocar SeeDance 2.0 mediante la interfaz compatible con OpenAI:

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="seedance-2.0",

prompt="Un gato naranja salta desde el alféizar de la ventana al sofá, el sol de la tarde entra por las persianas, la cámara sigue al gatito con un movimiento lento",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 Ejemplo completo de invocación (incluye manejo de excepciones y polling)

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"Error en la tarea: {status.error}")

time.sleep(5)

except Exception as e:

print(f"Excepción en la invocación: {e}")

return None

url = generate_seedance_video(

prompt="Un autobús rojo de dos pisos de estilo retro pasa por las calles de Londres después de la lluvia, las ventanas reflejan las luces de la calle",

duration=12

)

print(url)

Escenarios de aplicación de SeeDance 2.0

- Videos cortos de marca: Audio nativo sincronizado + movimientos de cámara cinematográficos, ideal para anuncios y materiales de marca.

- Creación multimodal: Admite audio y video como referencia de entrada, ideal para derivados de contenido IP.

- Consistencia facial: Excelente capacidad de referencia multimodal, ideal para la producción de contenido serializado.

- Publicidad en redes sociales internacionales: Salida nativa en múltiples relaciones de aspecto (16:9 / 9:16 / 1:1), adaptada directamente para TikTok, YouTube e Instagram.

- Videos musicales (MV): La generación conjunta de audio y video permite que la imagen y el ritmo de la música estén alineados de forma natural.

Alternativa 2 a la API de Sora-2: Wan 2.7

Posicionamiento central de Wan 2.7

Wan 2.7 es un Modelo de Lenguaje Grande de generación de video de nueva generación lanzado por Alibaba Tongyi Lab en marzo de 2026. Se basa en una arquitectura MoE (Mixture-of-Experts) de 27B de parámetros y utiliza la ruta técnica de Diffusion Transformer + Flow Matching. Ya está disponible a través de la plataforma DashScope de Alibaba Cloud y la plataforma WaveSpeedAI, siendo el primer modelo de video MoE de un fabricante nacional con API pública.

A diferencia de SeeDance 2.0, que se centra en la fusión multimodal, los dos puntos de venta únicos de Wan 2.7 son: el Thinking Mode (modo de pensamiento) y el control preciso del fotograma inicial y final. Puede "pensar" en la estructura de la toma antes de generar el video y permite especificar simultáneamente los fotogramas clave de inicio y fin, capacidades de las que carece la API de Sora-2 actual.

Resumen de capacidades clave de Wan 2.7

| Dimensión de capacidad | Rendimiento de Wan 2.7 | Comparativa con Sora-2 |

|---|---|---|

| Arquitectura del modelo | 27B MoE | No público |

| Duración máxima por vez | 15 segundos | Igualado |

| Resolución máxima | 1080p | Igualado |

| Thinking Mode | ✅ Soporta pensamiento de tomas | ❌ No soportado |

| Control de fotogramas | ✅ Especifica inicio y fin | ❌ Solo fotograma inicial |

| Referencia de 9 cuadrículas | ✅ Hasta 9 imágenes de referencia | ❌ No soportado |

| Referencia sujeto + voz | ✅ Soporta referencia combinada | ❌ No soportado |

| Límite de longitud de indicación | 5000 caracteres | ~1000 caracteres |

| Canales de invocación | Alibaba DashScope / WaveSpeedAI / Plataformas agregadoras | Oficial de OpenAI (se retirará) |

| Precio de referencia | Desde $0.10/seg | Desde $0.50/seg |

🎯 Recomendación de escenario: Si sus necesidades de generación de video requieren requisitos claros para las imágenes de inicio y fin (por ejemplo, intros y outros de marca, cuentas regresivas publicitarias), la capacidad de control de fotogramas de Wan 2.7 es insustituible para Sora-2. Se recomienda invocar Wan 2.7 directamente a través de una plataforma agregadora, sin necesidad de gestionar el SDK y el mecanismo de firma de Alibaba Cloud por su cuenta.

Ejemplo de invocación de Wan 2.7

from openai import OpenAI

# Usando el servicio proxy de API de APIYI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="Calle de neón estilo cyberpunk, la cámara asciende lentamente desde el suelo hasta una vista aérea de toda la ciudad",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 Ejemplo completo de referencia multimagen de Wan 2.7 (entrada de 9 cuadrículas + Thinking Mode)

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# Lista de imágenes de referencia

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"El protagonista atraviesa 9 escenas diferentes,"

"cada escena corresponde a una de las imágenes de referencia,"

"el video mantiene la consistencia facial y de vestuario del personaje"

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

Escenarios de aplicación de Wan 2.7

- Intros y outros de marca: Control preciso de fotogramas iniciales y finales, sin necesidad de alineación en postproducción.

- Series con consistencia de personajes: La referencia de 9 cuadrículas garantiza que el personaje no se desplace entre múltiples tomas.

- Tomas complejas: El Thinking Mode planifica automáticamente la estructura de la toma, ideal para cortometrajes y publicidad.

- Edición basada en instrucciones: Soporta la edición de videos existentes mediante instrucciones en lenguaje natural.

- Narrativa de 9 cuadrículas: Genera videos narrativos coherentes a partir de múltiples imágenes clave.

title: "Comparativa integral: SeeDance 2.0 vs Wan 2.7 vs Sora-2"

description: "Guía completa para migrar de Sora-2 a alternativas de alto rendimiento como SeeDance 2.0 y Wan 2.7 antes de su cierre."

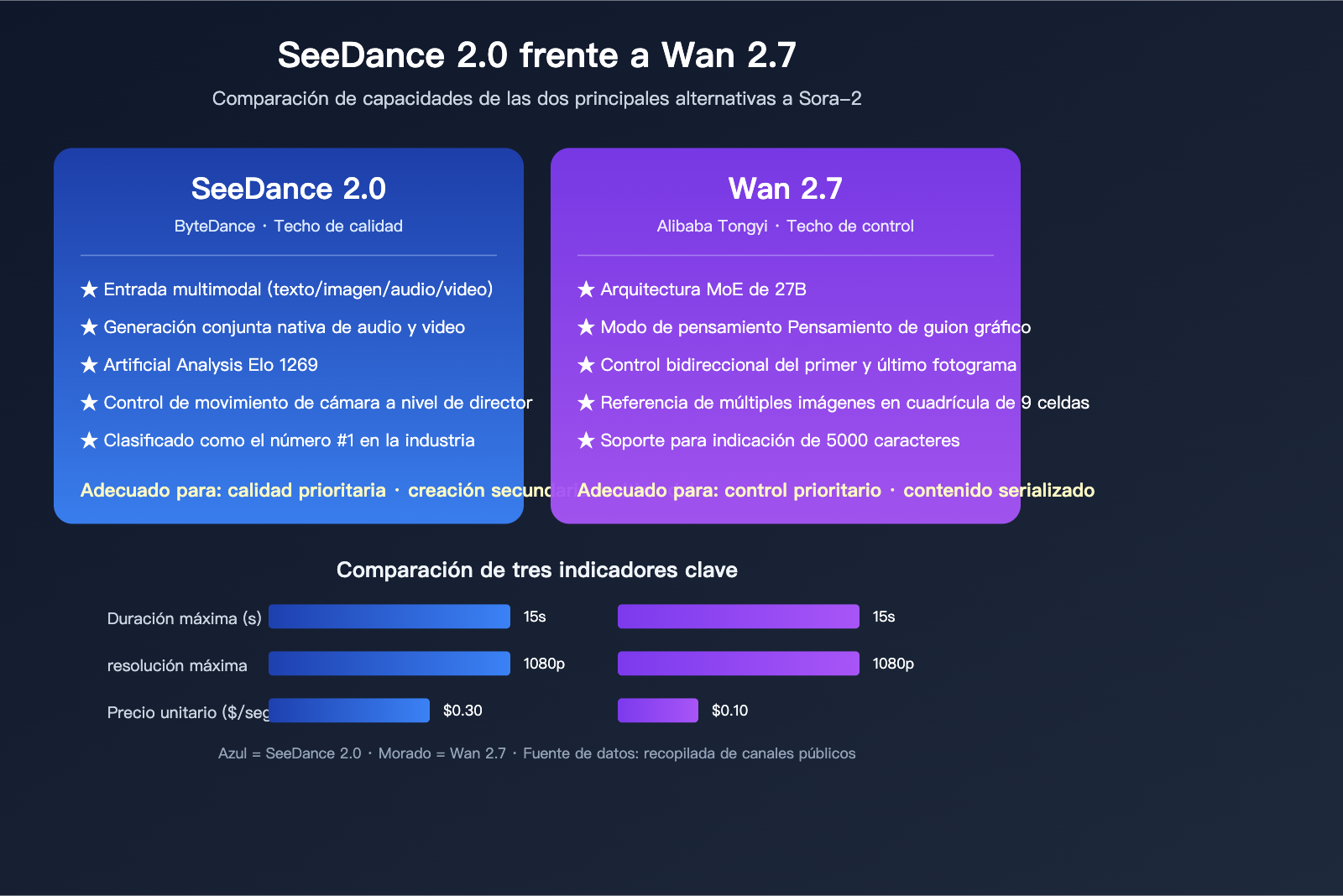

Comparativa integral: SeeDance 2.0 vs Wan 2.7 vs Sora-2

Comparativa de indicadores clave de los tres modelos

| Dimensión de comparación | Sora-2 (Próximo a cerrar) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| Fabricante | OpenAI | ByteDance | Alibaba Tongyi |

| Fecha de lanzamiento | 2025-10 | 2026-02-09 | 2026-03 |

| Estado del servicio | Cierre el 24-09-2026 | Beta abierta | Beta abierta |

| Duración máxima | 15s | 15s | 15s |

| Resolución máxima | 1080p | 1080p | 1080p |

| Audio nativo | ✅ | ✅ (Generación conjunta) | ✅ |

| Entrada multimodal | Texto+Imagen | Texto+Imagen+Audio+Video | Texto+Múltiples imágenes de referencia |

| Control de fotogramas inicial/final | ❌ | ❌ | ✅ Bidireccional |

| Thinking Mode | ❌ | ❌ | ✅ |

| Artificial Analysis Elo | ~1180 | 1269 (#1) | Aún no clasificado |

| Soporte de chino | Regular | Excelente | Excelente |

| Cumplimiento normativo local | ❌ | ✅ | ✅ |

| Precio de referencia | $0.50/seg | $0.30/seg | Desde $0.10/seg |

Recomendaciones de selección por escenario

| Escenario de negocio | Solución preferida | Motivo |

|---|---|---|

| Cortos de publicidad de marca | SeeDance 2.0 | Audio sincronizado + movimientos de cámara cinematográficos |

| Series/Contenido serializado | Wan 2.7 | Referencia de cuadrícula 9×9 para consistencia de personajes |

| Personalización de intros/outros | Wan 2.7 | Control preciso de fotogramas iniciales y finales |

| Creación multimodal | SeeDance 2.0 | Soporta entrada de referencia de audio y video |

| Generación basada en guiones en chino | Ambos | Comprensión del chino superior a Sora-2 |

| Prioridad de calidad máxima | SeeDance 2.0 | #1 en Artificial Analysis |

| Generación masiva sensible a costos | Wan 2.7 | Desde $0.10/seg, ventaja de precio clara |

| Contenido para redes sociales internacionales | SeeDance 2.0 | Salida nativa en múltiples relaciones de aspecto |

| Videos de productos de e-commerce | Wan 2.7 | Referencia del sujeto para asegurar consistencia del producto |

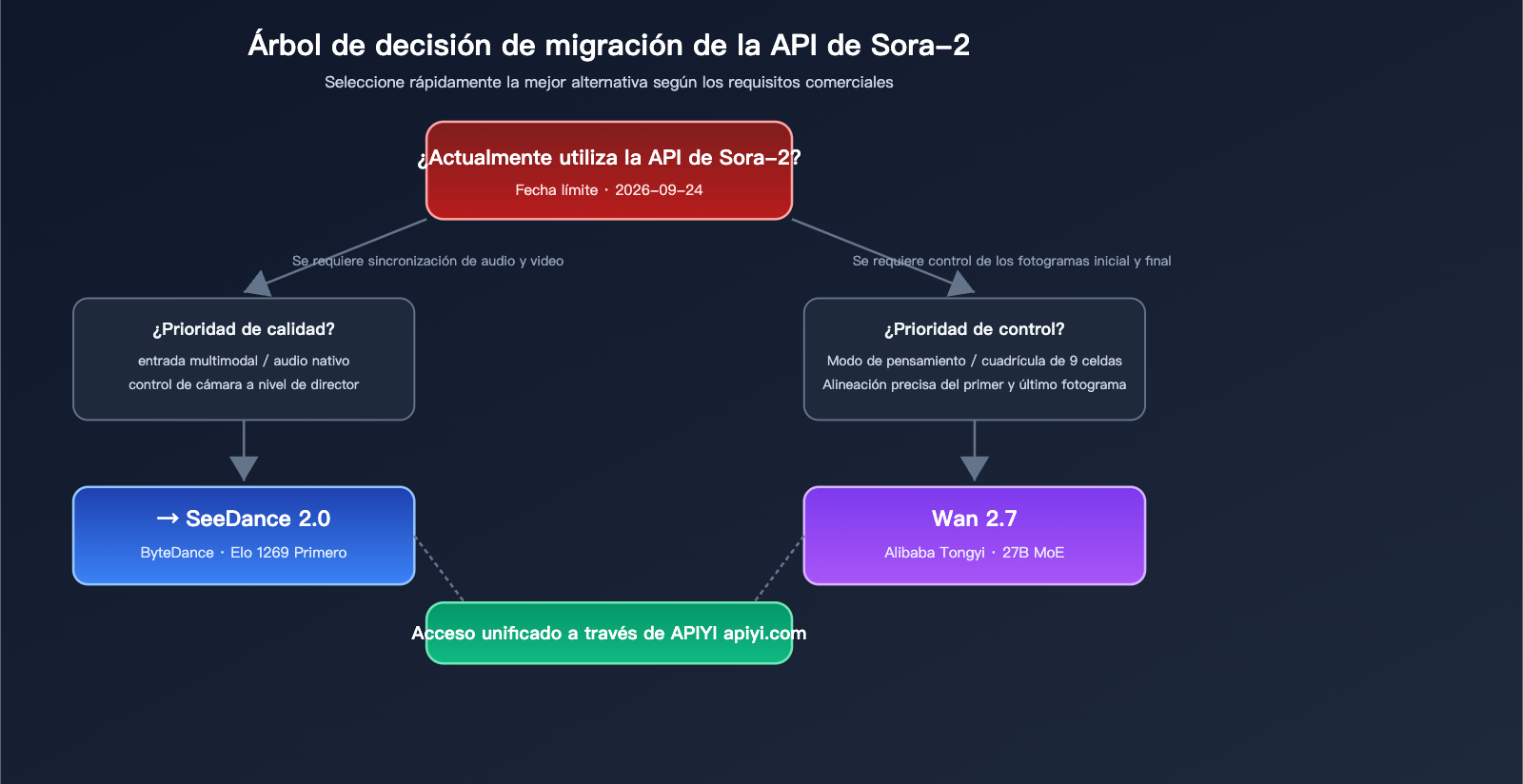

💡 Consejo de selección: Si solo puede elegir uno a corto plazo, SeeDance 2.0 es ideal para escenarios de "calidad primero", mientras que Wan 2.7 es mejor para escenarios de "control primero" y "costo primero". Se recomienda habilitar el acceso a ambos modelos en una plataforma de agregación para enrutar dinámicamente según la solicitud, manteniendo la máxima flexibilidad durante la migración.

Cálculo de costos de los tres modelos (Video de 10 segundos a 1080p)

| Modelo | Costo estimado por vez | Costo estimado mensual (10k veces) | Notas |

|---|---|---|---|

| Sora-2 | ~$5.00 | ~$50,000 | No disponible después de septiembre |

| SeeDance 2.0 | ~$3.00 | ~$30,000 | Incluye audio nativo |

| Wan 2.7 | ~$1.00 | ~$10,000 | Precio de entrada |

Nota: Los datos anteriores se basan en fuentes públicas; los precios reales están sujetos a las cotizaciones más recientes de los fabricantes. El uso a través de plataformas de agregación suele ofrecer ahorros adicionales frente a cuentas directas.

Inicio rápido: Migración de la API de Sora-2 a alternativas

Árbol de decisión para la ruta de migración

La migración de la API de Sora-2 a una alternativa se puede desglosar en 4 pasos:

- Inventario de llamadas actuales a Sora-2: Identifique todas las rutas de código que llaman a

sora-2o a la API de Videos, listando plantillas de indicación, parámetros de entrada y lógica de procesamiento de salida. - Selección del modelo objetivo: Determine el modelo principal basándose en las recomendaciones de selección por escenario.

- Reemplazo de base_url y nombre del modelo: Sustituya la

base_urlde OpenAI por la de la plataforma de agregación (ej.https://api.apiyi.com/v1) y actualice el nombre del modelo aseedance-2.0owan-2.7. - Pruebas de regresión: Ejecute el flujo completo con un conjunto de indicaciones representativas, comparando la calidad y latencia de las nuevas salidas frente a las antiguas.

Integración unificada mediante plataforma de agregación

from openai import OpenAI

# Usando APIYI para gestionar la migración

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

video_a = generate_video("Publicidad de producto: altavoz inteligente reproduciendo música", prefer="seedance")

video_b = generate_video("Intro de marca: logo emergiendo de destellos de luz", prefer="wan")

La ventaja de este enfoque es utilizar un SDK, una clave API y una base_url para invocar ambos modelos. Una vez que Sora-2 cierre el 24 de septiembre, solo tendrá que cambiar model="sora-2" por model="seedance-2.0" o model="wan-2.7" sin tocar el resto del código.

Lista de verificación de migración

| Fase | Tarea | Tiempo estimado |

|---|---|---|

| Inventario | Listar todos los puntos de entrada de Sora-2 | 0.5 días |

| Inventario | Organizar 50-100 indicaciones representativas | 1 día |

| Integración | Solicitar cuenta y cuotas en la plataforma de agregación | 0.5 días |

| Integración | Modificar campos base_url y model | 1 día |

| Pruebas | Ejecutar conjunto de pruebas de regresión | 2-3 días |

| Pruebas | Evaluación ciega de calidad por producto/diseño | 1 semana |

| Despliegue | Cambiar 10%-30% del tráfico | 1 semana |

| Despliegue | Cambiar al 100% del tráfico | — |

| Cierre | Eliminar código de llamada a Sora-2 | 0.5 días |

Siguiendo este ritmo, puede completar la migración en 4-6 semanas, dejando al menos 2 meses de ventana operativa estable antes de la fecha límite del 24 de septiembre.

🎯 Consejo de migración: No espere hasta septiembre para empezar. Abra una cuenta en la plataforma de agregación ahora, clone su código actual de Sora-2 y cambie la

base_urlahttps://api.apiyi.com/v1. Esto le permitirá realizar experimentos comparativos en paralelo con datos de negocio reales.

Control de costos durante la migración

El costo por generación de video es significativamente mayor que el de los modelos de texto. Si no se optimiza, la factura de la API podría duplicarse. Considere estas estrategias:

- Estrategia de degradación: En fase de prueba, use videos de 720p / 5 segundos; una vez confirmado el resultado, pase a 1080p / 15 segundos.

- Reutilización de caché: Implemente caché de hash de contenido para solicitudes con la misma indicación y parámetros.

- Facturación agregada: Evite mínimos de consumo al centralizar el gasto en una plataforma de agregación.

- Generación por lotes: Aproveche el modo batch de los fabricantes para generar durante la noche y obtener descuentos del 30%-50%.

- Optimización de indicaciones: Una indicación más precisa reduce el número de regeneraciones, ahorrando entre un 20% y un 40% en costos.

Problemas comunes y soluciones

| Problema | Causa | Solución |

|---|---|---|

| Relación de aspecto inconsistente | Diferentes valores predeterminados | Especifique explícitamente el parámetro aspect_ratio |

| Diferencia en límites de duración | Facturación por segundos | Especifique la duration según sea necesario |

| Audio ausente | Interfaces de audio distintas | Active explícitamente audio=True |

| Deriva de estilo en la indicación | Preferencias distintas por modelo | Optimice la indicación para cada modelo individualmente |

| Diferencias en mecanismos de callback | Algunos soportan solo polling | Use el webhook de la plataforma de agregación |

Preguntas frecuentes sobre el cierre de la API de Sora-2

P1: Tras el cierre de la API de Sora-2, ¿seguirán funcionando los vídeos ya generados?

Sí. Los archivos de vídeo, una vez descargados localmente o en un OSS, no se ven afectados por el cierre de la API. Sin embargo, si anteriormente referenciaba directamente los video_url devueltos por OpenAI, estos enlaces dejarán de funcionar tras el cierre. Es imperativo que transfiera todos los vídeos a su propio almacenamiento de objetos antes del 24 de septiembre. Si el volumen de transferencia es grande, puede utilizar la capacidad de proxy de vídeo de la plataforma APIYI (apiyi.com), la cual gestiona automáticamente la limitación de concurrencia y los reintentos en caso de error.

P2: ¿Lanzará OpenAI una API de Sora-3 en el futuro?

OpenAI no ha proporcionado un calendario para Sora-3. Desde una perspectiva estratégica, OpenAI está priorizando actualmente sus recursos de cómputo en la línea principal de GPT y en los servicios de agentes; la posibilidad de reiniciar una API de generación de vídeo a corto plazo es baja. Los análisis de Wikipedia y Futurum Group también señalan que la falta de resultados comerciales esperados de Sora es la razón principal de este cierre. Le sugerimos no basar su planificación de negocio en la idea de que "quizás Sora-3 regrese" y asegurarse de completar la migración a SeeDance 2.0 o Wan 2.7.

P3: ¿Se pueden invocar SeeDance 2.0 y Wan 2.7 de forma estable en China continental?

Sí. Ambos modelos son operados por ByteDance y Alibaba respectivamente, con nodos de servicio dentro del país, por lo que la estabilidad de la red es muy superior a las llamadas transfronterizas a OpenAI. Si anteriormente necesitaba usar un proxy o servidores extranjeros para Sora-2, al migrar a estos modelos podrá simplificar su arquitectura de red. Al realizar la invocación directamente a través de plataformas de agregación nacionales que cumplen con la normativa, podrá resolver simultáneamente los problemas de estabilidad y de facturación legal.

P4: ¿Tiene aún valor la ingeniería inversa de la API de Sora como transición final?

No se recomienda. La estabilidad de la API mediante ingeniería inversa ha disminuido drásticamente desde el primer trimestre de 2026 y, tras la desaparición de la fuente oficial en septiembre, las interfaces invertidas dejarán de funcionar por completo. Seguir invirtiendo en soluciones de ingeniería inversa equivale a añadir código nuevo sobre una pila tecnológica que se sabe obsoleta, lo que solo aumentará los costes de migración. La opción más económica es migrar directamente a SeeDance 2.0 o Wan 2.7.

P5: ¿Cómo evaluar la eficacia real de las alternativas durante la migración?

Recomendamos establecer una evaluación tridimensional: calidad visual (puntuación subjetiva), cumplimiento de la indicación (comparación objetiva) y coste por unidad (cálculo financiero). El método concreto consiste en extraer 50 indicaciones representativas de las invocaciones históricas de Sora-2, ejecutarlas de nuevo en SeeDance 2.0 y Wan 2.7, y realizar una evaluación a ciegas por parte del equipo de producto. Recomendamos realizar pruebas comparativas a través de una plataforma de agregación, con facturación y registros unificados, para tomar rápidamente la decisión más adecuada para su negocio.

P6: ¿Cambiarán las especificaciones de la interfaz API al migrar a una plataforma de agregación?

Las plataformas de agregación suelen adaptarse al protocolo compatible con OpenAI, lo que significa que su marco de código original para invocar Sora-2 puede mantenerse prácticamente intacto; solo necesitará modificar los campos base_url y model. Los parámetros de solicitud relacionados con la generación de vídeo (indicación, duración, audio, resolución, etc.) varían ligeramente entre modelos, pero la plataforma de agregación realizará la alineación de parámetros. Puede consultar la documentación de la plataforma para conocer las diferencias específicas.

P7: ¿Debo migrar inmediatamente o esperar hasta septiembre?

Recomendamos encarecidamente comenzar las pruebas de inmediato y completar la migración antes de finales de junio. Hay tres razones:

- Cuanto más cerca estemos del 24 de septiembre, más usuarios de Sora-2 estarán saturando la ventana de migración, y los recursos de las plataformas de agregación y modelos alternativos serán más escasos.

- Una migración temprana permite comparar exhaustivamente ambas alternativas, evitando cambios de última hora.

- Los desarrolladores que migran pronto suelen obtener mejores cuotas de prueba y condiciones de precios.

P8: ¿Cuál de los dos, SeeDance 2.0 o Wan 2.7, es más amigable con las indicaciones en chino?

Ambos son significativamente superiores a Sora-2 en cuanto a comprensión del chino. SeeDance 2.0 es más sutil en la expresión de emociones y descripciones de acciones en chino, mientras que Wan 2.7, al admitir indicaciones largas de hasta 5000 caracteres y el "Modo de Pensamiento" (Thinking Mode), es más estable en escenarios narrativos complejos. Si sus indicaciones suelen ser de menos de 200 caracteres, elija SeeDance 2.0; si necesita describir planos complejos con frecuencia, elija Wan 2.7.

P9: ¿Cómo garantizar que no haya interrupciones en el servicio durante la migración?

La forma más segura es la escritura y lectura dual: durante el periodo de transición, invoque tanto a Sora-2 como al modelo objetivo, guarde ambas salidas y gestione el flujo en el front-end mediante A/B testing. De este modo, si el modelo objetivo presenta problemas, podrá volver inmediatamente a Sora-2 (antes del 24 de septiembre), minimizando el riesgo. Las plataformas de agregación suelen admitir el enrutamiento dinámico basado en el campo model, lo que hace que el coste de implementar la escritura y lectura dual sea muy bajo.

Conclusión: El mejor camino tras el cierre de la API de Sora-2

OpenAI ha fijado la fecha de cierre de la API de Sora-2 para el 24 de septiembre de 2026, dejando menos de medio año para todos los negocios de generación de vídeo. La ingeniería inversa de la API, que alguna vez fue una "solución de transición barata", ha perdido su valor bajo la doble presión del endurecimiento del control de riesgos y el cierre oficial. Seguir invirtiendo en ella solo hará que los costes de migración se acumulen aún más.

Afortunadamente, el sector de la generación de vídeo en 2026 ha formado un panorama multipolar muy saludable: SeeDance 2.0 se ha convertido en el techo de calidad con una puntuación de 1269 en el Elo de Artificial Analysis, destacando en entradas multimodales y generación conjunta nativa de audio y vídeo; por su parte, Wan 2.7 ha establecido una ventaja diferenciada única con su "Modo de Pensamiento" y control de fotogramas inicial y final, ideal para escenarios que requieren un control preciso de la imagen. Ambas soluciones superan significativamente a la inminente Sora-2 en soporte de chino, cumplimiento normativo nacional y estabilidad de invocación.

Nuestra recomendación es: no ponga todos los huevos en la misma cesta. Acceda a SeeDance 2.0 y Wan 2.7 simultáneamente a través de la plataforma APIYI (apiyi.com) y realice el enrutamiento dinámico según la solicitud de negocio específica: el contenido que prioriza la calidad debe ir por SeeDance 2.0, y las imágenes que requieren un control preciso deben ir por Wan 2.7. Esta arquitectura de doble modelo no solo garantiza la estabilidad durante el periodo de migración, sino que también permite integrar sin problemas el negocio original de Sora-2 después de septiembre.

Lo más importante: empiece ahora. Esperar a agosto o septiembre para iniciar la migración hará que la adaptación del modelo, el ajuste de las indicaciones y la solicitud de cuotas sean mucho más difíciles que ahora. Le sugerimos iniciar las pruebas de concepto (PoC) esta misma semana, clonar el código de invocación actual de Sora-2 para realizar pruebas en paralelo y utilizar datos de negocio reales para impulsar la decisión final, asegurándose de que, para cuando llegue el cierre del 24 de septiembre, ya lleve al menos 2 meses operando con una solución alternativa estable.

Autor: Equipo de APIYI — Especialistas en servicios de proxy de API para modelos de lenguaje grandes y agregación de modelos de generación de vídeo.