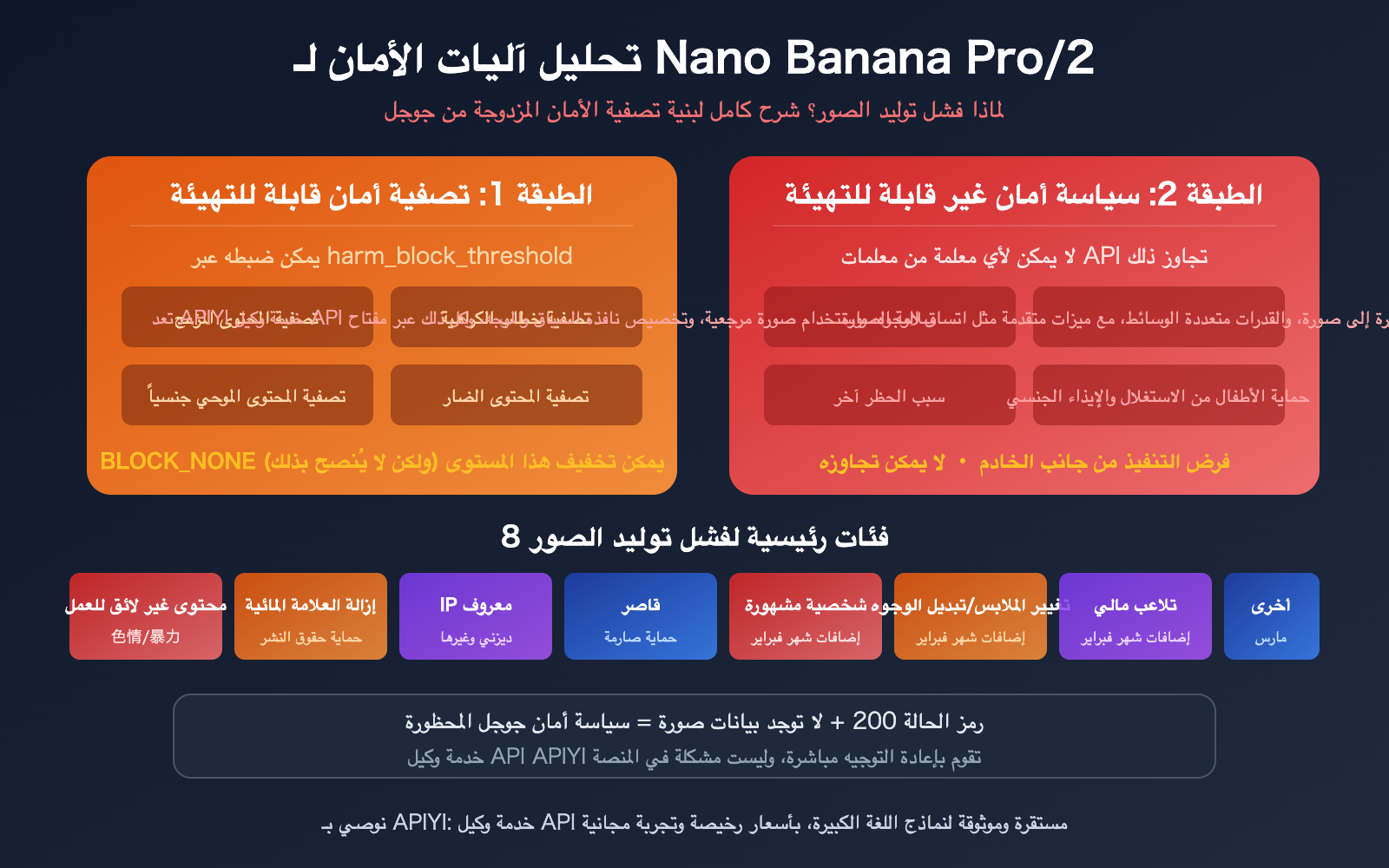

ملاحظة من المؤلف: هل واجهت فشلاً في توليد الصور باستخدام Nano Banana Pro/2؟ يحلل هذا المقال فئات الرفض الثماني في بنية التصفية الأمنية مزدوجة الطبقات من جوجل: مثل المحتوى غير اللائق (NSFW)، إزالة العلامات المائية، الشخصيات المعروفة، القاصرين، وغيرها. كما يتضمن طرق تحديد الأخطاء وحلولاً برمجية للمنتجات الموجهة للمستخدم النهائي (C-end).

عند استخدام Nano Banana Pro أو Nano Banana 2 لاستدعاء واجهة برمجة تطبيقات (API) توليد الصور، قد تواجه موقفاً حيث يعود رمز الحالة 200، ولكن بدون بيانات صورة، أو تتلقى رداً نصياً يقول "I'm unable to assist with that". هذه ليست مشكلة في منصة وكيل API، بل هي نتيجة لتفعيل سياسات أمان المحتوى الخاصة بجوجل.

منذ 23 يناير 2026، شددت جوجل بشكل ملحوظ سياسات الأمان الخاصة بتوليد الصور؛ وبعد إطلاق Nano Banana 2 في 27 فبراير، تمت ترقية آليات الأمان بشكل أكبر، حيث تمت إضافة حظر للمحتويات المتعلقة بـ الشخصيات المعروفة، تزوير المعلومات المالية، تغيير الملابس/الوجوه، والإيحاءات الجنسية الضمنية. يقدم هذا المقال تحليلاً كاملاً لجميع أسباب فشل توليد الصور والحلول المقترحة.

القيمة الجوهرية: بعد قراءة هذا المقال، ستفهم الآلية الأساسية لفشل توليد الصور في Nano Banana Pro/2، وستتقن طرق تحديد فئات الفشل الثماني، وستتعلم كيفية التعامل مع هذه الأخطاء بذكاء في منتجاتك الموجهة للمستخدم النهائي.

Nano Banana Pro/2: طرق تحديد أسباب فشل توليد الصور

عندما تتلقى رسالة خطأ مثل Error: Gemini did not return edited image data أو ما يشابهها، كيف يمكنك تحديد سبب الفشل؟ توفر جوجل 3 مؤشرات رئيسية، مرتبة حسب الأولوية:

| الأولوية | مؤشر التحديد | سمة الفشل | الشرح |

|---|---|---|---|

| الأعلى | candidatesTokenCount |

يساوي 0 | رفض مباشر، لم يتم توليد أي محتوى |

| الثانية | finishReason |

IMAGE_SAFETY / PROHIBITED_CONTENT / OTHER | تم حظره أثناء عملية التوليد |

| مهم | استجابة نصية من API | إرجاع نص بدلاً من صورة، عدد الرموز (Token) < 1000 | النموذج "يشرح" نصياً سبب الرفض |

مظهران نموذجيان لفشل توليد الصور في Nano Banana Pro/2

المظهر الأول: candidatesTokenCount = 0

في استجابة API، تكون قيمة usageMetadata.candidatesTokenCount هي 0، مما يعني أن النموذج رفض توليد الصورة مباشرة. في هذه الحالة، عادة ما يكون finishReason هو IMAGE_SAFETY أو PROHIBITED_CONTENT، وتكون قيمة content.parts في جسم الاستجابة هي null.

المظهر الثاني: إرجاع نص بدلاً من صورة

في استجابة API، تكون قيمة candidatesTokenCount لا تساوي 0 ولكنها أقل من 1000، حيث يعيد النموذج نصاً بدلاً من بيانات الصورة. الردود الشائعة تشمل:

- "I'm unable to assist with that request"

- "أنا غير قادر على المساعدة في هذا الطلب"

- "I cannot modify images of real people"

القاسم المشترك بين هاتين الحالتين هو: رمز الحالة هو 200. وهذا يعني أن الطلب نفسه صحيح، وأن APIYI كوكيل شفاف قام بإعادة توجيه استجابة جوجل مباشرة، والمشكلة تكمن في سياسات أمان المحتوى الخاصة بجوجل.

🎯 نصيحة للمطورين: إذا كنت تطور منتجاً موجهاً للمستخدم النهائي (C-end)، يجب عليك اكتشاف سمات الفشل هذه في الكود البرمجي، وتحويل الأخطاء التقنية إلى رسائل ودية للمستخدم. توفر APIYI دليلاً كاملاً لمعالجة الأخطاء:

xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

فئات الأمان الثمانية لفشل توليد الصور في Nano Banana Pro/2

يوضح الجدول التالي بالتفصيل فئات فشل توليد الصور الثمانية وخصائصها:

| الفئة | المحتوى المثير | معرف الخطأ | تاريخ الإضافة | إمكانية التجنب |

|---|---|---|---|---|

| 1. NSFW | إباحي، عنيف، دموي | IMAGE_SAFETY | أصلي | لا يمكن |

| 2. إزالة العلامة المائية | إزالة علامة حقوق النشر | MALFORMED_FUNCTION_CALL | أصلي | لا يمكن |

| 3. ملكية فكرية معروفة | ديزني، مارفل، إلخ | IMAGE_SAFETY | تعزيز في يناير | لا يمكن |

| 4. القاصرين | محتوى حساس يتعلق بالأطفال | حماية CSAM | أصلي | لا يمكن (تسامح صفر) |

| 5. شخصيات معروفة | صور مشاهير، سياسيين | رفض نصي | 27 فبراير | لا يمكن |

| 6. تغيير الملابس/الوجه | تعديل ملابس أو ملامح الشخصية | blockReason OTHER | 27 فبراير | لا يمكن |

| 7. التلاعب المالي | تعديل بيانات الطلبات/الفواتير | blockReason OTHER | 27 فبراير | لا يمكن |

| 8. تلميحات ضمنية | محتوى غير صريح ولكن تلميحي | IMAGE_SAFETY | 27 فبراير | يمكن تعديل الموجه جزئياً |

ملاحظات خاصة حول سياسة أمان Nano Banana Pro/2

حظر إزالة العلامة المائية: هذه فئة خاصة. عندما يطلب المستخدم إزالة العلامة المائية من صورة، لن تعيد جوجل خطأ IMAGE_SAFETY التقليدي، بل ستعيد MALFORMED_FUNCTION_CALL—وهذا في جوهره تدخل استباقي من سياسة أمان محتوى جوجل، وليس خطأً تقنياً (Bug). تم تصميم هذا لحماية مصالح أصحاب حقوق النشر.

نمط الأنمي أكثر عرضة للحظر: قد يتم قبول نفس الموجه في نمط واقعي، ولكن يتم حظره في نمط الأنمي، والسبب هو أن نمط الأنمي يسهل تفعيل آليات الكشف عن حقوق الملكية الفكرية.

جوجل تعترف بالرقابة المفرطة: صرحت جوجل رسمياً بأن فلاتر أمان توليد الصور "أصبحت أكثر حذراً بكثير مما كنا نقصد"، حتى أن الموجهات غير الضارة تماماً مثل "كلب" أو "وعاء من الحبوب" قد تؤدي إلى حظر.

🎯 توضيح شفاف: تعمل APIYI كوكيل شفاف، حيث تقوم بإعادة توجيه استجابة جوجل مباشرة. إذا كان رمز الحالة 200 وفشل توليد الصورة، فهذا بالفعل رد فعل من جانب جوجل. بالطبع، تأمل APIYI أن ينجح العملاء في توليد الصور، لكن سياسات الأمان تخضع لتحكم جوجل، ولا يمكن للمنصة التدخل فيها.

خطة معالجة أخطاء فشل توليد الصور في Nano Banana Pro/2

بالنسبة للمطورين الذين يبنون منتجات موجهة للمستخدم النهائي (C-end)، يعد التعامل الصحيح مع فشل توليد الصور أمراً بالغ الأهمية. فيما يلي سير العمل الموصى به:

أولويات كشف الأخطاء في Nano Banana Pro/2

def check_generation_result(response):

"""

الكشف عما إذا كان توليد الصورة في Nano Banana Pro/2 ناجحاً

الأولوية: candidatesTokenCount > finishReason > استجابة نصية

"""

usage = response.get("usageMetadata", {})

candidates = response.get("candidates", [{}])

candidate = candidates[0] if candidates else {}

# الأولوية القصوى: candidatesTokenCount = 0

if usage.get("candidatesTokenCount", 0) == 0:

return {"success": False, "reason": "content_rejected"}

# الأولوية الثانية: فحص finishReason

finish_reason = candidate.get("finishReason", "")

if finish_reason in ["IMAGE_SAFETY", "PROHIBITED_CONTENT"]:

return {"success": False, "reason": "safety_filter"}

# هام: التحقق مما إذا كان قد تم إرجاع نص بدلاً من صورة

parts = candidate.get("content", {}).get("parts", [])

has_image = any("inlineData" in p for p in (parts or []))

if not has_image and usage.get("candidatesTokenCount", 0) < 1000:

return {"success": False, "reason": "text_response"}

return {"success": True}

قالب رسائل الخطأ الصديقة للمستخدم في Nano Banana Pro/2

| نوع الخطأ | نص الرسالة المقترح | الإجراء المقترح |

|---|---|---|

| محتوى غير متوافق | «المحتوى الحالي لا يتوافق مع معايير الأمان، يرجى تعديل الوصف والمحاولة مجدداً» | تعديل الموجه |

| وظيفة غير مدعومة | «هذا النوع من عمليات تعديل الصور غير مدعوم حالياً» | تجربة عملية أخرى |

| محتوى خارج النطاق | «الوصف الحالي يتضمن محتوى محمياً، يرجى استخدام وصف أصلي» | تجنب المحتوى المحمي |

| مشكلة تقنية | «واجهنا مشكلة مؤقتة في التوليد، يرجى المحاولة لاحقاً» | الانتظار وإعادة المحاولة |

عرض مثال كامل لكود معالجة الأخطاء للمستخدم النهائي

# تعيين رسائل الخطأ

ERROR_MESSAGES = {

"content_rejected": {

"title": "المحتوى لم يجتز فحص الأمان",

"message": "المحتوى الحالي لا يتوافق مع معايير الأمان، يرجى تعديل الوصف والمحاولة مجدداً",

"suggestion": "نصيحة: تجنب الشخصيات الشهيرة، الشخصيات المحمية بحقوق الطبع، والمحتوى الحساس"

},

"safety_filter": {

"title": "تم تفعيل فلتر الأمان",

"message": "تم حظر توليد الصورة بواسطة سياسات الأمان",

"suggestion": "نصيحة: حاول تعديل الموجه واستخدام وصف أكثر عمومية"

},

"text_response": {

"title": "فشل التوليد",

"message": "تعذر على الذكاء الاصطناعي توليد الصورة المطلوبة",

"suggestion": "نصيحة: بسّط الوصف أو غيّر الموضوع وحاول مجدداً"

},

"watermark": {

"title": "الوظيفة غير مدعومة حالياً",

"message": "إزالة العلامة المائية غير مدعومة حالياً",

"suggestion": "نصيحة: استخدم وظائف تحرير الصور الأخرى"

}

}

🎯 أفضل الممارسات: لا تعرض أبداً "خطأ غير معروف" للمستخدم النهائي. حتى عند مواجهة خطأ غير مصنف، قدم دائماً رسالة بديلة ودودة. للحصول على دليل معالجة الأخطاء الكامل، راجع وثائق APIYI:

xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

الجدول الزمني لسياسات الأمان في Nano Banana Pro/2 وتوصيات التعامل

استراتيجيات المطورين للتعامل مع فشل توليد الصور في Nano Banana Pro/2

الاستراتيجية الأولى: تحسين الموجه

- تجنب استخدام أسماء المشاهير أو أسماء الشخصيات المحمية بحقوق الطبع مباشرة.

- استخدم أوصافاً عامة بدلاً من الملكيات الفكرية المحددة (مثل "محارب يرتدي درعاً" بدلاً من "آيرون مان").

- الأسلوب الواقعي أقل عرضة لاكتشاف حقوق الطبع مقارنة بأسلوب الأنمي.

- تجنب طلبات تعديل الصور التي تتضمن تبديل الوجوه أو تغيير الملابس.

الاستراتيجية الثانية: تحسين معالجة الأخطاء

- تحقق من الأخطاء حسب الأولوية:

candidatesTokenCount←finishReason← استجابة نصية. - جهز رسائل ودية للمستخدم لكل نوع من أنواع الأخطاء.

- احتفظ ببيانات الاستجابة الأصلية لأغراض التصحيح.

- لا تعرض أبداً "خطأ غير معروف" للمستخدم.

الاستراتيجية الثالثة: ضمان التكلفة

- استخدم خطة تعويض فشل التوليد (SLA) من APIYI (apiyi.com).

- يتم تعويض الرصيد عن عمليات التوليد الفاشلة، ويمكن للمستخدمين الذين يستهلكون أكثر من 1000 دولار شهرياً المشاركة.

- ضمان استرداد تكاليف الطلبات الفاشلة.

🎯 لمطوري المنتجات الموجهة للمستخدم النهائي: نوصي بشدة بقراءة دليل معالجة الأخطاء الكامل من APIYI على الرابط:

xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf، والذي يتضمن أمثلة برمجية كاملة، ومنطق التعرف الذكي على الكلمات المفتاحية، وحلول العرض الأمامية، وحالات الاختبار.

الأسئلة الشائعة

س1: لماذا ينجح الموجه نفسه في توليد الصور أحياناً ويفشل أحياناً أخرى؟

توجد عوامل احتمالية في مرشحات الأمان الخاصة بجوجل. قد يؤدي الموجه نفسه إلى نتائج مختلفة في أوقات مختلفة أو باستخدام مفاتيح API مختلفة. يرجع ذلك إلى أن نموذج الأمان بحد ذاته يحتوي على درجة من العشوائية، خاصة عند التعامل مع "المحتوى الحدي". إذا فشل الموجه بشكل متكرر، ننصح بتعديل طريقة الوصف.

س2: هل مشكلة “رمز الحالة 200 ولكن بدون صورة” تعود إلى APIYI؟

لا. تعمل APIYI كوكيل شفاف يقوم بإعادة توجيه استجابات جوجل مباشرة. رمز الحالة 200 يعني أن الطلب نفسه صحيح، ولكن سياسة أمان المحتوى لدى جوجل هي التي منعت توليد الصورة. يمكنك التحقق من finishReason و candidatesTokenCount في الاستجابة لمعرفة السبب الدقيق. بالطبع، تسعى APIYI دائماً لضمان نجاح عملائها في توليد الصور.

س3: هل يتم خصم الرصيد في حال فشل توليد الصورة؟

نعم، تقوم جوجل بخصم الحصة. ولكن أطلقت APIYI (apiyi.com) خطة تعويض عن فشل توليد الصور (SLA)؛ حيث يمكن للمستخدمين الذين يستهلكون أكثر من 1000 دولار شهرياً طلب تعويض عن تكاليف الطلبات الفاشلة (عدد الطلبات الفاشلة × 0.05 دولار / معامل الخصم). هذه هي المنصة الوحيدة في السوق حالياً التي توفر هذا النوع من الضمانات.

الخلاصة

النقاط الجوهرية لفشل توليد الصور في Nano Banana Pro/2:

- بنية أمان مزدوجة الطبقات: الطبقة الأولى (Layer 1) يمكن تعديلها عبر معاملات API، بينما الطبقة الثانية (IMAGE_SAFETY، سبب الحظر OTHER، إلخ) يتم فرضها قسراً من جانب خادم جوجل ولا يمكن تجاوزها.

- فئات الرفض الثماني: NSFW، إزالة العلامات المائية، الملكية الفكرية المعروفة، القاصرون (4 فئات أصلية) + الشخصيات المعروفة، تبديل الملابس والوجوه، التلاعب المالي، التلميحات الضمنية (4 فئات مضافة في Nano Banana 2).

- آلية الوكيل الشفاف: تقوم APIYI بإعادة توجيه استجابة جوجل مباشرة، لذا فإن رمز الحالة 200 مع عدم وجود صورة يعني أن سياسة أمان جوجل هي التي قامت بالحظر، وليست مشكلة في المنصة.

تستمر سياسات الأمان لدى جوجل في التشديد خلال عام 2026، حيث شهدت ثلاث ترقيات متتالية من 23 يناير إلى مارس. بالنسبة لمطوري تطبيقات المستخدم النهائي (C-end)، فإن تحسين معالجة الأخطاء وتنبيهات المستخدم يعد أولوية قصوى.

نوصي بالوصول إلى Nano Banana Pro/2 عبر APIYI (apiyi.com) بسعر 0.05 دولار/مرة + ضمان تعويض SLA عند فشل التوليد، مما يتيح لك استخدام أقوى نموذج لتوليد الصور بأقل تكلفة فعلية ممكنة.

📚 المراجع

-

دليل معالجة الأخطاء في APIYI: أفضل الممارسات لمعالجة أخطاء Gemini 3 Pro Image Preview API

- الرابط:

xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf - الوصف: سير عمل كامل لتحديد الأخطاء، أمثلة برمجية، ونماذج نصوص التنبيه للمستخدم النهائي.

- الرابط:

-

وثائق إعدادات أمان Google AI: شرح رسمي لإعدادات تصفية الأمان

- الرابط:

ai.google.dev/gemini-api/docs/safety-settings - الوصف: المعلمات والخيارات المتاحة لتصفية الأمان في الطبقة الأولى (Layer 1).

- الرابط:

-

وثائق واجهة برمجة تطبيقات المحتوى التوليدي من Google: شرح رسمي لرموز الأخطاء

- الرابط:

ai.google.dev/api/generate-content - الوصف: تعريفات كاملة للحقول مثل

finishReasonوblockReason.

- الرابط:

-

وثائق تصفية الأمان في Google Cloud: إعدادات الأمان في Vertex AI

- الرابط:

docs.google.com/vertex-ai/generative-ai/docs/multimodal/configure-safety-filters - الوصف: شرح للبنية متعددة الطبقات لتصفية الأمان على مستوى المؤسسات.

- الرابط:

المؤلف: الفريق التقني لـ APIYI

تبادل الخبرات: نرحب بمشاركتكم لحالات فشل توليد الصور باستخدام Nano Banana Pro/2 في قسم التعليقات. للمزيد من المعلومات، يمكنكم زيارة مركز توثيق APIYI عبر الرابط: docs.apiyi.com