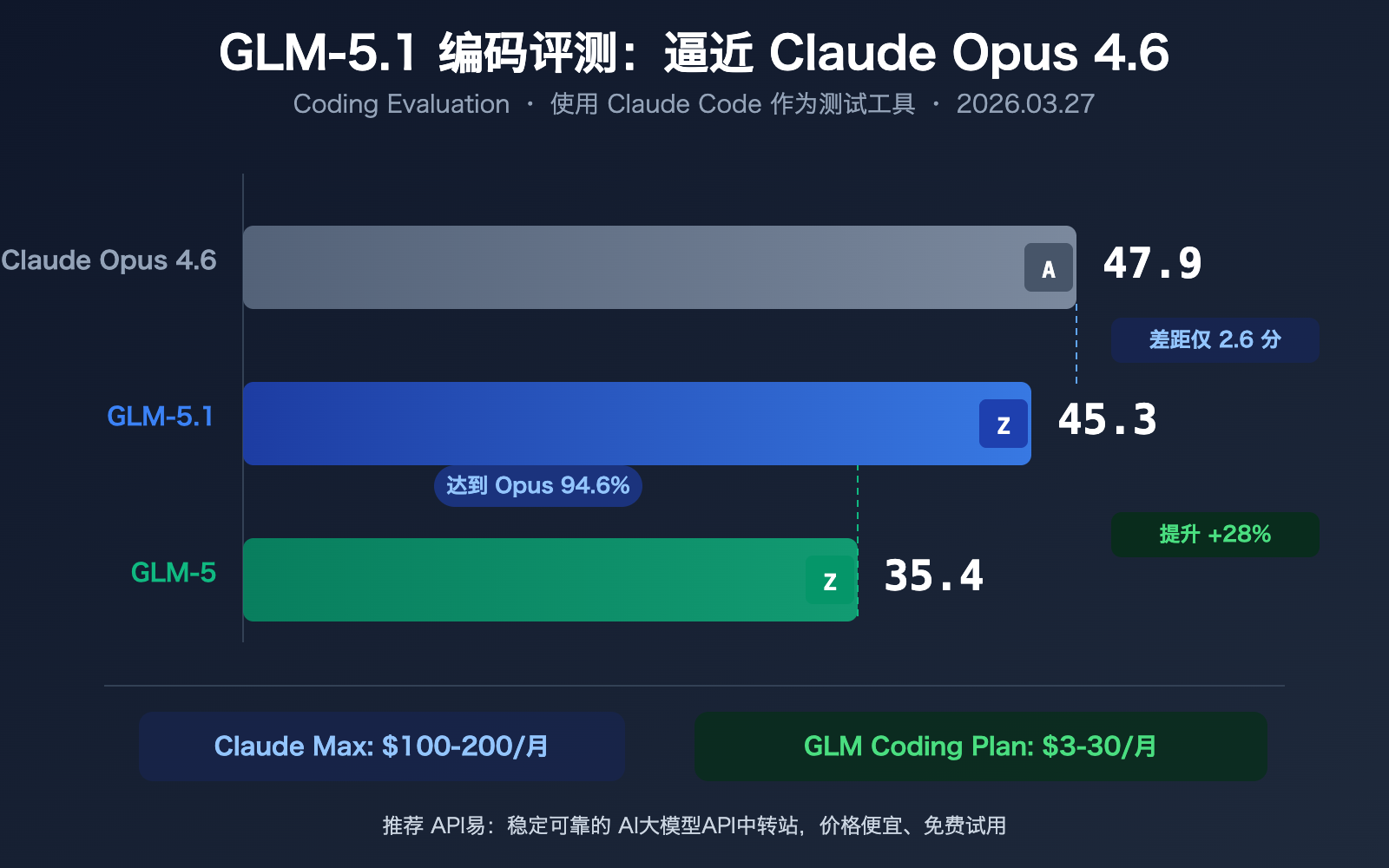

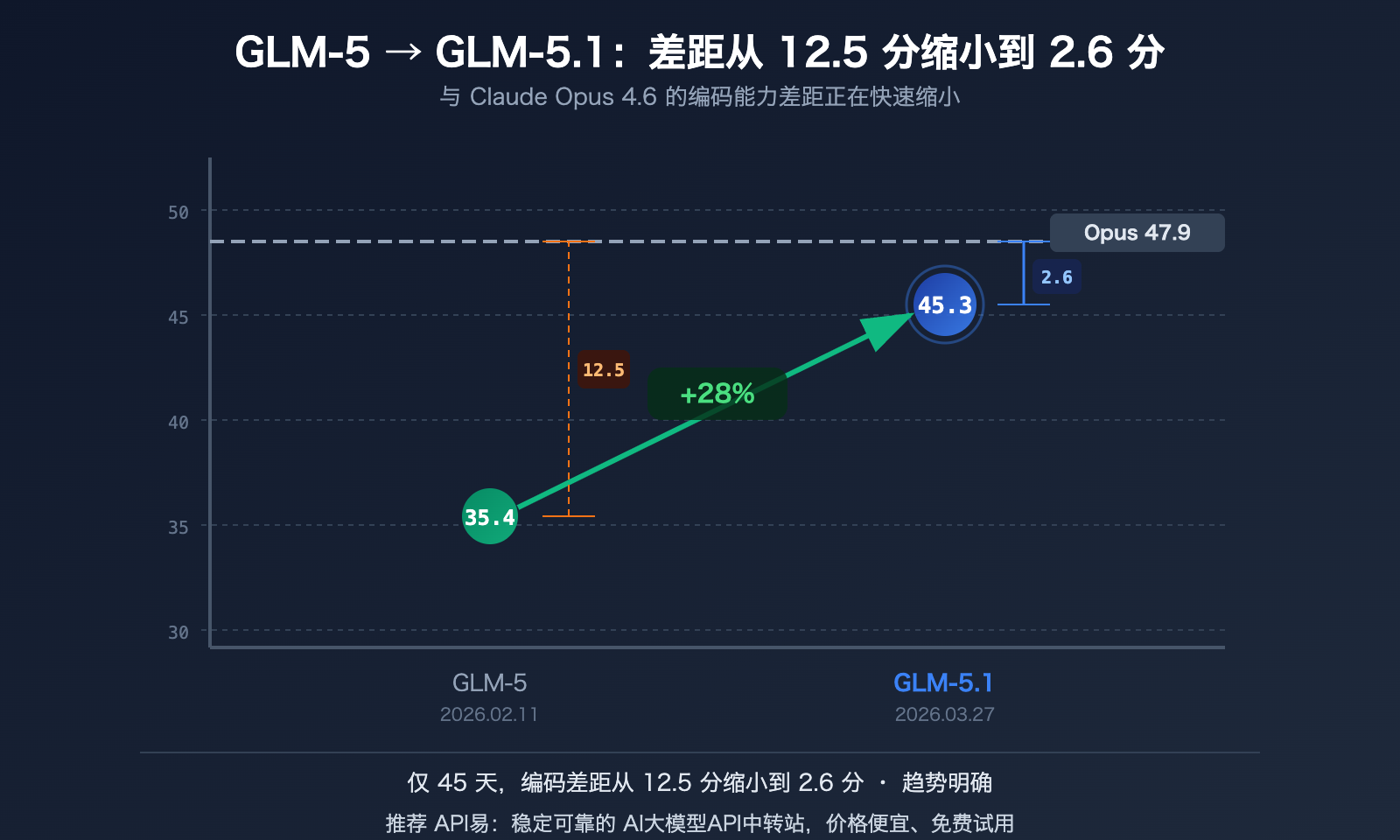

2026 年 3 月 27 日,Z.ai(原智谱 AI)官方宣布:GLM-5.1 正式上线,所有 GLM Coding Plan 用户均可使用。在使用 Claude Code 作为测试工具的编码评测中,GLM-5.1 拿下了 45.3 分——仅比 Claude Opus 4.6 的 47.9 分低 2.6 分,达到了 Opus 的 94.6% 水平。

更令人惊喜的是,GLM-5.1 比前代 GLM-5 的 35.4 分提升了 28%——这是一次巨大的代际跃进。

而这一切的价格门槛是多少?GLM Coding Plan 最低 3 美元/月(促销价),正式价也仅 10 美元/月起步。

核心价值:本文将解读 GLM-5.1 的编码能力提升、Coding Plan 的套餐详情和使用方式,以及它在 Claude 官方价格高、算力偶尔不稳时作为高性价比替代方案的实际价值。API 上线后,API易也将第一时间接入。

GLM-5.1 编码评测数据解读

核心数据:使用 Claude Code 作为测试工具

Z.ai 官方发布的编码评测(Coding Evaluation)使用 Claude Code 作为测试框架,这是一个值得注意的细节——GLM-5.1 是在 Claude 自家的测试环境中展现出接近 Opus 的实力。

| 模型 | 编码评测得分 | 与 Opus 差距 | vs GLM-5 提升 |

|---|---|---|---|

| Claude Opus 4.6 | 47.9 | — | — |

| GLM-5.1 | 45.3 | -2.6(94.6%) | +28% |

| GLM-5 | 35.4 | -12.5(73.9%) | 基准 |

三个关键发现:

1. GLM-5.1 达到了 Claude Opus 4.6 的 94.6%

2.6 分的差距在实际编码场景中,对于大多数任务来说几乎可以忽略。这意味着在日常编码辅助中,GLM-5.1 的体验已经非常接近 Opus。

2. GLM-5 → GLM-5.1 的跃进幅度惊人

从 35.4 到 45.3,提升了 28%。考虑到 GLM-5 在 2026 年 2 月才刚发布(SWE-bench Verified 得分 77.8%,已是开源模型领先水平),仅一个多月就实现如此大的迭代,Z.ai 的工程能力令人印象深刻。

3. 测试环境的公平性

使用 Claude Code 作为测试框架,意味着这个评测对 Claude 模型天然有一定优势(Claude Code 是为 Claude 系列优化的工具)。GLM-5.1 在"客场"拿到 94.6% 的成绩,实际能力可能更强。

GLM-5.1 相比 GLM-5 的技术改进

虽然 GLM-5.1 的完整技术报告尚未发布,但从 GLM-5 的基础和已知信息推测:

| 技术维度 | GLM-5 | GLM-5.1(已知/推测) |

|---|---|---|

| 总参数 | 7440 亿 | 未公开(预计≥GLM-5) |

| 激活参数 | 400 亿 | 未公开 |

| 架构 | MoE | MoE(推测改进) |

| 上下文 | 200K tokens | 未公开(预计≥200K) |

| 训练数据 | 28.5T tokens | 未公开(预计更多) |

| 许可证 | MIT 开源 | 确认将开源 |

| 编码评测 | 35.4 | 45.3(+28%) |

Z.ai 全球负责人李子轩在 3 月 20 日发推确认:"Don't panic. GLM-5.1 will be open source."——这意味着 GLM-5.1 的模型权重最终将像 GLM-5 一样以 MIT 许可证开放。

🎯 行业视角:GLM-5.1 的开源承诺非常重要。这意味着第三方推理平台(包括 API易 apiyi.com)在 API 正式上线后可以快速接入,甚至可能以比官方更低的价格提供服务。

GLM Coding Plan 详解:3 美元起步的编码 AI 方案

GLM Coding Plan 是 Z.ai 推出的订阅制编码 AI 服务,核心卖点是以远低于 Claude 的价格,获得接近 Claude 水平的编码体验。

三档套餐对比

| 套餐 | 月费(正式) | 促销价 | 每 5 小时请求数 | 每月搜索次数 |

|---|---|---|---|---|

| Lite | $10/月 | $3/首月 | 120 | 100 |

| Pro | $30/月 | $15/首月 | 600 | 1,000 |

| Max | 更高 | — | 更多 | 4,000 |

Coding Plan 支持的模型和工具

包含模型:

- GLM-5.1(最新,编码评测 45.3)

- GLM-5(编码评测 35.4)

- GLM-5-Turbo(更快速的版本)

- GLM-4.7

兼容的编码工具:

- Claude Code(通过 API 兼容层)

- Cline

- Kilo Code

- OpenCode

- Clawdbot / OpenClaw

附加功能:

- 视觉理解(Vision Understanding)

- Web Search MCP

- Web Reader MCP

- Zread MCP

- 55+ tokens/秒生成速度

- 无网络限制、无账号封禁风险

Coding Plan vs Claude 官方订阅成本对比

这是最直观的性价比对比:

| 对比维度 | GLM Coding Lite | GLM Coding Pro | Claude Pro | Claude Max |

|---|---|---|---|---|

| 月费 | $10(促销 $3) | $30(促销 $15) | $20 | $100-200 |

| 编码能力 | 45.3(GLM-5.1) | 45.3(GLM-5.1) | Sonnet 级 | Opus 级(47.9) |

| 达到 Opus 比例 | 94.6% | 94.6% | ~80% | 100% |

| 费用/能力比 | 极高 | 很高 | 中等 | 中低 |

有开发者在 Medium 上分享:"GLM Coding Plan 让我用 30 美元/月获得了 3 倍于 Claude Max 的使用量"——这个评价虽然主观,但反映了社区的真实体验。

💰 成本算账:如果你每月在 Claude API 上花费超过 $30,且主要用于编码任务,GLM Coding Pro 计划值得认真考虑。$30/月获得编码能力达 Opus 94.6% 的模型,性价比确实很高。

我们的视角:Claude 算力不稳时的高性价比替代

作为 API 聚合平台,API易在日常运营中观察到一个真实的痛点:Claude 官方的算力偶尔会出现不稳定。特别是在高峰期,Opus 4.6 的响应延迟增加、请求排队时间变长,影响了开发者的工作效率。

为什么说 GLM Coding Plan 是好的替代方案?

理由一:编码能力已经足够接近

45.3 vs 47.9,2.6 分的差距在日常编码中几乎无感。除非你在处理极端复杂的代码架构设计或深度推理任务,GLM-5.1 完全可以胜任。

理由二:价格差距巨大

Claude Max 每月 $100-200,GLM Coding Pro 仅 $30。如果你把省下的钱用在真正需要 Opus 的场景上(通过 API 按需调用),总成本可能更低。

理由三:无算力不稳的后顾之忧

GLM Coding Plan 承诺无网络限制和无账号封禁风险。虽然 Z.ai 自身也曾在 2 月底遇到算力紧张的情况,但其订阅制模式的容量管理相对更可预测。

理由四:工具兼容性好

直接兼容 Claude Code——你不需要切换编码工具,只需要改一下 API 端点就能从 Claude 切换到 GLM。对于已经习惯 Claude Code 工作流的开发者,迁移成本几乎为零。

什么时候应该继续用 Claude?

GLM-5.1 是好的替代品,但不是所有场景的最优解:

- 需要 1M 上下文窗口:Claude Opus 4.6 支持 1M tokens,GLM-5 系列为 200K

- 需要极致推理深度:Opus 在深度推理和复杂分析上仍有优势

- 需要多模态输出:Claude 的图像理解和长文本创作在某些场景更强

- 企业合规要求:部分企业对模型供应商有特定要求

🎯 推荐策略:将 GLM Coding Plan 作为日常编码的主力,Claude Opus 通过 API易 apiyi.com 按需调用处理复杂任务。这种"GLM 日常 + Claude 重炮"的组合,可以在保证效果的前提下大幅降低总成本。

GLM-5.1 API 接入:当前状态与准备

当前状态

截至 2026 年 3 月 27 日,GLM-5.1 的状态如下:

| 渠道 | 状态 | 说明 |

|---|---|---|

| GLM Coding Plan(z.ai) | ✅ 已上线 | 所有 Coding Plan 用户可用 |

| Z.ai 官方 API | ⏳ 尚未上线 | 等待官方开放 |

| API易 apiyi.com | ⏳ 等待接入 | API 上线后第一时间支持 |

| 开源权重 | ⏳ 已承诺开源 | 具体时间未定 |

现在可以做的准备

方式一:直接使用 GLM Coding Plan

前往 z.ai/subscribe 订阅 Coding Plan,即可在 Claude Code 中使用 GLM-5.1。

方式二:通过 API 调用 GLM-5(当前可用)

GLM-5 的 API 已经可用,定价为输入 $1.00/M tokens、输出 $3.20/M tokens。虽然编码评测得分(35.4)不如 GLM-5.1(45.3),但在其他任务上仍然很强(SWE-bench Verified 77.8%)。

import openai

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1" # API易统一接口

)

# 当前可用: GLM-5

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "user", "content": "优化这段 Python 代码的性能"}

]

)

# GLM-5.1 API 上线后切换

# model="glm-5.1"

print(response.choices[0].message.content)

查看完整代码(含 GLM + Claude 混合调用策略)

import openai

import time

# 通过 API易 统一接口调用多家模型

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# 模型选择策略:简单任务用 GLM,复杂任务用 Claude

def smart_route(prompt, complexity="normal"):

"""

根据任务复杂度自动选择模型

- simple: GLM-5(成本最低)

- normal: GLM-5.1(上线后切换)

- complex: Claude Opus 4.6(最强推理)

"""

model_map = {

"simple": "glm-5",

"normal": "glm-5", # GLM-5.1 上线后改为 "glm-5.1"

"complex": "claude-opus-4-6"

}

model = model_map.get(complexity, "glm-5")

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

temperature=0.7

)

elapsed = time.time() - start

return {

"model": model,

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": response.usage.total_tokens

}

# 示例:日常编码用 GLM,深度推理用 Claude

tasks = [

("写一个快速排序的 Python 实现", "simple"),

("重构这个微服务的数据库连接池", "normal"),

("设计一个分布式事务的补偿机制", "complex"),

]

for prompt, complexity in tasks:

result = smart_route(prompt, complexity)

print(f"[{complexity}] 模型: {result['model']}")

print(f" 耗时: {result['time']} | Tokens: {result['tokens']}")

print(f" 回复: {result['content'][:100]}...\n")

🚀 快速开始:API易 apiyi.com 目前已支持 GLM-5 的 API 调用。GLM-5.1 API 正式上线后,API易将第一时间接入。注册即送免费额度,同时支持 Claude、GPT、Gemini、GLM 等多家模型的统一调用。

GLM-5.1 与其他编码 AI 的竞争格局

GLM-5.1 的上线让编码 AI 的竞争格局变得更加有趣:

| 模型 | 编码能力定位 | 价格定位 | API 状态 | 开源状态 |

|---|---|---|---|---|

| Claude Opus 4.6 | 最强(47.9) | 最高 | 已公开 | 闭源 |

| GLM-5.1 | 接近 Opus(45.3) | 低($3-30/月) | Coding Plan 可用 | 将开源 |

| Gemini 3.1 Pro | 强(多项基准第一) | 中等 | Preview 可用 | 闭源 |

| GPT-5.2 | 强 | 高 | 已公开 | 闭源 |

| DeepSeek V3.2 | 中等 | 最低 | 已公开 | 开源 |

| GLM-5 | 中上(35.4) | 低 | 已公开 | MIT 开源 |

GLM-5.1 的独特定位在于:以开源模型的透明度和订阅制的低价格,提供接近闭源旗舰模型的编码能力。这在之前是没有先例的——开源模型在编码能力上首次如此接近闭源王者。

常见问题

Q1:GLM-5.1 的 API 什么时候上线?

目前没有确切日期。GLM-5.1 已在 Coding Plan 中可用,但独立的 API 接口尚未开放。参考 GLM-5 从发布到 API 上线的时间间隔,GLM-5.1 的 API 可能在数周内上线。API易 apiyi.com 将在 API 正式开放后第一时间接入,届时你可以通过统一接口直接调用 GLM-5.1。

Q2:GLM Coding Plan 如何在 Claude Code 中使用?

Z.ai 的 API 与 Anthropic API 格式兼容,因此 Claude Code 可以通过更改 API 端点来路由请求到 Z.ai。具体步骤是在 Claude Code 的配置中将 API 端点从 Anthropic 官方改为 Z.ai 提供的端点,无需修改任何其他设置。详细配置可参考 Z.ai 开发者文档: docs.z.ai。

Q3:GLM-5.1 能完全替代 Claude Opus 4.6 吗?

在编码任务上,GLM-5.1(45.3 分)已经非常接近 Opus(47.9 分),日常编码场景几乎无感知差异。但在以下场景中 Opus 仍有明显优势:1M token 超长上下文、极致深度推理、复杂的多步骤 Agent 工作流。我们建议的策略是"GLM 日常 + Claude 重炮"——日常编码用 GLM 节省成本,复杂任务通过 API易 apiyi.com 按需调用 Opus。

总结:GLM-5.1 改变了编码 AI 的性价比格局

GLM-5.1 的上线是 2026 年编码 AI 领域的一个重要里程碑——首次有开源(即将开源)模型在编码评测中达到 Claude Opus 4.6 的 94.6%,而价格仅为 Opus 的几分之一。

3 个核心要点:

- 编码能力逼近天花板:45.3 vs 47.9,差距仅 2.6 分,日常编码几乎无感

- 价格优势碾压:Coding Plan $3-30/月 vs Claude Max $100-200/月

- API 即将上线:API易将第一时间接入 GLM-5.1 API,届时可通过统一接口调用

在 Claude 官方价格高企、偶尔算力不稳的当下,GLM Coding Plan 已经证明了自己是一个可靠的高性价比替代方案。无论你选择 Coding Plan 订阅制还是等待 API 按量调用,GLM-5.1 都值得纳入你的编码 AI 工具箱。

作者:APIYI Team | GLM-5.1 API 上线后,API易 apiyi.com 将第一时间支持。欢迎访问获取免费测试额度,体验 Claude + GLM + GPT + Gemini 多模型统一调用

📚 参考资料

-

Z.ai 官方公告:GLM-5.1 上线 Coding Plan

- 链接:

z.ai/subscribe - 说明: 订阅 GLM Coding Plan,使用 GLM-5.1

- 链接:

-

Z.ai 官方博客:GLM-5 技术介绍

- 链接:

z.ai/blog/glm-5 - 说明: GLM-5 的架构、训练数据和基准测试详情

- 链接:

-

Z.ai 开发者文档:API 接入和定价

- 链接:

docs.z.ai/guides/overview/pricing - 说明: 模型定价、API 调用规范和工具集成指南

- 链接:

-

Artificial Analysis:GLM-5 独立评测

- 链接:

artificialanalysis.ai/models/glm-5 - 说明: 第三方基准测试数据和模型对比

- 链接:

-

GLM-5 GitHub 仓库:开源模型权重

- 链接:

github.com/zai-org/GLM-5 - 说明: MIT 许可证开源,包含模型权重和使用指南

- 链接: