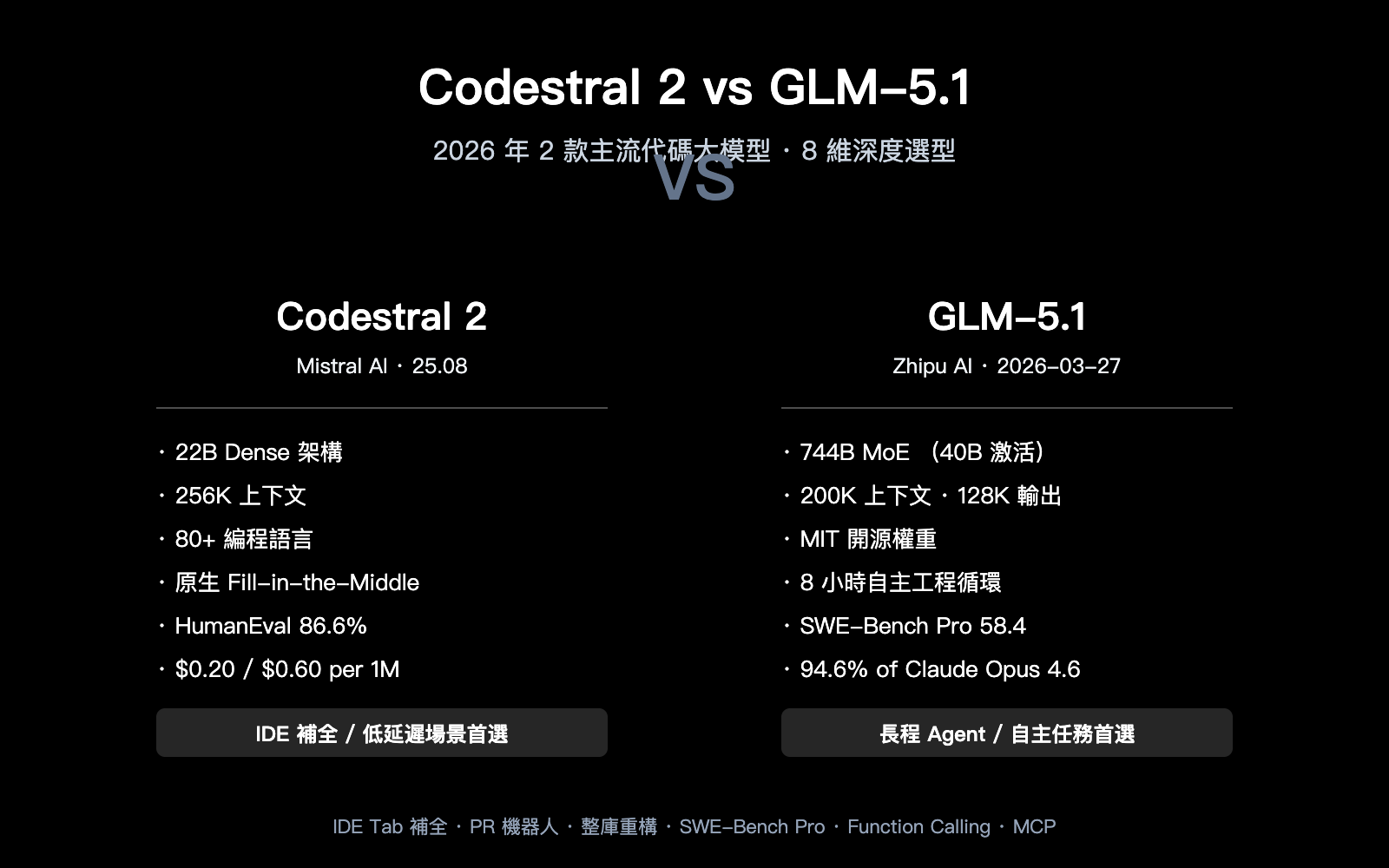

2026 年的代碼大模型賽道正在被兩類完全不同的產品形態切割:一類是以 Mistral Codestral 2(當前最新版本 Codestral 25.08) 爲代表的"IDE 優先、高頻補全型"選手,專注於 Fill-in-the-Middle (FIM)、高通過率補全和跨 80+ 語言的即時響應;另一類則是以 Zhipu GLM-5.1 爲代表的"長程代理型"選手,依靠 744B 參數 MoE 架構和 200K 上下文,主打"8 小時自主工程任務"的 SWE-Bench Pro 級複雜代碼能力。

這兩種路線面向的用戶羣和計費策略幾乎沒有交集,但又經常在"哪個更適合寫代碼"這個問題上被放到一起評估。本文基於 Mistral AI 官方公告(2025-07-30 Codestral 25.08)和 Z.ai 開發者文檔(GLM-5.1,2026-03-27 發佈)等英文一手資料,從架構、基準、上下文、長程任務、部署與價格 6 個維度給出一份可複製的選型決策表,並附上兩款模型的 API 接入對比代碼,幫你在 10 分鐘內做出判斷。

Codestral 2 與 GLM-5.1 的核心定位差異

在深入跑分之前,必須先弄清一件事:兩款模型並不屬於同一類產品。把它們放在一個維度上橫向比較,會得出非常有誤導性的結論。

一句話定位

- Codestral 2(25.08):面向代碼補全與編輯任務的專用代碼模型。22B 稠密架構、原生 FIM 訓練目標、強調"秒級響應 + 高接受率",是 IDE Copilot 類產品的事實標準之一。

- GLM-5.1:面向通用 Agent 與長程編程任務的通用旗艦模型。744B MoE(每 token 激活約 40B)、200K 上下文,在 SWE-Bench Pro 上以 58.4 分超過 GPT-5.4、Claude Opus 4.6 和 Gemini 3.1 Pro。

選型前必須回答的三個問題

| 問題 | 偏向 Codestral 2 | 偏向 GLM-5.1 |

|---|---|---|

| 主要使用場景是 IDE 內補全還是自主改 PR? | IDE 補全 | 多步自主任務 |

| 每次請求的 token 量是幾十還是幾萬? | 幾十~幾千 | 幾千~十幾萬 |

| 用戶在等待時間上能否容忍幾十秒? | 不能 | 可以 |

🎯 選型建議:如果 80% 的調用來自"寫一行代碼的下一步補全",就選 Codestral 2;如果 80% 的調用來自"幫我修復這個 repo 中的 bug",就選 GLM-5.1。兩者都可通過 API易 apiyi.com 的統一接口並行測試,不需要分別接入 Mistral 和 Z.ai。

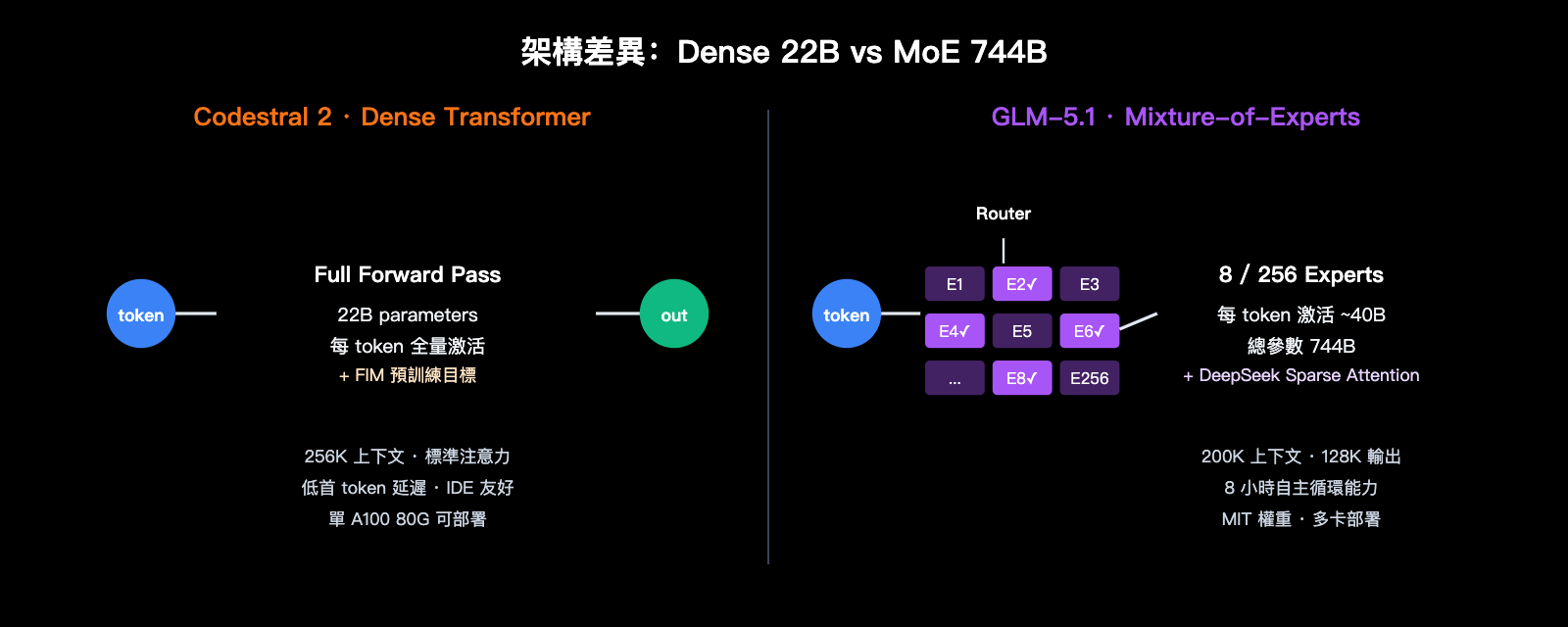

Codestral 2 和 GLM-5.1 的架構與參數對比

架構差異是後續所有性能表現的根源。

關鍵規格一覽

| 項目 | Codestral 2 (25.08) | GLM-5.1 |

|---|---|---|

| 廠商 | Mistral AI | Zhipu AI (Z.ai) |

| 架構 | Dense Transformer | Mixture-of-Experts |

| 總參數 | 22B | 744B |

| 激活參數 | 22B | 約 40B(256 experts,每 token 8 激活) |

| 上下文窗口 | 256K | 200K |

| 最大輸出 | 標準 | 128K tokens |

| 注意力機制 | 標準 + FIM 優化 | DeepSeek Sparse Attention |

| License | Mistral 商用許可 / MNPL | MIT(開源權重) |

| 發佈時間 | 2025-07-30(最新迭代) | 2026-03-27 |

| 代碼語言覆蓋 | 80+ 主流語言 | 通用多語言 |

架構差異帶來的直接影響

- 顯存與部署成本:Codestral 2 的 22B 單機(A100 80G)即可推理;GLM-5.1 需要多卡並行或託管推理服務。

- 單 token 延遲:Codestral 2 的 Dense 架構在短輸入下延遲更穩定;GLM-5.1 受路由器選擇和稀疏注意力影響,首 token 稍慢但長序列上有優勢。

- 開源策略:GLM-5.1 以 MIT 開源釋放權重,對私有部署和二次訓練更友好;Codestral 2 雖可本地運行但商用需許可。

🎯 部署建議:需要完全私有化部署的團隊優先考慮 GLM-5.1 的 MIT 權重;只想快速接入而不考慮自託管的團隊可通過 API易 apiyi.com 直接調用兩款模型 API,省去採購與授權溝通。

Codestral 2 vs GLM-5.1 核心代碼基準對比

兩款模型的跑分都來自廠商自測,且評測集並不完全重合。下面只列出有直接對照意義的指標。

Codestral 2 強項:補全質量 & IDE 指標

| 指標 | 數值 | 說明 |

|---|---|---|

| Accepted Completions(接受率) | +30%(相對 25.01) | 生產環境 IDE 採用率 |

| Retained Code(保留率) | +10% | 建議代碼在提交時未被刪除比例 |

| Runaway Generations(失控生成) | -50% | 超長無用續寫的下降 |

| IFEval v8(指令跟隨) | +5% | 指令準確度 |

| MultiPL-E 平均分 | +5% | 多語言代碼能力 |

| HumanEval(前代 25.01 數據) | 86.6% | 參考數據 |

| MBPP(前代 25.01 數據) | 91.2% | 參考數據 |

GLM-5.1 強項:複雜工程任務

| 指標 | 數值 | 說明 |

|---|---|---|

| SWE-Bench Pro | 58.4 | 超 GPT-5.4 / Claude Opus 4.6 / Gemini 3.1 Pro |

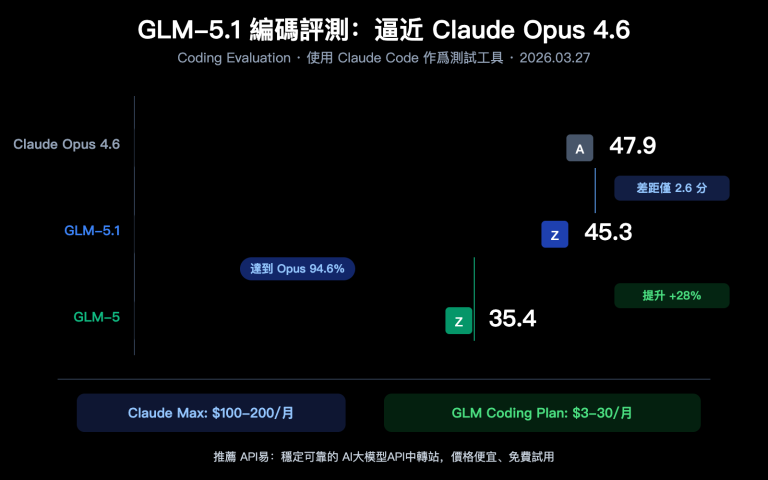

| Claude Code 對照 | 45.3(Opus 4.6 爲 47.9) | 達到 Opus 4.6 的 94.6% |

| vs GLM-5 基線 | +28% | 來自後訓練優化 |

| KernelBench Level 3 | 3.6x 加速 | ML kernel 優化場景 |

| 單任務持續時長 | 最長 8 小時 | 自主"實驗-分析-優化"循環 |

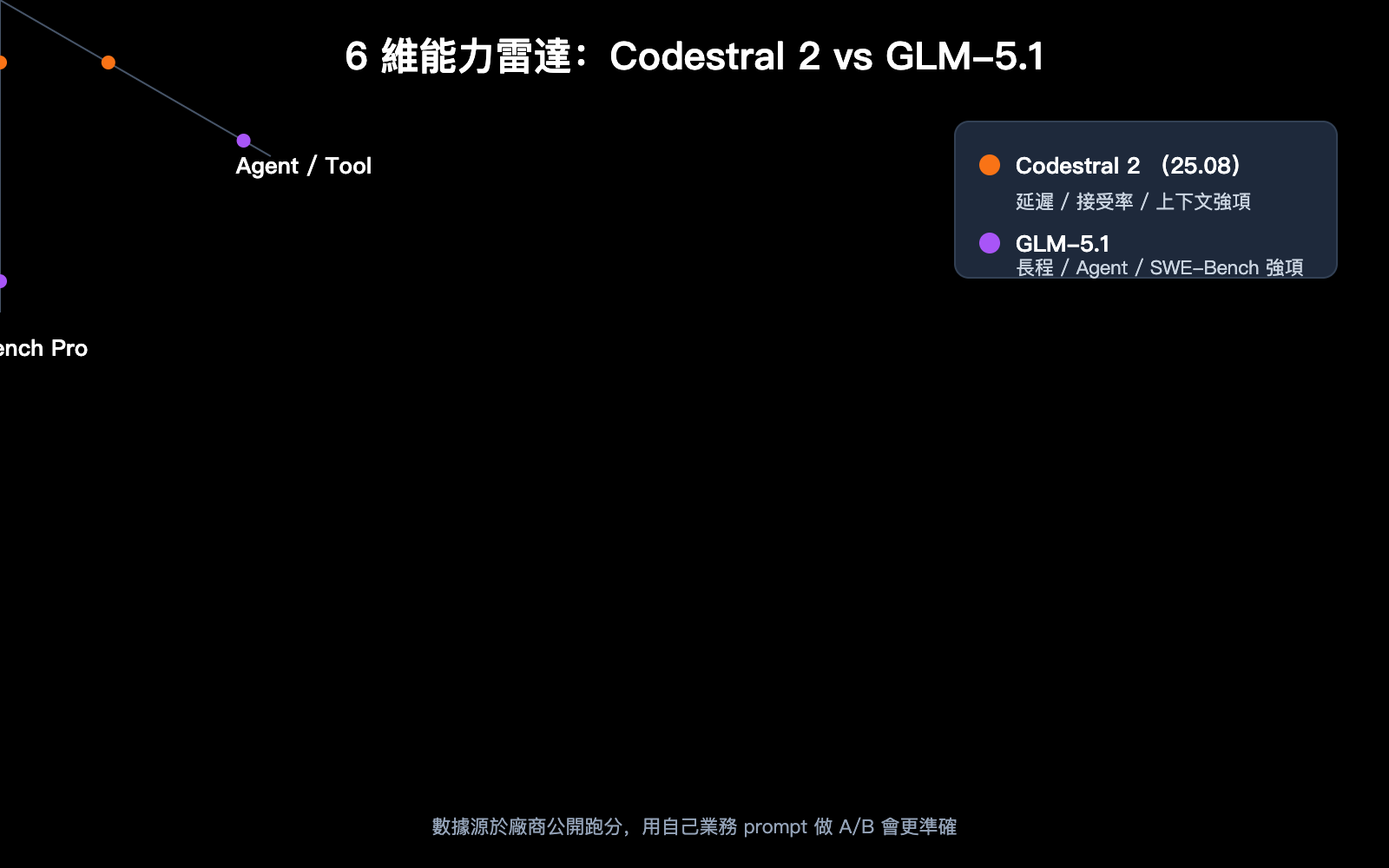

兩者能力重合度評估

| 能力 | Codestral 2 | GLM-5.1 |

|---|---|---|

| 單文件補全 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| 多文件重構 | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Bug 定位 + 修復 PR | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 跨語言翻譯 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Agent / Tool Use | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 首 token 延遲 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

🎯 跑分閱讀提示:官方數據通常來自相對最優的評測設置,實際業務表現可能有 10%~20% 浮動。建議用自己的代碼庫在 API易 apiyi.com 上跑一份 A/B 測試,再做最終決定。

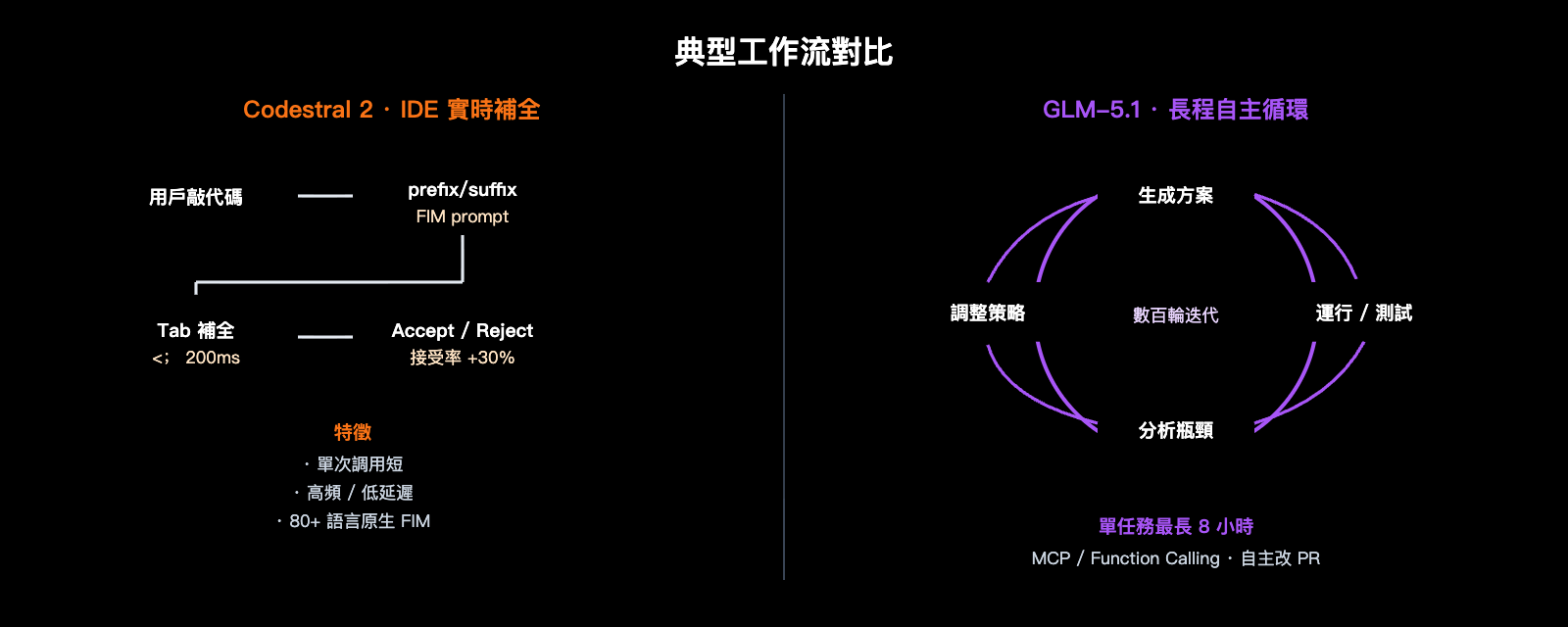

Codestral 2 與 GLM-5.1 的上下文與長程任務能力

256K vs 200K 的上下文窗口在數字上很接近,但承載的任務類型完全不同。

Codestral 2 的 256K 上下文:整倉補全

Codestral 2 將 256K 上下文主要用於**"把整個代碼庫塞進 prompt"**,以便補全時感知跨文件依賴:

- 適合:monorepo 內的大型函數補全、全項目 Lint Fix、跨模塊重命名。

- 不適合:需要多步推理、工具調用和結果回寫的 Agent 流程。

GLM-5.1 的 200K 上下文 + 8 小時自主循環

GLM-5.1 的突破不在"能裝多少上下文",而在"能持續工作多久":

- 官方演示中,模型可在單任務內迭代數百次:運行 benchmark → 識別瓶頸 → 調整策略 → 再跑 benchmark。

- DeepSeek Sparse Attention 讓 200K 長序列的推理成本保持在可用區間。

- 搭配 Function Calling / MCP,可直接對接外部工具鏈。

典型長程任務對照

| 任務 | Codestral 2 | GLM-5.1 |

|---|---|---|

| 補全一個 200 行函數 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| 從 GitHub Issue 生成 PR | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 在整個 repo 內找 bug 並修復 | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 多輪自動調優 ML kernel | ⭐ | ⭐⭐⭐⭐⭐ |

| 在 IDE 按 Tab 補全 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

🎯 場景遷移建議:原先用 Codestral 做整庫補全的團隊,如果遇到"補完了但跑不過測試"的場景,不妨用 GLM-5.1 接管"生成-運行-修復"閉環,通過 API易 apiyi.com 切換 base_url 即可複用同一套 OpenAI 兼容代碼。

快速上手:Codestral 2 和 GLM-5.1 的 API 接入對比

兩款模型都提供 OpenAI 兼容接口,實際差異主要在 model 名稱與參數。下方示例以 API易 apiyi.com 的統一 base_url 展示最小可用代碼。

Codestral 2 調用(代碼補全)

from openai import OpenAI

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_API_KEY",

)

resp = client.chat.completions.create(

model="codestral-latest", # 指向 Codestral 25.08

messages=[

{"role": "system", "content": "You are a senior Python engineer."},

{"role": "user", "content": "補全一個高性能 LRU 緩存實現。"},

],

temperature=0.2,

max_tokens=512,

)

print(resp.choices[0].message.content)

GLM-5.1 調用(長程任務)

from openai import OpenAI

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_API_KEY",

)

resp = client.chat.completions.create(

model="glm-5.1",

messages=[

{"role": "system", "content": "You are a SWE agent. Analyze repo, run tests, iterate."},

{"role": "user", "content": "修復 repo 中 tests/test_api.py 的全部失敗用例。"},

],

temperature=0.3,

max_tokens=8192,

# GLM-5.1 支持 Function Calling + 結構化輸出

)

print(resp.choices[0].message.content)

📎 展開查看 FIM 專用調用(Codestral 2 獨有)

# Codestral 原生 FIM 通過 prefix / suffix 拼裝 prompt

prefix = "def binary_search(arr, target):\n "

suffix = "\n return -1"

prompt = f"[PREFIX]{prefix}[SUFFIX]{suffix}[MIDDLE]"

# 將 prompt 作爲 user 內容發給 codestral-latest 即可獲得高精度補全

🎯 接入建議:兩款模型都遵循 OpenAI schema,只需切換 model 名稱即可複用同一套業務代碼。統一通過 API易 apiyi.com 調用可以省去分別維護 Mistral Console 與 Z.ai 賬號、餘額、限流策略的運維成本。

Codestral 2 與 GLM-5.1 的價格與部署策略

價格與部署靈活性往往是決策的最後一公里。

公開價格參考

| 模型 | 輸入單價 | 輸出單價 | 說明 |

|---|---|---|---|

| Codestral 2(25.08) | $0.20 / 1M | $0.60 / 1M | 沿用 Codestral 系列價格 |

| GLM-5.1 | 約 $3 起的 Coding Plan 套餐 | 套餐制 | 另提供按 token 計費選項 |

注:以上價格基於廠商官網和渠道公開信息,實際匯率與促銷以當日爲準。

部署選項對比

| 部署方式 | Codestral 2 | GLM-5.1 |

|---|---|---|

| 官方 Cloud API | ✅ Mistral Console | ✅ Z.ai 平臺 |

| 第三方兼容網關 | ✅(API易 apiyi.com 等) | ✅(API易 apiyi.com 等) |

| VPC / 私有云 | ✅ 需許可 | ✅ MIT 自由部署 |

| 本地單機推理 | ✅ 單 A100/消費級 GPU 受限 | ❌ 需多卡 |

| Function Calling | 支持(通過 chat completions) | ✅ 原生支持 + MCP |

🎯 成本優化建議:對補全頻次高、單次 token 少的 IDE 場景,優先用 Codestral 2 + 緩存;對低頻但單次 token 大的 Agent 場景,用 GLM-5.1 套餐制會更划算。兩套策略可以在 API易 apiyi.com 上按模型分組配置,避免總賬號被單一模型消耗殆盡。

Codestral 2 和 GLM-5.1 的場景推薦與避坑指南

四大典型場景決策

| 場景 | 推薦模型 | 關鍵原因 |

|---|---|---|

| VSCode / JetBrains 補全插件 | Codestral 2 | FIM 原生 + 低延遲 |

| 自動修 bug / PR 機器人 | GLM-5.1 | 長程自主循環 |

| 代碼評審助手(單文件評論) | Codestral 2 | 響應快、成本低 |

| 端到端 Agent(對接測試/部署) | GLM-5.1 | MCP + Function Calling |

| 生成 boilerplate 項目骨架 | 並列 | 任一模型均可 |

| ML kernel 性能調優 | GLM-5.1 | KernelBench 3.6x 加速 |

常見避坑清單

- ❌ 不要讓 Codestral 2 跑 Agent:失控生成率雖然降低 50%,但它不是爲多步決策而優化的。

- ❌ 不要讓 GLM-5.1 做毫秒級補全:首 token 延遲對 IDE Tab 鍵響應體驗不友好。

- ❌ 不要只看一個榜單:SWE-Bench Pro 上 GLM-5.1 贏,HumanEval 上 Codestral 系列並不落後。

- ✅ 做一次小樣本 A/B:用自己業務裏最典型的 100 條 prompt,用 API易 apiyi.com 切換 model 參數跑一遍對比。

常見問題 FAQ

Q1:爲什麼官方頁面叫 Codestral 25.08 而不是 Codestral 2?

Mistral 的命名習慣是 <系列>-<年份>.<月份>,Codestral 25.08 屬於 Codestral 的第 2 代迭代(第 1 代 24.05 發佈,第 2 代從 25.01 起演進至 25.08)。業內和社區習慣把 25.01+ 統稱"Codestral 2"。調用時指定 codestral-latest 即可命中當前第 2 代最新版本。

Q2:GLM-5.1 的 744B 參數會不會推理很慢?

MoE 架構下每 token 只激活 40B 參數,加上 DeepSeek Sparse Attention,實際推理速度接近 40B 級別稠密模型。配合 API易 apiyi.com 的長連接和緩存策略,長上下文場景的體感延遲在可接受範圍。

Q3:兩款模型的上下文誰更能喫滿?

Codestral 2 的 256K 更多是"容量",GLM-5.1 的 200K 加上稀疏注意力對"真實利用率"更友好。做整庫任務前建議先用 tiktoken 或官方分詞器估算實際 token 數,避免無效截斷。

Q4:開源權重對企業有什麼實際意義?

GLM-5.1 以 MIT 釋放權重,可在內網部署並二次訓練;Codestral 2 商用需許可協議。對合規要求嚴格的金融、政企客戶來說差別巨大。如果只是希望繞過地區訪問限制,API易 apiyi.com 也能提供穩定的國內可用入口。

Q5:能否兩個模型並用?

可以,也推薦。典型做法是 IDE 補全用 Codestral 2,後臺 Agent 用 GLM-5.1,兩者走不同 model key,統一從 API易 apiyi.com 計費。

Q6:跑分是廠商自測,可信度如何?

Codestral 和 GLM 的跑分均屬自報告,Z.ai 的 SWE-Bench Pro 58.4 分尚未有獨立復現。建議將公開跑分當作"能力上限參考",落地前務必做業務場景迴歸測試。

總結:Codestral 2 vs GLM-5.1 的最終選型建議

回到開頭的那三個問題:

- 如果你的產品是Copilot、Tab 補全、代碼片段生成,選 Codestral 2。它的 FIM、延遲、價格和 80+ 語言覆蓋面是這一類場景的最佳平衡點。

- 如果你的產品是PR 機器人、Bug 修復代理、8 小時跑任務的後臺 Agent,選 GLM-5.1。744B MoE + SWE-Bench Pro 58.4 + 長程自主循環,是目前開源陣營最接近 Claude Opus 4.6 的選項。

- 如果你的產品同時包含以上兩種場景,把二者並用是 2026 年的最經濟方案。

🎯 落地建議:把選型從"二選一"升級爲"雙模編排"。通過 API易 apiyi.com 的 OpenAI 兼容接口,只需在業務代碼中用一個字段區分"短補全 / 長任務",就能在 Codestral 2 與 GLM-5.1 之間自動路由,把每種請求都送到最適合它的模型上。

— APIYI Team(API易 apiyi.com 技術團隊)