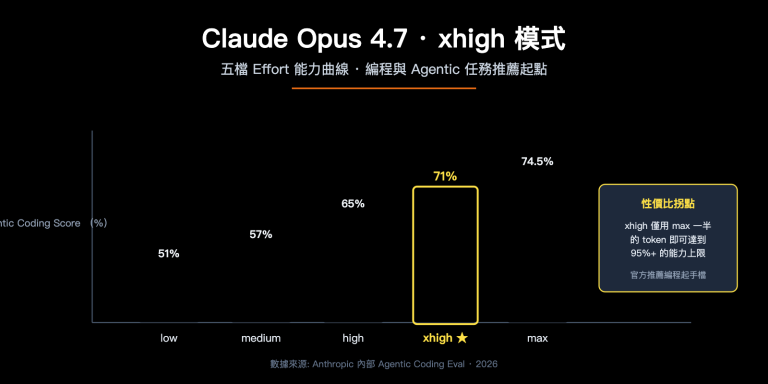

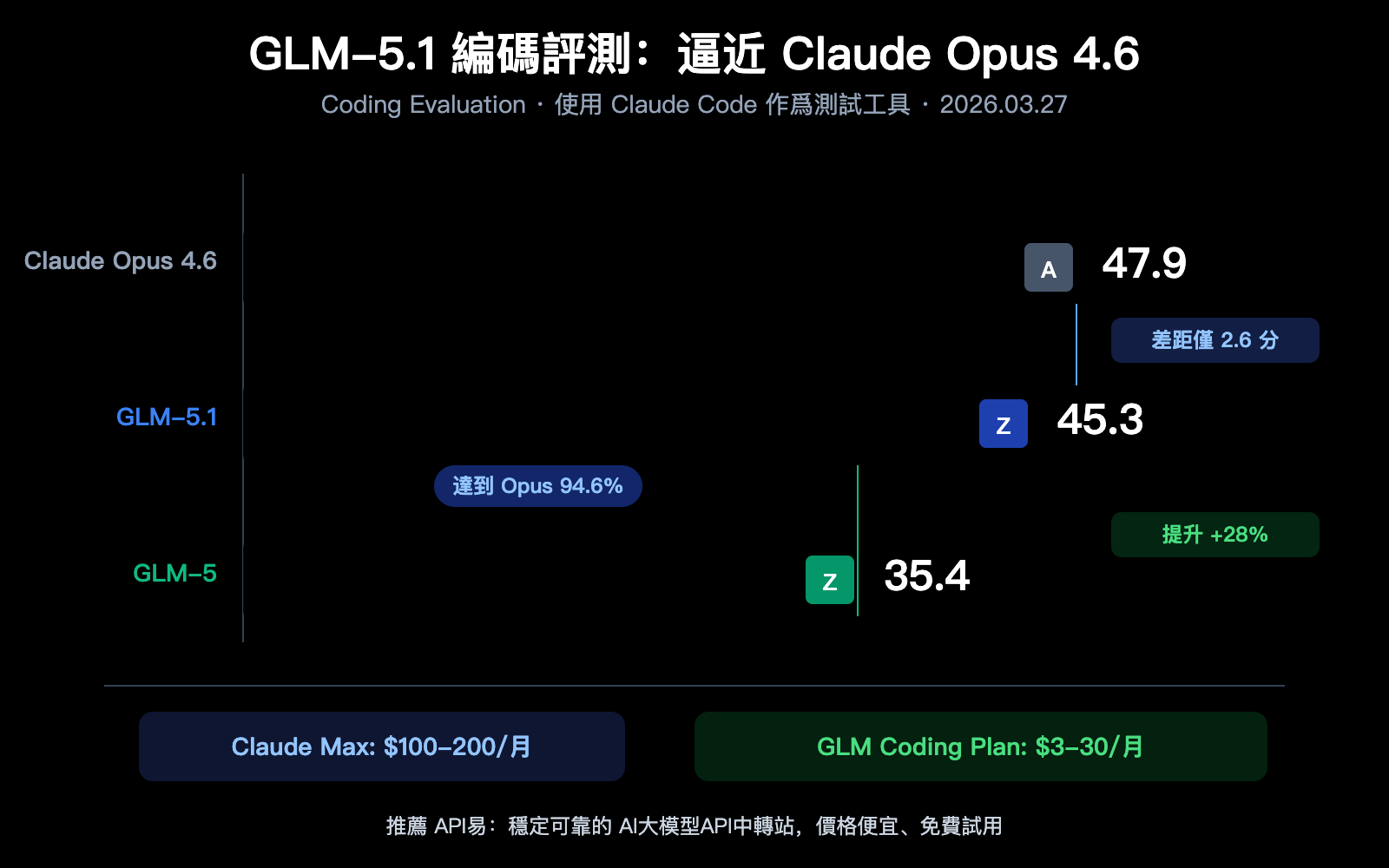

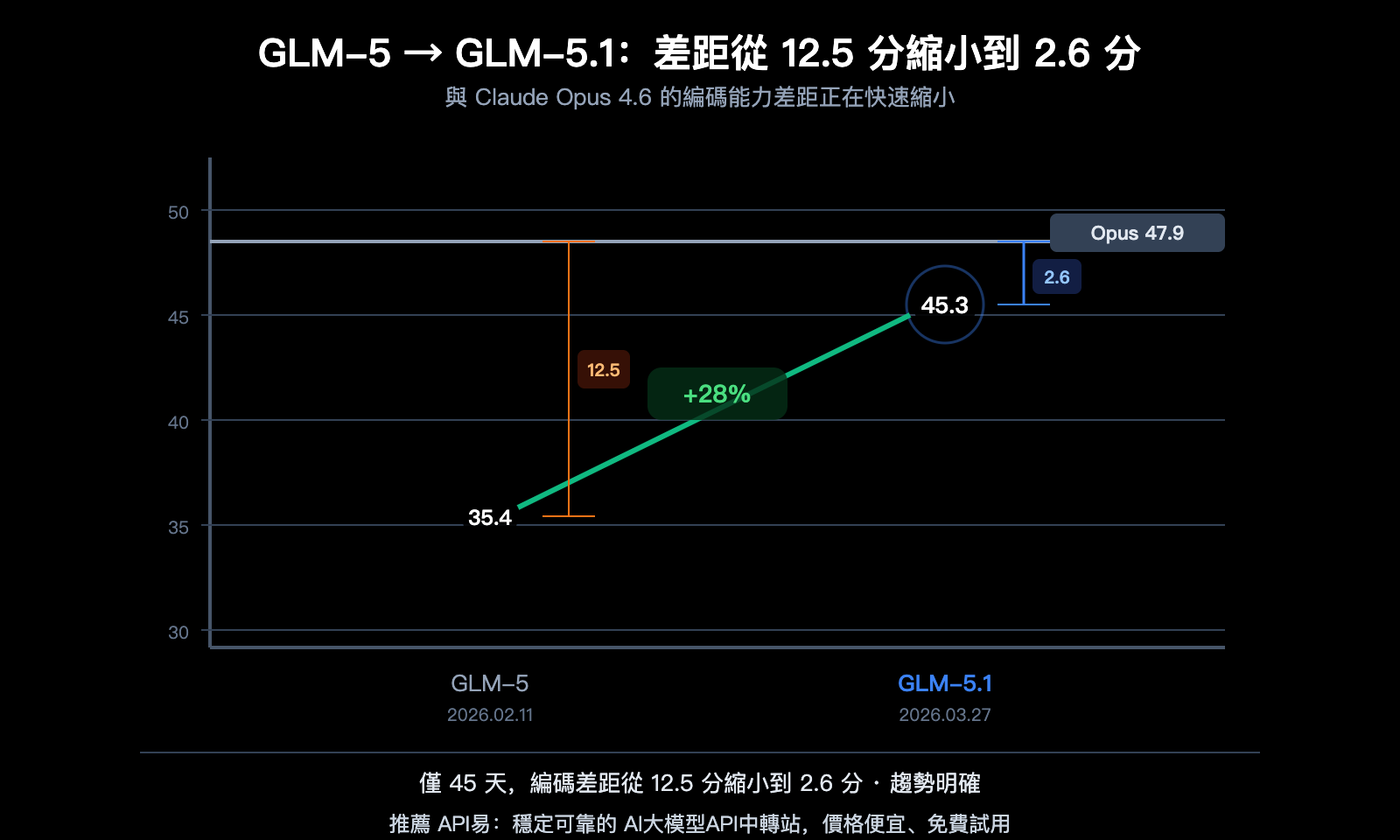

2026 年 3 月 27 日,Z.ai(原智譜 AI)官方宣佈:GLM-5.1 正式上線,所有 GLM Coding Plan 用戶均可使用。在使用 Claude Code 作爲測試工具的編碼評測中,GLM-5.1 拿下了 45.3 分——僅比 Claude Opus 4.6 的 47.9 分低 2.6 分,達到了 Opus 的 94.6% 水平。

更令人驚喜的是,GLM-5.1 比前代 GLM-5 的 35.4 分提升了 28%——這是一次巨大的代際躍進。

而這一切的價格門檻是多少?GLM Coding Plan 最低 3 美元/月(促銷價),正式價也僅 10 美元/月起步。

核心價值:本文將解讀 GLM-5.1 的編碼能力提升、Coding Plan 的套餐詳情和使用方式,以及它在 Claude 官方價格高、算力偶爾不穩時作爲高性價比替代方案的實際價值。API 上線後,API易也將第一時間接入。

GLM-5.1 編碼評測數據解讀

核心數據:使用 Claude Code 作爲測試工具

Z.ai 官方發佈的編碼評測(Coding Evaluation)使用 Claude Code 作爲測試框架,這是一個值得注意的細節——GLM-5.1 是在 Claude 自家的測試環境中展現出接近 Opus 的實力。

| 模型 | 編碼評測得分 | 與 Opus 差距 | vs GLM-5 提升 |

|---|---|---|---|

| Claude Opus 4.6 | 47.9 | — | — |

| GLM-5.1 | 45.3 | -2.6(94.6%) | +28% |

| GLM-5 | 35.4 | -12.5(73.9%) | 基準 |

三個關鍵發現:

1. GLM-5.1 達到了 Claude Opus 4.6 的 94.6%

2.6 分的差距在實際編碼場景中,對於大多數任務來說幾乎可以忽略。這意味着在日常編碼輔助中,GLM-5.1 的體驗已經非常接近 Opus。

2. GLM-5 → GLM-5.1 的躍進幅度驚人

從 35.4 到 45.3,提升了 28%。考慮到 GLM-5 在 2026 年 2 月纔剛發佈(SWE-bench Verified 得分 77.8%,已是開源模型領先水平),僅一個多月就實現如此大的迭代,Z.ai 的工程能力令人印象深刻。

3. 測試環境的公平性

使用 Claude Code 作爲測試框架,意味着這個評測對 Claude 模型天然有一定優勢(Claude Code 是爲 Claude 系列優化的工具)。GLM-5.1 在"客場"拿到 94.6% 的成績,實際能力可能更強。

GLM-5.1 相比 GLM-5 的技術改進

雖然 GLM-5.1 的完整技術報告尚未發佈,但從 GLM-5 的基礎和已知信息推測:

| 技術維度 | GLM-5 | GLM-5.1(已知/推測) |

|---|---|---|

| 總參數 | 7440 億 | 未公開(預計≥GLM-5) |

| 激活參數 | 400 億 | 未公開 |

| 架構 | MoE | MoE(推測改進) |

| 上下文 | 200K tokens | 未公開(預計≥200K) |

| 訓練數據 | 28.5T tokens | 未公開(預計更多) |

| 許可證 | MIT 開源 | 確認將開源 |

| 編碼評測 | 35.4 | 45.3(+28%) |

Z.ai 全球負責人李子軒在 3 月 20 日發推確認:"Don't panic. GLM-5.1 will be open source."——這意味着 GLM-5.1 的模型權重最終將像 GLM-5 一樣以 MIT 許可證開放。

🎯 行業視角:GLM-5.1 的開源承諾非常重要。這意味着第三方推理平臺(包括 API易 apiyi.com)在 API 正式上線後可以快速接入,甚至可能以比官方更低的價格提供服務。

GLM Coding Plan 詳解:3 美元起步的編碼 AI 方案

GLM Coding Plan 是 Z.ai 推出的訂閱制編碼 AI 服務,核心賣點是以遠低於 Claude 的價格,獲得接近 Claude 水平的編碼體驗。

三檔套餐對比

| 套餐 | 月費(正式) | 促銷價 | 每 5 小時請求數 | 每月搜索次數 |

|---|---|---|---|---|

| Lite | $10/月 | $3/首月 | 120 | 100 |

| Pro | $30/月 | $15/首月 | 600 | 1,000 |

| Max | 更高 | — | 更多 | 4,000 |

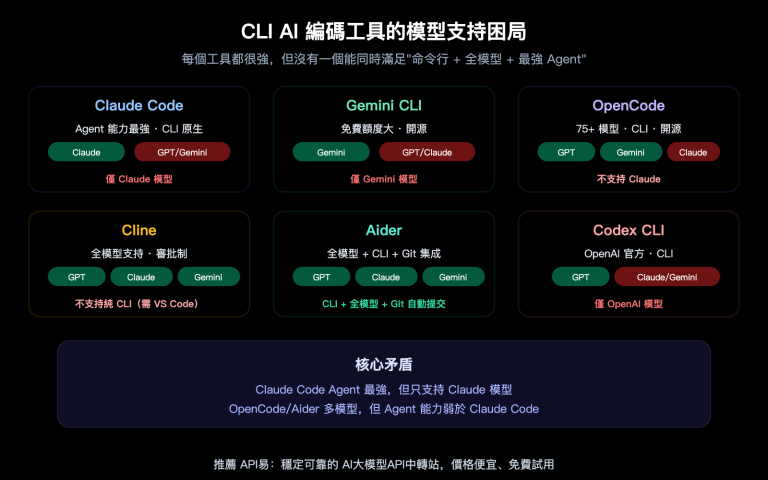

Coding Plan 支持的模型和工具

包含模型:

- GLM-5.1(最新,編碼評測 45.3)

- GLM-5(編碼評測 35.4)

- GLM-5-Turbo(更快速的版本)

- GLM-4.7

兼容的編碼工具:

- Claude Code(通過 API 兼容層)

- Cline

- Kilo Code

- OpenCode

- Clawdbot / OpenClaw

附加功能:

- 視覺理解(Vision Understanding)

- Web Search MCP

- Web Reader MCP

- Zread MCP

- 55+ tokens/秒生成速度

- 無網絡限制、無賬號封禁風險

Coding Plan vs Claude 官方訂閱成本對比

這是最直觀的性價比對比:

| 對比維度 | GLM Coding Lite | GLM Coding Pro | Claude Pro | Claude Max |

|---|---|---|---|---|

| 月費 | $10(促銷 $3) | $30(促銷 $15) | $20 | $100-200 |

| 編碼能力 | 45.3(GLM-5.1) | 45.3(GLM-5.1) | Sonnet 級 | Opus 級(47.9) |

| 達到 Opus 比例 | 94.6% | 94.6% | ~80% | 100% |

| 費用/能力比 | 極高 | 很高 | 中等 | 中低 |

有開發者在 Medium 上分享:"GLM Coding Plan 讓我用 30 美元/月獲得了 3 倍於 Claude Max 的使用量"——這個評價雖然主觀,但反映了社區的真實體驗。

💰 成本算賬:如果你每月在 Claude API 上花費超過 $30,且主要用於編碼任務,GLM Coding Pro 計劃值得認真考慮。$30/月獲得編碼能力達 Opus 94.6% 的模型,性價比確實很高。

我們的視角:Claude 算力不穩時的高性價比替代

作爲 API 聚合平臺,API易在日常運營中觀察到一個真實的痛點:Claude 官方的算力偶爾會出現不穩定。特別是在高峯期,Opus 4.6 的響應延遲增加、請求排隊時間變長,影響了開發者的工作效率。

爲什麼說 GLM Coding Plan 是好的替代方案?

理由一:編碼能力已經足夠接近

45.3 vs 47.9,2.6 分的差距在日常編碼中幾乎無感。除非你在處理極端複雜的代碼架構設計或深度推理任務,GLM-5.1 完全可以勝任。

理由二:價格差距巨大

Claude Max 每月 $100-200,GLM Coding Pro 僅 $30。如果你把省下的錢用在真正需要 Opus 的場景上(通過 API 按需調用),總成本可能更低。

理由三:無算力不穩的後顧之憂

GLM Coding Plan 承諾無網絡限制和無賬號封禁風險。雖然 Z.ai 自身也曾在 2 月底遇到算力緊張的情況,但其訂閱制模式的容量管理相對更可預測。

理由四:工具兼容性好

直接兼容 Claude Code——你不需要切換編碼工具,只需要改一下 API 端點就能從 Claude 切換到 GLM。對於已經習慣 Claude Code 工作流的開發者,遷移成本幾乎爲零。

什麼時候應該繼續用 Claude?

GLM-5.1 是好的替代品,但不是所有場景的最優解:

- 需要 1M 上下文窗口:Claude Opus 4.6 支持 1M tokens,GLM-5 系列爲 200K

- 需要極致推理深度:Opus 在深度推理和複雜分析上仍有優勢

- 需要多模態輸出:Claude 的圖像理解和長文本創作在某些場景更強

- 企業合規要求:部分企業對模型供應商有特定要求

🎯 推薦策略:將 GLM Coding Plan 作爲日常編碼的主力,Claude Opus 通過 API易 apiyi.com 按需調用處理複雜任務。這種"GLM 日常 + Claude 重炮"的組合,可以在保證效果的前提下大幅降低總成本。

GLM-5.1 API 接入:當前狀態與準備

當前狀態

截至 2026 年 3 月 27 日,GLM-5.1 的狀態如下:

| 渠道 | 狀態 | 說明 |

|---|---|---|

| GLM Coding Plan(z.ai) | ✅ 已上線 | 所有 Coding Plan 用戶可用 |

| Z.ai 官方 API | ⏳ 尚未上線 | 等待官方開放 |

| API易 apiyi.com | ⏳ 等待接入 | API 上線後第一時間支持 |

| 開源權重 | ⏳ 已承諾開源 | 具體時間未定 |

現在可以做的準備

方式一:直接使用 GLM Coding Plan

前往 z.ai/subscribe 訂閱 Coding Plan,即可在 Claude Code 中使用 GLM-5.1。

方式二:通過 API 調用 GLM-5(當前可用)

GLM-5 的 API 已經可用,定價爲輸入 $1.00/M tokens、輸出 $3.20/M tokens。雖然編碼評測得分(35.4)不如 GLM-5.1(45.3),但在其他任務上仍然很強(SWE-bench Verified 77.8%)。

import openai

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1" # API易統一接口

)

# 當前可用: GLM-5

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "user", "content": "優化這段 Python 代碼的性能"}

]

)

# GLM-5.1 API 上線後切換

# model="glm-5.1"

print(response.choices[0].message.content)

查看完整代碼(含 GLM + Claude 混合調用策略)

import openai

import time

# 通過 API易 統一接口調用多家模型

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# 模型選擇策略:簡單任務用 GLM,複雜任務用 Claude

def smart_route(prompt, complexity="normal"):

"""

根據任務複雜度自動選擇模型

- simple: GLM-5(成本最低)

- normal: GLM-5.1(上線後切換)

- complex: Claude Opus 4.6(最強推理)

"""

model_map = {

"simple": "glm-5",

"normal": "glm-5", # GLM-5.1 上線後改爲 "glm-5.1"

"complex": "claude-opus-4-6"

}

model = model_map.get(complexity, "glm-5")

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

temperature=0.7

)

elapsed = time.time() - start

return {

"model": model,

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": response.usage.total_tokens

}

# 示例:日常編碼用 GLM,深度推理用 Claude

tasks = [

("寫一個快速排序的 Python 實現", "simple"),

("重構這個微服務的數據庫連接池", "normal"),

("設計一個分佈式事務的補償機制", "complex"),

]

for prompt, complexity in tasks:

result = smart_route(prompt, complexity)

print(f"[{complexity}] 模型: {result['model']}")

print(f" 耗時: {result['time']} | Tokens: {result['tokens']}")

print(f" 回覆: {result['content'][:100]}...\n")

🚀 快速開始:API易 apiyi.com 目前已支持 GLM-5 的 API 調用。GLM-5.1 API 正式上線後,API易將第一時間接入。註冊即送免費額度,同時支持 Claude、GPT、Gemini、GLM 等多家模型的統一調用。

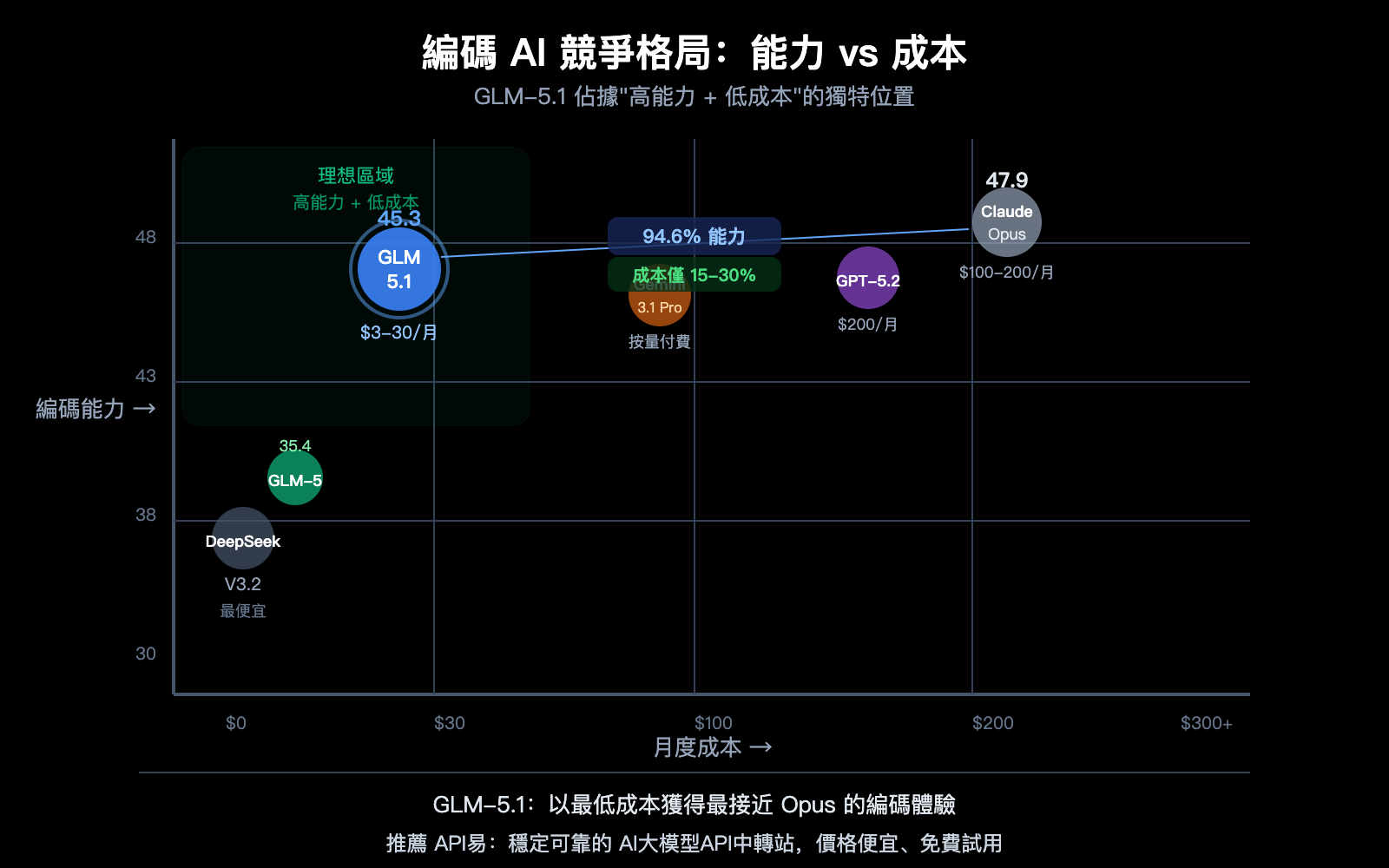

GLM-5.1 與其他編碼 AI 的競爭格局

GLM-5.1 的上線讓編碼 AI 的競爭格局變得更加有趣:

| 模型 | 編碼能力定位 | 價格定位 | API 狀態 | 開源狀態 |

|---|---|---|---|---|

| Claude Opus 4.6 | 最強(47.9) | 最高 | 已公開 | 閉源 |

| GLM-5.1 | 接近 Opus(45.3) | 低($3-30/月) | Coding Plan 可用 | 將開源 |

| Gemini 3.1 Pro | 強(多項基準第一) | 中等 | Preview 可用 | 閉源 |

| GPT-5.2 | 強 | 高 | 已公開 | 閉源 |

| DeepSeek V3.2 | 中等 | 最低 | 已公開 | 開源 |

| GLM-5 | 中上(35.4) | 低 | 已公開 | MIT 開源 |

GLM-5.1 的獨特定位在於:以開源模型的透明度和訂閱制的低價格,提供接近閉源旗艦模型的編碼能力。這在之前是沒有先例的——開源模型在編碼能力上首次如此接近閉源王者。

常見問題

Q1:GLM-5.1 的 API 什麼時候上線?

目前沒有確切日期。GLM-5.1 已在 Coding Plan 中可用,但獨立的 API 接口尚未開放。參考 GLM-5 從發佈到 API 上線的時間間隔,GLM-5.1 的 API 可能在數週內上線。API易 apiyi.com 將在 API 正式開放後第一時間接入,屆時你可以通過統一接口直接調用 GLM-5.1。

Q2:GLM Coding Plan 如何在 Claude Code 中使用?

Z.ai 的 API 與 Anthropic API 格式兼容,因此 Claude Code 可以通過更改 API 端點來路由請求到 Z.ai。具體步驟是在 Claude Code 的配置中將 API 端點從 Anthropic 官方改爲 Z.ai 提供的端點,無需修改任何其他設置。詳細配置可參考 Z.ai 開發者文檔: docs.z.ai。

Q3:GLM-5.1 能完全替代 Claude Opus 4.6 嗎?

在編碼任務上,GLM-5.1(45.3 分)已經非常接近 Opus(47.9 分),日常編碼場景幾乎無感知差異。但在以下場景中 Opus 仍有明顯優勢:1M token 超長上下文、極致深度推理、複雜的多步驟 Agent 工作流。我們建議的策略是"GLM 日常 + Claude 重炮"——日常編碼用 GLM 節省成本,複雜任務通過 API易 apiyi.com 按需調用 Opus。

總結:GLM-5.1 改變了編碼 AI 的性價比格局

GLM-5.1 的上線是 2026 年編碼 AI 領域的一個重要里程碑——首次有開源(即將開源)模型在編碼評測中達到 Claude Opus 4.6 的 94.6%,而價格僅爲 Opus 的幾分之一。

3 個核心要點:

- 編碼能力逼近天花板:45.3 vs 47.9,差距僅 2.6 分,日常編碼幾乎無感

- 價格優勢碾壓:Coding Plan $3-30/月 vs Claude Max $100-200/月

- API 即將上線:API易將第一時間接入 GLM-5.1 API,屆時可通過統一接口調用

在 Claude 官方價格高企、偶爾算力不穩的當下,GLM Coding Plan 已經證明了自己是一個可靠的高性價比替代方案。無論你選擇 Coding Plan 訂閱制還是等待 API 按量調用,GLM-5.1 都值得納入你的編碼 AI 工具箱。

作者:APIYI Team | GLM-5.1 API 上線後,API易 apiyi.com 將第一時間支持。歡迎訪問獲取免費測試額度,體驗 Claude + GLM + GPT + Gemini 多模型統一調用

📚 參考資料

-

Z.ai 官方公告:GLM-5.1 上線 Coding Plan

- 鏈接:

z.ai/subscribe - 說明: 訂閱 GLM Coding Plan,使用 GLM-5.1

- 鏈接:

-

Z.ai 官方博客:GLM-5 技術介紹

- 鏈接:

z.ai/blog/glm-5 - 說明: GLM-5 的架構、訓練數據和基準測試詳情

- 鏈接:

-

Z.ai 開發者文檔:API 接入和定價

- 鏈接:

docs.z.ai/guides/overview/pricing - 說明: 模型定價、API 調用規範和工具集成指南

- 鏈接:

-

Artificial Analysis:GLM-5 獨立評測

- 鏈接:

artificialanalysis.ai/models/glm-5 - 說明: 第三方基準測試數據和模型對比

- 鏈接:

-

GLM-5 GitHub 倉庫:開源模型權重

- 鏈接:

github.com/zai-org/GLM-5 - 說明: MIT 許可證開源,包含模型權重和使用指南

- 鏈接: