Примечание автора: не переходя на дешевые каналы и сохраняя исходную стоимость моделей, разберем, как OpenClaw экономит деньги за счет контроля длины входных токенов. Мы рассмотрим 6 стратегий: изоляция задач в новых диалогах, точный поиск блоков кода вместо загрузки всего файла, обрезка контекста, локальный поиск QMD и другие.

OpenClaw славится своим «аппетитом» к токенам — некоторые пользователи умудряются сжигать по 21,5 млн токенов в день, получая счета более $600 в месяц. Первая реакция многих — перейти на более дешевые модели, но это неизбежно бьет по качеству. Настоящий способ экономии токенов — контроль входных данных: именно объем контекста, который вы «скармливаете» модели, определяет итоговую стоимость. В этой статье мы сосредоточимся на главном вопросе: как перейти от стратегии «запихнуть всё целиком» к «подавать точно и дозированно», не меняя модель и не теряя в качестве.

Ключевая ценность: прочитав эту статью, вы освоите 6 практических стратегий контроля входных токенов, которые помогут сократить расходы на 50–90%.

Основные принципы экономии токенов в OpenClaw

Давайте сразу проясним: в этой статье мы обсуждаем способы экономии токенов без смены модели и потери качества. Вы используете те же Claude Opus 4.6 или GPT-5, модель остается прежней, а экономия достигается за счет оптимизации входных данных.

| Стратегия | Процент экономии | Сложность внедрения | Основная идея |

|---|---|---|---|

| Новый чат для каждой задачи | 60-80% | Низкая | Начинайте новый диалог для каждой задачи, чтобы избежать накопления истории |

| Точный поиск блоков кода | 40-95% | Средняя | Передавайте только нужные фрагменты кода, а не весь файл целиком |

| Обрезка контекста | 30-50% | Низкая | Вручную или автоматически очищайте ненужную историю переписки |

| Локальный поиск QMD | 80-90% | Средняя | Локальный векторный поиск, отправка только релевантных фрагментов |

| Кэширование промптов (Prompt Caching) | 80-90% (затраты на ввод) | Низкая | Используйте кэширование, чтобы не отправлять системный промпт повторно |

| Отключение режима Thinking | 10-50x | Низкая | Отключайте режим рассуждения для задач, не требующих глубокого анализа |

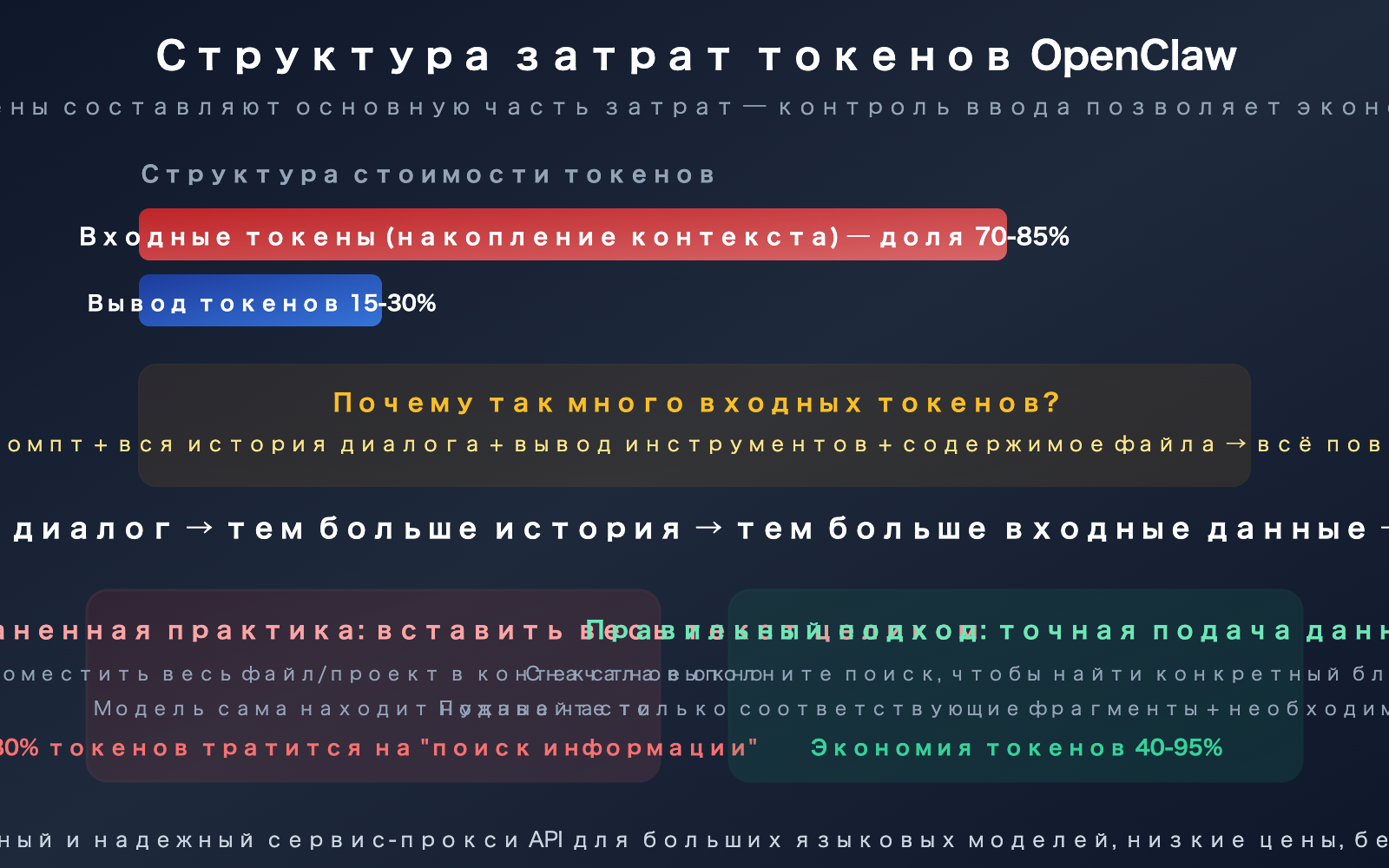

Механизм расхода токенов в OpenClaw

Чтобы экономить токены, нужно понимать, почему OpenClaw их «ест».

Каждый раз, когда вы отправляете сообщение в OpenClaw, система отправляет модели не только ваш текущий запрос, но и всю историю диалога. Чем длиннее переписка, тем больше входных токенов уходит на каждый запрос.

В частности, входные данные одного запроса включают:

- Системный промпт (System Prompt): основные инструкции OpenClaw, обычно 2000-5000 токенов.

- AGENTS.md / SOUL.md: файлы конфигурации рабочего пространства.

- Загруженные навыки (Skills): каждый активный навык занимает место.

- Полная история диалога: все сообщения с начала сессии.

- Результаты вызова инструментов: вывод после чтения файлов или выполнения команд.

- Результаты поиска по памяти (Memory): релевантный контент, извлеченный из базы знаний.

В сессии OpenClaw, которая длится 30 минут, входные токены для последнего сообщения могут достигать 100 000 или даже 1 000 000 — при том, что большая часть данных за первые 29 минут уже не нужна для текущей задачи.

Стратегия 1: Новый чат для каждой задачи в OpenClaw

Это самый простой и эффективный метод.

Почему новый чат экономит токены

Представьте, что вы делаете 3 вещи в рамках одного диалога: исправляете баг А → пишете функцию Б → рефакторите модуль В. К моменту начала третьей задачи входные данные модели содержат всю историю переписки и чтения файлов по первым двум задачам — но для рефакторинга модуля В они абсолютно бесполезны.

Один чат:

История задачи А (20K токенов)

+ Содержимое файлов задачи А (30K токенов)

+ История задачи Б (25K токенов)

+ Содержимое файлов задачи Б (40K токенов)

+ Текущее сообщение задачи В (5K токенов)

= 120K токенов на входе (из которых 115K — это «исторический багаж»)

Новый чат:

Текущее сообщение задачи В (5K токенов)

+ Системный промпт (3K токенов)

= 8K токенов на входе (экономия 93%)

Лучшие практики при работе с диалогами

| Сценарий | Нужно ли открывать новый чат? | Причина |

|---|---|---|

| Переключение на совершенно другую задачу | Да | Контекст предыдущей задачи больше не нужен |

| Итеративная настройка одной функции | Нет | Нужен контекст предыдущих обсуждений |

| Исправление разных багов в разных файлах | Да | Каждый баг независим, перекрестный контекст не нужен |

| Последовательные изменения в одном модуле | Нет | Модели нужно понимать логику предыдущих правок |

| Более 20 сообщений в диалоге | Да (или очистка) | Накопилось слишком много истории |

🎯 Совет: Простой критерий — если вам хочется сказать «забудь всё, что было раньше, давай сделаем другое», просто открывайте новый чат.

Этот принцип применим не только к OpenClaw, но и к Claude Code и другим инструментам разработки на базе ИИ. Каждый отдельный API-запрос, выполненный через APIYI (apiyi.com), по своей сути является «новым чатом», поэтому проблема накопления контекста там отсутствует.

Стратегия №2: Точный поиск фрагментов кода в OpenClaw вместо загрузки всего проекта

Это ключевой момент статьи — как сделать так, чтобы модель видела только те фрагменты кода, которые нужно изменить, а не скармливать ей весь файл или даже весь проект целиком?

Суть проблемы: почему «загрузка всего проекта» — это пустая трата ресурсов

Статистика показывает, что 80% токенов у AI-агентов для программирования уходит впустую на «поиск нужного». Типичный сценарий: вы просите OpenClaw изменить одну функцию, а он считывает 25 файлов, просто чтобы найти те самые 3 нужные функции. В итоге вы оплачиваете чтение всех 25 файлов.

Файл на 1000 строк — это примерно 15 000–25 000 токенов. Если вам нужно изменить всего 20 строк (около 300–500 токенов), но в модель «запихивают» весь файл, то 96–98% входных токенов тратятся впустую.

4 способа точного поиска фрагментов кода в OpenClaw

Способ №1: Указывайте конкретные файлы и номера строк

Не говорите «исправь функцию входа», лучше скажите: «измени функцию handleLogin в src/auth/login.ts с 45 по 78 строку». Чем точнее инструкция, тем меньше файлов придется считывать OpenClaw.

❌ "Исправь баг при входе"

→ OpenClaw считывает 10+ файлов, потребляет 200K+ токенов

✅ "Исправь проверку на null в файле src/auth/login.ts на 52 строке"

→ OpenClaw считывает только нужную часть 1 файла, потребляет ~20K токенов

Способ №2: Используйте локальный семантический поиск QMD

QMD (Quick Memory Database) в OpenClaw позволяет создавать локальный векторный индекс. Он находит нужные фрагменты кода и отправляет модели только самое важное.

Как включить: активируйте QMD в настройках OpenClaw, и он автоматически проиндексирует файлы проекта и историю диалогов. При последующих запросах QMD сначала найдет нужный код локально и отправит модели только точный фрагмент.

Способ №3: Используйте синтаксис @file для прямой ссылки

В OpenClaw можно использовать синтаксис @file, чтобы точно указать на нужный файл и избежать лишнего поиска:

Измени функцию handleLogin в @src/auth/login.ts,

добавь логику обработки истечения срока действия refreshToken.

Используй метод isTokenExpired из @src/auth/token.ts как пример.

Так OpenClaw загрузит только эти 2 файла, а не будет сканировать весь каталог src/auth/.

Способ №4: Используйте файл со структурой проекта

Опишите структуру проекта в AGENTS.md или SOUL.md. Это поможет OpenClaw понять, «какая функция в каком файле лежит», и сократит необходимость в поисковом сканировании.

## Структура проекта

- Аутентификация: src/auth/ (login.ts, token.ts, session.ts)

- Управление пользователями: src/user/ (profile.ts, settings.ts)

- API-маршруты: src/routes/ (auth.route.ts, user.route.ts)

Этот обзор занимает всего пару сотен токенов, но экономит десятки тысяч токенов, которые ушли бы на «слепое» сканирование файлов.

Стратегии 3–6: Продвинутые методы экономии токенов в OpenClaw

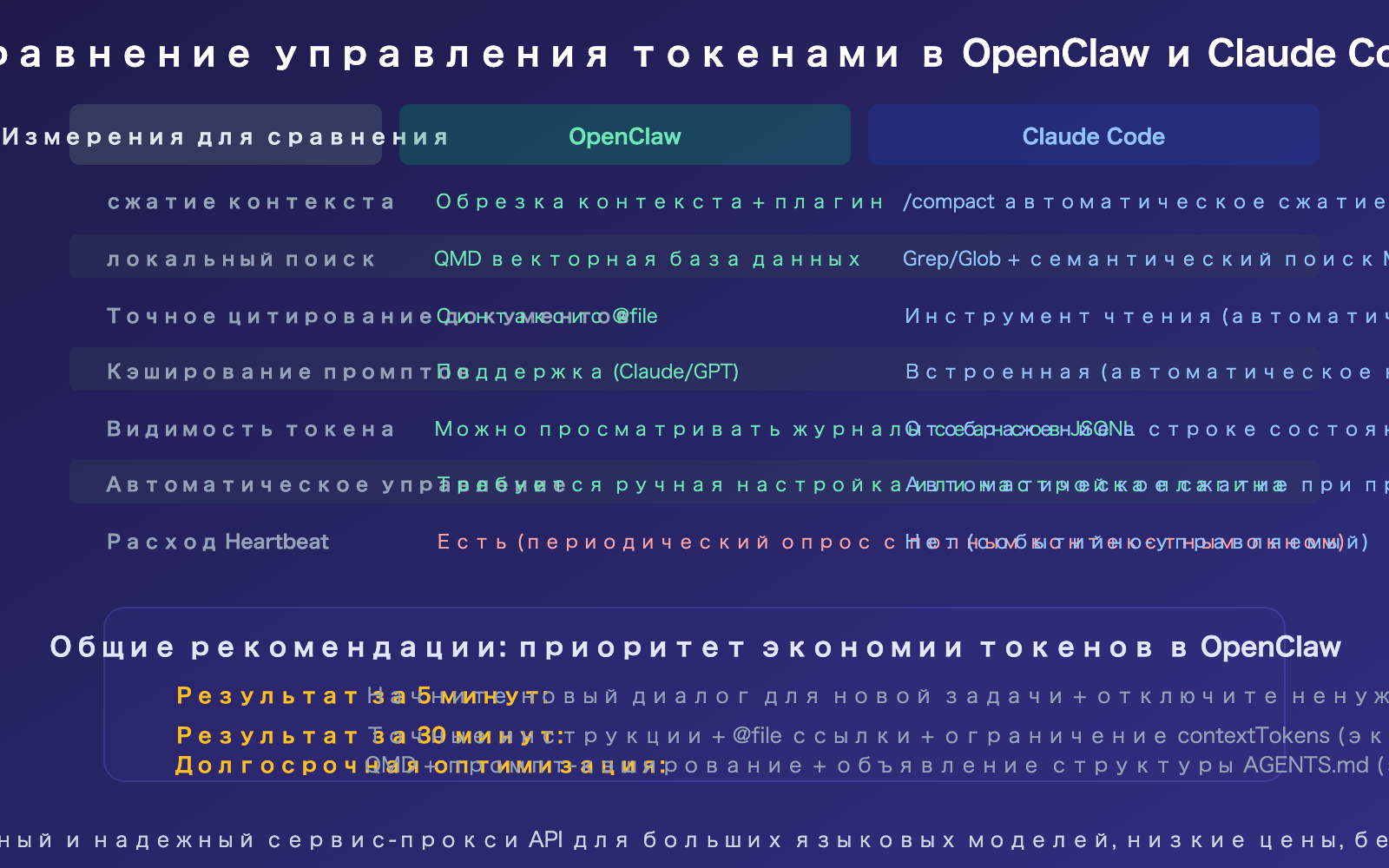

Стратегия 3: Обрезка контекста (Context Pruning)

OpenClaw поддерживает как ручную, так и автоматическую обрезку контекста. Когда диалог становится слишком длинным, можно очистить историю сообщений, которые больше не нужны.

В версии OpenClaw 2026.3.7 появились плагины Context Engine, позволяющие сторонним разработчикам предлагать альтернативные стратегии управления контекстом (ранее эта логика была жестко прописана в ядре). Плагин lossless-claw позволяет сжимать историю диалога без потери ключевой информации.

Практические советы:

- После завершения каждой подзадачи вручную очищайте вывод ненужных вызовов инструментов.

- Установите

contextTokens: 50000для ограничения размера контекстного окна. - Используйте функцию

compactдля сжатия истории диалога.

Стратегия 4: Локальный семантический поиск QMD

QMD (Quick Memory Database) — это функция локального векторного поиска в OpenClaw. Она создает векторную базу данных прямо на вашем устройстве, индексируя историю диалогов и документы. При выполнении запроса система сначала ищет релевантный контент локально и отправляет модели только самые подходящие фрагменты.

Результат: снижение затрат на входные токены на 80–90%.

Стратегия 5: Использование кэширования промптов (Prompt Caching)

Семейства моделей Claude и GPT поддерживают кэширование промптов — когда системный промпт или часто используемый контекст не меняются, API автоматически использует кэшированную версию, что снижает стоимость входных токенов на 80–90%.

Важное ограничение: при вызове Claude через формат, совместимый с OpenAI (/v1/chat/completions), кэширование промптов не поддерживается. Необходимо использовать нативный формат Anthropic (/v1/messages). Если вы используете APIYI (apiyi.com), платформа поддерживает нативный формат кэширования промптов.

Стратегия 6: Отключение режима Thinking для неинтеллектуальных задач

Режим Thinking/Reasoning увеличивает потребление токенов в 10–50 раз. Если текущая задача не требует глубоких рассуждений (например, простое форматирование, перемещение файлов или замена текста), отключение режима Thinking поможет значительно сэкономить.

| Тип задачи | Нужен ли Thinking | Разница в токенах |

|---|---|---|

| Анализ сложных багов | Да | Обычное потребление |

| Архитектурное проектирование | Да | Обычное потребление |

| Простое форматирование | Нет | Экономия 10-50x |

| Перемещение/переименование файлов | Нет | Экономия 10-50x |

| Генерация шаблонного кода | По ситуации | Для простых шаблонов можно отключить |

Подсказка: Context Compaction в Claude Code и Context Pruning в OpenClaw решают одну и ту же задачу — контроль накопленных входных токенов. Если вы используете оба инструмента, вы можете централизованно управлять лимитами вызовов API через APIYI (apiyi.com).

Сравнение экономии токенов: OpenClaw против Claude Code

Оба инструмента решают одну и ту же проблему, но подходы к реализации различаются.

Часто задаваемые вопросы

Q1: Что делать, если после начала нового диалога модель не знает контекст проекта?

Используйте систему памяти Memory в OpenClaw и файл AGENTS.md. Memory автоматически извлекает соответствующую информацию о контексте проекта в новых сессиях (отправляются только самые важные фрагменты, а не вся история целиком). В AGENTS.md можно прописать структуру проекта и ключевые соглашения — они будут автоматически загружаться при каждом новом диалоге. Это гораздо эффективнее, чем каждый раз скармливать модели историю из 20 сообщений.

Q2: Как узнать, сколько токенов было потрачено в текущем диалоге?

История диалогов OpenClaw сохраняется в JSONL-файлах в директории .openclaw/agents.main/sessions/, где можно напрямую посмотреть количество токенов для каждого запроса. Но удобнее использовать панель мониторинга вашего API-провайдера: при вызове через сервис-прокси API APIYI (apiyi.com) в личном кабинете отображается точный расход токенов и стоимость каждого запроса.

Q3: В чем разница между QMD и обычным поиском через grep?

grep выполняет точное совпадение: если вы ищете «handleLogin», он найдет только те места, где есть эта строка. QMD — это семантический поиск: если вы введете «обработка ошибок при входе пользователя», он найдет все семантически связанные блоки кода, даже если в самом коде нет слов «вход» или «обработка ошибок». Семантический поиск точнее, он передает модели меньше «мусора», что позволяет существенно экономить токены.

Q4: Почему Heartbeat потребляет так много токенов?

Механизм Heartbeat (пульс) в OpenClaw регулярно проверяет статус задач. Если установить слишком короткий интервал (например, каждые 5 минут), то при каждом «ударе сердца» модели будет отправляться полный контекст диалога. Некоторые пользователи обнаружили, что функция автоматической проверки почты может «сжечь» $50 за день. Решение: увеличьте интервал Heartbeat или приостанавливайте его, когда автоматический мониторинг не требуется.

Резюме

Ключевые способы экономии токенов в OpenClaw (без смены модели и потери качества):

- Входные токены — основная статья расходов (70–85%): при каждом запросе вся история диалога отправляется заново, поэтому чем длиннее переписка, тем она дороже. Самый простой способ сэкономить — начинать новый диалог для каждой новой задачи.

- Точный поиск по коду — главный рычаг: переход от «запихнуть всё в контекст» (120 тыс. токенов) к «точечной подаче» (4 тыс. токенов) позволяет сэкономить до 96% на тех же задачах. Методы: явное указание номеров строк, ссылки через @file, семантический поиск QMD и описание структуры в AGENTS.md.

- Трехэтапный путь оптимизации: 5 минут (новый диалог + отключение Thinking, экономия 50%) → 30 минут (точные инструкции + ограничение контекста, экономия 80%) → долгосрочная перспектива (QMD + кэширование, экономия 97%).

Рекомендуем управлять API-вызовами OpenClaw через APIYI (apiyi.com). Платформа предоставляет точную статистику использования токенов и мониторинг расходов, что поможет вам наглядно оценить эффективность каждой оптимизации.

📚 Справочные материалы

-

Руководство по использованию токенов и контролю расходов в OpenClaw: Официальная документация по управлению токенами.

- Ссылка:

docs.openclaw.ai/reference/token-use - Описание: содержит настройки

contextTokensи оптимизацию Heartbeat.

- Ссылка:

-

Практика экономии токенов в OpenClaw: как снизить расходы с $600 до $20: Полная трехэтапная стратегия оптимизации.

- Ссылка:

blog.laozhang.ai/en/posts/openclaw-save-money-practical-guide - Описание: включает конкретные параметры конфигурации и ожидаемый процент экономии.

- Ссылка:

-

80% токенов AI-агентов для кодинга тратятся впустую на поиск: Исследование точности контекста.

- Ссылка:

medium.com/@jakenesler/context-compression-to-reduce-llm-costs - Описание: объясняет, почему точный поиск эффективнее, чем простое увеличение контекстного окна.

- Ссылка:

-

Центр документации APIYI: Статистика использования токенов и мониторинг расходов.

- Ссылка:

docs.apiyi.com - Описание: поддержка управления вызовами API для OpenClaw и Claude Code.

- Ссылка:

Автор: Техническая команда APIYI

Техническое обсуждение: Приглашаем к дискуссии в комментариях. Больше материалов можно найти в центре документации APIYI по адресу docs.apiyi.com.