Примечание автора: На основе данных, просочившихся в ходе «серого» тестирования в LM Arena, представляем полный разбор 8 ключевых улучшений gpt-image-2 по сравнению с gpt-image-1.5, включая рендеринг текста, реализм, вывод в 4K, скорость, поддержку языков и генерацию скриншотов интерфейсов.

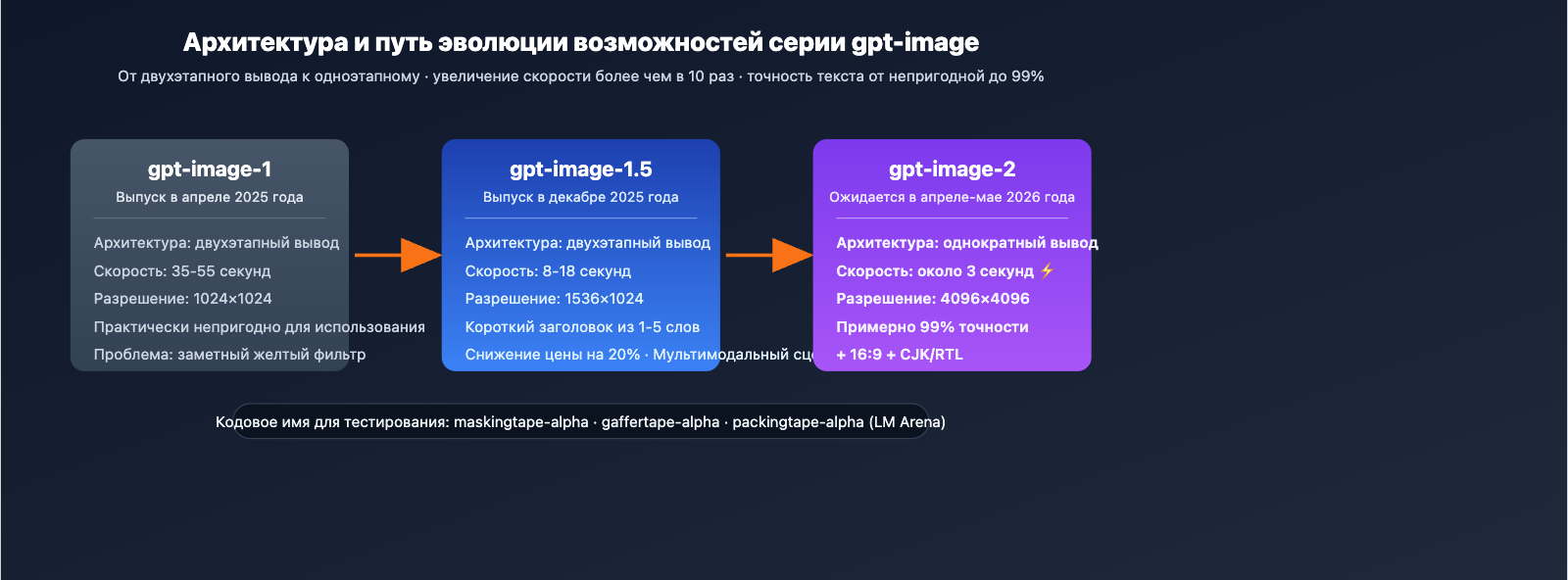

В начале апреля 2026 года на платформе LM Arena незаметно появились три анонимные модели: maskingtape-alpha, gaffertape-alpha и packingtape-alpha. Ранние тестеры сообщают, что точность рендеринга текста в них приближается к 99%, время генерации составляет всего около 3 секунд, а также имеется нативная поддержка вывода в 4K. Сообщество практически единогласно сходится во мнении, что это и есть готовящаяся к выпуску gpt-image-2 от OpenAI.

Это не vaporware (пустые обещания): публичные записи тестов в LM Arena, сравнительные скриншоты от независимых исследователей и типичные циклы «серого» тестирования OpenAI (обычно официальный релиз следует через 2–4 недели) указывают на один и тот же вывод. В этой статье мы систематически сравним 8 ключевых обновлений gpt-image-2 и gpt-image-1.5.

Ценность материала: после прочтения вы будете четко понимать, в чем именно gpt-image-2 превосходит предшественника (текст, реализм, 4K, скорость, UI-дизайн, языки), и как бесшовно перейти на новую модель в день открытия API.

Основные моменты gpt-image-2

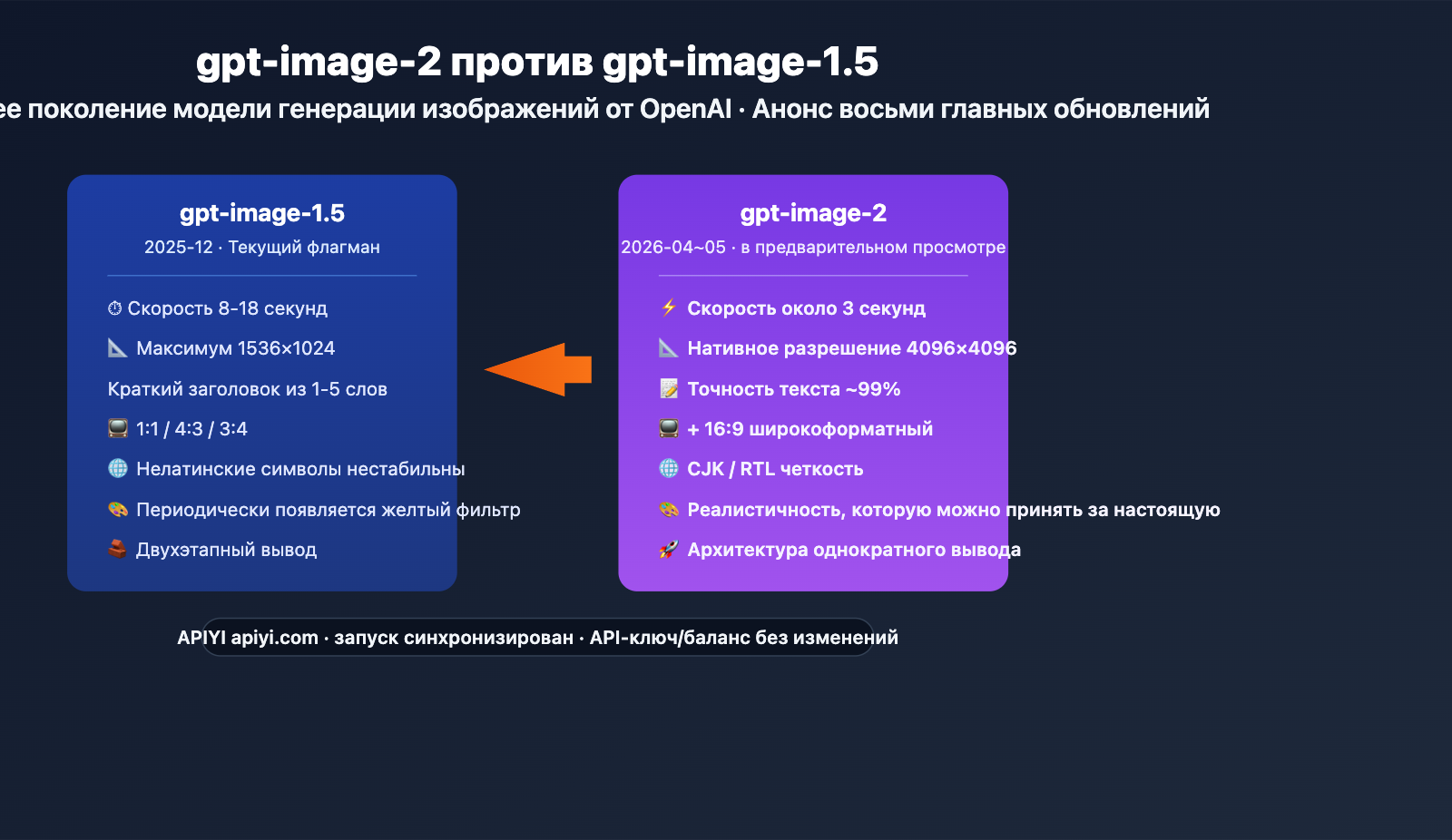

| Параметр | gpt-image-1.5 | gpt-image-2 (улучшения) |

|---|---|---|

| Рендеринг текста | Хорошо для заголовков из 1-5 слов | Точность на уровне символов ~99% |

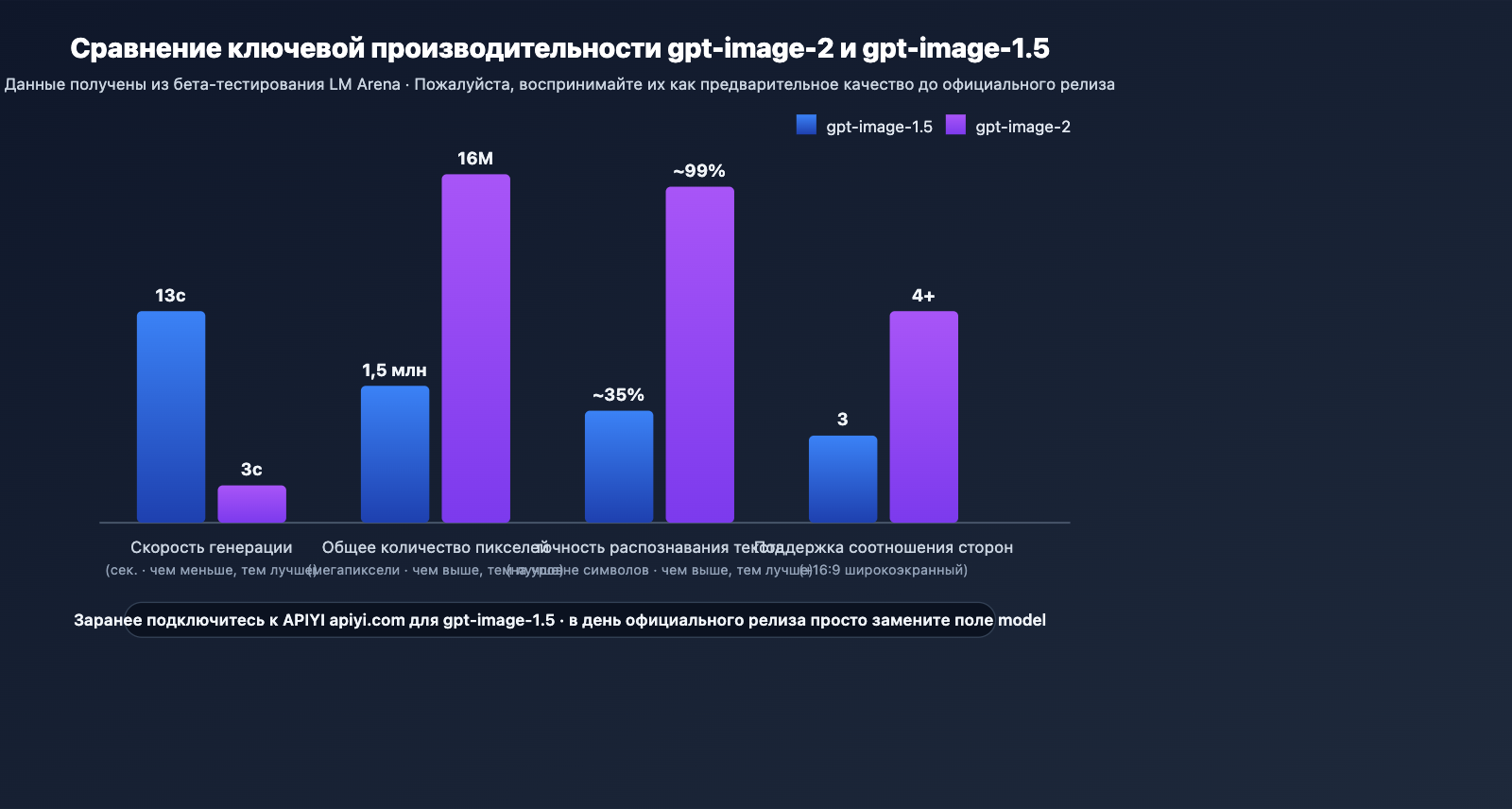

| Скорость генерации | 8-18 секунд | ~3 секунды (в 3-5 раз быстрее) |

| Макс. разрешение | 1536×1024 | 2048×2048 / 4096×4096 |

| Поддержка форматов | Только 1:1, 4:3, 3:4 | Добавлен широкоэкранный 16:9 |

| Реализм | Присутствует «AI-фильтр» | Портреты/продукты неотличимы от фото |

Общее значение обновлений gpt-image-2

Текст больше не является слабым местом. В эпоху gpt-image-1.5 большинство моделей ошибались при рендеринге текста длиннее 5-6 слов. Тестеры LM Arena отмечают, что в gpt-image-2 UI-метки, вывески и рекламные тексты практически не требуют постобработки. Это означает, что локализованная реклама, макеты интерфейсов и изображения для соцсетей больше не нуждаются в ручной верстке.

Переход от двухэтапного к одноэтапному выводу. Если gpt-image-1.5 все еще опиралась на двухэтапный конвейер, то gpt-image-2, по отзывам, перешла на архитектуру с одноэтапным выводом (отдельная модель). Это стало фундаментом для 3-секундной скорости, а также означает, что пропускная способность пакетной обработки может вырасти на порядок.

Подробный разбор 8 главных улучшений gpt-image-2 по сравнению с gpt-image-1.5

Улучшение 1: Почти идеальный рендеринг текста

Тестировщики LM Arena сообщают, что точность распознавания символов в gpt-image-2 составляет около 99%. Текст органично вписывается в сцену (например, в интерфейсы приложений, на плакаты или вывески), а не «висит» поверх изображения, как это было у старых моделей.

Это была общая «болезнь» всех популярных моделей генерации изображений (Midjourney, Stable Diffusion, Imagen, Flux), и, наконец, в gpt-image-2 она была системно решена.

Улучшение 2: Реализм, который трудно отличить от реальности

Многие тестировщики отмечают, что портреты, селфи на пляже и макросъемка продуктов, созданные gpt-image-2, выглядят настолько реалистично, что сложно поверить в их ИИ-происхождение:

- Анатомически правильные руки: пропорции пальцев и углы суставов выглядят естественно.

- Точные отражения в очках: отражения соответствуют окружению.

- Исчезновение желтого фильтра: тот самый «ИИ-оттенок», который преследовал эпоху gpt-image-1, больше не появляется.

Улучшение 3: Глубокие знания о мире

Когда тестировщики просили сгенерировать «магазин IKEA ночью», «скриншот главной страницы YouTube» или «сцену из Minecraft с правильным игровым интерфейсом», gpt-image-2 воссоздавал реальные бренды, интерфейсы и окружение настолько точно, что их можно принять за настоящие фотографии.

Это означает, что модель действительно понимает визуальные условности реального мира, а не просто распределяет пиксели на основе статистики.

Улучшение 4: Нативный вывод в 4K

Максимальное разрешение вывода gpt-image-1.5 составляло 1536×1024, в то время как gpt-image-2, как ожидается, будет поддерживать нативное разрешение 2048×2048 и 4096×4096, а также широкоформатный режим 16:9.

| Сценарий использования | Опыт gpt-image-1.5 | Опыт gpt-image-2 |

|---|---|---|

| Коммерческая печать | Требуется постобработка | Нативное 4K для печати |

| Маркетинговые визуалы | Недостаточное разрешение | Нативное качество для плакатов |

| Продуктовые фото высокого разрешения | Требуется апскейлинг | Готово за один проход |

| Видео-превью | Отсутствие 16:9 | Нативная поддержка широкоформата |

Улучшение 5: Более быстрая генерация (около 3 секунд)

Наблюдатели Arena зафиксировали время генерации около 3 секунд — это значительно быстрее, чем стандартные 10–20 секунд (или даже 35–55 секунд в эпоху gpt-image-1) у предыдущих флагманских моделей.

Это дает преимущество как в интерактивном UX (время ожидания пользователя заметно сокращается), так и в пакетной обработке (производительность вырастает в 3–5 раз).

Улучшение 6: Рендеринг текста на разных языках

В превью латиница, CJK (китайский, японский, корейский) и языки с письмом справа налево (арабский, иврит) отображаются четко и читабельно.

Если при релизе это качество сохранится, локализованная реклама и многоязычные UI-макеты больше не потребуют ручной верстки — это огромный плюс для команд, работающих на международном рынке, трансграничной электронной коммерции и контент-менеджеров.

Улучшение 7: Генерация UI и скриншотов

Тестировщики особо отметили способность модели воссоздавать интерфейсы — веб-страницы, приложения и окна ОС выглядят поразительно точно. Это подходит для следующих задач:

- Дизайн-исследования: быстрая генерация концептов UI.

- Материалы для обучения: создание примеров скриншотов для технической документации.

- Концепты: демонстрация клиентам интерфейсов продуктов, которые еще не разработаны.

- Материалы для A/B тестирования: массовая генерация интерфейсов в разных стилях для выбора лучшего.

Улучшение 8: Доступ через API сразу после релиза

Как только OpenAI откроет API, APIYI сразу же добавит поддержку. Ваши текущие ключи, баланс и счета на apiyi.com останутся прежними — не нужно регистрировать новые аккаунты, менять SDK или переписывать бизнес-логику.

Совет по миграции: До официального релиза gpt-image-2 вы можете тестировать текущий gpt-image-1.5 через APIYI apiyi.com, чтобы привыкнуть к настройкам

base_urlи структуре параметров. В день релиза вам останется только заменить полеmodel.

Быстрый старт с gpt-image-2 (Руководство по миграции API)

Минималистичный пример (на базе gpt-image-1.5, в релизной версии просто замените название модели)

from openai import OpenAI

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.images.generate(

model="gpt-image-1.5", # После официального релиза замените на "gpt-image-2"

prompt="A modern cafe menu board with hand-lettered text 'Today Special: Espresso $4.50'",

size="1024x1024",

quality="high"

)

print(response.data[0].url)

Посмотреть полный код реализации (включая 4K, 16:9 и обработку ошибок)

from openai import OpenAI

from typing import Optional, Literal

def generate_image(

prompt: str,

model: str = "gpt-image-1.5",

size: Literal["1024x1024", "1536x1024", "1024x1536", "2048x2048", "4096x4096"] = "1024x1024",

quality: Literal["low", "medium", "high", "auto"] = "high",

n: int = 1

) -> Optional[str]:

"""

Генерация изображений, совместимая с gpt-image-1.5 и будущим gpt-image-2

Args:

prompt: Текстовый промпт (до 2000 токенов)

model: Название модели (после релиза можно переключить на gpt-image-2)

size: Размер вывода (gpt-image-2 будет поддерживать 2K/4K)

quality: Уровень качества

n: Количество генераций (сейчас поддерживается только 1)

Returns:

Временный URL изображения (действителен 24 часа)

"""

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://vip.apiyi.com/v1"

)

try:

response = client.images.generate(

model=model,

prompt=prompt,

size=size,

quality=quality,

n=n

)

return response.data[0].url

except Exception as e:

print(f"Ошибка генерации изображения: {e}")

return None

url = generate_image(

prompt="Product hero shot: sleek wireless earbuds on marble, 'AuraPods Pro' label visible",

model="gpt-image-1.5",

size="1536x1024",

quality="high"

)

print(f"URL изображения: {url}")

Совет платформы: Получите бесплатные тестовые лимиты через APIYI apiyi.com, чтобы мгновенно опробовать возможности gpt-image-1.5. В день выхода gpt-image-2 вы сможете переключиться на него без изменения кода.

Сравнение gpt-image-2 и gpt-image-1.5

| Параметр | gpt-image-1.5 (дек. 2025) | gpt-image-2 (ожид. апр-май 2026) | Значимость |

|---|---|---|---|

| Архитектура | Двухэтапный вывод | Одноэтапный вывод | Значительный рост пропускной способности |

| Скорость | 8-18 сек. | ~3 сек. | В 3-5 раз быстрее |

| Макс. разрешение | 1536×1024 | 4096×4096 | Подходит для коммерческой печати |

| Соотношение сторон | 1:1/3:4/4:3 | + 16:9 (широкоформат) | Удобно для превью видео |

| Точность текста | Короткие заголовки (1-5 слов) | ~99% (символьный уровень) | Забудьте о ручной верстке |

| Мультиязычность | Нестабильно для нелатиницы | Отлично для CJK/RTL | Идеально для локализации |

| Рендеринг UI | Средне | "Имитация" реальных скриншотов | Подходит для дизайна и туториалов |

Сравнительный анализ обновлений

В сравнении с Midjourney: Midjourney остается лидером в художественных стилях, но имеет ограниченный API и слабые возможности рендеринга текста. В свою очередь, gpt-image-2 предлагает стандартный API и 99% точность текста, что делает его лучшим выбором для интеграции в автоматизированные рабочие процессы.

В сравнении с Imagen 2: Google Imagen 2 хорош в фотореализме, но его API-экосистема довольно закрыта, а поддержка языков, отличных от английского, ограничена. gpt-image-2 более сбалансирован в плане мультиязычности, рендеринга UI и скорости, что важно для глобальных команд.

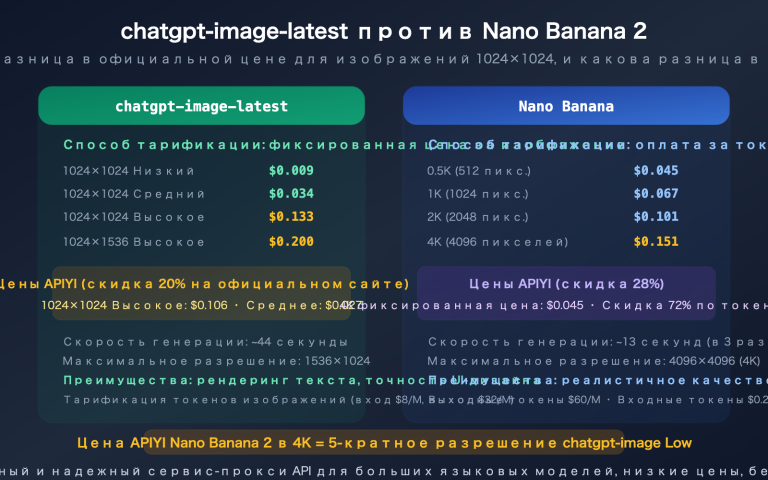

В сравнении с nano-banana-pro: nano-banana-pro выигрывает по соотношению цена/качество, но уступает gpt-image-2 в выводе 4K и способности точно воспроизводить брендовые элементы. Для коммерческой печати и маркетинга gpt-image-2 — более надежный вариант.

Примечание к сравнению: Данные частично основаны на открытых тестах LM Arena и отзывах ранних пользователей. До официального релиза gpt-image-2 воспринимайте их как предварительные. Рекомендуем заранее протестировать gpt-image-1.5 через сервис-прокси API APIYI (apiyi.com), чтобы ознакомиться со структурой параметров.

Сценарии использования gpt-image-2

Обновление до gpt-image-2 стоит рассмотреть, если вам актуальны следующие задачи:

- Сценарий 1 — Коммерческая печать: Нативный вывод в 4K решает проблему низкого разрешения для плакатов, каталогов и наружной рекламы.

- Сценарий 2 — Локализованная реклама: Рендеринг текста на разных языках избавляет от ручной верстки, значительно ускоряя работу команд, работающих на зарубежных рынках.

- Сценарий 3 — Дизайн UI: Быстрая генерация концептов и материалов для обучающих руководств.

- Сценарий 4 — Главные изображения для e-commerce: Фотореализм и точное отображение текста на продукте идеально подходят для маркетинговых визуалов.

- Сценарий 5 — Видеоконтент: Поддержка широкоформатного соотношения 16:9 для массовой генерации превью для YouTube и коротких видео.

Совет: Если вы сейчас выбираете API для генерации изображений, рекомендуем начать с подключения gpt-image-1.5 через APIYI (apiyi.com). После официального релиза новой версии вы сможете перейти на нее бесшовно, просто заменив поле

model.

Часто задаваемые вопросы (FAQ)

Q1: Что такое gpt-image-2?

gpt-image-2 — это модель генерации изображений следующего поколения от OpenAI, выпуск которой ожидается в апреле-мае 2026 года. Согласно результатам «серого» тестирования в LM Arena, модель использует архитектуру однопроходного вывода (single-pass inference), обеспечивает точность рендеринга текста около 99%, скорость генерации около 3 секунд и нативную поддержку разрешения 4K. Это значительное обновление после gpt-image-1 (апрель 2025) и gpt-image-1.5 (декабрь 2025).

Q2: В чем разница между gpt-image-2 и gpt-image-1.5?

Основные различия проявляются в восьми аспектах: рендеринг текста (с 5 слов до 99% точности), скорость (с 8–18 секунд до 3 секунд), разрешение (с 1536×1024 до 4096×4096), соотношение сторон (добавлено 16:9), реалистичность (устранение желтого фильтра), мировые знания (точность брендов/UI), поддержка языков (четкость CJK/RTL) и точность воспроизведения UI (возможность создания реалистичных скриншотов). gpt-image-1.5 все еще подходит для коротких заголовков и стандартных форматов, но для коммерческой печати, локализации и работы с UI рекомендуется дождаться gpt-image-2.

Q3: Когда выйдет gpt-image-2?

По состоянию на 17 апреля 2026 года официального анонса от OpenAI не было. Основываясь на циклах предыдущих «серых» тестов (обычно 2–4 недели до официального релиза), эксперты ожидают выход модели в период с конца апреля по середину мая 2026 года. Три кодовых имени моделей в LM Arena (maskingtape-alpha, gaffertape-alpha, packingtape-alpha) в настоящее время проходят A/B тестирование.

Q4: Для каких сценариев лучше всего подходит gpt-image-2?

Модель идеально подходит для следующих задач:

- Коммерческая печать (постеры/альбомы): нативный вывод 4K избавляет от необходимости последующего апскейлинга.

- Локализация изображений для соцсетей: рендеринг текста на разных языках исключает необходимость верстки в Photoshop.

- Концепты UI-дизайна: генерация примеров скриншотов для исследования продуктов и создания обучающих материалов.

- Маркетинговые изображения для e-commerce: реалистичные портреты в сочетании с точным отображением текста на продуктах.

- Превью для видеоплатформ: пакетная генерация в нативном соотношении 16:9.

Q5: Как быстро подключиться к gpt-image-2 через API?

Рекомендуем заранее подключиться через APIYI (apiyi.com), чтобы начать использовать gpt-image-2 сразу после релиза:

- Зарегистрируйтесь на apiyi.com и получите API-ключ.

- Используйте

base_url=https://vip.apiyi.com/v1для вызова текущей модели gpt-image-1.5, чтобы ознакомиться с параметрами. - В день выхода gpt-image-2 вам нужно будет просто заменить поле

modelсgpt-image-1.5наgpt-image-2.

APIYI синхронизирует новые модели одновременно с OpenAI, при этом ваши ключи, баланс и история счетов остаются прежними — не нужно регистрировать новый аккаунт или менять SDK.

Q6: Есть ли у gpt-image-2 известные ограничения или неопределенности?

Основные вопросы связаны с тем, что модель еще официально не представлена:

- Цена неизвестна: gpt-image-1.5 была примерно на 20% дешевле, чем gpt-image-1; стоимость gpt-image-2 будет подтверждена позже.

- Лимиты скорости: в период запуска возможны ограничения по квотам, поэтому использование сервиса-прокси API поможет избежать проблем с «холодным стартом».

- Возможные изменения: характеристики тестовой версии в LM Arena могут отличаться от финальной, поэтому воспринимайте их как предварительные.

- План «Б»: если проект срочный, текущая модель gpt-image-1.5 остается стабильным и надежным флагманским решением.

Q7: Заменит ли gpt-image-2 модель DALL-E 3?

Судя по темпам релизов OpenAI, DALL-E 3, скорее всего, будет постепенно выводиться из эксплуатации после официального запуска gpt-image-2. Серия gpt-image стала основным приоритетом компании, а структура параметров API уже стабилизировалась. Рекомендуем для новых проектов сразу использовать gpt-image-1.5 или дождаться gpt-image-2, чтобы не тратить ресурсы на кастомизацию под DALL-E 3.

Q8: Действительно ли модели серии tape в LM Arena — это gpt-image-2?

Официального подтверждения нет, но есть четыре веских аргумента в пользу OpenAI:

- Стиль именования (серия tape) соответствует историческим кодовым названиям OpenAI.

- Точность рендеринга текста (99%) и уровень мировых знаний превосходят все существующие публичные модели.

- Период тестирования совпадает с типичным графиком «серого» запуска OpenAI.

- Стиль генерации изображений логически продолжает серию gpt-image (отличается от Midjourney/Imagen).

Рекомендуем следить за официальными анонсами и ждать синхронизации на APIYI (apiyi.com).

Основные выводы по gpt-image-2

- Модель следующего поколения: флагман OpenAI 2026 года, замена gpt-image-1.5, переход от двухэтапной архитектуры к однопроходному выводу.

- Восемь ключевых улучшений: текст (99%), скорость (3 сек), нативный 4K, 16:9, реалистичность, мировые знания, поддержка языков, точность UI.

- Сценарии использования: коммерческая печать, локализованная реклама, концепты UI, изображения для e-commerce, превью для видео.

- График релиза: ожидается с конца апреля по середину мая 2026 года, текущие кодовые имена — серия tape.

- Бесшовная миграция: подключитесь к gpt-image-1.5 через APIYI (apiyi.com) заранее, в день релиза просто замените поле

model.

Резюме

Ключевые моменты сравнения gpt-image-2 и gpt-image-1.5:

- Качественный скачок: три основных показателя — работа с текстом, скорость и разрешение — достигли или превзошли стандарты промышленного уровня. Это уже не тот случай, когда результат «можно использовать, но нужно дорабатывать».

- Новые возможности: впервые стали по-настоящему доступны такие сценарии, как коммерческая печать, многоязычная локализация и воспроизведение UI, что значительно снижает затраты на постобработку.

- Бесшовная миграция: структура параметров API полностью совместима с gpt-image-1.5, поэтому команды, подготовившиеся заранее, смогут переключиться на новую версию в день релиза без единого изменения в коде.

Для принятия решений рекомендуем немедленно подключиться к gpt-image-1.5 через APIYI (apiyi.com), чтобы освоить параметры и рабочие процессы. Платформа предоставляет бесплатные лимиты и унифицированный интерфейс, что позволит вам в день выхода gpt-image-2 просто сменить поле model и сразу воспользоваться всеми восемью преимуществами обновления.

Дополнительные материалы

Если вас заинтересовала модель gpt-image-2, рекомендуем ознакомиться с этими материалами:

- 📘 Полное руководство по API gpt-image-1.5 — освойте параметры и лучшие практики работы с текущей флагманской моделью генерации изображений.

- 📊 Сравнение цен и качества: gpt-image-2 против nano-banana-pro — узнайте структуру затрат популярных API для генерации изображений.

- 🚀 Оптимизация пакетных вызовов API генерации изображений в продакшене — изучите конвейеры обработки, стратегии параллелизма и кэширования.

📚 Справочные материалы

-

Анализ MindStudio: Комплексный разбор "What Is GPT Image 2"

- Ссылка:

mindstudio.ai/blog/what-is-gpt-image-2 - Описание: Систематизированный обзор матрицы возможностей gpt-image-2 от популярного зарубежного блога.

- Ссылка:

-

Анализ утечек getimg.ai: Слухи, утечки и дата релиза GPT Image 2

- Ссылка:

getimg.ai/blog/gpt-image-2-rumours-leaks-release-date-2026 - Описание: Первичные наблюдения за производительностью трех моделей под кодовым названием "tape" в LM Arena.

- Ссылка:

-

Официальный блог OpenAI: Анонс обновлений функций работы с изображениями в ChatGPT

- Ссылка:

openai.com/index/new-chatgpt-images-is-here - Описание: Официальное разъяснение пути развития серии gpt-image.

- Ссылка:

-

Техническая документация gpt-image-1.5: Подборка от EvoLink

- Ссылка:

evolink.ai/blog/gpt-image-1-5-guide-features-comparison-access - Описание: Подробные параметры gpt-image-1.5, включая скорость, разрешение и уровни качества.

- Ссылка:

Автор: Техническая команда APIYI

Техническое обсуждение: Приглашаем к дискуссии в комментариях. Больше материалов доступно в центре документации APIYI по адресу docs.apiyi.com