Conclusão em uma frase: ao acessar o gpt-image-2 via Relay Oficial (Official Relay), não há riscos jurídicos adicionais desde que o uso seja razoável — a estrutura de risco é idêntica à de uma empresa que utiliza a API oficial da OpenAI diretamente. No entanto, se o provedor de serviço proxy de API utilizar canais de engenharia reversa (Reverse-engineered), o risco de conformidade será transmitido ao longo da cadeia de chamadas até a empresa. Este artigo apresenta um método de avaliação rigoroso e uma lista de verificação jurídica com 8 itens.

Desde que o gpt-image-2 foi lançado oficialmente pela OpenAI em 21/04/2026, ele tem sido amplamente adotado em cenários B2B no mercado interno. As três perguntas mais frequentes das equipes jurídicas das empresas são: Podemos usar diretamente? Existe risco de conformidade? A quem pertence a imagem gerada?

Essas três perguntas parecem simples, mas envolvem os Termos de Serviço da OpenAI, Políticas de Uso, cláusulas de indenização, mecanismos de segurança de conteúdo, direitos de propriedade comercial e a "diferença entre tipos de provedores de serviço proxy de API", que é o ponto mais negligenciado pelas empresas locais. Sem ler os três documentos originais dos termos em inglês da OpenAI, é fácil para o departamento jurídico chegar a uma conclusão conservadora, porém incorreta.

Este artigo decompõe o mapa de conformidade do gpt-image-2 seguindo a ordem do fluxo real de aprovação corporativa.

I. Dois canais que devem ser diferenciados antes de conectar o gpt-image-2

A essência da revisão de conformidade dos serviços de IA pelo departamento jurídico nacional não é o modelo em si, mas se a "cadeia de chamadas pode ser rastreada até uma autorização legal". É por isso que primeiro precisamos decompor claramente o papel do "provedor de serviço proxy de API".

1.1 Relay Oficial vs. Inverso: A diferença fundamental na natureza jurídica

| Tipo de canal | Implementação técnica | Método de autenticação da OpenAI | Origem da cobrança | Qualificação jurídica |

|---|---|---|---|---|

| Relay Oficial (Relay) | O provedor possui uma chave API da OpenAI legítima, recebe e encaminha solicitações | Padrão Authorization: Bearer sk-xxx |

Pago via fatura oficial da OpenAI | Revenda legal de API |

| Inverso (Reverse) | Sessão/conta web do ChatGPT reversa, contorna a autenticação da API | Simula Session/Cookie do navegador | Rodízio de múltiplas contas/contorna cobrança | Viola os ToS da OpenAI, zona cinzenta jurídica |

| Auto-hospedado (Self-hosted) | A empresa possui sua própria chave API e chama diretamente | Sua própria chave | Pago por conta própria | Usuário padrão, totalmente em conformidade |

Julgamento crítico: Quando você envia uma solicitação para um endpoint como https://api.example.com/v1/images/generations, você precisa saber como o provedor chega à OpenAI na camada subjacente.

🎯 Dica importante: Ao escolher um serviço proxy, certifique-se de que o provedor utilize um canal de relay oficial. Por exemplo, a plataforma APIYI (apiyi.com) acessa a API oficial da OpenAI externamente e utiliza internamente chaves API de nível empresarial legalmente adquiridas, mantendo uma relação comercial B2B padrão com a OpenAI. Isso determina o limite de conformidade para as empresas clientes a jusante.

1.2 Por que o "canal inverso" faz com que a empresa assuma riscos solidários

Os [Termos de Serviço] da OpenAI estipulam claramente que os usuários da API não devem "contornar, obstruir ou destruir as restrições de acesso da OpenAI". Se o provedor de serviço implementou o acesso através da engenharia reversa do ChatGPT, então:

- Esta responsabilidade por quebra de contrato será transmitida ao longo da cadeia contratual: O provedor viola o contrato → A empresa, como usuária a jusante, ainda pode ser considerada em "violação indireta" se não puder provar que não tinha conhecimento.

- A Indenização (defesa em nome de) da OpenAI não se aplica: Explicaremos isso em detalhes mais adiante, mas, em termos simples, sob um canal reverso, você não obtém a proteção de "defesa em nome de" da OpenAI contra alegações de violação de propriedade intelectual de terceiros.

- O mecanismo de segurança de conteúdo pode ser contornado: Canais reversos frequentemente modificam parâmetros de segurança como

moderation, fazendo com que as imagens geradas pela empresa possam atingir categorias proibidas pela OpenAI, sem que a empresa saiba.

1.3 Como identificar rapidamente o tipo de canal de proxy

Ao realizar a devida diligência sobre os provedores de serviço, o departamento jurídico da empresa pode usar as seguintes perguntas para identificar rapidamente:

✅ Três perguntas para julgar o canal de conformidade

Q1: "Por favor, forneçam a prova da relação de serviço de API entre vocês e a OpenAI

(por exemplo, tipo de conta OpenAI, captura de tela da conta corporativa, fatura mensal)"

Q2: "O endpoint que vocês chamam é api.openai.com ou

uma interface derivada de chat.openai.com?"

Q3: "Se nossa solicitação acionar a moderação de conteúdo da OpenAI,

o código de erro é retornado como está? Ou foi reescrito por vocês?"

O Relay Oficial geralmente consegue responder diretamente às duas primeiras perguntas, e a resposta para a terceira pergunta é "retornado como está: 400/safety_violations". Já o canal inverso geralmente é vago ou se recusa a fornecer comprovantes.

二、Limites comerciais do gpt-image-2 sob os termos oficiais da OpenAI

Após confirmar a conformidade do canal, o próximo ponto de preocupação jurídica é: "Podemos usar as imagens geradas diretamente para fins comerciais?" Esta parte é definida conjuntamente por três documentos: Termos de Uso da OpenAI, Termos de Serviço e Políticas de Uso.

2.1 Propriedade da saída: A OpenAI cede explicitamente ao usuário

A seção 3 "Conteúdo" dos Termos de Uso da OpenAI estabelece claramente:

"A OpenAI cede a você todos os seus direitos, títulos e interesses sobre a Saída (Output)."

Pontos principais da tradução:

- O usuário retém a propriedade sobre a Entrada (Input).

- O usuário possui direitos completos sobre a Saída (Output), com a OpenAI transferindo ativamente esses direitos ao usuário.

- Isso significa que, legalmente, você é o titular dos direitos das imagens geradas pelo

gpt-image-2.

2.2 Escopo comercial: Inclui todas as atividades comerciais, incluindo revenda

| Atividade Comercial | Permitido? | Base nos Termos da OpenAI |

|---|---|---|

| Uso interno da empresa (promoção interna/PPT/protótipos) | ✅ Permitido | Termos §3 |

| Veiculação de anúncios de marketing | ✅ Permitido | Termos §3 |

| Embalagens de produtos/materiais impressos | ✅ Permitido | Termos §3 |

| Imagens de produtos de e-commerce/venda direta (impressão) | ✅ Permitido | Termos §3 |

| Revenda como serviço SaaS (invocação de API para terceiros) | ✅ Permitido | Termos §3 + Termos de Serviço |

| Treinamento de modelos concorrentes | ❌ Proibido | Termos de Serviço §2(c) |

Linha vermelha única: É proibido usar a saída do gpt-image-2 para treinar qualquer modelo que concorra com os serviços da OpenAI. Este é o único uso comercial expressamente proibido pela OpenAI.

🎯 Recomendação para empresas: Se o seu negócio envolve fornecer "SaaS de geração de imagens por IA" para clientes, este caminho é permitido pelos termos da OpenAI. Recomendamos realizar testes comparativos de múltiplos modelos através da plataforma APIYI (apiyi.com), que suporta uma interface unificada para modelos como

gpt-image-2,Imagen 4eFlux 1.1 Pro, facilitando a seleção técnica dentro da conformidade.

2.3 A realidade da proteção de direitos autorais: Você "possui", mas é difícil "reivindicar"

Este é o ponto onde o departamento jurídico mais se confunde. O fato de a OpenAI ceder os "direitos" a você não significa que essa imagem goze de "proteção pela lei de direitos autorais".

| Dimensão | Termos da OpenAI | Lei de Direitos Autorais (Prática jurídica EUA/China) |

|---|---|---|

| Propriedade | OpenAI transfere todos os direitos ao usuário | Depende do caso |

| Direitos autorais completos | Não garantido | Escritório de Direitos Autorais dos EUA: IA pura não tem direitos autorais; China reconhece contribuição humana |

| Direitos comerciais | Totalmente permitido, incluindo revenda | Não afeta — é um direito contratual, independente do copyright |

| Prevenção de roubo por terceiros | Não garante exclusividade | Pode ser impossível reivindicar proteção por direitos autorais |

Conclusão prática: Você pode usar as imagens do gpt-image-2 para fins comerciais com tranquilidade, mas não presuma que elas terão a mesma proteção de direitos autorais que uma obra feita à mão por um designer. Para ativos de alto valor (como logotipos de marcas ou mascotes principais), recomenda-se que um designer humano faça uma criação secundária substancial sobre a saída da IA para garantir a possibilidade de reivindicação de direitos autorais.

三、Mecanismos de segurança de conteúdo do gpt-image-2 e obrigações de auditoria prévia das empresas

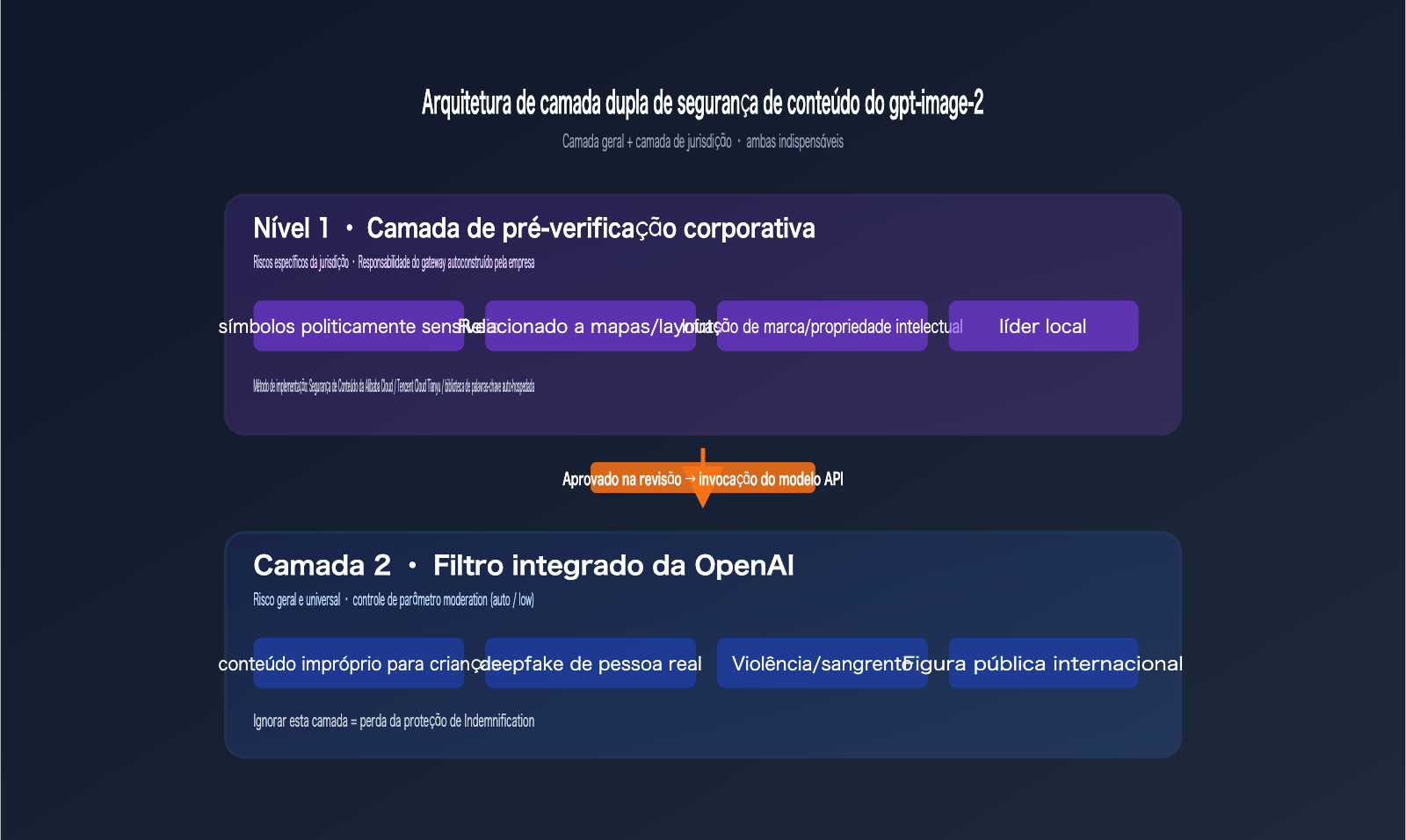

A segurança de conteúdo da OpenAI é um aspecto subestimado no espectro de conformidade. Muitos departamentos jurídicos acreditam que "o filtro de segurança do modelo é suficiente", o que é um equívoco perigoso.

3.1 Dois níveis de mecanismos de segurança integrados ao gpt-image-2

A API do gpt-image-2 possui dois níveis de verificação de segurança integrados ao gerar imagens:

# Primeiro nível: verificação da entrada (prompt) (antes da geração)

# Segundo nível: verificação da imagem de saída (antes do retorno)

# Parâmetros controláveis pela empresa:

{

"model": "gpt-image-2",

"prompt": "seu comando aqui",

"moderation": "auto", # Valor padrão, filtragem padrão

# "moderation": "low", # Opcional, filtragem permissiva, mas não pode ser desativada

"size": "1024x1024",

"quality": "high"

}

Importante: O parâmetro moderation só pode ser escolhido entre auto (padrão) e low, não existe opção "off". Isso significa que a OpenAI sempre mantém um filtro de base — por exemplo, conteúdo prejudicial a menores ou deepfakes de figuras públicas reais serão recusados em qualquer modo.

3.2 Categorias de conteúdo não cobertas pelos filtros de segurança da OpenAI

Os filtros da OpenAI focam em riscos universais, mas não cobrem riscos específicos da jurisdição onde a empresa opera:

| Categoria de Risco | Filtro OpenAI | Requisitos na China Continental |

|---|---|---|

| Conteúdo impróprio para crianças | ✅ Filtro forte | ✅ Consistente |

| Deepfakes de pessoas reais | ✅ Filtro forte | ✅ Consistente |

| Violência/Sangue | ⚠️ Depende da gravidade | ✅ Controle rigoroso |

| Símbolos politicamente sensíveis | ⚠️ Cobertura parcial | ❗️ Requer auditoria prévia |

| Imagem de líderes nacionais | ⚠️ Apenas figuras públicas internacionais | ❗️ Requer auditoria prévia |

| Mapas/Territórios | ❌ Não coberto | ❗️ Requer auditoria prévia |

| Logotipos comerciais/Violação de marca | ❌ Não coberto | ❗️ Requer auditoria prévia |

Conclusão chave: A segurança de conteúdo da OpenAI é uma camada universal; empresas na China Continental possuem obrigações de conformidade em nível jurisdicional. Mesmo acessando o gpt-image-2 via canal conforme, a empresa ainda precisa realizar uma "auditoria de conteúdo prévia" no cliente ou em seu próprio gateway.

🎯 Sugestão de integração: Na prática, recomendamos que as empresas usem uma camada de API de segurança de conteúdo local (como o Content Security da Alibaba Cloud ou o Tianyu da Tencent) para filtrar palavras-chave no comando antes de chamar o

gpt-image-2. Após receber a imagem, realize uma verificação na saída com uma API de auditoria de conteúdo visual. Plataformas de serviço proxy de API como a APIYI (apiyi.com) retornam os códigos de errosafety_violationsda OpenAI, facilitando a centralização dos logs de auditoria.

3.3 Segurança, conformidade e a forte vinculação com a Indenização

Este é o detalhe jurídico mais facilmente ignorado. A seção 7 dos Termos de Serviço da OpenAI fornece uma cláusula de Indenização (Indemnification):

Quando o usuário da API utiliza a saída dentro dos limites legais e é processado por terceiros por violação de propriedade intelectual, a OpenAI arcará com os custos de defesa e indenização razoável.

No entanto, esta proteção possui duas condições de exclusão:

- O usuário sabe ou deveria saber que a saída pode violar direitos de terceiros e, ainda assim, a utiliza.

- O usuário desativou ou contornou os mecanismos de segurança fornecidos pela OpenAI.

Implicação prática: Se você insistir em usar moderation: low ou contornar os filtros de segurança da OpenAI por meios técnicos, você renuncia voluntariamente à proteção de Indenização. Mesmo que você tenha obtido uma saída de API perfeita, se for processado por violação, a OpenAI não aparecerá para defendê-lo.

IV. Conformidade de transferência de dados do gpt-image-2: PIPL e Lei de Segurança de Dados

Ao integrar o gpt-image-2 em empresas na China continental, existe um problema mais fundamental e anterior à "escolha do serviço proxy de API": a conformidade na transferência de dados para fora do país. Este é um ponto de extrema atenção para o departamento jurídico, mas que muitas equipes técnicas ignoram durante a seleção de ferramentas.

4.1 Quais dados são considerados "transferidos para fora"

Os servidores de processamento da API da OpenAI estão localizados nos Estados Unidos, portanto, qualquer solicitação enviada ao gpt-image-2 envolve a transferência de dados para o exterior. Especificamente no cenário de geração de imagens, os seguintes dados são transmitidos:

| Tipo de dado | Transferido? | Sensibilidade PIPL |

|---|---|---|

| Texto do comando | ✅ Sim | Depende do conteúdo |

| Imagem de referência (cenário imagem para imagem) | ✅ Sim | Alta (pode conter rostos/cenas) |

| Imagem gerada | ✅ Sim (retorno após geração) | Média |

| IP/UA do usuário | ✅ Sim (se conexão direta) | Baixa |

| Dados associados ao negócio (user_id, session_id) | ⚠️ Depende da implementação | Média |

🎯 Sugestão de caminho de transmissão de dados: Utilize um serviço proxy de API em conformidade no país (como a plataforma APIYI, apiyi.com). O comando chega primeiro a um servidor doméstico e, em seguida, é enviado para o exterior através da rede nacional, reduzindo o risco de conformidade de "conexão direta do terminal do usuário com o exterior". A arquitetura de entrada doméstica dessa plataforma atende aos requisitos de conformidade da PIPL para o papel de "processador de dados".

4.2 Três caminhos de conformidade sob a estrutura da PIPL

O Artigo 38 da "Lei de Proteção de Informações Pessoais" (PIPL) estabelece três caminhos de conformidade para a transferência de dados para o exterior:

Caminho 1: Avaliação de segurança organizada pelo departamento nacional de cibersegurança

- Aplicável a: Operadores de infraestrutura de informação crítica, processamento de dados de mais de 1 milhão de pessoas

- Dificuldade: ★★★★★ (Avaliação governamental, ciclo de 6-12 meses)

Caminho 2: Certificação de proteção de informações pessoais

- Aplicável a: Empresas em geral, via certificação por instituições profissionais

- Dificuldade: ★★★ (Certificação institucional, ciclo de 2-3 meses)

Caminho 3: Registro de contrato padrão (SCC)

- Aplicável a: Maioria das empresas, assinatura de contrato padrão e registro

- Dificuldade: ★★ (Relativamente simples, mas requer supervisão posterior)

Para o cenário de integração do gpt-image-2, a grande maioria das empresas se enquadra no Caminho 3 (Contrato Padrão). Isso significa que você precisa:

- Assinar um contrato com os usuários finais contendo cláusulas de SCC.

- Avaliar o tipo e a sensibilidade dos dados transferidos.

- Realizar o registro junto ao escritório local de cibersegurança.

4.3 Melhores práticas para reduzir a sensibilidade dos dados transferidos

Sem comprometer o negócio, existem várias maneiras de reduzir a complexidade da conformidade dos dados transferidos:

| Método prático | Custo de implementação | Ganho de conformidade |

|---|---|---|

| Modelo de comando padronizado (evitar concatenação dinâmica de privacidade) | Baixo | Alto |

| Anonimização de imagem de referência (desfoque de rosto/substituição de fundo) | Médio | Alto |

| Hash de ID de usuário (não transmitir o user_id real) | Baixo | Médio |

| Pré-processamento local (filtragem de palavras-chave sensíveis) | Médio | Alto |

| Proxy de conformidade (processado por provedor doméstico) | Baixo | Alto |

4.4 Relação entre conformidade PIPL e negócios do gpt-image-2

| Cenário de negócio | Complexidade de dados transferidos | Caminho de conformidade recomendado |

|---|---|---|

| Ilustração de documentos internos da empresa | Baixa (sem dados pessoais) | Apenas registro de contrato padrão |

| Geração de material de marketing (sem rostos) | Baixa | Registro de contrato padrão |

| Geração de perfil de usuário (contém rostos) | Alta | Certificação de proteção + SCC |

| Imagens de produtos de e-commerce (com modelos) | Média | Registro de contrato padrão + autorização de imagem do modelo |

| Geração de avatar para redes sociais (com fotos de usuários) | Alta | Certificação de proteção + consentimento individual do usuário |

V. 8 Listas de verificação de conformidade jurídica para empresas ao integrar o gpt-image-2

Consolidamos a análise acima em uma lista de verificação que você pode entregar diretamente à sua equipe jurídica ou de compliance.

5.1 Checklist completo (por ordem de aprovação)

| Nº | Item de verificação | Padrão de aprovação | Nível de risco |

|---|---|---|---|

| 1 | Tipo de canal do serviço proxy de API | Deve ser redirecionamento oficial, com comprovantes de fatura da OpenAI | Alto |

| 2 | Qualificação do provedor do serviço proxy | Empresa registrada (local ou exterior) com ICP/licença operacional | Alto |

| 3 | Caminho de transmissão de dados | Clareza se o comando/imagem passa por SSL e se há registro/retenção | Médio |

| 4 | Camada de pré-moderação de conteúdo | Mecanismo duplo: auditoria de comando própria + auditoria de imagem de saída | Alto |

| 5 | Estratégia de parâmetro moderation |

Uso padrão auto; se for low, exige exceção por escrito |

Médio |

| 6 | Declaração de limites comerciais | Declaração nos Termos de Serviço (ToS) proibindo o uso para treinar modelos concorrentes | Médio |

| 7 | Transferência de propriedade da imagem | Acordo claro de propriedade com clientes a jusante/usuários finais | Médio |

| 8 | Plano de resposta a emergências | Fluxo de tratamento para casos de reclamações/processos gerados por imagens | Alto |

5.2 Diferenças de prioridade por perfil de empresa

| Perfil da empresa | Itens de verificação prioritários | Foco jurídico |

|---|---|---|

| Chamada direta (uso interno) | 1, 4, 5 | Conformidade do canal proxy, segurança de conteúdo |

| Provedor SaaS (revenda) | 1, 6, 7 | Limites comerciais, acordos de direitos com clientes |

| Empresa listada / Estatal | Todos os 8 itens | Trilha de auditoria completa, comprovantes rastreáveis |

| E-commerce transfronteiriço | 1, 4, 7 | Conformidade multijurisdicional, alinhamento de propriedade |

🎯 Sugestão de integração: Para empresas listadas e estatais, recomendamos priorizar provedores de serviço proxy que ofereçam faturas completas, pagamento via conta corporativa e acordos SLA. A plataforma APIYI (apiyi.com) suporta emissão de notas fiscais para contas corporativas e permite a assinatura de contratos formais de serviço, atendendo a todos os requisitos de auditoria de conformidade corporativa.

5.3 Modelo de "Carta de Compromisso de Conformidade do Provedor"

Para transformar o checklist acima em termos contratuais, sugerimos exigir que o provedor do serviço proxy confirme por escrito as seguintes cláusulas ao assinar o contrato:

Cláusulas essenciais da Carta de Compromisso de Conformidade (para referência jurídica)

1. Conformidade do canal: O provedor garante que todas as solicitações de

encaminhamento de API utilizam o endpoint oficial da OpenAI

(api.openai.com), sem utilizar engenharia reversa ou métodos de

bypass de autenticação.

2. Retenção de qualificações: O provedor compromete-se a manter os

comprovantes de relacionamento de serviço com a OpenAI por pelo

menos 36 meses e disponibilizá-los durante auditorias de conformidade.

3. Transparência de parâmetros de segurança: O provedor compromete-se a

não modificar o parâmetro moderation enviado pelo cliente; qualquer

ajuste requer notificação prévia por escrito.

4. Transmissão de códigos de erro: O provedor compromete-se a transmitir

ao cliente, sem alterações, todos os códigos de erro de violação de

segurança (safety violation) e de política (policy violation) da OpenAI.

5. Não retenção de dados: O provedor compromete-se a armazenar o comando

e a imagem apenas temporariamente durante o processamento, excluindo-os

em até N horas após a conclusão.

VI. Prática de integração do gpt-image-2: Exemplo de código mínimo de conformidade

Após a parte jurídica, vejamos um código mínimo executável com auditoria prévia, ajudando a equipe técnica a estabelecer uma base de conformidade rapidamente.

6.1 Código de chamada simplificado

# pip install openai

from openai import OpenAI

# Via proxy de conformidade (ex: APIYI apiyi.com), mantendo a chamada padrão do SDK da OpenAI

client = OpenAI(

api_key="sk-your-key",

base_url="https://api.apiyi.com/v1" # Substitua pelo endpoint do proxy de conformidade

)

response = client.images.generate(

model="gpt-image-2",

prompt="A modern minimalist office workspace, natural lighting",

size="1024x1024",

quality="high",

moderation="auto" # Valor padrão, mantém a proteção de indenização

)

print(response.data[0].url)

📦 Versão completa com auditoria dupla (clique para expandir)

import os

import logging

from openai import OpenAI

from openai import BadRequestError

# Substitua pelo seu endpoint de proxy de conformidade, usando a APIYI apiyi.com como exemplo

client = OpenAI(

api_key=os.environ["OPENAI_API_KEY"],

base_url="https://api.apiyi.com/v1"

)

def pre_check_prompt(prompt: str) -> bool:

"""

Auditoria prévia: Chamada de API de segurança de conteúdo local

Exemplo de placeholder, integre com segurança de conteúdo da Alibaba/Tencent Cloud

"""

forbidden_keywords = [

# Palavras-chave específicas da jurisdição

"líderes nacionais", "termos politicamente sensíveis",

# Palavras-chave de risco comercial

"nome de marca famosa + réplica", "logo de concorrente"

]

return not any(kw in prompt for kw in forbidden_keywords)

def post_check_image(image_url: str) -> bool:

"""

Auditoria posterior: Chamada de API de auditoria de imagem

Exemplo de placeholder, integre com serviço de segurança de conteúdo de imagem

"""

# Em ambiente real, chame a auditoria de imagem da Alibaba/Tencent Cloud

return True

def generate_compliant_image(prompt: str):

# Passo 1: Auditoria prévia

if not pre_check_prompt(prompt):

logging.warning("O comando não passou na auditoria prévia")

return None

# Passo 2: Invocação do modelo gpt-image-2

try:

response = client.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="high",

moderation="auto" # Deve manter o valor padrão para garantir a indenização

)

image_url = response.data[0].url

except BadRequestError as e:

# As violações de segurança da OpenAI serão transmitidas exatamente assim

logging.error(f"OpenAI recusou a geração: {e}")

return None

# Passo 3: Auditoria posterior

if not post_check_image(image_url):

logging.warning("A imagem não passou na auditoria posterior")

return None

return image_url

if __name__ == "__main__":

url = generate_compliant_image(

"A modern minimalist office workspace, natural lighting"

)

print(f"URL da imagem em conformidade: {url}")

6.2 Registro de logs em três níveis: Para auditoria jurídica

Um detalhe frequentemente negligenciado na integração de conformidade é a retenção de logs. Abaixo estão os três níveis de logs sugeridos:

[L1] Logs da camada de solicitação

- request_id, timestamp, user_id

- comando (anonimizado ou hash)

- valor do parâmetro moderation

[L2] Logs da camada de resposta

- status_code retornado pela OpenAI

- se houver safety_violations, registrar o tipo de erro

- url e hash da imagem gerada

[L3] Logs da camada de auditoria

- resultado de aprovação/rejeição da auditoria prévia

- resultado de aprovação/rejeição da auditoria posterior

- motivo da rejeição e palavras-chave detectadas

🎯 Sugestão de retenção de logs: Auditorias jurídicas geralmente exigem a retenção de pelo menos 6 a 12 meses de logs completos de invocação. A APIYI (apiyi.com) oferece recursos de consulta de logs em nível de solicitação para empresas, permitindo buscas por user_id, intervalo de tempo, tipo de erro, entre outros, facilitando a conformidade da sua empresa.

VII. Matriz de Nível de Risco do gpt-image-2: Prioridades de Conformidade por Cenário de Negócio

Nem todos os cenários de aplicação do gpt-image-2 exigem "conformidade máxima". Fornecer à equipe jurídica uma matriz de nível de risco ajuda as áreas de negócio a alocar recursos de conformidade de forma priorizada.

7.1 Matriz de Nível de Risco (baseada nas dimensões "Sensibilidade de Dados × Uso Comercial")

| Cenário de Negócio | Sensibilidade de Dados | Uso Comercial | Risco Geral | Nível de Conformidade Recomendado |

|---|---|---|---|---|

| Imagens internas para PPT | Baixa | Baixa (Uso interno) | 🟢 Baixo | Básico: Registro SCC |

| Materiais de marketing (sem rostos) | Baixa | Média (Publicação externa) | 🟡 Médio | Padrão: SCC + Auditoria de conteúdo geral |

| Imagens de produtos de e-commerce | Média | Alta (Venda direta) | 🟡 Médio | Padrão: SCC + Verificação de marca/IP |

| Geração de avatar (com rostos) | Alta | Média (Uso pelo usuário) | 🟠 Alto | Avançado: Certificação de proteção de dados + Consentimento explícito |

| Geração de imagem de celebridades | Alta | Qualquer | 🔴 Altíssimo | Não recomendado: Risco jurídico excessivo |

| Projetos governamentais/sociais | Alta | Baixa | 🟠 Alto | Avançado: Avaliação de segurança + Substituição nacional |

| Revenda SaaS | Média | Alta | 🟠 Alto | Avançado: Cadeia de conformidade completa + Acordo de usuário |

7.2 Escolhas de Caminho de Conformidade para Três Tipos Típicos de Empresas

Tipo A: Pequenas e Médias Empresas de Internet (menos de 100 funcionários)

Estratégia de conformidade: Pragmática

- Canal: Escolha um serviço proxy de API nacional com boa reputação

- Documentação: Registro de contrato padrão (SCC) é suficiente

- Auditoria de conteúdo: API de segurança de conteúdo da Alibaba Cloud/Tencent Cloud

- Logs: Retenção por 6 meses

- Orçamento: 50-100 mil / ano

Tipo B: Grandes Empresas / Empresas de Capital Aberto

Estratégia de conformidade: Rigorosa

- Canal: Priorize serviços proxy com qualificações (Xinchuang/Proteção de nível)

- Documentação: Contrato padrão + Certificação de proteção de dados + Manual de conformidade interno

- Auditoria de conteúdo: Auditoria de camada dupla + Verificações manuais aleatórias

- Logs: Retenção por 12 meses, auditáveis

- Orçamento: 300-500 mil / ano

Tipo C: Empresas Estatais / Projetos Governamentais

Estratégia de conformidade: Aversão ao risco

- Canal: Use apenas provedores certificados (Xinchuang), priorizando modelos nacionais

- Documentação: Avaliação de segurança da Administração do Ciberespaço

- Auditoria de conteúdo: Auditoria de três camadas (pré/inter/pós)

- Logs: 36 meses ou mais, trilha de auditoria completa

- Orçamento: 1 milhão+ / ano

7.3 Plano de Resposta a Emergências para Incidentes de Risco

Independentemente de quão boa seja a conformidade, é preciso ter um plano de contingência. Os incidentes de risco relacionados ao gpt-image-2 dividem-se principalmente em três categorias:

| Tipo de Incidente | Cenário de Gatilho | Resposta Imediata | Ação em até 7 dias |

|---|---|---|---|

| Reclamação de violação de IP | SAC recebe acusação de terceiros | Remover a imagem imediatamente | Iniciar processo de indenização da OpenAI |

| Vazamento de conteúdo ilegal | Notificação de órgãos reguladores | Suspender serviço, remover todo conteúdo gerado | Cooperar com investigação, enviar logs de invocação |

| Problema de conformidade no proxy | Provedor notificado / abandono | Alternar para endpoint de backup | Avaliar risco de dados existentes, notificar usuários |

| Ataque de injeção de comando | Usuário contorna templates para gerar conteúdo nocivo | Desativar temporariamente a função de entrada | Atualizar mecanismo de auditoria prévia |

🎯 Construção de Capacidade de Emergência: Uma resposta completa exige que o provedor de serviço proxy ofereça capacidade de "busca rápida de logs em nível de requisição". A APIYI (apiyi.com) fornece interfaces de log de nível empresarial, suportando busca em tempo real por

request_id,user_id, intervalo de tempo e tipo de erro, reduzindo significativamente o tempo de resposta em auditorias ou reclamações.

7.4 Equilíbrio entre Custo de Conformidade e Valor de Negócio

Do ponto de vista da tomada de decisão, vejamos a relação custo-benefício:

| Direção do Investimento | Custo Único | Custo Contínuo | Valor de Negócio |

|---|---|---|---|

| Escolher o canal de proxy correto | 0 | Próximo a 0 | ⭐⭐⭐⭐⭐ |

| Implantar auditoria de conteúdo dupla | 50-150 mil | 10-20 mil/mês | ⭐⭐⭐⭐⭐ |

| Registro de contrato SCC | 20-50 mil | 0 | ⭐⭐⭐⭐ |

| Certificação de proteção de dados | 100-300 mil | 0 | ⭐⭐⭐ |

| Avaliação de segurança | 500-1 milhão | 0 | ⭐⭐⭐ |

| Sistema completo de logs de auditoria | 50-100 mil | 10 mil/mês | ⭐⭐⭐⭐⭐ |

Conclusão: Escolher o canal de proxy correto é a decisão de conformidade com o maior ROI — o custo é quase zero, mas pode cobrir mais de 60% dos riscos de conformidade.

VIII. FAQ Jurídico sobre o gpt-image-2

Q1: Nossa empresa está na China, usar o gpt-image-2 diretamente será considerado "acesso ilegal a serviço estrangeiro"?

Não. As leis chinesas de Segurança Cibernética e Segurança de Dados não proíbem empresas de acessar APIs estrangeiras para fins comerciais. Os pontos reais de conformidade são: (a) se a transferência de dados para fora do país está em conformidade (se o comando contém informações pessoais); (b) se o provedor possui uma entidade legal na China. Ao acessar via um serviço proxy de API nacional, o caminho de transmissão de dados é processado conforme necessário, reduzindo drasticamente o atrito de conformidade.

Q2: O jurídico pergunta "se algo der errado, quem assume a responsabilidade?". Como responder?

Defina camada por camada conforme a cadeia contratual:

- OpenAI: Acusações de violação de propriedade intelectual de terceiros (sob premissa de uso conforme, via indenização).

- Provedor de serviço proxy: Conformidade do canal, autenticidade da chave API, precisão do faturamento.

- Empresa: Legalidade da entrada de conteúdo, conformidade do uso final, acordos com usuários.

- Usuário final: Conformidade do uso secundário (se você for um provedor SaaS).

As quatro camadas de responsabilidade devem ser acordadas claramente em contrato, em vez de assinar apenas um "acordo de serviço padrão".

Q3: gpt-image-2 vs gpt-image-1, o que mudou juridicamente?

Em termos de termos de API, não houve mudança — ambos seguem os mesmos Termos de Serviço e Políticas de Uso da OpenAI. Tecnicamente, o gpt-image-2 introduz o raciocínio agente, realizando mais planejamento prévio, o que significa que a filtragem de segurança de conteúdo será mais inteligente, porém mais rigorosa — alguns comandos que passavam no gpt-image-1 podem ser recusados no gpt-image-2. Recomenda-se que a equipe jurídica solicite um teste de regressão de comandos históricos.

Q4: Podemos registrar direitos autorais de imagens geradas pelo gpt-image-2?

Teoricamente é possível, mas a taxa de sucesso varia conforme a jurisdição:

- Escritório de Direitos Autorais dos EUA: Não aceita registro de conteúdo puramente gerado por IA.

- China: Algumas decisões judiciais reconhecem a "contribuição criativa do engenheiro de comando", mas depende de cada caso.

- União Europeia: Conservadora, tende a não proteger.

Sugestão prática: Se for um ativo de IP central (logo de marca, personagem), após o rascunho via gpt-image-2, certifique-se de que um designer faça uma criação secundária substancial para aumentar a chance de sucesso no registro.

Q5: Se o provedor de serviço proxy desaparecer, as imagens geradas ainda podem ser usadas?

Sim. A OpenAI atribuiu a propriedade das imagens ao "usuário que invocou a API" (ou seja, a empresa). Isso é um direito contratual, independente da existência do provedor. A condição é que você tenha salvo os logs completos de requisição/resposta como prova de direito.

Q6: A empresa precisa incluir o gpt-image-2 nos Termos de Serviço / Política de Privacidade?

Altamente recomendado. Divulgue três pontos:

- Seu produto usa o modelo gpt-image-2 da OpenAI para gerar imagens.

- O comando inserido pelo usuário será transmitido à OpenAI/provedor de proxy.

- O escopo de uso das imagens geradas (comercial/não comercial, exclusivo/não exclusivo).

A divulgação clara na política de privacidade é exigida pela lei chinesa de Proteção de Informações Pessoais e ajuda a empresa a alegar "consentimento informado" em caso de disputas.

Q7: Clientes governamentais/institucionais podem usar o gpt-image-2?

Sim, mas devem fazer duas coisas extras:

- Escolher um provedor de proxy com qualificações de "Xinchuang/Proteção de nível".

- Realizar desidentificação rigorosa do conteúdo do comando, nunca transmitindo informações confidenciais ou políticas.

Q8: Imagens geradas pelo gpt-image-2 precisam ser identificadas como "Geradas por IA"?

Altamente recomendado. O Artigo 12 das "Medidas Provisórias para a Gestão de Serviços de Inteligência Artificial Generativa" da China exige:

"Os provedores devem identificar conteúdos gerados, como imagens e vídeos, de acordo com as disposições de gestão de síntese profunda de serviços de informação na internet."

Existem duas formas:

- Identificação explícita: Inserir "Gerado por IA" no canto da imagem ou nos metadados.

- Marca d'água implícita: Adicionar marca d'água digital invisível na base da imagem.

Imagens do gpt-image-2 incorporam metadados C2PA por padrão, um padrão internacional de autenticação de origem. Ainda assim, a empresa deve realizar a identificação explícita conforme as leis locais.

Q9: Se o usuário fizer upload de imagem para i2i (imagem para imagem), como fica o direito autoral?

Este é um cenário comum do gpt-image-2 e requer atenção especial:

| Cenário | Direito autoral da imagem de entrada | Direito autoral da imagem de saída |

|---|---|---|

| Usuário envia foto própria | Original do usuário | Usuário (criação secundária) |

| Usuário envia obra de terceiros | Pertence a terceiros | Risco jurídico alto |

| Usuário envia foto com rosto de celebridade | Envolve direitos de imagem | Risco jurídico altíssimo |

Melhor prática: Exija nos Termos de Serviço que o usuário garanta a conformidade dos direitos autorais e de imagem das fotos enviadas e mantenha logs de atividade do usuário.

Q10: E se a OpenAI restringir repentinamente o acesso na China?

Historicamente, a OpenAI ajustou suas políticas de acesso na China algumas vezes. Provedores de serviço proxy nacionais em conformidade geralmente possuem nós no exterior e configurações de múltiplos endpoints, permitindo uma alternância transparente. Esta é uma das razões centrais para priorizar soluções de proxy em vez de conexão direta. Recomenda-se incluir uma cláusula de "SLA de alta disponibilidade de endpoint" ao contratar o provedor.

IX. Resumo: Os três julgamentos centrais para a conformidade legal do gpt-image-2

Voltando à questão inicial deste artigo. Se precisarmos responder às preocupações do departamento jurídico de uma empresa da forma mais concisa possível, bastam três pontos:

9.1 Três julgamentos centrais

✅ Julgamento 1: O uso comercial do gpt-image-2 não traz riscos jurídicos adicionais

Premissa: Utilizar o canal oficial + não contornar mecanismos de segurança + não utilizar para treinar modelos concorrentes

✅ Julgamento 2: A propriedade das imagens geradas pertence ao usuário corporativo que invoca a API

Nota: Propriedade não equivale a direitos autorais completos; para ativos de IP essenciais, recomenda-se a criação secundária por humanos

✅ Julgamento 3: A empresa tem a obrigação de realizar uma "verificação de conteúdo prévia"

Motivo: A OpenAI realiza apenas filtragem genérica; riscos específicos da jurisdição são de responsabilidade da própria empresa

9.2 Três recomendações de ação para o departamento jurídico corporativo

- Estabeleça uma lista de verificação de due diligence para o serviço proxy de API: Deve incluir, no mínimo, três questões centrais: tipo de canal, qualificação da entidade e retenção de dados.

- Estabeleça um mecanismo de segurança de conteúdo em duas camadas: Filtragem de segurança da OpenAI + API de segurança de conteúdo nacional, garantindo a cobertura de riscos específicos da jurisdição.

- Estabeleça um sistema completo de logs de invocação: Mantenha pelo menos 12 meses de logs de solicitação/resposta/auditoria para fins de conformidade.

9.3 Recomendações de melhores práticas

🎯 Recomendação geral: O

gpt-image-2é totalmente seguro para uso em cenários corporativos; o segredo está em escolher a forma correta de acesso e implementar mecanismos de conformidade adequados. Recomendamos que as empresas acessem através de plataformas de serviço proxy de API como a APIYI (apiyi.com), que possui uma cadeia de conformidade completa. Esta plataforma suporta emissão de notas fiscais corporativas, fornece logs de invocação completos e transmite fielmente os códigos de erro de segurança, atendendo aos padrões de verificação da maioria das equipes jurídicas.

A conformidade não serve para impedir o negócio, mas para colocar os riscos sobre a mesa. Quando você apresenta à equipe jurídica um plano completo com "comprovante de conformidade de canal + segurança de conteúdo em duas camadas + 12 meses de logs de auditoria", a aprovação para o uso do gpt-image-2 geralmente ocorre de forma muito fluida.

O gpt-image-2 é um dos modelos de geração de imagens mais poderosos da OpenAI atualmente, com excelente desempenho em resolução 2K, renderização de texto e composições complexas. Ao fazer o dever de casa sobre conformidade legal, o caminho para a iteração do produto e a comercialização será muito mais tranquilo.

Uma última frase para as equipes jurídicas corporativas: "O objetivo da revisão de conformidade não é dizer 'não', mas pensar claramente em 'como usar com segurança'." Esperamos que este artigo sirva como ponto de partida para a sua decisão sobre "usar ou não usar o gpt-image-2".

Caso encontre problemas específicos durante o processo de revisão de conformidade — como listas de verificação de qualificação de fornecedores, modelos de contrato SCC ou seleção de API de verificação de conteúdo — estes são tópicos que podem ser abordados individualmente, e publicaremos guias práticos correspondentes em breve.

Autor: Equipe APIYI — Plataforma de acesso a API de Modelo de Linguagem Grande para empresas, apiyi.com, com suporte a gpt-image-2, Claude 4.7, Gemini 3 Pro e mais de 200 modelos principais, atendendo às necessidades de acesso em conformidade de empresas listadas, estatais e corporações transnacionais.

Termos de referência: Termos de Uso da OpenAI, Termos de Serviço da OpenAI, Políticas de Uso da OpenAI, Política de Indenização da OpenAI. Este artigo não constitui aconselhamento jurídico; para decisões específicas de conformidade, consulte o departamento jurídico da sua empresa ou um advogado especializado.