title: "Adeus Sora-2: Guia de Migração e Alternativas para a Descontinuação da API"

description: "A API do Sora-2 será encerrada em 24 de setembro de 2026. Confira o cronograma, o impacto e as melhores alternativas (SeeDance 2.0 e Wan 2.7) para manter seu negócio funcionando."

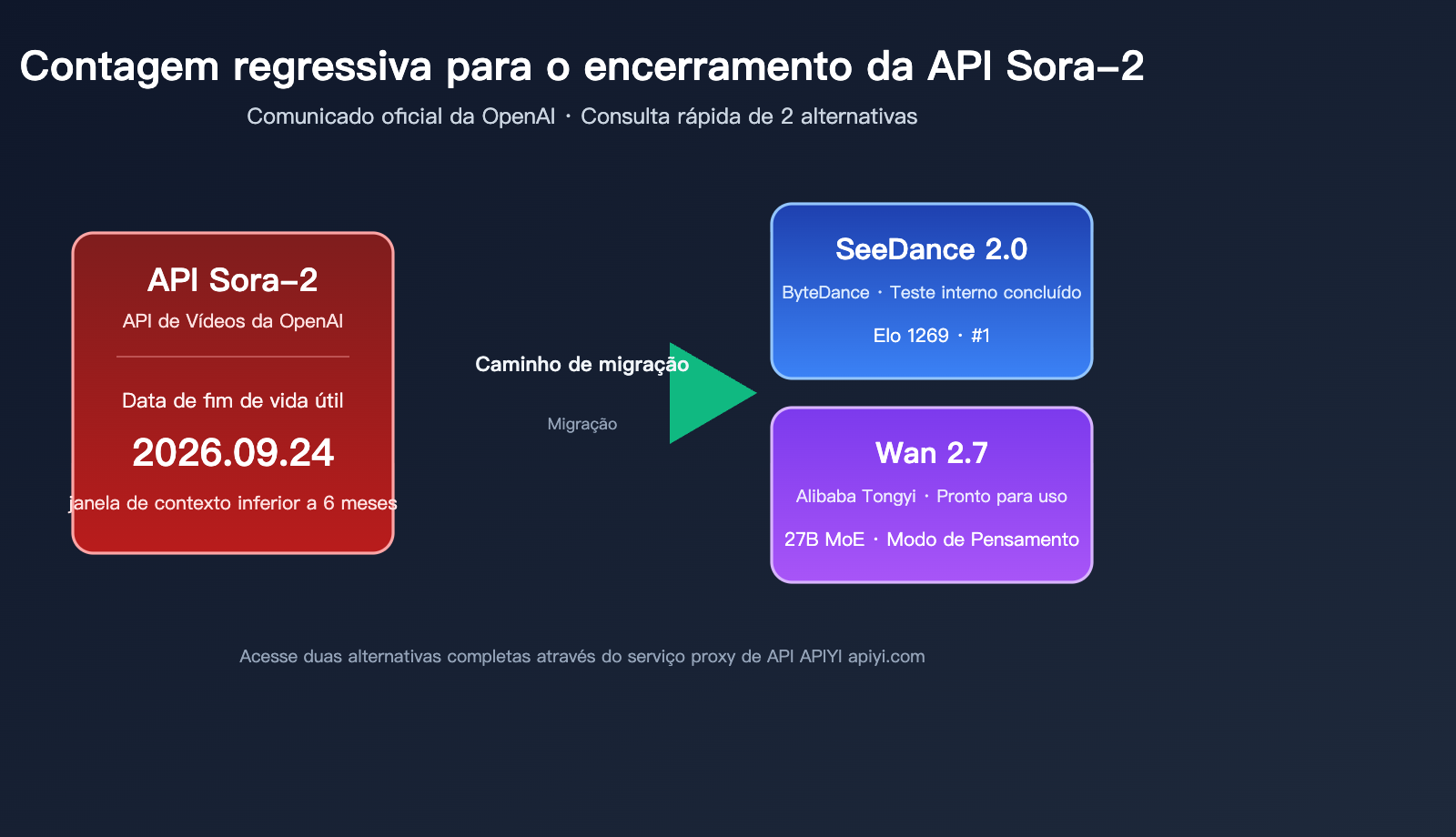

A OpenAI anunciou oficialmente em 24 de março de 2026, por meio de um comunicado aos desenvolvedores: a data de encerramento da API Sora-2 foi definida para 24 de setembro de 2026. Isso significa que todos os serviços de geração de vídeo que dependem de sora-2, sora-2-pro e da API de Vídeos precisam concluir a migração em menos de seis meses.

Vale um alerta: as chamadas "APIs Sora reversas" que circularam no mercado nos últimos meses tornaram-se praticamente inúteis após a OpenAI endurecer o controle de riscos. Continuar apostando nisso só trará problemas para o seu negócio. Este artigo detalha o cronograma de encerramento da API Sora-2, o impacto oficial e recomenda duas alternativas prontas para produção baseadas em testes reais: SeeDance 2.0 da ByteDance e Wan 2.7 da Alibaba Tongyi.

Se você utiliza a API Sora-2 para produção de conteúdo em vídeo, recomendo comparar e testar o SeeDance 2.0 e o Wan 2.7 através da plataforma APIYI (apiyi.com). A plataforma já integra diversos modelos de geração de vídeo líderes de mercado, o que pode reduzir drasticamente o custo da sua migração.

Cronograma de encerramento da API Sora-2 e impacto

Datas oficiais de encerramento da API Sora-2

A OpenAI adotou uma estratégia de encerramento em duas fases para o Sora: primeiro o encerramento das aplicações para o consumidor final (C-end) e, posteriormente, da API para empresas (B-end), deixando um período de carência de cerca de 5 meses para os desenvolvedores. Embora seja uma das transições mais organizadas da história da OpenAI, o prazo para os desenvolvedores continua bastante apertado.

| Data | Evento | Impacto | Período de carência |

|---|---|---|---|

| 24/03/2026 | Aviso oficial | Todos os usuários da API Sora-2 | T+0 |

| 26/04/2026 | Encerramento do site e App Sora | Usuários finais e criadores | T+33 dias |

| 24/09/2026 | Encerramento oficial da API Sora-2 | Todos os serviços integrados via API | T+184 dias |

| Após 25/09/2026 | Erro 410 Gone na API | Interrupção total dos serviços | — |

A OpenAI recomenda na sua central de ajuda: se você deseja manter o conteúdo em vídeo gerado anteriormente no Sora, certifique-se de exportar os dados antes do fechamento do App em 26 de abril. No entanto, para desenvolvedores integrados via API, o prazo final é 24 de setembro.

Vale ressaltar que a OpenAI não sinalizou qualquer possibilidade de "adiamento". Com base no histórico de encerramentos de modelos desde 2025, o encerramento na data limite tornou-se o padrão, portanto, não conte com exceções.

Lista de modelos afetados pelo encerramento da API Sora-2

Muitas equipes acreditam que apenas o alias sora-2 será descontinuado, mas, na verdade, esta é uma desativação completa de toda a linha de APIs de Vídeo:

| ID do Modelo | Tipo | Status | Sugestão de substituição |

|---|---|---|---|

sora-2 |

Alias padrão | Descontinuado | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

Alias HD | Descontinuado | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

Snapshot padrão | Descontinuado | SeeDance 2.0 |

sora-2-2025-12-08 |

Snapshot padrão | Descontinuado | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

Snapshot Pro | Descontinuado | Wan 2.7 (inclui Thinking Mode) |

| API de Vídeos (conjunto) | Endpoints da API | Desativação total | Plataformas agregadoras |

Em resumo, a OpenAI não manterá nenhum ponto de entrada para a API de geração de vídeo. A partir de 25 de setembro, todas as solicitações com o prefixo videos retornarão o erro 410 Gone. Isso é diferente de práticas anteriores, onde a OpenAI descontinuava apenas snapshots, mas mantinha os aliases.

🎯 Informação chave: Isso significa que você não pode simplesmente "trocar o nome do modelo" para concluir a migração; é necessário migrar para uma API de geração de vídeo totalmente diferente. Sugiro concluir os testes de integração até o final de junho, utilizando plataformas agregadoras para comparar o SeeDance 2.0 e o Wan 2.7, evitando a correria nos últimos dois meses.

O verdadeiro motivo do encerramento da API Sora-2

Embora a OpenAI não tenha dado explicações detalhadas, análises de veículos como The Decoder, Futurum Group e Wikipedia apontam três motivos principais:

- Custos de processamento insustentáveis: A geração de vídeo consome dezenas de vezes mais tempo de GPU do que modelos de texto, e a receita comercial não cobria os custos. Após o lançamento do Sora-2, a OpenAI teve que limitar rigorosamente as cotas por usuário, o que inibiu a vontade de integração dos desenvolvedores.

- Riscos elevados de segurança de conteúdo: Mesmo com marcas d'água e moderação, o Sora ainda gerava controvérsias sobre deepfakes e direitos autorais, com custos jurídicos e de conformidade superando o valor do próprio modelo.

- Foco estratégico: A OpenAI está priorizando seu poder computacional para a linha GPT, Operator e negócios de agentes; vídeo, por enquanto, não é uma prioridade central.

Entender esses motivos é crucial para escolher uma alternativa. As empresas que continuam investindo em geração de vídeo são aquelas que tratam essa tecnologia como um pilar estratégico. ByteDance e Alibaba veem a geração de vídeo como uma direção estratégica fundamental, o que faz com que o ritmo de iteração de seus produtos seja muito mais rápido que o da OpenAI, sendo essa a razão pela qual elas estão prontas para absorver a base de usuários do Sora-2 em 2026.

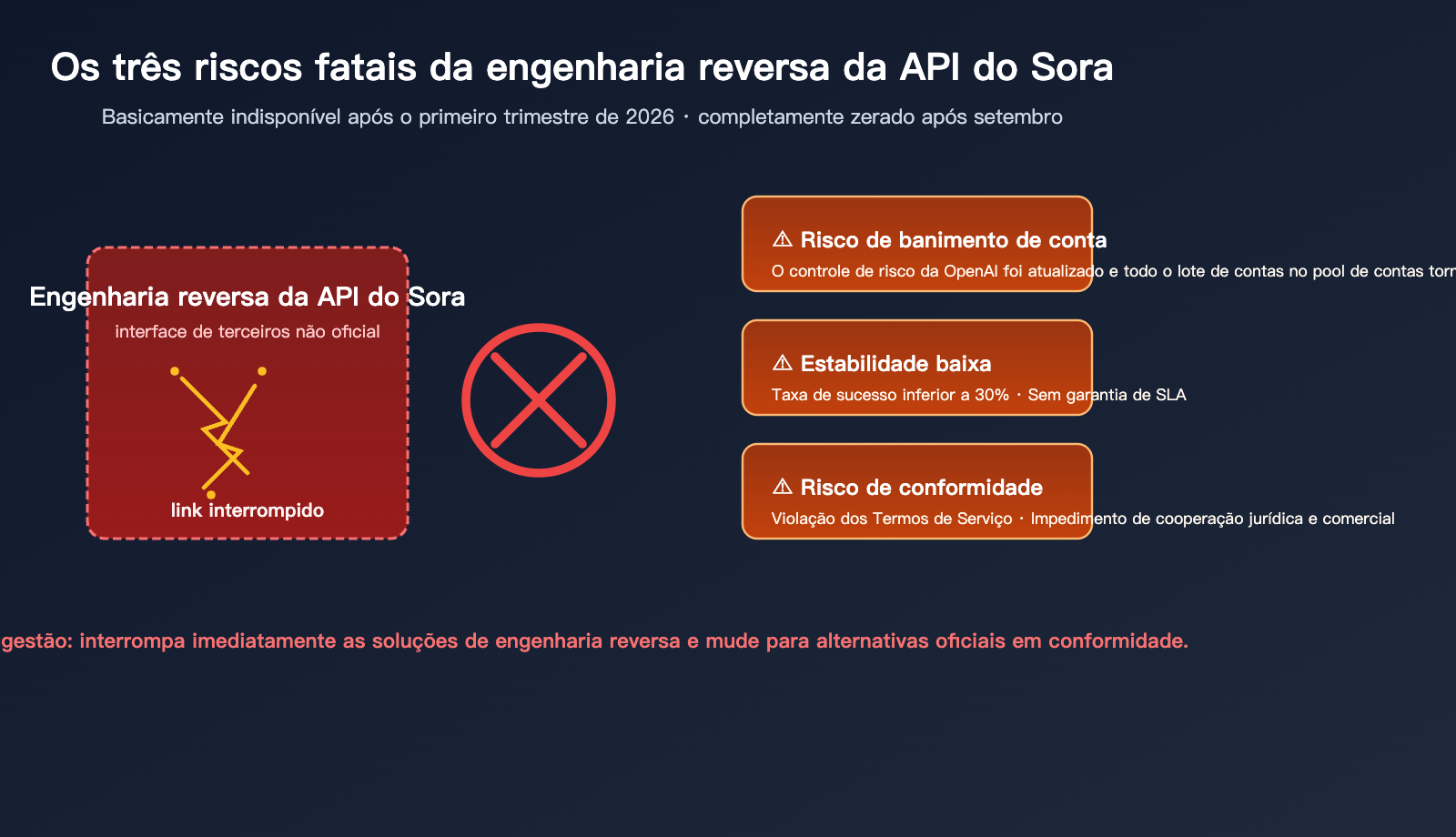

Por que a "API reversa do Sora" não é mais uma opção viável

O status atual da API reversa do Sora em 2026

No último semestre, circularam na comunidade chinesa várias interfaces reversas que prometiam "invocação do modelo Sora-2 sem precisar de uma conta OpenAI", com preços variando de uma fração a um décimo do custo oficial. No entanto, de acordo com o feedback de várias comunidades de desenvolvedores, essas interfaces tornaram-se basicamente inutilizáveis após o primeiro trimestre de 2026:

- Em janeiro de 2026, a OpenAI atualizou as regras de controle de risco da Cloudflare, fazendo com que um grande número de interfaces reversas retornasse erro 403.

- Alguns provedores de serviços reversos utilizam pools de contas, mas a OpenAI intensificou o banimento de contas anômalas em massa, levando à falha de todo o pool.

- Mesmo quando funcionam ocasionalmente, a velocidade de geração é extremamente lenta e a taxa de sucesso é inferior a 30%, tornando-as inviáveis para produção.

- Cada vez mais provedores de serviços reversos estão "desaparecendo" ou mudando de ramo, deixando os usuários com risco de perder saldos pré-pagos.

Mais importante ainda: como a OpenAI decidiu descontinuar a API oficial em 24 de setembro, o "upstream" dessas interfaces reversas desaparecerá completamente. Este caminho chegará a zero após setembro.

3 razões para não continuar investindo em soluções reversas

| Dimensão de Risco | Manifestação Específica | Consequência de Negócio |

|---|---|---|

| Risco de Estabilidade | Interface bloqueada a qualquer momento, sem SLA | Interrupção constante no ambiente de produção |

| Risco de Conformidade | Violação dos Termos de Serviço da OpenAI, possível envolvimento com venda de contas | Bloqueio de parcerias jurídicas e comerciais |

| Custos Irrecuperáveis | Descontinuação oficial após setembro, tornando a reversa inútil | Desperdício de recursos com nova migração |

| Risco de Dados | Agentes terceiros podem acessar seus comandos e conteúdos gerados | Vazamento de segredos comerciais |

⚠️ Recomendação forte: Se sua equipe ainda utiliza qualquer forma de API reversa do Sora, pare imediatamente o desenvolvimento de novas funcionalidades e priorize a avaliação de alternativas oficiais e em conformidade. Recomendamos a integração direta via plataformas agregadoras compatíveis com SeeDance 2.0 ou Wan 2.7, garantindo a estabilidade do serviço e evitando problemas com auditorias de conformidade.

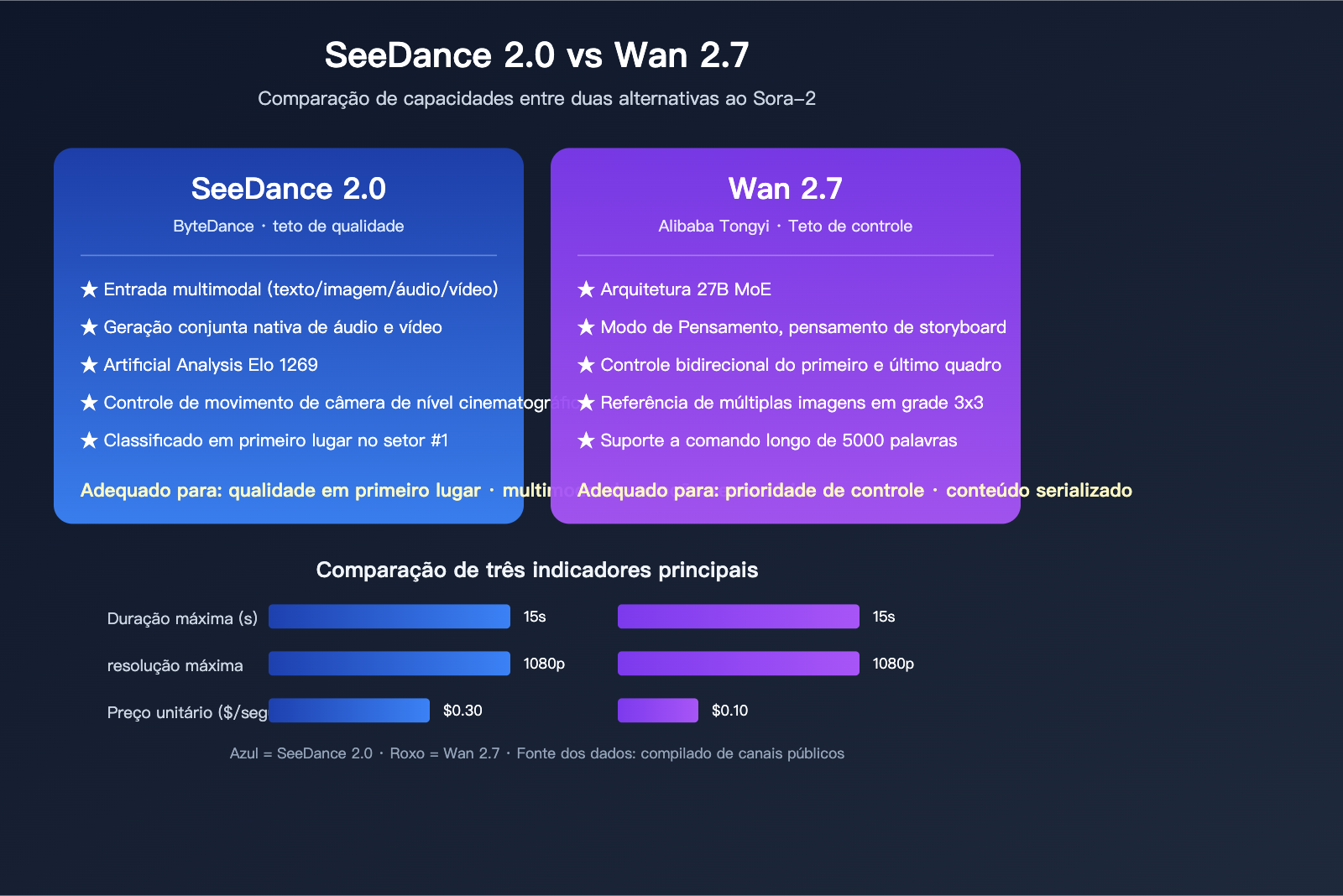

Alternativa à API Sora-2: SeeDance 2.0

Posicionamento principal do SeeDance 2.0

O SeeDance 2.0 é o modelo de geração de vídeo carro-chefe da equipe de Modelos de Linguagem Grande Doubao da ByteDance, lançado oficialmente em 9 de fevereiro de 2026. Em 14 de abril, entrou em teste público na plataforma BytePlus ModelArk, e desde 9 de abril está disponível para invocação na plataforma fal. No ranking de modelos de vídeo da Artificial Analysis, o SeeDance 2.0 alcançou um Elo de 1269, superando o Google Veo 3, o OpenAI Sora 2 e o Runway Gen-4.5, ocupando o primeiro lugar nos rankings públicos atuais.

Seu maior diferencial é a adoção de uma arquitetura unificada de geração multimodal de áudio e vídeo — não é necessário gerar o vídeo primeiro para depois adicionar o áudio; ele produz até 15 segundos de conteúdo audiovisual de qualidade cinematográfica em uma única inferência. Essa capacidade de "origem única para áudio e imagem" é algo que o Sora-2, que precisa gerar o vídeo e depois acoplar um TTS, não consegue igualar.

Visão geral das capacidades do SeeDance 2.0

| Dimensão de Capacidade | Desempenho do SeeDance 2.0 | Comparação com Sora-2 |

|---|---|---|

| Duração máxima por vez | 15 segundos | Empate |

| Áudio sincronizado | Geração nativa de áudio e vídeo | Sora-2 requer TTS externo |

| Modalidades de entrada | Texto / Imagem / Áudio / Vídeo | Sora-2 apenas texto+imagem |

| Controle de câmera | Comandos de direção cinematográfica | Sora-2 mais limitado |

| Realismo físico | Líder do setor | Empate |

| Elo Artificial Analysis | 1269 (#1) | ~1180 |

| Canais públicos de invocação | BytePlus ModelArk / fal / Plataformas agregadoras | Oficial OpenAI (será descontinuado) |

| Compreensão de comando em chinês | Excelente | Regular |

O SeeDance 2.0 já está disponível para testes internos através da plataforma APIYI (apiyi.com). Se você está procurando uma alternativa para o Sora-2, entre em contato com o suporte da plataforma para liberar uma cota de teste do SeeDance 2.0, utilizando o protocolo compatível com OpenAI para a invocação.

Exemplo de invocação do SeeDance 2.0

Abaixo está um exemplo simples de como invocar o SeeDance 2.0 usando a interface compatível com OpenAI:

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="seedance-2.0",

prompt="Um gato laranja pula do parapeito da janela para o sofá, o pôr do sol entra pelas persianas, a câmera segue o gatinho com um movimento lento",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 Exemplo completo de invocação (incluindo tratamento de exceções e polling)

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"Falha na tarefa: {status.error}")

time.sleep(5)

except Exception as e:

print(f"Exceção na invocação: {e}")

return None

url = generate_seedance_video(

prompt="Um ônibus retrô vermelho de dois andares passa pelas ruas de Londres após a chuva, o reflexo das luzes da rua aparece nas janelas",

duration=12

)

print(url)

Cenários de aplicação do SeeDance 2.0

- Vídeos curtos de marca: Áudio nativo sincronizado + movimentos de câmera cinematográficos, ideal para anúncios e materiais de marca.

- Criação multimodal: Suporte para áudio e vídeo como referência de entrada, ideal para derivados de conteúdo IP.

- Consistência facial: Excelente capacidade de referência multimodal, ideal para produção de conteúdo em série.

- Distribuição em redes sociais internacionais: Saída nativa em múltiplas proporções (16:9 / 9:16 / 1:1), adaptando-se diretamente ao TikTok, YouTube e Instagram.

- MV de música: A geração unificada de áudio e vídeo permite que a imagem e o ritmo da música fiquem naturalmente alinhados.

Alternativa à API Sora-2 2: Wan 2.7

Posicionamento principal do Wan 2.7

O Wan 2.7 é um Modelo de Linguagem Grande de geração de vídeo de nova geração lançado pelo laboratório Tongyi da Alibaba em março de 2026. Ele é baseado em uma arquitetura MoE (Mixture-of-Experts) de 27B de parâmetros e utiliza a rota técnica Diffusion Transformer + Flow Matching. Já disponível através das plataformas Alibaba Cloud DashScope e WaveSpeedAI, é atualmente o primeiro modelo de vídeo MoE de um fabricante chinês com API pública.

Diferente do SeeDance 2.0, que foca na fusão multimodal, os dois grandes diferenciais do Wan 2.7 são: Thinking Mode (Modo de Pensamento) e controle preciso do primeiro e último quadro — ele pode "pensar" na estrutura da cena antes de gerar o vídeo, além de permitir especificar quadros-chave de início e fim, capacidades que a atual API Sora-2 não possui.

Visão geral das capacidades do Wan 2.7

| Dimensão de capacidade | Desempenho do Wan 2.7 | Comparação com Sora-2 |

|---|---|---|

| Arquitetura do modelo | 27B MoE | Não divulgado |

| Duração máxima única | 15 segundos | Equivalente |

| Resolução máxima | 1080p | Equivalente |

| Thinking Mode | ✅ Suporta pensamento de cena | ❌ Não suporta |

| Controle de quadros | ✅ Especifica início e fim | ❌ Apenas início |

| Imagem de referência 3×3 | ✅ Até 9 imagens | ❌ Não suporta |

| Referência de sujeito+voz | ✅ Suporta referência combinada | ❌ Não suporta |

| Limite de caracteres do comando | 5000 caracteres | ~1000 caracteres |

| Canais de invocação pública | Alibaba Cloud DashScope / WaveSpeedAI / Plataformas agregadoras | Oficial OpenAI (será descontinuado) |

| Preço unitário de referência | A partir de $0.10/s | A partir de $0.50/s |

🎯 Sugestão de cenário: Se o seu projeto de geração de vídeo exige requisitos claros para as cenas de início e fim (como vinhetas de marca ou contagens regressivas publicitárias), a capacidade de controle de quadros do Wan 2.7 é algo que a Sora-2 não consegue substituir. Recomendamos invocar o Wan 2.7 diretamente via plataformas agregadoras, sem a necessidade de lidar com o SDK e o mecanismo de assinatura da Alibaba Cloud.

Exemplo de invocação do Wan 2.7

from openai import OpenAI

# Usando o serviço proxy de API da APIYI

client = OpenAI(

api_key="sua-chave-api",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="Rua neon em estilo cyberpunk, a câmera sobe lentamente do chão até uma visão aérea da cidade",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 Exemplo completo de referência com múltiplas imagens no Wan 2.7 (Entrada 3×3 + Thinking Mode)

from openai import OpenAI

client = OpenAI(

api_key="sua-chave-api",

base_url="https://api.apiyi.com/v1"

)

# Lista de 9 imagens de referência

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"O protagonista atravessa 9 cenas diferentes,"

"cada cena corresponde a uma das imagens de referência,"

"mantendo a consistência facial e do vestuário durante todo o vídeo"

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

Cenários de aplicação do Wan 2.7

- Vinhetas de marca: Controle preciso do início e fim, sem necessidade de alinhamento na pós-produção.

- Séries com consistência de personagem: Uso de imagens de referência 3×3 para garantir que o personagem não mude entre diferentes ângulos.

- Cenas complexas: O Thinking Mode planeja automaticamente a estrutura da cena, ideal para curtas e publicidade.

- Edição baseada em comandos: Suporta edição de vídeos existentes através de comandos em linguagem natural.

- Narrativa 3×3: Geração de vídeos narrativos coerentes a partir de múltiplas imagens-chave.

Comparativo Completo: SeeDance 2.0 vs Wan 2.7 vs Sora-2

Comparativo dos principais indicadores dos três modelos

| Dimensão de Comparação | Sora-2 (Descontinuado) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| Fabricante | OpenAI | ByteDance | Alibaba Tongyi |

| Data de Lançamento | 10/2025 | 09/02/2026 | 03/2026 |

| Status do Serviço | Desativado em 24/09/2026 | Beta Aberto | Beta Aberto |

| Duração Máxima | 15s | 15s | 15s |

| Resolução Máxima | 1080p | 1080p | 1080p |

| Áudio Nativo | ✅ | ✅ (Geração conjunta) | ✅ |

| Entrada Multimodal | Texto+Imagem | Texto+Imagem+Áudio+Vídeo | Texto+Múltiplas Ref. |

| Controle de Frame Inicial/Final | ❌ | ❌ | ✅ Bidirecional |

| Thinking Mode | ❌ | ❌ | ✅ |

| Artificial Analysis Elo | ~1180 | 1269 (#1) | Ainda não listado |

| Suporte a Chinês | Médio | Excelente | Excelente |

| Conformidade Local | ❌ | ✅ | ✅ |

| Preço de Referência | $0.50/seg | $0.30/seg | A partir de $0.10/seg |

Sugestões de seleção por cenário

| Cenário de Negócio | Solução Recomendada | Motivo |

|---|---|---|

| Vídeos curtos de publicidade | SeeDance 2.0 | Áudio sincronizado + movimentos de câmera cinematográficos |

| Dramas curtos/Séries | Wan 2.7 | Referência em grade 3×3 garante consistência facial |

| Aberturas/Encerramentos | Wan 2.7 | Controle preciso de frames inicial e final |

| Criação Multimodal | SeeDance 2.0 | Suporta entrada de referência de áudio e vídeo |

| Geração via texto em chinês | Ambos | Compreensão superior ao Sora-2 |

| Foco em qualidade máxima | SeeDance 2.0 | Primeiro lugar no Artificial Analysis |

| Sensível a custos/Volume | Wan 2.7 | A partir de $0.10/seg, vantagem clara de preço |

| Redes sociais internacionais | SeeDance 2.0 | Saída nativa em múltiplas proporções |

| Vídeos de e-commerce | Wan 2.7 | Referência de objeto garante consistência do produto |

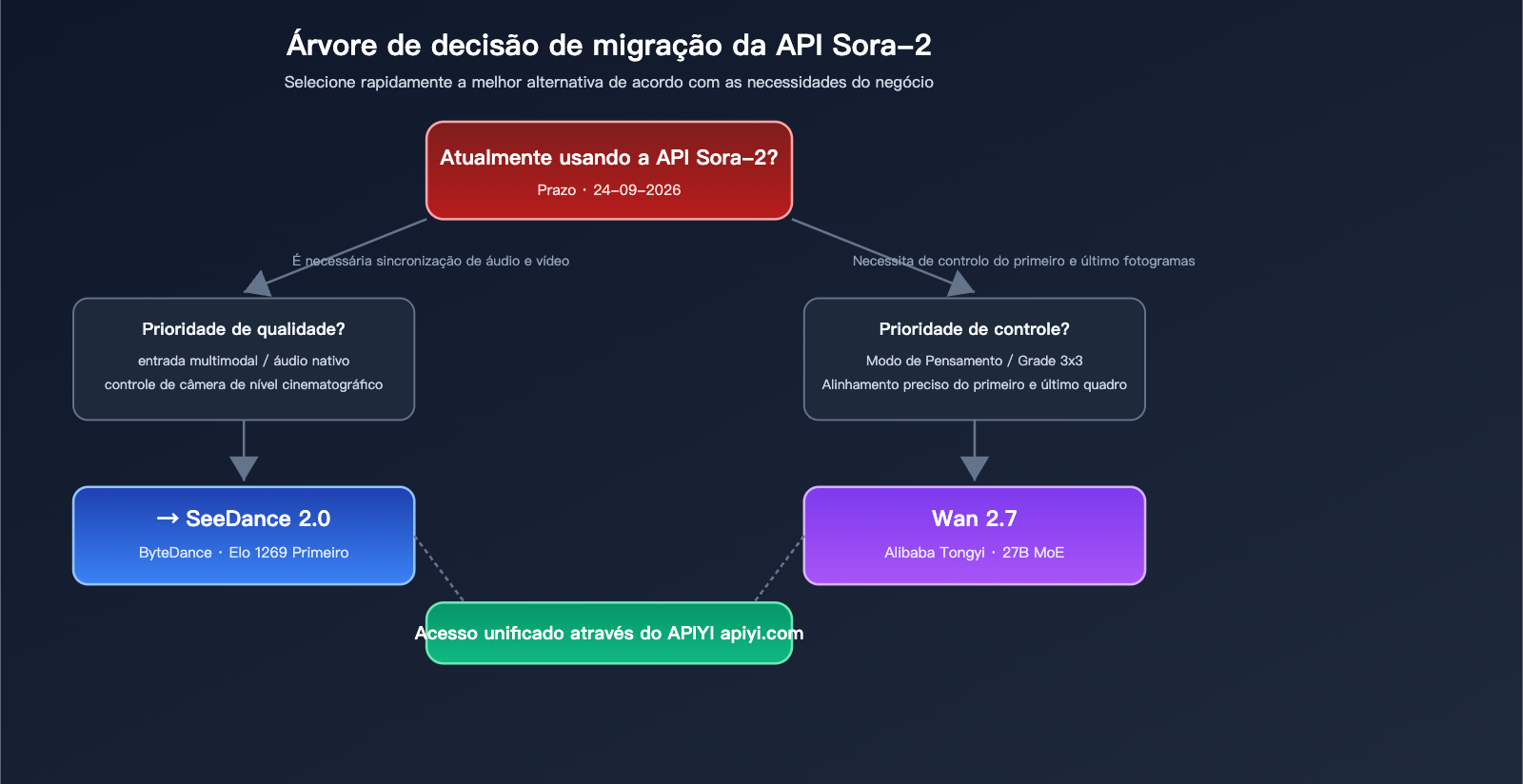

💡 Dica de escolha: Se você só puder escolher um no curto prazo, o SeeDance 2.0 é ideal para cenários de "foco em qualidade", enquanto o Wan 2.7 é melhor para "foco em controle" e "foco em custo". Recomendamos habilitar a invocação de ambos os modelos em uma plataforma agregadora para roteamento dinâmico, garantindo máxima flexibilidade durante a migração.

Estimativa de custos dos três modelos (Vídeo 10s 1080p)

| Modelo | Custo por execução | Custo mensal (10k execuções) | Observação |

|---|---|---|---|

| Sora-2 | ~$5.00 | ~$50,000 | Indisponível após setembro |

| SeeDance 2.0 | ~$3.00 | ~$30,000 | Inclui áudio nativo |

| Wan 2.7 | ~$1.00 | ~$10,000 | Preço de entrada |

Nota: Dados compilados de fontes públicas; preços reais sujeitos às tabelas oficiais dos fabricantes. O uso via plataformas agregadoras costuma oferecer descontos extras em relação a contas diretas.

Guia rápido: Migrando a API do Sora-2 para alternativas

Árvore de decisão para migração

A migração da API do Sora-2 pode ser dividida em 4 etapas:

- Inventário de invocações: Identifique todos os pontos do código que chamam

sora-2ou a API de vídeos, listando modelos de comando, parâmetros de entrada e lógica de tratamento de saída. - Seleção do modelo: Com base nas sugestões acima, defina o modelo principal.

- Substituição de base_url e nome do modelo: Troque a

base_urlda OpenAI pela da plataforma agregadora (ex:https://api.apiyi.com/v1) e atualize o nome do modelo paraseedance-2.0ouwan-2.7. - Testes de regressão: Execute o fluxo completo com um conjunto de comandos representativos para comparar a qualidade e a latência.

Acesso unificado via plataforma agregadora

from openai import OpenAI

# Configuração usando o serviço proxy de API da APIYI

client = OpenAI(

api_key="sua-chave-api",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

# Alterna entre os modelos conforme a preferência

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

video_a = generate_video("Anúncio de produto: caixa de som inteligente tocando música", prefer="seedance")

video_b = generate_video("Abertura de marca: logo surgindo de um brilho", prefer="wan")

A vantagem dessa abordagem é usar um SDK, uma chave API e uma base_url para acessar ambos os modelos. Após o desligamento do Sora-2 em 24 de setembro, bastará alterar o parâmetro model no código, sem necessidade de refatoração estrutural.

Checklist de migração (Recomendado imprimir)

| Fase | Tarefa | Tempo estimado |

|---|---|---|

| Inventário | Listar todos os pontos de entrada do Sora-2 | 0.5 dia |

| Inventário | Organizar 50-100 comandos representativos | 1 dia |

| Acesso | Solicitar conta e cotas na plataforma agregadora | 0.5 dia |

| Acesso | Ajustar base_url e campos de modelo | 1 dia |

| Teste | Executar conjunto de testes de regressão | 2-3 dias |

| Teste | Avaliação cega de qualidade por design/produto | 1 semana |

| Gradual | Migrar 10%-30% do tráfego | 1 semana |

| Gradual | Migrar para 100% do tráfego | — |

| Finalização | Desativar código de chamada do Sora-2 | 0.5 dia |

Seguindo esse cronograma, você conclui a migração em 4-6 semanas, garantindo uma margem de segurança antes do prazo final de 24 de setembro.

🎯 Dica de migração: Não espere até setembro para testar. Abra sua conta na plataforma agora, clone o código existente e aponte para

https://api.apiyi.com/v1. Isso permite rodar experimentos comparativos com dados reais de negócio para tomar a decisão final.

Controle de custos durante a migração

A geração de vídeo é significativamente mais cara que modelos de texto. Para evitar surpresas na fatura:

- Estratégia de degradação: Teste com vídeos de 720p/5s antes de subir para 1080p/15s.

- Cache de reuso: Utilize cache baseado em hash para comandos e parâmetros idênticos.

- Faturamento agregado: Evite taxas mínimas de várias contas usando uma plataforma centralizada.

- Geração em lote: Utilize o modo batch dos fabricantes para processamento noturno, com descontos de 30%-50%.

- Otimização de comando: Comandos mais precisos reduzem a necessidade de novas gerações, economizando 20%-40%.

Problemas comuns e soluções

| Problema | Causa | Solução |

|---|---|---|

| Proporção de saída inconsistente | aspect_ratio padrão diferente |

Especifique explicitamente o parâmetro |

| Limite de duração | Diferentes formas de cobrança | Especifique duration conforme necessário |

| Áudio ausente | Interfaces de áudio distintas | Ative explicitamente audio=True |

| Desvio de estilo no comando | Preferências de modelo diferentes | Otimize o comando para cada modelo |

| Diferença no callback | Alguns suportam apenas polling | Use o webhook da plataforma agregadora |

FAQ: Perguntas Frequentes sobre o encerramento da API do Sora-2

Q1: Após o encerramento da API do Sora-2, os vídeos já gerados ainda poderão ser usados?

Sim. Os arquivos de vídeo, uma vez baixados localmente ou para um OSS, não são afetados pelo encerramento da API. No entanto, se você estiver referenciando diretamente o video_url retornado pela OpenAI, esses links deixarão de funcionar após o encerramento. Certifique-se de transferir todos os vídeos para o seu próprio armazenamento de objetos antes de 24 de setembro. Se o volume de transferência for grande, você pode usar a capacidade de proxy de vídeo da plataforma APIYI (apiyi.com), que gerencia automaticamente o controle de concorrência e as tentativas de falha.

Q2: A OpenAI lançará uma API do Sora-3 futuramente?

A OpenAI não forneceu um cronograma para o Sora-3. Do ponto de vista estratégico, a OpenAI está priorizando o poder computacional para a linha principal do GPT e para negócios de agentes, portanto, a possibilidade de reiniciar a API de geração de vídeos a curto prazo é baixa. Análises da Wikipedia e do Futurum Group também apontam que a falta de resultados comerciais esperados do Sora foi a causa principal deste encerramento. Recomendamos não basear seu planejamento de negócios na ideia de que "talvez o Sora-3 volte"; é essencial concluir a migração para o SeeDance 2.0 ou Wan 2.7.

Q3: O SeeDance 2.0 e o Wan 2.7 podem ser invocados de forma estável na China continental?

Sim. Ambos os modelos são operados pela ByteDance e pelo Alibaba, respectivamente, com nós de serviço localizados na China, oferecendo uma estabilidade de rede muito superior às invocações transfronteiriças da OpenAI. Se você precisava usar proxies ou servidores estrangeiros para o Sora-2, ao migrar para esses modelos, sua arquitetura de rede pode ser simplificada. A invocação direta através de plataformas de agregação compatíveis com as normas locais resolve os problemas de estabilidade e de conformidade fiscal de uma só vez.

Q4: A engenharia reversa da API do Sora ainda tem algum valor de transição?

Não recomendamos. A estabilidade das APIs via engenharia reversa caiu drasticamente após o primeiro trimestre de 2026 e, com o desaparecimento da fonte oficial após setembro, essas interfaces deixarão de existir completamente. Continuar investindo em soluções de engenharia reversa é adicionar novo código a uma pilha tecnológica que já se sabe que será descartada, o que apenas aumentará o custo da migração. A abordagem mais econômica é migrar diretamente para o SeeDance 2.0 ou Wan 2.7.

Q5: Como avaliar a eficácia real das alternativas durante a migração?

Recomendamos estabelecer uma avaliação tridimensional: qualidade visual (pontuação subjetiva), aderência ao comando (comparação objetiva) e custo unitário (cálculo financeiro). A prática recomendada é extrair 50 comandos representativos das invocações históricas do Sora-2, executá-los novamente no SeeDance 2.0 e no Wan 2.7 e realizar uma avaliação cega pela equipe de produto. Sugerimos usar uma plataforma de agregação para testes comparativos, com faturamento e logs unificados, para tomar a decisão mais adequada ao seu negócio.

Q6: As especificações da interface da API mudarão após a migração para uma plataforma de agregação?

As plataformas de agregação geralmente adaptam o protocolo compatível com a OpenAI, o que significa que a estrutura de código que você usava para invocar o Sora-2 pode ser mantida, bastando alterar os campos base_url e model. Os parâmetros de solicitação relacionados à geração de vídeo (comando, duração, áudio, resolução, etc.) variam ligeiramente entre os modelos, e a plataforma de agregação fará o alinhamento desses parâmetros. Consulte a documentação da plataforma para detalhes específicos.

Q7: Devo migrar imediatamente ou esperar até setembro?

Recomendamos fortemente começar os testes imediatamente e concluir a migração antes do final de junho. Por três motivos:

- Quanto mais perto de 24 de setembro, mais usuários do Sora-2 estarão tentando migrar, tornando os recursos da plataforma de agregação e dos modelos alternativos mais escassos.

- A migração antecipada permite comparar plenamente as duas alternativas, evitando decisões de última hora.

- Desenvolvedores que migram cedo geralmente conseguem melhores cotas de teste e condições de preço.

Q8: Qual modelo, SeeDance 2.0 ou Wan 2.7, é mais amigável para comandos em chinês?

Ambos são significativamente superiores ao Sora-2 na compreensão do chinês. O SeeDance 2.0 é mais refinado na expressão de emoções e descrição de ações em chinês, enquanto o Wan 2.7, por suportar comandos longos de 5.000 caracteres e o "Modo de Pensamento" (Thinking Mode), apresenta um desempenho mais estável em cenários narrativos complexos. Se seus comandos geralmente têm menos de 200 caracteres, escolha o SeeDance 2.0; se precisar descrever storyboards complexos, escolha o Wan 2.7.

Q9: Como garantir que não haja interrupção do serviço durante a migração?

A prática mais segura é o "double-write, double-read" (escrita e leitura dupla): durante a transição, invoque tanto o Sora-2 quanto o modelo de destino, salve as duas saídas e faça o roteamento A/B no front-end. Assim, se houver algum problema com o modelo de destino, você pode reverter imediatamente para o Sora-2 (antes de 24 de setembro), minimizando os riscos. As plataformas de agregação geralmente suportam roteamento dinâmico baseado no campo model, tornando o custo dessa estratégia muito baixo.

Conclusão: O melhor caminho após o encerramento da API do Sora-2

A OpenAI definiu a data de encerramento da API do Sora-2 para 24 de setembro de 2026, deixando menos de meio ano para todos os negócios de geração de vídeo. A engenharia reversa da API, que antes era uma "solução de transição barata", perdeu seu valor sob a pressão do endurecimento do controle de riscos e do encerramento oficial. Continuar investindo nisso só fará com que os custos de migração se acumulem.

Felizmente, o setor de geração de vídeo em 2026 formou um cenário multipolar muito saudável: o SeeDance 2.0 tornou-se o padrão de qualidade com uma pontuação de 1269 no Elo da Artificial Analysis, destacando-se em entradas multimodais e geração conjunta nativa de áudio e vídeo; o Wan 2.7 estabeleceu uma vantagem competitiva única com o "Modo de Pensamento" e controle de quadros inicial/final, ideal para cenários que exigem controle preciso da imagem. Ambas as soluções são significativamente superiores ao Sora-2 em suporte ao chinês, conformidade local e estabilidade de invocação.

Nossa recomendação é: não coloque todos os ovos na mesma cesta. Utilize a plataforma APIYI (apiyi.com) para acessar tanto o SeeDance 2.0 quanto o Wan 2.7 e faça o roteamento dinâmico conforme a solicitação do negócio — conteúdos que priorizam a qualidade seguem pelo SeeDance 2.0, enquanto cenas que exigem controle preciso seguem pelo Wan 2.7. Essa arquitetura de modelo duplo garante estabilidade durante a migração e permite a continuidade perfeita dos negócios originais do Sora-2 após setembro.

O ponto mais importante: comece agora. Esperar até agosto ou setembro para iniciar a migração tornará a adaptação do modelo, o ajuste de comandos e a solicitação de cotas muito mais difíceis do que agora. Recomendamos iniciar os testes de PoC esta semana, clonar o código de invocação existente do Sora-2 para testes paralelos e usar dados reais de negócios para orientar a decisão final, garantindo que, no momento do encerramento em 24 de setembro, você já tenha uma solução alternativa operando de forma estável há pelo menos dois meses.

Autor: Equipe APIYI — Especializada em serviços de proxy de API para modelos de linguagem grande e agregação de modelos de geração de vídeo.