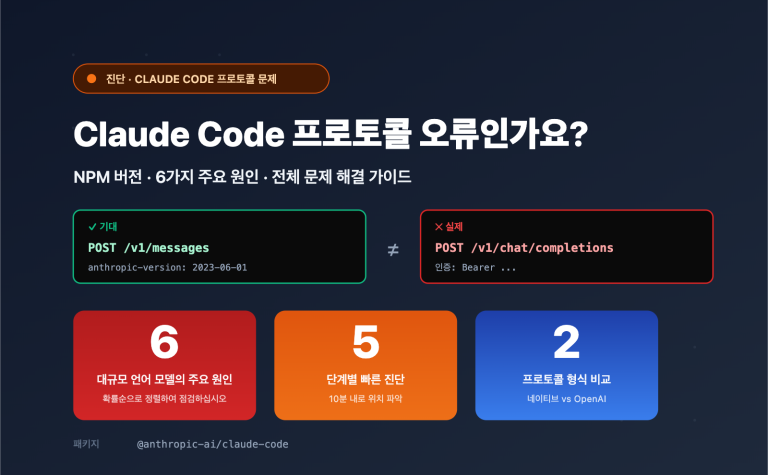

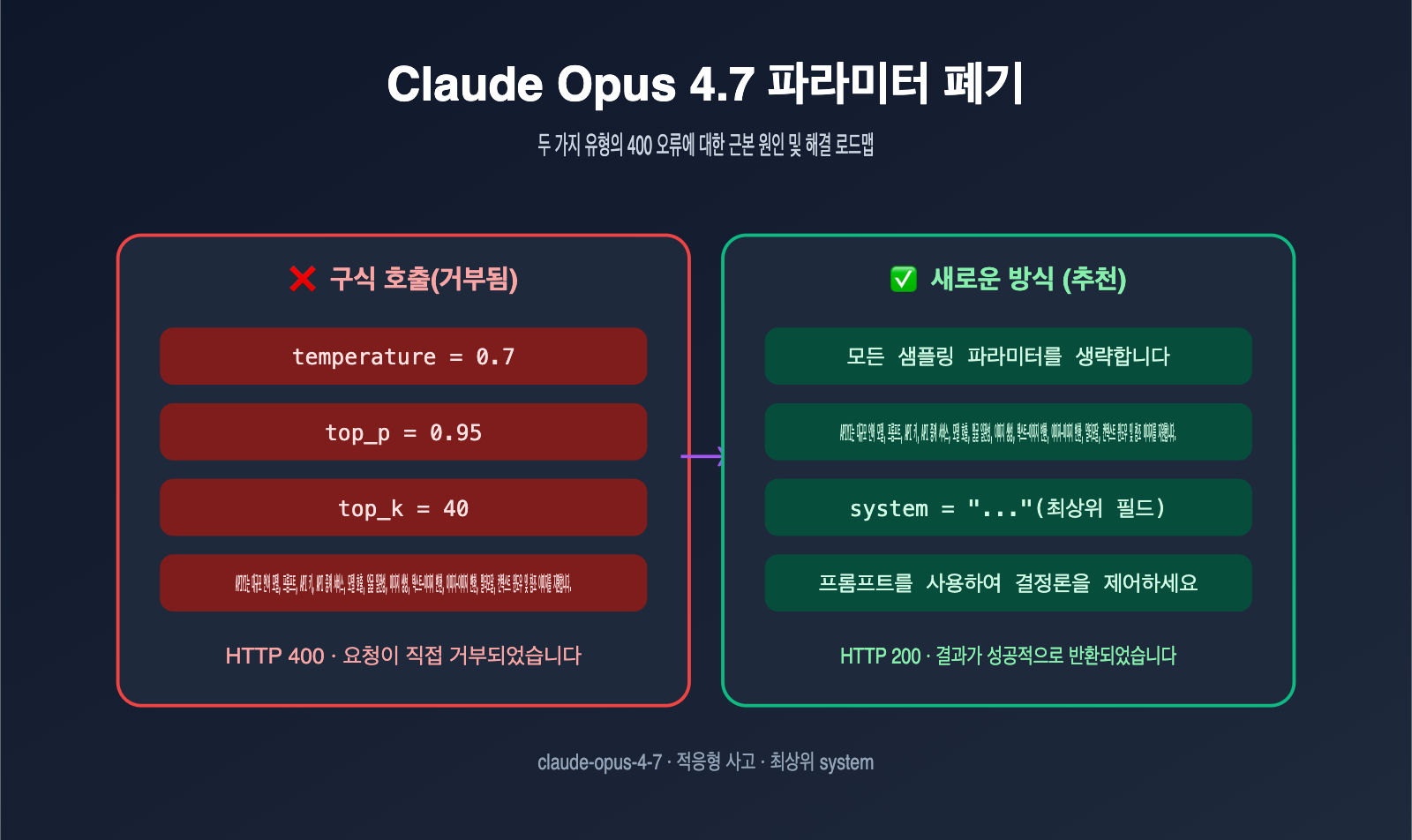

작성자 주: Claude Opus 4.7에서는 temperature, top_p, top_k 등의 샘플링 파라미터가 폐기되었으며, system 프롬프트는 메시지 역할(role)이 아닌 최상위 파라미터로 전달해야 합니다. 이번 글에서는 자주 발생하는 2가지 400 에러의 근본 원인과 코드 수정 방안을 명확히 정리해 드립니다.

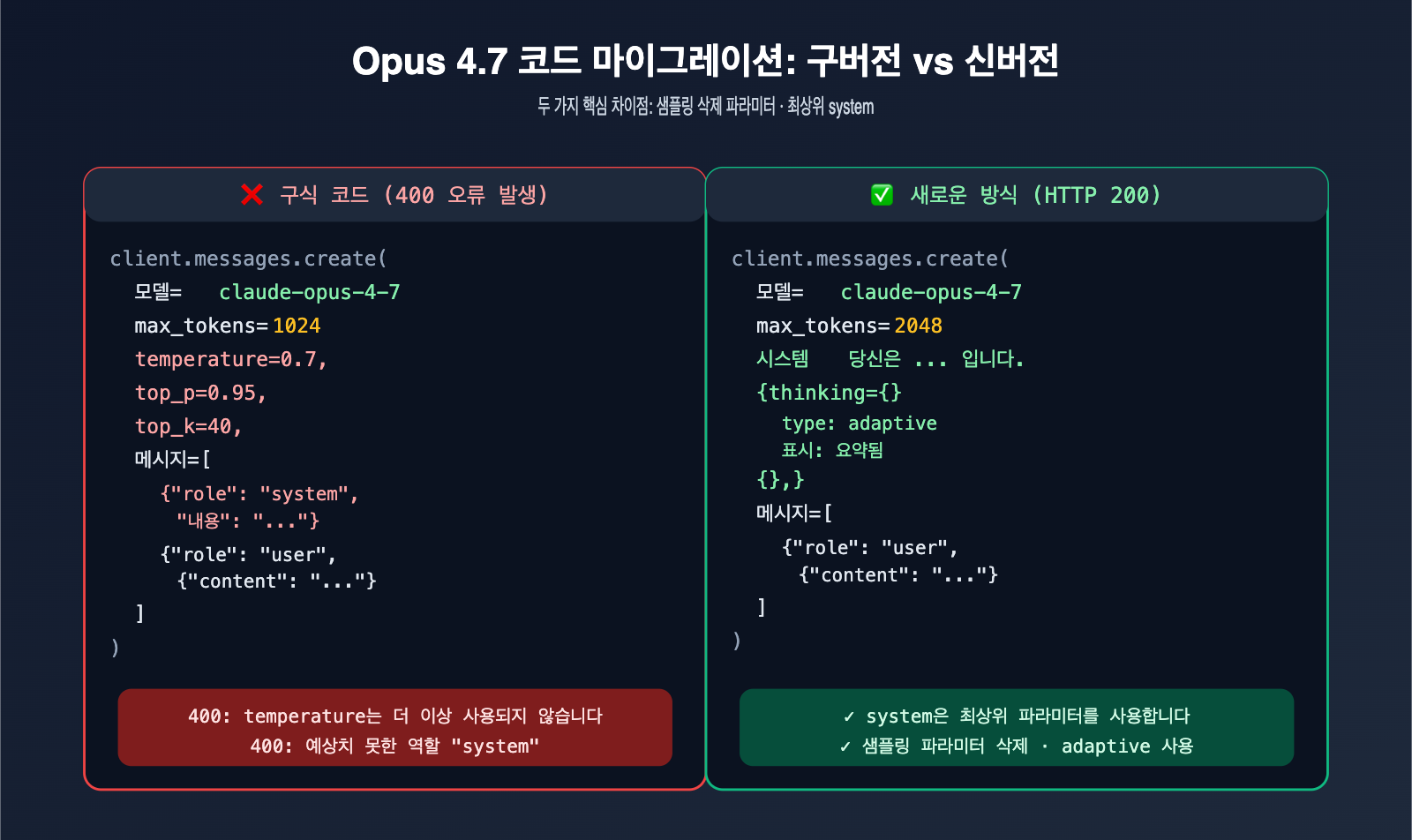

Claude Opus 4.7로 업그레이드한 후 개발자들이 가장 많이 겪는 문제는 모델 자체가 아니라 요청 파라미터입니다. 첫 번째 빈번한 에러는 temperature is deprecated for this model이고, 두 번째는 Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role입니다. 두 에러 모두 HTTP 400을 반환하며 서로 무관해 보이지만, 사실 Anthropic이 Opus 4.7에서 단행한 다소 공격적인 API 수렴 정책이라는 동일한 원인을 가리키고 있습니다.

많은 팀이 이번 변경 사항을 제대로 확인하지 않은 채, 습관적으로 "온도를 0으로 설정"하거나 "system 메시지를 하나 더 추가"하는 것을 확실성을 높이는 만능 해결책으로 사용하곤 합니다. Opus 4.7은 이러한 경로를 완전히 차단했습니다. 이 가이드에서는 원인, 에러 내용, 수정 방법이라는 세 가지 관점에서 이 문제들을 완전히 파헤치고, 바로 복사해서 사용할 수 있는 마이그레이션 코드를 제공합니다. 이 글을 다 읽고 나면 10분 안에 현재 겪고 있는 400 에러를 해결할 수 있을 뿐만 아니라, Anthropic의 이번 설계 변경 이면에 숨겨진 논리를 이해하여 다음 모델 업그레이드 시에도 시행착오를 줄일 수 있을 것입니다.

Claude Opus 4.7에서 폐기된 파라미터

에러를 이해하기 전에, 먼저 전체 "폐기 목록"을 살펴보겠습니다. Anthropic이 Opus 4.7에서 단행한 변경 사항은 겉보기보다 훨씬 많으며, 4.6 시절의 deprecation보다 영향 범위가 훨씬 큽니다.

| 파라미터 | 상태 | 동작 | 대체 방안 |

|---|---|---|---|

temperature |

폐기 | 기본값 외 설정 시 400 반환 | 완전히 생략, 프롬프트로 무작위성 제어 |

top_p |

폐기 | 위와 동일 | 완전히 생략 |

top_k |

폐기 | 위와 동일 | 완전히 생략 |

thinking.budget_tokens |

제거 | 명시적 예산 설정 시 400 반환 | thinking: { type: "adaptive" } |

reasoning_effort (구형) |

제거 | 기존 필드 미작동 | output_config: { effort: "max" } |

메시지 내 role: "system" |

미지원 | 기존에도 미지원했으나 4.7에서 엄격하게 에러 발생 | 최상위 system 파라미터 사용 |

🎯 업그레이드 전 필수 확인: Python SDK를 사용하는 경우, 기존 코드에

temperature=0.7,top_p=0.95또는messages=[{"role": "system", ...}]중 하나라도 포함되어 있으면 Opus 4.7에서 400 에러가 발생합니다. APIYI(apiyi.com)를 통해 Opus 4.7을 연동하는 것을 권장합니다. 해당 플랫폼은 파라미터 호환성을 위해 우아한 다운그레이드(graceful degradation)를 지원하므로 새로운 인터페이스로 원활하게 전환할 수 있습니다.

목록에서 가장 간과하기 쉬운 것은 thinking 파라미터입니다. Opus 4.6 시절에는 thinking: {"type": "enabled", "budget_tokens": 8000}을 전달하여 모델이 더 깊게 생각하도록 할 수 있었지만, Opus 4.7에서는 이러한 방식이 즉시 거부됩니다. 새 버전은 adaptive 타입만 허용하며, 모델이 스스로 추론 강도를 결정합니다. 또한 adaptive thinking은 기본적으로 꺼져 있으므로 명시적으로 활성화해야 합니다.

또 다른 숨겨진 변경 사항은 토크나이저(tokenizer)입니다. Opus 4.7은 새로운 토크나이저를 사용하며, 동일한 텍스트라도 새 모델에서는 4.6 대비 토큰 수가 0%에서 35%까지 증가할 수 있습니다. 이는 4.6 기준으로 산정한 비용 예산이 4.7에서는 "소리 없는 가격 인상"으로 이어질 수 있음을 의미하므로, 청구서를 다시 확인해야 합니다.

왜 Claude Opus 4.7은 temperature 파라미터를 폐기했을까요?

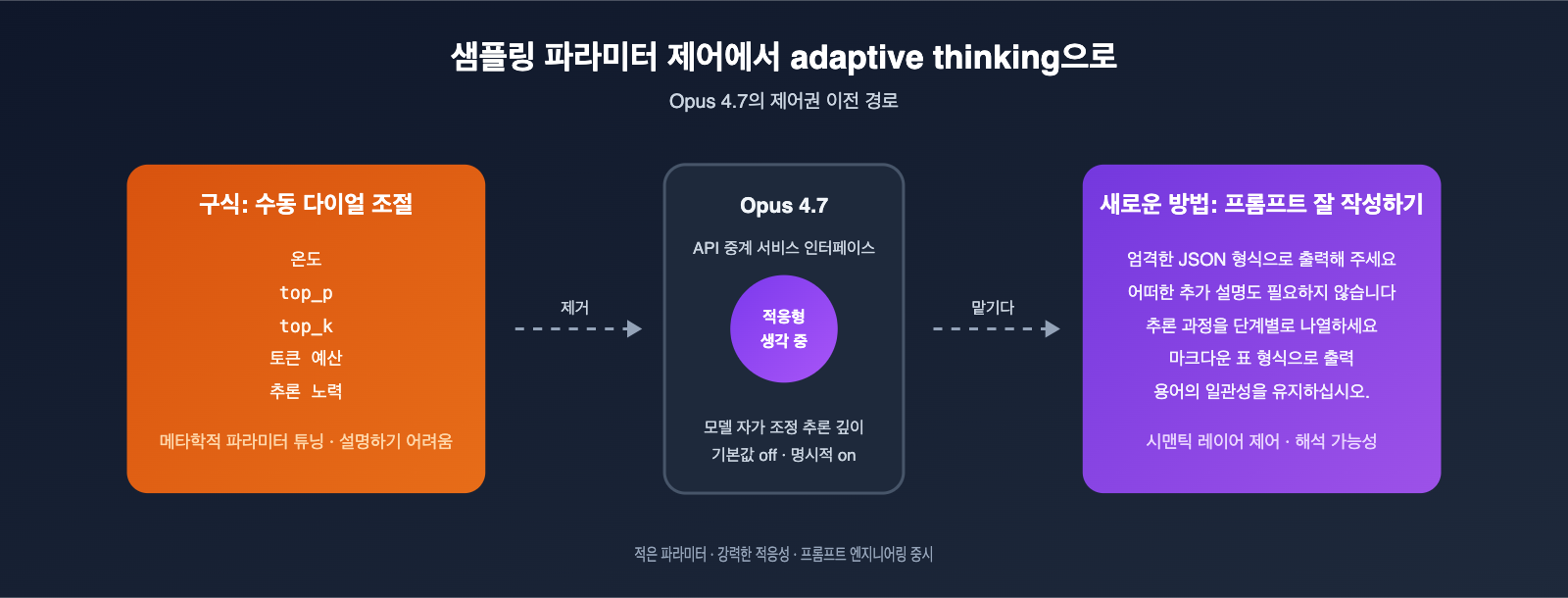

이번 변경의 내면을 이해하면 삽질을 크게 줄일 수 있습니다. Anthropic이 Opus 4.7에서 temperature, top_p, top_k라는 세 가지 샘플링 파라미터를 "회수"한 것은, 본질적으로 모델을 '파라미터 조절이 가능한 라이브러리'에서 '자체 적응형 블랙박스'로 전환했기 때문입니다.

모델 아키텍처 관점에서 보면, Opus 4.7은 추론 강도의 제어권을 adaptive thinking 모듈에 넘겼습니다. 이 모듈은 불확실성을 스스로 조절하는 기능을 내장하고 있죠. 즉, '샘플링 계층에서 무작위성을 조절'하던 기존의 온도(temperature) 방식은 모델 내부의 추론 로직과 더 이상 호환되지 않으며, 강제로 설정할 경우 오히려 새로운 버전의 최적화 경로를 방해하게 됩니다. Anthropic은 문서에서 "내부 평가 결과, adaptive thinking이 extended thinking과 수동 temperature 조합보다 안정적으로 우수하다"고 명시했습니다.

다른 시각에서 보면, 이번 '노브(knob) 제거'는 초보자를 위한 친절한 업그레이드이기도 합니다. 과거에는 LLM을 다룰 때 "온도 설정이 잘못된 건가?"라는 미신 같은 고민에 빠지기 쉬웠고, 아무리 조절해도 최적값을 찾기 어렵거나 결과 차이를 설명하기 힘들었습니다. Opus 4.7은 이런 '모호한' 최적화 경로를 차단함으로써, 개발자들이 프롬프트 설계나 컨텍스트 관리와 같이 실제로 안정적인 성과를 낼 수 있는 곳에 집중하도록 유도합니다.

엔지니어링 측면에서 볼 때, 세 가지 샘플링 파라미터의 폐기는 Anthropic이 더 이상 '온도 조절을 통한 안정성 확보'라는 구식 방식을 권장하지 않음을 의미합니다. 새로운 권장 방식은 프롬프트 엔지니어링을 통해 "확정적인 답변이 필요함", "엄격한 JSON 출력 요망" 등을 명시하여 모델이 의미론적(semantic) 층위에서 스스로 제약하게 만드는 것입니다. APIYI(apiyi.com)를 통해 Opus 4.7을 호출하는 팀이라면, 기존의 temperature=0에 의존하던 코드를 "시스템 프롬프트에 확정성을 명시하는" 방식으로 점진적으로 전환하시길 권장합니다.

이러한 사고방식은 GPT-5.5의 '5단계 reasoning effort'와 대비됩니다. OpenAI는 "개발자에게 더 세밀한 스위치를 제공"하는 반면, Anthropic은 "스위치를 회수하여 모델에게 맡기는" 방식을 택했습니다. 두 철학 중 무엇이 옳다고 할 수는 없지만, 둘 다 전통적인 하이퍼파라미터 튜닝의 역할을 약화시키고 있다는 점은 분명합니다. 개발자에게 주는 가장 큰 교훈은, 앞으로의 LLM 튜닝은 '노브 조절'에서 '프롬프트와 컨텍스트를 잘 작성하는 것'으로 무게 중심이 이동한다는 것입니다.

참고로, Anthropic의 이번 '급격한 수렴'은 예고가 없었던 것이 아닙니다. Opus 4.6 시절부터 이미 문서에서 extended thinking을 deprecated로 표시하고, 개발자들에게 adaptive thinking으로의 전환을 안내해 왔습니다. 그때부터 권장 방식대로 코드를 작성했다면 이번 4.7 업그레이드는 거의 비용이 들지 않았을 것입니다. 반대로, 여전히 "온도를 높여 창의성을 높이고, 낮춰서 안정성을 챙기던" 구식 방식에 의존했다면 이번 마이그레이션은 다소 고통스러울 수 있습니다.

temperature 파라미터 400 에러 해결 방안

원인을 알았으니 해결은 간단합니다. 아래는 최소한의 수정 예시이며, APIYI(apiyi.com)의 base_url을 사용하면 국내에서도 안정적으로 실행할 수 있습니다.

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # APIYI를 통한 Opus 4.7 통합 호출

)

# ❌ 기존 코드: temperature is deprecated 400 에러 발생

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ 수정 코드: 샘플링 파라미터를 완전히 생략

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 빠른 수정 제안:

base_url을https://api.apiyi.com으로 변경하고, APIYI(apiyi.com)에서 발급받은 Anthropic 호환 키를 사용하세요. 기존 코드에서 샘플링 파라미터 세 줄만 삭제하면 바로 작동합니다. 만약 즉시 수정이 어렵다면, APIYI(apiyi.com)는 기본적으로 폐기된 파라미터에 대해 부드러운 하향 조정(fallback)을 지원하므로 마이그레이션을 위한 완충 기간을 가질 수 있습니다.

다음 표는 가장 적합한 방식을 선택할 수 있도록 세 가지 전형적인 마이그레이션 전략을 정리한 것입니다.

| 기존 방식 | 새로운 방식 | 기대 효과 |

|---|---|---|

temperature=0 (확정성 추구) |

시스템 프롬프트에 "엄격한 JSON 출력, 부가 설명 금지" 명시 | 출력 안정성 향상, 토큰 절약 |

temperature=1 (창의성 추구) |

샘플링 파라미터 미설정, 모델의 자율성 활용 | 4.7 본연의 성능 발휘 |

top_p / top_k (샘플링 제한) |

adaptive thinking의 effort: "max" 활용 |

샘플링 제어 대신 추론 깊이 강화 |

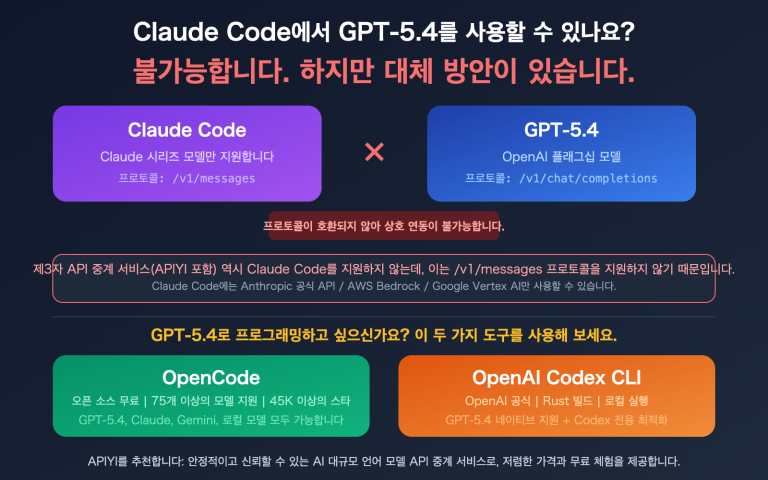

만약 OpenAI 호환 프로토콜을 사용 중이라면(많은 서드파티 프레임워크가 기본값으로 사용), SDK가 내부적으로 temperature=1.0을 강제로 주입하고 있는지 확인해야 합니다. 커뮤니티에는 프레임워크의 하드코딩된 기본값 때문에 Opus 4.7이 요청을 거부하는 이슈가 많습니다. 이 경우 프레임워크를 업데이트하거나 APIYI(apiyi.com)의 호환 레이어를 이용하시기 바랍니다.

system 角色报错的本质与修复

第二个高频 400 报错和 temperature 没关系,是个老问题在新模型上"重新被放大"。Anthropic 的 Messages API 从未支持过把 system 写成消息角色,但很多从 OpenAI Chat Completions 迁移过来的代码会下意识地这么写,于是就触发了 Unexpected role "system" 报错。

理解这件事的关键在于:Anthropic 把 system 视为"会话级配置"而不是"对话内容"。它必须出现在请求体顶层,而不是 messages 数组里。下面这张表对照了 OpenAI 和 Anthropic 的差异。

| 항목 | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

| system 위치 | messages 배열 첫 번째 |

요청 본문 최상위 system 필드 |

| system 개수 | 여러 개 가능 | 문자열 하나만 가능 |

| 4.7 오류 발생 | 없음 | Unexpected role "system" 400 |

| 마이그레이션 난이도 | — | 낮음, 위치만 이동하면 됨 |

🎯 마이그레이션 팁: 프로젝트에 "OpenAI / Claude 이중 실행" 로직이 있다면 어댑터를 하나 만드는 것을 추천합니다. OpenAI 호출 시에는 system을 messages 안에 넣고, Claude 호출 시에는 최상위

system필드로 옮기면 됩니다. APIYI(apiyi.com)를 통해 두 모델을 모두 연결하면 하나의 키 체계로 관리할 수 있어 설정 중복을 피할 수 있습니다.

수정 방법은 매우 간단합니다. 아래의 잘못된 예시와 올바른 예시를 비교해 보세요.

# ❌ 잘못된 방식: Unexpected role "system" 400 오류 발생

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ 올바른 방식: system을 최상위 파라미터로 전달

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

한 가지 덧붙이자면, Claude에게 "여러 개의 system 지침"을 주고 싶다면, 이를 하나의 문자열로 합쳐서 줄바꿈이나 번호로 구분하는 것이 좋습니다. Anthropic SDK는 system 필드를 콘텐츠 블록 배열 형태로도 지원하지만, 이는 고급 기능이므로 초보자는 "단일 문자열"로 이해하는 것이 좋습니다. 이렇게 작성하면 숨겨진 장점이 하나 더 있습니다. 단일 문자열로 합치면 APIYI(apiyi.com)의 프롬프트 캐싱 적중률이 높아져 장기 실행 작업의 비용이 더욱 절감됩니다.

Claude Opus 4.7 마이그레이션 코드 템플릿

두 가지 오류 수정을 하나로 합친, "바로 실행 가능한 Opus 4.7 시작 코드"입니다. adaptive thinking, system 최상위 파라미터, 그리고 캐싱 비용 효율적인 작성법이 포함되어 있습니다.

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # APIYI를 통해 Opus 4.7 호출

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 운영 환경 권장사항: APIYI(apiyi.com)에서 Opus 4.7을 호출할 때, 변하지 않는 system 프롬프트와 도구 설명을 앞부분에 배치하면 캐싱 비용 0.1x가 적용되어 반복 요청 비용을 원가의 10% 수준까지 낮출 수 있습니다. 이는 장기 실행 에이전트나 문서 생성 작업에 특히 유리합니다.

실제 마이그레이션 시 몇 가지 세부 사항을 유의해야 합니다. 첫째, thinking 필드는 필수가 아니지만, 작업이 추론 깊이에 민감하다면 명시적으로 adaptive thinking을 켜는 것이 좋습니다. 그렇지 않으면 모델은 기본 경량 추론 모드를 유지합니다. 둘째, 새로운 토크나이저로 인해 동일한 텍스트가 0%에서 35%까지 더 많은 토큰을 소모하므로, max_tokens 예산을 상향 조정해야 합니다. 그렇지 않으면 긴 출력 시 잘릴 수 있습니다. 셋째, 이전 버전의 thinking_budget 등 주변 파라미터도 함께 제거해야 합니다. 잔류 필드는 오류를 일으키지는 않지만 무시되므로, 여전히 작동 중이라고 착각할 수 있습니다. 넷째, 애플리케이션이 4.6과 4.7을 동시에 호출한다면, 모델명별로 비용을 기록하여 신구 토크나이저 혼용으로 인한 비용 귀속 왜곡을 방지하는 것이 좋습니다.

Opus 4.6과 4.7을 모두 호환해야 하는 코드베이스를 유지 중이라면, 모델명에 따라 파라미터 화이트리스트를 관리하는 것이 가장 안정적입니다. "샘플링 파라미터 + 이전 thinking 필드"를 4.7 호출 시에는 제외하고 4.6 호출 시에는 유지하도록 하면, 모델별로 별도의 호출 함수를 관리할 필요가 없습니다.

아래 오류 확인 표는 Opus 4.7 업그레이드 과정에서 가장 흔히 발생하는 400 오류들을 정리한 것이니, 오류 메시지에 따라 바로 수정해 보세요.

| 오류 키워드 | 오류 의미 | 수정 방법 |

|---|---|---|

temperature is deprecated |

더 이상 사용되지 않는 temperature 필드 전달됨 | 요청 본문에서 temperature를 완전히 삭제 |

top_p is deprecated |

더 이상 사용되지 않는 top_p 필드 전달됨 | top_p 삭제, 모델이 자율적으로 처리하게 함 |

top_k is deprecated |

더 이상 사용되지 않는 top_k 필드 전달됨 | top_k 삭제, 모델이 자율적으로 처리하게 함 |

| Unexpected role "system" | system이 messages 배열 안에 작성됨 | 최상위 system 필드로 이동 |

Invalid budget_tokens |

구버전 extended thinking 예산 사용됨 | adaptive thinking으로 변경하고 budget 전달 안 함 |

Unknown parameter reasoning_effort |

구버전 추론 강도 필드 사용됨 | output_config: {effort: "max"}로 변경 |

Claude Opus 4.7 파라미터 폐기 관련 FAQ

Q1: Opus 4.7에서 왜 이렇게 많은 파라미터를 한꺼번에 폐기했나요?

핵심 이유는 'adaptive thinking'이 기존에 temperature, top_p, top_k, thinking budget이 각각 담당하던 "무작위성 및 추론 깊이 제어" 역할을 완전히 대체했기 때문입니다. Anthropic 내부 평가 결과, adaptive thinking이 사람이 직접 파라미터를 조정하는 것보다 일관되게 우수한 성능을 보여주어, 인터페이스를 단순화하기로 결정한 것입니다.

Q2: temperature를 1.0으로 설정하면 오류를 "우회"할 수 있나요?

아니요, 불가능합니다. Opus 4.7은 샘플링 파라미터에 대해 "값이 무엇인지"가 아니라 "전달되었는지 여부"를 판단합니다. 요청 본문에 해당 키가 포함되어 있으면 기본 설정이 아닌 것으로 간주하여 400 오류를 반환합니다. 올바른 방법은 요청에서 해당 필드를 완전히 제거하여 SDK가 모델 자체의 기본 샘플링 동작을 따르도록 하는 것입니다.

Q3: OpenAI SDK를 통해 APIYI에서 Opus 4.7을 호출하면 temperature 오류가 발생하나요?

사용 중인 SDK 버전과 상위 프레임워크에 따라 다릅니다. OpenAI SDK는 기본적으로 temperature=1.0을 포함하는데, 이를 Anthropic 백엔드로 직접 전달하면 Opus 4.7에서 거부됩니다. 하지만 APIYI(apiyi.com)를 통해 호출하면 플랫폼에서 이러한 일반적인 호환성 문제를 우아하게 처리하여, 폐기된 필드를 자동으로 필터링해 줍니다.

Q4: system 오류는 4.7에서만 발생하나요? 이전 Claude 모델은 괜찮았나요?

아닙니다. Anthropic Messages API는 원래 system을 messages 배열 안에 넣는 것을 허용하지 않았습니다. 다만 Opus 4.7의 검증이 더 엄격해졌을 뿐이며, 일부 초기 모델들은 이를 "느슨하게" 받아들였던 것입니다. system을 요청 본문 최상단에 배치하는 것이 항상 모범 사례이며, 이렇게 수정하면 모든 Claude 모델에서 정상적으로 작동합니다.

Q5: OpenAI에서 마이그레이션할 때, 최소 몇 줄을 수정해야 Opus 4.7을 실행할 수 있나요?

보통 세 곳을 수정하면 됩니다. 1) model을 claude-opus-4-7로 변경, 2) messages 내의 system 항목을 최상단 system 필드로 이동, 3) temperature, top_p 등 샘플링 파라미터 삭제. base_url을 https://api.apiyi.com으로 설정하면 보통 10분 이내에 전체 프로젝트를 실행할 수 있습니다. 호출 지점이 많다면 call_claude()와 같은 유틸리티 함수를 만들어 이 세 가지 수정을 한곳으로 모아두는 것을 추천합니다. 향후 API 변경 시에도 한 곳만 수정하면 되니까요.

Q6: adaptive thinking은 기본적으로 켜져 있나요? 명시적으로 켜야 하나요?

기본값은 꺼져 있습니다. 수학적 추론, 코드 리팩토링, 복잡한 계획 수립 등 추론 깊이가 중요한 작업이라면 thinking: {type: "adaptive"}를 명시적으로 전달하는 것이 좋습니다. 여기에 output_config: {effort: "max"}를 조합하면 최상의 추론 능력을 얻을 수 있습니다. 단, 토큰 사용량이 증가하므로 품질과 비용 사이에서 적절한 균형을 잡아야 합니다.

Q7: 국내에서 Opus 4.7 호출은 안정적인가요?

Anthropic 인터페이스에 직접 연결하면 네트워크 환경의 영향을 받을 수 있으며, 특히 긴 작업은 연결이 끊기기 쉽습니다. APIYI(apiyi.com)를 통해 Opus 4.7을 호출하면 국내 접속 안정성 문제를 해결할 수 있습니다. 플랫폼은 이미 안정적으로 운영 중이며, 캐시 과금 0.1x 혜택을 통해 비용도 크게 절감할 수 있습니다.

Q8: 새로운 토크나이저로 인해 비용이 얼마나 오르나요? 어떻게 대응해야 하나요?

새로운 토크나이저는 텍스트에 따라 0%에서 35%까지 토큰 수가 증가하며, 평균적으로는 10%에서 15% 정도 늘어납니다. 가장 효과적인 대응책은 캐시 가능한 system prompt나 도구 설명을 앞부분에 배치하여 0.1x 캐시 과금을 유도하는 것입니다. 이렇게 하면 오히려 단가 비용을 낮출 수 있습니다.

Claude Opus 4.7 파라미터 폐기 핵심 요약

- Opus 4.7은

temperature,top_p,top_k세 가지 샘플링 파라미터를 완전히 폐기했습니다. 값을 전달하면 400 오류가 발생합니다. - Extended thinking은 제거되었으며, adaptive thinking만 지원합니다. 기본값은 꺼져 있으므로 명시적으로 활성화해야 합니다.

Unexpected role "system"은 Messages API의 기존 규칙입니다.system은 메시지 역할이 아닌 최상단 필드로 전달해야 합니다.- 새로운 토크나이저로 인해 동일 텍스트 대비 토큰 수가 4.6 버전보다 0~35% 증가했으므로, 예산과

max_tokens를 재산정해야 합니다. - 수정은 세 단계로 충분합니다: 샘플링 파라미터 삭제,

system을 최상단으로 이동, 모델명을claude-opus-4-7로 변경. - APIYI(apiyi.com)를 통해 Opus 4.7을 호출하면 파라미터 호환성 자동 처리, 0.1x 캐시 과금, 국내 안정적 접속을 모두 누릴 수 있습니다.

- adaptive thinking과

output_config: {effort: "max"}조합은 Opus 4.7에서 최고의 추론 성능을 끌어내는 표준 방식입니다.

요약

Claude Opus 4.7의 파라미터 폐기는 언뜻 '파괴적인 변경'처럼 보이지만, 사실 Anthropic이 모델을 '세부 사항을 노출하는 도구'에서 '자체 적응형 블랙박스'로 진화시키기 위한 핵심 단계입니다. 개발자 입장에서는 기존에 temperature나 thinking budget 같은 '스위치'로 조정하던 안정성을, 이제는 프롬프트 엔지니어링과 적응형 사고(adaptive thinking)의 조합으로 점진적으로 옮겨가야 함을 의미합니다. 단기적으로는 마이그레이션 비용이 발생하겠지만, 장기적으로는 코드가 더 간결해지고 모델의 성능도 더욱 안정화될 것입니다. 이러한 진화 경로는 결코 고립된 현상이 아니며, 주요 대규모 언어 모델들이 모두 '파라미터는 줄이고 적응력은 높이는' 방향으로 나아가고 있으니, 빨리 적응할수록 더 큰 이점을 누릴 수 있습니다.

Opus 4.7로 업그레이드 중이거나 이번 변경이 운영 환경에 미칠 영향을 평가하고 계신다면, APIYI(apiyi.com)에서 새 버전을 먼저 연동해 테스트해보시길 권장합니다. APIYI는 이미 Opus 4.7을 안정적으로 지원하며 폐기된 파라미터에 대한 호환성 다운그레이드를 제공하고 있습니다. 캐시 요금 0.1x 혜택과 함께라면 현재 가장 부담 없는 마이그레이션 경로가 될 것입니다.

시행착오를 줄이고 칼퇴하시길 바랍니다.

— APIYI 기술팀, 더 많은 AI 모델 실전 튜토리얼은 APIYI(apiyi.com)에서 확인하세요.