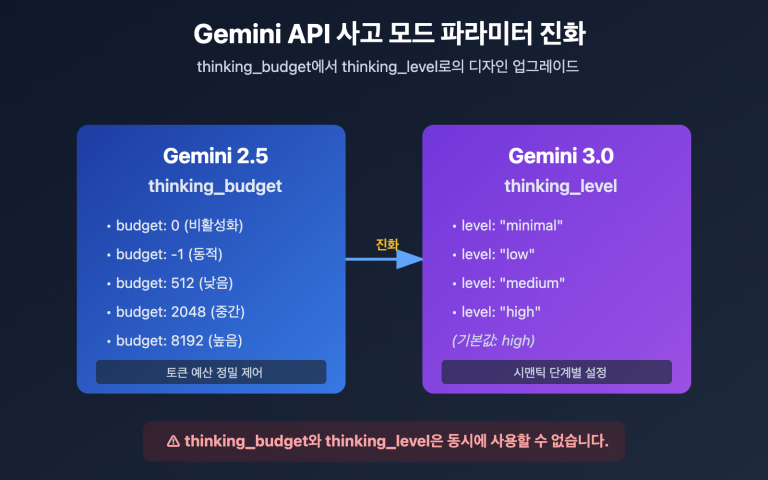

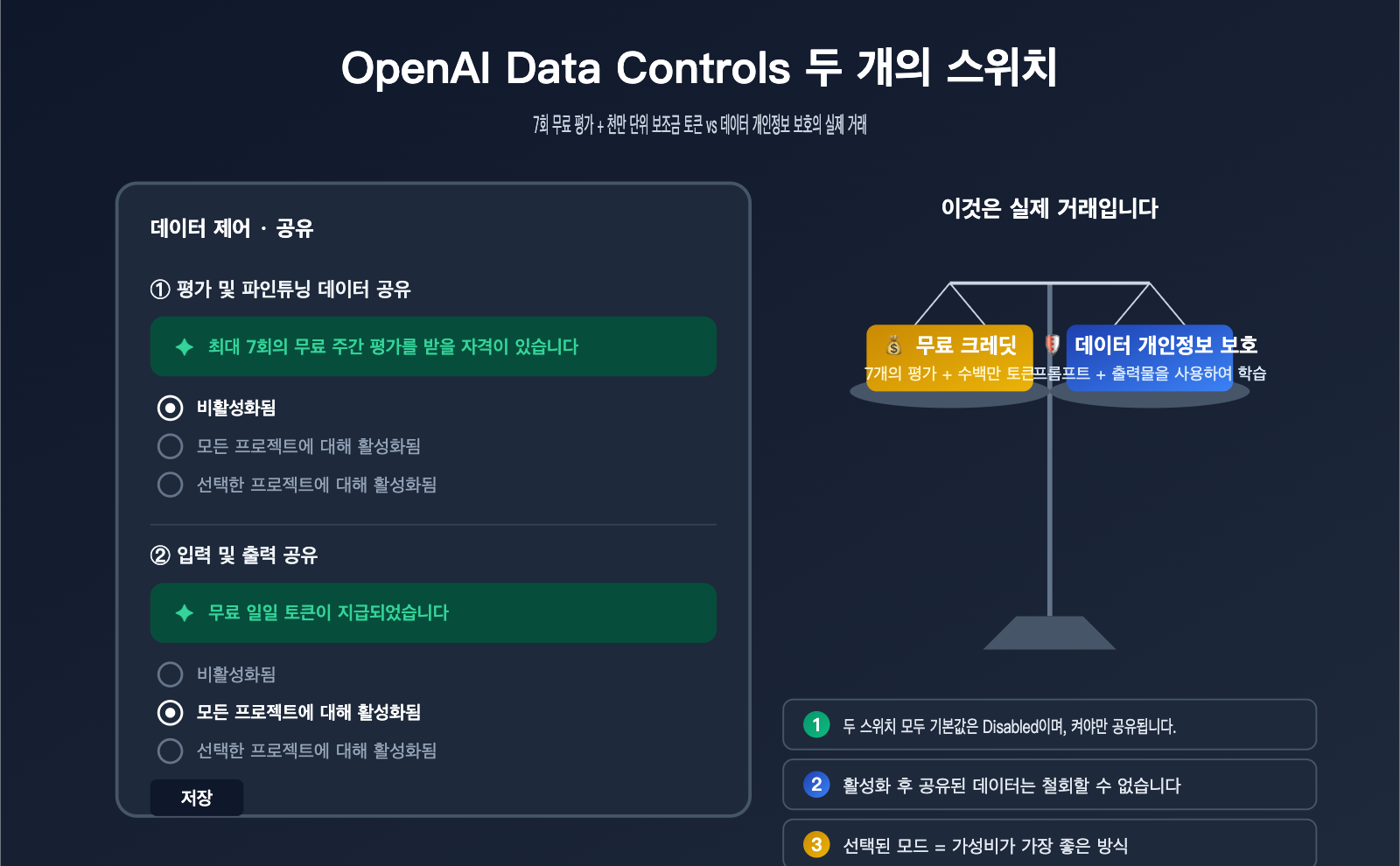

최근 고객분들로부터 OpenAI 관리자 페이지의 'Data Controls' 설정에 있는 두 가지 옵션에 대해 질문을 자주 받습니다. 바로 "Share evaluation and fine-tuning data with OpenAI"와 "Share inputs and outputs with OpenAI"인데요. 각 옵션은 'Disabled', 'Enabled for all projects', 'Enabled for selected projects' 중 선택할 수 있습니다. 첫 번째 옵션에는 "최대 7회의 무료 주간 평가(evals) 제공"이라는 녹색 안내가, 두 번째 옵션에는 "매일 무료 토큰 제공"이라는 문구가 적혀 있어 마치 공짜 혜택처럼 보이지만, 이를 활성화했을 때의 대가에 대해 확신하지 못하는 분들이 많습니다.

사실 이 두 스위치는 OpenAI가 '무료 크레딧'을 대가로 사용자의 '학습/평가 데이터'를 가져가는 일종의 양방향 거래입니다. 활성화하는 순간 발생하는 대가는 분명합니다. 평가 데이터와 API 입출력 내용이 향후 모델 개선을 위해 OpenAI에 전달되거든요. APIYI(apiyi.com) 고객 중에는 이를 반년 동안 켜두었다가 뒤늦게 개인정보 유출 위험을 깨달은 분도 계셨고, 반대로 반년 동안 꺼두었다가 매일 수백만 토큰 규모의 무료 혜택을 놓친 것을 알고 아쉬워하는 분들도 계셨습니다. 이번 글에서는 영어 공식 문서를 바탕으로 두 설정의 실제 역할, 획득 가능한 혜택, 개인정보 영향, 그리고 권장 설정까지 한 번에 정리해 드립니다.

OpenAI Data Controls 두 설정 항목의 핵심 정의

Settings → Data Controls → Sharing 페이지로 이동하면 서로 독립적이지만 자주 혼동되는 두 개의 스위치를 볼 수 있습니다. 이들은 공유되는 콘텐츠, 제공되는 보상, 개인정보에 미치는 영향이 완전히 다르므로, 그 경계를 이해하는 것이 올바른 의사결정의 전제 조건입니다.

| 설정 항목 | Share evaluation and fine-tuning data | Share inputs and outputs |

|---|---|---|

| 공유 콘텐츠 | 평가 프롬프트 + 결과 + 채점 로직 + 미세 조정 데이터 | API 호출의 전체 입력 및 출력 |

| 무료 보상 | 주당 최대 7회 무료 평가 실행 | 일일 토큰 보조금 (티어 및 모델 그룹별 할당) |

| 데이터 용도 | 평가 파이프라인 개선 + 향후 모델 학습 | 모델 학습 / 개선에 직접 사용 |

| 기본 상태 | Disabled | Disabled |

| 스위치 단위 | Disabled / All / Selected 3단계 | Disabled / All / Selected 3단계 |

| 조작 권한 | Org Owner 전용 | Org Owner 전용 |

| 적용 범위 | 활성화 이후 생성된 데이터부터 공유 | 활성화 이후 발생하는 트래픽부터 공유 |

| 해제 난이도 | 언제든 전환 가능 | 언제든 전환 가능 |

🎯 빠른 이해를 위한 제언: 만약 "안전하게 무료 혜택만 받고 싶다"면, 설정을 'Enabled for selected projects'로 변경하고 테스트용 프로젝트를 별도로 생성하여 개발/내부 스크립트를 실행하세요. 메인 프로젝트와 운영 API 트래픽은 APIYI(apiyi.com) 게이트웨이를 통해 관리함으로써, 모든 프로젝트가 데이터 학습 파이프라인에 노출되는 것을 방지할 수 있습니다.

Share evaluation and fine-tuning data 설정 상세 설명

이 옵션의 명칭은 "평가 및 미세 조정(Fine-tuning) 데이터 공유"이지만, 실제 공유 범위는 이름보다 훨씬 넓습니다. 이 기능을 활성화하면 OpenAI는 사용자의 평가 프롬프트와 결과물(completions)뿐만 아니라, 직접 정의한 **평가 로직(grading logic)**과 미세 조정 데이터셋의 프롬프트 및 결과물까지 수집하게 됩니다. 즉, 모델을 어떻게 평가하는지, 어떤 답변을 좋은 답변으로 간주하는지, 그리고 데이터셋에 포함된 도메인 지식까지 모두 OpenAI의 수집 대상이 된다는 뜻입니다.

그 대가로 매주 최대 7회의 무료 평가 실행(eval runs)을 제공합니다. OpenAI 고객 센터에 따르면 "OpenAI와 공유하는 평가는 현재 주당 최대 7회까지 무료로 처리됩니다"라고 명시되어 있습니다. 이 한도를 초과하거나 무료 혜택이 적용되지 않는 모델을 사용할 경우 표준 토큰 요금이 부과됩니다. 수치상으로는 작아 보이지만, 모델 선택 및 비교를 자주 수행하는 팀에게는 매주 7회의 무료 평가가 수백 달러의 비용 절감 효과를 가져다줄 수 있습니다.

주의할 점은 이 설정이 활성화 이후 생성되는 데이터에만 적용된다는 것입니다. 과거 데이터가 소급 적용되어 공유되지 않으며, 기능을 끈다고 해서 이미 공유된 데이터가 "회수"되는 것도 아닙니다. 따라서 "현재 어떤 데이터를 가지고 있는가"가 아니라 "향후 6~12개월 동안 얼마나 많은 평가 데이터를 공유할 의향이 있는가"를 기준으로 결정해야 합니다.

| 구분 | 활성화 시 이점 | 활성화 시 대가 |

|---|---|---|

| 직접 이점 | 매주 7회 무료 평가 | / |

| 간접 이점 | 평가 파이프라인의 OpenAI 최적화 | / |

| 데이터 대가 | / | 평가 프롬프트, 결과물, 평가 기준 수집 |

| 비즈니스 대가 | / | 미세 조정 데이터셋의 도메인 노하우 유출 |

| 가역성 | 언제든 해제 가능 | 이미 공유된 데이터는 회수 불가 |

🎯 Eval/FT 공유 설정 권장: 평가 데이터가 공개 벤치마크나 민감하지 않은 테스트셋이라면 활성화해도 무방합니다. 하지만 평가 프롬프트에 고객의 실제 데이터, 내부 비즈니스 규칙, 독점적인 평가 로직이 포함되어 있다면, 특정 샌드박스 프로젝트에만 적용되는 'Selected' 모드로 설정하는 것을 권장합니다.

Share inputs and outputs 설정 상세 설명

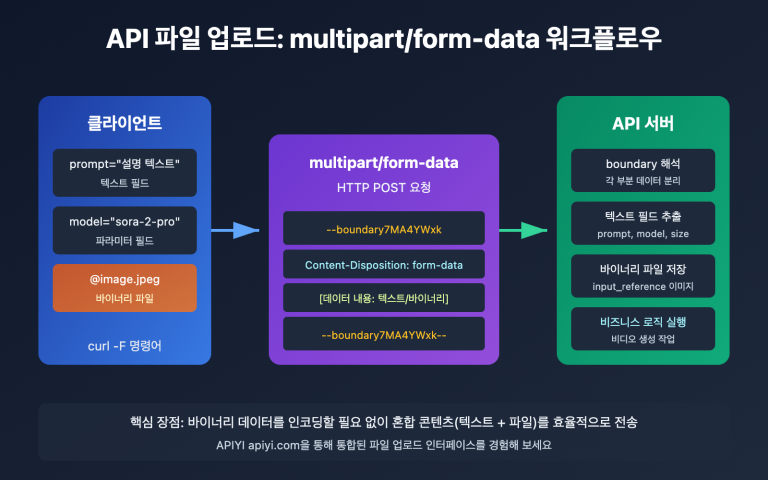

이 옵션은 두 가지 설정 중 "대가도 크지만 혜택도 확실한" 기능입니다. 활성화 시 해당 프로젝트를 거치는 모든 API 호출의 입력 프롬프트와 출력 결과물이 OpenAI에 수집되어 모델 학습이나 개선에 사용됩니다. 이는 기본 API 정책과 근본적으로 다릅니다. 2023년 3월부터 OpenAI는 기본적으로 API 데이터를 모델 학습에 사용하지 않겠다고 명시했으나, 이 옵션을 켜는 것은 해당 보호 조치를 스스로 해제하는 것과 같습니다.

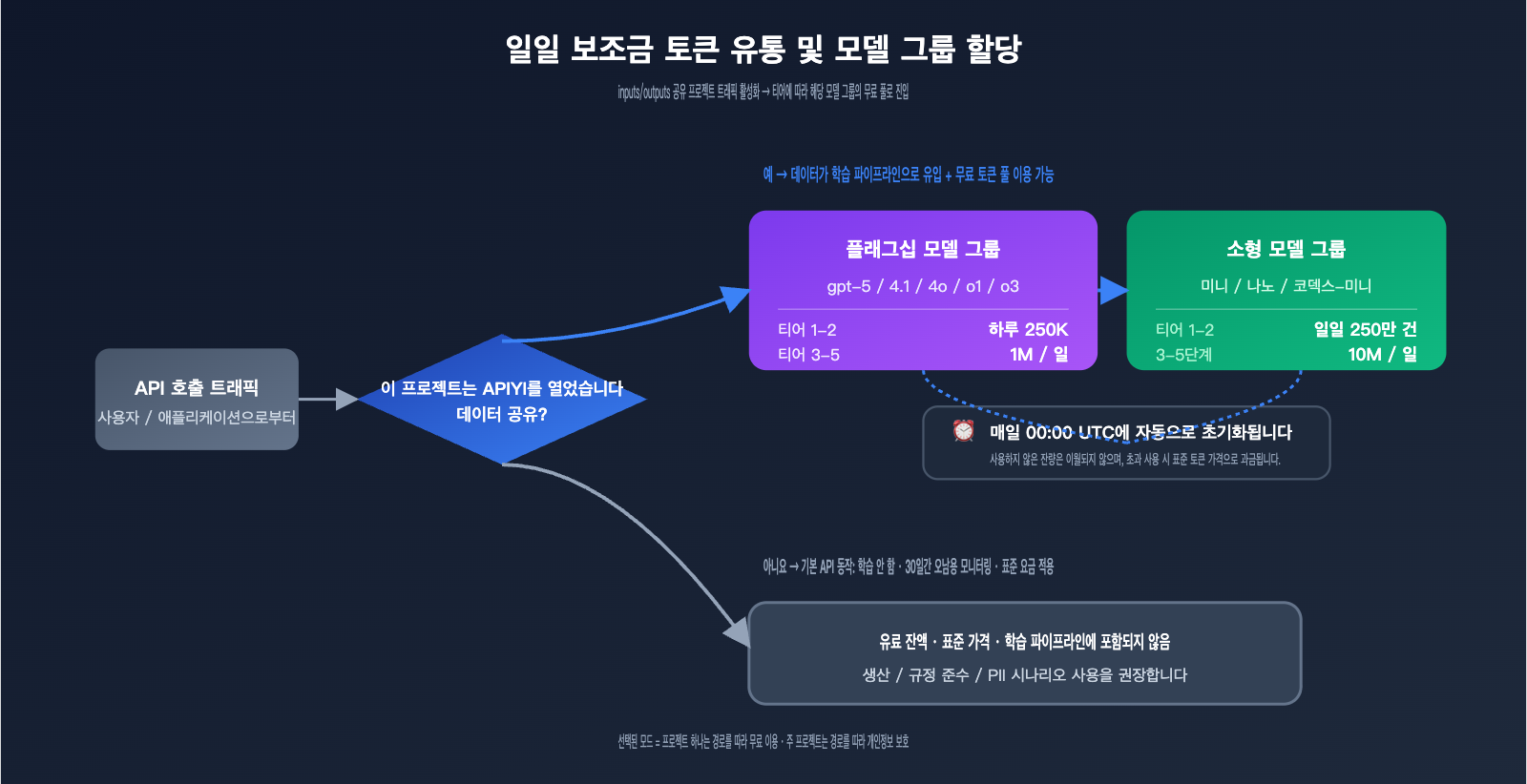

그 대가로 계정 티어와 모델 그룹에 따라 매일 보너스 토큰(complimentary daily tokens)을 지급합니다. 이는 OpenAI가 공개한 데이터 중 가장 구체적인 무료 혜택이며, 매일 00:00 UTC에 자동으로 초기화됩니다.

| 모델 그룹 | Tier 1-2 일일 한도 | Tier 3-5 일일 한도 | 초기화 시간 |

|---|---|---|---|

| 플래그십 모델 그룹 | 250,000 토큰 | 1,000,000 토큰 | 00:00 UTC |

| 소형 모델 그룹 | 2,500,000 토큰 | 10,000,000 토큰 | 00:00 UTC |

플래그십과 소형 모델 그룹은 성능에 따른 임의 분류가 아니라 OpenAI가 명시한 리스트를 따릅니다. 리스트에 없는 모델을 호출할 경우 무료 혜택이 적용되지 않습니다.

| 모델 그룹 | 포함된 모델 리스트 |

|---|---|

| 플래그십 그룹 | gpt-5, gpt-5-codex, gpt-5-chat-latest, gpt-4.5-preview, gpt-4.1, gpt-4o, o1, o3, o1-preview |

| 소형 모델 그룹 | gpt-5-mini, gpt-5-nano, gpt-4.1-mini, gpt-4.1-nano, gpt-4o-mini, o1-mini, o4-mini, codex-mini-latest |

🎯 토큰 혜택의 실제 가치: gpt-4o-mini 기준 입력 $0.15/M, 출력 $0.60/M으로 계산하면, Tier 1-2의 일일 2.5M 소형 모델 토큰은 하루 약 $1

2의 무료 혜택이며 월간 $3060를 절약할 수 있습니다. Tier 3-5로 올라가면 일일 10M 토큰으로 월간 $120~240까지 절약 가능합니다. 단순히 이 혜택을 위해 조직 전체 트래픽을 공유하는 것은 비효율적이므로, 별도의 테스트 프로젝트를 만들어 'Selected' 모드로 설정하는 것을 권장합니다.

기본 API 개인정보 보호 vs 공유 활성화 후의 실제 차이

많은 팀이 "기본 API는 학습에 사용되지 않는가?"라는 질문에 대해 오해하고 있습니다. OpenAI의 실제 정책은 다음과 같습니다. 기본 API는 학습에 사용되지 않지만, 오남용 모니터링(Abuse Monitoring)을 위해 30일간 데이터가 보관됩니다. '데이터 제로 보존(Zero Data Retention, ZDR)'은 이와 별개의 개념으로, 웹페이지에서 버튼 하나로 켜는 것이 아니라 기업 고객이 OpenAI 영업팀에 별도로 신청해야 합니다.

이 기준을 이해하면 두 가지 옵션의 영향이 명확해집니다. 'Inputs/Outputs'를 활성화하는 것은 "2023년부터 제공된 학습 보호 기능을 스스로 포기하는 것"이며, 'Eval/FT'를 활성화하는 것은 "앞선 항목에 더해 평가 방법론까지 기여하는 것"입니다. 두 옵션 모두 30일간의 오남용 모니터링 보관 정책에는 영향을 주지 않으며, ZDR과 중복 적용할 수도 없습니다.

| 구분 | 기본 API (둘 다 끔) | Inputs/Outputs 켬 | Eval/FT Data 켬 |

|---|---|---|---|

| 학습 사용 여부 | ❌ 사용 안 함 | ✅ 학습에 사용 | ✅ 학습 + 평가에 사용 |

| 오남용 모니터링 보관 | 30일 | 30일 | 30일 |

| 데이터 철회 가능 여부 | / | ❌ 공유 후 철회 불가 | ❌ 공유 후 철회 불가 |

| ZDR 호환 여부 | ✅ ZDR 신청 가능 | ❌ 옵션과 상충 | ❌ 옵션과 상충 |

| 권장 시나리오 | 프로덕션 / 컴플라이언스 / PII | 개발 / 테스트 / 공개 데이터 | 공개 벤치마크 평가 |

🎯 개인정보 보호 결정 가이드: 데이터 개인정보 보호와 관련된 컴플라이언스 요구사항(GDPR, HIPAA, 기업 NDA, 고객 PII 등)이 있다면 두 옵션 모두 비활성화(Disabled) 상태를 유지하세요. 민감한 트래픽은 APIYI(apiyi.com) 게이트웨이를 통하거나 ZDR을 신청하는 것이 좋습니다. 개인 프로젝트, 내부 도구, 해커톤 시연 등 공개적인 환경이라면 모든 프로젝트에 대해 활성화(Enabled)해도 무방합니다.

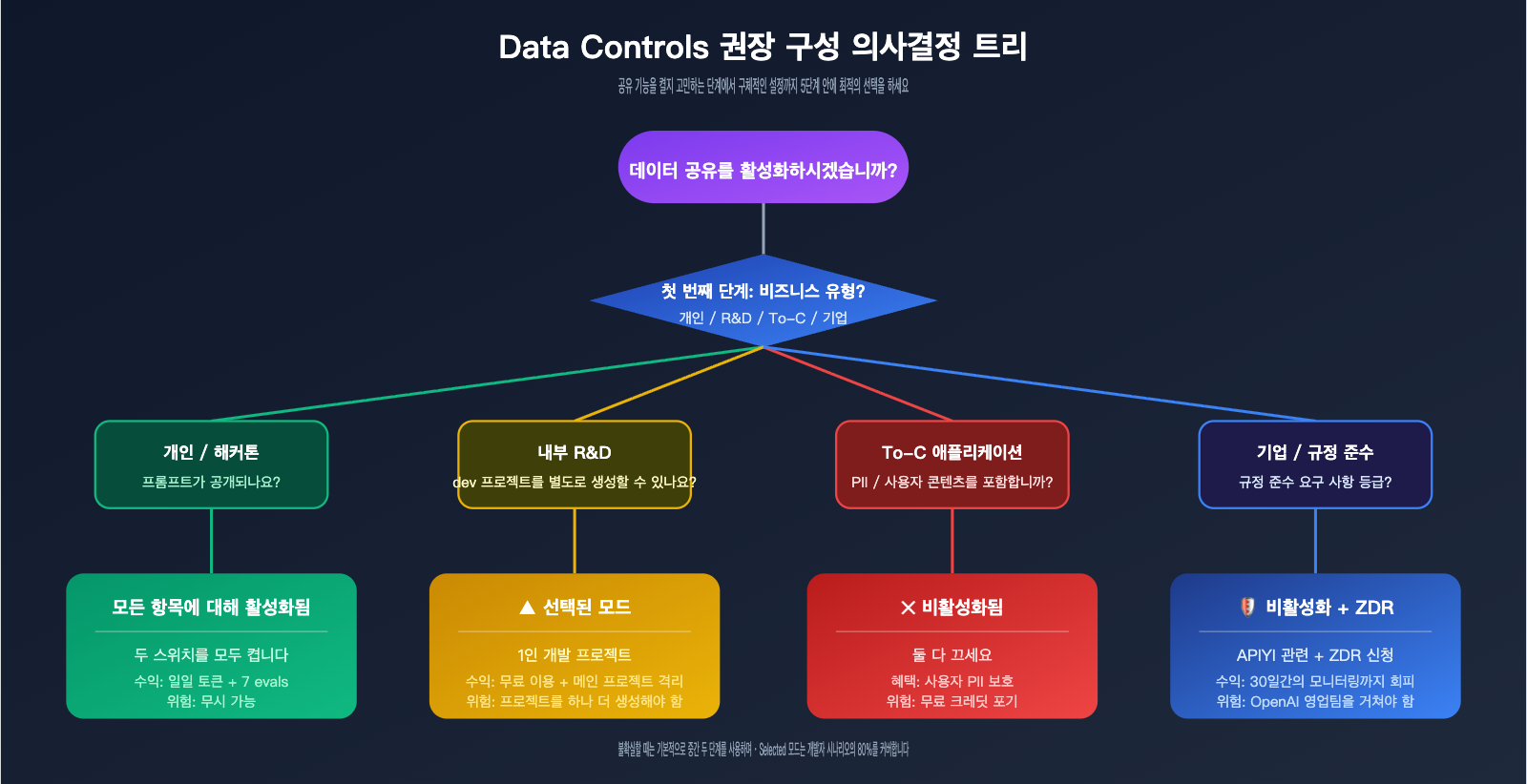

OpenAI 데이터 제어 옵션 활성화를 위한 4단계 결정 프레임워크

단순히 "켜라/꺼라"라고 답하기엔 복잡합니다. 4가지 대표적인 비즈니스 시나리오를 통해 매트릭스를 구성해 보았습니다. 결정의 핵심 기준은 데이터 민감도(처리하는 내용이 개인정보나 기밀을 포함하는가)와 호출 규모(무료 크레딧으로 얻을 수 있는 실질적 가치)입니다.

| 비즈니스 유형 | 데이터 민감도 | 권장 Inputs/Outputs | 권장 Eval/FT |

|---|---|---|---|

| 개인 개발 / 해커톤 | 낮음 | 모두 활성화 | 모두 활성화 |

| 내부 R&D / 모델 선정 | 중간 | 선택적 활성화 | 선택적 활성화 |

| To-C 앱 (PII 포함) | 높음 | 비활성화 또는 선택적(개발용) | 비활성화 |

| 기업 / 컴플라이언스 | 매우 높음 | 비활성화 + ZDR 사용 | 비활성화 |

첫 번째는 개인 개발이나 해커톤 프로젝트입니다. 이 경우 토큰 소비가 주로 공개된 프롬프트(대회 문제, 데모 코드 등)에서 발생하므로, 공유를 활성화하여 일일 보조금을 받는 것이 가성비 면에서 가장 유리합니다. 두 번째는 내부 R&D로, 'Selected' 모드를 사용하는 것을 추천합니다. 공유 가능한 실험용 프로젝트를 별도로 생성하고, 메인 개발 프로젝트는 비활성화 상태를 유지하세요.

세 번째는 사용자 입력, 대화 내역, 개인정보를 다루는 To-C 앱입니다. 이 경우 두 옵션 모두 끄는 것이 좋습니다. 무료 크레딧 혜택보다는 사용자 PII가 학습 파이프라인에 포함되었을 때 추적하기 어렵다는 위험이 더 큽니다. 네 번째는 의료, 금융, 공공 등 기업이나 컴플라이언스가 중요한 환경입니다. 이 경우 ZDR을 신청하거나 APIYI(apiyi.com)와 같은 규정 준수 게이트웨이를 사용하여 30일 오남용 모니터링까지 원천 차단해야 합니다.

🎯 3단계 옵션 선택법: 특정 옵션을 활성화하기로 했다면, 'Enabled for all projects'보다는 'Enabled for selected projects'를 우선 선택하세요. 이렇게 하면 '학습 허용' 프로젝트를 별도로 지정하여 개발/테스트용으로 사용하고, 프로덕션 프로젝트는 격리 상태를 유지할 수 있어 향후 설정 변경 시에도 마이그레이션 비용이 매우 낮습니다.

OpenAI Data Controls 자주 묻는 질문(FAQ)

Q1: Inputs/Outputs 설정을 켜면 OpenAI가 내 모든 과거 데이터를 즉시 가져가나요?

아니요. 두 스위치 모두 "Only traffic sent after turning this setting on will be shared"(이 설정을 켠 후 전송된 트래픽만 공유됨) / "Only evaluation and fine-tuning data created after turning this setting on will be shared"(이 설정을 켠 후 생성된 평가 및 파인튜닝 데이터만 공유됨)라고 명시되어 있습니다. 스위치는 켠 이후에 발생하는 데이터에만 적용되며, 과거 데이터는 소급하여 공유되지 않습니다.

Q2: 무료 토큰은 Credit Grants와 같은 것인가요?

완전히 같지는 않지만 연관되어 있습니다. Inputs/Outputs 공유를 통해 얻는 것은 '일일 토큰 풀'이며, UTC 00:00에 자동으로 초기화됩니다. OpenAI 관리자 페이지의 Credit Grants 항목에서 보이는 '소액의 센트' 단위 크레딧은 이 풀을 사용량에 따라 달러 가치로 환산하여 사후 정산한 기록입니다. 즉, 같은 프로젝트의 두 가지 표시 방식이라고 이해하시면 됩니다.

Q3: Selected 모드를 켜서 하나의 프로젝트만 공유하도록 설정하면, 메인 프로젝트 트래픽은 완전히 안전한가요?

완전히 안전합니다. OpenAI 설정 화면에서 공유에 참여할 프로젝트를 정밀하게 선택할 수 있습니다. 선택되지 않은 프로젝트의 트래픽은 기본 API 동작 방식(학습에 사용되지 않으며, 30일간 남용 모니터링만 수행)을 따릅니다. 만약 이마저도 걱정된다면, 메인 프로젝트 트래픽을 APIYI(apiyi.com)와 같은 게이트웨이로 우회시켜 아키텍처 수준에서 완전히 격리하는 것이 좋습니다.

Q4: Eval/FT 공유의 "7 free weekly evals"는 구체적으로 어떻게 계산되나요?

토큰 수가 아닌 '실행 횟수'를 기준으로 계산합니다. 평가(eval)를 한 번 실행할 때마다(처리하는 샘플 수와 관계없이) 1회로 간주하며, 매주 최대 7회까지 무료입니다. 이를 초과하면 평가에 사용된 모델의 표준 토큰 가격으로 과금됩니다. 일부 모델은 무료 목록에 포함되어 있지 않아 실행 시 즉시 요금이 부과될 수 있습니다.

Q5: Inputs/Outputs를 끈 후, 이미 수집된 데이터는 돌려받을 수 있나요?

아니요. OpenAI 정책상 이미 공유된 데이터는 철회할 수 없습니다. 스위치를 끄는 것은 향후 데이터가 학습 파이프라인으로 유입되는 것을 차단할 뿐입니다. 이것이 바로 저희가 프로덕션 트래픽에는 APIYI(apiyi.com)와 같은 게이트웨이를 사용하여 '하드 격리'를 할 것을 권장하는 이유입니다. 기본적으로 학습 파이프라인에 진입하지 않도록 설정하는 것이 '사후에 끄는 것'보다 훨씬 확실하기 때문입니다.

OpenAI Data Controls 3줄 요약

첫째, 이 두 스위치는 진정한 '양방향 거래'입니다. 실질적이고 정량화 가능한 데이터(평가 방법론, API 입출력)를 제공하고 그 대가로 정량화 가능한 무료 혜택(주 7회 평가, 일일 수백만~수천만 토큰)을 받는 것입니다. 이를 단순한 선물이 아닌 거래로 이해해야 전략적인 의사결정이 가능합니다.

둘째, 기본 API는 학습하지 않지만 30일간의 남용 모니터링은 여전히 유지됩니다. 비즈니스상 개인정보 보호 규정 준수가 중요하다면 두 스위치 모두 비활성화(Disabled)해야 하며, ZDR 신청이나 APIYI(apiyi.com)와 같은 규정 준수 게이트웨이를 통해 더 엄격하게 관리해야 합니다. 스위치는 '추가적인 학습 권한 부여 여부'만 결정할 뿐, '모니터링 여부'를 결정하지는 않습니다.

셋째, Selected 모드를 사용하여 '프로젝트별 격리'를 우선하세요. 공유 가능한 개발/테스트 트래픽 전용의 독립 프로젝트를 새로 만들고, 프로덕션 프로젝트와 민감한 데이터는 완전히 분리하세요. 이렇게 하면 무료 혜택은 챙기면서도 사용자 데이터가 학습 파이프라인으로 유입되는 것을 방지할 수 있는 가장 효율적인 방법입니다.

이 두 스위치를 저울질하고 계시다면, 가장 안전한 방법은 '개인 / 내부 / To-C / 기업' 네 가지 유형에 맞춰 등급을 결정한 뒤, Selected 모드를 사용하여 독립적인 테스트 프로젝트를 생성해 무료 혜택을 활용하는 것입니다. 메인 프로덕션 트래픽은 APIYI(apiyi.com) 게이트웨이를 통해 아키텍처적으로 격리하세요. 이렇게 하면 OpenAI의 무료 정책을 누리면서도 사용자 데이터와 비즈니스 노하우라는 개인정보 보호 경계를 확실히 지킬 수 있습니다.

📌 작성자: APIYI 기술팀 — OpenAI Data Controls, ZDR, 과금 정책 등 주요 정책 변경 사항을 지속적으로 추적하며, 통합 과금 및 프라이버시 제어가 가능한 멀티 모델 API 게이트웨이 경험을 제공합니다. 더 자세한 내용은 APIYI(apiyi.com)에서 확인하세요.