最近在サポートしているクライアントの画像生成ニーズを調査する中で、共有すべき興味深い現象が見つかりました。GPT-Image-2 は、純粋な透明背景の PNG を生成できなくなっているのです。プロンプトに「背景は必ず透明にしてください」と指定したり、API で background: "transparent" パラメータを直接渡したりしても、最新の GPT-Image-2 は実色背景の画像を返すか、エラーを返してしまいます。これは前世代の sora_image や gpt-4o-image と比較して明らかに能力が低下しており、ECサイトの SKU 切り抜き、SNS 用ステッカー、PPT 用イラストなどを制作するチームにとって大きな痛手となっています。

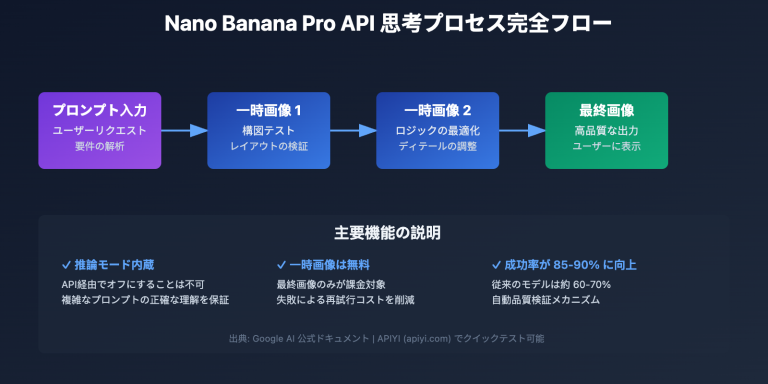

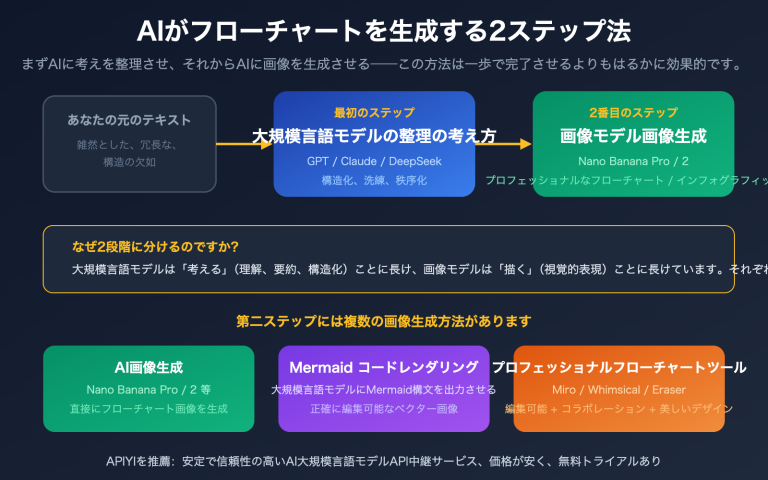

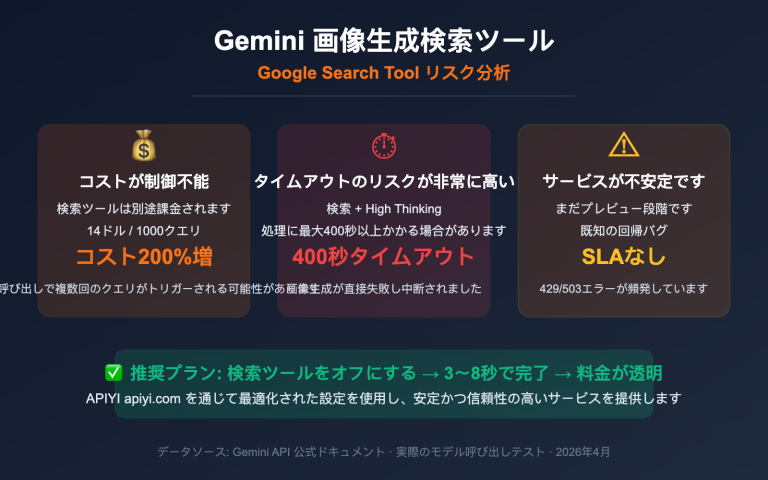

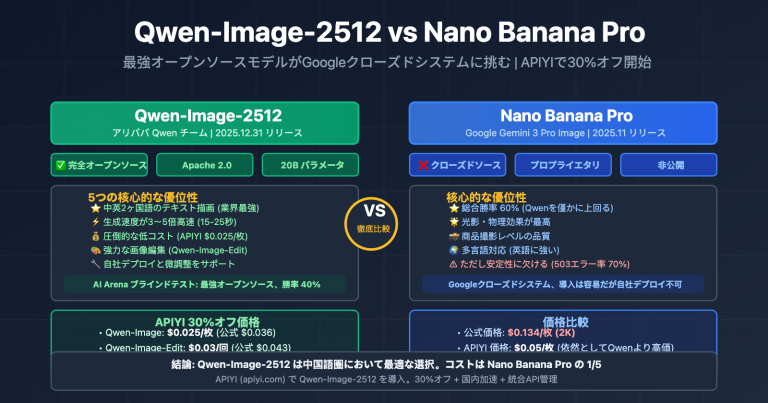

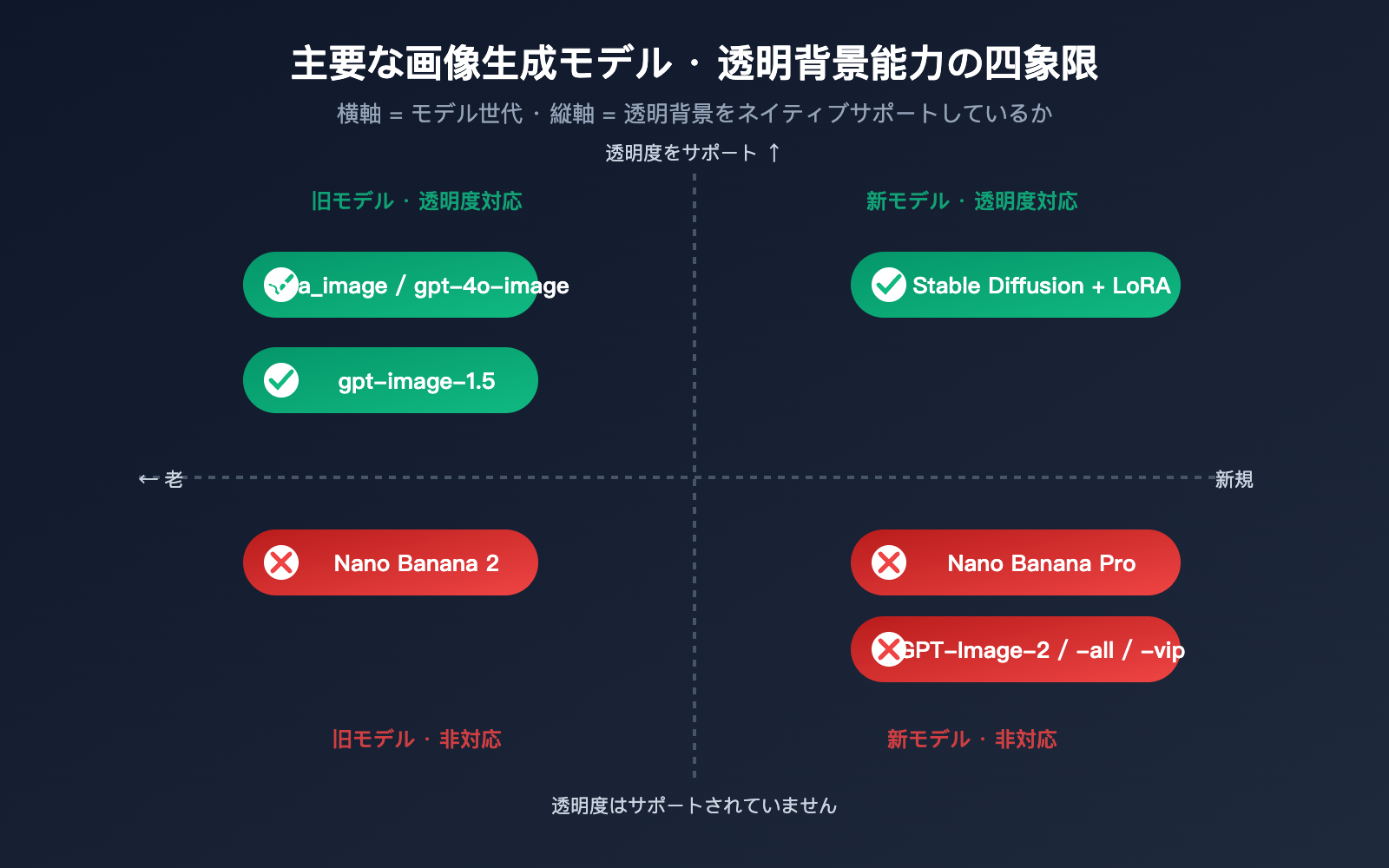

さらに興味深いことに、Google が 2025 年末にリリースしたフラッグシップモデル「Nano Banana Pro」(Gemini 3 Pro Image ベース)も同様に透明背景の生成をサポートしておらず、前世代の「Nano Banana 2」も同じ制限を抱えています。つまり、現在業界で主流の画像生成基盤モデルの二大巨頭が、一見基礎的とも思える「透明背景」という機能を切り捨ててしまったのです。私たちは APIYI (apiyi.com) で一連の回帰テストを実施し、現象、根本原因、代替案をまとめました。製品統合を進めているチームの迅速な意思決定にお役立てください。

GPT-Image-2 透明背景生成失敗の再現実験

この能力差を理解する最も手っ取り早い方法は、実際に試してみることです。私たちは APIYI ゲートウェイを使用して gpt-image-2、gpt-image-1.5、gpt-image-2-all の 3 つのバージョンを呼び出し、プロンプトを「a cute orange cat sticker, transparent background」に統一し、background パラメータを明示的に transparent に設定しました。結果は一貫しており、gpt-image-2 シリーズは 4xx エラーを返すか、実色や市松模様の背景画像を生成しました。唯一 gpt-image-1.5 だけが、アルファチャンネル付きの真の透明 PNG を返しました。

# APIYI ゲートウェイを通じて 3 つのバージョンの透明背景生成能力をテスト

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

# ❌ gpt-image-2 は transparent をサポートしておらず、ゲートウェイ層で拒否されます

client.images.generate(

model="gpt-image-2",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

# ✅ gpt-image-1.5 は依然として透明背景の出力をネイティブサポートしています

client.images.generate(

model="gpt-image-1.5",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

🎯 導入のアドバイス: 現在のワークフローをそのまま維持したい場合、最も低コストな方法は、モデル名を

gpt-image-1.5に戻し、base_url を APIYI (apiyi.com) に向けることです。他のパラメータは一切変更不要で、5 分以内に透明背景の出力能力を回復できます。

また、プロンプトに「background must be transparent」「isolated on transparent canvas」「PNG with alpha channel」といった指示を盛り込むテストも行いました。しかし、GPT-Image-2 は非常に頑固で、白背景を返すか、灰白の市松模様(透明であることを示す視覚的マーカー)を画像として描画してしまいます。これは Nano Banana Pro の失敗パターンと酷似しており、プロンプトの精度不足ではなく、モデルのセマンティック(意味的)アライメントレベルでの欠陥であると言えます。

| トリガー方法 | GPT-Image-2 の挙動 | gpt-image-1.5 の挙動 | 推奨アクション |

|---|---|---|---|

background="transparent" パラメータ |

API 拒否 / 実色 | 真の透明 PNG | モデルを切り替える |

| プロンプトに「transparent background」 | 白背景または市松模様 | 真の透明 PNG | テキストに依存しない |

| プロンプトに「isolated subject on white」 | 薄いグレー背景 | 主体は白背景 | パラメータと併用する |

出力 output_format=webp |

実色のまま | 真の透明 webp | webp は能力に影響しない |

| Edit インターフェース + アルファマスク | 無効 | 部分的に透明 | 1.5 のみ利用可能 |

GPT-Image-2で透明背景が廃止された3つの根本的な理由

GPT-Image-2において透明背景機能が削除された背景には、主に以下の3つの理由があります。

第一に、アーキテクチャレベルでの取捨選択です。OpenAIはGPT-Image-2の公式ドキュメントで「gpt-image-2 doesn't currently support transparent backgrounds(現在、GPT-Image-2は透明背景をサポートしていません)」と明記しています。理由は公開されていませんが、業界では、より強力な「シーンの一貫性」を重視するトレーニング目標への移行が関係していると推測されています。モデルは「切り抜き」ではなく「現実世界のシーンを補完する」ように学習されているため、根本的なレベルでアルファチャンネルの教師信号が削られているのです。これはバグではなく、製品設計上の意図的なトレードオフです。

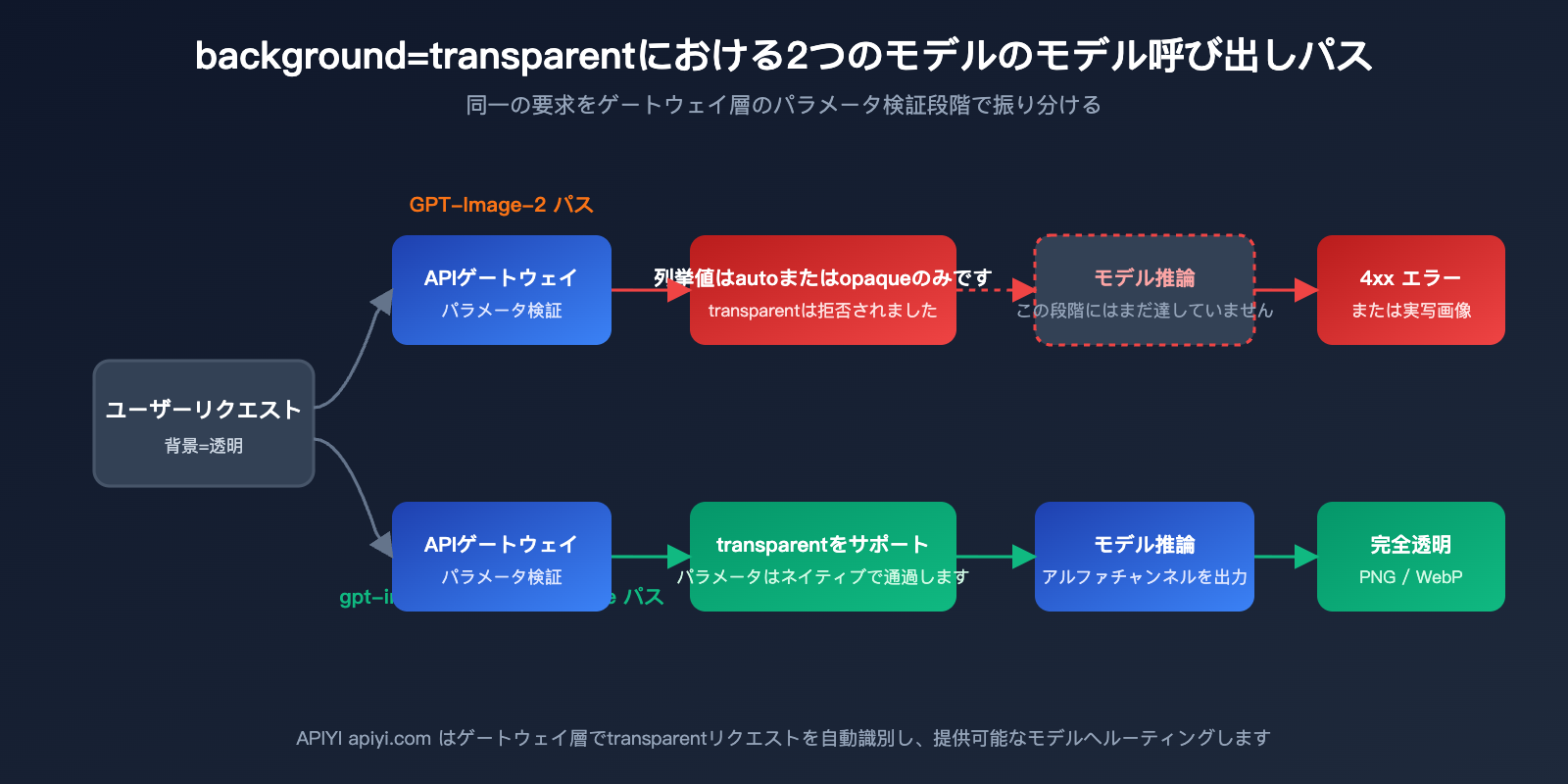

第二に、APIゲートウェイによる強制的なバリデーションです。OpenAIの公式エンドポイントのレスポンスを解析したところ、GPT-Image-2の background パラメータの列挙値は auto と opaque のみに制限されており、transparent はパラメータ空間から完全に削除されています。つまり、APIYIゲートウェイを含むあらゆる上位プラットフォームにおいて、リクエストの段階でこの呼び出しは拒否され、モデル推論のステップまで到達することはありません。「別のサードパーティプラットフォームを使えば回避できる」というのは誤解であり、gpt-image-2-allやgpt-image-2-vipといった「公式逆転」チャネルも、すべて同じバックエンドモデルを使用しています。

第三に、セキュリティと著作権のフィルタリング戦略です。透明背景画像は二次合成によく利用されますが、肖像権やブランドロゴが関わるケースが非常に多いのが実情です。OpenAIはこの2年間、「二次合成可能な素材」の出力権限を厳格化しており、GPT-Image-2にもより厳格なコンテンツ審査パイプラインが搭載されています。透明背景機能の廃止は、この方針と一致しています。

🎯 アーキテクチャの理解に関するアドバイス:APIYI(apiyi.com)のような統合ゲートウェイでは、GPT-Image-2とGPT-Image-1.5のパラメータ空間を個別に検証しています。

transparentリクエストが発生した場合には自動的にダウングレードを提案することで、ビジネス側で「呼び出しが失敗した理由がわからない」といった事態を防ぐようにしています。

GPT-Image-2 と Nano Banana Pro の透明背景生成能力の比較

多くのクライアントから「Google Nano Banana 2 / Nano Banana Pro に切り替えれば解決するのでは?」という質問をいただきますが、答えは非常に厳しいものです。結論から言うと、解決しません。Nano Banana Pro の失敗パターンは、GPT-Image-2 よりもさらに「厄介」です。一見すると「透明背景」の画像が生成されたように見えますが、よく見るとチェッカーボード模様(市松模様)が画像内の実色ピクセルとして描画されています。つまり、Photoshop の透明度を示すガイドパターンを「そのまま絵として描いてしまっている」状態なのです。

コミュニティでの現在の有力な説は、モデルの学習データに「透明をチェッカーボードで表現した」素材(ストックフォト、Photoshop のスクリーンショット、デザインチュートリアルなど)が大量に含まれており、モデルが「透明=チェッカーボード」という誤った関連付けを学習してしまったというものです。Google 公式も Gemini API フォーラムにて、Nano Banana シリーズは現時点で透明背景の出力をネイティブサポートしておらず、Gemini 3 Flash とコード実行を組み合わせることで「遠回りして解決する」必要があると認めています。

| モデル | リリース時期 | 透明背景サポート | 失敗時の挙動 | 推奨シーン |

|---|---|---|---|---|

| GPT-Image-2 | 2026 年初頭 | ❌ 非対応 | 実色背景 / エラー | 写実的なシーン、ポスター |

| GPT-Image-2-all(官逆) | 2026 年初頭 | ❌ 非対応 | 公式と同一 | GPT-Image-2 と同等 |

| GPT-Image-1.5 | 2025 年半ば | ✅ ネイティブ対応 | / | ステッカー、EC向け切り抜き |

| sora_image / gpt-4o-image | 2025 年 3 月 | ✅ 対応 | / | 既存ワークフローとの互換性 |

| Nano Banana 2 | 2025 年後半 | ❌ 非対応 | 灰白のチェッカーボード | 二次創作、スタイル化 |

| Nano Banana Pro | 2025 年末 | ❌ 非対応 | 灰白のチェッカーボード | 高忠実度編集 |

| Stable Diffusion + LoRA | 継続更新 | ✅ 間接対応 | 後処理が必要 | セルフホストによる大量生産 |

🎯 選定のヒント:単に「被写体を切り抜きたい」だけであれば、2026 年時点で最も効率的な組み合わせは、GPT-Image-1.5 / sora_image で直接出力するか、Nano Banana Pro で出力した後に背景除去処理を一度通すことです。これらのルートは APIYI (apiyi.com) 上で認証と課金を一元化できるため、業務側で複数のキーを管理する手間を省けます。

GPT-Image-2 で透明背景を実現する 4 つの代替案

GPT-Image-2 自体は透明背景の出力を拒否しますが、業務で実現するための成熟した代替ルートが 4 つあります。それぞれコストと品質のバランスが異なるため、シーンに応じて柔軟に組み合わせるのがおすすめです。

- sora_image / gpt-image-1.5 へのダウングレード:最も変更が少ない方法です。クライアント側のコードはほぼそのままに、

modelフィールドをgpt-image-2からgpt-image-1.5またはsora_imageに切り替えるだけで、アルファチャンネル付きの出力を即座に復元できます。代償として、写実性や長文レンダリング能力は GPT-Image-2 より劣りますが、ステッカー、ロゴ、EC用画像などには十分です。 - GPT-Image-2 出力 + 後処理での切り抜き:GPT-Image-2 で高品質な実色背景画像を生成し、その後に切り抜きモデル(851-labs/background-remover、RemBG、BiRefNet など)を接続してアルファチャンネルを抽出します。GPT-Image-2 の写実性を活かせますが、レイテンシが 1〜3 秒増加し、複雑なエッジ(髪の毛、ガラス、煙など)の精度は切り抜きモデルの性能に依存します。

- クロマキー(グリーンバック)法:プロンプトで「solid pure green background, hex #00ff00」と強制し、GPT-Image-2 に純色の背景画像を生成させ、コードで HSV 色空間の閾値処理を行って置換します。汎用的な切り抜きよりも高速で安価ですが、被写体自体に緑色が含まれている場合は不向きです。

- 二重底画像による減算処理:GPT-Image-2 で同じシード値を使用して「白背景」と「黒背景」の 2 枚を生成し、ピクセルごとの色差を計算してアルファ値を逆算します。OpenAI コミュニティで議論されている「ハードコア」な手法で、品質は最も安定していますが、コストは 2 倍になります。

| 代替案 | 実装の複雑さ | 追加コスト | エッジ品質 | 適用シーン |

|---|---|---|---|---|

| GPT-Image-1.5 / sora_image へ切り替え | ⭐ | 0 | 高 | ステッカー、EC主画像 |

| GPT-Image-2 + 汎用切り抜きモデル | ⭐⭐ | 切り抜き 1 回分 | 中〜高 | 写実的な人物、製品画像 |

| クロマキー(グリーンバック)法 | ⭐⭐⭐ | ほぼゼロ | 中 | キャラクター、幾何学図形 |

| 二重底画像による減算処理 | ⭐⭐⭐⭐ | 出力コスト 2 倍 | 高 | ガラス、髪の毛などの複雑なエッジ |

🎯 エンジニアリングのアドバイス:APIYI (apiyi.com) では、「透明背景が必要」というリクエストをデフォルトで gpt-image-1.5 にルーティングしています。もし GPT-Image-2 の写実的なスタイルを維持したい場合は、統一インターフェースを通じて「生成+切り抜き」を 2 ステップの直列処理として実装し、エンドポイントを一つにまとめることで、業務側の実装を簡素化できます。

プロジェクトでエッジの品質とコストの両方が重要な場合、以下の切り抜きツール比較表を参考にしてください。

| 切り抜きツール | エッジ精度 | 平均処理時間 | デプロイ形態 | 推奨組み合わせ |

|---|---|---|---|---|

| 851-labs/background-remover | 高 | 1.5-2 秒 | クラウド API | GPT-Image-2 の写実画像 |

| RemBG(U2Net) | 中 | 0.5 秒 | セルフホスト | 純色背景、バッチ処理 |

| BiRefNet | 極めて高い | 2-3 秒 | セルフホスト | 髪の毛、複雑なエッジ |

| HSV 色彩閾値 | 中 | 0.1 秒未満 | Python 数行 | クロマキー(グリーンバック) |

GPT-Image-2 透明背景に関するFAQ

Q1:GPT-Image-2 のプロンプトで「背景を透明にする」と指定しても失敗するのはなぜですか?

モデルが「アルファチャンネルを出力する」という学習を行っておらず、RGB空間での描画のみに対応しているためです。無理に「transparent background(透明な背景)」と指定すると、モデルはそれを「透明を表現する視覚記号」と解釈し、結果として市松模様(チェッカーボード)の背景を描画してしまいます。これは典型的なセマンティックアライメント(意味的整合)の失敗であり、プロンプトをどれだけ詳細に書いても解決できません。

Q2:gpt-image-2-all / gpt-image-2-vip などの公式逆プロキシ経由でもダメなのはなぜですか?

公式逆プロキシは、本質的には同じOpenAIのバックエンドモデルを呼び出しているだけであり、フロントエンドでアカウントプールやプロキシを構築しているに過ぎません。モデル自体が対応していない機能は、フロントエンドでどのようにパッケージングしても補完することはできません。一部のサードパーティプラットフォームが「GPT-Image-2 は透明背景をサポートしている」と謳っている場合、それは多くの場合、APIゲートウェイ層でバックグラウンド処理として背景削除を行っているだけであり、GPT-Image-2 がネイティブで透明背景を出力しているわけではありません。

Q3:プロジェクトで透明背景が必要な場合、どの API を選ぶべきですか?

APIYI (apiyi.com) での実測に基づくと、以下の選択を推奨します。ステッカーや絵文字、ECサイトのメイン画像には「GPT-Image-1.5」を、写真レベルのリアルな切り抜きが必要な場合は「GPT-Image-2 + 切り抜きモデル」を、国内のコンプライアンス要件がある場合は「Stable Diffusion シリーズのセルフホスト」を検討してください。これら3つの選択肢はすべて同一のゲートウェイ内で切り替え可能なため、A/Bテストが容易です。

Q4:GPT-Image-2 / Nano Banana Pro はいつ透明背景をサポートするようになりますか?

OpenAI も Google も公式なスケジュールは発表していません。過去のアップデート傾向から見ると、OpenAI はマイナーバージョン(GPT-Image-2.1 や 2.5 など)で不足しているパラメータを補完する可能性があります。一方、Google の Nano Banana シリーズは、基盤モデルを修正するのではなく、Gemini 3 Flash + コード実行という「組み合わせ技」で解決する傾向にあります。

Q5:APIYI (apiyi.com) はこの問題に対してどのようなサポートを提供していますか?

私たちは以下の3点を提供しています:①ゲートウェイ層で transparent というリクエストを自動識別し、ダウングレードを提案する機能、②GPT-Image-1.5、GPT-Image-2、Nano Banana Pro など複数のモデルルートを統合、③統一された課金・クォータ・ログ管理を提供し、チームが複数の SDK を自前で保守することなく、各ソリューションの真のコストを比較できるようにしています。

GPT-Image-2 透明背景問題の3つのまとめ

第一に、GPT-Image-2 が透明背景をサポートしないことは確定した製品戦略であり、プロンプトの書き方や接続方法の問題ではありません。プロンプトで「transparent」という言葉を試行錯誤するワークフローは、早急に 1.5 への移行や後処理パイプラインの構築に切り替えるべきです。そうしなければ、市松模様の背景から抜け出せなくなります。

第二に、Nano Banana 2 / Pro も同様に透明背景をサポートしていません。現時点でこの分野の「ネイティブな透明出力」は、前世代の GPT-Image-1.5、sora_image / gpt-4o-image、あるいは Stable Diffusion のセルフホストに頼るしかありません。「隠しスイッチ」があることを期待するのは現実的ではありません。

第三に、ビジネスにおいて最も安定した手法は、モデルをゲートウェイの背後に抽象化することです。「透明背景のニーズ」をゲートウェイ内で自動的に対応可能なモデルへルーティングさせるのが最適です。このルーティング戦略はすでにデフォルトの動作として実装済みです。チームは試行錯誤の時間を節約し、本来のビジネスロジックに集中することができます。

画像生成関連のワークフローを再構築中であれば、ぜひ APIYI (apiyi.com) で回帰テストを行ってみてください。既存のプロンプトを GPT-Image-2 と GPT-Image-1.5 の両方で実行すれば、10分以内に「どのシーンでどのモデルを使うべきか」という対照表を作成でき、直接ダウングレードするか、切り抜き処理を挟むかを判断できます。

📌 著者: APIYI 技術チーム — OpenAI、Google、Anthropic などの主要モデルの機能変更を継続的に追跡し、開発者に統一されたマルチモデル API ゲートウェイ体験を提供します。詳細は APIYI (apiyi.com) をご覧ください。