OpenAI は 2026 年 3 月 24 日、開発者向け通知を通じて Sora-2 API のサービス終了日が 2026 年 9 月 24 日であることを正式に発表しました。これは、sora-2、sora-2-pro、および Videos API に依存するすべての動画生成サービスが、半年以内に移行を完了しなければならないことを意味します。

さらに注意すべき点は、ここ半年間市場に出回っていたいわゆる「リバースエンジニアリングされた Sora API」のほとんどが、OpenAI のセキュリティ強化により既に使用不可能になっていることです。このルートに頼り続けることは、ビジネス上のリスクを増大させるだけです。本記事では、Sora-2 API の終了スケジュールと影響範囲を詳しく解説し、実測データに基づいた、実運用に耐えうる代替案として、ByteDance の SeeDance 2.0 と Alibaba 通義の Wan 2.7 を推奨します。

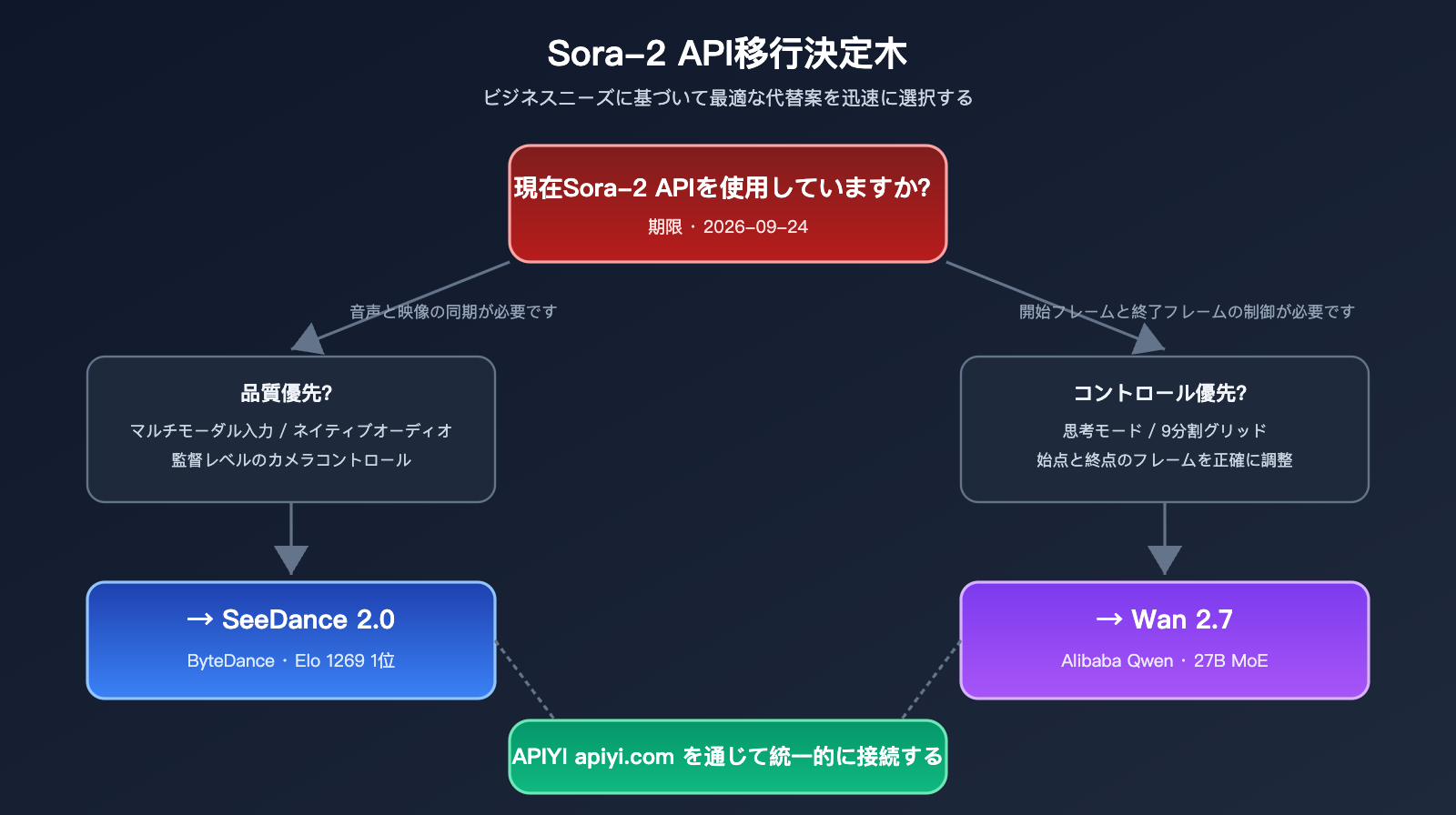

現在 Sora-2 API を使用して動画コンテンツを制作されている場合は、APIYI (apiyi.com) プラットフォームを通じて SeeDance 2.0 と Wan 2.7 の比較テストを行うことをお勧めします。同プラットフォームは、主要な動画生成モデルを統合しており、移行コストを最小限に抑えることが可能です。

Sora-2 API 終了スケジュールと影響範囲

Sora-2 API 終了の公式タイムライン

OpenAI は Sora 製品に対して2段階のクローズ戦略を採用しています。コンシューマー向けサービスを先に終了し、法人向け API を後に終了させることで、開発者が移行するための約 5 か月の猶予期間を設けています。これは OpenAI の歴史上、製品ラインの終了において最も丁寧な「ソフトランディング」ですが、開発者に残された時間は依然として非常にタイトです。

| 日程 | イベント | 対象 | 猶予期間 |

|---|---|---|---|

| 2026-03-24 | 公式通知の発行 | すべての Sora-2 API 利用者 | T+0 |

| 2026-04-26 | Sora Web版およびアプリ終了 | 一般ユーザー、クリエイター | T+33日 |

| 2026-09-24 | Sora-2 API 正式終了 | すべての API 統合サービス | T+184日 |

| 2026-09-25以降 | API エンドポイントが 410 Gone を返却 | 未移行のサービスは完全に停止 | — |

OpenAI はヘルプセンターにおいて、Sora で生成した過去の動画コンテンツを保存したい場合は、4 月 26 日のアプリ終了までに必ずデータのエクスポートを完了するよう明記しています。しかし、API を通じて統合している開発者にとっての真の締め切りは 9 月 24 日です。

特筆すべきは、OpenAI が通知の中で「延期」の可能性を示唆していない点です。2025 年以降の OpenAI によるモデル終了の実行状況を見ると、期限が来れば即停止が標準的な運用となっており、楽観視は禁物です。

Sora-2 API 終了の影響を受けるモデル一覧

多くのチームが sora-2 というエイリアスのみが終了すると考えていますが、実際にはVideos API モデル全体が退役します。

| モデル ID | タイプ | ステータス | 推奨代替案 |

|---|---|---|---|

sora-2 |

標準版エイリアス | 終了 | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

高画質版エイリアス | 終了 | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

標準版スナップショット | 終了 | SeeDance 2.0 |

sora-2-2025-12-08 |

標準版スナップショット | 終了 | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

Pro版スナップショット | 終了 | Wan 2.7 (Thinking Mode 含む) |

| Videos API (全インターフェース) | API エンドポイント | 全体停止 | 統合プラットフォームで互換対応 |

つまり、OpenAI は動画生成 API の入り口を一切残さないということです。9 月 25 日以降、videos で始まるすべてのリクエストは 410 Gone エラーまたは廃止エラーを返します。これは、従来の GPT シリーズモデルが「スナップショットは終了するがエイリアスは残す」という手法をとっていたのとは異なり、事業ラインそのものの撤退を意味します。

🎯 重要情報: これは、単に「モデル名を変更する」だけで移行が完了するわけではないことを意味します。全く異なる動画生成 API へ切り替える必要があります。6 月末までに新スキームの接続テストを完了させることを推奨します。APIYI などの統合プラットフォームを利用すれば、SeeDance 2.0 と Wan 2.7 の両候補を一度に比較でき、直前の慌ただしい移行を回避できます。

Sora-2 API 終了の真の理由

OpenAI は詳細な説明を行っていませんが、The Decoder、Futurum Group、Wikipedia などの英語メディアの分析を総合すると、主な理由は以下の 3 つに集約されます。

- 持続不可能な計算コスト: 動画生成の 1 回の呼び出しに必要な GPU 時間はテキストモデルの数十倍であり、商業収益がコストをカバーできていません。Sora-2 公開後、OpenAI はユーザーごとのクォータに厳しい制限を課さざるを得ず、これが開発者の統合意欲を削ぐ結果となりました。

- 高いコンテンツセキュリティリスク: 透かしやコンテンツ審査を導入したにもかかわらず、Sora はディープフェイクや著作権問題を繰り返し引き起こしており、法務・コンプライアンスコストがモデル自体の価値を大きく上回っていました。

- 戦略の集中: OpenAI は計算リソースを GPT 主軸、Operator、および Agent 事業に優先的に投入しており、動画はもはやコアな方向性ではないと判断されました。

これらの理由を理解することは、代替案を選択する上で非常に重要です。動画生成に継続的に投資できる企業は、動画を戦略のメインストリームとして捉えているプレイヤーであるはずです。ByteDance と Alibaba は、動画生成を重要な戦略的方向性と位置づけており、その製品開発のスピードは OpenAI を遥かに凌駕しています。これが、2026 年に彼らが Sora-2 のユーザー層を迅速に引き継げる根本的な理由です。

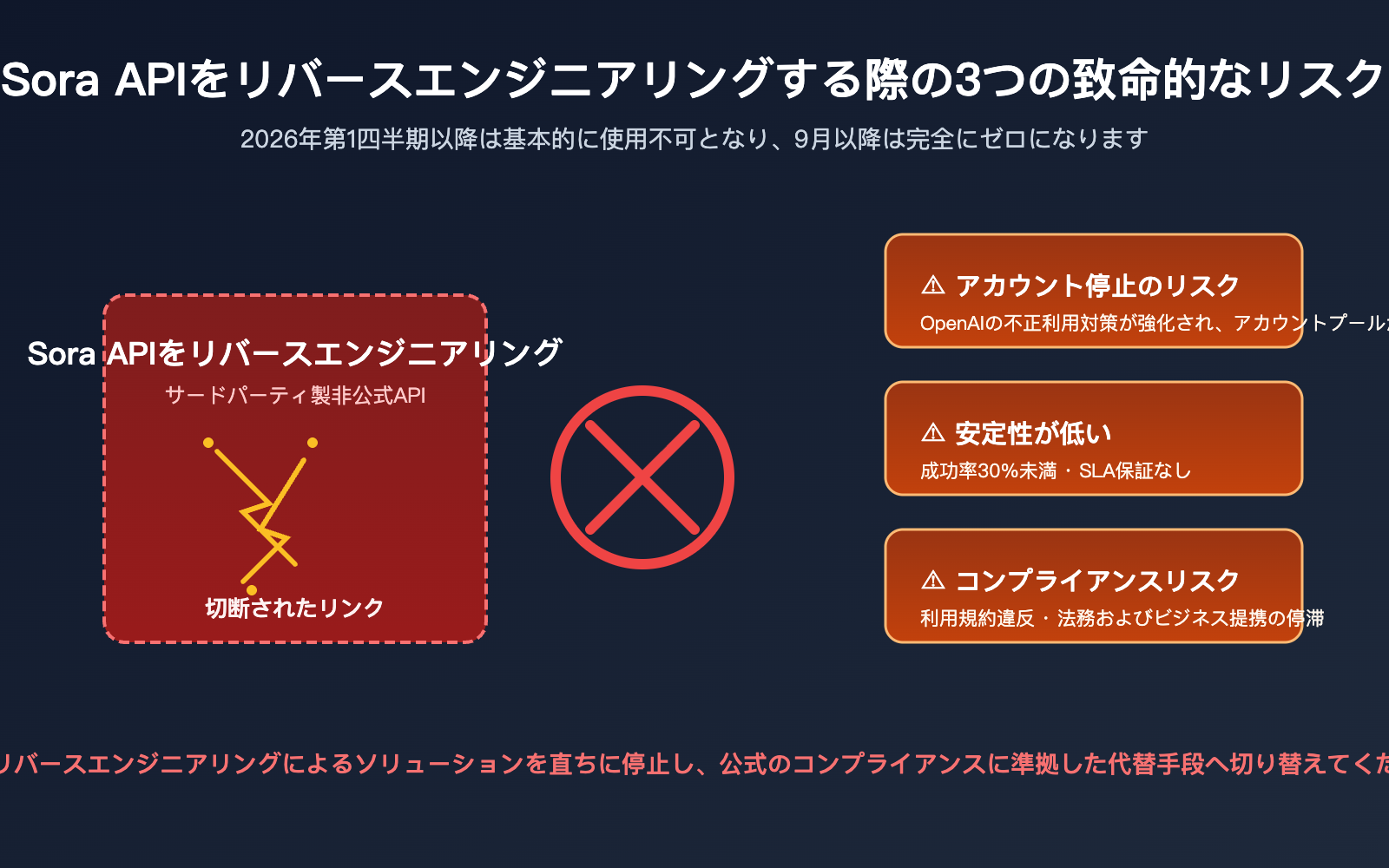

なぜ「Sora APIの逆向(リバースエンジニアリング)」がもはや選択肢ではないのか

2026年におけるSora API逆向の現状

過去半年間、中国語圏では「OpenAIアカウントなしでSora-2を呼び出せる」と謳う逆向APIが流通しており、価格も公式の数分の一から十数分の一程度でした。しかし、多くの開発者コミュニティからのフィードバックによると、これらのインターフェースは2026年第1四半期以降、ほぼ利用不可能になっています。

- OpenAIは2026年1月にCloudflareの不正利用対策ルールを強化し、多くの逆向APIが403エラーを返すようになりました。

- 一部のサービスプロバイダーはアカウントプールを利用していますが、OpenAIによる異常な大量アカウントの凍結措置が強化されたことで、プール全体が機能不全に陥っています。

- たまに接続できても、生成速度が極めて遅く、成功率も30%未満であり、実務での利用は不可能です。

- 逆向サービス提供者の多くが「夜逃げ」や事業転換を図っており、前払いした残高が消失するリスクが高まっています。

さらに重要なのは、OpenAIが9月24日に公式APIの提供終了を決定した以上、逆向APIの「上流」も完全に消滅するということです。この道は9月以降、完全に閉ざされます。

逆向ソリューションへの投資を今すぐ止めるべき3つの理由

| リスクの側面 | 具体的な状況 | ビジネスへの影響 |

|---|---|---|

| 安定性のリスク | APIがいつ遮断されるか不明、SLA保証なし | 本番環境の突然の停止 |

| コンプライアンス | OpenAI利用規約違反、アカウント売買に関与の可能性 | 法務およびビジネス提携への支障 |

| 埋没コスト | 9月以降の公式終了により、逆向も無効化 | 二重の移行作業によるリソースの無駄 |

| データリスク | 第三者代理店がプロンプトや生成内容にアクセス可能 | 企業秘密の漏洩 |

⚠️ 推奨: もし現在、何らかの形で逆向Sora APIを使用している場合は、直ちに新規機能の開発を停止し、公式かつコンプライアンスに準拠した代替案を優先的に検討してください。サービス安定性を確保し、将来的なコンプライアンス審査を回避するためにも、APIYIのような信頼できるアグリゲーションプラットフォームを通じて、SeeDance 2.0やWan 2.7へ直接接続することを強くお勧めします。

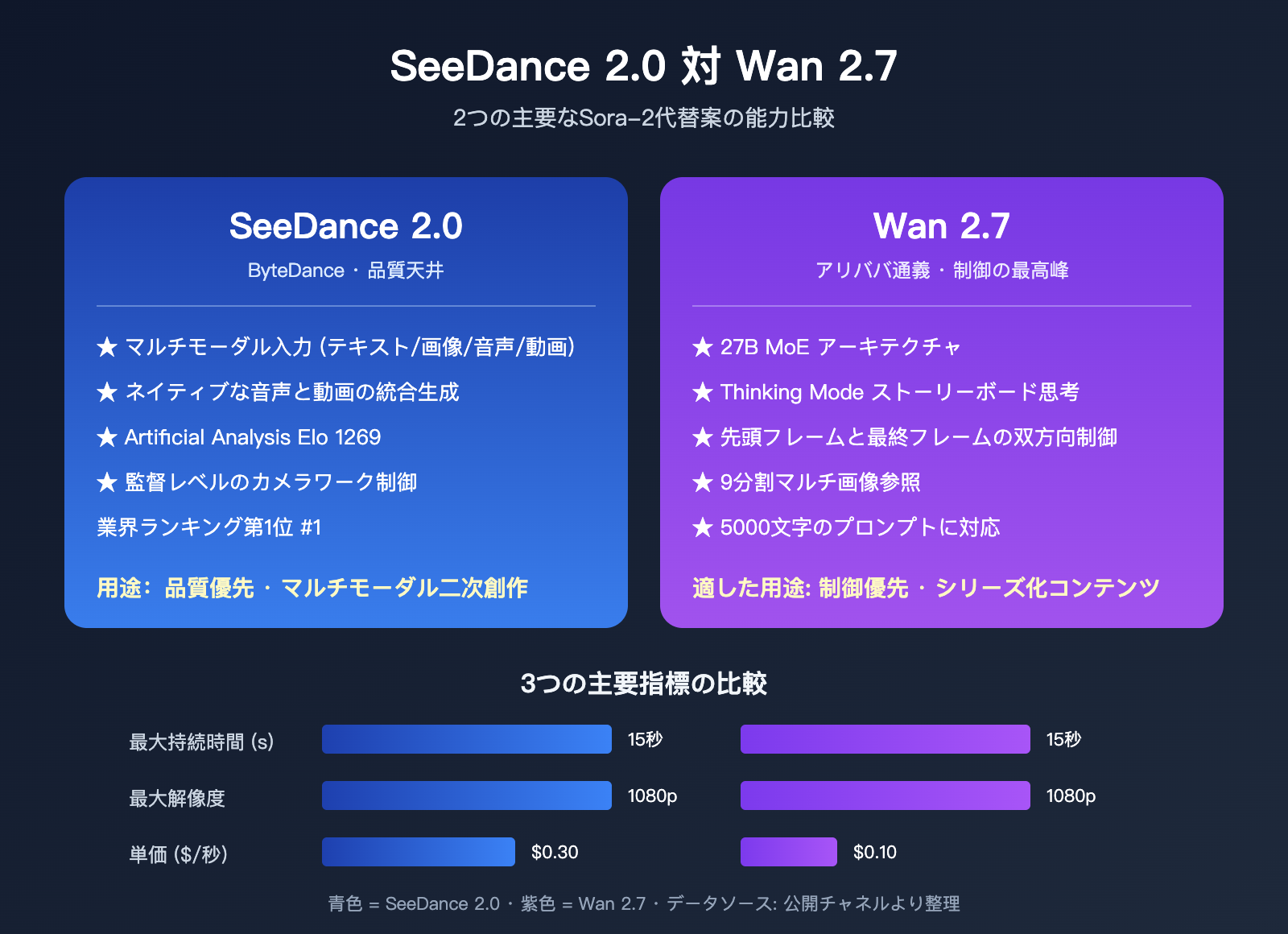

Sora-2 APIの代替案 1: SeeDance 2.0

SeeDance 2.0の核となるポジショニング

SeeDance 2.0は、ByteDanceの豆包(Doubao)大規模言語モデルチームが2026年2月9日に正式発表したフラッグシップ動画生成モデルです。4月14日に火山エンジン(BytePlus)のModelArkプラットフォームで公開テストが開始され、4月9日にはfalプラットフォームでも利用可能になりました。Artificial Analysisの動画モデルランキングにおいて、SeeDance 2.0はElo 1269というスコアを記録し、Google Veo 3、OpenAI Sora 2、Runway Gen-4.5を上回る、現在公開されているランキングで第1位のモデルです。

最大の特徴は、統合されたマルチモーダル音動画同時生成アーキテクチャを採用している点です。動画を生成した後に音声を補完するのではなく、一度の推論で最大15秒の映画品質の音動画を同時に出力します。この「音と映像の同源」能力は、動画を生成した後に外部のTTSを接続するSora-2の方式では到達不可能なレベルです。

SeeDance 2.0の主要機能一覧

| 機能の側面 | SeeDance 2.0の性能 | Sora-2との比較 |

|---|---|---|

| 最大生成時間 | 15秒 | 同等 |

| 同期音声 | ネイティブな音動画同時生成 | Sora-2は別途TTSが必要 |

| 入力モダリティ | テキスト / 画像 / 音声 / 動画 | Sora-2はテキスト+画像のみ |

| カメラ制御 | 監督レベルのカメラワーク指示 | Sora-2は比較的弱い |

| 物理的リアリティ | 業界トップクラス | 同等 |

| Artificial Analysis Elo | 1269 (#1) | ~1180 |

| 公開利用チャネル | BytePlus ModelArk / fal / アグリゲーションプラットフォーム | OpenAI公式(終了予定) |

| 中国語プロンプト理解 | 優秀 | 普通 |

SeeDance 2.0は現在、APIYI (apiyi.com) プラットフォームを通じて内覧利用が可能です。Sora-2の代替案をお探しの場合は、プラットフォームのカスタマーサポートまでご連絡いただき、SeeDance 2.0の試用枠を申請してください。OpenAI互換プロトコルを使用して統合的に呼び出すことができます。

SeeDance 2.0の呼び出し例

以下は、OpenAI互換インターフェースを使用してSeeDance 2.0を呼び出すシンプルな例です。

from openai import OpenAI

# APIYI経由での呼び出し

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="seedance-2.0",

prompt="オレンジ色の猫が窓辺からソファに飛び移る。夕日がブラインドから差し込み、カメラが猫をゆっくりと追いかける",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 完全な呼び出し例(例外処理とポーリングを含む)

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

# タスクの作成

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

# 完了までポーリング

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"タスク失敗: {status.error}")

time.sleep(5)

except Exception as e:

print(f"呼び出し例外: {e}")

return None

url = generate_seedance_video(

prompt="雨上がりのロンドンの街を走るレトロな赤い二階建てバス、窓には街灯の反射が映る",

duration=12

)

print(url)

SeeDance 2.0の適用シーン

- ブランド向けショート動画: ネイティブ音声と映画級のカメラワークにより、広告やブランド素材に最適。

- マルチモーダル二次創作: 音声や動画を入力参照としてサポートしており、IPコンテンツの派生制作に適しています。

- キャラクターの一貫性: マルチモーダル参照能力が優れており、シリーズ化されたコンテンツ制作に向いています。

- 海外SNS向け配信: 16:9 / 9:16 / 1:1といった複数のアスペクト比で出力可能で、TikTok、YouTube、Instagramに直接対応。

- 音楽MV: 音動画同時生成により、映像と音楽のリズムを自然に同期させることが可能です。

title: "Sora-2 API の代替案 2: Wan 2.7"

description: "Sora-2 API に代わる強力な選択肢「Wan 2.7」を徹底解説。27B MoEアーキテクチャ、思考モード、首尾フレーム制御など、その驚異的な性能と活用方法を紹介します。"

Sora-2 API の代替案 2: Wan 2.7

Wan 2.7 の核心的な位置づけ

Wan 2.7 は、アリババの通義(Tongyi)ラボが 2026年3月にリリースした次世代動画生成モデルです。**27BパラメータのMoE(Mixture-of-Experts)**アーキテクチャをベースとし、Diffusion TransformerとFlow Matching技術を採用しています。Alibaba CloudのDashScopeプラットフォームおよびWaveSpeedAIプラットフォームを通じて公開されており、中国国内メーカーとして初めてAPIを公開したMoE動画生成モデルとなります。

SeeDance 2.0 がマルチモーダル融合を主軸にしているのに対し、Wan 2.7 の大きな特徴は「Thinking Mode(思考モード)」と「首尾フレームの精密制御」です。動画生成前に構成を「思考」させたり、開始と終了のキーフレームを指定したりすることが可能で、これらは現在のSora-2 APIにはない強力な機能です。

Wan 2.7 の主要機能一覧

| 機能項目 | Wan 2.7 の性能 | Sora-2 との比較 |

|---|---|---|

| モデルアーキテクチャ | 27B MoE | 非公開 |

| 最大生成時間 | 15秒 | 同等 |

| 最大解像度 | 1080p | 同等 |

| 思考モード | ✅ 対応 | ❌ 非対応 |

| 首尾フレーム制御 | ✅ 開始・終了両方を指定可能 | ❌ 開始のみ |

| 9分割参照画像 | ✅ 最大9枚まで対応 | ❌ 非対応 |

| 主体+音声参照 | ✅ 組み合わせ参照に対応 | ❌ 非対応 |

| プロンプト上限 | 5000文字 | 約1000文字 |

| 公開APIチャネル | DashScope / WaveSpeedAI / 集約プラットフォーム | OpenAI公式(終了予定) |

| 単価目安 | $0.10/秒〜 | $0.50/秒〜 |

🎯 活用アドバイス: ブランドのオープニングやエンディング、広告のカウントダウンなど、開始・終了画面に明確な指定がある場合、Wan 2.7 の首尾フレーム制御機能はSora-2では代替不可能な強力な武器となります。APIYIなどの集約プラットフォーム経由で利用すれば、面倒なSDKの署名処理などを意識せずに簡単に呼び出せます。

Wan 2.7 の呼び出し例

from openai import OpenAI

# APIYI経由でWan 2.7を呼び出す例

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="サイバーパンク風のネオン街、カメラが地面からゆっくりと上昇し、街全体を見下ろす俯瞰ショット",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 Wan 2.7 複数画像参照の完全サンプル(9分割入力 + 思考モード)

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# 9枚の参照画像リストを用意

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"主人公が9つの異なるシーンを通過する様子。"

"各シーンは参照画像の1枚に対応し、"

"動画全体を通して人物の容姿や服装の一貫性を保つこと"

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

Wan 2.7 の活用シーン

- ブランドのオープニング・エンディング: 首尾フレームの精密制御により、後編集での調整が不要。

- キャラクターの一貫性保持: 9分割参照画像により、複数のカットでもキャラクターの崩れを防ぐ。

- 複雑な構成の動画: 思考モードが自動的にレンズ構成を計画するため、ショートドラマや広告に最適。

- 指示ベースの編集: 自然言語による指示で、既存の動画を編集可能。

- ストーリーテリング: 複数のキーフレームを一度に入力し、物語性のある一貫した動画を生成。

SeeDance 2.0 vs Wan 2.7 vs Sora-2 徹底比較

三大モデルの主要指標比較

| 比較項目 | Sora-2 (終了予定) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| 提供元 | OpenAI | ByteDance | Alibaba Tongyi |

| リリース日 | 2025-10 | 2026-02-09 | 2026-03 |

| サービス状況 | 2026-09-24 終了 | 公開ベータ | 公開ベータ |

| 最大動画時間 | 15s | 15s | 15s |

| 最高解像度 | 1080p | 1080p | 1080p |

| ネイティブ音声 | ✅ | ✅ (同時生成) | ✅ |

| マルチモーダル入力 | テキスト+画像 | テキスト+画像+音声+動画 | テキスト+複数参照画像 |

| 開始/終了フレーム制御 | ❌ | ❌ | ✅ 双方向 |

| Thinking Mode | ❌ | ❌ | ✅ |

| Artificial Analysis Elo | ~1180 | 1269 (#1) | 未ランクイン |

| 日本語対応 | 普通 | 優秀 | 優秀 |

| 国内利用の適合性 | ❌ | ✅ | ✅ |

| 単価目安 | $0.50/秒 | $0.30/秒 | $0.10/秒〜 |

シーン別選定ガイド

| ビジネスシーン | 推奨ソリューション | 理由 |

|---|---|---|

| ブランド広告動画 | SeeDance 2.0 | 音声同期と映画のようなカメラワーク |

| ショートドラマ/シリーズ物 | Wan 2.7 | 9分割参照によるキャラクターの一貫性維持 |

| オープニング/エンディング | Wan 2.7 | 開始・終了フレームの精密な制御 |

| マルチモーダル二次創作 | SeeDance 2.0 | 音声・動画の参照入力に対応 |

| 日本語プロンプト駆動生成 | 両方可 | Sora-2 より日本語理解が優れている |

| 最高品質優先 | SeeDance 2.0 | Artificial Analysis で1位 |

| コスト重視の大量生成 | Wan 2.7 | $0.10/秒〜で価格優位性が高い |

| 海外SNS向けコンテンツ | SeeDance 2.0 | 多様なアスペクト比のネイティブ出力 |

| EC商品動画 | Wan 2.7 | 被写体参照による商品イメージの維持 |

💡 選定アドバイス: 短期的に一つだけ選ぶなら、「品質優先」なら SeeDance 2.0、「制御・コスト優先」なら Wan 2.7 が適しています。集約プラットフォームで両方のモデル呼び出し権限を取得し、業務に応じて動的にルーティングすることで、移行期間中も柔軟性を最大限に確保できます。

三大モデルのコスト試算 (10秒 1080p 動画)

| モデル | 1回あたりの推定コスト | 月間1万回あたりの推定コスト | 備考 |

|---|---|---|---|

| Sora-2 | ~$5.00 | ~$50,000 | 9月以降利用不可 |

| SeeDance 2.0 | ~$3.00 | ~$30,000 | ネイティブ音声含む |

| Wan 2.7 | ~$1.00 | ~$10,000 | 入門価格 |

注: 上記データは公開情報を基に整理したものです。実際の価格は各社の最新料金表をご確認ください。集約プラットフォーム経由の呼び出しは、個別に契約するよりも割引が適用されることが一般的です。

Sora-2 API から代替案への移行クイックスタート

移行経路の決定フロー

Sora-2 API からの移行は、主に以下の4ステップで進めます:

- 既存の Sora-2 呼び出しの棚卸し:

sora-2または Videos API を使用しているコード箇所を特定し、プロンプトテンプレート、入力パラメータ、出力処理ロジックをリストアップします。 - ターゲットモデルの選択: 前述の選定ガイドに基づき、メインで使用するモデルを決定します。

- base_url とモデル名の置換: OpenAI の

base_urlを APIYI などの集約プラットフォームの URL(例:https://api.apiyi.com/v1)に変更し、モデル名をseedance-2.0またはwan-2.7に書き換えます。 - 回帰テスト: 代表的なプロンプトを使用して一連の処理を実行し、新旧の出力品質と遅延時間を比較します。

集約プラットフォーム経由での一括接続

from openai import OpenAI

# APIYI を経由してモデルを呼び出す

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

# モデルの切り替えを柔軟に行う

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

video_a = generate_video("製品広告:スマートスピーカーで音楽を再生", prefer="seedance")

video_b = generate_video("ブランドオープニング:光の粒子からロゴが浮かび上がる", prefer="wan")

この方法の利点は、1つの SDK、1つの API キー、1つの base_url で複数の代替モデルを呼び出せることです。9月24日の Sora-2 終了後も、model="sora-2" を model="seedance-2.0" などに変更するだけで済み、コードの大幅な修正は不要です。

移行チェックリスト(印刷して活用してください)

| フェーズ | チェック項目 | 予想工数 |

|---|---|---|

| 棚卸し | Sora-2 呼び出し箇所の全リストアップ | 0.5日 |

| 棚卸し | 代表的なプロンプト 50-100 件の整理 | 1日 |

| 接続 | 集約プラットフォームのアカウントとクォータ申請 | 0.5日 |

| 接続 | base_url とモデル名の書き換え | 1日 |

| テスト | 回帰テストの実行 | 2-3日 |

| テスト | プロダクト/デザインチームによる品質評価 | 1週間 |

| 段階移行 | トラフィックの 10%-30% を切り替え | 1週間 |

| 段階移行 | トラフィックを 100% に切り替え | — |

| 完了 | Sora-2 呼び出しコードの削除 | 0.5日 |

このスケジュールであれば、4-6週間で移行を完了でき、9月24日の期限までに十分な調整期間を確保できます。

🎯 移行のアドバイス: 9月まで待たずに今すぐテストを開始しましょう。集約プラットフォームでアカウントを開設し、既存の Sora-2 呼び出しコードを複製して

base_urlをhttps://api.apiyi.com/v1に変更してください。これにより、Sora-2 と代替モデルの比較実験を並行して行い、実際のビジネスデータに基づいて最終判断を下せます。

移行期間中のコスト管理アドバイス

動画生成はテキストモデルよりも単価が高いため、対策なしでは API 料金が跳ね上がる可能性があります。以下の戦略を検討してください:

- ダウングレード戦略: テスト段階では 720p / 5秒の動画を優先し、プロンプトの精度を確認してから 1080p / 15秒へ移行する。

- キャッシュの活用: 同一プロンプトや同一パラメータの要求にはハッシュキャッシュを適用し、重複生成を避ける。

- 集約課金: 複数のベンダーと個別に契約せず、集約プラットフォームで一括管理することで、最低利用料金の重複を回避する。

- バッチ生成: ベンダーのバッチモードを利用して夜間に生成を行うことで、30%-50% のコスト削減が可能。

- プロンプト最適化: より精度の高いプロンプトを作成して再生成回数を減らすことで、20%-40% のコストを節約できる。

よくある移行の落とし穴と解決策

| 落とし穴 | 原因 | 解決策 |

|---|---|---|

| 出力アスペクト比の不一致 | モデルごとのデフォルト値の違い | aspect_ratio パラメータを明示的に指定する |

| 動画時間の制限の違い | 秒数単位の課金体系 | 必要に応じて duration を指定する |

| 音声の欠落 | Sora-2 と新モデルのインターフェース差 | audio=True を明示的に有効化する |

| プロンプトのスタイル漂流 | モデルごとのプロンプトの癖 | モデルごとにプロンプトを個別に最適化する |

| コールバックの不一致 | 一部プラットフォームがポーリングのみ対応 | 集約プラットフォームの Webhook を統一して使用する |

title: Sora-2 API 終了に関する FAQ と移行ガイド

description: Sora-2 API の終了に伴うよくある質問(FAQ)と、SeeDance 2.0 や Wan 2.7 へのスムーズな移行戦略を解説します。APIYI を活用した最適な移行手順を確認しましょう。

Sora-2 API 終了に関する FAQ

Q1: Sora-2 API 終了後、すでに生成済みの動画は使えますか?

はい、使えます。動画ファイル自体は、一度ローカルや OSS にダウンロードしてしまえば API 終了の影響を受けません。 ただし、以前 OpenAI から返された video_url を直接参照している場合、API 終了後にこれらのリンクは無効になります。必ず 9 月 24 日までにすべての動画を自身のオブジェクトストレージへ転送してください。転送量が多い場合は、APIYI (apiyi.com) プラットフォームの動画エージェント機能を使用して一括ダウンロードすることをお勧めします。プラットフォーム側で自動的に並列処理のレート制限や失敗時の再試行が行われます。

Q2: OpenAI は今後 Sora-3 API をリリースする予定はありますか?

OpenAI 公式から Sora-3 に関するスケジュールは発表されていません。戦略的な観点から見ると、OpenAI は現在 GPT のメインラインとエージェント事業に計算リソースを優先的に投入しており、短期間で動画生成 API を再開する可能性は低いと考えられます。Wikipedia や Futurum Group の分析でも、Sora の商業化が期待に届かなかったことが今回の終了の主な原因であると指摘されています。「Sora-3 が戻ってくるかもしれない」という期待に業務計画を依存させるのは避け、SeeDance 2.0 または Wan 2.7 への移行を完了させることを強く推奨します。

Q3: SeeDance 2.0 と Wan 2.7 は中国大陸から安定して呼び出せますか?

はい、可能です。両モデルはそれぞれ ByteDance と Alibaba が運営しており、サービスノードが国内にあるため、海外経由で OpenAI を呼び出すよりもネットワークの安定性が大幅に優れています。以前 Sora-2 を利用するためにプロキシや海外サーバーが必要だった場合でも、これらのモデルに移行すればネットワーク構成を簡素化できます。 国内のコンプライアンスに準拠したアグリゲーションプラットフォームを通じて呼び出せば、安定性と請求書(発票)のコンプライアンス問題を一度に解決できます。

Q4: Sora API のリバースエンジニアリングは、移行期間の手段として有効ですか?

推奨しません。リバースエンジニアリングされた API は 2026 年第 1 四半期以降、安定性が著しく低下しており、9 月以降は公式のソースが消滅するため、リバースエンジニアリングされたインターフェースは完全に機能しなくなります。 廃止が確実な技術スタックに新しいコードを重ねることは、将来的にさらなる移行コストを招くだけです。最も経済的な方法は、直接 SeeDance 2.0 または Wan 2.7 へ移行することです。

Q5: 移行中に代替案の実際の効果をどのように評価すればよいですか?

3 次元の評価軸を設けることをお勧めします:視覚品質(主観評価)、プロンプトの忠実度(客観比較)、単価(コスト計算)です。具体的には、過去の Sora-2 の呼び出しから代表的なプロンプトを 50 件抽出し、SeeDance 2.0 と Wan 2.7 で再実行して、製品チームによるブラインドテストを行います。アグリゲーションプラットフォームを通じて実測比較を行い、課金やログを統一することで、業務に最適な選択を迅速に行うことができます。

Q6: アグリゲーションプラットフォームに移行すると、API インターフェースの仕様は変わりますか?

アグリゲーションプラットフォームは通常、OpenAI 互換プロトコルに対応しています。つまり、既存の Sora-2 呼び出しコードのフレームワークをほぼそのまま維持でき、base_url と model フィールドを変更するだけで済みます。動画生成に関連するリクエストパラメータ(プロンプト、duration、audio、resolution など)はモデル間で若干の差異がありますが、プラットフォーム側でパラメータの調整が行われます。詳細な差異についてはプラットフォームのドキュメントをご確認ください。

Q7: 今すぐ移行すべきか、9 月まで待つべきですか?

今すぐテストを開始し、6 月末までに移行を完了させることを強く推奨します。 理由は以下の 3 点です。

- 9 月 24 日に近づくほど、すべての Sora-2 ユーザーが移行に殺到し、アグリゲーションプラットフォームや代替モデルのリソースが逼迫するため。

- 早めに移行することで、2 つの代替案を十分に比較検討でき、直前での慌ただしい変更を避けられるため。

- 早期に移行する開発者は、より良い試用枠や価格設定を得られることが多いため。

Q8: SeeDance 2.0 と Wan 2.7 のどちらが中国語プロンプトに適していますか?

どちらも Sora-2 の中国語理解能力を大幅に上回っています。SeeDance 2.0 は中国語の感情表現や動作描写においてより繊細であり、Wan 2.7 は 5000 文字の長文プロンプトと Thinking Mode をサポートしているため、複雑な中国語のストーリーテリングにおいてより安定したパフォーマンスを発揮します。プロンプトが通常 200 字以内の場合は SeeDance 2.0 を、複雑な構成の描写が必要な場合は Wan 2.7 を選ぶのが良いでしょう。

Q9: 移行期間中にサービスを中断させないためにはどうすればよいですか?

最も安全な方法は**「デュアル書き込み・デュアル読み込み(Double Write/Read)」**です。切り替え期間中に Sora-2 とターゲットモデルの両方を呼び出し、両方の出力を保存して、フロントエンドで A/B テストのように切り替えます。これにより、ターゲットモデルに問題が発生した場合でも即座に Sora-2 へロールバックでき(9 月 24 日まで)、リスクを最小限に抑えられます。アグリゲーションプラットフォームは通常、model フィールドに基づいた動的ルーティングをサポートしているため、この構成を低コストで実現可能です。

まとめ: Sora-2 API 終了後のベストパス

OpenAI は Sora-2 API の終了日を 2026 年 9 月 24 日と確定させました。動画生成業務に残された猶予は半年を切っています。かつての「安価な移行手段」であったリバースエンジニアリング API は、リスク管理の強化と公式終了の二重の圧力により価値を失っており、そこに投資を続けることは移行コストを増大させるだけです。

幸いなことに、2026 年の動画生成分野は非常に健全なマルチ極体制を形成しています。SeeDance 2.0 は Artificial Analysis Elo 1269 というスコアで品質の頂点に立ち、マルチモーダル入力とネイティブな音動画生成に長けています。一方、Wan 2.7 は Thinking Mode と開始・終了フレームの制御により独自の差別化を図っており、精密な画面制御が必要なシーンに適しています。両方のソリューションは、中国語サポート、国内コンプライアンス、呼び出しの安定性の面で、終了予定の Sora-2 を大きく上回っています。

私たちの提案は、**「卵を一つのカゴに盛らない」**ことです。APIYI (apiyi.com) プラットフォームを通じて SeeDance 2.0 と Wan 2.7 の両方に接続し、具体的な業務リクエストに応じて動的にルーティングしてください。品質優先のコンテンツには SeeDance 2.0 を、精密な制御が必要な画面には Wan 2.7 を使用します。このデュアルモデル構成により、移行期間の安定性を確保し、9 月以降も既存の Sora-2 業務をシームレスに引き継ぐことができます。

最も重要な点は、**「今すぐ始めること」**です。8 月や 9 月になってから移行を開始すると、モデルの適合、プロンプトの調整、枠の申請など、すべてが今よりもはるかに困難になります。今週中に PoC テストを開始し、既存の Sora-2 呼び出しコードを複製して並行テストを行い、実際の業務データに基づいて最終決定を下すことを推奨します。これにより、9 月 24 日の終了時には少なくとも 2 ヶ月間安定稼働している代替ソリューションを確保できるはずです。

著者: APIYI Team — AI 大規模言語モデル API 中継および動画生成モデルアグリゲーションサービスに特化