Apa hal paling menyebalkan saat mengembangkan aplikasi AI akhir-akhir ini? Kemungkinan besar adalah skenario ini: Anda sudah merevisi petunjuk hingga versi ke-17, menjalankan beberapa pengujian dan merasa hasilnya sudah oke, tapi begitu diluncurkan, aplikasi Anda langsung tumbang oleh edge case (kasus ekstrem) yang tidak pernah terpikirkan sebelumnya. Inilah masalah yang ingin diselesaikan oleh OpenAI dalam artikel Cookbook Oktober 2025 berjudul "Building resilient prompts using an evaluation flywheel".

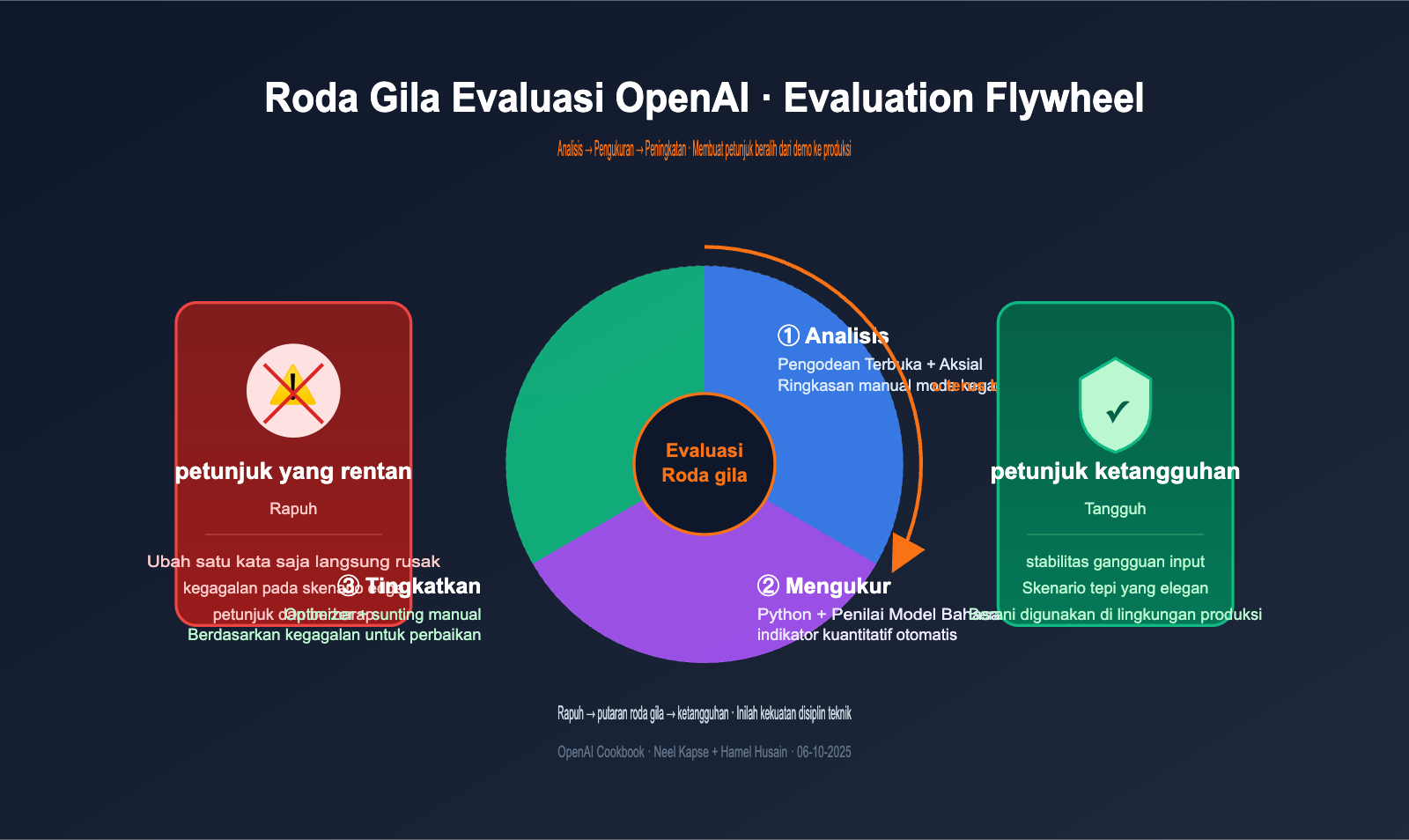

Insinyur OpenAI, Neel Kapse, bersama edukator ML ternama Hamel Husain, memperkenalkan konsep inti Evaluation Flywheel (Roda Gila Evaluasi). Mereka menggunakan metodologi matang dari riset kualitatif sosiologi untuk mengubah pengembangan aplikasi AI dari sekadar "prompt-and-pray" (mengubah petunjuk lalu berdoa) menjadi sebuah "disiplin teknik". Artikel ini akan mengulas kerangka kerja Roda Gila Evaluasi OpenAI dengan bahasa yang mudah dipahami agar Anda bisa menerapkannya di proyek AI Anda.

🎯 Panduan Cepat: Cookbook ini menggunakan contoh nyata "Asisten Sewa Apartemen" untuk mendemonstrasikan alur kerja lengkap, mulai dari analisis kegagalan, grader otomatis, hingga integrasi CI. API Evals dan alat Prompt Optimizer yang disebutkan merupakan kemampuan tingkat lanjut platform OpenAI. Anda bisa mengaksesnya melalui layanan proksi API seperti APIYI (apiyi.com). Pengembang di Indonesia bisa langsung mengikuti alur kerja di cookbook tersebut untuk menerapkannya.

Kasus Asisten Sewa Apartemen: Aplikasi AI Nyata yang Tumbang oleh Skenario Pinggiran

Contoh yang dipilih dalam cookbook sangat dekat dengan kehidupan sehari-hari: asisten AI yang menjawab pertanyaan penyewa, mulai dari ukuran apartemen, jadwal kunjungan, hingga pengenalan fasilitas. Sekilas terdengar seperti bot layanan pelanggan biasa, namun saat benar-benar digunakan di lingkungan produksi, kegagalannya sangat beragam.

Contoh kegagalan yang disebutkan dalam artikel sangat representatif dan mungkin pernah Anda alami:

| Jenis Kegagalan | Perwujudan Spesifik | Akibat |

|---|---|---|

| Kesalahan Penjadwalan | Menyarankan waktu kunjungan yang tidak tersedia | Penyewa datang sia-sia, tingkat keluhan melonjak |

| Kekacauan Status | Tidak membatalkan janji lama saat menjadwalkan ulang | Janji ganda di waktu yang sama, data prospek kacau |

| Tata Letak Rusak | Daftar fasilitas menumpuk menjadi satu blok teks | Pengalaman pengguna buruk, informasi sulit dibaca |

| Tautan Mati | Tautan denah unit 404 | Pengguna beralih ke kompetitor |

| Pergeseran Data | Jam operasional yang dijawab tidak sesuai data asli | Menyesatkan pengguna, risiko hukum |

Jika Anda pernah membuat aplikasi AI, Anda pasti tahu bahwa hal-hal ini bukan karena kita sengaja mengabaikannya saat menulis petunjuk, melainkan karena kita sama sekali tidak menyadari hal itu bisa terjadi. Tim Fractional dalam contoh Receipt Inspection merangkum fenomena ini dengan tepat: menjalankan beberapa happy path saja tidak akan pernah menemukan long tail bug di lingkungan produksi. Kita harus membangun siklus tertutup "pengumpulan kegagalan → induksi pola → pengukuran otomatis".

Siklus tertutup inilah yang menjadi inti masalah yang ingin diselesaikan oleh Roda Gila Evaluasi.

Definisi Inti Roda Evaluasi OpenAI: Disiplin Rekayasa untuk Menggantikan "Prompt-and-Pray"

Cookbook OpenAI memberikan definisi yang ringkas mengenai roda evaluasi: sebuah proses iteratif berkelanjutan yang menggantikan tebak-tebakan dengan disiplin rekayasa terstruktur. Proses ini terdiri dari tiga tahap yang berputar terus-menerus layaknya roda, di mana setiap putaran membuat sistem menjadi lebih tangguh dari sebelumnya.

Tanggung jawab ketiga tahap ini sangat jelas, masing-masing menyelesaikan masalah spesifik:

| Tahap | Masalah Utama | Aktivitas Utama | Output |

|---|---|---|---|

| Analyze (Analisis) | "Mengapa gagal?" | Membaca sampel gagal secara manual, menyimpulkan pola kegagalan | Daftar klasifikasi kegagalan + persentase |

| Measure (Pengukuran) | "Seberapa parah kegagalannya?" | Membuat grader, menjalankan dataset | Indikator kuantitatif + baseline |

| Improve (Perbaikan) | "Bagaimana cara memperbaikinya?" | Mengubah petunjuk, menjalankan evaluasi ulang | Versi baru + perbandingan indikator |

Banyak tim melewatkan tahap Analisis dan langsung melakukan evaluasi otomatis, yang merupakan alasan paling umum mengapa roda evaluasi gagal. Pengukuran otomatis tanpa analisis kualitatif hanyalah angan-angan, karena Anda tidak benar-benar tahu apa yang sedang diukur. Ini adalah wawasan paling inti dari cookbook ini, dan itulah yang membedakannya dari tutorial evaluasi biasa.

💡 Analogi: Roda evaluasi mirip dengan siklus PDCA yang sudah dikenal oleh manajer produk, namun diterapkan pada rekayasa petunjuk dengan metodologi yang konkret. Analisis berarti "mencari masalah", Pengukuran berarti "mengukur masalah", dan Perbaikan berarti "memperbaiki masalah". Ketiga langkah ini tidak boleh dilewatkan. Kami menyarankan saat menjalankan evaluasi menggunakan API OpenAI di apiyi.com, pastikan tahap Analisis dilakukan dengan matang sebelum memulai pengukuran.

Tahap Satu Roda Evaluasi OpenAI: Metode Pelabelan Dua Langkah untuk Analisis

Tahap Analisis adalah bagian yang paling sering diabaikan namun paling krusial dalam roda evaluasi. Cookbook ini menyajikan metode yang sangat profesional: Open Coding (Pengodean Terbuka) → Axial Coding (Pengodean Aksial). Metode ini berasal dari penelitian kualitatif sosiologi dan telah teruji selama puluhan tahun sebagai salah satu paradigma paling matang untuk menganalisis data teks tidak terstruktur.

Langkah pertama, Open Coding, pekerjaannya cukup sederhana: baca 50 sampel yang gagal, jangan buat asumsi klasifikasi apa pun, dan berikan label deskriptif untuk setiap kegagalan. Contohnya:

- "Merekomendasikan waktu kunjungan yang tidak tersedia"

- "Daftar fasilitas berupa tumpukan teks yang berantakan"

- "Penjadwalan ulang tidak membatalkan janji asli"

- "Menjawab ukuran yang bukan milik apartemen tersebut"

- "Tautan denah lantai tidak bisa dibuka"

Perhatikan bahwa pada langkah ini, Anda sengaja tidak mengejar kerapian klasifikasi. Anda hanya perlu mendeskripsikan apa yang Anda lihat secara jujur. Open Coding seperti menulis catatan bacaan; biarkan pikiran mengalir tanpa perlu kaku, karena pengelompokan yang terlalu dini akan membuat Anda kehilangan kepekaan terhadap pola-pola yang tidak terduga.

Langkah kedua, Axial Coding, baru mulai melakukan strukturisasi. Anda menggabungkan label-label yang tersebar dari langkah pertama menjadi kategori tingkat tinggi yang bermakna. Contoh kategori yang diberikan cookbook adalah:

- Masalah Penjadwalan Kunjungan (Gabungan: waktu salah, tidak dibatalkan, janji ganda) → 35% dari kegagalan

- Masalah Format (Gabungan: tata letak rusak, tautan mati) → 10% dari kegagalan

- Masalah Akurasi Data (Gabungan: jam operasional salah, ukuran salah) → sekian % dari kegagalan

Axial Coding seperti menyusun daftar isi, yang memungkinkan Anda melihat "peta medan" kegagalan. Angka 35% tersebut langsung memberi tahu Anda kategori mana yang harus diprioritaskan untuk diperbaiki karena memiliki ROI tertinggi.

| Metode Pelabelan | Tujuan | Pola Pikir | Output |

|---|---|---|---|

| Open Coding | Penemuan (Discovery) | Bebas, tanpa asumsi kategori | 50+ label deskriptif |

| Axial Coding | Strukturisasi (Structure) | Induktif, membangun kategori | 5-8 kategori kegagalan tingkat tinggi |

🔧 Saran Praktis: Bagi pengembang di Indonesia, saat melakukan tahap Analisis, Anda dapat menghubungkan log produksi melalui API proksi OpenAI (seperti apiyi.com) langsung ke antarmuka pelabelan Dataset di platform Evals API tanpa perlu membangun backend sendiri. Gunakan kolom pelabelan tipe Feedback untuk Open Coding dan tipe Label untuk Axial Coding. Alurnya akan sama persis dengan yang ada di cookbook.

Tahap Kedua Roda Evaluasi OpenAI: Pemilihan Dua Jenis Grader untuk Measure (Pengukuran)

Setelah tahap Analyze, Anda sudah tahu "seperti apa kegagalan itu". Kini di tahap Measure, Anda perlu mengubah kegagalan tersebut menjadi kode deteksi otomatis. Cookbook memberikan panduan pemilihan untuk dua jenis grader, yang sering kali membingungkan bagi para engineer.

| Jenis Grader | Skenario Penggunaan | Keunggulan | Kelemahan |

|---|---|---|---|

| Python Grader | Aturan deterministik (string, regex, validasi API) | Hasil stabil, nol halusinasi, nol biaya tambahan | Tidak bisa menilai dimensi subjektif |

| LLM Grader | Penilaian subjektif (estetika format, keselarasan semantik, kualitas penalaran) | Fleksibel, bisa menilai dimensi yang sulit dikodekan | Perlu penyelarasan SME, ada biaya token |

Sebagai contoh asisten apartemen, kedua jenis grader ini memiliki kegunaannya masing-masing:

- "Apakah waktu rekomendasi tersedia dalam jadwal asli?" → Python Grader (cek database atau API)

- "Apakah daftar fasilitas tersusun dengan rapi?" → LLM Grader (memberi skor 0-10)

- "Apakah tautan denah lantai dapat diakses?" → Python Grader (permintaan HEAD)

- "Apakah nada jawaban sesuai dengan identitas merek?" → LLM Grader (memberi skor berdasarkan rubrik)

Cookbook menekankan praktik rekayasa yang sangat penting: LLM Grader harus melalui penyelarasan SME (Subject Matter Expert/Pakar Bidang), jangan langsung percaya begitu saja pada skor GPT-4o. Metode spesifiknya adalah dengan membagi data menjadi train/validation/test, serta memeriksa dua indikator:

- High TPR (True Positive Rate): Mampu menangkap kegagalan yang sebenarnya.

- High TNR (True Negative Rate): Tidak salah menilai sampel yang sebenarnya sudah benar.

Jika hanya melihat akurasi, Anda bisa tertipu oleh baseline yang tinggi. Anda wajib menyelaraskan kedua indikator ini. Inilah pembeda antara LLM-as-Judge yang "terlihat berfungsi" dengan yang "benar-benar berfungsi".

📊 Alur Validasi: SME melabeli 100 sampel sebagai ground truth → LLM Grader memberi skor pada sampel yang sama → Hitung TPR/TNR → Sesuaikan petunjuk grader hingga kedua indikator tercapai. Alur ini didukung secara native di platform Evals APIYI, karena API Evals sepenuhnya kompatibel dengan protokol resmi OpenAI.

Tahap Ketiga Roda Evaluasi OpenAI: Eksperimen Jalur Ganda untuk Improve (Peningkatan)

Pada tahap ketiga, Anda akhirnya bisa mulai mengubah petunjuk. Cookbook memberikan dua jalur peningkatan paralel yang tidak saling meniadakan, melainkan saling melengkapi.

Jalur Satu: Optimasi Petunjuk Otomatis (Prompt Optimizer)

Platform OpenAI memiliki alat Prompt Optimizer bawaan. Anda cukup memberikan kumpulan sampel kegagalan dan petunjuk asli, maka alat ini akan mencoba serangkaian strategi penulisan ulang (menambahkan few-shot, chain-of-thought, menyesuaikan urutan instruksi, dll.) dan mengevaluasi efektivitasnya menggunakan grader Anda. Keunggulan jalur ini adalah praktis, cocok sebagai langkah eksplorasi awal.

Jalur Dua: Mengubah Petunjuk Secara Manual Berdasarkan Pola Kegagalan

Berdasarkan pola kegagalan yang dirangkum pada tahap Analyze, engineer dapat mengubah petunjuk secara manual dan terarah. Contohnya:

- Kesalahan penjadwalan kunjungan → Tambahkan langkah wajib "periksa jadwal ketersediaan" ke dalam petunjuk.

- Format berantakan → Gunakan tag XML untuk menentukan format output dengan jelas.

- Pembatalan janji tidak terproses → Tambahkan instruksi status mesin "batalkan dulu sebelum menjadwalkan ulang".

Keunggulan jalur manual adalah presisi. Anda tahu persis perubahan mana yang ditujukan untuk pola kegagalan yang mana, sehingga proses debug lebih terukur.

Setelah kedua jalur dijalankan, Anda akan memiliki N versi kandidat petunjuk. Langkah paling krusial di tahap Improve adalah: Jalankan semua versi pada dataset yang sama menggunakan kumpulan grader yang sama, lalu pilih versi dengan indikator terbaik. Langkah ini tidak boleh dilewati, karena manusia memiliki bias "merasa sudah benar" terhadap petunjuk yang mereka buat sendiri. Satu-satunya cara untuk mengoreksinya adalah dengan angka.

Setelah semua versi dijalankan, satu putaran roda selesai. Anda mungkin akan menemukan pola kegagalan baru (karena sistem sudah lebih baik, sehingga kasus-kasus edge yang lebih dalam mulai muncul), lalu kembali ke tahap Analyze untuk memulai putaran berikutnya. Inilah inti dari istilah "roda" — ia tidak akan berhenti, semakin cepat berputar, semakin tangguh sistem Anda.

Perbedaan Mendasar antara Resilient Prompt (Prompt Tangguh) dan Prompt Rapuh

Istilah resilient prompt (prompt tangguh) dalam judul artikel ini adalah konsep yang sangat krusial. Definisi yang diberikan oleh cookbook adalah: prompt yang mampu memberikan respons berkualitas tinggi pada semua kemungkinan input. Terdengar sederhana, namun sebenarnya ini adalah standar rekayasa yang sangat tinggi.

Perbedaan antara ketangguhan dan kerapuhan terlihat jelas dalam lima dimensi berikut:

| Dimensi Perbandingan | Prompt Rapuh | Prompt Tangguh |

|---|---|---|

| Ketahanan Input | Berubah satu kata, langsung rusak | Stabil meski ada parafrase sinonim |

| Skenario Tepi | Output aneh atau halusinasi | Degradasi elegan atau beralih ke manusia |

| Observabilitas | Kotak hitam, hanya bisa menebak | Ada grader lengkap untuk pelacakan |

| Penerimaan Produksi | Performa demo ≠ performa produksi | Lolos siklus evaluasi lengkap |

| Evolusi | Memperbaiki A merusak B | Perlindungan regresi otomatis |

Secara intuitif, insinyur sering merasa prompt "sudah cukup baik", namun saat masuk ke lingkungan produksi, masalah dengan probabilitas 0,1% akan muncul. Angka 0,1% terlihat kecil, tetapi dalam jutaan pemanggilan, itu berarti 1.000 insiden. Nilai rekayasa dari prompt tangguh bukan sekadar meningkatkan 80% menjadi 90%, melainkan meningkatkan 99% menjadi 99,9%.

🚀 Tips Integrasi: Untuk mendorong ketangguhan prompt hingga 99,9%, Anda harus mengotomatiskan siklus evaluasi. Ini memerlukan penggunaan API OpenAI Evals dan alat Prompt Optimizer yang stabil. Kami menyarankan penggunaan platform layanan proksi API OpenAI seperti apiyi.com, karena antarmukanya sinkron sepenuhnya dengan API resmi, dan node IDC domestik menjamin tugas evaluasi jangka panjang tidak terputus.

Integrasi CI/CD dan Pemantauan Produksi pada Roda Gila Evaluasi OpenAI

Langkah terakhir yang ditekankan oleh cookbook adalah: menjadikan roda gila evaluasi sebagai disiplin rekayasa sehari-hari. Implementasinya terbagi menjadi dua bagian:

Bagian Pertama: Integrasi CI/CD

Hubungkan rangkaian grader ke alur kerja CI, sehingga setiap kali ada perubahan prompt, evaluasi akan berjalan secara otomatis. Jika metrik mengalami penurunan melebihi ambang batas, PR akan otomatis diblokir dari penggabungan. Langkah ini mengubah "evaluasi" dari sekadar aktivitas riset menjadi aktivitas pengembangan rutin, yang merupakan tanda bahwa prompt benar-benar telah masuk ke tahap rekayasa.

| Tipe Ambang Batas CI | Pengaturan Rekomendasi | Penjelasan |

|---|---|---|

| Akurasi Keseluruhan | Penurunan ≤ 1% | Mencegah regresi keseluruhan |

| Grader Kunci | Penurunan ≤ 0,5% | Kontrol ketat untuk mode kegagalan prioritas tinggi |

| Deteksi Mode Baru | Peringatan, bukan blokir | Mendorong penemuan masalah baru |

| Latensi P95 | Pertumbuhan ≤ 10% | Mengontrol biaya dan pengalaman pengguna |

Bagian Kedua: Pemantauan Produksi

Selain CI, Anda juga perlu melakukan pengambilan sampel berkelanjutan di lingkungan produksi untuk menemukan "mode kegagalan liar" yang tidak ada dalam set CI. Mode baru ini akan ditambahkan kembali ke set evaluasi untuk memutar roda gila ke putaran berikutnya.

Caranya adalah dengan mengambil sampel log produksi dalam proporsi tertentu (misalnya 1%), menjalankan rangkaian grader yang sama, dan melakukan analisis manual saat ditemukan metrik yang tidak normal. Mode kegagalan baru yang ditemukan kemudian diproses melalui Open Coding → Axial Coding sebelum dimasukkan ke dalam set pengujian, dan roda gila pun berputar kembali.

Siklus ini memastikan sistem prompt Anda selalu menjadi lebih tangguh, alih-alih stagnan setelah dideploy. Inilah disiplin rekayasa inti yang ditinggalkan oleh cookbook bagi semua insinyur AI.

5 Pelajaran Praktis dari Flywheel Evaluasi OpenAI untuk Pengembang Lokal

Setelah membaca tuntas cookbook tersebut, saya merangkum 5 pelajaran yang memiliki panduan langsung bagi para pengembang di Indonesia:

Pelajaran 1: Mulailah dari Analisis, Jangan dari Pengukuran

Banyak tim langsung memasang grader dan mengejar metrik tanpa melakukan analisis manual terlebih dahulu. Akibatnya, grader tidak benar-benar mengukur pola kegagalan yang sebenarnya; angkanya terlihat bagus, tetapi pengguna tetap mengeluh. Jangan memulai evaluasi otomatis sebelum Anda melakukan Open Coding manual pada setidaknya 50 sampel.

Pelajaran 2: Jangan Libatkan GPT dalam Tahap Open Coding

Open Coding harus dilakukan oleh manusia, karena saat GPT melakukan mode induksi, ia akan mencemari label Anda dengan bias dari data pelatihannya sendiri. Waktu paling awal untuk melibatkan LLM adalah setelah Axial Coding, saat mengimplementasikan grader. Tahap "penemuan" dalam analisis adalah ranah eksklusif manusia.

Pelajaran 3: Prioritaskan Python Grader daripada LLM Grader

Selama bisa dicakup oleh aturan deterministik, jangan gunakan LLM Grader. Alasannya ada tiga: stabil, murah, dan tidak memerlukan penyelarasan SME (Subject Matter Expert). Simpan LLM Grader hanya untuk dimensi yang benar-benar subjektif dan tidak bisa dicakup oleh aturan.

Pelajaran 4: Hubungkan Metrik dengan Dampak Bisnis

Masalah penjadwalan sebesar 35%, masalah format 10%—persentase ini harus dikonversi menjadi "tingkat churn pengguna" atau "tingkat keluhan" agar memiliki nilai keputusan. Metrik itu sendiri tidak ada artinya, yang penting adalah konsekuensi bisnis yang diwakilinya.

Pelajaran 5: Jadikan Flywheel sebagai Otomatisasi, Bukan Proyek Sekali Jalan

ROI dari satu putaran flywheel mungkin tidak terlalu tinggi, tetapi bunga majemuk jangka panjangnya sangat signifikan. Jadikan grader sebagai tugas CI, buat pengambilan sampel produksi sebagai tugas terjadwal, dan buat deteksi pola baru sebagai peringatan otomatis agar flywheel dapat berputar 24 jam sehari.

Kerangka Kode Python untuk Replikasi Flywheel Evaluasi di Indonesia

Meskipun cookbook utamanya mendemonstrasikan alur kerja UI Platform OpenAI, pemanggilan terprogram melalui Evals API juga didukung. Kerangka kode Python di bawah ini menunjukkan cara memanggil Evals API untuk membuat grader dan menjalankan evaluasi, yang cocok bagi pengembang lokal yang menyukai alur kerja berbasis kode:

from openai import AsyncOpenAI

client = AsyncOpenAI(

base_url="https://vip.apiyi.com/v1", # Beralih ke gateway proksi OpenAI

api_key="Kunci APIYI Anda"

)

# 1. Membuat tugas evaluasi (mendefinisikan kumpulan grader)

eval_cfg = await client.evals.create(

name="leasing_assistant_v1",

data_source_config={

"type": "stored_completions",

"metadata": {"version": "v1"}

},

testing_criteria=[

{ # Contoh Python Grader

"type": "string_check",

"name": "tour_time_valid",

"input": "{{sample.output}}",

"operation": "eq",

"reference": "{{item.expected_time}}"

},

{ # Contoh LLM Grader

"type": "score_model",

"name": "format_quality",

"model": "gpt-4o",

"input": "{{sample.output}}",

"instructions": "Berikan skor 0-10 untuk kejelasan format output"

}

]

)

# 2. Menjalankan evaluasi (run)

run = await client.evals.runs.create(

eval_id=eval_cfg.id,

name="baseline_run",

data_source={"type": "completions"}

)

# 3. Mengambil hasil evaluasi

result = await client.evals.runs.retrieve(eval_id=eval_cfg.id, run_id=run.id)

print(f"Tingkat kelulusan: {result.report_url}")

Kode ini memiliki tiga poin kunci. Pertama adalah pengalihan base_url, baris ini menentukan apakah Anda dapat menjalankan tugas evaluasi jangka panjang secara stabil di Indonesia. Kedua adalah array testing_criteria, di mana Anda dapat mengonfigurasi semua grader ke dalam array dan menjalankannya sekaligus. Ketiga, Evals API bersifat asinkron; menjalankan evaluasi pada dataset besar mungkin memakan waktu beberapa menit hingga puluhan menit, jadi pastikan program Anda menangani proses tunggu dan percobaan ulang (retry) dengan baik.

FAQ OpenAI Evaluation Flywheel

Q1: Apa bedanya Evaluation Flywheel dengan platform evaluasi seperti LangSmith atau Weights & Biases?

Posisinya berbeda. LangSmith berfokus pada "instrumentasi evaluasi", sedangkan Evaluation Flywheel berfokus pada "metodologi evaluasi". Yang pertama memberi tahu Anda cara mengimplementasikannya, sementara yang kedua memberi tahu Anda cara berpikirnya. Keduanya bisa digunakan bersamaan; gunakan alat untuk menopang metodologinya.

Q2: Apakah 50 sampel gagal sudah cukup, atau terlalu sedikit?

Untuk tahap Open Coding, 50 sampel sudah cukup karena tujuannya adalah menemukan pola, bukan statistik yang menyeluruh. Jumlah sampel yang dibutuhkan pada tahap Measure bergantung pada tingkat kegagalan: jika tingkat kegagalannya 5%, Anda butuh 1.000 sampel untuk mendapatkan interval kepercayaan metrik yang stabil; jika tingkat kegagalannya 30%, maka 200 sampel sudah cukup.

Q3: Bisakah Prompt Optimizer otomatis menggantikan perubahan manual?

Tidak bisa. Alat otomatis unggul dalam optimasi lokal berdasarkan grader yang diketahui, tetapi tidak mahir memahami batasan bisnis (seperti aturan implisit "klien meminta setiap respons tidak lebih dari 80 karakter"). Menggabungkan perubahan manual dengan optimasi otomatis adalah praktik terbaik.

Q4: Apakah pemanggilan Evals API stabil jika dilakukan di dalam negeri?

Koneksi langsung ke OpenAI untuk tugas jangka panjang (evaluasi biasanya memakan waktu beberapa menit hingga beberapa jam) sering kali mengalami connection reset. Kami menyarankan penggunaan layanan proksi API seperti apiyi.com. Node IDC lokal telah dioptimalkan secara khusus untuk koneksi jangka panjang, sehingga tingkat kegagalan tugas evaluasi berkurang secara signifikan.

Q5: Untuk skala tim seperti apa Evaluation Flywheel ini cocok?

Cocok untuk siapa saja, mulai dari proyek 1 orang hingga tim beranggotakan 100 orang. Perbedaannya hanya pada frekuensi putaran flywheel. Proyek 1 orang mungkin berputar setiap dua minggu, sementara tim besar bisa melakukan iterasi harian atau bahkan per jam. Kuncinya adalah membangun disiplin, bukan skala.

Q6: Siapa itu Hamel Husain, dan mengapa cookbook ini begitu diperhatikan?

Hamel adalah pendidik yang sangat berpengaruh di komunitas pembelajaran mesin dan telah lama mendorong praktik terbaik rekayasa untuk aplikasi Model Bahasa Besar. Cookbook ini adalah pertama kalinya OpenAI secara sistematis memperkenalkan metodologi penelitian kualitatif (Open Coding, dll.) ke dalam rekayasa petunjuk, itulah sebabnya banyak dibahas di industri.

Kesimpulan

Nilai sebenarnya dari metodologi OpenAI Evaluation Flywheel adalah memberikan jawaban standar bagi komunitas insinyur AI mengenai "bagaimana cara melakukan rekayasa petunjuk yang profesional". Ini bukan sekadar alat, melainkan disiplin rekayasa yang mengubah pengembangan petunjuk dari "pekerjaan tangan berdasarkan perasaan" menjadi "praktik rekayasa yang terukur".

Dengan menanamkan tiga tahap Analyze → Measure → Improve ke dalam alur kerja pengembangan, aplikasi AI Anda akan naik kelas dari sekadar "demo yang terlihat meyakinkan" menjadi produk yang "siap untuk produksi dan memenuhi SLA". Di balik peningkatan ini terdapat siklus lengkap di mana kegagalan dikumpulkan secara sistematis, pola diringkas secara terstruktur, dan perbaikan divalidasi melalui pengukuran otomatis.

Jika Anda sedang mengerjakan aplikasi AI berbasis petunjuk, kami sangat menyarankan untuk membangun flywheel ini. Kami menyarankan penggunaan platform APIYI untuk memanggil Evals API dan Prompt Optimizer. Cukup ubah base_url dalam satu baris kode, dan Anda bisa menjalankan seluruh alur kerja cookbook tanpa perlu pusing memikirkan masalah stabilitas jaringan di dalam negeri.

Jadikan "flywheel" ini sebagai memori otot, dan mulai hari ini, petunjuk Anda akan menjadi lebih tangguh.

📌 Penulis: Tim APIYI — Mengikuti praktik rekayasa API multimodal dari OpenAI / Anthropic / Google dalam jangka panjang. Untuk panduan praktis cookbook lainnya dan panduan akses Evals API, kunjungi pusat dokumentasi apiyi.com.